開発ワークフローに適したAIモデルを選ぶことは、一見単純な問題のように思えるかもしれません。「どちらを使うべきか?」

しかし、その根底には、自社のシステムスタックにおいてAIをどのように構築・運用するかという、より大きな決断が潜んでいます。

チームがデプロイやカスタムをより細かく制御できる、Mistral AIのオープンウェイトモデルであるMixtralを選ぶべきでしょうか?それとも、強力な独自モデルと使いやすいエコシステムで知られる、OpenAIの広く利用されているAIアシスタントであるChatGPTを選ぶべきでしょうか?

その選択は、インフラに対する制御の度合いから、AI機能をどれほど迅速にリリースできるかまで、すべてに影響を及ぼします。

本ガイドでは、MixtralとChatGPTをアーキテクチャ、パフォーマンス、カスタマイズ性、コスト、プライバシーの観点から詳細に比較し、チームに最適なモデルを選定できるよう解説します。また、ClickUpのようなオールインワンツールを活用して、ワークフロー内で複数のモデルを並行して使用することで、「どちらか一方」という二者択一の議論を回避している開発者がどれほど多いかについてもご紹介します。⚒️

準備はいいですか?それでは、詳しく見ていきましょう。

MixtralとChatGPTの比較概要

MixtralとChatGPTは開発者にとって優れたツールですが、それぞれが異なる分野で真価を発揮します。詳細に入る前に、まず両者の機能を簡単に要約します:

| 機能/カテゴリ | Mixtral | ChatGPT | ClickUp Brain |

|---|---|---|---|

| モデルアーキテクチャ | オープンウェイトのミクスチャー・オブ・エキスパート(8×70億);スパース活性化により、トークンごとにアクティブなパラメーターは一部のみとなり、推論コストを削減 | 独自のトランスフォーマーアーキテクチャ。推論時にすべてのパラメーターがアクティブになる高密度モデル | 統合ワークスペース内で、Claude、GPT、Gemini、DeepSeekを含む複数のLLMにアクセス可能 |

| オープンソースとしての利用可能性 | Apache 2.0ライセンスに基づき、重みデータは完全に公開されています。自由にダウンロードおよび修正が可能です。 | 閉じたソースのため、モデルの重みやアーキテクチャの詳細にはアクセスできません | 複数のモデルプロバイダーにアクセスできるSaaSプラットフォーム |

| コンテキストウィンドウ | 最大32Kトークンまでネイティブ対応。一部のデプロイメントでは拡張コンテキストも利用可能です | モデルバージョンに応じて8K~128Kトークン(GPT-4 Turboは128Kをサポート) | タスク、ドキュメント、会話から自動的に情報を取得する、ワークスペースを意識したコンテキスト |

| セルフホスティングオプション | はい。ローカル環境またはプライベートクラウドインフラ上で実行可能です。 | いいえ。OpenAIのサーバー経由でAPIのみ利用可能です。 | クラウドベースで、企業レベルのセキュリティ対策が施されています |

| 微調整のサポート | 完全な微調整およびLoRA/QLoRAアダプターをサポートしています | 一部のモデルでは、API経由で限定的な微調整が可能です | 基盤モデルを採用しており、カスタマイズはプロンプトとワークスペースのコンテキストを通じて行われます |

| チームサイズ | 個人開発者からMLOpsキャパシティを持つ大規模エンジニアリングチームまで | APIベースのワークフローに慣れているあらゆるサイズのチーム | あらゆる部門の、あらゆるサイズのチーム |

| 価格 | 無料(セルフホスティングの場合)。APIの費用はプロバイダーによって異なります。 | サブスクリプションおよび従量制のAPI料金体系 | 「Free Foreverプラン」をご利用いただけます |

ClickUpにおけるソフトウェアのレビュー方法

当社の編集チームは、透明性が高く、調査に基づいたベンダー中立のプロセスを採用しているため、当社の推奨事項は実際の製品価値に基づいているとご信頼いただけます。

ClickUpにおけるソフトウェアのレビュー方法について、詳細な概要をご紹介します。

Mixtralの概要

Mixtralは、Mistral AIが開発したオープンウェイトモデルであり、mixture-of-experts (MoE)アーキテクチャを基盤としています。これは、8人の専門コンサルタントからなるチームのようなものと考えてください。全員がすべてのタスクに取り組むのではなく、モデルは必要な専門家だけを呼び出します。

Mixtralは、各プロンプトに対して最も関連性の高い2人の「エキスパート」を選択して回答を生成し、残りのエキスパートは待機状態にします。その結果、はるかに大規模なモデルと同等のパフォーマンスを実現しながら、リクエストあたりの計算リソースを大幅に削減できます。

Mixtralのメリット

- Apache 2.0 ライセンスに基づくオープンウェイト: モデルの重みデータに完全にアクセスできるため、制限的なライセンスに縛られることなく、自社でのホスティング、微調整、および変更が可能です。これは、チームが厳格な知的財産(IP)や コンプライアンス要件の下で仕事をしている場合に、大きなメリットとなります。

- Mixture-of-expertsの効率性: パラメーター数は470億にも上りますが、トークンごとに約130億しかアクティブ化されないため、より少ない計算コストと高速な応答で、はるかに大規模なモデルと同等の性能を得ることができます

- 優れた多言語対応能力: さまざまなプログラミング言語や自然言語のコードやテキストを効果的に処理します

- セルフホスティングの柔軟性: 自社のインフラ上で実行できるため、データを完全に管理でき、利用量が増加してもコストの予測が容易になります

- 活発なオープンソースコミュニティ: 拡大を続けるツールエコシステム、コミュニティによって微調整されたモデルバリエーション、そして役立つデプロイガイドを活用できます

Mixtralのデメリット

- インフラのオーバーヘッド: セルフホスティングはプラグアンドプレイではありません。MLOpsの専門知識、専用のGPUリソース、そして継続的なメンテナンスが必要です。

- エコシステムの規模が小さい: ChatGPTの巨大で成熟したエコシステムに比べ、あらかじめ用意された統合機能、プラグイン、サードパーティ製ツールの数が少ない

- プロバイダーによって品質にばらつきあり: サードパーティのAPIを利用する場合、価格設定、レートリミット、信頼性にばらつきが見られる可能性があります

- 会話タスクへの対応は未熟: コード生成には優れていますが、チャットに特化した大規模な微調整を経ているChatGPTと比較すると、会話能力の洗練度がやや劣ると感じるかもしれません。

Mixtralの価格(100万トークンあたりのコスト)

- Free

- 入力: 100万トークンあたり0.70ドル

- 出力: 100万トークンあたり0.70ドル

ChatGPTの概要

ChatGPTはOpenAIが提供する主力対話型AIであり、GPT-4、GPT-4 Turbo、GPT-4oなどのAPIを通じて開発者が利用できます。その最大の強みは、人間によるフィードバックを用いた強化学習(RLHF)を徹底的に行っている点にあります。このプロセスでは、人間のレビュー担当者が応答を評価・採点することで、モデルの有用性、正確性、安全性を高めています。

開発者にとって、これは特に会話型のユースケースにおいて、得られる応答が通常、最初から洗練され、よく構成されていることを意味します。

ChatGPTのメリット

- 成熟した洗練された応答: RLHFのおかげで、ChatGPTは最小限のプロンプトでも、常に有用で適切なコメント付きのコードや明確なドキュメントを生成します

- 充実したエコシステム: 数千もの拡張機能、統合機能、ツールに対応しており、主要なIDEやフレームワークでも強力にサポートされています

- 信頼性の高いAPIインフラストラクチャ: 開発者との連携に注力し、十分な資金力を有する組織が提供する、企業レベルの稼働率とサポートの恩恵を受けられます

- マルチモーダル機能: 最新のGPT-4モデルは画像、音声、ファイルを処理できるため、例えばスクリーンショットからUIを分析したり、さまざまな開発ワークフローを横断して作業したりする場合に最適です。

- 導入のハードルが低い: インフラのセットアップは不要です。APIキーさえあれば、すぐに開発を開始できます。

ChatGPTのデメリット

- 閉じたソースかつプロプライエタリ: モデルの重みデータにアクセスできないため、セルフホスティングや自由な微調整、動作の詳細な監査を行うことができません

- データプライバシーに関する懸念: すべてのプロンプトはOpenAIのサーバー上で処理されます。コンプライアンス規則がある規制産業や、機密性の高いコードベースを扱う場合、これが問題となる可能性があります。

- 大規模利用時のコスト予測の難しさ: トラフィックの多いアプリケーションを運用している場合、トークンベースの利用方式では使用量が増えるほどコストが急速に膨らむ可能性があるため、注意が必要です。

- ベンダーロックインのリスク: 単一のプロバイダーにすべてを依存すると、ベンダーロックインのリスクが生じます。プロバイダー側のAPI変更やサービス更新により、ワークフローが中断される可能性があります

ChatGPTの料金

- Free

- Go: ユーザーあたり月額8ドル

- さらに: ユーザーあたり月額20ドル

- プロプラン: ユーザーあたり月額200ドル

MixtralとChatGPT:主な機能の比較

MixtralとChatGPTが、皆様にとって重要な機能において実際にどのように比較されるのか、詳しく見ていきましょう。

機能その1:コーディングおよびコード生成のベンチマーク

ChatGPT、特にGPT-4は、思慮深いチームメイトのようにコードを記述する傾向があります。基本的なプロンプトを使用した場合でも、詳細なコードを生成し、コメントを追加し、エラー処理も最初から適切に行います。そのため、本番環境向けのコード生成に最適です。

一方、Mixtralは同等のパフォーマンスを発揮できますが、デフォルトでより簡潔な出力を生成するため、同等の完成度を得るにはプロンプトエンジニアリングに追加の時間を費やす必要があります。

基本的な定型コードに関しては、どちらのモデルも十分に機能します。しかし、処理が複雑になると、ChatGPTのより明確で洗練された出力により、優位に立つことがよくあります。

🏆 結論: より洗練され、本番環境ですぐに使えるコードという点で、ChatGPTが優れています。

💡 プロのヒント:単にモデルを比較するだけでなく、実際のワークフローの中で比較しましょう。MixtralとChatGPTの出力が、単なる孤立したプロンプトではなく、実際の開発プロセスにどのように統合されるかをテストしてください。そうすることで時間を節約でき、後でタブを切り替える手間も省けます。

機能 #2: コンテキストウィンドウと長テキスト処理

大規模で複雑なコードベースを扱う際、AIアシスタントが3つ前のプロンプトの内容を忘れてしまっては、作業が困難になります。そのため、モデルが一度に記憶できるテキスト量である「コンテキストウィンドウ」は、開発者にとって非常に重要です。両ツールはこの点について異なるアプローチをとっています:

- Mixtral-8x7B: 32,000トークンのネイティブコンテキストウィンドウを備えており、大容量のファイルや長時間の会話にも十分対応可能です

- ChatGPT: 8,000~128,000トークンに対応しています。GPT-4 Turboの巨大な128Kウィンドウを利用すれば、理論上は小さなコードリポジトリを1つのプロンプトで入力することも可能です。ただし、ウィンドウが大きくなるほどコストが高くなる可能性がある点に留意してください。

🏆 結論: 膨大なコードベースにも対応できる巨大なキャパシティを持つGPT-4 Turboが優位ですが、Mixtralも32Kトークンの処理範囲内では非常に高いパフォーマンスを発揮するため、ほとんどのプロジェクトにおいて効率的です。

📮 ClickUpインサイト:アンケート回答者のわずか12%が、生産性スイートに組み込まれたAI機能を利用しています。この低い導入率は、現在の実装には、ユーザーが慣れ親しんだスタンドアロンの対話型プラットフォームから移行したくなるような、シームレスで文脈に応じた統合が欠けている可能性を示唆しています。

例えば、ユーザーからのプレーンテキストのプロンプトに基づいて、AIが自動化ワークフローを実行できるでしょうか?ClickUp Brainなら可能です!このAIは、チャットスレッドの要約、テキストの下書きや推敲、ワークスペースからの情報取得、画像生成など、ClickUpのあらゆる機能に深く統合されています!3つ以上のアプリを、仕事のためのオールインワンアプリであるClickUpに置き換えた、ClickUpユーザーの40%に加わりましょう!

機能 #3: API アクセスと開発者向け統合

AIモデルの品質は、ワークフローへの統合が煩雑で時間のかかるプロセスであるならば、意味をなしません。不十分なドキュメント、SDKの不足、信頼性の低いAPIは、プロジェクトが開始される前に頓挫させてしまう可能性があります。

OpenAIは、充実したドキュメント付きのAPI、主要言語向けのSDK、機能呼び出しなどの高度な機能を備え、洗練された開発者向け統合環境を提供しています。

一方、MixtralのAPIアクセスは、Mistral独自のプラットフォーム、Together AI、Fireworksなど、複数のプロバイダーに分散しており、それぞれ独自のドキュメントと信頼性を持っています。これは当然ながら選択肢の幅を広げますが、同時に異なるドキュメント、信頼性、セットアップを管理しなければならないことを意味し、一貫性の欠如を招く可能性があります。

🏆 結論: 引き分け。OpenAIのAPIは迅速な統合を実現する優れた開発者体験を提供する一方、Mixtralは特定のインフラ要件を持つチームに対して、プロバイダー選択の柔軟性をより高く提供するためです。

機能 #4: カスタムとセルフホスティングのオプション

既製のAIモデルも優れていますが、チーム独自のコーディングスタイルや独自のコードベース、あるいは専門的な分野がある場合、カスタマイズは大きな違いをもたらします。特定のニーズに合わせてモデルを調整できない場合、多くの価値を逃すことになります。

これがMixtralの最大の強みです。重みが公開されているため、以下のことが可能です:

- 微調整: 独自のコードでモデルを学習させ、特定の分野のエキスパートにしましょう

- アダプターを活用する: LoRAやQLoRAといった効率的な手法を用いて、モデルを一から再学習させることなくカスタムします

- モデルを量子化: より小型で低コストなハードウェアへのデプロイに向けて、モデルサイズを縮小します

一方、ChatGPTはAPIを通じて限定的なカスタムは可能ですが、基盤となるモデルの重みにはアクセスできません。基本的には、OpenAIが許可する範囲内に制限されます。

🏆 結論: カスタム性とセルフホスティングの面でMixtralがトップの選択肢となり、特殊なニーズや厳格なデータ要件を持つチームにとって最適な選択肢となります。

機能 #5:開発チームのためのプライバシーとデータセキュリティ

多くのエンジニアリングチームにとって、独自のコードや機密性の高い顧客データをサードパーティのAPIに送信することは、そもそも選択肢になり得ません。

Mixtralのセルフホスティングオプションでは、プロンプトやコードが自社のインフラから外部に流出することはないため、データの完全な管理が可能となり、強固なプライバシーとデータセキュリティの重要な原則が守られます。これは、金融や医療など規制の厳しい業界のチームにとって理想的です。

ChatGPT企業はSOC 2やHIPAAへの準拠といった堅牢なコンプライアンス機能も提供していますが、それでもデータの取り扱いは第三者に委ねる必要があります。

🏆 結論: セルフホスティング機能により最強のプライバシー保証が得られるため、Mixtralが優れています。

MixtralとChatGPT、どちらを選ぶべきか?

一言で言えば、それはニーズ次第です。判断の指針となる簡単なフレームワークをご紹介します:

- Mixtralを選ぶべき場合: チームにMLOpsの専門知識がある場合、特定のタスク向けにモデルを微調整する必要がある場合、または厳格なデータプライバシー規則によりセルフホスティングが必須である場合

- 次のような場合はChatGPTを選択してください: チームが迅速な導入、洗練された初期設定時の体験、そして豊富なツールエコシステムを重視している場合

より良い答えは、どちらか一方だけを選ばなければならないわけではないということです。多くのチームはハイブリッドなアプローチを採用しており、一般的なサポートにはChatGPTを、機密性の高い社内タスクには自社でホストするMixtralを活用しています。

さらに、ClickUpのようなツールを活用すれば、単一の統合AIワークスペース内で両方のモデルを使用し、その出力をタスク、ドキュメント、プロジェクトに直接接続させることで、真の生産性向上を実現できます。これにより、どのモデルを使用しても、AIで生成した知見が即座に実際の業務の一部となります。

ClickUpのご紹介:AI開発ワークフローでChatGPTとMixtralを活用する最適な方法

MixtralとChatGPTのどちらを選ぶかは、通常、トレードオフの問題に帰着します。

Mixtralは、学習データの規模に関する柔軟性とデプロイメントの制御性を提供します。ChatGPTは、高度に洗練された出力と優れた会話調整機能を提供します。

しかし、開発者として直面するであろう実用的な問題があります。それは、どちらのツールも通常、実際の開発ワークフローの外側に存在しているという点です。

1つのタブでAIモデルにプロンプトを入力し、結果をコピーして別の場所に貼り付け、手作業でタスクやドキュメント、アクションアイテムに変換します。

時間が経つにつれて、これが「ツールの乱立」を引き起こします。アイデア生成にはAIを使い、仕事管理には別のツール、ドキュメント作成にはさらに別のツール、そして自動化にはまた別のツールを使うことになるのです。

ClickUpはこれとは異なるアプローチをとっています。

ClickUpでは、AIモデルを独立したアシスタントとして扱うのではなく、コードに関する議論、ドキュメント、タスク、自動化機能がすでに存在するワークスペースに直接組み込んでいます。

つまり、AIの出力は単なるアイデアの生成にとどまらず、あなたやチームがやっている仕事に即座に組み込まれるのです。

その仕事の仕組みは以下の通りです。

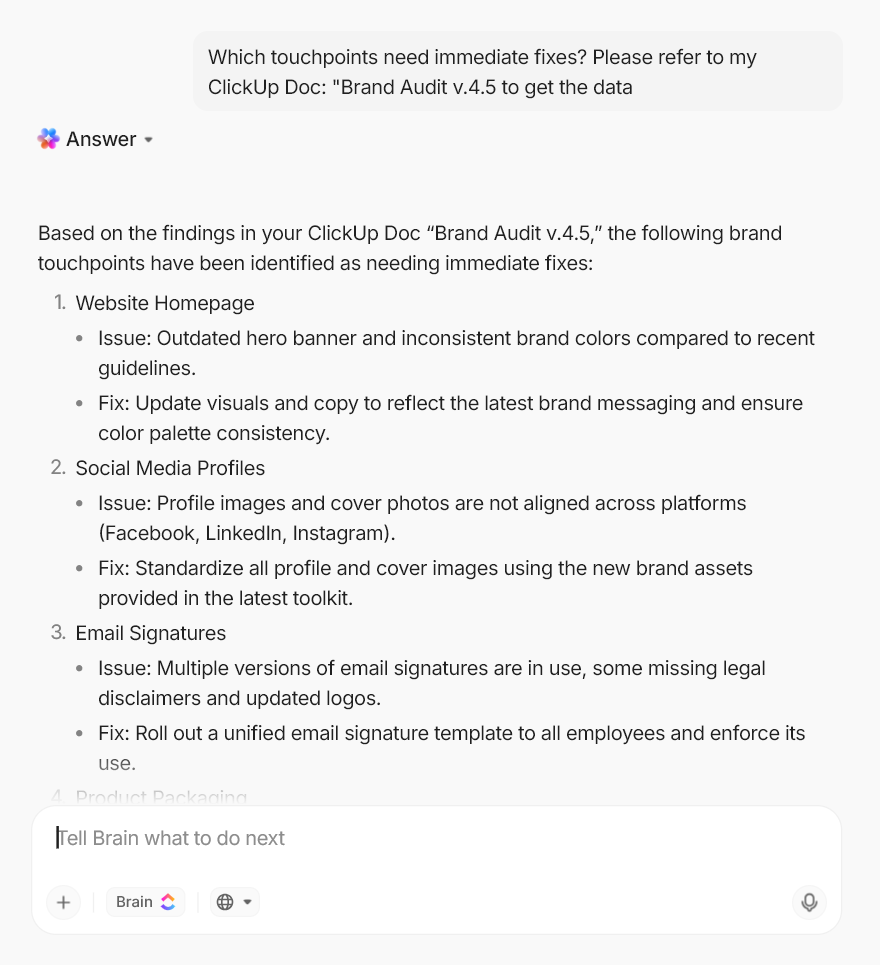

ClickUpの最大の強み:1つのワークスペースで複数のAIモデルを利用可能

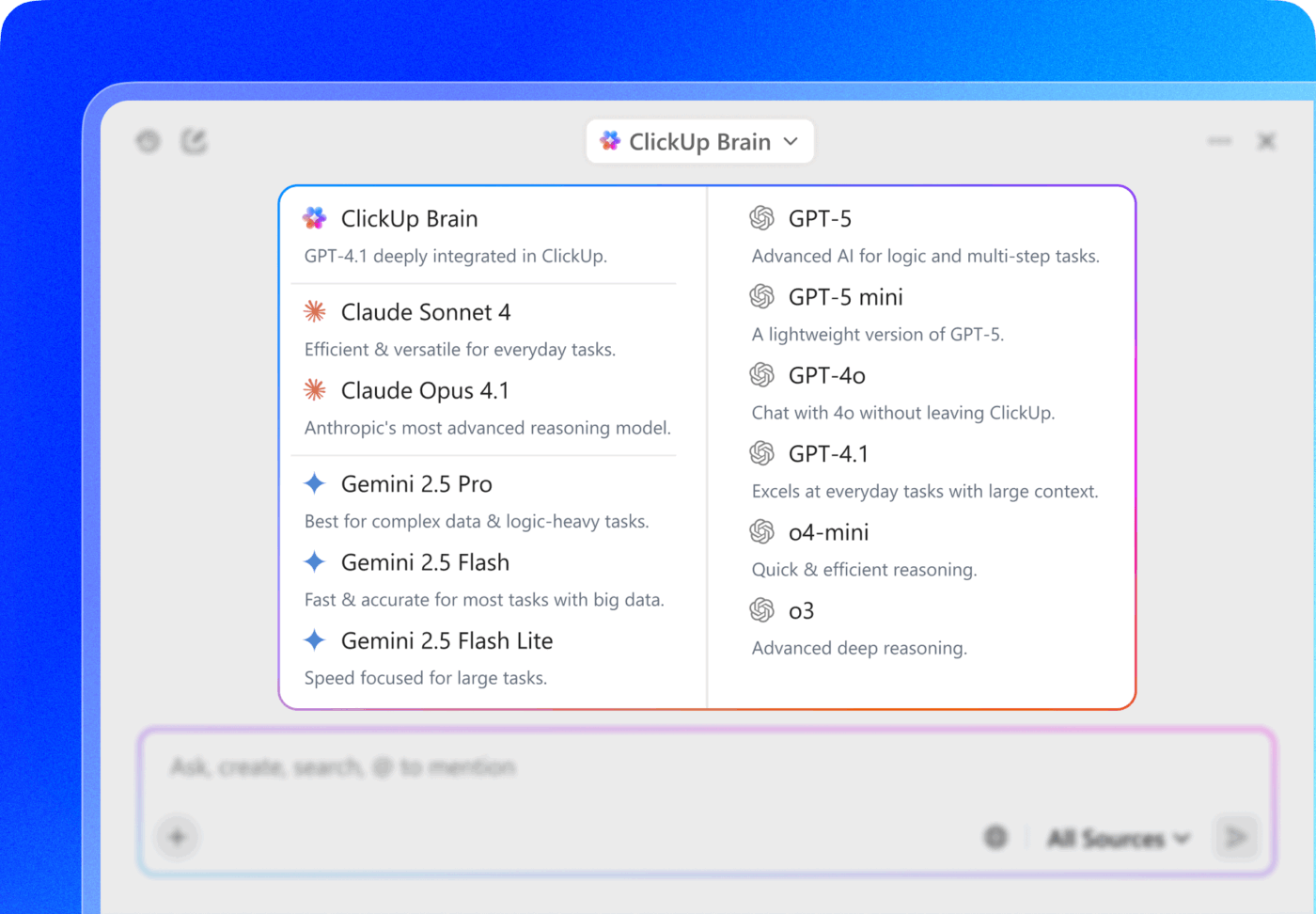

ClickUp Brainを使えば、単一のAIモデルに縛られることはありません。ワークスペース内でChatGPT、Gemini、Claudeなどの主要なモデルに直接アクセスでき、タスクに応じて切り替えることが可能です。

さらに、Zapierを介した連携により、Mixtralのようなモデルをワークスペースに接続できるため、チームでオープンウェイトモデルを試しながら、仕事を一箇所に整理して管理することができます。

開発者であるあなたにとって、この柔軟性は重要です。

ChatGPTを構造化されたドキュメント作成に、別のツールをアーキテクチャ案のブレインストーミングに、そしてMixtralをコードレビューの要約に使用する場合もあるでしょう。そのため、複数のAIツールを開くためにタブを切り替える代わりに、プロジェクトデータが保存されている場所ですぐに回答を生成できます。

💡 プロのヒント:ClickUp Brain内で、MixtralとChatGPTの両方に同じプロンプトを入力してみてください。出力結果を比較し、本番環境での使用に適している方を判断して、その結果をタスクにリンクさせましょう。精度が重要な重要な機能に最適です。

ClickUpの利点その2:タスクと並行してAIコーディングエージェントを活用する

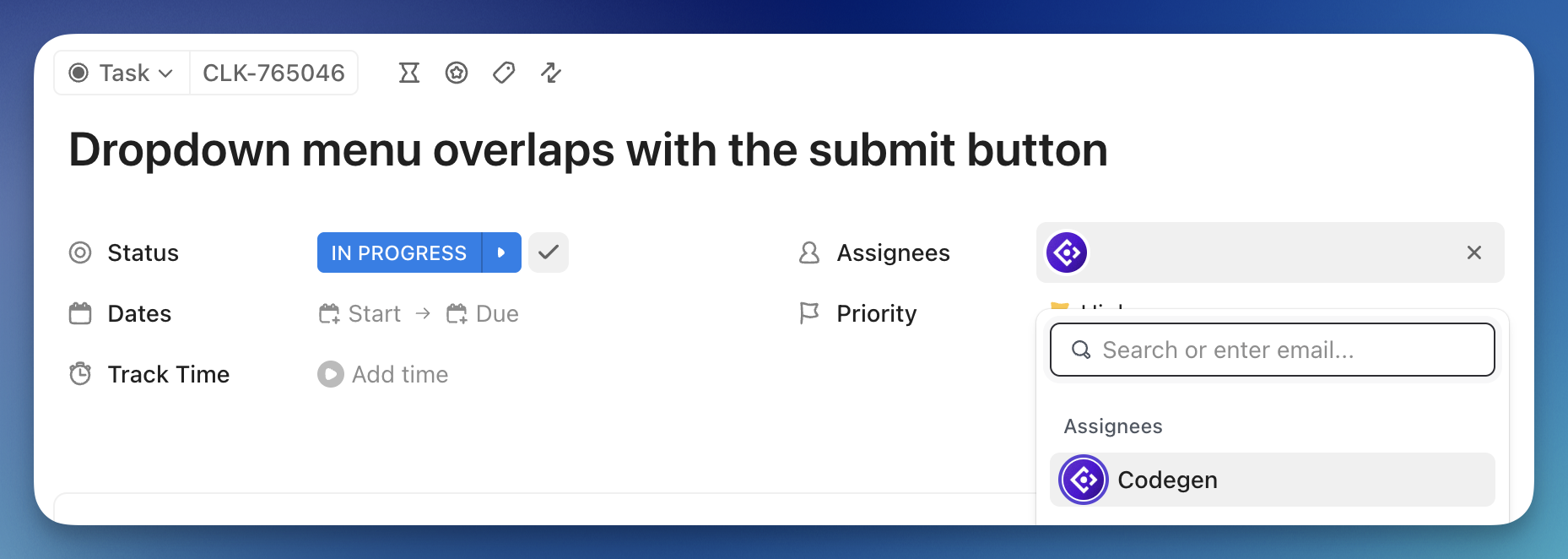

開発者であれば、すでにCursor AIエージェントやCodegen AIエージェントといったツールを使って、コードの生成、機能のレビュー、ロジックのリファクタリングを行っているかもしれません。

ClickUpを使えば、開発作業の進捗を追跡しているのと同じ環境に、それらのワークフローを組み込むことができます。

CursorやCodegen AIのエージェントを、まるでチームメイトを呼ぶように@メンションしたり、ClickUpタスクを割り当てたりできます。エージェントはバックグラウンドで作業を行うため、ユーザーはより重要なタスクに集中できます。タスクが完了すると、エージェントから自動的に通知が届きます。

その時点で、修正を実装するか、別の開発者に割り当てるか、あるいは次のスプリントに持ち越すかを決定します。

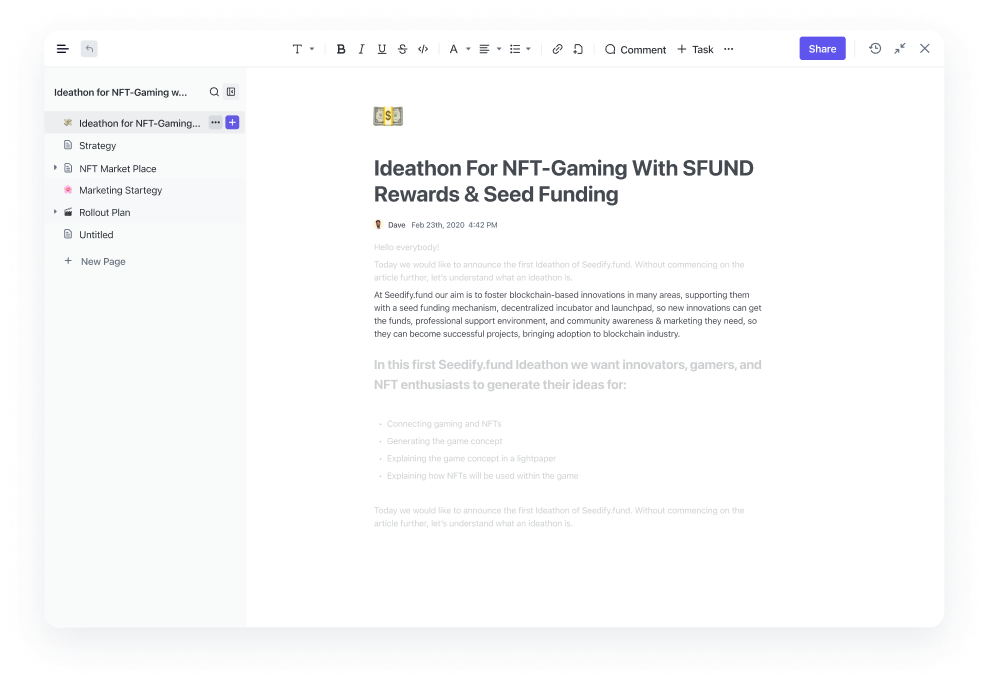

ClickUpの利点その3:ClickUp Docsによるドキュメントの一元管理

開発プロセスには通常、APIリファレンス、アーキテクチャに関するメモ、オンボーディングガイド、トラブルシューティングのドキュメントなど、多くのドキュメント作成が伴います。

一元化されたシステムがないと、それらのリソースはGoogle ドキュメント、社内wiki、あるいはNotionのページなどに散らばってしまうことになります。

ClickUp Docsを使えば、技術ドキュメントをすべて、それらがサポートするタスクやプロジェクトのすぐ隣に、ClickUpタスク内に保存できます。

新しい認証システムのドキュメントを作成する場合、ClickUp Docs内で技術仕様書を作成し、それをClickUpタスク内の実装タスクにリンクさせ、機能の進化に合わせてドキュメントを更新することができます。

また、プロジェクト全体を通じてタスクがどのように進捗しているかについて洞察が必要な場合は、ワークスペースに組み込まれたインテリジェンスレイヤー「ClickUp Brain」に質問するだけで、プロジェクトデータの完全なコンテキストを含め、それらのドキュメントから直接回答を取得できます。

つまり、ドキュメントは単なるナレッジベースに留まるのではなく、プロジェクトの動的なワークフローの一部となるのです。

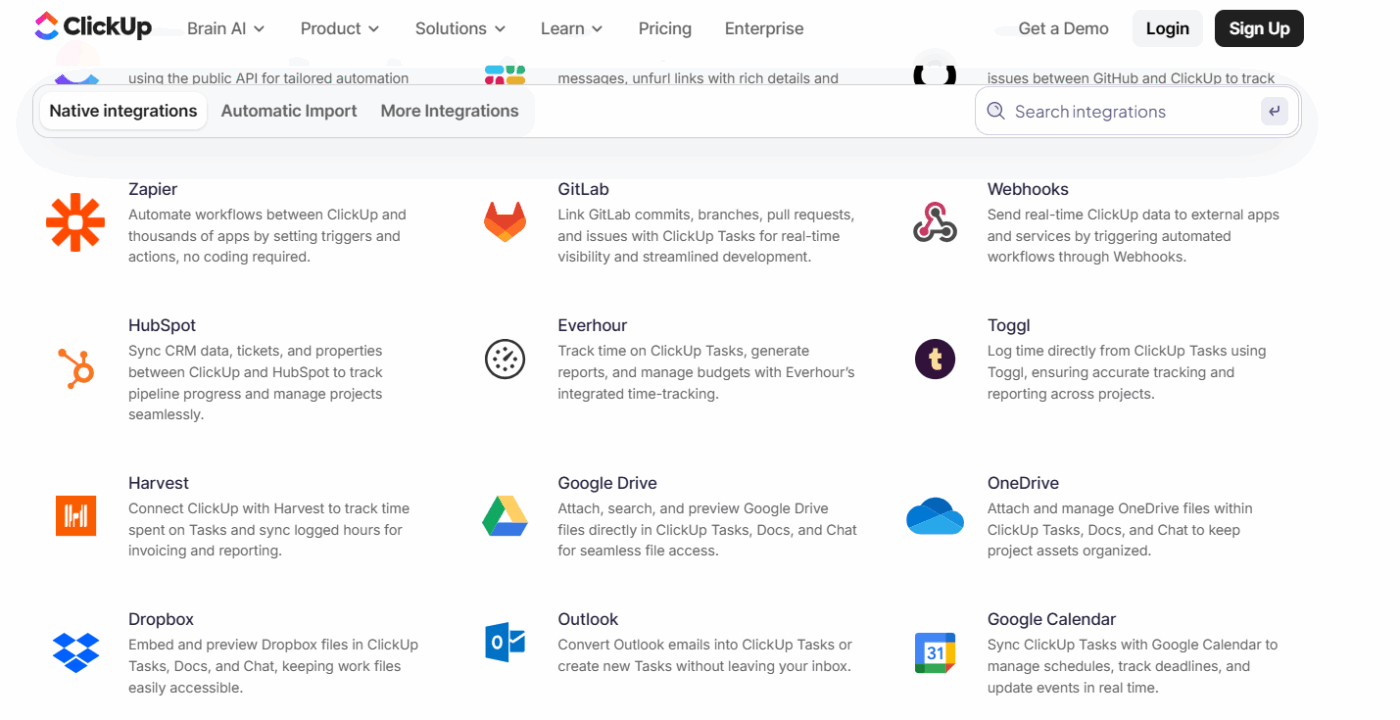

ClickUpの利点その4:外部の開発者ツールをClickUpと接続する

ClickUpの連携機能により、GitHub、Slack、Figma、その他の連携アプリなど、外部プラットフォームとの接続を維持し、過去の知見や最新情報をワークスペースに簡単に取り込むことができます。

GitHubのドキュメントやコードリファレンスを関連タスクに直接リンクできます。Slackでの更新情報やディスカッションを、実行可能なタスクに変換できます。他のツールにあるファイルやプロジェクト資産も、同じワークスペースに統合できます。

プロのヒント: ClickUp Chatを使えば、Slackとプロジェクトタスクの間を行き来する手間を完全に省けます。チームのディスカッションや開発ワークフローをすべてClickUp内で完結させましょう。

ワークスペースを離れることなく、チャットメッセージから即座にチームメンバーをタグ付けし、タスクに直接コメントを割り当てられるため、会話の中で重要な情報が埋もれてしまうことはありません。すべての更新情報、決定事項、フォローアップがプロジェクトの文脈に沿って管理されるため、コラボレーションがより迅速になり、混乱も大幅に軽減されます。

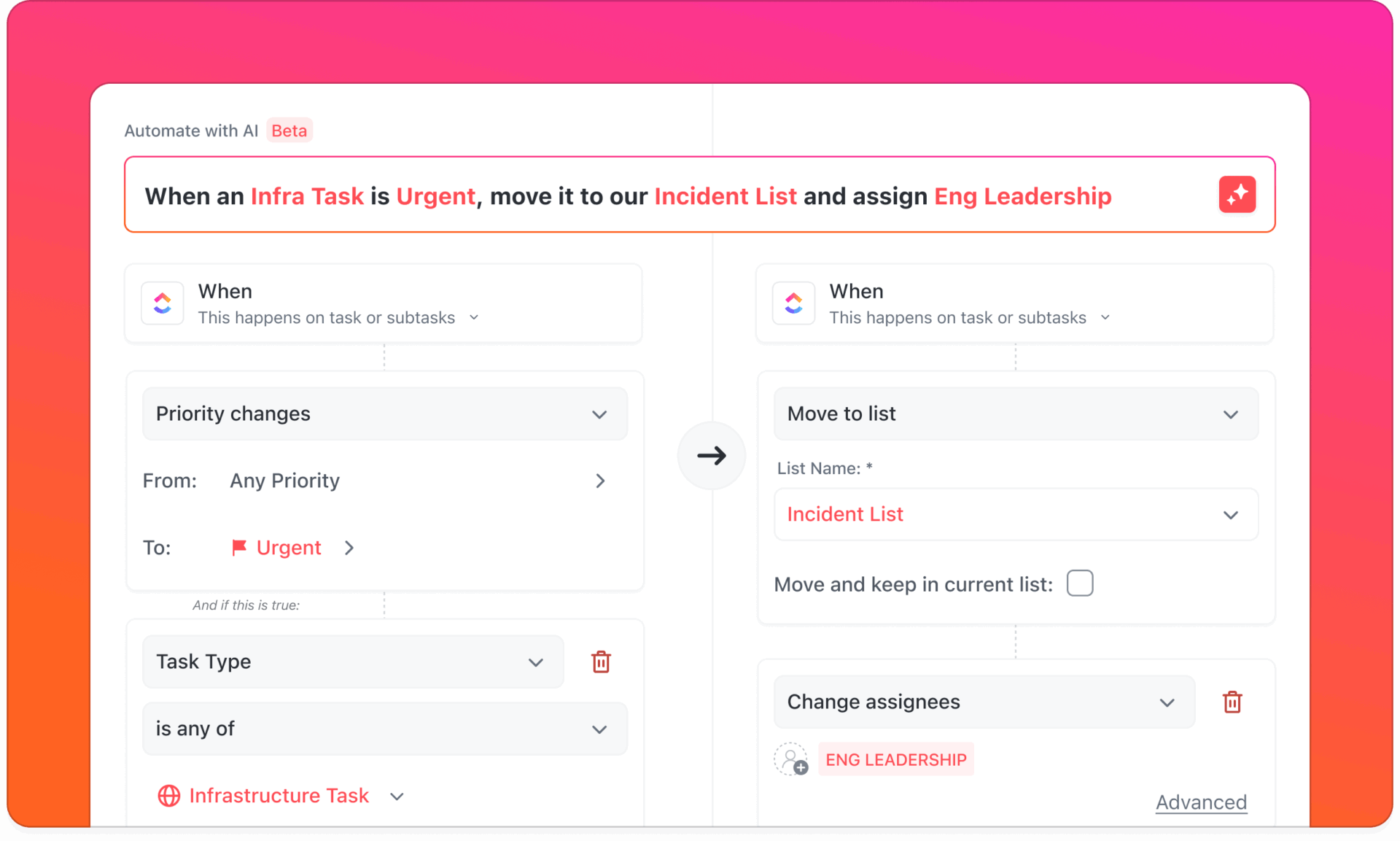

ClickUpの利点その5:反復的な開発ワークフローの自動化

ClickUp Automationsは、開発チームの作業を遅らせがちな手作業のステップを排除します。タスクのステータス、期限、またはカスタムフィールドに基づいてアクションをトリガーできます。

機能が「QA準備完了」の状態になると、ClickUpは自動的にそのタスクをテスターに割り当て、QAチームに通知します。

テスターがバグを報告した場合、自動化機能によってタスクが再オープンされ、担当開発者にタグが付けられ、その問題がスプリントバックログに戻されます。そのため、どのフェーズでもワークフローが自動的に継続されます。

AIを活用してClicking-Upを始めましょう

AIを真に活用するには、単にモデルを選ぶだけでなく、モデルと仕事を接続するワークスペースを選ぶ必要があります。Mixtralは柔軟性、オープンな重みデータ、そして制御性を提供します。ChatGPTは洗練された出力と巨大なエコシステムを提供します。どちらも優れたツールですが、単独ではどうでしょうか? それらはワークフローの外に存在するため、タブを切り替えたり、出力をコピー&貼り付けたり、洞察を手作業でタスクやドキュメントに変換したりする手間がかかってしまいます。

AIをワークスペースに直接組み込むことで、複数のモデルを並行して使用したり、出力結果をタスクやドキュメントに接続したり、チームメンバーと共同作業を行ったり、ナレッジを一元化したり、反復的なワークフローを自動化したりできます。これにより、MixtralやChatGPT、その他のAIで生成された知見は、別のツールに放置されることなく、すぐに現在の仕事の一部となります。

実際に試してみませんか?ClickUpで今すぐ無料で始めましょう✨。

よくある質問(FAQ)

Mixtral-8x7Bは「ミクスチャー・オブ・エキスパート(MOE)」アーキテクチャを採用しており、これは8つの専門モデルを1つに統合したようなものです。一方、Mistral 7Bのような標準的なモデルは、単一の密なモデルです。これにより、Mixtralはより大きなモデルと同等の性能を、より高い効率で実現できます。

はい、Mixtralのオープンウェイトライセンスにより、自社ハードウェア上で実行してデータを完全に管理できます。これには高性能なGPUが必要ですが、モデルの量子化バージョンであれば、より一般的なコンシューマー向け機器でも実行可能です。

コーディング、デバッグ、ドキュメント作成に毎日AIを利用している場合、ChatGPT Plusの高速な応答速度と優先度は、サブスクリプション料金に見合う価値があるでしょう。たまにしか利用しないユーザーにとっては、従量制のAPIを使い続ける方が経済的かもしれません。

複数のAIモデルを単一のインターフェースに集約したプラットフォームを利用できます。例えば、ClickUp BrainではOpenAI、Anthropic、Googleのモデルにアクセスできるため、ワークスペースを離れることなく、あらゆるタスクに最適なAIを活用できます。