Kebanyakan orang mengira mereka harus memilih antara menggunakan alat AI yang canggih atau menjaga kerahasiaan data mereka. Namun, sebenarnya Anda bisa mendapatkan keduanya. Menjalankan AI secara lokal berarti data tidak pernah meninggalkan perangkat keras Anda. Anda tetap memegang kendali penuh atas informasi Anda sambil tetap mengotomatiskan tugas-tugas yang paling berulang.

Panduan ini menunjukkan kepada Anda cara menggunakan AI lokal untuk alur kerja yang aman dengan menggunakan alat seperti Ollama. Anda akan belajar cara memilih model sumber terbuka yang sesuai dengan spesifikasi perangkat keras Anda. Serta membangun alur kerja otomatis yang memproses dokumen pribadi secara lokal.

Kami juga akan membahas cara mengonsolidasikan alur kerja di ruang terpadu seperti ClickUp. 😎

Apa Itu AI Lokal?

AI lokal berarti Anda menjalankan model bahasa besar (LLM) sepenuhnya di perangkat keras Anda sendiri—seperti laptop atau server di lokasi—daripada mengirimkan data Anda ke layanan cloud eksternal. Hal ini cocok untuk tim mana pun yang menangani informasi sensitif, mulai dari tim teknik dan desain produk hingga departemen hukum dan keuangan.

Dengan sebagian besar alat AI berbasis cloud, prompt, dokumen, dan data Anda dikirim ke server pihak ketiga. Anda kehilangan kendali atas cara informasi tersebut diproses, disimpan, atau digunakan.

Sebaliknya, AI lokal menjaga data Anda tetap berada di lingkungan Anda. Anda tetap memiliki kendali penuh atas keamanan dan perlindungan data untuk alur kerja Anda.

Tentu saja, ada kompromi yang harus dilakukan. Mengimplementasikan AI lokal membutuhkan upaya teknis yang lebih besar dan investasi perangkat keras di awal. Namun, hal ini sepenuhnya menghilangkan ketergantungan Anda pada penyedia eksternal. Dengan inferensi di perangkat, informasi Anda tetap berada tepat di tempat yang Anda inginkan.

Mengapa AI Lokal Penting untuk Alur Kerja Tim yang Aman

🔎 Tahukah Anda? Hanya 1 dari 10 konsumen yang bersedia membagikan informasi sensitif, seperti data keuangan, komunikasi, atau biometrik, kepada sistem yang didukung AI.

Keraguan ini mencerminkan kenyataan yang semakin nyata bagi tim B2B. Dengan AI berbasis cloud, pada dasarnya Anda menyerahkan kekayaan intelektual perusahaan Anda kepada pihak ketiga. Bagi tim hukum, keuangan, atau SDM, hal ini menimbulkan risiko hukum yang besar.

AI lokal mengubah dinamika ini dengan memindahkan AI ke perangkat keras Anda sendiri. Inilah mengapa hal itu penting bagi operasional harian Anda:

- Cegah kebocoran data: Mencegah kode eksklusif atau kontrak klien pribadi digunakan untuk melatih model publik yang mungkin digunakan oleh pesaing Anda

- Pastikan kepatuhan terhadap regulasi: Tetap patuhi batasan GDPR atau HIPAA karena data sensitif tidak pernah melintasi batas negara atau tersimpan di server pihak ketiga

- Hilangkan ketergantungan pada internet: Jalankan analisis data yang kompleks atau tugas penyusunan dokumen selama pemadaman listrik atau di lingkungan dengan keamanan tinggi di mana akses ke cloud dibatasi

- Kelola biaya secara terprediksi: Hindari kenaikan biaya API seiring pertumbuhan tim Anda, karena satu-satunya biaya yang Anda keluarkan adalah perangkat keras yang sudah Anda miliki

Dengan mengintegrasikan AI lokal ke dalam alat yang sudah Anda miliki, Anda dapat mengotomatiskan pekerjaan Anda tanpa mengorbankan keamanan.

⚠️ Namun, penting untuk diingat bahwa masalah ini bisa semakin parah. Tim Anda mungkin ingin mengadopsi berbagai alat AI, yang dapat menyebabkan penyebaran AI yang tidak terkendali —penyebaran alat AI tanpa pengawasan atau strategi. Hal ini dapat mengakibatkan pemborosan uang, duplikasi upaya, dan risiko keamanan.

Pada akhirnya, hal ini memperluas model ancaman keamanan Anda dan membuat pekerjaan menjadi lebih sulit untuk dilacak.

📮Wawasan ClickUp: Tim berkinerja rendah 4 kali lebih mungkin menggunakan 15+ alat, sementara tim berkinerja tinggi menjaga efisiensi dengan membatasi perangkat mereka hingga 9 platform atau kurang. Namun, bagaimana jika menggunakan satu platform saja? Sebagai aplikasi serba guna untuk bekerja, ClickUp menyatukan tugas, proyek, dokumen, wiki, obrolan, dan panggilan Anda dalam satu platform, lengkap dengan alur kerja yang didukung AI. Siap bekerja lebih cerdas? ClickUp cocok untuk setiap tim, membuat pekerjaan menjadi transparan, dan memungkinkan Anda fokus pada hal-hal penting sementara AI menangani sisanya.

Apa yang Anda Butuhkan untuk Menjalankan AI Lokal?

Anda tidak memerlukan superkomputer khusus untuk menjalankan AI secara lokal. Perubahan terbaru dalam cara model dibangun memungkinkan Anda memulai dengan perangkat keras yang sudah Anda miliki. Yang diperlukan hanyalah memenuhi beberapa kriteria tertentu.

Persyaratan perangkat keras

Perangkat keras Anda menentukan ukuran dan kecepatan model AI yang dapat Anda gunakan. Meskipun mesin yang bertenaga memungkinkan Anda menjalankan model penalaran yang lebih kompleks, model yang lebih kecil ternyata telah menjadi sangat mumpuni.

- GPU dengan VRAM: Kartu NVIDIA khusus dengan setidaknya 12GB VRAM merupakan pilihan ideal saat ini bagi sebagian besar tim. Hal ini memungkinkan Anda menjalankan model berukuran sedang seperti Llama 3.3 (8B) atau Mistral Small dengan kecepatan tinggi

- RAM Sistem: Jika Anda tidak memiliki GPU kelas atas, RAM komputer Anda akan menangani beban tersebut. 32GB memberikan ruang yang cukup untuk menjalankan model sambil tetap membuka browser dan alat manajemen proyek Anda

- Memori terpadu (untuk pengguna Mac): Jika Anda menggunakan Mac dengan chip seri M (M2, M3, atau M4), RAM dan memori GPU Anda berbagi ruang. Hal ini membuat Mac sangat efisien untuk AI lokal karena model dapat mengakses seluruh ruang memori

- Penyimpanan cepat: Model adalah file berukuran besar, biasanya berkisar antara 5GB hingga 50GB. Penggunaan SSD NVMe sangat penting untuk menghindari waktu tunggu yang lama saat memuat model baru

🔎 Tahukah Anda? Membuat PC kini jauh lebih mahal dibandingkan beberapa bulan yang lalu. Sebelumnya, satu set memori DDR5 32GB berharga di bawah $130, tetapi kini harga set yang sama melonjak melebihi $400. Perubahan ini menjadikan 32GB sebagai standar minimum baru untuk pekerjaan AI lokal yang serius, karena Anda memerlukan ruang yang cukup untuk menjalankan model tanpa kinerja sistem Anda terganggu.

Persyaratan perangkat lunak

Perangkat lunak berfungsi sebagai jembatan antara perangkat keras Anda dan AI. Anda tidak perlu lagi menjadi pengembang untuk menjalankan ini.

- Sistem operasi: Meskipun Linux merupakan platform asli untuk AI, Windows dan macOS kini sama-sama mumpuni. Pengguna Windows dapat menggunakan WSL2 untuk lingkungan mirip Linux, meskipun banyak alat kini dapat dijalankan langsung di Windows

- Pengelola model: Alat seperti Ollama atau LM Studio adalah titik awal yang paling mudah. Alat-alat ini menangani kuantisasi—mengompres model agar sesuai dengan perangkat keras Anda secara otomatis

- Driver: Anda memerlukan driver terbaru untuk perangkat keras Anda, seperti driver CUDA terbaru untuk kartu NVIDIA. Sebagian besar penginstal modern akan memeriksa hal ini untuk Anda selama proses penginstalan

Pilihan LLM sumber terbuka

Kita menyaksikan ledakan model open-source yang dapat diunduh secara gratis. Model-model ini dikembangkan oleh perusahaan seperti Meta (Llama), Mistral, dan Alibaba (Qwen). Berbeda dengan sistem tertutup, model-model ini memungkinkan Anda melihat secara tepat bagaimana cara kerjanya dan ke mana data Anda dikirim.

Saat memilih model bahasa besar, perhatikan lisensi perangkat lunaknya. Sebagian besar menggunakan lisensi Apache 2.0 atau MIT, yang memungkinkan Anda menggunakannya untuk operasi bisnis tanpa biaya langganan bulanan. Karena model-model ini berjalan di perangkat keras Anda, mereka terintegrasi langsung ke dalam alur kerja pribadi Anda.

Misalnya, Anda dapat menggunakan model lokal untuk menyusun draf email internal, merangkum transkrip rapat, atau menganalisis kumpulan data eksklusif. Hal ini memastikan bahwa detail proyek yang paling sensitif dan catatan strategis tetap tersimpan di perangkat Anda.

🧠 Fakta Menarik: Chip seri M dari Apple menawarkan keunggulan arsitektur yang unik bagi tim yang berfokus pada privasi. Memori Terpadu Mac memungkinkan AI menggunakan seluruh pool RAM sistem seolah-olah itu adalah memori grafis khusus.

Ini berarti MacBook yang dilengkapi dengan RAM 128GB dapat menjalankan model-model besar dan sangat canggih yang biasanya memerlukan perangkat keras khusus perusahaan dengan harga lebih dari $10.000.

Model AI Lokal Terbaik untuk Alur Kerja Tim

Untuk menemukan model yang tepat, sesuaikan keunggulan model dengan tugas tim Anda dan kemampuan perangkat keras yang dimiliki.

Model serbaguna

Inilah alat andalan dalam pengaturan lokal Anda. Gunakan untuk menyusun draf email, merangkum pembaruan proyek, atau mengumpulkan ide-ide kreatif.

- Llama 4 Scout (17B): Dilengkapi dengan jendela konteks 10 juta token, yang memungkinkan Anda memproses ribuan halaman teks sekaligus

- Mistral Small 4: Menggunakan arsitektur campuran ahli, yang berarti model ini hanya mengaktifkan sebagian kecil dari parameternya untuk setiap tugas

- Qwen 3.5 (7B): Konsisten unggul jika tim Anda menangani dokumentasi teknis dalam berbagai bahasa

Model untuk penalaran dan penggunaan alat

Gunakan ini saat Anda membutuhkan agen LLM untuk memecahkan masalah bertahap, mengikuti logika yang kompleks, atau bertindak sebagai agen otonom dalam alur kerja Anda.

- Llama 4 Maverick: Model ini secara bawaan mendukung berbagai mode data. Hal ini menjadikannya ideal bagi tim yang perlu menganalisis grafik kompleks atau lembar kerja keuangan, di mana konteks visual sama pentingnya dengan teks

- Phi-4 (14B): Didesain khusus untuk bidang STEM dan penalaran logis. Gunakan model ini untuk validasi data atau tugas matematika kompleks yang biasanya memerlukan model yang jauh lebih besar dan mahal.

- DeepSeek-R1: Menampilkan rantai pemikiran internalnya, yang membantu Anda memverifikasi logikanya untuk analisis yang berisiko tinggi. Ideal untuk penelitian mendalam dan perencanaan strategis

Model khusus tugas

Terkadang, alat khusus lebih efisien daripada asisten umum. Model-model ini dioptimalkan untuk satu bagian tertentu dari alur kerja Anda.

- Qwen 3-Coder-Next: Memahami logika pada skala repositori, sehingga dapat menyarankan perbaikan bug atau refaktorisasi kode di seluruh berkas. Semua itu dilakukan sambil mengikuti panduan gaya khusus tim Anda

- Voxtral Mini: Mengidentifikasi pembicara yang berbeda dalam rekaman dan mengubah rekaman rapat pribadi menjadi teks yang dapat dicari. Berfungsi sepenuhnya secara offline, cocok untuk menghindari kebocoran data

- Nomic Embed v1.5: Mengubah dokumen pribadi Anda menjadi data matematis untuk pencarian semantik. Hal ini memungkinkan Anda mencari basis pengetahuan internal tim Anda berdasarkan makna, bukan hanya kata kunci.

📚 Baca Juga: Mesin Pencari LLM: Pencarian Informasi Berbasis AI

Alat Populer untuk Menjalankan AI Lokal

Anda tidak perlu lagi menjadi insinyur perangkat lunak untuk menjalankan model di mesin Anda sendiri. Beberapa aplikasi yang ramah pengguna kini dapat menangani pengaturan teknis untuk Anda dalam hitungan menit.

Ollama dan OpenWebUI

Ollama cocok jika Anda menginginkan kecepatan dan fleksibilitas. Aplikasi ini berjalan di latar belakang dan mengelola perpustakaan model Anda melalui antarmuka yang sederhana.

Meskipun awalnya merupakan alat dasar, kebanyakan orang menggunakannya bersama OpenWebUI. Hal ini menambahkan pengalaman obrolan yang lebih baik di browser Anda yang terlihat dan terasa seperti alat berbasis cloud yang sudah Anda kenal. OpenWebUI juga menciptakan jembatan lokal bagi aplikasi lain di komputer Anda untuk berkomunikasi secara aman dengan model AI Anda.

LM Studio

Jika Anda lebih menyukai aplikasi desktop tradisional, LM Studio adalah alternatif yang sangat baik. Aplikasi ini berfungsi seperti toko aplikasi untuk AI. Anda dapat menggunakannya untuk mencari, mengunduh, dan berinteraksi dengan model baru hanya dengan beberapa klik.

Aplikasi ini dilengkapi dengan fitur deteksi perangkat keras bawaan, sehingga secara otomatis menyesuaikan pengaturan Anda sesuai dengan GPU atau RAM yang Anda miliki. Hal ini menjadikannya titik awal yang ideal jika Anda ingin bereksperimen dengan berbagai model tanpa perlu menulis satu baris kode pun.

GPT4All

Bagi tim yang berfokus sepenuhnya pada privasi dan analisis dokumen, GPT4All adalah solusi yang andal dan sederhana. Aplikasi ini dapat berjalan di hampir semua komputer, termasuk laptop lama yang mungkin tidak dilengkapi dengan kartu grafis khusus.

Fitur paling berguna dari aplikasi ini adalah kemampuannya untuk berinteraksi langsung dengan file lokal Anda. Anda dapat mengarahkan aplikasi ke folder di hard drive Anda, dan AI akan menjawab pertanyaan tentang dokumen-dokumen tersebut. Semua itu tanpa perlu mengunggahnya ke server pihak ketiga.

📚 Baca Juga: Agen AI Terbaik untuk Pengguna Tanpa Kode

Cara Mengatur AI Lokal untuk Alur Kerja yang Aman

Panduan ini menggunakan Ollama karena merupakan alat yang didukung secara luas untuk membangun alur kerja AI lokal yang aman.

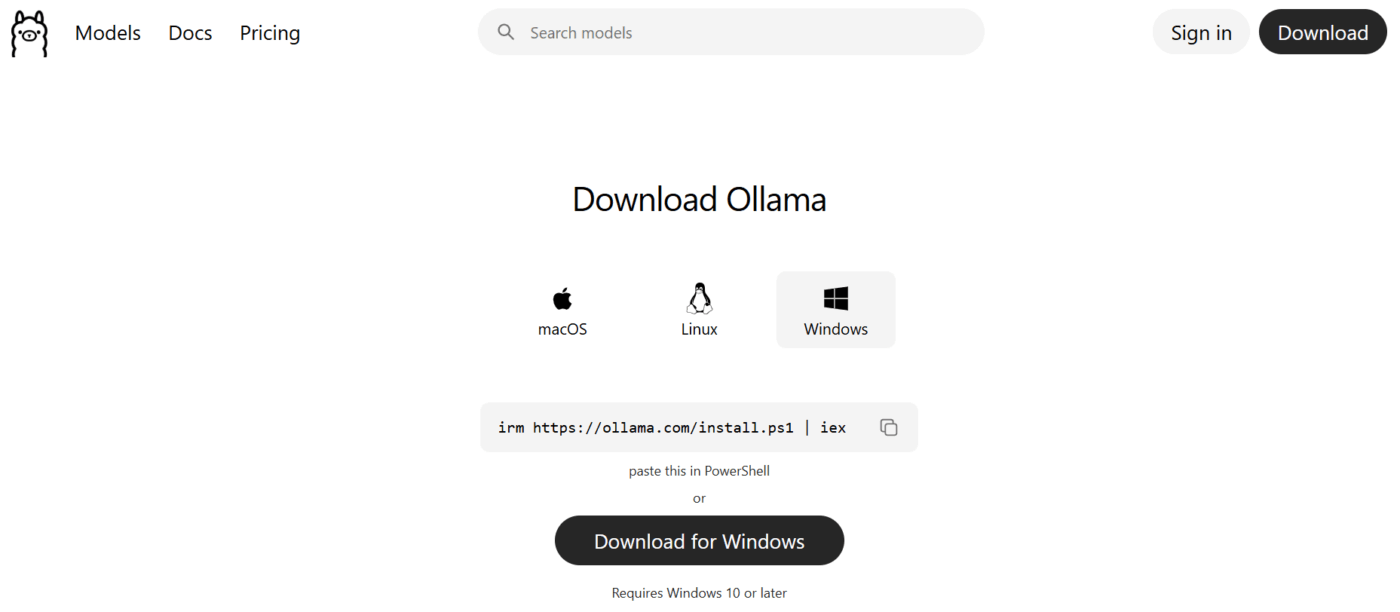

Langkah 1: Instal Ollama

Unduh penginstal dari situs web resmi untuk sistem operasi Anda. Meskipun versi Windows sebelumnya memerlukan pengaturan manual untuk subsistem Linux, versi saat ini diinstal sebagai aplikasi asli.

Proses instalasi hanya membutuhkan waktu beberapa menit. Setelah instalasi selesai, buka terminal atau jendela perintah Anda, lalu ketik ollama --version untuk memastikan bahwa aplikasi sudah siap digunakan.

Langkah 2: Unduh dan jalankan model

Untuk mulai menggunakan AI, Anda perlu mengunduh bobot modelnya ke mesin Anda. Untuk uji coba pertama Anda, cobalah model yang ringkas namun kuat seperti Llama 3.2 (3B) atau Mistral terbaru.

Gunakan perintah ollama run llama3.2 untuk memulai unduhan.

Tergantung pada kecepatan internet Anda, proses ini biasanya memakan waktu beberapa menit. Setelah unduhan selesai, Anda dapat mengetikkan perintah langsung ke terminal untuk mendapatkan respons instan dari model yang ada di hard drive Anda.

Langkah 3: Hubungkan ke alat alur kerja Anda

Nilai sebenarnya dari AI lokal terletak pada integrasinya ke dalam tugas-tugas harian Anda. Saat Ollama berjalan, ia secara otomatis memulai server lokal di http://localhost:11434. Hal ini menciptakan jembatan aman bagi aplikasi lain untuk berkomunikasi dengan model Anda.

Karena server ini kompatibel dengan protokol OpenAI standar, Anda dapat menghubungkannya ke platform otomatisasi atau skrip internal hanya dengan mengganti alamat API. Misalnya, Anda dapat mengarahkan alat pencarian dokumen lokal ke alamat ini. Hal ini memungkinkan alat tersebut merangkum file pribadi tanpa pernah mengirimkan teks tersebut ke cloud.

Praktik Terbaik Keamanan untuk Alur Kerja AI Lokal

Menjalankan AI secara lokal merupakan langkah besar dalam menjaga privasi. Namun, menyimpan data secara lokal berarti Anda kini bertanggung jawab untuk melindunginya. Meskipun Anda telah menghilangkan risiko kebocoran data di cloud pihak ketiga, Anda tetap perlu mengamankan perangkat keras Anda dan cara tim Anda berinteraksi dengan model-model tersebut.

Ikuti praktik terbaik berikut ini:

- Isolasi jaringan: Batasi akses API ke jaringan internal yang tepercaya agar server AI Anda tetap tidak dapat diakses dari internet publik

- Validasi input: Bersihkan semua data sebelum mengirimkannya ke model. Hal ini mencegah instruksi berbahaya yang tersembunyi dalam dokumen atau email

- Kontrol akses: Terapkan otentikasi pada titik akhir AI Anda untuk memastikan bahwa hanya pengguna yang berwenang yang dapat memicu tindakan model

- Pencatatan audit: Simpan catatan semua interaksi model untuk membantu dalam kepatuhan dan penyelidikan keamanan

- Isolasi kontainer: Jalankan model Anda di lingkungan terisolasi seperti Docker. Hal ini mencegah potensi pelanggaran mencapai file sistem inti Anda

- Pembaruan rutin: Instal patch terbaru untuk alat seperti Ollama agar tetap terlindungi dari kerentanan yang baru ditemukan

- Pembatasan laju: Untuk mencegah satu pengguna atau skrip membanjiri server Anda dengan permintaan, terapkan pembatasan laju untuk mengontrol jumlah permintaan yang dapat dilakukan dalam periode tertentu

🔎 Tahukah Anda? Manipulasi berbasis prompt bukan lagi ancaman teoretis. Survei terbaru dari Gartner menemukan bahwa 32% organisasi mengalami serangan prompt berbahaya pada aplikasi AI dalam setahun terakhir. Serangan ini dapat memanipulasi model lokal Anda sehingga menghasilkan output yang bias atau tidak sah.

Cara Membangun Alur Kerja AI yang Aman untuk Tim Anda

Setelah server lokal Anda berjalan, Anda dapat mengintegrasikannya ke dalam pekerjaan sehari-hari Anda. Hal ini mengubah alat sederhana menjadi mesin produktivitas pribadi. Cara paling efektif untuk melakukannya adalah melalui Retrieval-Augmented Generation (RAG).

Proses ini menghubungkan AI lokal Anda ke basis data pribadi yang berisi file-file Anda sendiri. Anda dapat menjawab pertanyaan menggunakan konteks perusahaan Anda tanpa perlu mengunggah satu byte pun ke cloud.

Anda juga dapat merancang alur kerja dengan keterlibatan manusia (human-in-the-loop), di mana hasil kerja AI ditinjau oleh anggota tim manusia. Hal ini memastikan akurasi sekaligus secara signifikan mempercepat hasil kerja Anda.

Berikut adalah beberapa contoh praktis:

- Analisis dokumen: Ringkas laporan internal atau umpan balik pelanggan untuk mengekstrak wawasan kunci secara instan

- Pembuatan draf: Buat versi awal email atau pembaruan proyek agar anggota tim dapat menyempurnakannya

- Klasifikasi data: Kategorikan tugas yang masuk secara otomatis berdasarkan konten spesifik dari permintaan

- Persiapan rapat: Buat poin-poin pembicaraan dengan menganalisis berkas-berkas proyek terkait yang tersimpan di drive lokal Anda

- Tinjauan kode: Dapatkan umpan balik mengenai kode sumber milik sendiri tanpa mengekspos kekayaan intelektual Anda kepada pihak ketiga

📮ClickUp Insight: Survei kematangan AI kami menunjukkan bahwa akses ke AI di tempat kerja masih terbatas—36% orang sama sekali tidak memiliki akses, dan hanya 14% yang mengatakan bahwa sebagian besar karyawan benar-benar dapat bereksperimen dengannya. Ketika AI dibatasi oleh izin, alat tambahan, atau pengaturan yang rumit, tim tidak mendapat kesempatan untuk mencobanya dalam pekerjaan sehari-hari yang nyata.

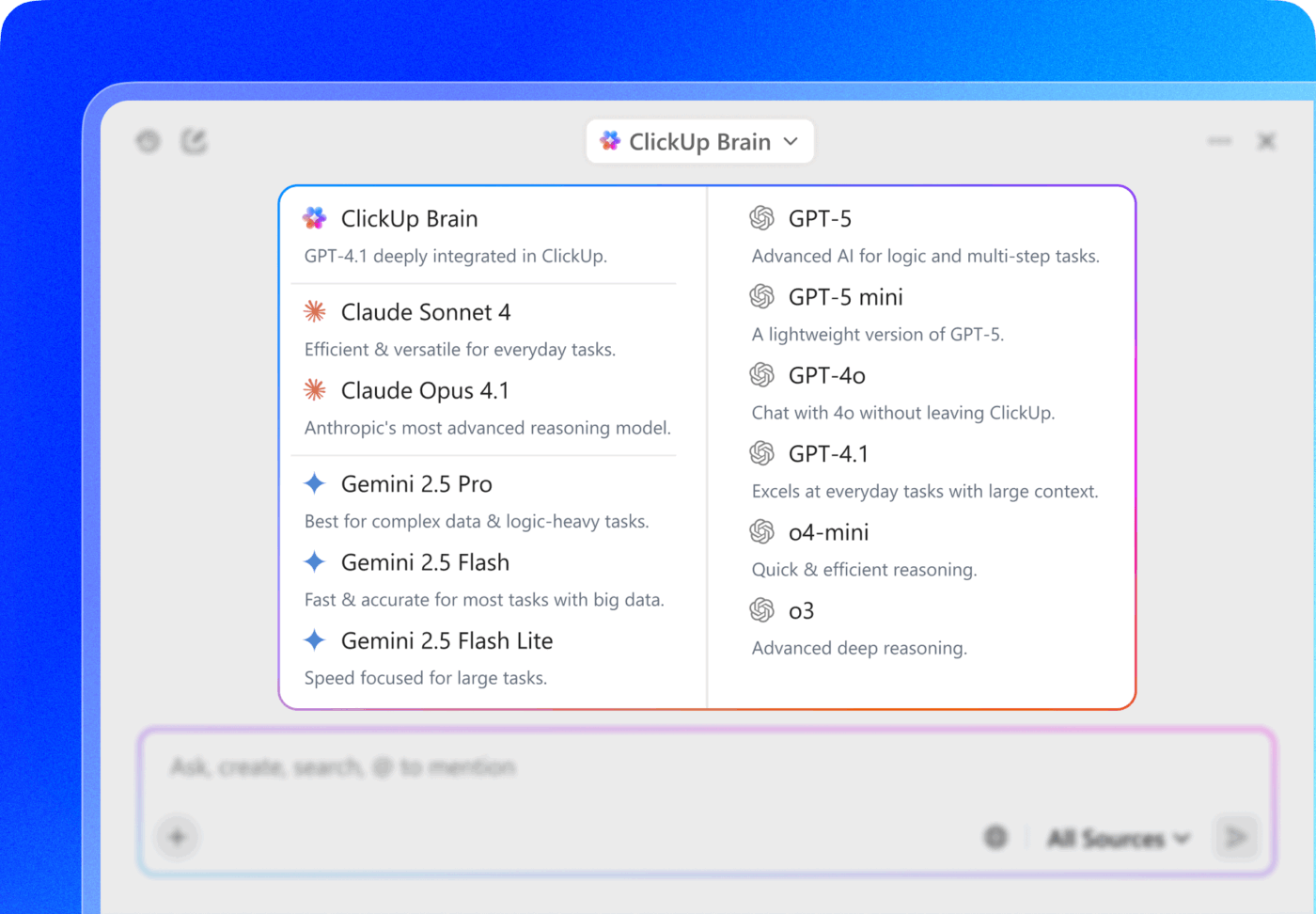

ClickUp Brain menghilangkan semua hambatan tersebut dengan menempatkan AI langsung di dalam ruang kerja yang sudah Anda gunakan. Anda dapat memanfaatkan berbagai model AI, menghasilkan gambar, menulis atau men-debug kode, mencari di web, merangkum dokumen, dan banyak lagi—tanpa perlu beralih alat atau kehilangan fokus.

Ini adalah mitra AI ambient Anda, mudah digunakan dan dapat diakses oleh semua anggota tim.

Keterbatasan Penggunaan AI Lokal untuk Alur Kerja AI

AI lokal adalah alat yang kuat, tetapi bukan solusi ajaib untuk setiap masalah. Memahami keterbatasannya membantu Anda memutuskan kapan harus menjalankan tugas di perangkat keras Anda sendiri dan kapan harus menggunakan cloud. Bagi beberapa tim, pertimbangan teknis dan finansial mungkin lebih penting daripada manfaat privasi.

- Batasan kemampuan: Model eksklusif kelas atas masih memiliki keunggulan tipis dalam hal penalaran kompleks dan nuansa kreatif dibandingkan dengan versi sumber terbuka

- Investasi perangkat keras: Kinerja cepat pada model besar memerlukan GPU mahal dengan VRAM yang besar. Hal ini dapat menjadi biaya awal yang tinggi bagi tim kecil

- Biaya pemeliharaan: Anda bertanggung jawab atas semua pembaruan perangkat lunak, pemecahan masalah perangkat keras, dan penerapan tambalan keamanan tanpa dukungan tim penyedia layanan

- Keahlian teknis: Mengoptimalkan lingkungan lokal memerlukan pengetahuan praktis tentang kuantisasi model dan konfigurasi server

- Manajemen keamanan: Berbeda dengan layanan cloud, model lokal tidak dilengkapi dengan fitur moderasi bawaan. Anda harus menerapkan filter konten dan batasan keamanan sendiri

- Konsumsi daya: Menjalankan model AI berskala besar di server atau workstation Anda sendiri dapat secara signifikan meningkatkan penggunaan listrik dan kebutuhan pendinginan

Banyak tim menggunakan pendekatan hibrida: AI lokal untuk data sensitif, dan AI cloud untuk tugas-tugas yang kurang sensitif namun membutuhkan kapasitas maksimal. Berikut ini gambaran singkat perbandingan antara keduanya:

| Faktor | AI Lokal | AI Cloud |

|---|---|---|

| Privasi data | Kontrol penuh | Data yang dikirim ke penyedia |

| Kompleksitas pengaturan | Lebih tinggi | Lebih rendah |

| Biaya berkelanjutan | Perangkat keras + listrik | Biaya per token |

| Kemampuan model | Baik, terus membaik | Teknologi terkini |

| Pemeliharaan | Dikelola sendiri | Dikelola oleh penyedia |

Bagaimana ClickUp Mendukung Alur Kerja Berbasis AI yang Aman

Sebagian besar tim saat ini terjebak dalam dilema: menggunakan AI cloud yang kuat namun khawatir tentang ke mana data Anda akan pergi, atau menyiapkan model lokal dan menghadapi biaya operasional yang berkelanjutan. ClickUp mengatasi dilema tersebut dengan bertindak sebagai ruang kerja AI terintegrasi — di mana AI sudah terintegrasi dalam sistem tempat pekerjaan Anda berlangsung.

ClickUp Brain adalah lapisan AI yang terintegrasi langsung ke dalam ruang kerja ClickUp, dirancang untuk memahami tugas, dokumen, dan komunikasi tim Anda dalam satu tempat. Fitur ini menyediakan bantuan AI dengan konteks lengkap—tanpa alat terpisah, tanpa integrasi yang rentan.

Bagi tim yang ingin membangun alur kerja AI yang aman, kombinasi antara konteks dan kontrol itulah yang membedakan antara eksperimen dan penerapan yang sesungguhnya.

🌟 ClickUp juga telah memenuhi standar SOC 2 dan mematuhi standar ISO 42001 untuk pengelolaan AI yang bertanggung jawab. Hal ini memastikan data Anda tidak pernah digunakan untuk melatih model pihak ketiga, sehingga Anda dapat mengotomatisasi pekerjaan Anda dengan tingkat kepercayaan yang sama seperti pada pengaturan on-premise.

Akses fitur pencarian dan alur kerja otonom dengan ClickUp Brain

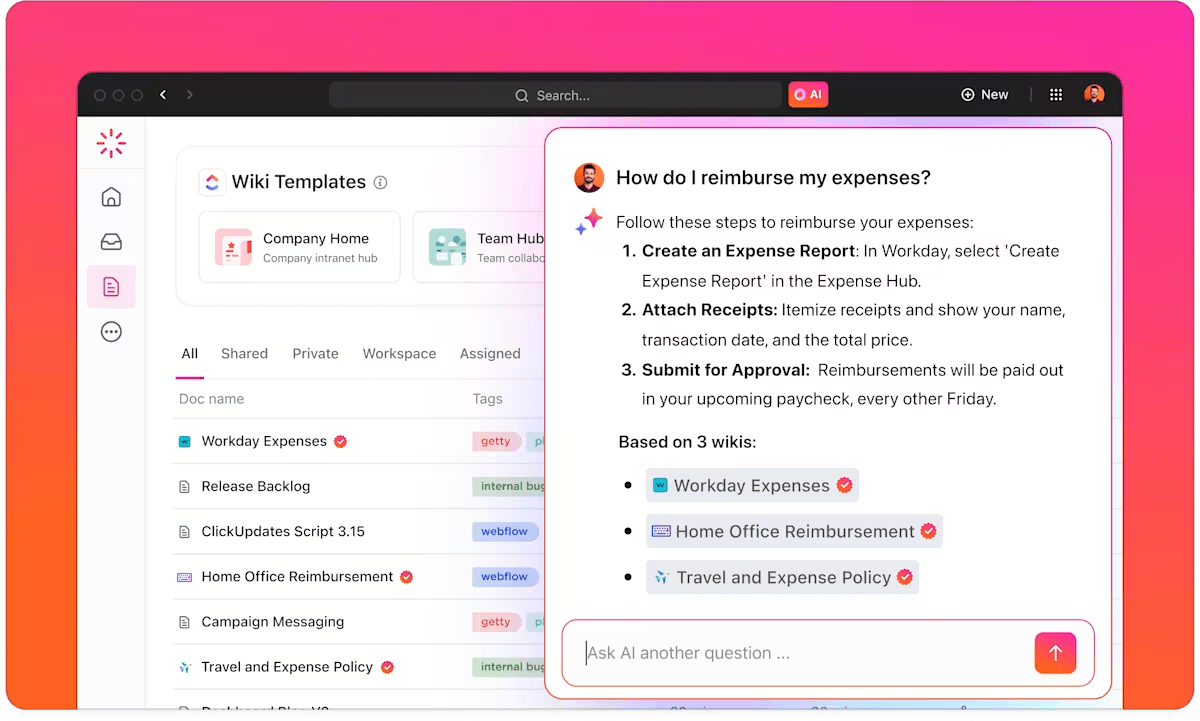

Setelah data Anda aman di dalam ruang kerja, ClickUp Brain mengekstrak nilai dari tugas dan dokumen Anda secara real-time.

Karena AI ini terintegrasi, hal ini menghindari kesenjangan konteks yang memperlambat pengaturan lokal. Anda dapat mengajukan pertanyaan yang memerlukan gambaran lengkap riwayat proyek Anda agar dapat dijawab dengan akurat:

- Tentukan keputusan akhir dari ringkasan teknis yang panjang tanpa perlu menggulir melalui berbagai versi

- Draf pembaruan pemangku kepentingan dari komentar tugas dan perubahan status

ClickUp Brain menghasilkan jawaban yang didasarkan pada data ruang kerja Anda dengan menganalisis konten spesifik di dalam Dokumen, tugas, dan obrolan Anda. Hal ini memastikan bahwa seiring perkembangan proyek Anda, AI selalu memiliki konteks terbaru.

Hal ini memungkinkan tim Anda untuk mengembangkan wawasan tanpa harus menjelaskan ulang riwayat proyek secara manual atau memindahkan data antar alat yang tidak terhubung.

💡Tips Pro: Anda dapat memperluas konteks ruang kerja Anda lebih jauh lagi dengan menggunakan Enterprise AI Search untuk mengambil informasi dari semua alat eksternal Anda.

Misalnya, ajukan pertanyaan mendalam seperti ‘Tunjukkan semua kesepakatan yang sedang berjalan di pipeline,’ dan ClickUp Brain akan mencari di seluruh aplikasi yang terhubung, termasuk Slack, Google Drive, dan Gmail, untuk memberikan jawaban real-time yang dapat diandalkan beserta sumbernya.

Hal ini mengubah data yang tersebar di berbagai platform menjadi lapisan intelijen tunggal yang dapat dicari, di mana Anda dapat menemukan file, pesan, atau tugas apa pun tanpa perlu meninggalkan ruang kerja Anda.

Kelola tugas secara cerdas dengan otomatisasi dan AI

ClickUp Brain tidak hanya membantu secara pasif—tetapi juga bekerja secara aktif di dalam sistem tugas Anda. ClickUp Brain dapat:

- Buat tugas dari catatan rapat atau Dokumen

- Pecah hasil kerja yang besar menjadi subtugas

- Sarankan pemilik tugas berdasarkan aktivitas sebelumnya

- Rekomendasikan tenggat waktu berdasarkan konteks proyek

Fitur ini juga dapat memperbarui status tugas, merangkum utas komentar yang panjang menjadi langkah-langkah selanjutnya yang jelas, serta mengidentifikasi hambatan sebelum menghambat pelaksanaan.

Jika dipadukan dengan ClickUp Automation, ini menjadi sistem loop tertutup: AI dapat memicu alur kerja (seperti menugaskan tugas, memberi tahu pemangku kepentingan, atau memperbarui prioritas) berdasarkan perubahan di dalam ruang kerja Anda.

Misalnya, ketika sebuah dokumen telah diselesaikan, tugas-tugas dapat dibuat dan ditugaskan secara otomatis tanpa perlu memindahkan data secara manual antar alat.

💟 Bonus: Jadikan ClickUp Brain MAX sebagai “memori keputusan” Anda.

Gunakan untuk:

- Ringkaslah utas komentar yang panjang menjadi keputusan yang jelas dan langkah selanjutnya

- Perbarui Dokumen dengan “apa yang berubah dan mengapa” setelah pencapaian tonggak penting

- Buat catatan keputusan mingguan dari tugas, rapat, dan pembaruan

Seiring waktu, hal ini menciptakan lapisan pengetahuan institusional yang dinamis yang dapat dijadikan acuan oleh Brain MAX. Jadi, alih-alih menjawab perintah secara terpisah, sistem ini mulai merespons dengan mempertimbangkan keputusan, prioritas, dan pola-pola di masa lalu.

Itulah saat AI beralih dari sekadar membantu menjadi andal—terutama dalam alur kerja AI yang aman di mana konteks dan jejak audit sangat penting.

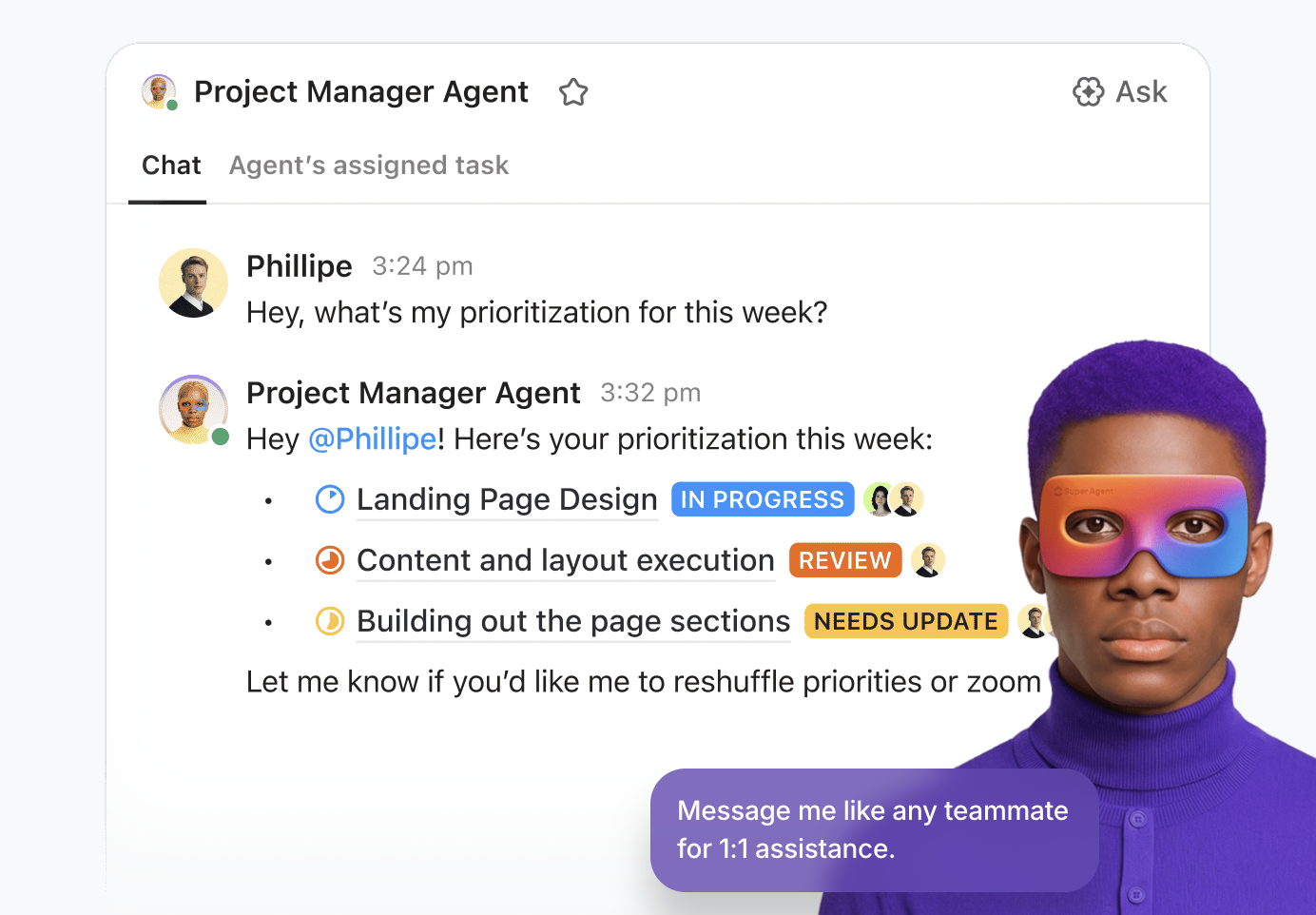

Dapatkan eksekusi yang aman dan sadar konteks dalam skala besar dengan Super Agents

Super Agents dari ClickUp membawa ClickUp Brain ke level berikutnya—dari sekadar membantu pekerjaan hingga secara aktif mengarahkannya. Agen-agen ini dapat dikonfigurasi untuk memantau alur kerja, mengambil tindakan, dan mengoordinasikan tugas di seluruh ruang kerja Anda berdasarkan aturan yang telah ditentukan dan konteks real-time.

Misalnya, Super Agent dapat:

- Pantau permintaan yang masuk atau dokumen, dan ubah secara otomatis menjadi tugas terstruktur dengan penanggung jawab dan tenggat waktu

- Pantau kemajuan proyek dan tandai risiko atau penundaan sebelum menjadi lebih parah

- Aktifkan otomatisasi multi-langkah saat kondisi terpenuhi—seperti memberi tahu pemangku kepentingan, memperbarui prioritas, atau membuat tugas tindak lanjut

Agen-agen ini berjalan sepenuhnya di dalam ruang kerja terpadu ClickUp, dengan pemahaman penuh tentang tugas, Dokumen, dan struktur Izin Anda. Artinya:

- Anda tidak perlu mengekspor data ke sistem AI eksternal atau alat orkestrasi

- Mereka hanya mengakses data yang diizinkan untuk mereka lihat

- Mereka beroperasi dalam batas izin yang sama dengan tim Anda

Pelajari lebih lanjut tentang bekerja dengan Super Agents:

Manfaatkan bantuan AI di dalam dokumen Anda

Dengan ClickUp Docs, bantuan AI terintegrasi langsung ke dalam alur kerja dokumentasi Anda. Tim dapat menyusun ringkasan proyek, merangkum laporan panjang, mengekstrak poin tindakan, atau menyunting konten untuk audiens yang berbeda—semuanya tanpa perlu meninggalkan platform.

Hal ini penting untuk alur kerja AI yang aman karena salah satu risiko terbesar berasal dari menyalin dan menempelkan informasi sensitif ke alat eksternal. Di ClickUp, Anda meminimalkan perpindahan data dan mempertahankan kendali penuh atas akses melalui Izin.

Kesimpulan Akhir: Membangun Stack AI Pribadi Anda

AI lokal memanfaatkan kecerdasan buatan sambil tetap mempertahankan kendali penuh atas privasi data dan kepatuhan. Namun, jalur ini memerlukan investasi yang signifikan dalam perangkat keras, pengaturan teknis, dan pemeliharaan berkelanjutan.

Praktik keamanan tetap krusial, baik Anda menggunakan AI lokal maupun AI cloud. Strategi paling efektif sering kali melibatkan pendekatan hibrida: menggunakan AI lokal untuk operasi yang paling sensitif sambil memanfaatkan solusi terkelola dan aman untuk produktivitas sehari-hari.

Sangat penting untuk mempertimbangkan trade-off—bagi banyak tim, beban tambahan dari solusi DIY mungkin bukan pilihan yang tepat.

Bagi mereka yang menginginkan produktivitas AI yang kuat tanpa beban infrastruktur, solusi terkelola seperti ClickUp Brain menawarkan alternatif yang menarik. Solusi ini menyediakan keamanan tingkat perusahaan tanpa kerumitan pengaturan.

Mulailah menggunakan ClickUp secara gratis dan jelajahi alur kerja yang aman dan kontekstual yang didukung AI untuk tim Anda.

Pertanyaan yang Sering Diajukan

Apa perbedaan antara AI lokal dan AI berbasis cloud untuk alur kerja tim?

AI lokal sepenuhnya berjalan di perangkat keras Anda sendiri, memastikan data tidak pernah meninggalkan jaringan internal Anda, sementara AI berbasis cloud mengirimkan perintah ke server pihak ketiga untuk diproses. Pengaturan lokal memberikan kedaulatan data penuh dan akses offline, sedangkan layanan cloud menawarkan daya komputasi yang lebih tinggi dan kemudahan penggunaan dengan mengorbankan kontrol langsung atas data.

Bagaimana tim dapat menggunakan model AI lokal dengan data proyek yang rahasia?

Tim dapat menggunakan AI lokal untuk memproses dokumen sensitif, kode eksklusif, dan catatan keuangan dengan mengarahkan model ke direktori on-premise yang bersifat pribadi. Karena proses inferensi dilakukan di perangkat, Anda dapat melakukan tugas seperti ringkasan otomatis, ekstraksi data, dan pencarian pengetahuan internal tanpa risiko terpapar pada kumpulan data pelatihan LLM publik.

Apakah model AI lokal sama mumpuninya dengan ChatGPT untuk tugas-tugas kerja?

Banyak model lokal sumber terbuka, seperti Llama 3 dan Mistral, kini sangat mumpuni dalam menangani tugas-tugas rutin seperti menyusun draf, pemrograman, dan ringkasan. Meskipun model cloud kelas atas seperti GPT-4o masih unggul dalam penalaran yang sangat kompleks, model lokal menawarkan kinerja yang sebanding untuk 90% operasi bisnis sehari-hari dengan privasi yang jauh lebih baik.

Apa saja kelebihan dan kekurangannya jika menjalankan AI secara lokal dibandingkan dengan menggunakan layanan AI cloud?

Pertimbangan utama adalah memilih antara privasi data yang sepenuhnya terjamin dengan AI lokal versus skalabilitas tanpa perawatan dari AI cloud. Menjalankan AI secara lokal memerlukan investasi perangkat keras di awal dan keahlian teknis, namun menghilangkan biaya API berulang dan risiko kebocoran data. AI cloud lebih cepat untuk diimplementasikan, tetapi melibatkan biaya langganan berkelanjutan dan ketergantungan pada data pihak ketiga.