La plupart d'entre nous avons déjà eu l'occasion de « discuter » avec les derniers outils d'IA disponibles. Si vous avez passé suffisamment de temps avec l'IA, vous savez déjà qu'elle est comme cet ami brillant mais tête en l'air qui a de grandes idées, mais qui oublie parfois ce dont vous avez parlé. Ou comme ce collègue toujours au téléphone qui partage des informations douteuses provenant de discussions aléatoires, répandant ainsi des fausses informations.

Ce n'est que la partie émergée de l'iceberg lorsqu'on parle des défis liés à l'intelligence artificielle.

Des chercheurs de l'université d'État de l'Oregon et d'Adobe développent une nouvelle technique de formation visant à réduire les préjugés sociaux dans les systèmes d'IA. Si cette technique s'avère fiable, elle pourrait rendre l'IA plus équitable pour tous.

Mais ne nous emballons pas. Il ne s'agit là que d'une solution parmi tant d'autres pour relever les nombreux défis liés à l'IA auxquels nous sommes confrontés aujourd'hui. Des problèmes techniques aux dilemmes éthiques, le chemin vers une IA fiable est semé d'embûches complexes.

Examinons ensemble ces défis liés à l'IA et voyons ce qu'il faut faire pour les surmonter.

10 défis et solutions liés à l'IA

À mesure que la technologie de l'IA progresse, elle se heurte à toute une série de problèmes. Cette liste explore dix défis urgents liés à l'IA et présente des solutions pratiques pour un déploiement responsable et efficace de l'IA.

1. Biais algorithmique

Le biais algorithmique désigne la tendance des systèmes IA à produire des résultats biaisés, souvent en raison de la nature de leurs données d'entraînement ou de leur conception. Ces biais peuvent se manifester sous de nombreuses formes, perpétuant et amplifiant souvent les biais sociétaux existants.

Solutions

- Données diverses et représentatives : utilisez des ensembles de données d'entraînement qui reflètent véritablement la diversité de tous les groupes afin d'éviter les biais liés au genre, à l'origine ethnique ou à l'âge.

- Détection et surveillance des biais : vérifiez régulièrement vos systèmes d'IA pour détecter d'éventuels biais. Cela doit se faire à la fois par une surveillance automatisée et par vos propres vérifications manuelles afin de vous assurer que rien ne vous échappe.

- Ajustements algorithmiques : jouez un rôle actif dans l'ajustement des algorithmes d'IA afin de lutter contre les biais. Cela peut impliquer de rééquilibrer les pondérations des données ou d'ajouter des contraintes d'équité à vos modèles.

- Directives éthiques en matière d'IA : contribuez à définir des pratiques éthiques en matière d'IA en adoptant et en mettant en œuvre des directives qui traitent de l'équité et des préjugés, en veillant à ce que ces principes soient intégrés à chaque étape de votre projet d'IA.

2. Le manque de transparence de l'IA suscite la méfiance

La transparence en matière d'IA signifie faire preuve d'ouverture quant au fonctionnement des systèmes d'IA, y compris leur conception, les données qu'ils utilisent et leurs processus décisionnels. L'explicabilité va encore plus loin en garantissant que tout le monde, quelles que soient ses compétences techniques, puisse comprendre les décisions prises par l'IA et les raisons qui les motivent. Ces concepts contribuent à dissiper les craintes liées à l'IA, telles que les biais, les problèmes de confidentialité ou même les risques liés à des utilisations militaires autonomes.

Solutions

- Élaborez une documentation claire : fournissez des informations détaillées sur les modèles d'IA, leur processus de développement, les données utilisées et les processus décisionnels. Cela favorise une meilleure compréhension et établit les bases de la confiance.

- Mettre en œuvre des modèles d'IA explicables : utilisez des modèles qui offrent plus de transparence, tels que des arbres de décision ou des systèmes basés sur des règles, afin que les utilisateurs puissent voir exactement comment les entrées sont transformées en sorties.

- Utilisez des outils d'interprétabilité : appliquez des outils tels que LIME (Local Interpretable Model-agnostic Explanations) ou SHAP (SHapley Additive exPlanations) pour décomposer les contributions des différentes fonctionnalités dans le processus décisionnel du modèle.

3. La mise à l'échelle de l'IA est plus difficile qu'il n'y paraît

La mise à l'échelle de la technologie IA est essentielle pour les organisations qui souhaitent exploiter son potentiel dans différents secteurs d'activité. Cependant, la mise en place d'une infrastructure IA évolutive est une tâche complexe.

Malgré un retour sur investissement potentiellement élevé, de nombreuses entreprises ont du mal à passer des projets pilotes à un déploiement à grande échelle.

Le fiasco de Zillow dans le domaine de la revente immobilière constitue un rappel frappant des défis liés à l'évolutivité de l'IA. Leur IA, destinée à prédire les prix de l'immobilier à des fins lucratives, présentait des taux d'erreur pouvant atteindre 6,9 %, ce qui a entraîné de lourdes pertes financières et une dépréciation de 304 millions de dollars de leurs stocks.

Le défi de l'évolutivité est particulièrement évident en dehors des géants technologiques tels que Google et Amazon, qui disposent des ressources nécessaires pour exploiter efficacement l'IA. Pour la plupart des autres entreprises, en particulier celles qui ne sont pas spécialisées dans les technologies et qui commencent tout juste à explorer l'IA, les obstacles comprennent un manque d'infrastructure, de puissance de calcul, d'expertise et de mise en œuvre stratégique.

Solutions

- Infrastructure améliorée : développez une infrastructure numérique robuste capable de gérer des déploiements d'IA à grande échelle. Par exemple, les services cloud et les centres de données localisés réduisent la latence et améliorent les performances.

- Équipes interdisciplinaires : favorisez un environnement collaboratif où les équipes techniques et commerciales travaillent ensemble pour intégrer de manière transparente les solutions d'IA dans les modèles d'entreprise existants.

- Outils de développement automatisés de l'IA : utilisez des plateformes telles que evoML de TurinTech pour automatiser le développement de codes d'apprentissage automatique, ce qui permet une création et un déploiement plus rapides des modèles.

- Apprentissage et adaptation continus : mettez en place des mécanismes d'apprentissage et de mise à jour continus des modèles d'IA afin de vous adapter aux données du monde réel et à l'évolution des conditions du marché, garantissant ainsi leur pertinence et leur efficacité à long terme.

- Investissez dans le développement des talents : développez une expertise interne en IA grâce à des formations et des pratiques de recrutement axées sur les technologies émergentes en matière d'IA, afin de réduire la dépendance excessive vis-à-vis des talents externes dans ce domaine.

À lire également : Les statistiques essentielles sur l'IA à connaître aujourd'hui

4. Deepfake et fraude générative par IA

L'IA générative et les technologies deepfake transforment le paysage de la fraude, en particulier dans le secteur des services financiers. Elles permettent de créer plus facilement et à moindre coût des contrefaçons convaincantes.

Par exemple, en janvier 2024, un deepfake se faisant passer pour un directeur financier a ordonné à un employé de transférer 25 millions de dollars, démontrant ainsi les graves implications de ces technologies.

Cette tendance croissante met en évidence les défis auxquels sont confrontées les banques qui peinent à adapter leurs systèmes de gestion des données et de détection des fraudes afin de lutter contre des escroqueries de plus en plus sophistiquées qui trompent non seulement les particuliers, mais aussi les systèmes de sécurité automatisés.

Solutions

- Technologies de détection avancées : les banques doivent investir dans des technologies plus récentes capables de détecter plus efficacement les deepfakes et les anomalies générées par l'IA.

- Supervision humaine : l'intégration d'analyses humaines qualifiées aux réponses de l'IA améliore les taux de détection et aide à vérifier et à comprendre l'identification des fraudes par l'IA.

- Efforts collaboratifs de prévention de la fraude : l'établissement de partenariats au sein d'un même secteur et entre différents secteurs peut contribuer à développer des mécanismes plus robustes pour identifier et prévenir la fraude.

5. Défis liés à l'interopérabilité et à l'interaction entre l'homme et l'IA

Lorsque différentes organisations ou différents pays utilisent conjointement l'IA, ils doivent s'assurer que celle-ci se comporte de manière éthique, conformément aux règles de chacun. C'est ce qu'on appelle l'interopérabilité éthique, qui revêt une importance particulière dans des domaines tels que la défense et la sécurité.

À l'heure actuelle, les gouvernements et les organisations ont leurs propres règles et éthique. Par exemple, consultez les directives de Microsoft pour l'interaction entre l'homme et l'IA :

Cependant, il existe un manque de normalisation dans cette philosophie et ces règles à travers le monde.

À l'heure actuelle, les systèmes d'IA sont assortis de leurs propres règles éthiques, qui peuvent convenir dans un contexte donné, mais poser problème dans un autre. Lorsque ces systèmes interagissent avec des humains, s'ils ne se comportent pas comme prévu, cela peut entraîner des malentendus ou de la méfiance.

Solutions

- Définissez des normes éthiques universelles : convenez de règles éthiques de base que tous les systèmes d'IA doivent respecter, quelle que soit leur origine. Mettez l'accent sur l'équité, la responsabilité et la transparence.

- Utilisez un système de certification rigoureux : avant toute utilisation, tout système /IA doit passer un test rigoureux afin de confirmer qu'il respecte ces normes éthiques. Cela peut inclure des contrôles effectués par les créateurs, mais aussi par des groupes indépendants.

- Assurez-vous que tout le monde soit au courant : soyez toujours clair sur la manière dont l'IA prend ses décisions et utilise les données. Cette transparence contribue à instaurer la confiance et facilite l'intégration de différents systèmes d'IA.

- Gardez un œil sur les choses : vérifiez régulièrement les systèmes d'IA pour vous assurer qu'ils continuent de respecter les normes éthiques. Mettez-les à jour si nécessaire pour vous adapter aux nouvelles règles ou technologies.

6. L'éthique de l'IA ne se limite pas à de bonnes intentions

L'intelligence artificielle (IA) s'immisce dans presque tous les aspects de notre vie, des voitures autonomes aux assistants virtuels, et c'est formidable ! Mais il y a un hic : la manière dont nous utilisons l'IA peut parfois soulever de sérieux problèmes éthiques. Il existe des questions éthiques épineuses concernant la confidentialité, les préjugés, la suppression d'emplois, etc.

L'IA étant capable de faire des tâches qui étaient auparavant réservées aux humains, la question de savoir si elle devrait même en faire certaines fait l'objet d'un vaste débat.

Par exemple, l'IA devrait-elle écrire des scénarios de films ? Cela semble cool, mais cela a provoqué un énorme remous dans le monde du divertissement, avec des grèves aux États-Unis et en Europe. Et il ne s'agit pas seulement de savoir quels emplois l'IA peut remplacer, mais aussi comment elle utilise nos données, prend des décisions et parfois même se trompe. Cela pousse tout le monde, des développeurs technologiques aux juristes, à se démener pour trouver comment gérer l'IA de manière responsable.

Solutions

- Clarifiez les règles : élaborez des directives claires sur la manière dont l'IA doit être utilisée. Cela implique de fixer des limites pour éviter toute utilisation abusive et de comprendre les implications juridiques des actions de l'IA.

- Respectez la confidentialité : d'énormes quantités de données, y compris des informations personnelles, sont utilisées pour entraîner l'IA. Nous devons être extrêmement prudents quant à la manière dont ces données sont collectées, utilisées et protégées. Il s'agit de s'assurer que l'IA respecte notre confidentialité.

- Lutter contre les biais : l'IA n'est efficace que dans la mesure où les données sur lesquelles elle s'appuie le sont, et ces données comportent parfois des biais. Nous devons éliminer ces biais des systèmes d'IA afin de garantir leur équité et leur non-discrimination.

- Protégez la propriété intellectuelle : l'IA peut produire du travail basé sur ce qu'elle a appris des créations d'autres personnes. Cela peut porter atteinte aux droits d'auteur et priver les créateurs de leur dû si nous ne faisons pas attention.

- Éthique ou rapidité : dans la course effrénée pour commercialiser les dernières technologies /IA, l'éthique peut être mise de côté. Nous devons trouver un équilibre entre la nécessité d'aller vite et celle de bien faire les choses.

7. Le mélange des ensembles de données IA pourrait être catastrophique

Lors du développement de modèles d'apprentissage automatique basés sur l'IA, il peut être difficile de faire la distinction entre les ensembles de données d'entraînement, de validation et de test. L'ensemble de données d'entraînement du modèle d'IA sert à former le modèle, l'ensemble de données de validation permet de l'ajuster et l'ensemble de données de test évalue ses performances.

Cette erreur peut gravement nuire à la capacité du modèle à fonctionner efficacement dans des applications d'IA réelles, où l'adaptabilité et la précision sur des données standardisées sont des clés.

Solutions

- Division structurée des données : adoptez une approche systématique pour diviser les données en ensembles d'entraînement, de validation et de test.

- Techniques de validation croisée : utilisez des méthodes de validation croisée, en particulier dans les scénarios où les données sont limitées. Des techniques telles que la validation croisée K-fold permettent d'optimiser l'utilisation de la formation et fournissent une estimation plus fiable des performances du modèle sur des données inconnues.

- Randomisation des données : assurez-vous que la répartition des données est aléatoire afin d'éviter tout biais introduit par l'ordre des données. Cela permet de créer des ensembles d'entraînement et de validation représentatifs de l'ensemble des données.

8. Risques et préoccupations liés à la prise de décision par automatisation

Lorsque l'IA prend des décisions, les choses peuvent se compliquer, en particulier dans des domaines critiques tels que la santé et la banque. L'un des principaux problèmes réside dans le fait que nous ne pouvons pas toujours comprendre comment les systèmes d'IA prennent leurs décisions.

Cela peut conduire à des décisions injustes que personne ne peut expliquer. De plus, ces systèmes sont la cible de pirates informatiques qui, s'ils parviennent à y pénétrer, pourraient voler de nombreuses données importantes.

Solutions

- Développez des protocoles de sécurité robustes : assurez-vous que les systèmes IA sont bien protégés contre les pirates informatiques. Continuez à mettre à jour la sécurité pour combler toute nouvelle faille qui pourrait apparaître.

- Améliorez la transparence : utilisez des technologies qui aident l'IA à expliquer ses choix en termes simples. Si tout le monde comprend comment les décisions sont prises, les gens feront davantage confiance à l'IA.

- Protégez les informations privées : assurez la sécurité de toutes les données personnelles traitées par l'IA. Respectez les lois telles que le RGPD afin de garantir la confidentialité des données personnelles.

- Encouragez la collaboration multidisciplinaire : rassemblez des experts de tous les champs (technologie, droit, éthique) afin qu'ils travaillent ensemble. Ils peuvent contribuer à garantir que les décisions prises par l'IA sont équitables et sûres.

À lire également : Les outils d'IA les plus populaires auprès des étudiants

9. Absence de règles et de réglementations claires en matière d'IA

À l'heure actuelle, il n'existe pas d'organisme mondial de surveillance de l'IA ; la réglementation varie selon les pays et même selon les secteurs. Par exemple, il n'existe aucun organisme central spécifiquement dédié à l'IA aux États-Unis.

Cette approche décentralisée peut entraîner des incohérences et de la confusion ; différentes normes peuvent s'appliquer selon le lieu et la manière dont l'IA est déployée. Il est donc difficile pour les développeurs et les utilisateurs d'IA de s'assurer qu'ils sont en totale conformité avec toutes les juridictions.

Solutions

- Créer un organisme de réglementation dédié à l'IA : les pays pourraient tirer profit de la création d'une agence spécifique dédiée à l'IA. Cet organisme pourrait superviser tous les problèmes liés à l'IA, suivre le rythme rapide du développement de l'IA et garantir le respect des normes de sécurité et d'éthique.

- Coopération internationale : l'IA ne s'arrête pas aux frontières. Les pays doivent travailler ensemble pour créer des normes et des accords internationaux sur l'utilisation de l'IA, à l'instar des traités mondiaux en matière de protection de l'environnement.

- Une législation claire et adaptative : les lois doivent être claires (afin que les entreprises sachent comment s'y conformer), mais aussi suffisamment souples pour s'adapter aux nouvelles avancées en matière d'IA. Des mises à jour et des révisions régulières des lois sur l'IA pourraient contribuer à les maintenir pertinentes.

- Participation du public et des parties prenantes : les réglementations doivent être élaborées avec la contribution d'un large éventail de parties prenantes, notamment les entreprises technologiques, les éthiciens et le grand public. Cela permet de garantir la prise en compte de divers points de vue et de renforcer la confiance du public dans les systèmes d'IA.

À lire également : Outils d'IA pour les avocats

10. Désinformation provenant de l'IA

Imaginez disposer d'une technologie capable de penser comme un être humain. C'est la promesse de l'intelligence artificielle générale (AGI), mais elle comporte des risques importants. La désinformation est l'un des principaux problèmes à cet égard.

Avec l'AGI, il est facile de créer des fausses informations ou des informations erronées convaincantes, ce qui rend plus difficile pour tout le monde de distinguer le vrai du faux.

De plus, si l'AGI prend des décisions sur la base de ces informations erronées, cela peut entraîner des conséquences désastreuses, affectant tout, de la politique à la vie privée.

Solutions

- Mettez en place des contrôles rigoureux : vérifiez toujours les faits avant de laisser l'AGI diffuser des informations. Utilisez des sources fiables et confirmez les détails avant toute publication.

- Enseigner l'éthique à l'AGI : tout comme nous enseignons aux enfants à distinguer le bien du mal, nous devons enseigner à l'AGI les comportements éthiques. Cela implique notamment de comprendre l'impact de la diffusion de fausses informations et de prendre des décisions justes et équitables.

- Gardez les humains dans la boucle : quelle que soit l'intelligence de l'AGI, impliquez toujours les humains dans le processus décisionnel. Cela permet de détecter les erreurs et de s'assurer que les actions de l'AGI reflètent nos valeurs et notre éthique.

- Créez des règles claires : établissez des directives strictes sur ce que l'AGI peut et ne peut pas faire, en particulier en matière de création et de diffusion d'informations. Veillez à ce que ces règles soient respectées à la lettre.

À lire également : Le glossaire complet de l'IA

Outils pour relever les défis liés à l'IA

Lorsque vous êtes plongé dans l'IA, choisir les bons outils n'est pas seulement un plus, c'est une nécessité pour éviter que votre aventure dans l'IA ne tourne au désastre. Il s'agit de simplifier la complexité, de garantir la sécurité de vos données et d'obtenir l'assistance dont vous avez besoin pour relever les défis de l'IA sans vous ruiner.

La clé réside dans le choix d'un logiciel d'IA sur mesure qui améliore la productivité tout en préservant votre confidentialité et la sécurité de vos données.

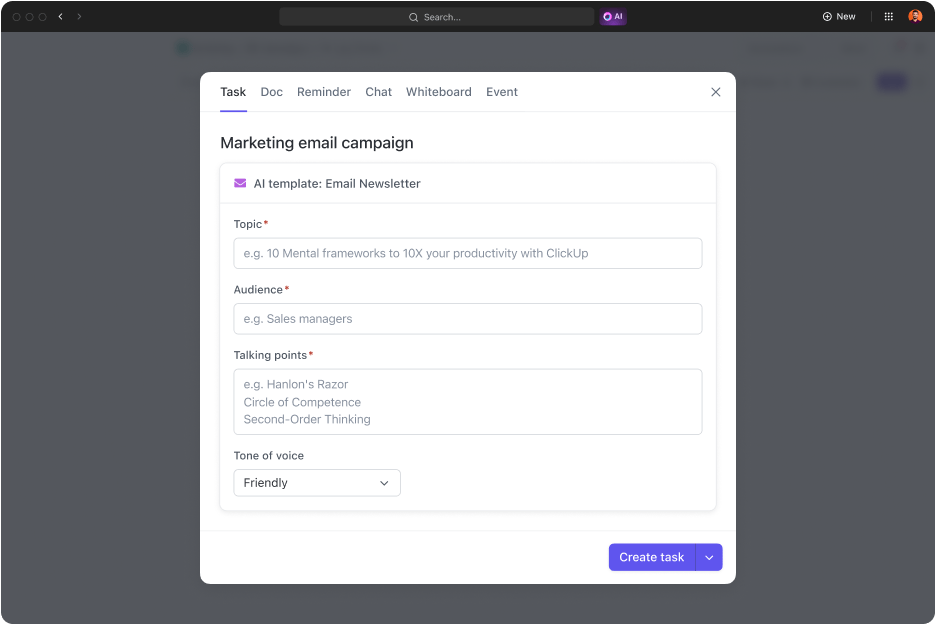

Découvrez ClickUp Brain, le couteau suisse de l'IA sur votre lieu de travail.

ClickUp Brain : efficacité, sécurité et innovation, tout en un

ClickUp Brain est conçu pour gérer tout ce qui touche à l'IA, de la gestion de vos projets et documents à l'amélioration de la communication au sein de votre équipe. Grâce aux capacités d'IA de ClickUp Brain, vous pouvez relever les défis liés aux données, améliorer la gestion de projet et booster votre productivité, tout en conservant une approche simple et sécurisée. ClickUp Brain est une solution complète qui :

- S'intègre parfaitement à votre travail quotidien

- Assurez-vous que vos données restent les vôtres

- Économisez votre argent et vos ressources

ClickUp Brain s'intègre intelligemment à votre flux de travail pour vous faire gagner du temps et vous épargner des efforts, tout en protégeant vos données. Il est (comme le reste de la plateforme ClickUp) conforme au RGPD et n'utilise pas vos données à des fins de formation.

Voici comment cela fonctionne :

- Gestion des connaissances par l'IA : Vous avez toujours rêvé d'obtenir des réponses instantanées et précises à partir de vos documents de travail ou de vos discussions ? ClickUp Brain rend cela possible. Plus besoin de passer des heures à fouiller dans vos fichiers. Il suffit de demander pour obtenir la réponse, qu'il s'agisse d'informations détaillées issues d'un document de projet ou d'informations issues des dernières mises à jour de l'équipe.

- Gestion de projet par l'IA : imaginez avoir un assistant IA qui vous aide à mener à bien vos projets. De l'automatisation des mises à jour des tâches au résumé de l'avancement des projets, ClickUp Brain se charge des tâches fastidieuses afin que vous puissiez vous concentrer sur la vue d'ensemble.

- AI Writer for Work : cet outil change la donne pour tous ceux qui redoutent l'écriture. Que vous rédigiez un e-mail rapide ou un rapport complet, ClickUp Brain vous aide à affiner votre prose, à vérifier votre orthographe et à ajuster votre ton à la perfection.

Réunion pour relever les défis de l'IA avec les bons outils

Malgré les défis liés à l'IA dont nous avons discuté, nous pouvons convenir que l'intelligence artificielle a fait beaucoup de chemin. Elle est passée d'une automatisation de base à des systèmes sophistiqués capables d'apprendre, de s'adapter et de prédire des résultats. Beaucoup d'entre nous ont désormais intégré l'IA dans divers aspects de leur vie, des assistants virtuels aux outils avancés de collecte et d'analyse de données.

À mesure que l'IA progresse, nous pouvons nous attendre à encore plus d'innovations, de piratages et d'outils d'IA pour améliorer la productivité, optimiser la prise de décision et révolutionner les industries. Ces progrès ouvrent de nouvelles possibilités et nous conduisent vers un avenir où l'IA jouera un rôle crucial tant dans la sphère personnelle que professionnelle.

Grâce à des outils d'IA tels que ClickUp Brain, vous pouvez tirer le meilleur parti des technologies d'IA tout en vous protégeant contre les défis liés à la confidentialité et à la sécurité des données. ClickUp est votre outil de gestion des tâches basé sur l'IA, idéal pour tout type de projet, du développement logiciel au marketing. Choisissez ClickUp pour transformer en toute sécurité votre organisation en une entité basée sur les données et l'IA, tout en augmentant la productivité de votre équipe.

Prêt à transformer vos flux de travail grâce à l'IA ? Inscrivez-vous dès maintenant à ClickUp !