A استطلاع ديلويت أن 75% من الشركات قد بدأت في اختبار تقنيات الذكاء الاصطناعي التوليدي، وأن 65% من الشركات تستخدمها داخليًا، و31% منها تستخدمها للاستهلاك الخارجي.

من المحتمل أنك واحد منهم أو أنك في طريقك لتبني تقنيات الذكاء الاصطناعي.

في كلتا الحالتين، إذا كنت قلقاً بشأن خصوصية البيانات والآثار الأخلاقية المترتبة على استخدام الذكاء الاصطناعي في عمل الشركة - فأنت في صحبة جيدة. خصوصية البيانات، وتسمم البيانات، والمخاطر الأخلاقية الجسيمة هي بعض المخاوف الأكثر إلحاحًا عند استخدام تقنيات الذكاء الاصطناعي الجيني.

في مثل هذا السيناريو، كيف يمكنك ضمان الاستخدام الشفاف والمسؤول والأخلاقي لتقنيات الذكاء الاصطناعي وتهيئة شركتك للنجاح في المستقبل؟

اقرأ هذا الدليل لاكتشاف كيفية وضع سياسة فعالة للذكاء الاصطناعي لشركتك.

ما هي سياسة الذكاء الاصطناعي؟

سياسة شركة الذكاء الاصطناعي هي وثيقة تحدد المبادئ التوجيهية والبروتوكولات الخاصة بالتطبيق الأخلاقي والمسؤول لتقنيات الذكاء الاصطناعي في الشركة. يضمن هذا الإطار استخدام الذكاء الاصطناعي بشكل آمن وأخلاقي واستراتيجي لتحقيق أهداف عملك.

يُعد إنشاء سياسة للذكاء الاصطناعي لشركتك خطوة قوية نحو التمكين والتحكم. ويمكن أن يؤدي أيضًا إلى زيادة ثقة العملاء وتحسين الكفاءة والميزة التنافسية في السوق.

دعنا نستكشف لماذا تُعد هذه السياسة أداة حاسمة لشركتك.

تساعد في الحفاظ على المعايير الأخلاقية

سياسة الذكاء الاصطناعي هي التزام بالحفاظ على المعايير الأخلاقية. فهي تضمن تطوير تقنيات الذكاء الاصطناعي ونشرها واستخدامها بطريقة تتماشى مع المعايير المجتمعية وقيم العمل، مما يعزز الشعور بالمسؤولية والالتزام في شركتك.

من خلال تضمين الاعتبارات الأخلاقية في حوكمة الذكاء الاصطناعي ، تدعم سياسة الذكاء الاصطناعي المعايير الأخلاقية المتمثلة في:

- الشفافية: يجب أن تنقل أنظمة الذكاء الاصطناعي منطقها بطريقة يمكن لأي شخص فهمها. وتساعد هذه الشفافية الموظفين على فهم عمل أنظمة الذكاء الاصطناعي وتحديد الأخطاء والحفاظ على دقة النظام والعمل

- عدم التحيز: هذا جانب حاسم في سياسة الذكاء الاصطناعي. فهو يضمن أن تكون النتائج التي يولدها الذكاء الاصطناعي عادلة وغير تمييزية وغير مسيئة، وكلها أمور بالغة الأهمية لنزاهة أنظمة الذكاء الاصطناعي

- الخصوصية: يجب الحفاظ على أعلى مستويات الأمان والسرية في أي بيانات للشركة يتم الاستفادة منها بواسطة تقنيات الذكاء الاصطناعي. وهذا يساعد على منع انتهاكات البيانات ويضمن عدم إساءة استخدام البيانات الخاصة

يضمن الامتثال القانوني

لا يخفى على أحد أن الجهات الفاعلة السيئة تستخدم تقنيات الذكاء الاصطناعي لأغراض شائنة، بما في ذلك الهجمات الإلكترونية والبرمجيات الخبيثة والقرصنة الآلية وغيرها. ومع استمرار تزايد المخاوف بشأن سوء الاستخدام المحتمل للذكاء الاصطناعي، بدأت الحكومات في جميع أنحاء العالم في وضع مبادئ توجيهية لتنظيم استخدام الذكاء الاصطناعي.

على سبيل المثال، قام الاتحاد الأوروبي بوضع قانون الذكاء الاصطناعي الأكثر شمولاً في العالم - وهو قانون الذكاء الاصطناعي -الذي سينظم استخدام الذكاء الاصطناعي في الأشهر المقبلة. يوفر هذا القانون قواعد لتقييم مستويات مختلفة من المخاطر التي تشكلها أنظمة الذكاء الاصطناعي. كما ينص على قواعد لتطوير واستخدام تقنيات الذكاء الاصطناعي في المؤسسات.

وقد أصدر البيت الأبيض أيضًا دليلًا إرشاديًا - وهو مخطط لوثيقة حقوق الذكاء الاصطناعي -لحماية المواطنين الأمريكيين من التهديدات التي يشكلها الاستخدام غير السليم لتكنولوجيا الذكاء الاصطناعي. يحدد هذا المخطط خمسة مبادئ يجب أن يُسترشد بها في تصميم ونشر واستخدام الأنظمة التي تعمل بالذكاء الاصطناعي في الولايات المتحدة. هذه المبادئ الخمسة هي

- الحماية من التمييز الخوارزمي

- أنظمة آمنة وفعالة

- خصوصية البيانات

- البدائل البشرية والمراعاة والاحتياط

- الإشعار والشرح

تساعدك سياسة الذكاء الاصطناعي على التنقل في المشهد القانوني المعقد المحيط بتقنيات الذكاء الاصطناعي. فهي تضمن الامتثال للوائح ذات الصلة والقوانين المعمول بها ومعايير الصناعة التي تحكم خصوصية البيانات وحقوق الملكية الفكرية. وهي تساعد في نهاية المطاف على حماية شركتك من المزالق القانونية وحماية عملائك من الهجمات القائمة على الذكاء الاصطناعي.

يستفيد منه الموظفون

مع قيام الذكاء الاصطناعي بإعادة تحديد الأدوار الوظيفية وديناميكيات مكان العمل، يمكن لسياسة واضحة للذكاء الاصطناعي للشركات أن تساعد الموظفين على التكيف مع التغييرات التي تعتمد على الذكاء الاصطناعي في شركتك، مما يوفر لهم الدعم والتوجيه الذي يحتاجونه.

يساعد ذلك الموظفين على فهم أدوارهم الوظيفية المتطورة، وتنفيذ المهام باستخدام الذكاء الاصطناعي، والاستفادة من هذه التقنيات بفعالية في عملهم.

تدعم السياسة أيضاً تطوير الموظفين من خلال برامج تدريبية منظمة. تزود هذه البرامج الموظفين بالمهارات والموارد والدعم الذي يحتاجونه للتكيف والنمو في مجال الذكاء الاصطناعي. ونتيجة لذلك، تعمل سياسة الذكاء الاصطناعي على تنمية الشعور بالتمكين وتعزيز النمو المهني.

تُعد سياسة الذكاء الاصطناعي المصممة جيدًا أمرًا محوريًا في تنمية مكان عمل أخلاقي وشامل. فهي تحدد معايير واضحة لاستخدام الذكاء الاصطناعي، لا سيما في المجالات الحساسة مثل التوظيف وتقييم الأداء، وتعمل بنشاط على التخفيف من التحيزات المختلفة - مثل التحيزات الجنسانية والعرقية والعمرية والاجتماعية والاقتصادية والإعاقة والثقافية والتعليمية والتحيزات المتعلقة بتأكيد الهوية.

وهذا يعزز المساواة في شركتك ويضمن حصول جميع الموظفين على معاملة عادلة ومنصفة.

يساعد على تعزيز تجربة العملاء

يتوقع عملاؤك خدمة سريعة وشخصية. تساعدك سياسة الذكاء الاصطناعي على تلبية توقعات العملاء هذه بسهولة. فهي تضمن أن كل تفاعل، سواء من خلال روبوت الدردشة أو نظام التوصيات، يحقق التوازن المثالي بين الكفاءة والتخصيص.

تعزز سياسة الذكاء الاصطناعي المدروسة جيداً ولاء العملاء من خلال ضمان تجربة متسقة للعلامة التجارية. يصبح كل تفاعل للذكاء الاصطناعي امتداداً لعملك، ويعكس بأمانة صوت علامتك التجارية وشخصيتك وقيمك. تعزز هذه السفيرة الرقمية علامتك التجارية في كل نقطة اتصال مع العملاء.

بالإضافة إلى الولاء، فهي تساعدك على بناء ثقة العملاء. يعرف العملاء الذين يدركون سياسة الذكاء الاصطناعي الخاصة بك أن تفاعلاتهم مع الذكاء الاصطناعي (ضمن نطاق مؤسستك) عادلة وشفافة وآمنة لأن سياسة الذكاء الاصطناعي تحمي من إساءة الاستخدام المحتملة لبيانات العملاء وتحمي معلومات العملاء.

تساعدك سياسة الذكاء الاصطناعي المصممة بشكل جيد على إنشاء تجارب ذكاء اصطناعي تتمحور حول العملاء، والتي تتفهم احتياجات العملاء ورغباتهم وملاحظاتهم وتستجيب لها بصدق.

خطوات لإنشاء سياسة فعالة للذكاء الاصطناعي لشركتك

الآن بعد أن أصبحت على دراية بفوائد سياسة الذكاء الاصطناعي، إليك خطوات إنشاء سياسة الذكاء الاصطناعي الخاصة بك:

1. إشراك أصحاب المصلحة ورؤساء الأقسام

يتطلب إنشاء سياسة فعالة للذكاء الاصطناعي مدخلات من وجهات نظر متنوعة. قم بتكوين مجموعة من أصحاب المصلحة ورؤساء الأقسام والمديرين التنفيذيين للأعمال وممثلي الشؤون القانونية والموارد البشرية والخبراء التقنيين. تأكد من أن أعضاء المجموعة الطويلة لديهم فهم أساسي للذكاء الاصطناعي وفوائده ومخاطره.

2. إجراء تقييم للاحتياجات وتحديد الغرض

تقييم التقدم المحرز في مختلف المجالات وتحديد المهام المتكررة والاختناقات التي يمكن أن تستفيد من الأتمتة. بعد إجراء تقييم شامل للاحتياجات، حدد الغرض من السياسة وما تهدف إلى تحقيقه من خلال هذه السياسة.

على سبيل المثال، هل هو تعزيز الاستخدام الأخلاقي والمسؤول للذكاء الاصطناعي أو تحسين الكفاءة أو ضمان الامتثال؟ سيؤدي تحديد الغرض إلى تشكيل اتجاه السياسة.

3. تحديد النطاق

تحديد مجالات العمل المحددة التي سيتم تطبيق الذكاء الاصطناعي فيها. ضع في اعتبارك ما إذا كنت تريد اعتماد استراتيجية ذكاء اصطناعي على مستوى المؤسسة أو التركيز على مجالات معينة مثل تحليل البيانات أو خدمة العملاء أو وظائف أخرى. بمجرد تحديد النطاق، حدد أدوات وتقنيات الذكاء الاصطناعي المناسبة لدعم التطبيقات المختارة.

4. تحديد متطلبات السياسة

حدد العناصر الأساسية للسياسة بشكل تعاوني. يمكن أن تكون المتطلبات:

- الامتثال للمعايير القانونية والتنظيمية

- اللوائح التنظيمية الخاصة بالصناعة

- المعايير الأخلاقية

- معايير إدارة البيانات

- بروتوكولات الخصوصية والأمان

بعد اتخاذ قرار بشأن المتطلبات، ضع المبادئ التوجيهية والبروتوكولات. سيساعدك ذلك على تشكيل ما يجب فعله وما لا يجب فعله لاستخدام الذكاء الاصطناعي في شركتك و التخفيف من المخاطر المحتملة.

5. إعداد موارد للتدريب

ضع مبادئ توجيهية لتدريب الموظفين. قدم ورش عمل أو وحدات تدريبية عبر الإنترنت مصممة خصيصًا للأدوار المختلفة داخل مؤسستك. قم بإعداد مجموعة متنوعة من موارد وإجراءات التدريب التي يمكن للموظفين استخدامها.

6. إنشاء المساءلة والحوكمة

حدد الأشخاص المسؤولين عن الإشراف على تنفيذ وتطبيق سياسة الذكاء الاصطناعي التوليدي في شركتك. إنشاء هيكل حوكمة للذكاء الاصطناعي مع آليات مساءلة واضحة.

على سبيل المثال، يمكنك تعيين مسؤول رئيسي للذكاء الاصطناعي، أو تشكيل لجنة أخلاقيات الذكاء الاصطناعي متعددة الوظائف، أو استخدام برنامج GRC لمراقبة الامتثال والتعامل مع المعضلات الأخلاقية وإدارة المخاطر المتعلقة بالذكاء الاصطناعي.

7. تنفيذ عمليات المراقبة والمراجعة

وضع إجراءات للمراقبة المستمرة والمراجعة الدورية لأنظمة الذكاء الاصطناعي وفعالية السياسات. من خلال الاستثمار في هذه العمليات، يمكن للمؤسسات أن تجني فوائد الذكاء الاصطناعي مع التخفيف من المخاطر وبناء أساس قوي لتطوير الذكاء الاصطناعي المسؤول.

على سبيل المثال، يمكنك إنشاء مجلس مراجعة وتلقي ملاحظات الموظفين بانتظام. سيساعدك ذلك على تحديث السياسة استجابةً للمراجعات والتعليقات.

8. إنشاء مسودة للسياسة

اجمع المعلومات من الخطوات المذكورة أعلاه وقم بإنشاء مسودة للسياسة. فيما يلي نظرة عامة على جميع النقاط التي يجب أن تغطيها المسودة:

- المقدمة: صف بإيجاز الغرض من سياستك وأهميتها

- الغرض: اذكر أهداف سياستك وغاياتها

- النطاق: حدد المجالات التي سيتم فيها استخدام تقنيات الذكاء الاصطناعي

- التعاريف: حدد أنواع أدوات وتقنيات الذكاء الاصطناعي التي ستشملها سياستك

- دليل الاستخدام الأخلاقي: اذكر المبادئ التوجيهية لدعم المعايير الأخلاقية في استخدام الذكاء الاصطناعي داخل شركتك

- الامتثال القانوني: قدم وصفًا موجزًا للقوانين وتدابير الامتثال ذات الصلة

- حواجز حماية البيانات: اذكر المبادئ التوجيهية والبروتوكولات الخاصة بإدارة البيانات وضمان خصوصية البيانات

- التدريب والموارد: أضف وصفًا موجزًا للتدريب والموارد المتاحة للموظفين

- التنفيذ والمراقبة: حدد من سيكون مسؤولاً عن ضمان التنفيذ ومراقبة التأثير وجمع الملاحظات حول سياسة الذكاء الاصطناعي

- عقوبات انتهاك السياسة: وصف الظروف التي تشير إلى انتهاك سياسة الذكاء الاصطناعي والعواقب المرتبطة بها

- الجدول الزمني لمراجعة السياسة: قم بإعداد الجدول الزمني للمراجعات المنتظمة للسياسة وتحديثات السياسة، إذا لزم الأمر

- بيانات السريان والموافقة: اذكر التاريخ الذي ستصبح فيه سياسة الذكاء الاصطناعي سارية المفعول ووفر مساحة للموظفين للإقرار بموافقتهم على هذه السياسة والتزامهم بها

9. مراجعة السياسة ووضعها في صيغتها النهائية والإبلاغ عنها

بعد صياغة السياسة، اطلب التعليقات من أصحاب المصلحة والمستشارين القانونيين. معالجة أي ثغرات تم تحديدها ومراجعة السياسة وتنقيحها لضمان وضوحها وامتثالها للقانون وقابليتها للتنفيذ. تقديم السياسة إلى مجلس الإدارة أو الإدارة العليا للموافقة عليها. عند الحصول على موافقتهم، قم بتوزيع السياسة على جميع الموظفين وابدأ في دمج تقنيات الذكاء الاصطناعي داخل الشركة.

أفضل الممارسات لإنشاء سياسة فعالة للذكاء الاصطناعي لشركتك

اتبع هذه الاستراتيجيات أثناء وضع سياسة الذكاء الاصطناعي للشركة:

- استخدم لغة بسيطة يسهل فهمها

- إضافة قائمة بأدوات الذكاء الاصطناعي المعتمدة والمحظورة

- إنشاءحوكمة البيانات وضع معايير وتوضيح نوع البيانات التي يمكن للموظفين إدخالها في أنظمة الذكاء الاصطناعي والتي لا يمكنهم إدخالها

- كن واضحًا بشأن المشكلات والنتائج التي يمكن أن تنشأ إذا تم تجاهل السياسة

- اجعل السياسة وثيقة حية - قم بتحديثها بناءً على المراجعات والتطورات التكنولوجية والتغييرات التنظيمية

- استخدم أدوات إدارة المشروع لإدارة المهام، والتعاون، وتخفيف المخاطر، وتحسين الموارد

اقرأ أيضًا: أفضل 10 برامج لإدارة البيانات في عام 2024 (المراجعات والأسعار)

استخدام ClickUp في إنشاء سياسة الذكاء الاصطناعي

غالباً ما تتضمن سياسة فعالة للذكاء الاصطناعي مدخلات من مختلف الأقسام، بما في ذلك الأقسام القانونية والموارد البشرية وتكنولوجيا المعلومات والعمليات. قد يكون التنسيق بين هذه الجهات المعنية أمرًا صعبًا. تعدد الاستخدامات أداة الذكاء الاصطناعي لإدارة المشاريع مثل ClickUp يمكنها تبسيط إنشاء السياسات والتعاون والإدارة.

تقدم ClickUp ميزات مصممة لتبسيط كتابة الإجراءات وتنفيذ إرشادات الذكاء الاصطناعي. دعونا نفحص هذه الميزات.

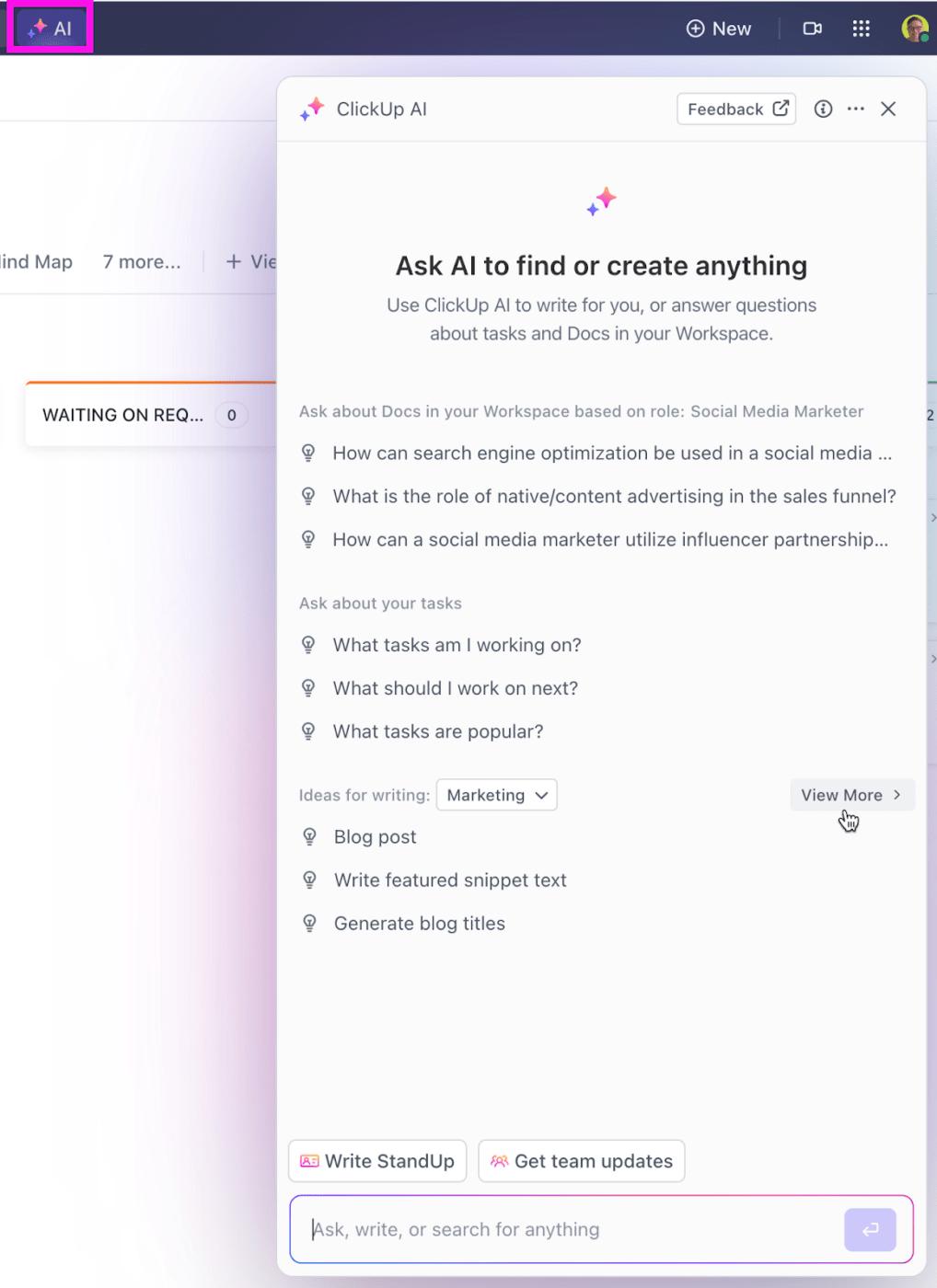

قدرات الذكاء الاصطناعي المتقدمة ClickUp Brain هو مجموعة من ميزات الذكاء الاصطناعي التي تتيح لك إدارة المراحل الأولية لصياغة سياسة الذكاء الاصطناعي بشكل أفضل. استخدمها للعصف الذهني وتوليد الأفكار في أبحاث سياسات الذكاء الاصطناعي. يمكن ل ClickUp Brain اقتراح الكلمات المفتاحية ذات الصلة، وتوسيع نطاق البحث، والمساعدة في تحديد مجالات التركيز المحتملة للسياسة.

💡 نصيحة احترافية: ألا تريد قراءة تقارير بحثية مطولة عند صياغة سياسة الذكاء الاصطناعي؟ استفد من ClickUp Brain لتلخيص المستندات وإنشاء نقاط مهمة.

إنشاء محتوى مخصص، وإنشاء جداول أعمال الاجتماعات وتحديثات التقدم، والمزيد باستخدام ClickUp Brain

استخدم ClickUp Brain كأداة إنتاجية لـ

- تلخيص الأوراق البحثية أو التقارير المعقدة وإنشاء جداول الأعمال

- إنشاء العروض التقديمية وموجزات المشاريع والجداول الزمنية

- إنشاء عناصر عمل ومهام فرعية

- إصلاح الأخطاء الإملائية وإزالة الأخطاء الإملائية باستخدام التدقيق الإملائي المدمج

- تنسيق النص وتحريره لضمان وضوحه وتأثيره

يمكنك الوصول إلى ClickUp Brain على أي جهاز ذكي - الهواتف المحمولة أو أجهزة iPad أو أجهزة الكمبيوتر المحمولة - بغض النظر عن نظام التشغيل أو الموقع.

علاوة على ذلك، تظل البيانات التي تدخلها في ClickUp Brain آمنة ومحمية. حصلت ClickUp على ترخيص يضمن أن تظل بيانات شركتك الحساسة خاصة ولا يمكن استخدامها لتدريب نماذج الذكاء الاصطناعي.

ترجم مستنداتك بلغات مختلفة على الفور باستخدام ClickUp Brain

💡 نصيحة احترافية: استخدم أداة الذكاء الاصطناعي في ClickUp Brain لترجمة السياسات إلى لغات متعددة، مما يضمن إمكانية الوصول إلى مجموعات لغوية متنوعة داخل شركتك.

توثيق مركزي مستندات ClickUp يتيح لك التعاون في الوقت الفعلي مع أصحاب المصلحة ورؤساء الأقسام والممثلين القانونيين وغيرهم الكثير. كما يمكّنك من صياغة سياسة الذكاء الاصطناعي مباشرةً داخل المستند.

قم بصياغة وثيقة السياسة وتخزينها في مستند ClickUp Doc مخصص، مما يضمن وصول الجميع إلى الإصدار الحالي. منح الأذونات المناسبة لأصحاب المصلحة المعنيين لسهولة الوصول والتعاون، والاحتفاظ بسجل واضح لتطور السياسة لأغراض الامتثال والمساءلة.

التعاون في الوقت الفعلي وصياغة المستندات بسهولة باستخدام ClickUp Docs لإنشاء سياسة الذكاء الاصطناعي للشركة

استخدم ClickUp Docs لـ

- تضمين قوائم المراجعة والإشارات المرجعية وإضافة الجداول والمزيد

- تخصيص حجم الخط والنمط والتفاصيل الأخرى لوثيقة سياسة الذكاء الاصطناعي الخاصة بك

- تتبّع عدد الكلمات ووقت القراءة لكل صفحة

- تحويل النص إلى مهام وتعيين المهام لأعضاء المجموعة

- وسم الآخرين بالتعليقات والتواصل بسهولة

- تتبع التقدم المحرز وتغيير حالة المهام والمشروع

- حماية مستندات عملك باستخدام عناصر التحكم في الخصوصية والتحرير

- مشاركة سياسة الذكاء الاصطناعي الخاصة بشركتك ومستندات العمل بأمان مع الموظفين

اقرأ أيضًا: كيفية استخدام الذكاء الاصطناعي للتوثيق

الأطر المدمجة

مع النقر فوق القوالب بين يديك طريقة أسرع وأسهل لصياغة وثيقة سياسة شركتك للذكاء الاصطناعي. يمكنك العثور على قوالب تتراوح بين سياسة الشركة و قوالب وثائق العمليات إلى إجراءات التشغيل الموحدة و قوالب الحوكمة . دعنا نستكشف بعض أهم القوالب المتعلقة بالسياسات بالتفصيل.

قالب كتيبات وسياسات وإجراءات الموظفين في #### ClickUp**

نموذج كتيبات كتيبات وسياسات وإجراءات الموظف في ClickUp

الـ قالب كتيبات وسياسات وإجراءات الموظف ClickUp يساعدك على إنشاء مستند شامل لتوصيل توقعات شركتك وسياساتها وإجراءاتها إلى موظفيك. على غرار قالب إجراءات التشغيل الموحدة ، يتيح لك هذا الإطار تحديد الأدوار والحقوق الوظيفية للموظفين، وتقليل الالتباس وسوء الفهم، وخلق بيئة عمل آمنة.

قالب مذكرة سياسة النقر فوق قالب مذكرة السياسة

قالب مذكرة سياسة ClickUp's Policy Memo Template

الـ قالب مذكرة سياسة ClickUp يسمح لك ببدء مسار عمل جديد أو إدخال تغييرات في السياسة بكل سهولة. يمكنك استخدام هذا النموذج كقالب لسياسة الذكاء الاصطناعي لمساعدتك في إنشاء مذكرات شاملة تحدد كيفية تفسير وتنفيذ سياسات الذكاء الاصطناعي المختلفة في شركتك. قوالب سياسة الشركة تساعدك مثل هذه النماذج على ضمان اطلاع الموظفين على سياسات شركتك والتزامهم بقواعدها ولوائحها.

قالب العمليات والإجراءات الخاصة بـ ClickUp's Process and Procedures Template**

قالب عملية وإجراءات ClickUp

الـ نموذج عملية ClickUp وإجراءاتها يتيح لك إدارة عملياتك في مكان واحد. باستخدام هذا القالب، يمكنك بسهولة إعداد عملياتك وتتبعها. استخدمه لإنشاء عمليات موحدة للعمل على المهام وتنظيم الإجراءات باستخدام لوحات كانبان وتقليل الأخطاء المكلفة وتحسين الدقة والكفاءة.

قم بصياغة سياسة ذكاء اصطناعي جيدة مع ClickUp

قد يكون وضع سياسة ذكاء اصطناعي مدروسة جيداً للشركات أمراً صعباً ويستغرق وقتاً طويلاً، ولكنه جزء مهم من إدارة الأعمال التجارية المتقدمة تكنولوجياً اليوم.

الاستفادة من أدوات إدارة مشاريع الذكاء الاصطناعي مثل ClickUp يمكنها تبسيط العملية وتسريعها. استخدم مجموعتها المتنوعة من الميزات لضمان صياغة سياسة ذكاء اصطناعي مدروسة وشاملة وذات صلة وقابلة للتنفيذ. اشترك مع ClickUp وأنشئ سياسة شاملة للذكاء الاصطناعي للشركة بكل سهولة.