Principais conclusões

- A IA agênica da OpenAI automatiza tarefas com várias etapas usando ferramentas integradas.

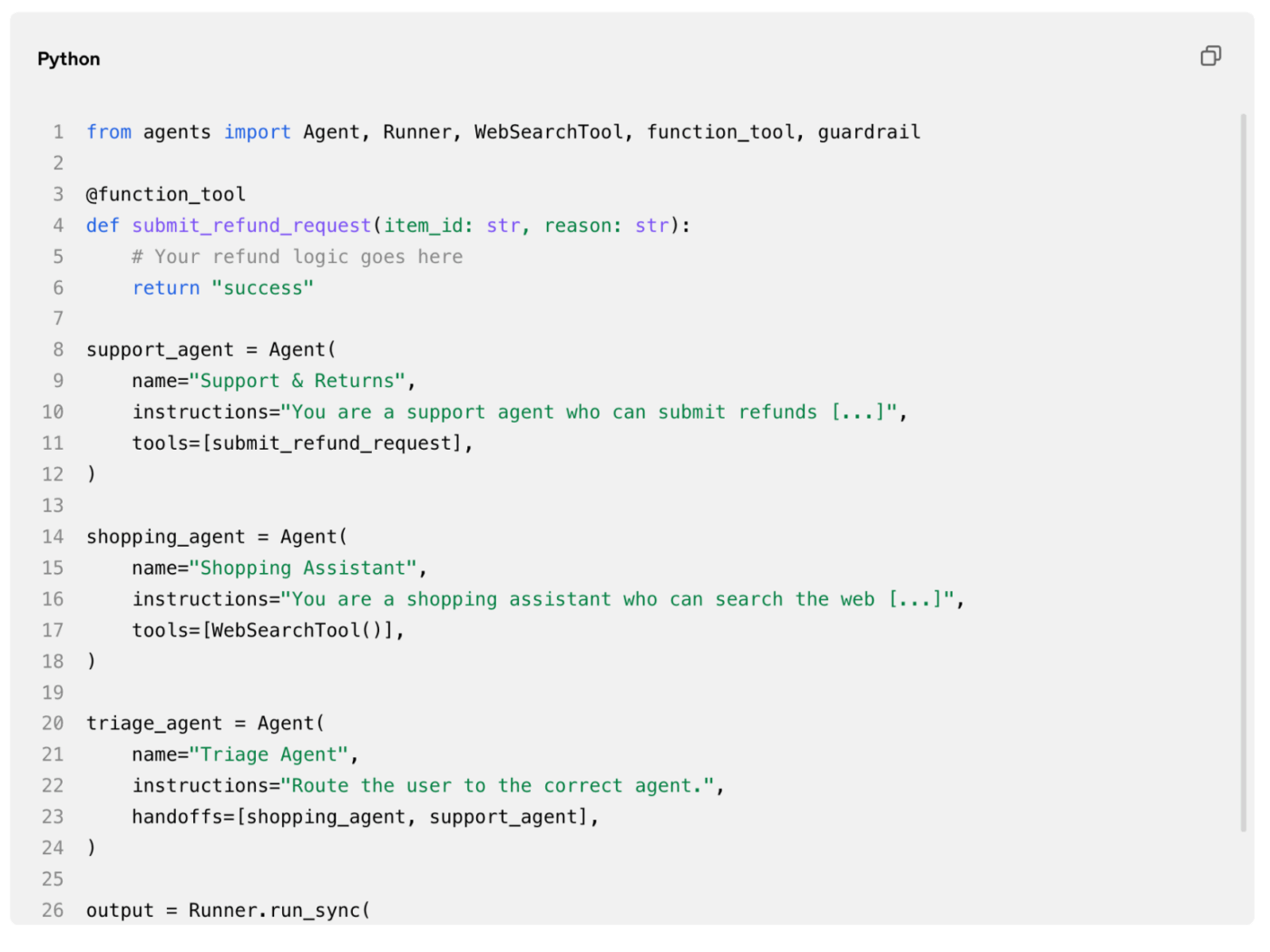

- O AgentKit permite que os desenvolvedores criem agentes personalizados com orquestração de baixo código.

- Os agentes acessam aplicativos de terceiros com segurança, com permissão do usuário e proteções.

- As implementações funcionam melhor quando testadas primeiro com tarefas específicas e de alto valor.

A OpenAI oferece IA agênica?

Sim, a OpenAI oferece um produto de IA agente totalmente funcional.

A empresa lançou o modo agente ChatGPT em 17 de julho de 2025, permitindo que a plataforma conclua autonomamente tarefas de várias etapas usando ferramentas integradas, como navegação na web e execução de código.

Três meses depois, a OpenAI lançou o AgentKit, um conjunto abrangente de ferramentas de desenvolvimento projetadas para criar, implantar e otimizar agentes de IA de ponta a ponta.

Esses lançamentos posicionam a OpenAI como líder no mercado de IA agênica. A empresa tem como alvo líderes empresariais e de produtos que desejam automação inteligente sem precisar reconstruir toda a sua pilha de tecnologia.

Depois de testar a plataforma nos últimos meses, achei a configuração surpreendentemente simples, embora o agente às vezes tivesse dificuldade com tarefas complexas que exigiam julgamento específico do domínio.

Como isso realmente funciona?

A IA agênica da OpenAI opera por meio de um sistema unificado que combina os recursos de raciocínio do ChatGPT com a capacidade de navegar em sites, executar códigos e chamar APIs em um computador virtual.

Quando você atribui uma tarefa, o agente avalia a meta, seleciona as ferramentas apropriadas e executa uma sequência de ações até concluir o objetivo ou encontrar um obstáculo.

O agente pode usar conectores para o Gmail, GitHub, Slack e outros aplicativos, acessando com segurança os dados do usuário somente após solicitar permissão. Essa camada de permissão garante que nenhuma ação confidencial ocorra sem aprovação explícita.

| Componente | Função comercial |

|---|---|

| Navegação na Web | Pesquisa de mercado, análise da concorrência, recuperação de dados em tempo real |

| Execução de código | Transformação de dados, automação de scripts, geração de relatórios |

| Chamadas de API | Atualizações de CRM, processamento de pedidos, integração de serviços de terceiros |

| Acesso ao conector | Elaboração de e-mails, agendamento de calendários, recuperação de documentos |

Em meus próprios testes, notei que o agente fazia uma pausa antes de enviar e-mails ou modificar arquivos, o que gerou confiança em seu processo de tomada de decisão.

Essa arquitetura permite que o agente execute tarefas que antes exigiam várias ferramentas e transferências manuais. Por exemplo, ele pode extrair dados de vendas de um CRM, analisar tendências em uma planilha e redigir um e-mail de resumo sem mudar de contexto.

Essa diferença é importante porque a velocidade de conclusão das tarefas aumenta quando um único sistema coordena todo o fluxo de trabalho. Agora, como isso funciona quando um usuário real coloca isso em prática?

Como isso funciona na prática?

Imagine um gerente de produto que precisa compilar inteligência competitiva para uma próxima sessão de planejamento de sprint.

Em vez de visitar manualmente os sites dos concorrentes, copiar listas de recursos e redigir notas, ela ativa o modo agente do ChatGPT com um único comando: “Pesquise as três principais plataformas de CRM, compare seus recursos de IA e resuma as conclusões em uma tabela.”

O agente segue um caminho claro, do problema ao resultado:

- Identifica o escopo da tarefa e confirma as três plataformas de CRM a serem pesquisadas.

- Navega pelo site e pela documentação de cada fornecedor para extrair detalhes dos recursos de IA.

- Compila as conclusões em uma tabela de comparação estruturada.

- Ele revisa os resultados para verificar a precisão e sinaliza qualquer informação ausente.

Em 10 minutos, o gerente de produto tem um documento pronto para compartilhar. Essa velocidade e autonomia contrastam fortemente com os assistentes de pesquisa tradicionais, que exigem instruções passo a passo ou verificação manual em cada etapa.

As soluções concorrentes muitas vezes carecem da integração estreita entre raciocínio, navegação e manipulação de dados que a OpenAI reúne em uma única interface. Isso nos leva à questão mais ampla de o que diferencia a OpenAI em um campo tão concorrido.

O que torna a OpenAI diferente?

A OpenAI conquistou uma posição única entre as principais empresas que desenvolvem agentes ao criar um modo de agente voltado para o consumidor e um kit de ferramentas completo para desenvolvedores no mesmo ano.

Enquanto outros fornecedores se concentram em automação limitada ou exigem codificação personalizada extensa, a OpenAI oferece uma experiência plug-and-play para usuários não técnicos, além de opções de personalização avançadas para equipes de engenharia.

A empresa também priorizou a segurança e a governança. A OpenAI lançou o Guardrails, uma camada de segurança modular de código aberto que pode mascarar automaticamente dados pessoais, detectar tentativas de jailbreak e garantir a conformidade com as políticas.

Isso garante que os agentes implantados operem dentro de limites confiáveis, uma consideração crítica para empresas que lidam com informações confidenciais.

Aqui estão os principais pontos fortes e desvantagens da plataforma:

- O AgentKit oferece uma tela visual do tipo arrastar e soltar para orquestrar fluxos de trabalho com vários agentes sem precisar escrever código de orquestração.

- Ferramentas integradas, como pesquisa na web, pesquisa de arquivos e controle do computador, reduzem a necessidade de integrações personalizadas.

- Os primeiros usuários relatam problemas ocasionais de precisão e desempenho lento em tarefas complexas e com várias etapas.

- O acesso limitado ao serviço no mundo real significa que algumas tarefas ainda exigem acompanhamento manual.

Um usuário do Reddit capturou bem o sentimento misto: “Desenvolvi aplicativos complexos em uma semana que antes levariam meses”, enquanto outro observou que o agente “falha rotineiramente em tarefas básicas” e carece da transparência necessária para a automação de processos robóticos empresariais.

Essas experiências contrastantes destacam uma plataforma ainda em fase de amadurecimento, mas que já mostra sinais de seu potencial transformador.

Com esse contexto em mente, vamos explorar como os agentes da OpenAI se encaixam nos ecossistemas de tecnologia empresarial existentes.

Integração e adequação ao ecossistema

A IA agênica da OpenAI se conecta aos sistemas circundantes por meio de um Registro de Conectores centralizado que oferece integrações prontas para uso para aplicativos empresariais comuns.

Os administradores gerenciam esses conectores a partir de um único console, concedendo ou restringindo o acesso com base nas funções da equipe e nos requisitos de conformidade.

O Agents SDK e a Responses API fornecem ferramentas integradas, como pesquisa na web, pesquisa de arquivos e controle do computador, permitindo que os desenvolvedores criem agentes que recuperam informações em tempo real e realizam ações sem código de integração personalizado. Isso reduz o atrito da implementação e acelera o tempo de retorno.

Veja como as principais plataformas se encaixam no ecossistema de agentes da OpenAI:

| Plataforma | Função de integração |

|---|---|

| Dropbox, Google Drive, SharePoint | Acesse e recupere documentos com segurança para pesquisa e relatórios. |

| Microsoft Teams, Slack | Mensagens em tempo real, notificações e coordenação do fluxo de trabalho |

| Gmail, Outlook | Elaboração de e-mails, agendamento e gerenciamento da caixa de entrada |

| GitHub | Acesso ao repositório de código, automação de pull requests, controle de versão |

A integração de modelos de terceiros também é suportada. A plataforma não se limita aos modelos OpenAI; os desenvolvedores podem avaliar outros modelos dentro da plataforma e chamar APIs externas por meio de interfaces padronizadas.

Essa extensibilidade torna os agentes OpenAI adaptáveis em pilhas de tecnologia heterogêneas, onde coexistem vários fornecedores de IA.

Cronograma de implementação e gestão de mudanças

A adoção da IA agênica funciona melhor quando as organizações fazem uma implementação gradual, em vez de ativar uma mudança em toda a empresa de uma só vez.

Comece com um piloto restrito que vise um fluxo de trabalho de alto valor e baixo risco, como automatizar a triagem de tickets de suporte ao cliente ou gerar resumos semanais de vendas. Isso permite que as equipes aprendam os pontos fortes e as limitações da plataforma em um ambiente controlado.

Aqui está uma sequência de implementação comprovada:

- Inicie um projeto piloto com uma equipe e uma única tarefa bem definida.

- Avalie métricas de desempenho, como taxa de conclusão de tarefas e satisfação do usuário.

- Refine prompts, conectores e proteções com base no feedback do piloto.

- Expanda para equipes adjacentes com fluxos de trabalho semelhantes.

- Expanda para a implantação completa assim que a governança e o treinamento estiverem em vigor.

As partes interessadas devem incluir a segurança de TI para revisar as políticas de acesso aos dados, os responsáveis pela conformidade para garantir o alinhamento regulatório e os usuários finais para coletar feedback prático. Os rótulos de funções genéricas mantêm o processo flexível, pois as estruturas organizacionais variam.

A gestão da mudança é importante aqui, porque a IA agênica transfere a tomada de decisões dos seres humanos para os algoritmos em contextos específicos.

A comunicação transparente sobre o que o agente pode e não pode fazer evita expectativas irreais e gera confiança na tecnologia.

Agora, vamos ouvir o que os primeiros usuários estão realmente dizendo sobre suas experiências práticas.

Comentários da comunidade e opinião dos primeiros usuários

As primeiras opiniões estão bastante divididas. Alguns desenvolvedores estão entusiasmados com o ganho de velocidade, enquanto outros consideram os recursos atuais insuficientes para uso em produção.

- “Desenvolvi aplicativos complexos em uma semana que antes levariam meses” ( usuário do Reddit, r/aipromptprogramming ).

- “O agente da OpenAI é um truque interessante, mas nada mais do que isso” ( usuário do Reddit, r/ChatGPT ).

- “Isso vai acabar completamente com o mercado de RPA” ( usuário do Reddit, r/productivity ).

- “Ele falha rotineiramente em tarefas básicas e não consegue acessar a maioria dos serviços do mundo real” ( usuário do Reddit, r/ChatGPT ).

Se estiver interessado, você pode ler todos os mais de 500 comentários sobre o recurso aqui para entender o que quero dizer:

O lançamento do AgentKit também gerou discussões sobre como os criadores de agentes de IA terceirizados podem ter dificuldades para competir, a menos que se especializem ou agreguem valor exclusivo.

Um observador observou que “a maioria das startups que oferecem fluxos de trabalho de IA sem código estão de repente parecendo redundantes”, agora que a OpenAI fornece um construtor de agentes nativo.

Apesar das limitações atuais, uma parte da comunidade continua otimista. A opinião é que a IA agênica poderá revolucionar a automação assim que as lacunas de confiabilidade e conformidade forem eliminadas.

Cuidar de tarefas rotineiras, como preenchimento de formulários, compras ou monitoramento de dados, representa o que alguns chamam de “a maior mudança de paradigma tecnológico de nossa vida”.

Essas visões polarizadas preparam o terreno para entender para onde a OpenAI planeja levar a plataforma daqui para frente.

Roteiro e perspectivas do ecossistema

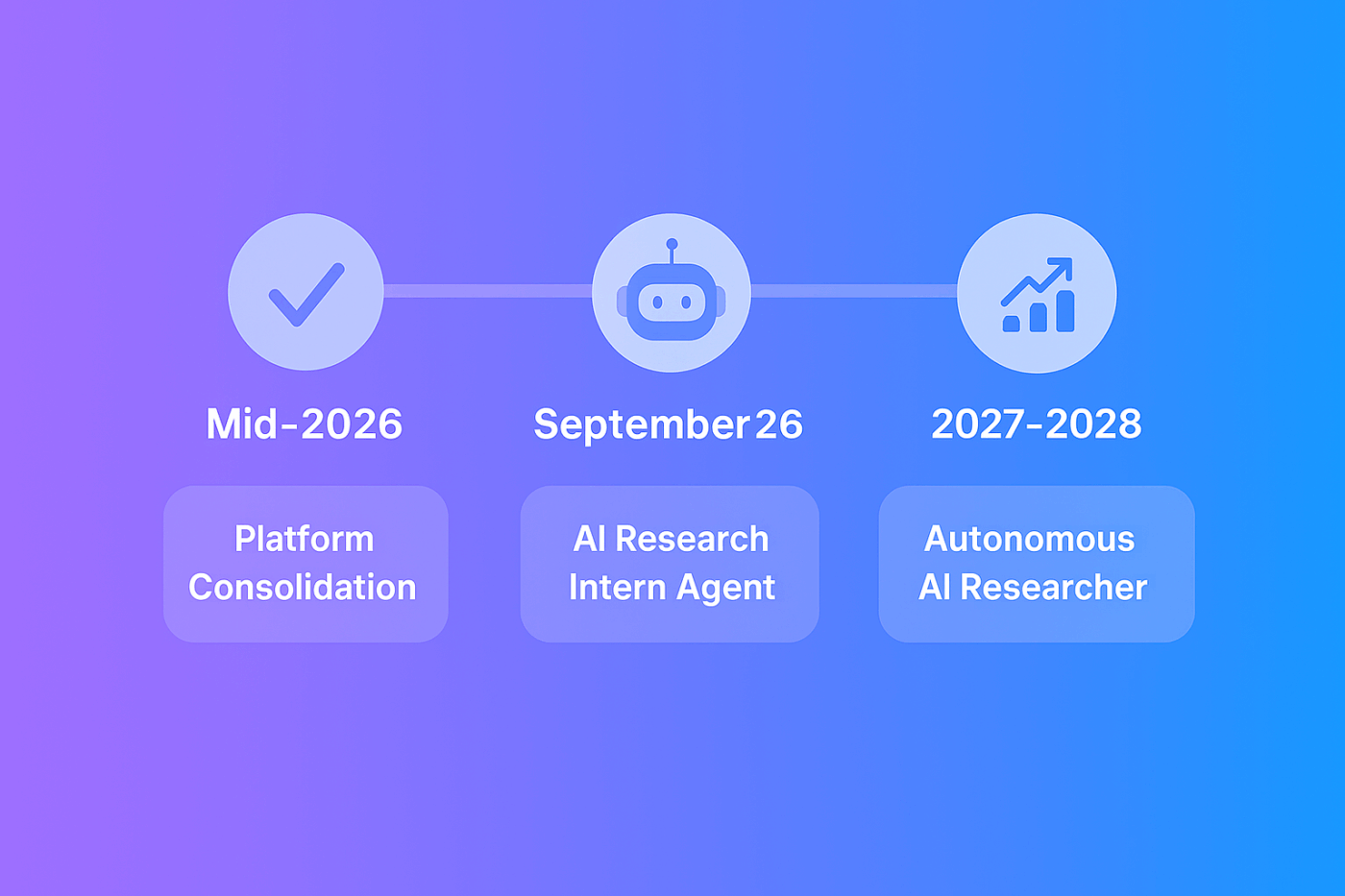

A OpenAI traçou um cronograma agressivo que vai da consolidação da plataforma até recursos de pesquisa autônomos.

Até meados de 2026, a OpenAI planeja aposentar a API Assistants legada, assim que a API Responses e o Agent SDK atingirem a paridade total de recursos.

Isso unificará os desenvolvedores em uma única plataforma de agentes aprimorada. Espere anúncios formais de descontinuação e ferramentas de migração à medida que a data de transição se aproxima.

No final de 2026, a OpenAI pretende lançar um agente de IA capaz de realizar pesquisas de forma autônoma em um nível “estagiário”. O CEO Sam Altman descreveu esse objetivo como a criação de um sistema que pode ler literatura, gerar hipóteses, realizar experimentos e analisar resultados com o mínimo de orientação humana.

Olhando mais adiante, a OpenAI tem como meta para 2028 um “pesquisador de IA legítimo” que possa lidar com problemas científicos complexos de ponta a ponta.

Alcançar esse marco exigiria dimensionar a infraestrutura de computação, estender as janelas de contexto além do limite atual de cinco horas de raciocínio efetivo e avançar nas inovações algorítmicas no raciocínio.

As melhorias a curto prazo incluem uma API de fluxos de trabalho para implantar e gerenciar programaticamente os fluxos de trabalho dos agentes e trazer mais recursos de agente para o aplicativo de consumo ChatGPT. Melhorias regulares no modelo irão impulsionar ainda mais o raciocínio do agente e reduzir erros.

Com um roteiro voltado para o futuro em vigor, os líderes precisam entender o compromisso financeiro necessário para adotar essa tecnologia.

Quanto custa a IA agênica da OpenAI?

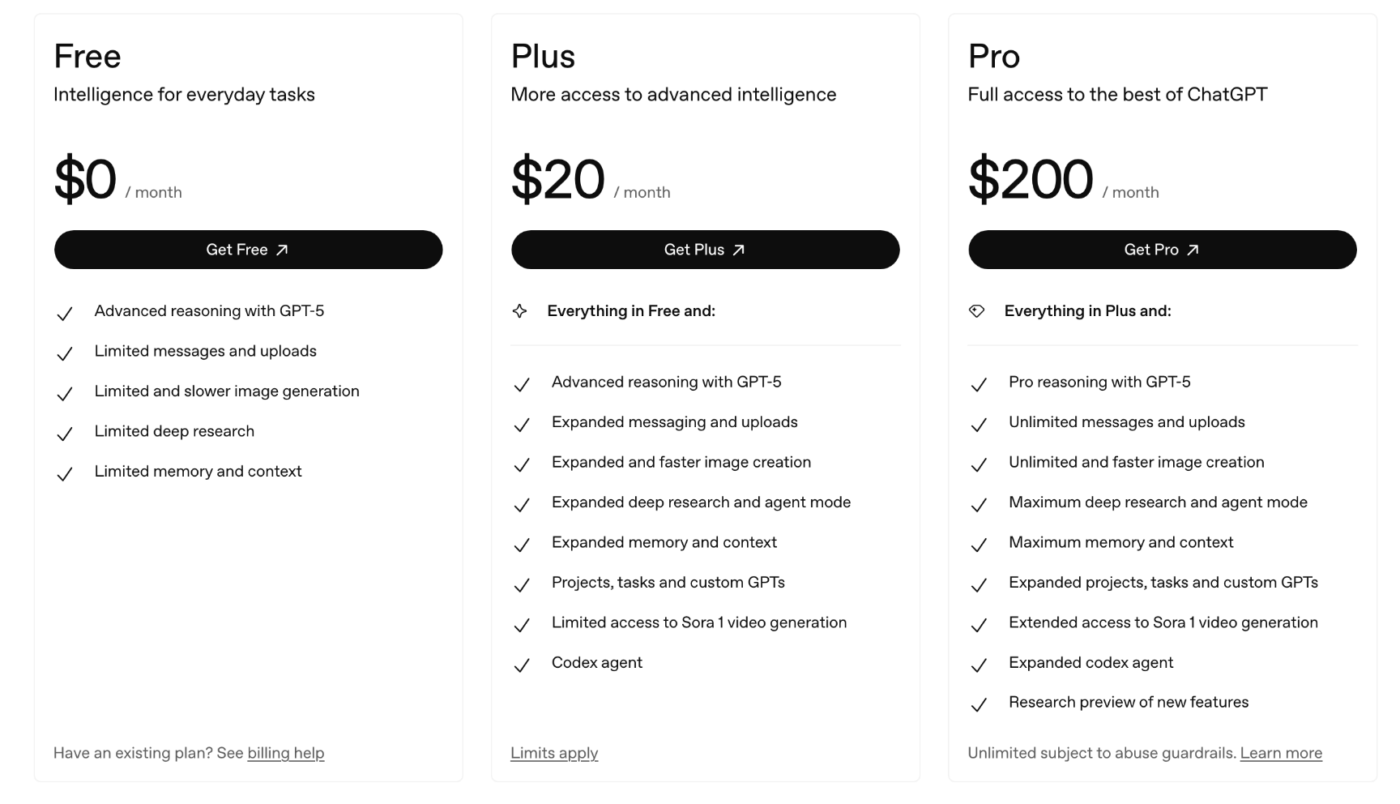

A OpenAI usa um modelo de assinatura em níveis para acesso ao agente ChatGPT e cobra separadamente pelas ferramentas de desenvolvimento de API.

O ChatGPT Plus custa US$ 20 por mês para um usuário e inclui aproximadamente 40 ações de agente por mês, com créditos pré-pagos disponíveis para uso adicional.

O ChatGPT Pro, com preço de US$ 200 por mês, oferece acesso prioritário e uso essencialmente ilimitado do agente, fornecendo inicialmente cerca de 400 ações do agente por mês por padrão.

Para equipes, o ChatGPT Team custa US$ 25 por usuário por mês em um contrato anual ou US$ 30 por usuário por mês. Esse plano inclui todos os recursos Plus para cada usuário, um console de administração compartilhado e limites de uso combinados mais altos.

Os desenvolvedores que utilizam a API pagam apenas pelos tokens do modelo subjacente e por quaisquer chamadas de API adicionais. Não há taxa separada para usar o SDK Agents, as ferramentas AgentKit ou as funções integradas.

No entanto, as consultas de pesquisa na web têm um custo adicional: US$ 30 por 1.000 consultas para a pré-visualização de pesquisa GPT-4o e US$ 25 por 1.000 para GPT-4o-mini. Outras ferramentas integradas, como pesquisa de arquivos ou execução de código, são cobradas exclusivamente pelos tokens do modelo consumidos.

Custos ocultos podem surgir de tarefas que exigem muito processamento ou integrações em grande escala que requerem chamadas de API extensas. As organizações devem monitorar de perto o uso durante os testes para prever as despesas mensais com precisão. Se não houver preços públicos para um recurso específico, consulte a página de dados comerciais da OpenAI ou entre em contato diretamente com a equipe de vendas.

Considerações finais

O modo agente da OpenAI é realmente promissor, mas ainda não está pronto para produção em todos os casos de uso. Vi ele se destacar em pesquisa e síntese, mas ter dificuldades em fluxos de trabalho que exigem julgamento sutil.

A atitude inteligente é tratar isso como uma ferramenta experimental, em vez de uma substituição completa da automação. Comece com uma tarefa repetitiva que tenha critérios de sucesso claros, monitore-a de perto e, em seguida, ajuste as instruções e permissões até que os resultados sejam consistentes.

Os primeiros usuários que iterarem cuidadosamente construirão um valioso conhecimento institucional à medida que a plataforma amadurecer. Aqueles que esperarem pela perfeição verão os concorrentes conquistarem a vantagem da curva de aprendizado.