Todas as publicações

Usando ClickUp

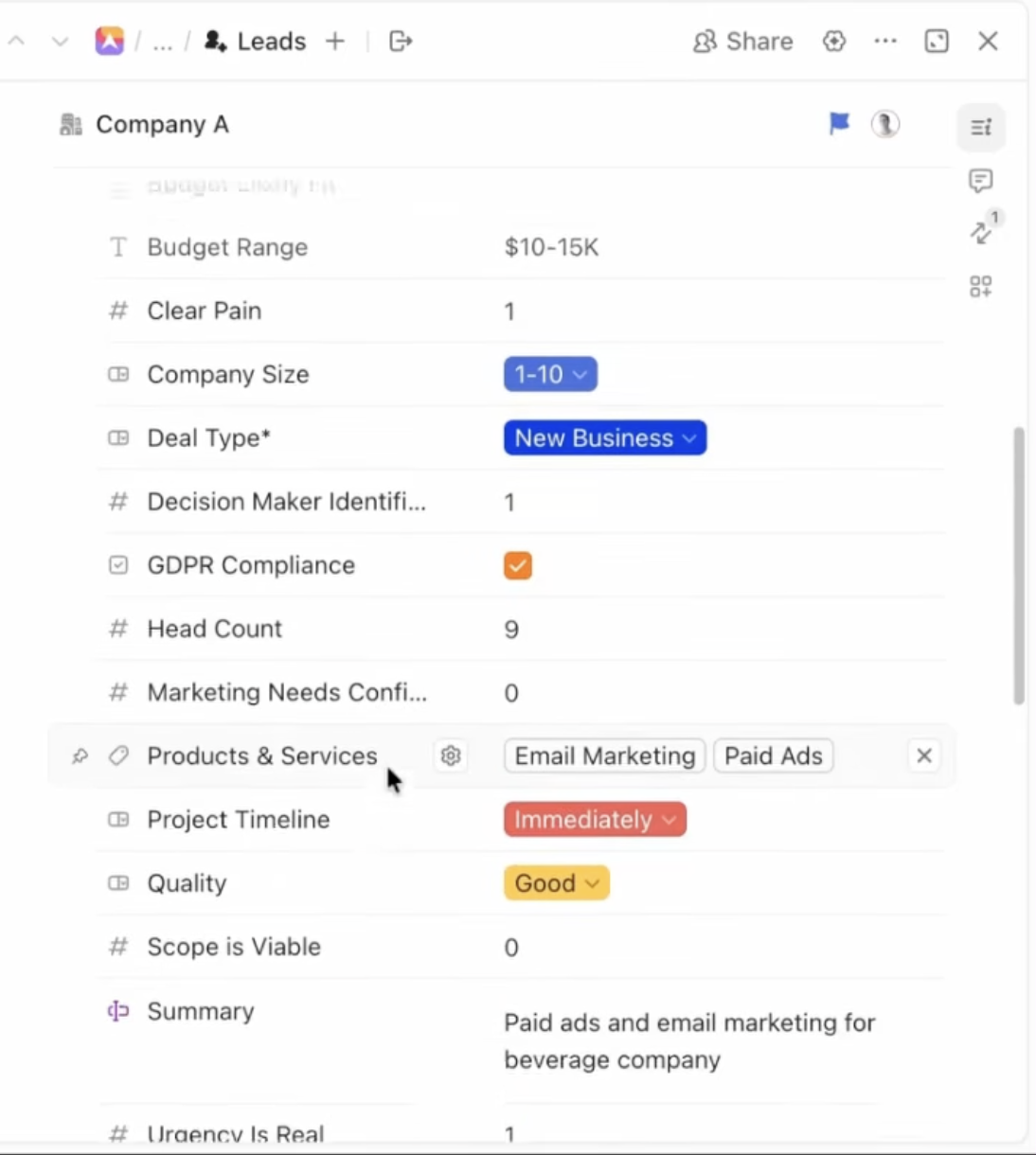

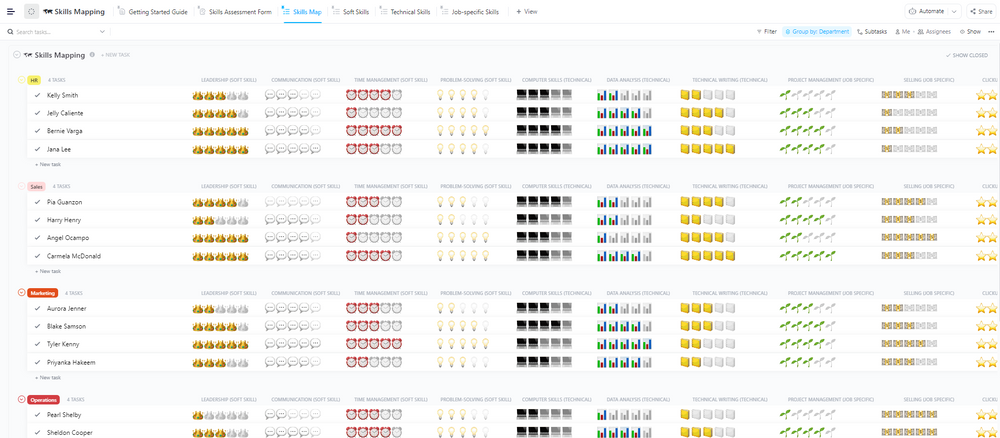

Campos personalizados do ClickUp por tipo de tarefa: como eu crio fluxos de trabalho de vendas mais organizados sem a confusão de campos

Christopher Day

Christopher Day

Usando ClickUp

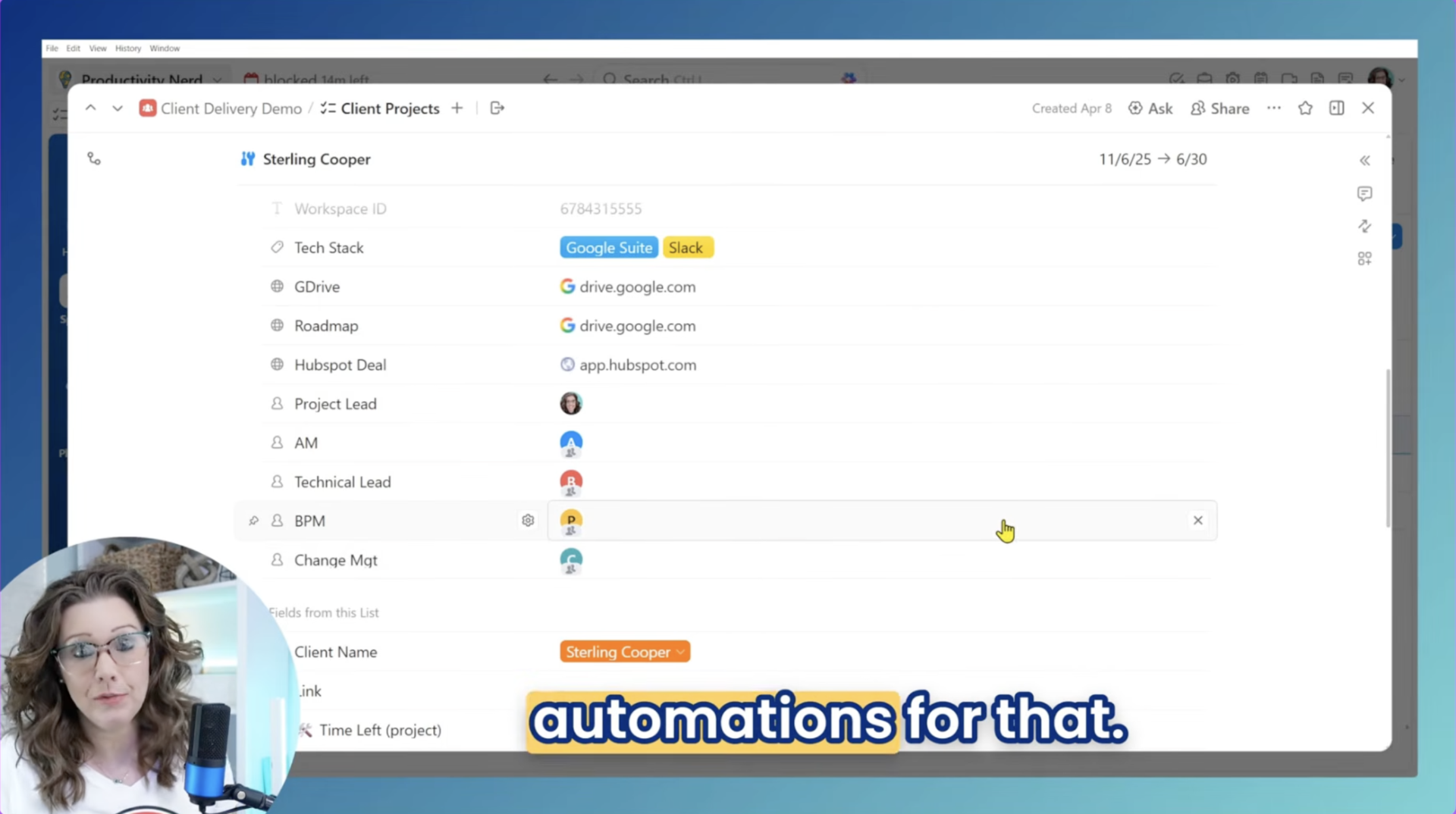

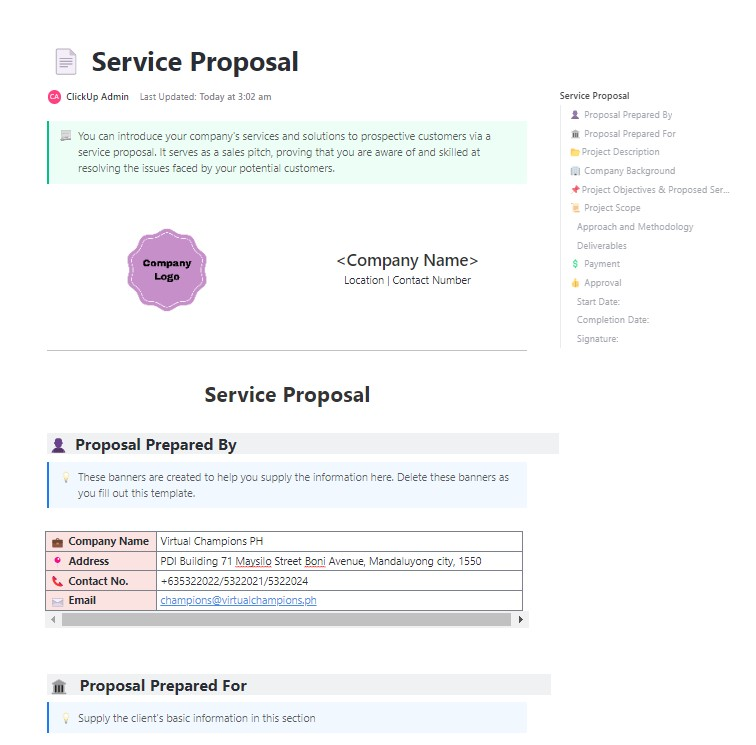

Campos personalizados por tipo de tarefa no ClickUp: como criei um centro de entregas para clientes que acaba com a caça ao tesouro

Jacqui Myslinski

Jacqui Myslinski

CRM

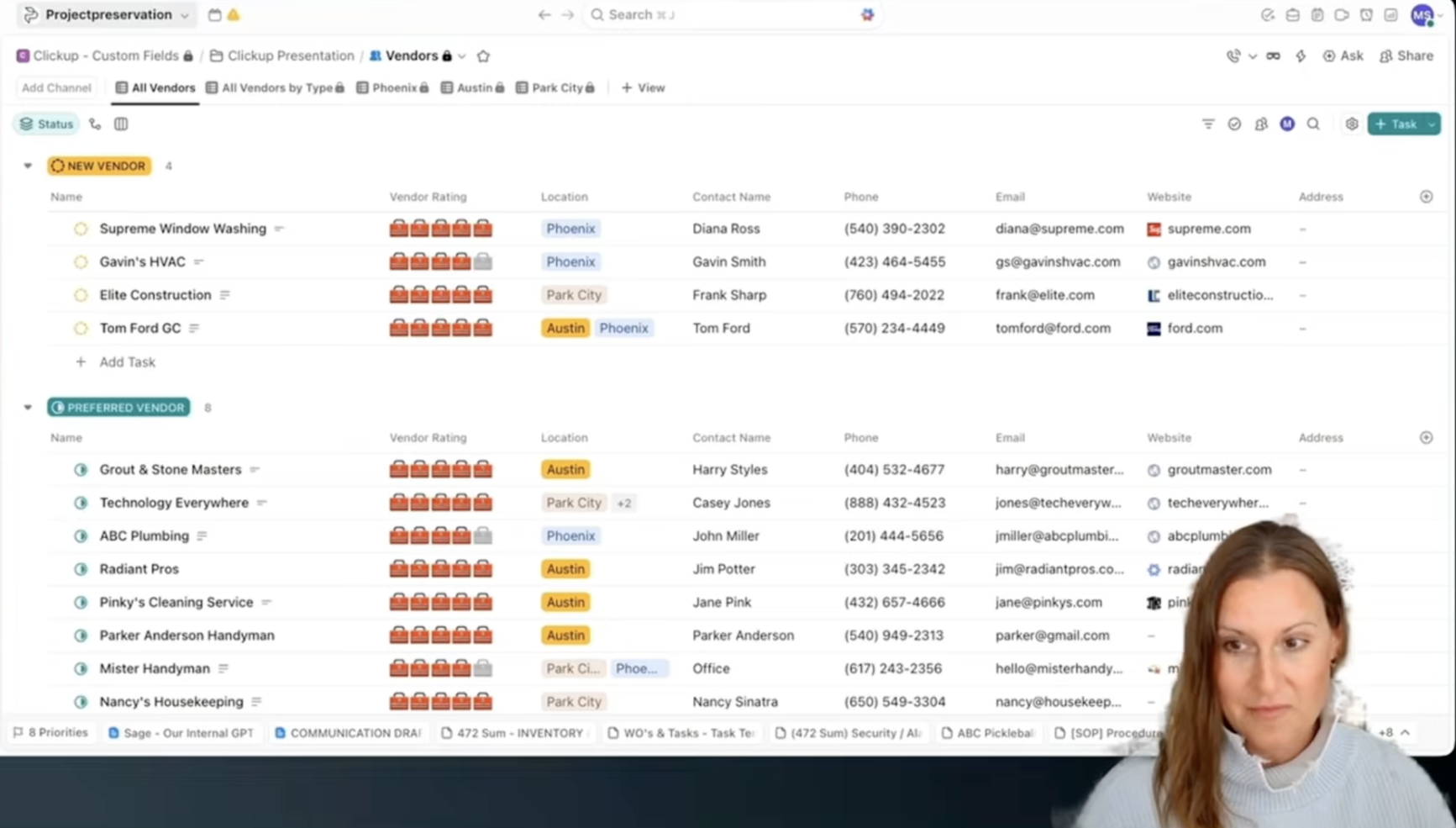

Campos personalizados do ClickUp: como criei um sistema integrado de gestão de imóveis para fornecedores e ordens de serviço

Melissa Shymko

Melissa Shymko

Disclosures

27 de abril – O que aconteceu com a nossa configuração de feature flags

ClickUp Security Team

ClickUp Security Team

Lançamentos de Recursos

Como estamos conquistando a confiança por meio da conformidade com a norma SOC 2

Erica Chappell

Erica Chappell

Software

8 ferramentas semelhantes ao Smartsheet para planejamento de capacidade

Preethi Anchan

Preethi Anchan

Modelos

10 modelos de modelo operacional empresarial no ClickUp

Praburam

Praburam

Software

Base44 x Claude Code: qual você deve usar?

Arya Dinesh

Arya DineshModelos

10 modelos de acompanhamento de receita de assinaturas que realmente identificam sinais de cancelamento

Praburam

Praburam

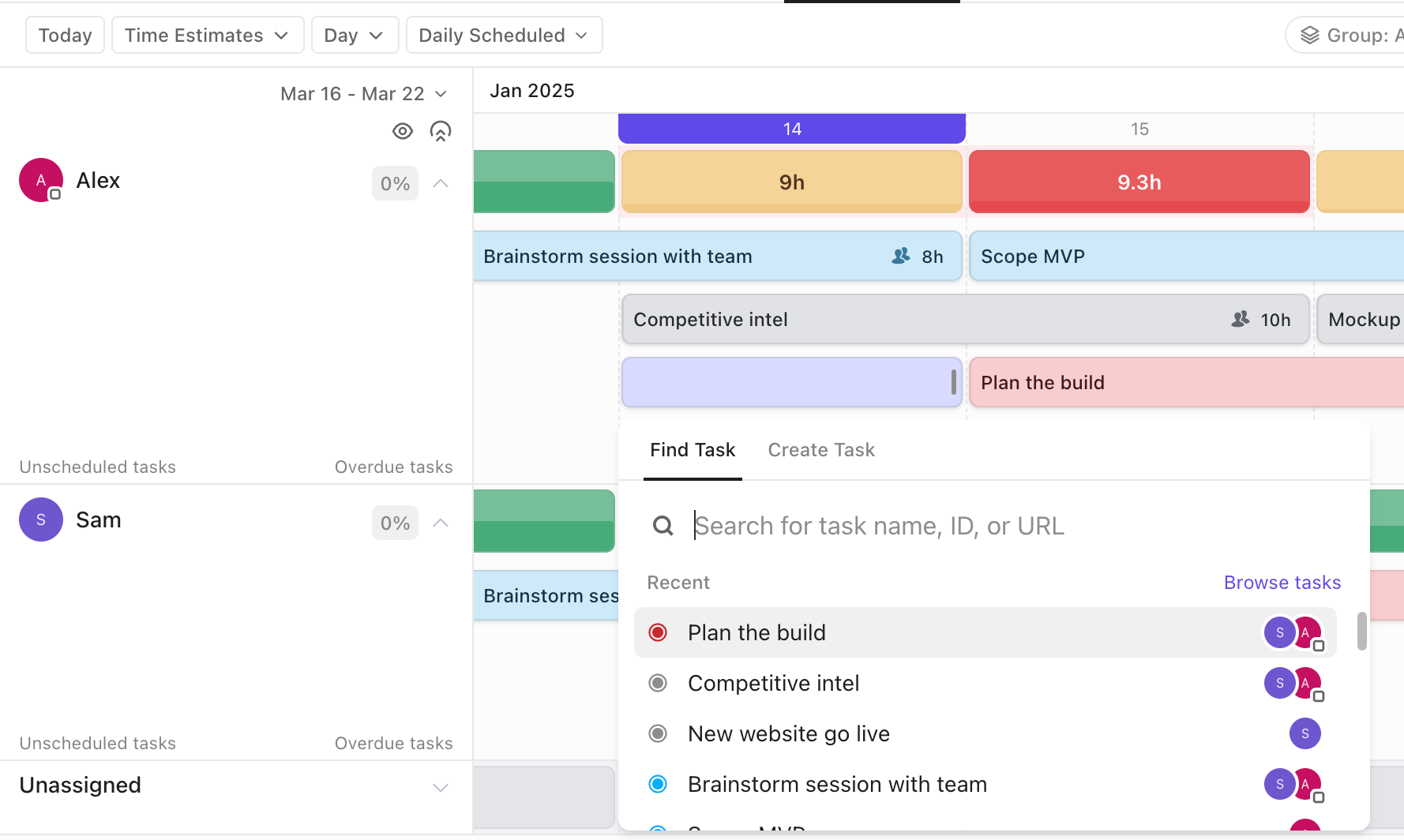

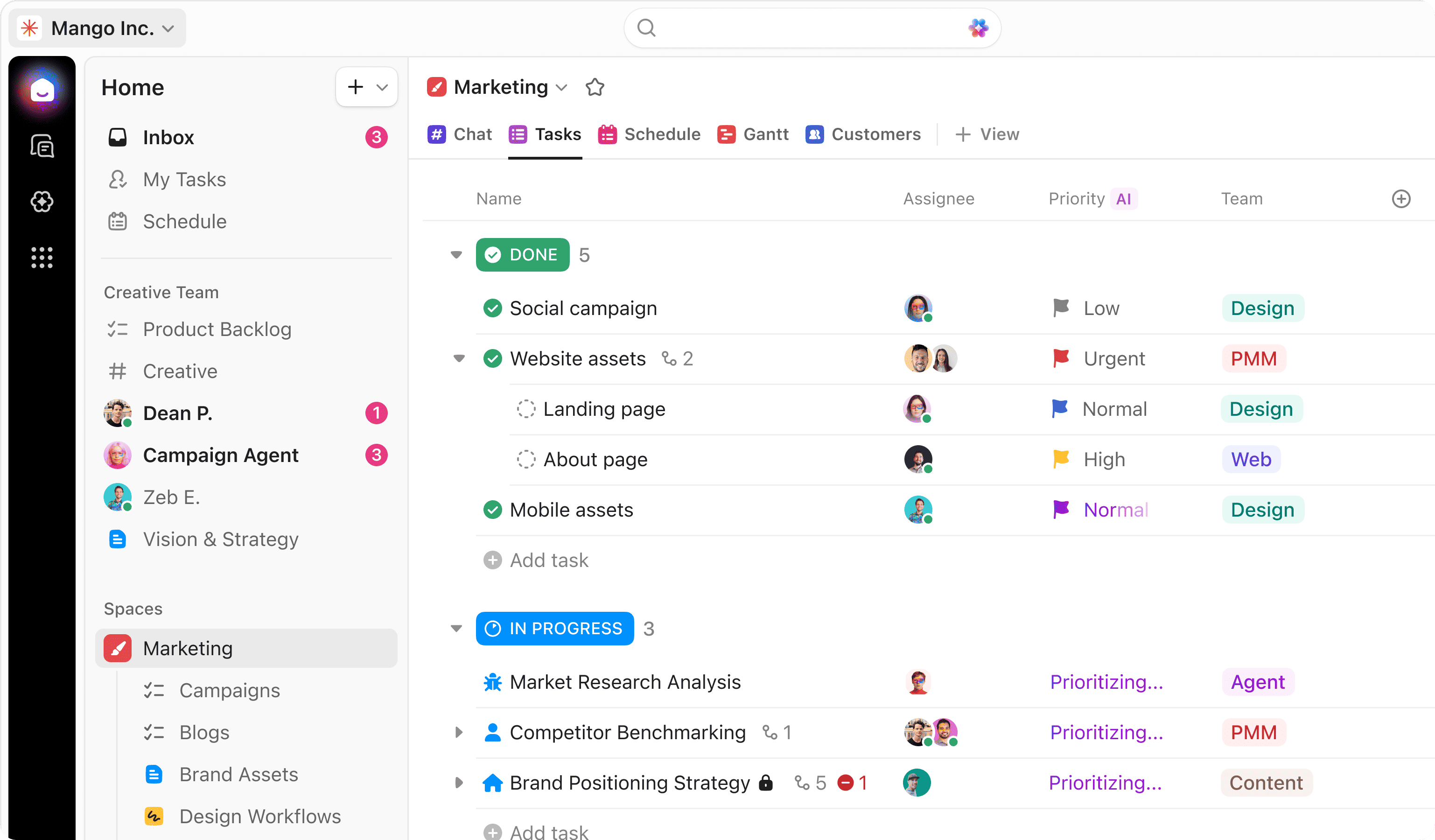

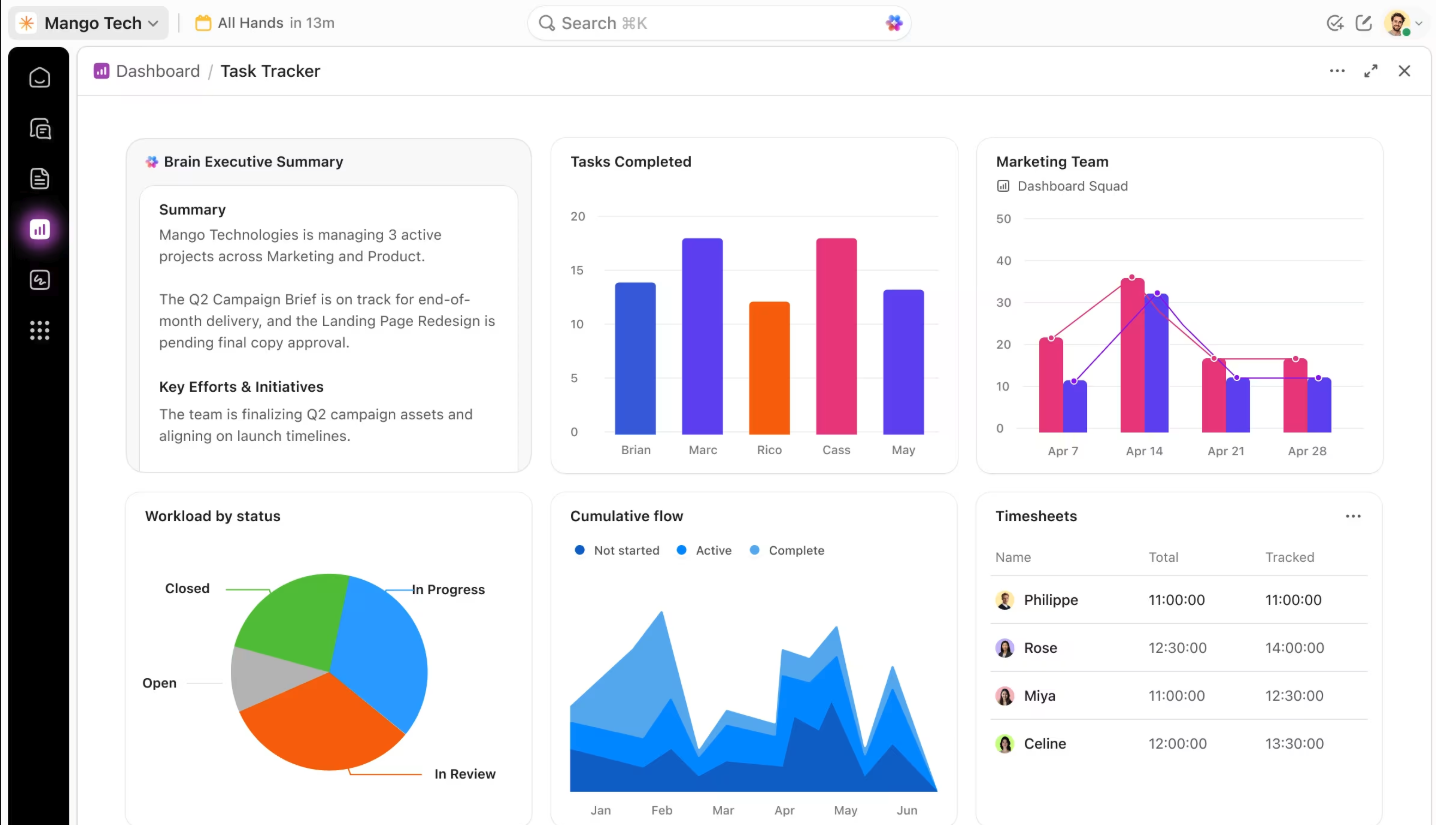

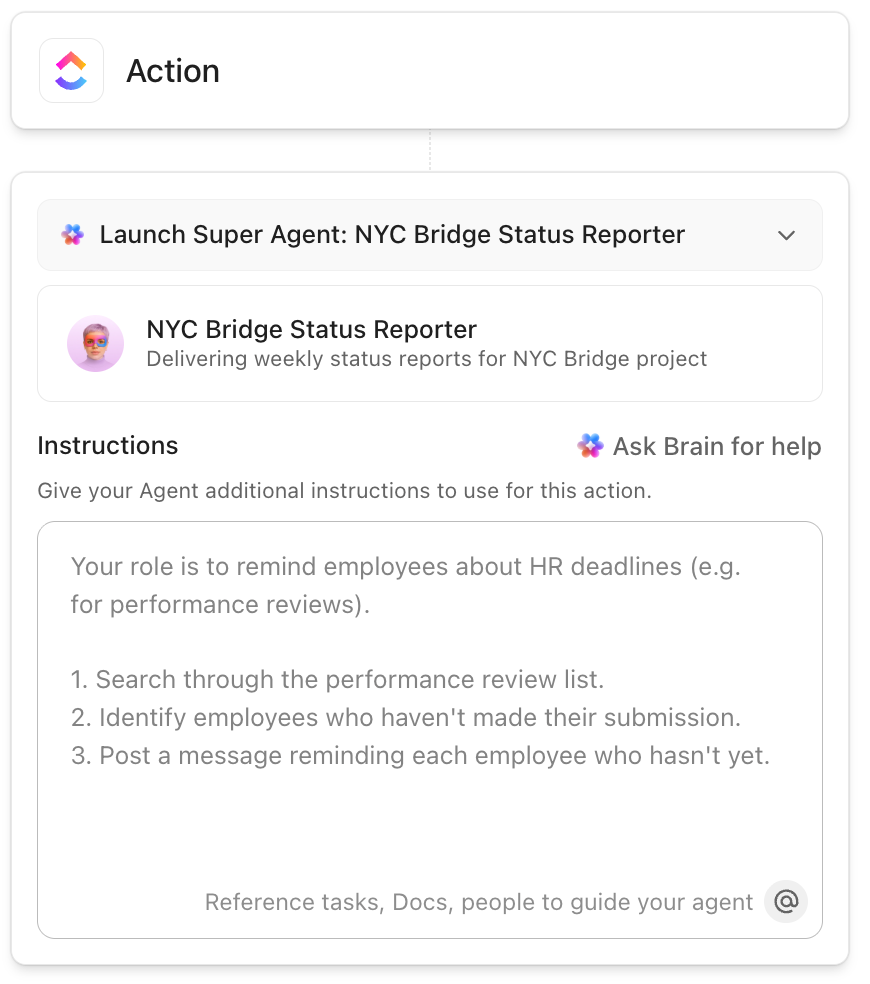

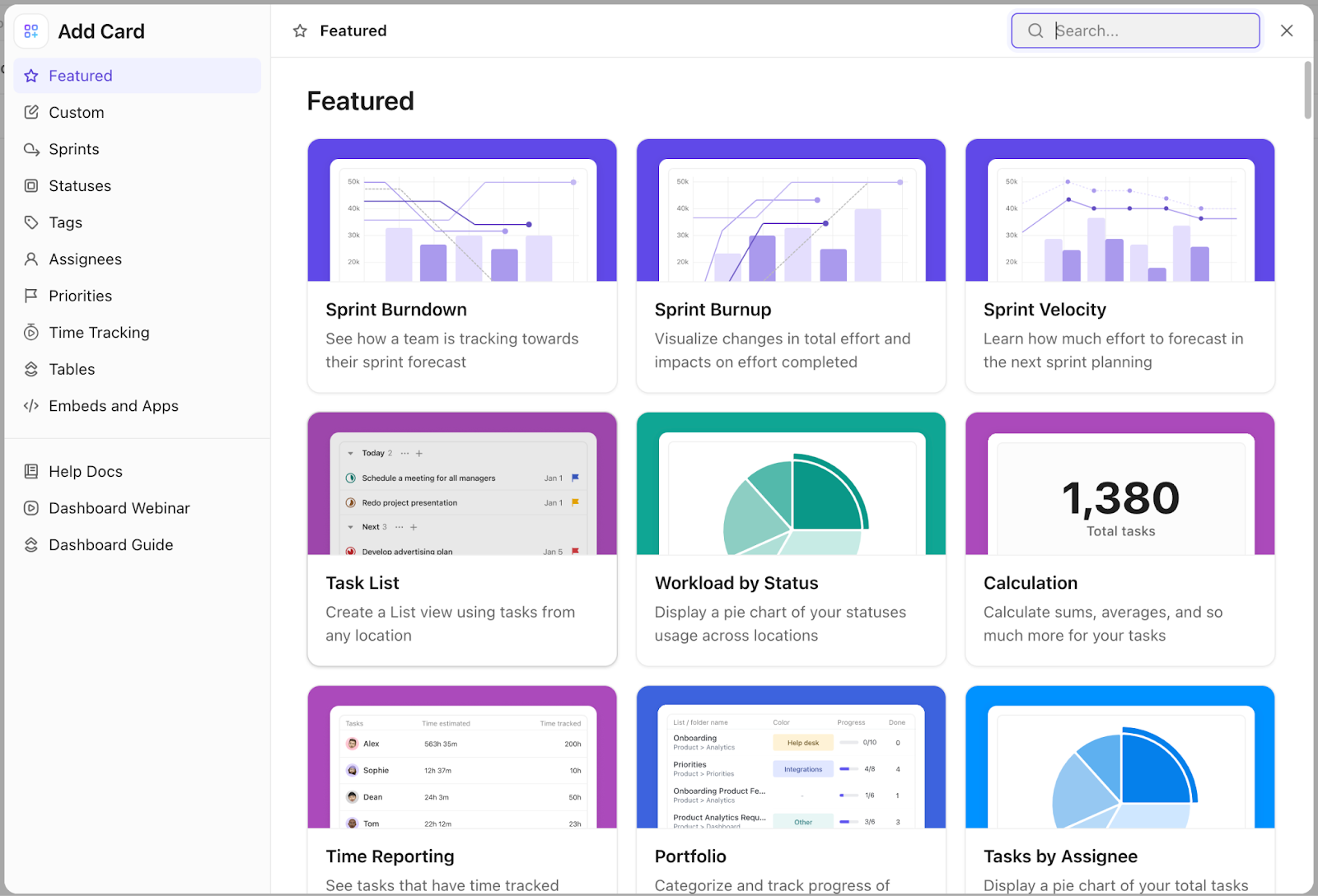

Usando ClickUp

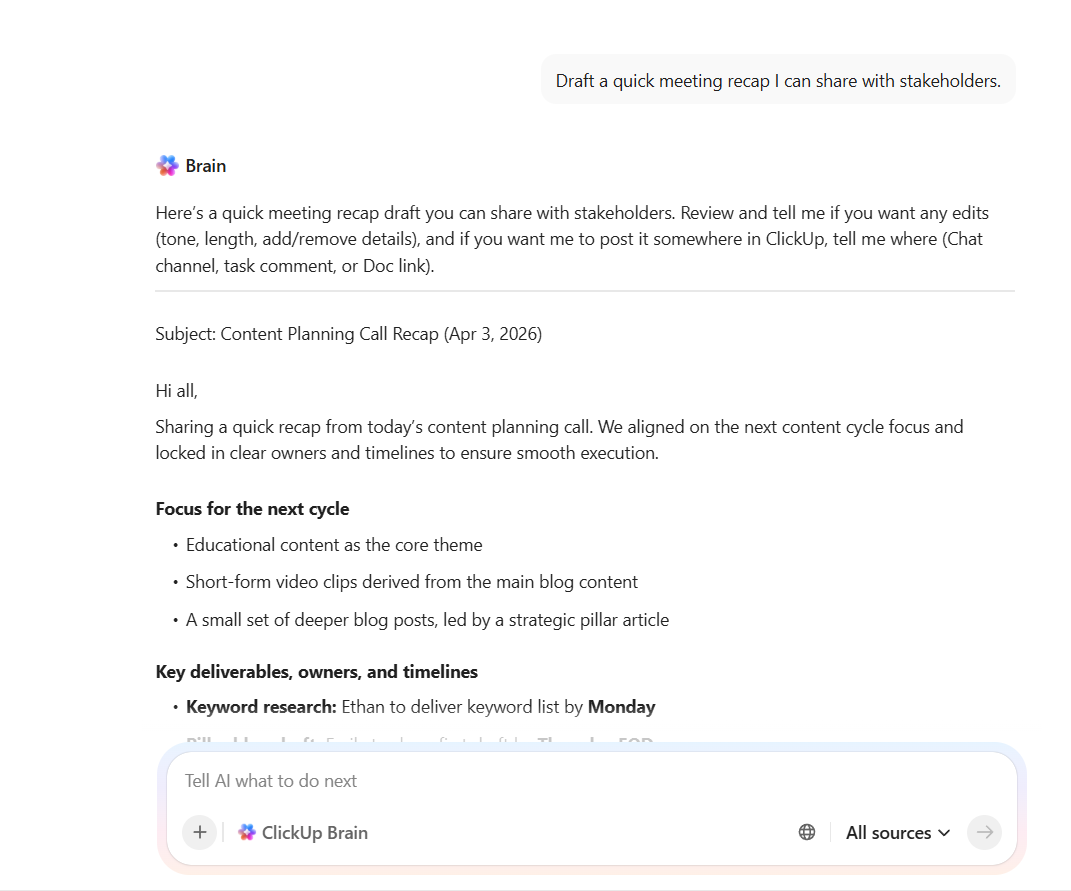

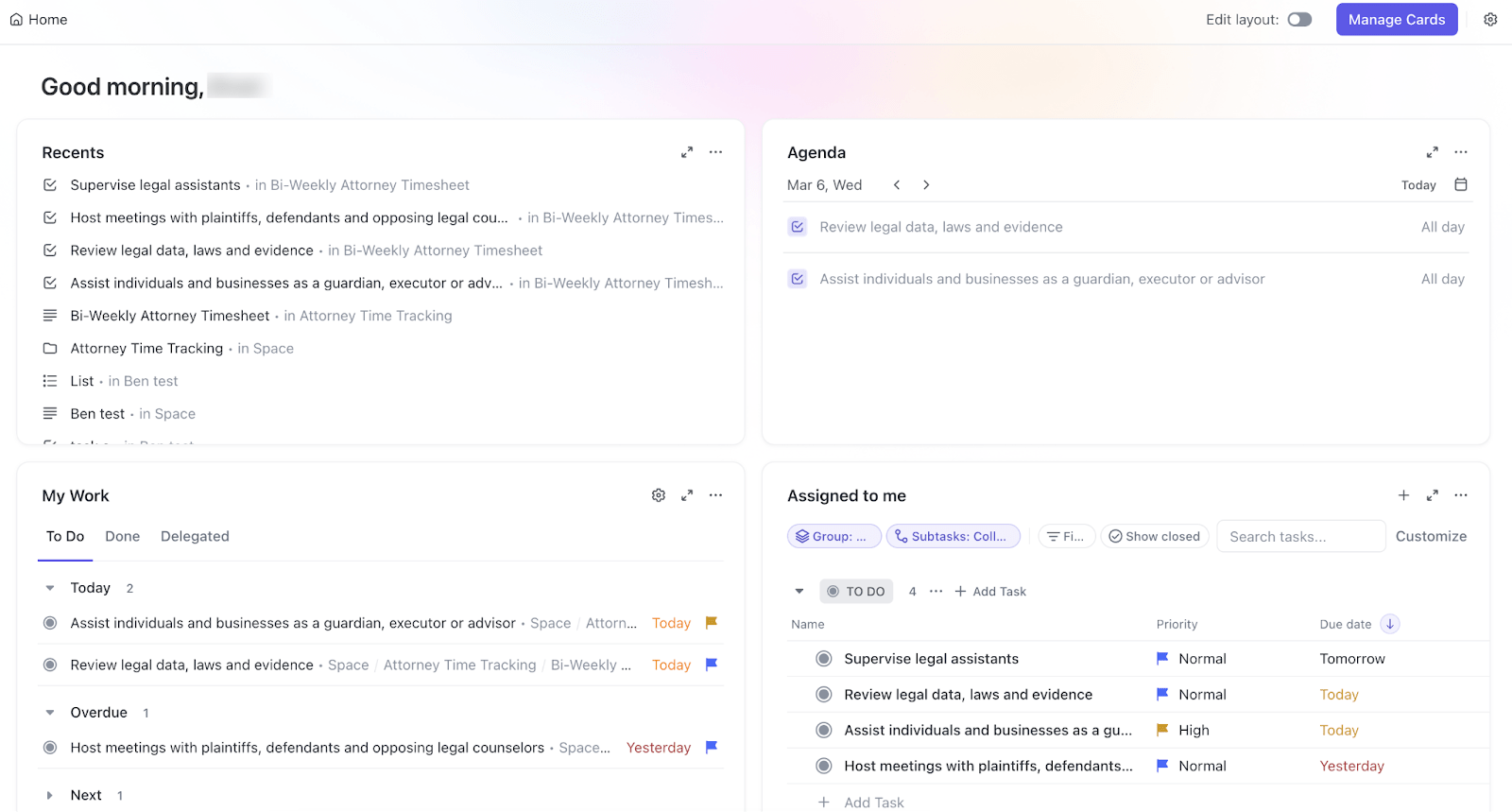

10 exemplos de painéis do ClickUp para equipes

Praburam

Praburam

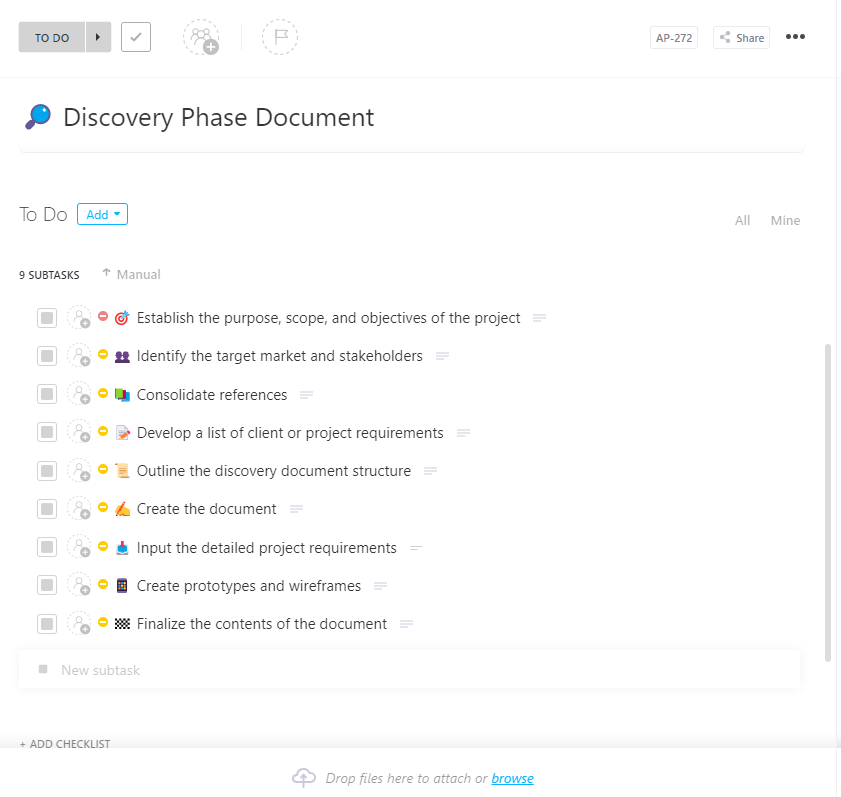

Modelos

10 modelos de fluxo de trabalho para síntese de insights no ClickUp

Praburam

Praburam

Modelos

10 modelos de estratégia de mobilidade de talentos do ClickUp

Praburam

Praburam

Modelos

10 modelos de preços para pacotes de serviços no ClickUp

Praburam

Praburam

Software

As 10 melhores alternativas à Fyntrix AI em 2026

Preethi Anchan

Preethi Anchan

Software

As 10 melhores alternativas ao Olovka AI em 2026

Preethi Anchan

Preethi Anchan

Software

Base44 x Lovable: qual criador de IA é o ideal para você?

Arya Dinesh

Arya Dinesh

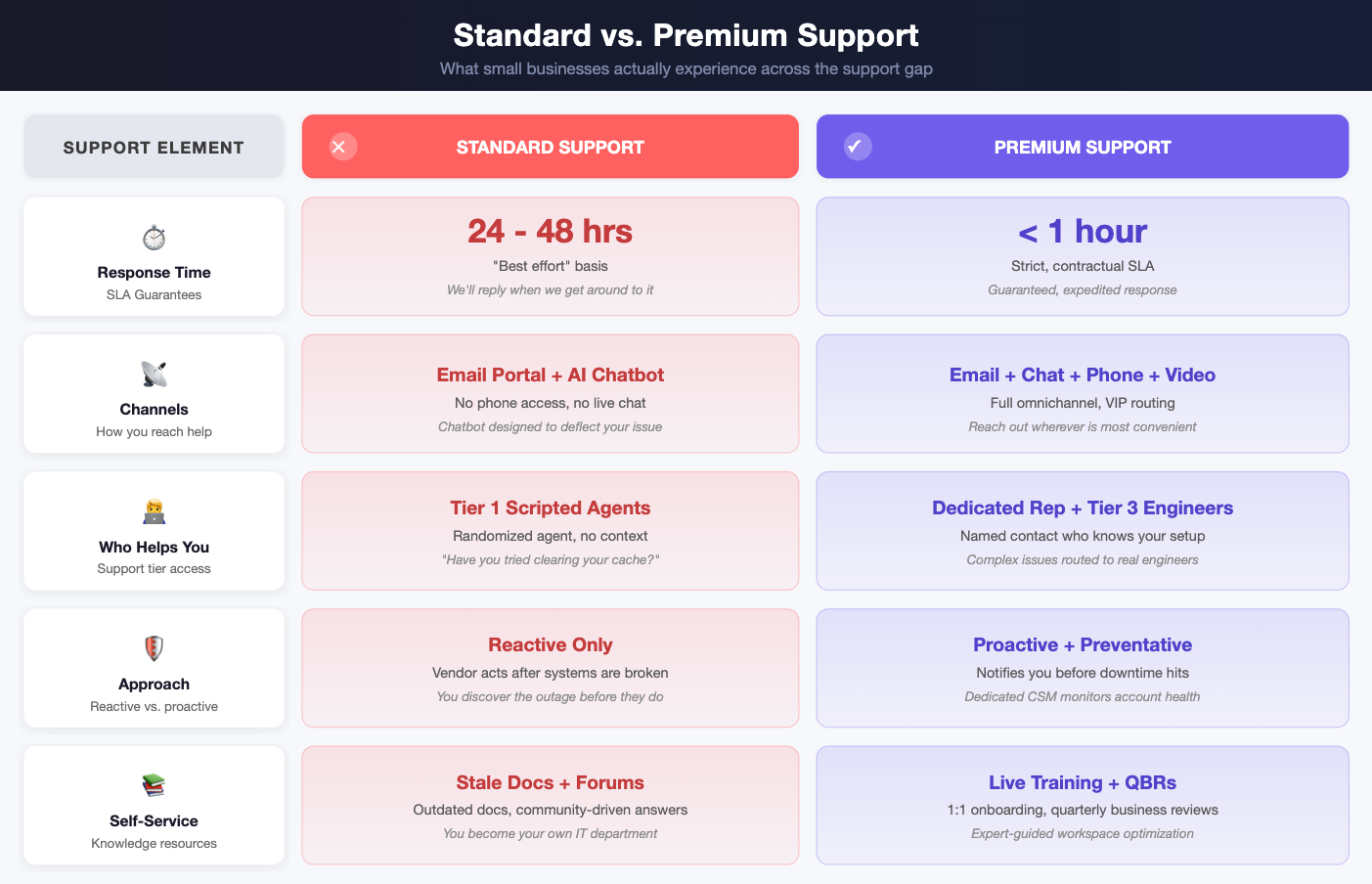

Business

O valor oculto de um representante dedicado para PMEs

Arya Dinesh

Arya Dinesh

Agências

Como criar um painel de operações da agência no Google Sheets

Manasi Nair

Manasi Nair

Software

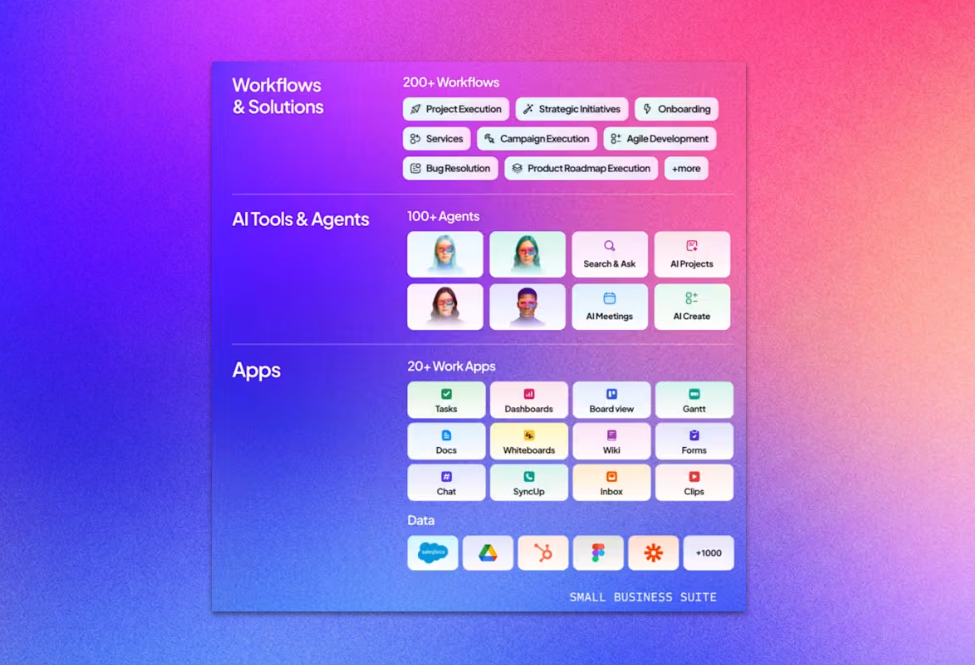

Base44 vs. ClickUp: Como eles se comparam em 2026

Arya Dinesh

Arya Dinesh

Software

Claude Code x Copilot: qual deles se adapta melhor ao seu fluxo de trabalho?

Arya Dinesh

Arya Dinesh

Software

Como usar o Copilot no Microsoft Teams de forma eficaz

Praburam

Praburam

Software

Como usar a ferramenta Bash para usuários do Gemini

Praburam

Praburam

Modelos

Como criar uma planilha de controle de horas no Google Sheets

Praburam

Praburam

Software

ClickUp x Workzone: qual ferramenta é a mais adequada para você?

Arya Dinesh

Arya Dinesh