Пристрастността на изкуствения интелект може да изглежда като технически проблем. Но нейните ефекти се проявяват в реалния свят и често могат да бъдат опустошителни.

Когато една AI система се отклони в грешната посока, дори и само малко, това може да доведе до несправедливи резултати.

С течение на времето тези малки проблеми могат да се превърнат в разочаровани клиенти, проблеми с репутацията или дори въпроси за съответствие, които не сте предвидили.

Повечето екипи не се заемат да създават пристрастна изкуствена интелигентност. Това се случва, защото данните са хаотични, реалният свят е неравен, а инструментите, които използваме, не винаги мислят по начина, по който очакваме. Добрата новина е, че не е нужно да сте специалист по данни, за да разберете какво се случва.

В този блог ще ви разясним какво всъщност е пристрастността на изкуствения интелект, защо се появява и как може да се прояви в ежедневните бизнес инструменти.

Какво е пристрастието в изкуствения интелект?

Пристрастността на изкуствения интелект се проявява, когато система за изкуствен интелект дава систематични, несправедливи резултати, които постоянно облагодетелстват или поставят в неравностойно положение определени групи от хора. Това не са просто случайни грешки, а предвидими модели, които се запечатват в начина, по който изкуственият интелект взема решения. Причината? Изкуственият интелект се учи от данни, които отразяват съществуваща човешка пристрастност, други несъзнателни пристрастности и социални неравенства.

Помислете за това по следния начин: ако обучите алгоритъм за наемане на персонал въз основа на данни от десет години, в които 90% от мениджърите са мъже, изкуственият интелект може погрешно да заключи, че мъжкият пол е ключова квалификация за мениджърска позиция. Изкуственият интелект не действа злонамерено, а просто идентифицира и повтаря моделите, които са му били показани.

Ето какво прави пристрастията в изкуствения интелект толкова сложни:

- Това е систематично, а не случайно: несправедливостта не е еднократна грешка, а повтарящ се модел в резултатите на изкуствения интелект.

- Често това е невидимо: Пристрастните резултати могат да се скрият зад сложната математика на привидно неутрален алгоритъм, което ги прави трудни за забелязване.

- Това се корени в данните и дизайна: Пристрастията се промъкват в системата чрез изборите, които ние, хората, правим, когато създаваме и обучаваме изкуствения интелект.

⭐ Представен шаблон

Шаблонът за доклад за реакция при инциденти на ClickUp предоставя готова структура за документиране, проследяване и разрешаване на инциденти от начало до край. Записвайте всички relevante подробности за инцидента, поддържайте ясно категоризирани статуси и записвайте важни атрибути като тежест, засегнати групи и стъпки за отстраняване. Поддържа персонализирани полета за неща като Одобрено от, Бележки за инцидента и Подкрепящи документи, които помагат за установяване на отговорност и доказателства през целия процес на преглед.

📖 Прочетете още: Как да извършите оценка на риска: инструменти и техники

Защо е важно да се намалява пристрастността на изкуствения интелект

Когато вашите AI системи са несправедливи, рискувате да навредите на живота на реални хора.

Това от своя страна излага вашата организация на сериозни бизнес предизвикателства и може дори да унищожи доверието, което сте изградили с много усилия сред вашите клиенти.

Пристрастна изкуствена интелигентност, която отказва заем на някого, отхвърля кандидатурата му за работа или дава неправилна препоръка, води до сериозни последствия в реалния свят.

Новите индустриални стандарти и рамки насърчават организациите да идентифицират и преодоляват активно пристрастността в своите AI системи. Рисковете засягат вашата организация от всички страни:

- Регулаторен риск: Неспазването на новите стандарти за изкуствен интелект може да доведе до значителни бизнес предизвикателства.

- Увреждане на репутацията: Веднъж след като обществеността разбере, че вашият AI е пристрастен, е изключително трудно да си върнете доверието й.

- Оперативна неефективност: Пристрастните модели дават ненадеждни резултати или AI халюцинации, които водят до лоши решения и изискват скъпи поправки.

- Етична отговорност: Вашата организация трябва да гарантира, че технологията, която използвате, третира всички потребители справедливо.

Когато успеете да намалите пристрастността, ще създадете AI системи, на които хората могат да разчитат. Справедливата AI отваря врати към нови пазари, подобрява качеството на вашите решения и показва на всички, че сте ангажирани с етичното управление на бизнеса си.

📮 ClickUp Insight: 22% от нашите респонденти все още са нащрек, когато става въпрос за използването на изкуствен интелект на работното място. От тези 22% половината се притесняват за поверителността на данните си, а другата половина просто не са сигурни, че могат да се доверят на това, което им казва изкуственият интелект.

ClickUp се справя с двата проблема чрез солидни мерки за сигурност и чрез генериране на подробни връзки към задачи и източници с всеки отговор.

Това означава, че дори и най-предпазливите екипи могат да започнат да се радват на повишената производителност, без да се тревожат дали информацията им е защитена или дали получават надеждни резултати.

📖 Прочетете още: AI Compliance Assistant: Как AI променя съответствието и одитите

Видове и източници на пристрастност в изкуствения интелект

Пристрастията могат да се промъкнат в AI системите ви от различни посоки.

От момента, в който започнете да събирате данни, до дълго след внедряването на системата, този елемент остава донякъде стабилен. Но ако знаете къде да търсите, можете да насочите усилията си и да спрете да играете безкрайна игра на „удари мишката“ с несправедливи резултати.

Пристрастност при вземането на проби

Пристрастност при вземането на проби се получава, когато данните, които използвате за обучение на AI, не отразяват точно реалния свят, в който AI ще се използва.

Например, ако създадете система за разпознаване на глас, обучена предимно на данни от американски англоговорящи, тя естествено ще има затруднения да разбере хора с шотландски или индийски акцент, подобно на това как LLM предпочитат имена, свързани с белите, в 85,1% от случаите при прегледа на автобиографии. Това недостатъчно представяне създава огромни слепи петна, което оставя вашия модел неподготвен да обслужва цели групи от хора.

Алгоритмична пристрастност

Алгоритмичната пристрастност възниква, когато дизайнът на модела или математическият процес усилват несправедливи модели, дори ако данните изглеждат неутрални.

Пощенският код на дадено лице не бива да определя дали то ще получи заем, но ако пощенските кодове във вашите тренировъчни данни са силно корелирани с расата, алгоритъмът може да се научи да използва местоположението като заместител за дискриминация.

Този проблем се влошава още повече с обратните връзки – когато пристрастно предсказание (като отказ за отпускане на заем) се въвежда обратно в системата като нови данни, пристрастността само се засилва с времето.

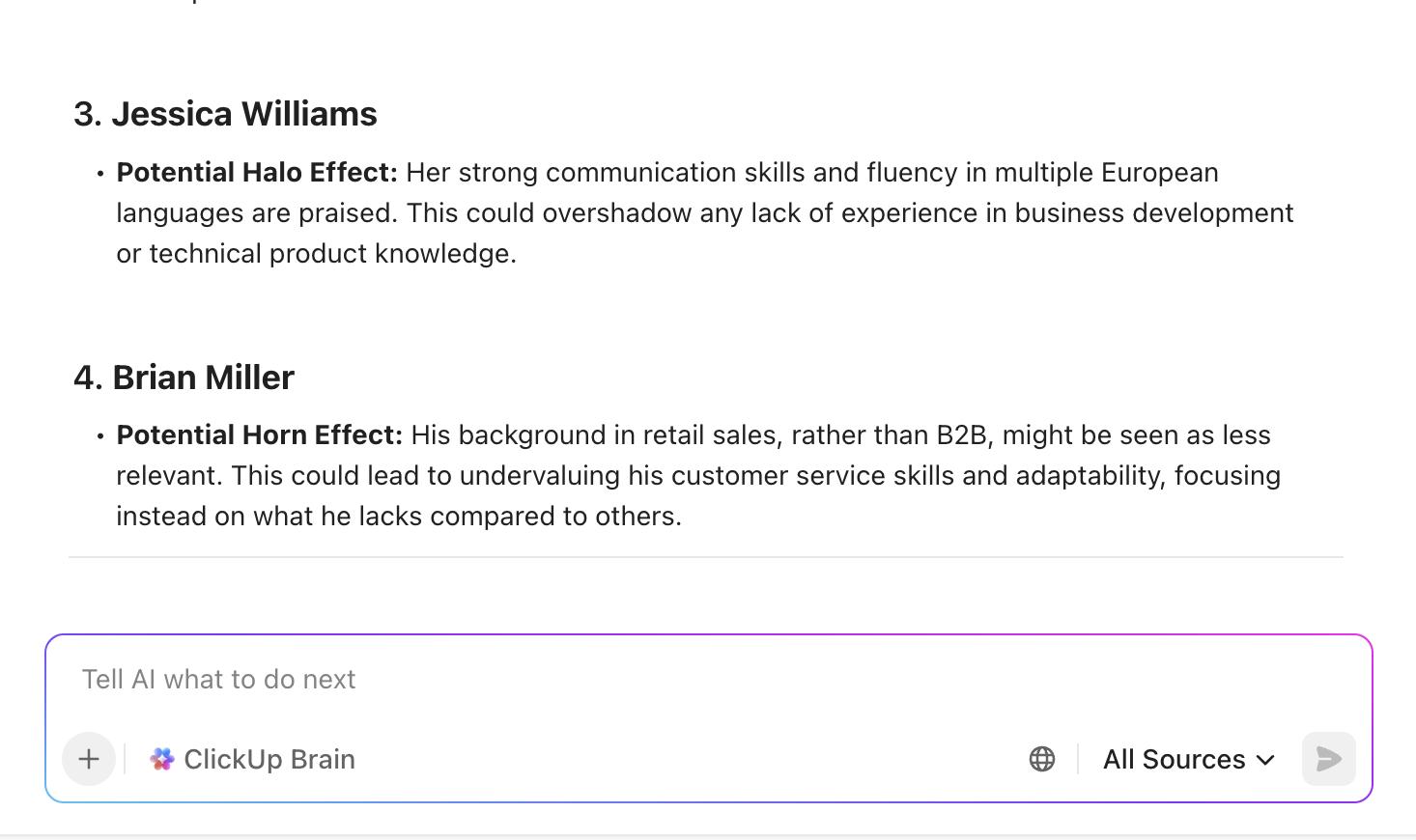

Човешки предразсъдъци при вземането на решения

Всеки избор, който човек прави при изграждането на AI система, може да доведе до пристрастност.

Това включва вземане на решение кои данни да се събират, как да се маркират и как да се дефинира „успехът“ за модела. Например, един екип може несъзнателно да предпочита данни, които подкрепят това, в което вече вярва (пристрастие към потвърждение), или да дава прекалено голяма тежест на първата информация, която вижда (пристрастие към закрепване).

Дори екипите с най-добри намерения могат случайно да кодират собствените си предположения и мироглед в системата за изкуствен интелект.

📖 Прочетете още: 10 шаблона за управление на проекти за управление на задачи

Примери за пристрастност на изкуствения интелект в реалния свят

Реални компании са се сблъскали с тежки последствия, когато техните AI системи са проявили пристрастност, което им е струвало милиони в щети и загуба на доверието на клиентите. Ето няколко документирани примера:

1. Пристрастни инструменти за набиране на персонал

Един от най-цитираните случаи е свързан с голяма технологична компания, която премахна вътрешна система за набиране на персонал, базирана на изкуствен интелект , след като установи, че тя предпочита мъжките кандидати пред жените. Системата беше обучена на базата на десет години автобиографии, в които повечето успешни кандидати бяха мъже. Затова тя започна да санкционира автобиографии, в които се срещаха думи като „женски“, като дори понижаваше оценките на завършилите женски колежи.

Това показва как пристрастията в историческите данни, когато миналите модели отразяват съществуващо неравенство, могат да се промъкнат в автоматизацията, ако не бъдат внимателно проверени. Но с разпространението на автоматизираното набиране на персонал с изкуствен интелект, мащабът на проблема става още по-голям.

🌼 Знаете ли, че: Последните данни показват, че 37% от организациите вече „активно интегрират“ или „експериментират“ с инструменти на Gen AI в процеса на набиране на персонал, което е увеличение спрямо 27% преди година.

2. Разпознаване на лица, което пропуска половината от населението

Изследване, ръководено от Джой Буоламвини и документирано в проучването Gender Shades, разкри, че търговските системи за лицево разпознаване имат процент на грешки до 34,7% при жените с тъмна кожа, в сравнение с по-малко от 1% при мъжете с светла кожа.

Това отново е отражение на небалансираните тренировъчни набори от данни. Пристрастността в биометричните инструменти има още по-далеко достигащи ефекти.

Полицията и правителствените агенции също са се сблъскали с проблеми, свързани с пристрастното разпознаване на лица. Разследвания на The Washington Post установиха , че някои от тези системи са много по-склонни да идентифицират погрешно хора от маргинализирани групи. В няколко реални случая това доведе до неправомерни арести, обществено недоволство и сериозни опасения относно това как тези инструменти засягат правата на хората.

📖 Прочетете още: Изкуствен интелект на работното място: начини за подобряване на производителността и ефективността

3. Алгоритми в здравеопазването, които не дават достатъчно приоритет на грижите

Системите за изкуствен интелект в здравеопазването, предназначени да предсказват кои пациенти се нуждаят от допълнителни грижи, също са показали пристрастност.

В един добре документиран случай широко използван алгоритъм за прогнозиране в здравеопазването допусна значителна грешка. Той трябваше да помогне при вземането на решение кои пациенти да получат допълнителни грижи, но в крайна сметка систематично даде по-ниска приоритетност на чернокожите пациенти, дори когато те бяха в същото или по-тежко състояние от белите пациенти.

Това се случи, защото моделът използваше разходите за здравеопазване като показател за медицинските нужди. Тъй като чернокожите пациенти исторически са имали по-ниски разходи за здравеопазване поради неравен достъп до грижи, алгоритъмът ги третираше като по-малко нуждаещи се. В резултат на това той отклони ресурсите за грижи от тези, които всъщност се нуждаеха от тях най-много. Изследователите установиха, че простото коригиране на този показател може значително да увеличи достъпа до справедливи програми за грижи.

Загрижеността по тези въпроси е накарала групите за граждански права да настояват за стандарти за „справедливост на първо място“ в изкуствения интелект в здравеопазването. През декември 2025 г. NAACP публикува подробен план, в който призовава болниците, технологичните компании и политиците да въведат одити за предубеждения, прозрачни практики за проектиране, приобщаващи рамки и инструменти за управление на изкуствения интелект, за да се предотврати задълбочаването на расовите неравенства в здравеопазването.

4. Кредитни алгоритми с неравномерни резултати

Изкуственият интелект и автоматизираното вземане на решения не само оформят това, което виждате в социалните медии, но и влияят върху това кой получава достъп до пари и при какви условия.

Един от най-обсъжданите примери от реалния свят е Apple Card , дигитална кредитна карта, издадена от Goldman Sachs.

През 2019 г. клиенти в социалните медии споделиха, че алгоритъмът за кредитен лимит на картата даваше много по-високи лимити на някои мъже, отколкото на съпругите или партньорките им. Това се случваше дори когато двойките имаха сходни финансови профили. Един софтуерен инженер заяви, че е получил кредитния лимит, който е 20 пъти по-висок от този на съпругата му, а дори съоснователят на Apple Стив Возняк потвърди подобен случай с неговата съпруга.

Тези модели предизвикаха обществено недоволство и доведоха до разследване от страна на Департамента за финансови услуги на щата Ню Йорк дали алгоритъмът дискриминира жените, като подчертаха как автоматизираните финансови инструменти могат да доведат до неравностойни резултати.

📖 Прочетете още: Как да използвате изкуствения интелект за управление на данни (примери за употреба и инструменти)

5. Автоматични надписи и разпознаване на глас, които изключват гласове

Системите за разпознаване на реч и автоматично субтитриране често не чуват всички по еднакъв начин. Множество проучвания показват, че тези инструменти работят по-добре за едни говорители, отколкото за други, в зависимост от фактори като акцент, диалект, раса и дали английският е първият език на говорителя.

Това се случва, защото търговските системи обикновено се обучават на бази данни, доминирани от определени речеви модели – често западен, стандартен английски – като другите гласове остават недостатъчно представени.

Например, изследователи от Станфорд тестваха пет водещи системи за преобразуване на реч в текст (от Amazon, Google, Microsoft, IBM и Apple) и установиха, че те правят почти два пъти повече грешки при транскрибирането на речта на чернокожи оратори в сравнение с бели оратори. Проблемът възникваше дори когато субектите произнасяха едни и същи думи при едни и същи условия.

Когато субтитрите са неточни за определени говорители, това може да доведе до лошо потребителско преживяване и недостъпност за хора, които разчитат на субтитри. По-лошото е, че това може да допринесе за пристрастни резултати в системи, които използват разпознаване на реч в областта на наемането на персонал, образованието или здравеопазването.

Всеки от тези примери илюстрира различен начин, по който пристрастността може да бъде вградена в автоматизираните системи чрез изкривени данни за обучение, лошо подбрани прокси сървъри или нерепрезентативни тестове. Във всеки случай резултатите не са само технически – те определят възможностите, подкопават доверието и носят реални бизнес и етични рискове.

📖 Прочетете още: Рискове срещу проблеми – каква е разликата?

Резюме: Как се проявяват предубежденията в изкуствения интелект и на кого навреждат

| Къде се появиха предубежденията | Кой беше засегнат | Реално въздействие |

|---|---|---|

| Алгоритми за набиране на персонал (отхвърлен инструмент за наемане на персонал с изкуствен интелект) | Жени | Автобиографиите бяха понижени въз основа на ключови думи, свързани с пола, което намали достъпа до интервюта и възможности за работа. |

| Системи за лицево разпознаване (Gender Shades + случаи на неправомерно арестуване) | Жени с тъмна кожа; маргинализирани расови групи | Много по-високите проценти на грешни идентификации доведоха до неправомерни арести, увреждане на репутацията и проблеми с гражданските права. |

| Алгоритми за прогнозиране на рискове в здравеопазването (изследване на Университета в Чикаго) | Чернокожи пациенти | Пациентите бяха лишавани от приоритет за допълнителни грижи, защото разходите за здравеопазване се използваха като неточен показател за медицинските нужди, което влоши неравенството в здравеопазването. |

| Алгоритми за кредитни лимити (разследване на Apple Card) | Жени | Мъжете получават значително по-високи кредитни лимити от жените с еднакви квалификации, което се отразява на достъпа до финансиране и възможностите за кредитиране. |

| Разпознаване на реч и автоматични субтитри (проучване на Stanford ASR) | Говорители с нестандартни акценти; Чернокожи говорители | Почти двойно по-високите нива на грешки създадоха бариери за достъп, недоразумения и пристрастни резултати в инструментите, използвани при наемане на работа, образование и ежедневен достъп до цифрови технологии. |

Стратегии за намаляване на пристрастията, които работят

Няма едно единствено чудодейно средство за елиминиране на пристрастията в изкуствения интелект.

Ефективното намаляване на пристрастността изисква многослойна защита, която се прилага през целия жизнен цикъл на изкуствения интелект. Чрез комбинирането на тези доказани стратегии можете значително да намалите риска от несправедливи резултати.

Събирайте разнообразни данни за обучение

Представителните данни са абсолютната основа на справедливата изкуствена интелигентност.

Вашият модел не може да се научи да обслужва групи от хора, които никога не е виждал по време на обучението си. Започнете с проверка на съществуващите си набори от данни, за да откриете евентуални демографски пропуски. След това положете съзнателни усилия да съберете нови данни от тези недостатъчно представени групи от населението.

Когато е трудно да се намерят данни от реалния свят, можете да използвате техники като увеличаване на данните (създаване на модифицирани копия на съществуващи данни) или генериране на синтетични данни, за да запълните празнините.

🚧 Набор от инструменти: Използвайте шаблона за вътрешен одит на ClickUp, за да планирате процеса на одит.

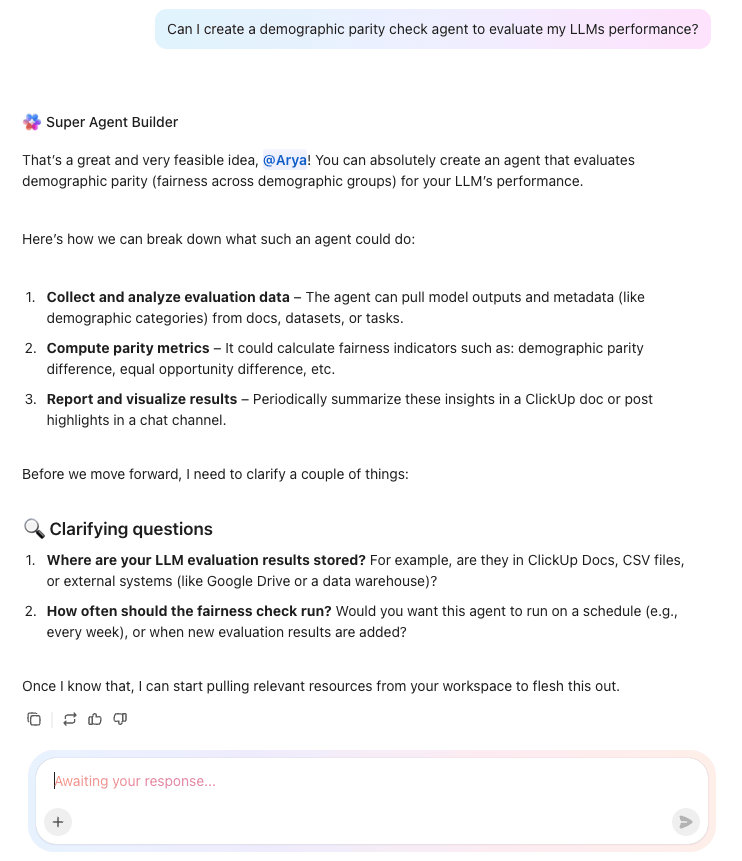

Тествайте модели за пристрастност

Трябва систематично да тествате за пристрастност, за да я откриете, преди да нанесе реална вреда. Използвайте показатели за справедливост, за да измерите как се представя вашият модел в различни групи.

Например, демографската паритет проверява дали моделът дава положителен резултат (като одобрение на заем) при равни проценти за всички групи, докато изравнените шансове проверяват дали процентите на грешките са равни.

Разделете ефективността на модела си по всички възможни демографски характеристики – раса, пол, възраст, географско положение – за да откриете къде има спад в точността или се прокрадва несправедливост.

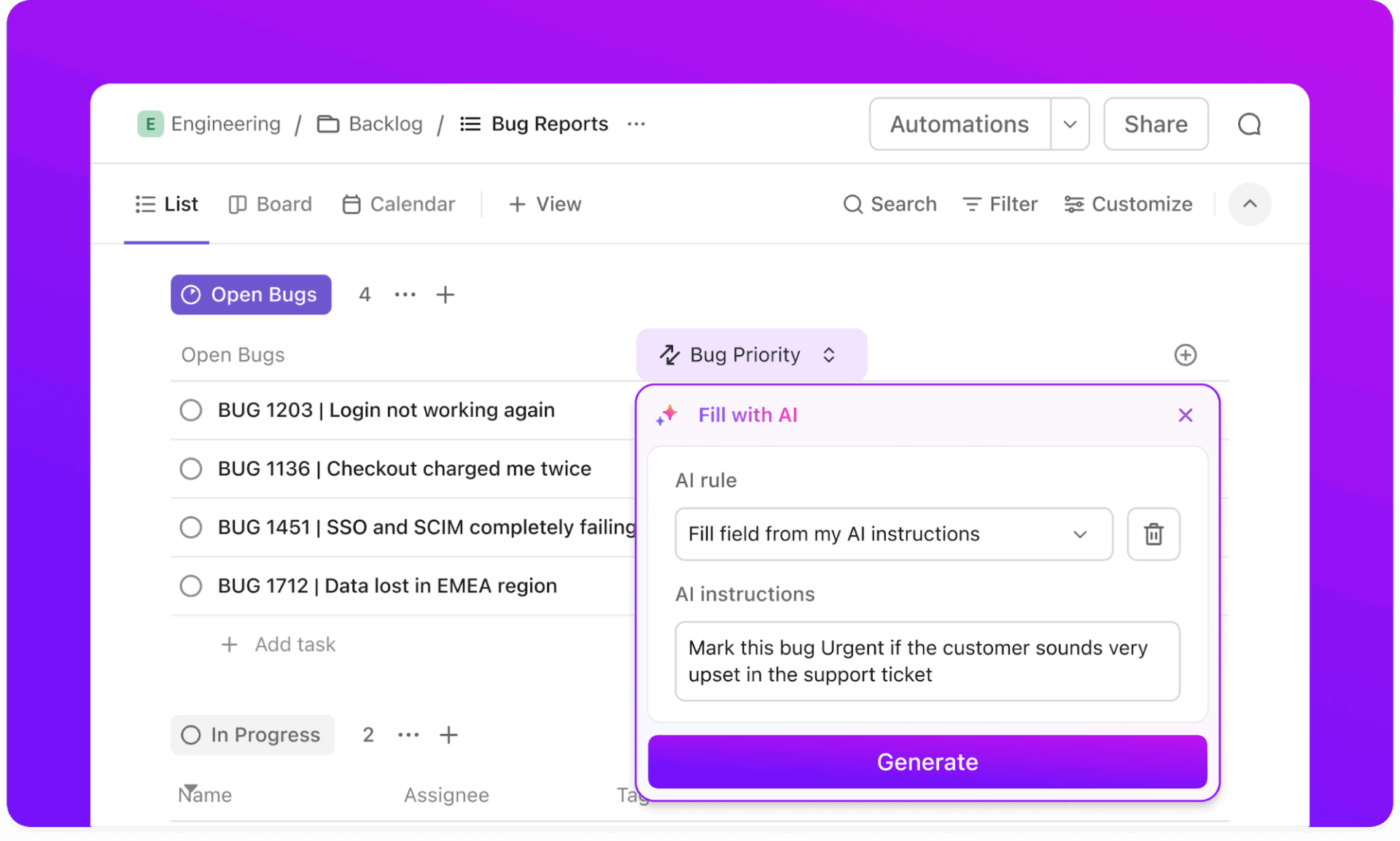

Поддържайте човешкия фактор в цикъла

Автоматизираните системи могат да пропуснат фини, контекстно-специфични несправедливости, които човек би забелязал веднага. Подходът „човек в цикъла“ е от решаващо значение за решения с висок залог, при които AI може да даде препоръка, но човек взема окончателното решение.

Това е особено важно в области като наемане на персонал, отпускане на кредити и медицинска диагностика. За да функционира това, вашите човешки рецензенти трябва да бъдат обучени да разпознават пристрастността и да имат правомощията да отменят предложенията на изкуствения интелект.

📖 Прочетете още: Как да използвате AI, ориентирана към човека, на работното място: Пълно ръководство

Прилагайте техники за алгоритмична справедливост

Можете също да използвате технически методи, за да се намесите директно и да намалите пристрастността. Тези техники се разделят на три основни категории:

- Предварителна обработка: Това включва коригиране на данните за обучение преди моделът да ги види, често чрез претегляне или повторно вземане на проби от данните, за да се създаде по-балансирано представяне на различните групи.

- В процеса на обработка: Тук добавяте ограничения за справедливост директно в процеса на обучение на модела, като го научавате да оптимизира едновременно точността и справедливостта.

- Пост-обработка: Това означава коригиране на окончателните прогнози на модела след като са направени, за да се гарантира, че резултатите са справедливи за всички групи.

Тези техники често включват компромис, при който може да е необходимо леко намаляване на общата точност, за да се постигне значително подобрение в справедливостта.

💟 Бонус: BrainGPT е вашият AI-задвижван десктоп спътник, който извежда тестването на AI пристрастия на ново ниво, като ви дава достъп до множество водещи модели – включително GPT-5, Claude, Gemini и други – всичко на едно място.

Това означава, че можете лесно да изпълнявате едни и същи команди или сценарии в различни модели, да сравнявате техните способности за разсъждение и да откривате къде отговорите се различават или показват пристрастност. Това супер приложение за изкуствен интелект ви позволява също да използвате функцията „говори към текст“, за да настроите тестови случаи, да документирате своите заключения и да организирате резултатите за паралелен анализ.

Неговите усъвършенствани инструменти за разсъждение и контекстно съзнание ви помагат да отстранявате проблеми, да подчертавате модели и да разбирате как всеки модел подхожда към чувствителни теми. Чрез централизиране на работния ви процес и позволяване на прозрачно, мултимоделно тестване, Brain MAX ви дава възможност да проверявате, сравнявате и отстранявате пристрастията на изкуствения интелект с увереност и прецизност.

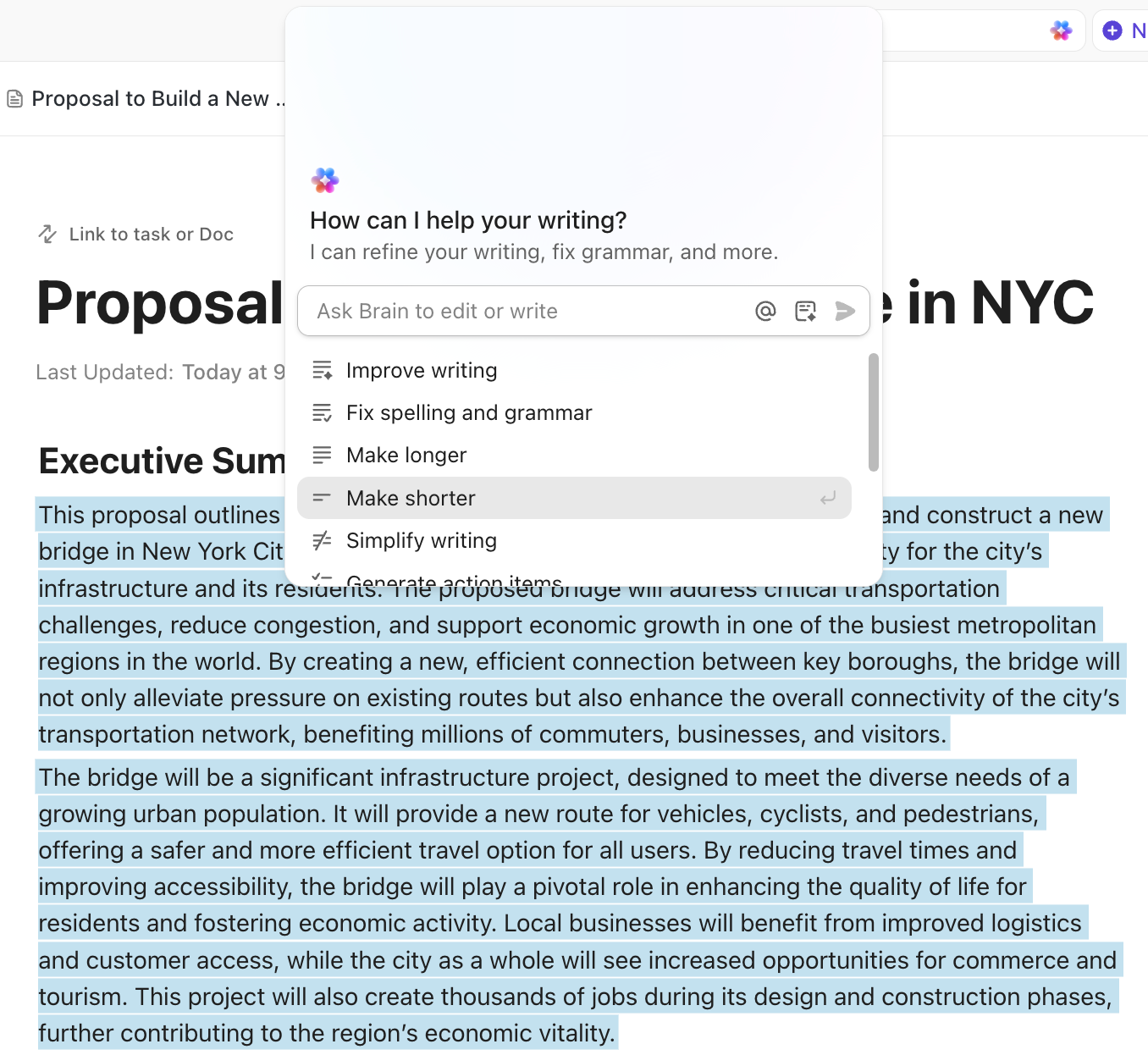

Повишете прозрачността и обяснимостта

Ако не знаете как вашият модел взема решения, не можете да го поправите, когато е грешен. Техниките за обяснима изкуствена интелигентност (XAI) ви помагат да надникнете в „черната кутия“ и да видите кои характеристики на данните определят прогнозите.

Можете също да създадете карти с модели, които са като етикети с хранителна информация за вашия AI, документиращи предназначението му, данни за производителността и известни ограничения.

📮ClickUp Insight: 13% от участниците в нашето проучване искат да използват изкуствен интелект, за да вземат трудни решения и да решават сложни проблеми. Въпреки това само 28% казват, че използват изкуствен интелект редовно в работата си. Възможна причина: опасения за сигурността!

Потребителите може да не желаят да споделят чувствителни данни, свързани с вземането на решения, с външен AI.

ClickUp решава този проблем, като предоставя AI-базирано решаване на проблеми директно във вашето защитено работно пространство. От SOC 2 до ISO стандарти, ClickUp отговаря на най-високите стандарти за сигурност на данните и ви помага да използвате безопасно генеративната AI технология в цялото си работно пространство.

Политики за управление и отчетност на изкуствения интелект

Една силна програма за управление на изкуствения интелект създава ясни отговорности и последователни стандарти, които всеки член на екипа може да следва.

Вашата организация се нуждае от ясни структури за управление, за да гарантира, че винаги има някой, който носи отговорност за етичното създаване и внедряване на изкуствен интелект.

Ето основните елементи на ефективна програма за управление на изкуствения интелект:

| Елемент на управление | Какво означава това | Конкретни стъпки за вашата организация |

|---|---|---|

| Ясна собственост | Специализирани лица или екипи отговарят за етиката, надзора и съответствието на изкуствения интелект. | • Назначете ръководител по етика на изкуствения интелект или междуфункционален комитет • Определете отговорностите за данните, качеството на моделите, съответствието и риска • Включете мненията на юридическия, инженерния, продуктовия и DEI екип в надзора |

| Документирани политики | Писмени указания, които определят как се събират, използват и наблюдават данните през целия жизнен цикъл на изкуствения интелект. | • Създайте вътрешни политики за извличане, етикетиране, поверителност и съхранение на данни • Документирайте стандарти за разработване, валидиране и внедряване на модели • Изисквайте от екипите да следват контролни списъци, преди да пуснат в употреба която и да е AI система |

| Одитни следи | Прозрачен архив на решения, версии на модели, набори от данни и промени | • Въведете контрол на версиите за набори от данни и модели • Записвайте ключови решения, параметри на моделите и прегледайте резултатите • Съхранявайте одитни следи в централно, достъпно хранилище |

| Редовни прегледи | Непрекъснати оценки на AI системите за проверка на пристрастност, отклонения и пропуски в съответствието | • Планирайте тримесечни или полугодишни оценки на пристрастността чрез солидна LLM оценка • Преобучете или прекалибрирайте моделите, когато производителността спадне или поведението се промени • Прегледайте моделите след значителни актуализации на данните или промени в продукта |

| План за реагиране при инциденти | Ясен протокол за идентифициране, докладване и коригиране на пристрастията или вредите, причинени от изкуствения интелект. | • Създайте вътрешен работен процес за ескалиране на пристрастията • Определете как се разследват проблемите и кой одобрява корекциите • Очертайте стъпките за комуникация с потребители, клиенти или регулаторни органи, когато е необходимо |

💡Професионален съвет: Рамки като NIST AI Risk Management Framework и EU AI Act, с глоби до 7% от годишния оборот, могат да предоставят отлични модели за изграждане на ваша собствена програма за управление.

Как да намалите пристрастността с ClickUp

Конвергентната AI работна среда на ClickUp обединява всички движещи се части на вашата програма за управление на AI в една организирана работна среда.

Вашите екипи могат да управляват задачи, да съхраняват политики, да преглеждат резултати от одити, да обсъждат рискове и да проследяват инциденти, без да преминават от един инструмент към друг или да губят контекста. Всеки запис на модел, регистър на решения и план за коригиращи мерки остава свързан, така че винаги знаете кой какво е направил и защо.

И тъй като изкуственият интелект на ClickUp разбира работата във вашето работно пространство, той може да извади на повърхността минали оценки, да обобщи дълги доклади и да помогне на вашия екип да остане съгласуван с развитието на стандартите. Резултатът е система за управление, която е по-лесна за следване, по-лесна за одит и много по-надеждна с разрастването на вашия изкуствен интелект.

Нека го разгледаме като работен процес!

Стъпка 1: Настройте работното си пространство за управление на изкуствения интелект

Започнете с създаването на специално пространство в ClickUp за цялата работа, свързана с управлението. Добавете списъци за инвентара на вашите модели, оценки на пристрастията, доклади за инциденти, документи за политики и планирани прегледи, така че всеки елемент от програмата да се намира в една контролирана среда.

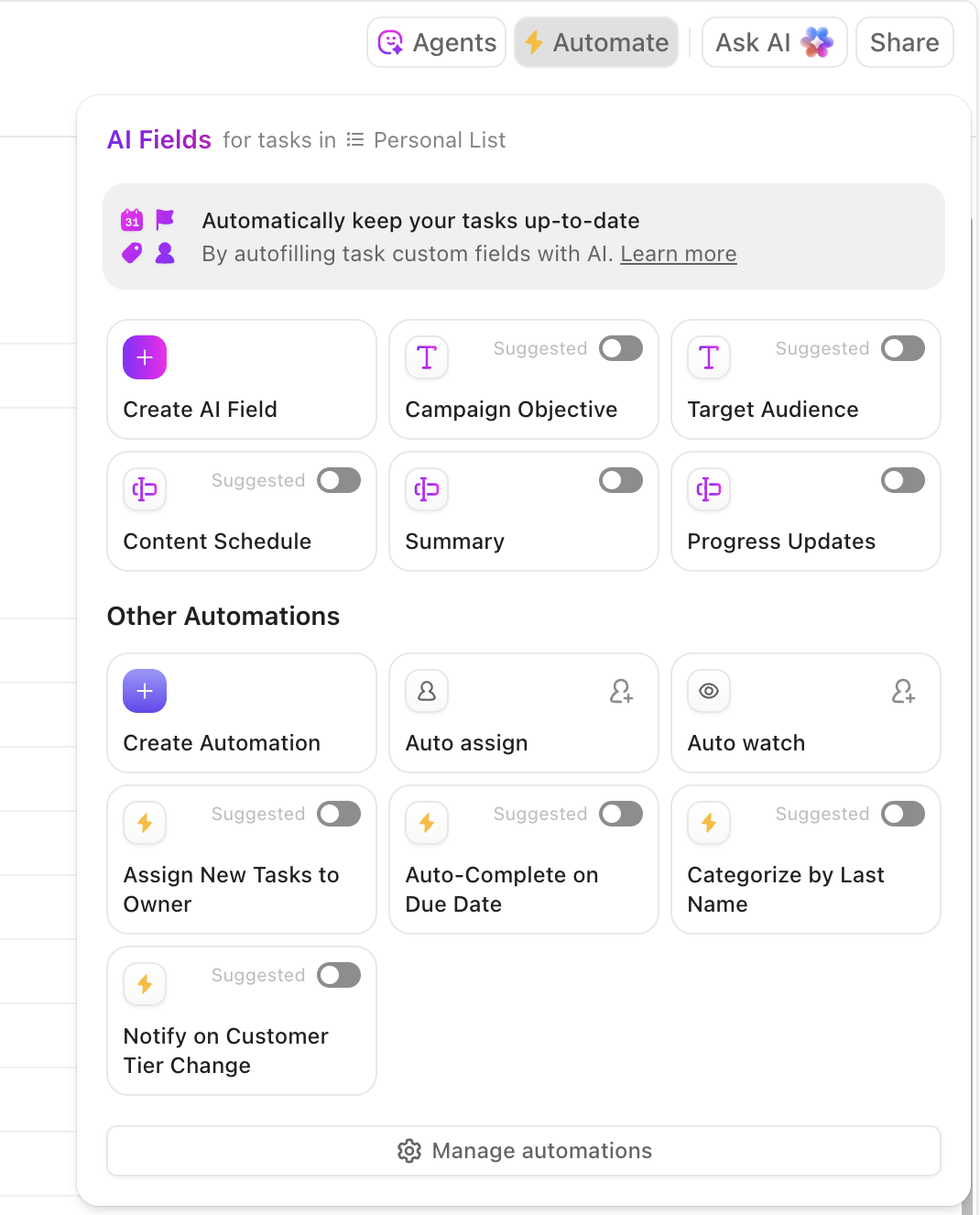

Конфигурирайте персонализирани полета или AI полета, за да проследявате показателите за справедливост, резултатите от тестовете за пристрастност, версиите на моделите, статуса на прегледа и нивата на риск. Използвайте разрешения, базирани на роли, за да гарантирате, че само оторизирани прегледачи, инженери и ръководители по съответствие имат достъп до чувствителна AI работа. Това създава структурна основа, която инструментите на конкурентите и общите платформи за проекти не могат да предложат.

Стъпка 2: Изградете своя рамка за управление

След това създайте ClickUp Doc, който да ви служи като жива наръчник за управление. Тук очертавате процедурите си за оценка на пристрастията, праговете за справедливост, указанията за документиране на моделите, стъпките за човешко участие и протоколите за ескалация.

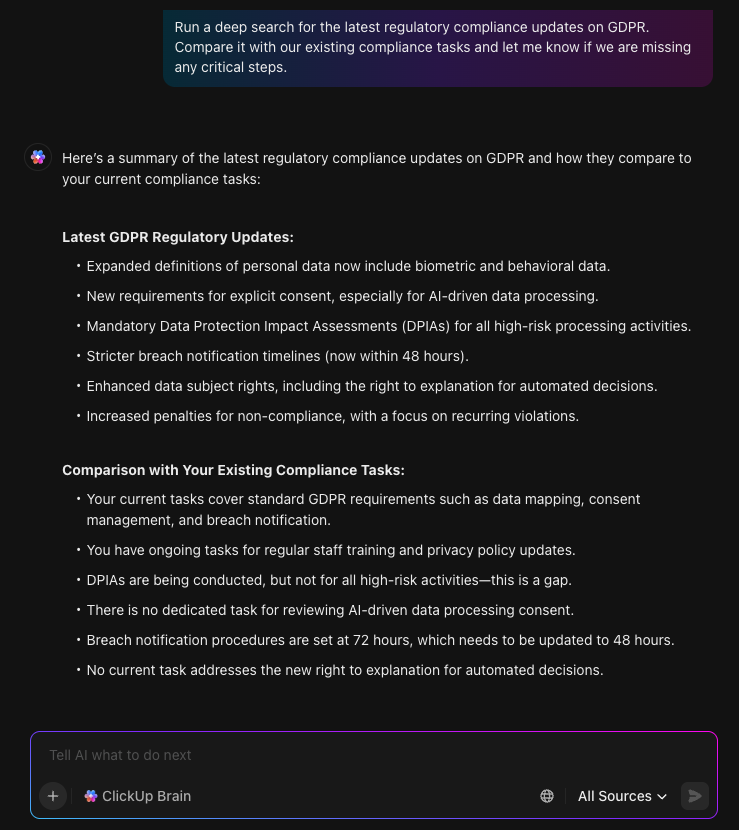

Тъй като документите остават свързани със задачите и записите на моделите, вашите екипи могат да си сътрудничат, без да губят историята на версиите или да разпръскват файловете в различни инструменти. Следващото, ClickUp Brain може да ви помогне да обобщите външни регламенти, да изготвите нови текстове на политики или да изведете на преден план предишни констатации от одити, което прави създаването на политики по-последователно и проследимо.

Тъй като може да търси в интернет, да превключва между няколко AI модели и да синтезира информация в ясни указания, вашият екип остава в крак с нововъзникващите стандарти и промените в бранша, без да напуска работното си място. Всичко, от което се нуждаете – актуализации на политиките, регулаторни прозрения и минали решения – е събрано на едно място, което прави вашата система за управление по-стабилна и много по-лесна за поддържане.

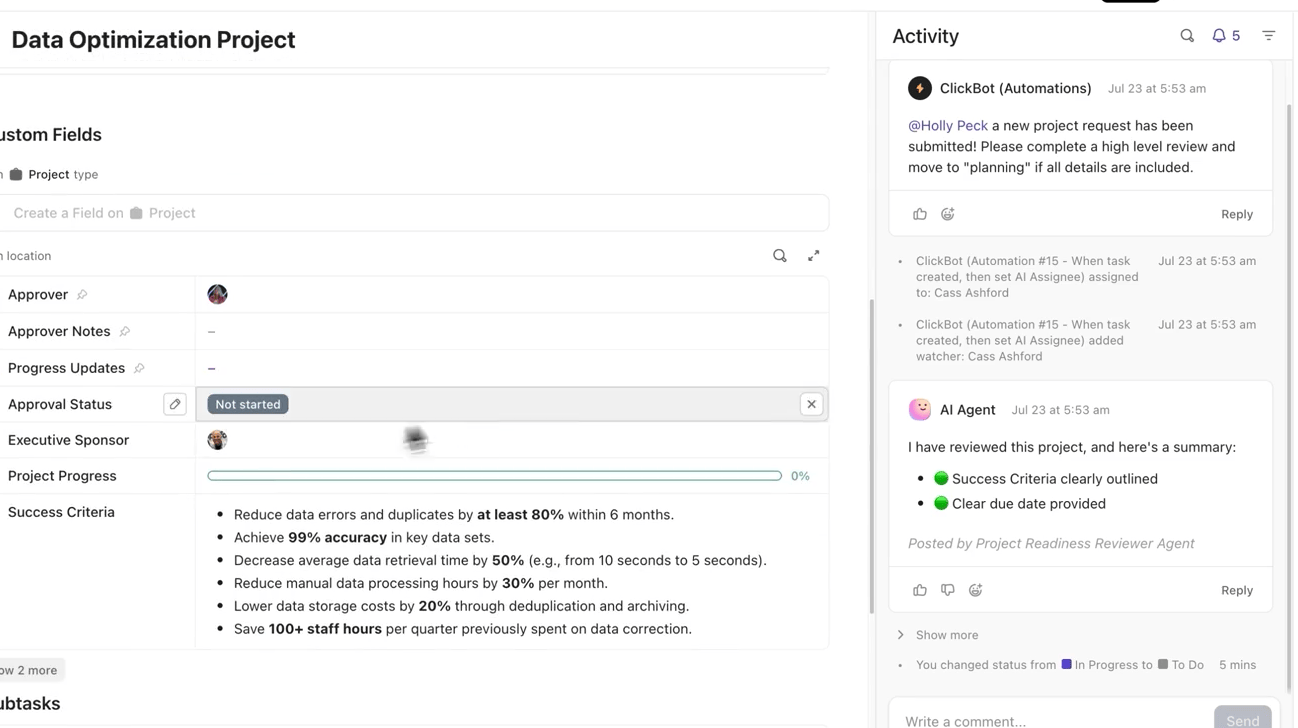

Стъпка 3: Регистрирайте всеки модел

Всеки модел трябва да има своя собствена задача в списъка „Инвентар на моделите“, така че собствеността и отговорността винаги да са ясни.

Лесно проследявайте всеки случай на пристрастност като действие, което може да бъде предприето, като използвате ClickUp Tasks и ClickUp Custom Fields, за да структурирате работните си процеси за оценка на пристрастността и да записвате всеки важен детайл.

По този начин можете да проследявате типа на пристрастността, степента на сериозност, състоянието на корекцията, отговорния член на екипа и следващата дата за преглед, като по този начин гарантирате, че всеки проблем има ясен отговорник и краен срок.

Прикачете набори от данни, обобщения на оценки и бележки за произхода, за да имате всичко на едно място. Автоматизираните процеси могат да предупреждават рецензентите, когато даден модел премине в етап на подготовка или производство.

Стъпка 4: Извършвайте планирани и събитиеви одити за предубеждения

Одитите за пристрастност трябва да се извършват както по график, така и в отговор на конкретни събития.

Настройте прости правила чрез ClickUp Automations, които автоматично задействат задачи за преглед, когато даден модел достигне нов етап на внедряване или настъпи срокът за планиран одит. Никога повече няма да пропуснете тримесечната оценка на пристрастността, тъй като Automations може да назначи подходящите прегледащи, да зададе правилни крайни срокове и дори да изпрати напомняния, когато наближи крайният срок.

За одити, основани на събития, ClickUp Forms улеснява събирането на доклади за случаи на пристрастност или обратна връзка от хора, докато рецензентите използват Custom Fields, за да регистрират пропуски в справедливостта, резултати от тестове и препоръки. Всяко подадено формуляр се препраща към вашия екип като задача, което създава повторяема одитна линия.

Стъпка 5: Разследвайте и разрешавайте случаи на пристрастност

Когато бъде идентифициран проблем с пристрастността, създайте задача за инцидент, която отразява сериозността, засегнатите групи, версията на модела и необходимите мерки за смекчаване. AI агентите могат да ескалират констатациите с висок риск до отговорниците за съответствие и да възложат задачата на подходящите рецензенти и инженери.

Всяко действие за намаляване на пристрастието, резултат от тест и стъпка за валидиране остава свързано с записите за инцидента. ClickUp Brain може да генерира обобщения за ръководството или да помогне за подготовката на бележки за коригиращи мерки за вашата документация за управление, като поддържа всичко прозрачно и проследимо.

Стъпка 6: Следете състоянието на програмата си за управление на изкуствения интелект

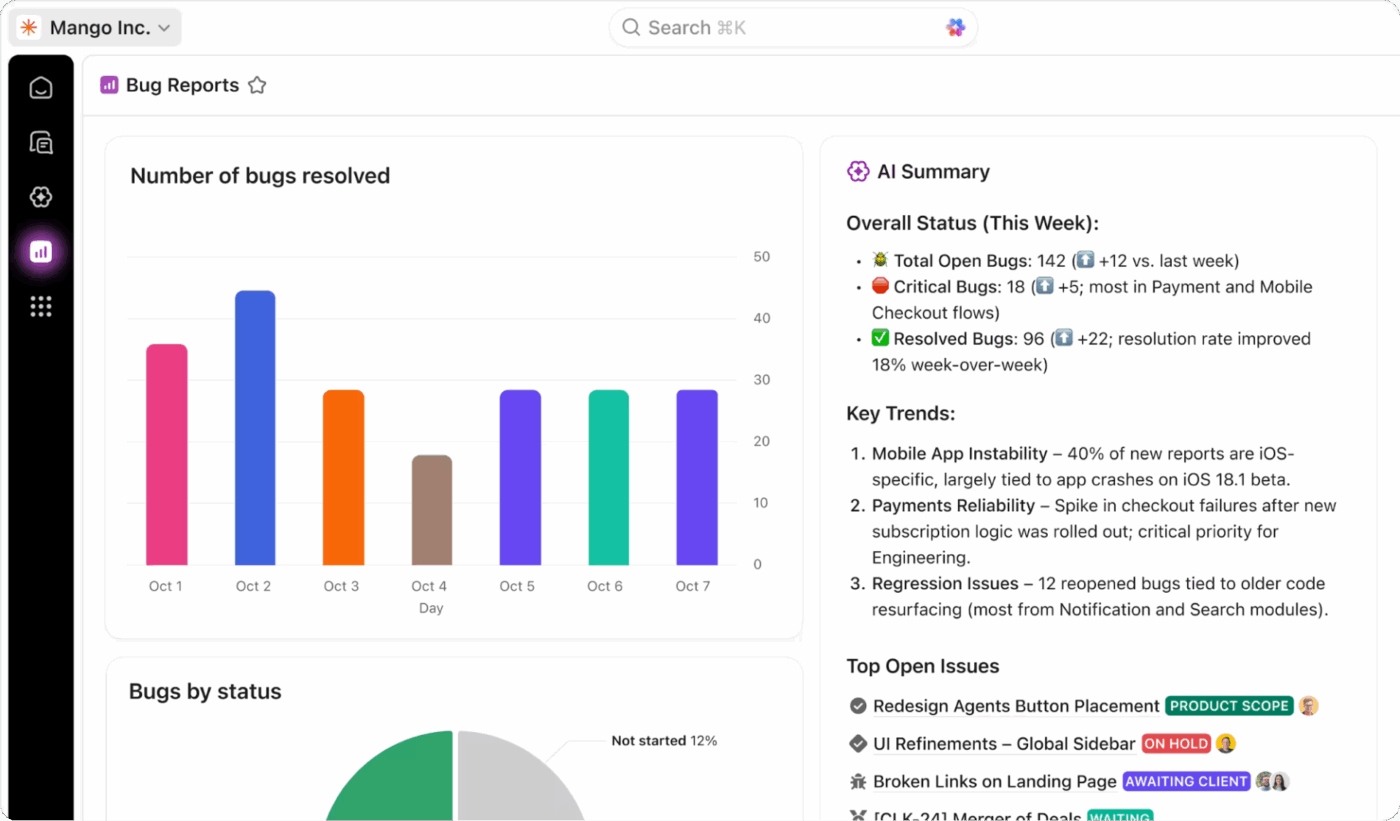

Накрая, създайте табла, които дават на лидерите реално време преглед на вашата програма за намаляване на пристрастията.

Включете панели, показващи отворени инциденти, време за разрешаване, процент на завършени одити, показатели за справедливост и състояние на съответствие за всички активни модели. Таблата без код в ClickUp могат автоматично да извличат данни и да актуализират задачите с напредъка на работата, с AI обобщения, вградени в изгледа на таблото.

Проверки за пристрастност след внедряване

Работата ви не приключва с пускането в експлоатация на AI модела.

Всъщност, тогава започва истинското изпитание. Моделите могат да „се отклонят“ и да развият нови предубеждения с течение на времето, тъй като реалните данни, които виждат, започват да се променят. Непрекъснатото наблюдение е единственият начин да се забележи това възникващо предубеждение, преди да причини широко разпространена вреда.

Ето какво трябва да включва вашето текущо наблюдение:

| Практика | Какво гарантира |

|---|---|

| Проследяване на ефективността по групи | Непрекъснато измерва точността и справедливостта на модела в различните демографски сегменти, за да се откриват неравенствата на ранен етап. |

| Откриване на отклонения в данните | Наблюдава промените в входните данни, които могат да въведат нови предубеждения или да отслабят ефективността на модела с течение на времето. |

| Обратна връзка от потребителите | Предоставя ясни канали за потребителите да съобщават за пристрастни или неточни резултати, подобрявайки надзора в реалния свят. |

| Планирани одити | Осигурява тримесечни или полугодишни задълбочени анализи на поведението на моделите, показателите за справедливост и изискванията за съответствие. |

| Реагиране при инциденти | Определя структуриран процес за разследване, коригиране и документиране на всички съобщени случаи на пристрастност. |

💟 Бонус: Генеративните AI системи, в частност, се нуждаят от допълнителна бдителност, защото резултатите от тях са много по-трудно предвидими от традиционните модели за машинно обучение. Чудесна техника за това е red-teaming, при която специален екип активно се опитва да провокира пристрастни или вредни реакции от модела, за да идентифицира неговите слаби места.

Например, проектът Lighthouse на Airbnb е отличен пример от индустрията за компания, която прилага систематично наблюдение на пристрастността след внедряването.

Това е изследователска инициатива, която проучва как възприеманата раса може да повлияе на резултатите от резервациите, като помага на компанията да идентифицира и намали дискриминацията на платформата. Тя използва методи, които гарантират поверителността, си сътрудничи с групи за граждански права и превръща резултатите в промени в продуктите и политиките, което позволява на повече гости да навигират в платформата, без да се сблъскват с невидими препятствия.

📖 Прочетете още: Генеративна изкуствена интелигентност срещу предсказваща изкуствена интелигентност: разбиране на разликите и приложенията им

Намалете пристрастността на изкуствения интелект с ClickUp

Създаването на справедлив и отговорен AI е ангажимент на цялата организация.

Когато вашите политики, хора, процеси и инструменти работят в хармония, вие създавате система за управление, която може да се адаптира към нови рискове, да реагира бързо на инциденти и да спечели доверието на хората, които разчитат на вашите продукти.

С структурирани прегледи, ясна документация и повтаряем работен процес за справяне с пристрастията, екипите остават съгласувани и отговорни, вместо да реагират в кризисен режим.

Чрез централизиране на всичко в ClickUp, от записи на модели до резултати от одити и доклади за инциденти, вие създавате единен оперативен слой, в който решенията са прозрачни, отговорностите са ясни и подобренията никога не се губят в бъркотията.

Силното управление не забавя иновациите, а ги стабилизира. Готови ли сте да включите намаляване на пристрастността в работните си процеси с изкуствен интелект? Започнете безплатно с ClickUp и започнете да изграждате вашата програма за управление на изкуствения интелект още днес.

Често задавани въпроси

Чудесна първа стъпка е да проведете одит на пристрастността на съществуващите ви AI системи. Тази базова оценка ще ви покаже къде в момента съществува несправедливост и ще ви помогне да определите приоритетите си в усилията за намаляване на пристрастността.

Екипите използват специфични показатели за справедливост, като демографска паритет, изравнени шансове и съотношение на неравномерно въздействие, за да количествено измерят пристрастността. Подходящият показател зависи от конкретния случай на употреба и вида справедливост, който е най-важен в този контекст.

Винаги трябва да добавяте етап на човешка проверка за решения с висок залог, които оказват значително влияние върху живота или възможностите на дадено лице, като например при наемане на работа, отпускане на заем или здравеопазване. Също така е разумно да го използвате по време на ранното внедряване на всеки нов модел, когато неговото поведение все още е непредсказуемо.

Тъй като генеративният AI може да произвежда почти безкраен набор от непредвидими отговори, не можете просто да проверите точността. Трябва да използвате активни техники за проучване, като red-teaming и мащабно изваждане на проби, за да разберете дали моделът произвежда пристрастно съдържание при различни условия.