Повечето от нас имат някакъв опит в „общуването“ с най-новите AI инструменти. Ако сте прекарали достатъчно време с AI, вече знаете, че той е като този брилянтен, но разсеян приятел, който има страхотни идеи, но понякога забравя за какво сте си говорили. Или като този колега, който винаги е на телефона и споделя съмнителни новини от случайни чат групи, разпространявайки дезинформация.

Това е само върхът на айсберга, когато говорим за предизвикателствата в областта на изкуствения интелект.

Изследователи от Орегонския държавен университет и Adobe разработват нова техника за обучение, за да намалят социалните предубеждения в системите за изкуствен интелект. Ако тази техника се окаже надеждна, тя може да направи изкуствения интелект по-справедлив за всички.

Но нека не избързваме. Това е само едно от многото решения, необходими за справяне с многобройните предизвикателства на изкуствения интелект, пред които сме изправени днес. От технически проблеми до етични дилеми, пътят към надежден изкуствен интелект е осеян с комплексни въпроси.

Нека разгледаме заедно тези предизвикателства, свързани с изкуствения интелект, и да видим какво е необходимо, за да ги преодолеем.

10 предизвикателства и решения в областта на изкуствения интелект

С напредъка на технологията на изкуствения интелект се появяват редица проблеми. Този списък разглежда десет наболели предизвикателства, свързани с изкуствения интелект, и предлага практични решения за отговорно и ефективно внедряване на изкуствения интелект.

1. Алгоритмична пристрастност

Алгоритмичната пристрастност се отнася до тенденцията на системите за изкуствен интелект да показват пристрастни резултати, често поради естеството на данните, с които са обучени, или поради дизайна им. Тези пристрастности могат да се проявяват в многобройни форми, често затвърждавайки и усилвайки съществуващите обществени пристрастности.

Решения

- Разнообразни и представителни данни: Използвайте обучителни набори от данни, които наистина отразяват разнообразието на всички групи, за да избегнете предубеждения, свързани с пола, етническата принадлежност или възрастта.

- Откриване и наблюдение на пристрастия: Редовно проверявайте AI системите си за пристрастия. Това трябва да бъде комбинация от автоматизирано наблюдение и ваши собствени ръчни прегледи, за да се уверите, че нищо не ви убягва.

- Алгоритмични настройки: Вземете активно участие в настройването на алгоритмите на изкуствения интелект, за да се борите с пристрастията. Това може да означава пребалансиране на тежестта на данните или добавяне на ограничения за справедливост към вашите модели.

- Етични насоки за изкуствения интелект: Допринесете за формирането на етични практики в областта на изкуствения интелект, като приемете и приложите насоки, които се занимават с въпросите за справедливостта и пристрастността, като гарантирате, че тези принципи са включени във всеки етап от вашия проект за изкуствен интелект.

2. Липсата на прозрачност на изкуствения интелект води до недоверие

Прозрачността в изкуствения интелект означава да бъдем отворени за това как функционират системите за изкуствен интелект, включително тяхното проектиране, данните, които използват, и процесите на вземане на решения. Обяснимият характер отива още по-далеч, като гарантира, че всеки, независимо от техническите си умения, може да разбере какви решения взема изкуственият интелект и защо. Тези концепции помагат да се преодолеят страховете, свързани с изкуствения интелект, като предубеждения, проблеми с поверителността или дори рискове като автономно военно приложение.

Решения

- Разработване на ясна документация: Предоставяйте изчерпателна информация за моделите на изкуствения интелект, процеса на тяхното разработване, въвежданите данни и процесите на вземане на решения. Това спомага за по-доброто им разбиране и създава основа за доверие.

- Внедряване на обясними модели на изкуствен интелект: Използвайте модели, които осигуряват по-голяма прозрачност, като дървета на решенията или системи, базирани на правила, така че потребителите да виждат точно как входните данни се превръщат в изходни данни.

- Използвайте инструменти за интерпретируемост: Приложете инструменти като LIME (Local Interpretable Model-agnostic Explanations) или SHAP (SHapley Additive exPlanations), за да разделите приноса на различните функции в процеса на вземане на решения на модела.

3. Мащабирането на изкуствения интелект е по-трудно, отколкото изглежда

Мащабирането на AI технологията е от ключово значение за организациите, които искат да се възползват от нейния потенциал в различни бизнес единици. Постигането на тази мащабируемост на AI инфраструктурата обаче е свързано с редица сложности.

Въпреки потенциала за висока възвръщаемост на инвестициите, много компании срещат затруднения при преминаването от пилотни проекти към пълномащабно внедряване.

Фиаското на Zillow с препродажбата на жилища е сурово напомняне за предизвикателствата, свързани с мащабируемостта на изкуствения интелект. Техният изкуствен интелект, чиято цел беше да прогнозира цените на жилищата с цел печалба, имаше процент на грешки до 6,9%, което доведе до сериозни финансови загуби и отписване на запаси на стойност 304 милиона долара.

Предизвикателството, свързано с мащабируемостта, е най-очевидно извън технологичните гиганти като Google и Amazon, които разполагат с ресурсите да използват AI ефективно. За повечето други, особено за нетехнологичните компании, които тепърва започват да проучват AI, пречките включват липса на инфраструктура, изчислителна мощ, експертиза и стратегическо внедряване.

Решения

- Подобрена инфраструктура: Разработете стабилна цифрова инфраструктура, която може да се справи с внедряването на изкуствен интелект в голям мащаб. Например, облачните услуги и локализираните центрове за данни намаляват латентността и подобряват производителността.

- Междисциплинарни екипи: Създайте среда за сътрудничество, в която технологичните и бизнес екипи работят заедно, за да интегрират безпроблемно AI решенията в съществуващите бизнес модели.

- Автоматизирани инструменти за разработка на изкуствен интелект: Използвайте платформи като evoML на TurinTech, за да автоматизирате разработката на кодове за машинно обучение, което позволява по-бързо създаване и внедряване на модели.

- Непрекъснато учене и адаптиране: Въведете механизми за непрекъснато учене и актуализиране на моделите на изкуствения интелект, за да се адаптират към реалните данни и променящите се пазарни условия, като по този начин се гарантира дългосрочната им уместност и ефективност.

- Инвестирайте в развитието на таланти: Изградете вътрешна експертиза в областта на изкуствения интелект чрез обучения и практики за наемане на персонал, които се фокусират върху нововъзникващите технологии за изкуствен интелект, като намалите прекомерната зависимост от външни таланти в тази област.

Прочетете също: Важни статистически данни за изкуствения интелект , които трябва да знаете днес

4. Deepfake и генеративна измама с изкуствен интелект

Генеративните технологии за изкуствен интелект и дълбоките фалшификати променят пейзажа на измамите, особено в сектора на финансовите услуги. Те правят създаването на убедителни фалшификати по-лесно и по-евтино.

Например, през януари 2024 г. фалшив профил, представящ се за финансов директор, нареди на служител да преведе 25 милиона долара, което показва сериозните последствия от такива технологии.

Тази нарастваща тенденция подчертава предизвикателствата, пред които са изправени банките, докато се борят да адаптират своите системи за управление на данни и откриване на измами, за да се противопоставят на все по-сложните измами, които не само мамят хората, но и машинно-базираните системи за сигурност.

Решения

- Усъвършенствани технологии за откриване: Банките трябва да инвестират в по-нови технологии, които могат да откриват по-ефективно дълбоки фалшификации и аномалии, генерирани от изкуствен интелект.

- Човешки надзор: Интегрирането на квалифициран човешки анализ с отговорите на изкуствения интелект подобрява степента на откриване и помага за проверка и разбиране на идентифицирането на измами, задвижвано от изкуствен интелект.

- Съвместни усилия за предотвратяване на измамите: Създаването на партньорства в рамките на и между различните отрасли може да спомогне за разработването на по-надеждни механизми за идентифициране и предотвратяване на измамите.

5. Предизвикателства, свързани с оперативната съвместимост и взаимодействието между човека и изкуствения интелект

Когато различни организации или страни използват AI заедно, те трябва да гарантират, че AI се държи етично в съответствие с правилата на всички. Това се нарича етична оперативна съвместимост и е особено важно в области като отбрана и сигурност.

В момента правителствата и организациите имат свои собствени правила и етика. Например, вижте Насоките на Microsoft за взаимодействие между човека и изкуствения интелект:

Въпреки това, в световен мащаб липсва стандартизация в тази етика и правила.

В момента системите за изкуствен интелект имат свои собствени етични правила, които може да са подходящи в един случай, но да създават проблеми в друг. Когато тези системи взаимодействат с хора и не се държат както се очаква, това може да доведе до неразбирателства или недоверие.

Решения

- Определете универсални етични стандарти: Договорете се за основни етични правила, които всички AI системи трябва да спазват, независимо от произхода им. Фокусирайте се върху справедливостта, отчетността и прозрачността.

- Използвайте строга система за сертифициране: Преди да се използва която и да е AI система, тя трябва да премине строг тест, за да се потвърди, че отговаря на тези етични стандарти. Това може да включва проверки от създателите, а също и от независими групи.

- Уверете се, че всички са в течение: Винаги бъдете ясни относно това как изкуственият интелект взема решения и използва данни. Тази прозрачност помага за изграждането на доверие и улеснява интегрирането на различни системи за изкуствен интелект.

- Дръжте нещата под око: Редовно проверявайте AI системите, за да се уверите, че те продължават да отговарят на етичните стандарти. Актуализирайте ги при необходимост, за да сте в крак с новите правила или технологии

6. Етиката на изкуствения интелект е нещо повече от добри намерения

Изкуственият интелект (AI) навлиза в почти всяка част от нашия живот – от самоуправляващите се автомобили до виртуалните асистенти, и това е страхотно! Но има и уловка: начинът, по който използваме AI, понякога може да предизвика сериозни етични проблеми. Съществуват трудни етични въпроси, свързани с поверителността, пристрастността, загубата на работни места и др.

Тъй като изкуственият интелект е в състояние да изпълнява задачи, които преди това са били извършвани от хора, се води цяла дискусия дали той изобщо трябва да изпълнява някои от тях.

Например, трябва ли изкуственият интелект да пише сценарии за филми? Звучи страхотно, но това предизвика огромно вълнение в света на развлеченията, като стачки в САЩ и Европа. И не става въпрос само за това какви работни места може да заеме изкуственият интелект, а и за това как той използва нашите данни, взема решения и понякога дори греши. Това кара всички, от технологичните разработчици до юридическите експерти, да се опитват да разберат как да се справят с изкуствения интелект по отговорен начин.

Решения

- Изяснете правилата: Разработете ясни насоки за това как трябва да се използва изкуственият интелект. Това означава да се поставят граници, за да се предотврати злоупотребата, и да се разберат правните последици от действията на изкуствения интелект.

- Зачитайте правото на личен живот: За обучението на изкуствения интелект се използват огромни количества данни, включително лична информация. Трябва да бъдем изключително внимателни по отношение на начина, по който тези данни се събират, използват и защитават. Става въпрос да се гарантира, че изкуственият интелект зачита правото ни на личен живот.

- Борба с предубежденията: AI е толкова добър, колкото данните, от които се учи, а понякога тези данни са предубедени. Трябва да премахнем тези предубеждения от AI системите, за да се уверим, че са справедливи и не дискриминират.

- Защитавайте интелектуалната собственост: AI може да създава произведения въз основа на това, което е научила от творбите на други хора. Това може да наруши авторските права и да лиши творците от заслуженото, ако не внимаваме.

- Етика срещу скорост: В лудото надпреварване за пускане на пазара на най-новите технологии за изкуствен интелект, етиката може да бъде пренебрегната. Трябва да намерим баланса между необходимостта от скорост и правилното изпълнение на нещата.

7. Смесването на набори от данни за изкуствен интелект може да доведе до катастрофални последствия

При разработването на модели за машинно обучение на изкуствен интелект може да бъде трудно да се направи правилна разлика между наборите от данни за обучение, валидиране и тестване. Наборът от данни за обучение на модела на изкуствен интелект обучава модела, наборът от данни за валидиране го настройва, а наборът от данни за тестване оценява неговата ефективност.

Тази грешка може сериозно да попречи на способността на модела да функционира ефективно в реални AI приложения, където адаптивността и точността на стандартизираните данни са от ключово значение.

Решения

- Структурирано разделяне на данни: Приемете систематичен подход за разделяне на данните на набори за обучение, валидиране и тестване

- Техники за кръстосана валидация: Използвайте методи за кръстосана валидация, особено в сценарии с ограничени данни. Техники като K-кратна кръстосана валидация помагат да се максимизира използването на обучението и осигуряват по-надеждна оценка на производителността на модела върху невиждани данни.

- Рандомизация на данните: Уверете се, че разделянето на данните е рандомизирано, за да се предотврати въвеждането на изкуствен интелект от реда на данните. Това помага при създаването на обучителни и валидиращи набори, които са представителни за цялостния набор от данни.

8. Рискове и опасения, свързани с автоматизираното вземане на решения

Когато изкуственият интелект взема решения, нещата могат да станат сложни, особено в критични области като здравеопазването и банковото дело. Един голям проблем е, че не винаги можем да видим как системите за изкуствен интелект стигат до своите решения.

Това може да доведе до несправедливи решения, които никой не може да обясни. Освен това тези системи са мишени за хакери, които, ако успеят да проникнат в тях, могат да откраднат много важни данни.

Решения

- Разработване на надеждни протоколи за сигурност: Уверете се, че системите за изкуствен интелект са добре защитени срещу хакери. Актуализирайте непрекъснато сигурността, за да запушвате всички нови пропуски, които се появяват.

- Повишете прозрачността: Използвайте технологии, които помагат на изкуствения интелект да обясни своите решения с прости думи. Ако всички разбират как се вземат решенията, те ще имат по-голямо доверие в изкуствения интелект.

- Защитете личната информация: Осигурете сигурността на всички лични данни, с които работи изкуственият интелект. Спазвайте закони като GDPR, за да сте сигурни, че личната информация на никого не е застрашена.

- Насърчавайте мултидисциплинарното сътрудничество: Съберете експерти от всички области – технологии, право, етика – да работят заедно. Те могат да помогнат да се гарантира, че решенията на изкуствения интелект са справедливи и безопасни.

Прочетете също: Най-популярните AI инструменти за студенти

9. Липса на ясни правила и регламенти за изкуствения интелект

В момента не съществува единен глобален регулатор за изкуствения интелект; регулациите варират в зависимост от страната и дори от сектора. Например, в САЩ няма централен орган, специално отговарящ за изкуствения интелект.

Този децентрализиран подход може да доведе до несъответствия и объркване; в зависимост от мястото и начина на внедряване на изкуствения интелект могат да се прилагат различни стандарти. Това затруднява разработчиците и потребителите на изкуствен интелект да гарантират пълно съответствие с всички юрисдикции.

Решения

- Създайте специален регулаторен орган за изкуствения интелект: Страните биха могли да се възползват от създаването на специална агенция, фокусирана върху изкуствения интелект. Този орган би могъл да наблюдава всички въпроси, свързани с изкуствения интелект, да следва бързото развитие на изкуствения интелект и да гарантира спазването на стандартите за безопасност и етика.

- Международно сътрудничество: AI не се спира пред границите. Страните трябва да работят заедно, за да създадат международни стандарти и споразумения за използването на AI, подобно на това как глобалните договори работят за опазването на околната среда.

- Ясно и адаптивно законодателство: Законите трябва да бъдат ясни (за да знаят компаниите как да ги спазват), но и достатъчно гъвкави, за да се адаптират към новите постижения в областта на изкуствения интелект. Редовните актуализации и прегледи на законите за изкуствения интелект биха могли да помогнат за поддържането на тяхната актуалност.

- Участие на обществеността и заинтересованите страни: Регулациите трябва да се разработват с участието на широк кръг от заинтересовани страни, включително технологични компании, етици и широката общественост. Това може да помогне да се гарантира, че се вземат предвид различни гледни точки и че обществеността има по-голямо доверие в системите за изкуствен интелект.

Прочетете също: AI инструменти за адвокати

10. Дезинформация от изкуствения интелект

Представете си, че разполагате с технология, която може да мисли като човек. Това е обещанието на изкуствения общ интелект (AGI), но то е свързано с големи рискове. Дезинформацията е един от основните проблеми в този случай.

С AGI лесно може да се създават фалшиви новини или убедителна невярна информация, което затруднява всички да разберат кое е истина и кое не.

Освен това, ако AGI взема решения въз основа на тази невярна информация, това може да доведе до катастрофални резултати, засягащи всичко – от политиката до личния живот.

Решения

- Въведете строги проверки: Винаги проверявайте фактите два пъти, преди да позволите на AGI да разпространява информация. Използвайте надеждни източници и потвърждавайте подробностите, преди да публикувате нещо.

- Научете AGI на етика: По същия начин, по който учим децата да различават доброто от лошото, трябва да научим AGI на етично поведение. Това включва разбиране на въздействието от разпространяването на невярна информация и вземането на справедливи и честни решения.

- Дръжте хората в течение: Независимо колко интелигентен става AGI, дръжте хората ангажирани в процеса на вземане на решения. Това помага да се откриват грешки и гарантира, че действията на AGI отразяват нашите ценности и етика.

- Създайте ясни правила: Определете строги насоки за това, което AGI може и не може да прави, особено когато става въпрос за създаване и разпространение на информация. Уверете се, че тези правила се спазват стриктно.

Прочетете също: Пълен речник на термини, свързани с изкуствения интелект

Инструменти за справяне с предизвикателствата на изкуствения интелект

Когато сте затънали до колене в изкуствения интелект, изборът на подходящите инструменти не е просто нещо, което е хубаво да имате; това е задължително, за да се уверите, че пътуването ви в света на изкуствения интелект няма да се превърне в катастрофа. Става въпрос за опростяване на сложното, защита на данните ви и получаване на подкрепата, от която се нуждаете, за да решите предизвикателствата на изкуствения интелект, без да разорявате банката.

Ключът е да изберете софтуер за изкуствен интелект, който подобрява производителността, като същевременно защитава вашата поверителност и сигурността на вашите данни.

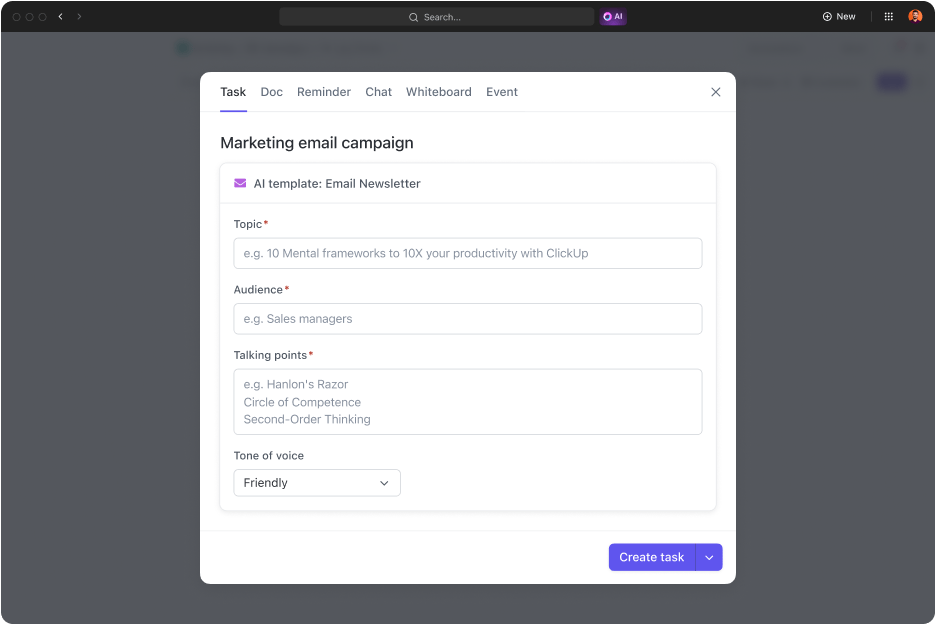

Влезте в ClickUp Brain, швейцарския армейски нож за изкуствен интелект на работното ви място.

ClickUp Brain: Ефективност, сигурност и иновации – всичко в едно

ClickUp Brain е проектиран да се справя с всичко, свързано с изкуствения интелект – от управлението на вашите проекти и документи до подобряването на комуникацията в екипа. С възможностите на изкуствения интелект на ClickUp Brain можете да се справите с предизвикателствата, свързани с данните, да подобрите управлението на проектите и да увеличите производителността, като същевременно поддържате нещата прости и сигурни. ClickUp Brain е цялостно решение, което:

- Интегрира се безпроблемно в ежедневната ви работа

- Гарантира, че вашите данни остават ваши

- Спестете пари и ресурси

ClickUp Brain се интегрира интелигентно във вашия работен процес, за да ви спести време и усилия, като същевременно защитава вашите данни. Той е (както и останалата част от платформата ClickUp) съвместим с GDPR и не използва вашите данни за обучение.

Ето как работи:

- AI Knowledge Manager: Искали ли сте някога да получавате незабавни и точни отговори от вашите работни документи или чатове? ClickUp Brain го прави възможно. Няма повече часове наред претърсване на файлове. Просто попитайте и ще получите отговор – дали става дума за подробности от проектен документ или информация от минали актуализации на екипа.

- AI Project Manager: Представете си, че имате AI помощник, който поддържа вашите проекти в правилната посока. От автоматизиране на актуализациите на задачите до обобщаване на напредъка по проекта, ClickUp Brain се занимава с досадните части, за да можете да се съсредоточите върху цялостната картина.

- AI Writer for Work: Този инструмент променя правилата на играта за всеки, който се страхува от писането. Независимо дали пишете кратко имейл или изготвяте подробен доклад, ClickUp Brain ви помага да усъвършенствате прозата си, да проверите правописа си и да коригирате тона си до съвършенство.

Справяне с предизвикателствата на изкуствения интелект с подходящите инструменти

Въпреки предизвикателствата, свързани с изкуствения интелект, които обсъдихме, можем да се съгласим, че изкуственият интелект е преминал дълъг път. Той еволюира от основна автоматизация до сложни системи, които могат да се учат, адаптират и предсказват резултати. Много от нас вече са интегрирали изкуствения интелект в различни аспекти от живота си, от виртуални асистенти до усъвършенствани инструменти за събиране и анализ на данни.

С напредъка на изкуствения интелект можем да очакваме още повече иновации, хакове и инструменти за изкуствен интелект, които да повишат производителността, да подобрят вземането на решения и да революционизират индустриите. Този напредък отваря нови възможности и ни води към бъдеще, в което изкуственият интелект играе решаваща роля както в личния, така и в професионалния живот.

С AI инструменти като ClickUp Brain можете да извлечете максимума от AI технологиите, като същевременно се предпазите от предизвикателствата на AI по отношение на поверителността и сигурността на данните. ClickUp е вашият предпочитан AI инструмент за управление на задачи за всичко – от софтуерни проекти до маркетинг. Изберете ClickUp, за да превърнете безопасно вашата организация в субект, задвижван от данни и AI, като същевременно увеличите производителността на екипа си.

Готови ли сте да трансформирате работните си процеси с изкуствен интелект? Регистрирайте се в ClickUp сега!