อคติของ AI อาจดูเหมือนเป็นปัญหาทางเทคโนโลยี แต่ผลกระทบของมันปรากฏให้เห็นในโลกแห่งความเป็นจริงและมักสร้างความเสียหายอย่างร้ายแรง

เมื่อระบบ AI มีแนวโน้มไปในทางที่ผิด แม้เพียงเล็กน้อย ก็สามารถนำไปสู่ผลลัพธ์ที่ไม่เป็นธรรมได้

เมื่อเวลาผ่านไป ปัญหาเล็กๆ เหล่านั้นอาจกลายเป็นลูกค้าที่ไม่พอใจ ปัญหาด้านชื่อเสียง หรือแม้กระทั่งคำถามเกี่ยวกับการปฏิบัติตามข้อกำหนดที่คุณไม่คาดคิดมาก่อน

ส่วนใหญ่ทีมไม่ได้ตั้งใจที่จะสร้าง AI ที่มีอคติ. มันเกิดขึ้นเพราะข้อมูลไม่เรียบร้อย, โลกจริงไม่เท่าเทียม, และเครื่องมือที่เราใช้ไม่ได้คิดเหมือนที่เราคาดหวังเสมอ. ข่าวดีคือคุณไม่จำเป็นต้องเป็นนักวิทยาศาสตร์ข้อมูลเพื่อเข้าใจสิ่งที่เกิดขึ้น.

ในบล็อกนี้ เราจะพาคุณไปทำความเข้าใจว่า อคติของ AI คืออะไร เกิดขึ้นได้อย่างไร และมันสามารถปรากฏในเครื่องมือทางธุรกิจที่ใช้ในชีวิตประจำวันได้อย่างไร

อคติของ AI คืออะไร?

อคติของ AI คือเมื่อระบบปัญญาประดิษฐ์สร้างผลลัพธ์ที่เป็นระบบและไม่เป็นธรรม ซึ่งเอื้อประโยชน์หรือทำให้กลุ่มคนบางกลุ่มเสียเปรียบอย่างสม่ำเสมอ สิ่งเหล่านี้ไม่ใช่เพียงข้อผิดพลาดแบบสุ่ม แต่เป็นรูปแบบที่สามารถคาดการณ์ได้ซึ่งฝังอยู่ในกระบวนการตัดสินใจของ AI สาเหตุคือ AI เรียนรู้จากข้อมูลที่สะท้อนอคติที่มีอยู่เดิมของมนุษย์อคติที่ไม่รู้ตัว และความไม่เท่าเทียมในสังคม

ลองคิดแบบนี้: หากคุณฝึกอัลกอริทึมการจ้างงานด้วยข้อมูลของบริษัทเป็นเวลาสิบปี ซึ่งในนั้น 90% ของผู้จัดการเป็นผู้ชาย AI อาจเรียนรู้อย่างไม่ถูกต้องว่าการเป็นผู้ชายเป็นคุณสมบัติสำคัญสำหรับตำแหน่งการจัดการ AI ไม่ได้มีเจตนาร้าย มันเพียงแค่ระบุและทำซ้ำรูปแบบที่มันถูกแสดงให้ดูเท่านั้น

นี่คือสิ่งที่ทำให้อคติของ AI ซับซ้อน:

- มันเป็นระบบ ไม่ใช่สุ่ม: ความไม่เป็นธรรมนี้ไม่ใช่ข้อผิดพลาดที่เกิดขึ้นเพียงครั้งเดียว แต่เป็นรูปแบบที่เกิดขึ้นซ้ำในผลลัพธ์ของ AI

- มันมักมองไม่เห็น: ผลลัพธ์ที่มีอคติสามารถซ่อนอยู่เบื้องหลังคณิตศาสตร์ที่ซับซ้อนของอัลกอริทึมที่ดูเหมือนเป็นกลาง ทำให้ยากที่จะสังเกตเห็น

- มันฝังรากอยู่ในข้อมูลและการออกแบบ: อคติเข้าสู่ระบบผ่านการตัดสินใจที่มนุษย์เราเลือกเมื่อเราสร้างและฝึกฝน AI

⭐ แม่แบบแนะนำ

เทมเพลตรายงานการตอบสนองต่อเหตุการณ์ของ ClickUp ให้โครงสร้าง ที่พร้อมใช้งานสำหรับการบันทึก ติดตาม และแก้ไขเหตุการณ์ตั้งแต่ต้นจนจบ บันทึกทุกรายละเอียดที่เกี่ยวข้องของเหตุการณ์ รักษาสถานะที่จัดหมวดหมู่อย่างชัดเจน และจับคุณลักษณะสำคัญเช่น ความรุนแรง กลุ่มที่ได้รับผลกระทบ และขั้นตอนการแก้ไข รองรับฟิลด์ที่กำหนดเองสำหรับสิ่งต่างๆ เช่น อนุมัติโดย, บันทึกเหตุการณ์, และ เอกสารสนับสนุน, ซึ่งช่วยเปิดเผยความรับผิดชอบและหลักฐานตลอดกระบวนการตรวจสอบ

📖 อ่านเพิ่มเติม: วิธีการประเมินความเสี่ยง: เครื่องมือและเทคนิค

ทำไมการลดอคติของ AI จึงมีความสำคัญ

เมื่อระบบ AI ของคุณไม่เป็นธรรม คุณเสี่ยงที่จะทำร้ายชีวิตของผู้คนจริง ๆ

สิ่งนี้ส่งผลให้องค์กรของคุณเผชิญกับความท้าทายทางธุรกิจที่ร้ายแรง และอาจทำลายความไว้วางใจที่คุณได้สร้างขึ้นอย่างหนักหน่วงกับลูกค้าของคุณได้

ระบบปัญญาประดิษฐ์ที่มีอคติซึ่งปฏิเสธการให้สินเชื่อแก่บุคคล ปฏิเสธใบสมัครงานของพวกเขา หรือให้คำแนะนำที่ไม่ถูกต้อง จะนำมาซึ่งผลกระทบที่ร้ายแรงต่อโลกแห่งความเป็นจริง

มาตรฐานและกรอบการทำงานใหม่ที่กำลังเกิดขึ้นในอุตสาหกรรมขณะนี้ส่งเสริมให้องค์กรต่างๆ ระบุและแก้ไขอคติในระบบ AI ของตนอย่างจริงจัง ความเสี่ยงเหล่านี้จะกระทบต่อองค์กรของคุณจากทุกด้าน:

- ความเสี่ยงด้านกฎระเบียบ: การไม่ปฏิบัติตามมาตรฐาน AI ใหม่ อาจส่งผลให้เกิดความท้าทายทางธุรกิจอย่างมีนัยสำคัญ

- ความเสียหายต่อชื่อเสียง: เมื่อสาธารณชนทราบว่า AI ของคุณมีอคติ จะเป็นเรื่องยากอย่างยิ่งที่จะเรียกคืนความไว้วางใจจากพวกเขา

- ความไม่มีประสิทธิภาพในการดำเนินงาน: แบบจำลองที่มีอคติให้ผลลัพธ์ที่ไม่น่าเชื่อถือหรือการหลอกลวงของ AIซึ่งนำไปสู่การตัดสินใจที่ไม่ดีและต้องแก้ไขด้วยค่าใช้จ่ายสูง

- ความรับผิดชอบทางจริยธรรม: องค์กรของคุณควรตรวจสอบให้แน่ใจว่าเทคโนโลยีที่คุณนำมาใช้ปฏิบัติต่อผู้ใช้ทุกคนอย่างเป็นธรรม

เมื่อคุณจัดการกับการลดอคติได้อย่างถูกต้อง คุณจะสร้างระบบ AI ที่ผู้คนสามารถพึ่งพาได้จริง AI ที่ยุติธรรมเปิดประตูสู่ตลาดใหม่ ๆ ยกระดับคุณภาพการตัดสินใจของคุณ และแสดงให้เห็นแก่ทุกคนว่าคุณมุ่งมั่นที่จะดำเนินธุรกิจอย่างมีจริยธรรม

📮 ClickUp Insight: 22% ของผู้ตอบแบบสอบถามของเรายังคงระมัดระวังเมื่อต้องใช้ AI ในการทำงาน จาก 22% นี้ ครึ่งหนึ่งกังวลเกี่ยวกับความเป็นส่วนตัวของข้อมูล ในขณะที่อีกครึ่งหนึ่งไม่แน่ใจว่าพวกเขาสามารถเชื่อถือสิ่งที่ AI บอกได้

ClickUp จัดการกับทั้งสองข้อกังวลโดยตรงด้วยมาตรการรักษาความปลอดภัยที่แข็งแกร่ง และโดยการสร้างลิงก์ที่ละเอียดไปยังงานและแหล่งที่มาในแต่ละคำตอบ

ซึ่งหมายความว่าแม้แต่ทีมที่ระมัดระวังที่สุดก็สามารถเริ่มเพลิดเพลินกับการเพิ่มประสิทธิภาพการทำงานได้โดยไม่ต้องกังวลว่าข้อมูลของพวกเขาจะได้รับการปกป้องหรือไม่ หรือพวกเขาจะได้รับผลลัพธ์ที่เชื่อถือได้หรือไม่

📖 อ่านเพิ่มเติม: ผู้ช่วยด้านการปฏิบัติตามกฎระเบียบด้วย AI: วิธีที่ AI กำลังเปลี่ยนแปลงการปฏิบัติตามกฎระเบียบและการตรวจสอบ

ประเภทและแหล่งที่มาของอคติในปัญญาประดิษฐ์

อคติสามารถแทรกซึมเข้าสู่ระบบ AI ของคุณได้จากหลายทิศทาง

ตั้งแต่ช่วงเวลาที่คุณเริ่มเก็บข้อมูลไปจนถึงระยะเวลานานหลังจากที่ระบบได้ถูกนำไปใช้งานแล้ว องค์ประกอบนี้ยังคงค่อนข้างคงที่ แต่หากคุณรู้ว่าควรมองหาอะไร คุณสามารถกำหนดเป้าหมายความพยายามของคุณได้อย่างมีประสิทธิภาพ และหยุดเล่นเกมไล่แก้ปัญหาที่ไม่รู้จบซึ่งมักให้ผลลัพธ์ที่ไม่ยุติธรรม

การลำเอียงในการสุ่มตัวอย่าง

การลำเอียงจากการสุ่มตัวอย่างคือสิ่งที่เกิดขึ้นเมื่อข้อมูลที่คุณใช้ในการฝึกอบรมระบบ AI ของคุณไม่สะท้อนถึงโลกจริงที่ระบบ AI จะถูกนำไปใช้

ตัวอย่างเช่น หากคุณสร้างระบบจดจำเสียงที่ฝึกฝนด้วยข้อมูลจากผู้พูดภาษาอังกฤษชาวอเมริกันเป็นหลัก ระบบจะมีความยากลำบากโดยธรรมชาติในการเข้าใจผู้ที่มีสำเนียงสก็อตหรืออินเดีย คล้ายกับวิธีที่LLMs ให้ความสำคัญกับชื่อที่เกี่ยวข้องกับคนผิวขาวถึง 85.1% ของเวลาในการคัดกรองประวัติย่อ การไม่ได้รับการแทนที่อย่างเพียงพอเช่นนี้สร้างจุดบอดขนาดใหญ่ ทำให้โมเดลของคุณไม่พร้อมที่จะให้บริการแก่กลุ่มคนทั้งหมด

อคติของอัลกอริทึม

อคติทางอัลกอริทึมเกิดขึ้นเมื่อการออกแบบหรือกระบวนการทางคณิตศาสตร์ของโมเดลขยายรูปแบบที่ไม่เป็นธรรม แม้ข้อมูลจะดูเป็นกลางก็ตาม

รหัสไปรษณีย์ของบุคคลไม่ควรเป็นตัวกำหนดว่าพวกเขาจะได้รับเงินกู้หรือไม่ แต่หากรหัสไปรษณีย์ในข้อมูลฝึกอบรมของคุณมีความสัมพันธ์อย่างใกล้ชิดกับเชื้อชาติ อัลกอริทึมอาจเรียนรู้ที่จะใช้ตำแหน่งที่ตั้งเป็นตัวแทนของการเลือกปฏิบัติได้

ปัญหานี้ยิ่งแย่ลงเมื่อเกิดวงจรป้อนกลับ—เมื่อการคาดการณ์ที่มีอคติ (เช่น การปฏิเสธสินเชื่อ) ถูกป้อนกลับเข้าสู่ระบบเป็นข้อมูลใหม่ อคติจะยิ่งทวีความรุนแรงขึ้นเรื่อยๆ เมื่อเวลาผ่านไป

อคติในการตัดสินใจของมนุษย์

ทุกการเลือกที่บุคคลทำขณะสร้างระบบ AI สามารถทำให้เกิดอคติได้

ซึ่งรวมถึงการตัดสินใจว่าจะเก็บข้อมูลใด วิธีการติดป้ายกำกับข้อมูล และวิธีการกำหนด "ความสำเร็จ" สำหรับโมเดล ตัวอย่างเช่น ทีมงานอาจเอนเอียงโดยไม่รู้ตัวไปสนับสนุนข้อมูลที่สนับสนุนสิ่งที่พวกเขาเชื่ออยู่แล้ว (อคติในการยืนยัน) หรือให้ความสำคัญกับข้อมูลชิ้นแรกที่พวกเขาเห็นมากเกินไป (อคติยึดติด)

แม้แต่ทีมที่มีเจตนาดีที่สุดก็สามารถเผลอใส่สมมติฐานและมุมมองของตนเองเข้าไปในระบบ AI ได้โดยไม่ตั้งใจ

📖 อ่านเพิ่มเติม: 10 แม่แบบการกำกับดูแลโครงการเพื่อจัดการงาน

ตัวอย่างอคติของ AI ในโลกแห่งความเป็นจริง

บริษัทจริงได้เผชิญกับผลกระทบอย่างรุนแรงเมื่อระบบ AI ของพวกเขาแสดงอคติ ซึ่งทำให้พวกเขาต้องเสียเงินหลายล้านบาทเป็นค่าเสียหายและสูญเสียความไว้วางใจจากลูกค้า. นี่คือตัวอย่างที่ได้รับการบันทึกไว้:

1. เครื่องมือการสรรหาที่มีอคติ

หนึ่งในกรณีที่ถูกอ้างถึงมากที่สุดเกี่ยวข้องกับบริษัทเทคโนโลยีรายใหญ่ที่ยกเลิกระบบคัดเลือกบุคลากรด้วย AI ภายในองค์กร หลังจากพบว่าระบบดังกล่าวมีแนวโน้มเลือกผู้สมัครชายมากกว่าผู้หญิง ระบบนี้ได้รับการฝึกฝนจากประวัติการทำงานตลอดสิบปีที่ผ่านมา ซึ่งผู้สมัครที่ประสบความสำเร็จส่วนใหญ่เป็นผู้ชาย ส่งผลให้ระบบเริ่มให้คะแนนประวัติการทำงานที่ปรากฏคำว่า "ของผู้หญิง" ต่ำลง รวมถึงลดคะแนนผู้สำเร็จการศึกษาจากวิทยาลัยหญิงโดยเฉพาะ

นี่แสดงให้เห็นว่า ความลำเอียงของข้อมูลทางประวัติศาสตร์ เมื่อรูปแบบในอดีตสะท้อนถึงความไม่เท่าเทียมที่มีอยู่ สามารถแทรกซึมเข้าไปในระบบอัตโนมัติได้หากไม่ได้รับการตรวจสอบอย่างรอบคอบแต่เมื่อการสรรหาบุคลากรโดยใช้ระบบอัตโนมัติร่วมกับ AIกลายเป็นเรื่องปกติมากขึ้น ขนาดของปัญหาก็จะยิ่งใหญ่ขึ้นไปอีก

🌼 คุณทราบหรือไม่: ข้อมูลล่าสุดแสดงให้เห็นว่า37% ขององค์กรกำลัง"ผสานรวมอย่างจริงจัง" หรือ "ทดลองใช้" เครื่องมือ Gen AI ในการสรรหาบุคลากร เพิ่มขึ้นจาก 27% เมื่อปีที่แล้ว

2. การจดจำใบหน้าที่ไม่ครอบคลุมครึ่งหนึ่งของประชากร

งานวิจัยที่นำโดยจอย บูออลามวินี และ บันทึกไว้ในรายงาน Gender Shades เปิดเผยว่าระบบจดจำใบหน้าเชิงพาณิชย์มี อัตราความผิดพลาดสูงถึง 34.7% สำหรับผู้หญิงผิวสีเข้ม เมื่อเทียบกับน้อยกว่า 1% สำหรับผู้ชายผิวขาว

นี่เป็นการสะท้อนถึงการมีชุดข้อมูลการฝึกอบรมที่ไม่สมดุลอีกครั้ง ความลำเอียงในเครื่องมือชีวมิติมีผลกระทบที่กว้างไกลมากขึ้น

ตำรวจและหน่วยงานของรัฐได้เผชิญกับปัญหาเกี่ยวกับการจดจำใบหน้าที่มีอคติเช่นกัน การสืบสวนจากThe Washington Post พบว่าระบบบางระบบมีความน่าจะเป็น สูงมากที่จะระบุตัวบุคคลผิดจากกลุ่มที่ถูกกีดกัน ในกรณีที่เกิดขึ้นจริงหลายกรณี นี้ได้นำไปสู่การจับกุมที่ผิดพลาด การจับกุมที่ไม่ถูกต้อง การต่อต้านจากสาธารณชน และข้อกังวลใหญ่เกี่ยวกับผลกระทบของเครื่องมือเหล่านี้ต่อสิทธิของประชาชน

📖 อ่านเพิ่มเติม: AI ในที่ทำงาน: วิธีปรับปรุงประสิทธิภาพและประสิทธิผล

3. อัลกอริทึมด้านสุขภาพที่ให้ความสำคัญกับการดูแลน้อยเกินไป

ระบบปัญญาประดิษฐ์ด้านสุขภาพที่ออกแบบมาเพื่อทำนายว่าผู้ป่วยรายใดต้องการการดูแลเพิ่มเติมก็แสดงให้เห็นถึงอคติเช่นกัน

ในกรณีที่มีการบันทึกไว้อย่างดี หนึ่งกรณี อัลกอริทึมการทำนายทางการแพทย์ที่ใช้กันอย่างแพร่หลายได้เกิดข้อผิดพลาดอย่างรุนแรง มันถูกออกแบบมาเพื่อช่วยตัดสินใจว่าผู้ป่วยรายใดควรได้รับการดูแลเพิ่มเติม แต่กลับกลายเป็นว่า ให้ลำดับความสำคัญต่ำกว่าแก่ผู้ป่วยผิวสีดำ อย่างเป็นระบบ แม้ว่าผู้ป่วยผิวสีดำจะมีอาการป่วยเท่ากันหรือมากกว่าผู้ป่วยผิวขาวก็ตาม

นั่นเกิดขึ้นเพราะแบบจำลองที่ใช้ ใช้ค่าใช้จ่ายด้านการดูแลสุขภาพเป็นตัวแทนของความต้องการทางการแพทย์ เนื่องจากผู้ป่วยผิวดำมีค่าใช้จ่ายด้านการดูแลสุขภาพต่ำกว่าในอดีตเนื่องจากข้อจำกัดในการเข้าถึงการรักษา อัลกอริทึมจึงมองว่าพวกเขา มีความต้องการน้อยกว่า ส่งผลให้ทรัพยากรการดูแลถูกเบี่ยงเบนไปจากผู้ที่ต้องการมากที่สุด นักวิจัยพบว่าเพียงแค่แก้ไขตัวแทนนี้ก็สามารถเพิ่มการเข้าถึงโปรแกรมการดูแลที่เป็นธรรมได้อย่างมีนัยสำคัญ

ความกังวลเกี่ยวกับประเด็นเหล่านี้ได้ทำให้กลุ่มสิทธิพลเมืองกดดันให้มีการกำหนด "มาตรฐานที่ให้ความสำคัญกับความเท่าเทียมเป็นอันดับแรก"ในปัญญาประดิษฐ์ด้านการดูแลสุขภาพ ในเดือนธันวาคม 2025 NAACP ได้เผยแพร่แผนงานโดยละเอียดที่เรียกร้องให้โรงพยาบาล บริษัทเทคโนโลยี และผู้กำหนดนโยบายนำการตรวจสอบอคติ แนวทางการออกแบบที่โปร่งใส กรอบการทำงานที่ครอบคลุมและเครื่องมือการกำกับดูแลปัญญาประดิษฐ์มาใช้เพื่อป้องกันความไม่เท่าเทียมกันด้านสุขภาพทางเชื้อชาติที่ลึกซึ้งยิ่งขึ้น

4. อัลกอริทึมเครดิตที่มีผลลัพธ์ไม่เท่าเทียมกัน

ปัญญาประดิษฐ์และการตัดสินใจอัตโนมัติไม่ได้มีบทบาทเพียงแค่กำหนดสิ่งที่คุณเห็นบนโซเชียลมีเดียเท่านั้น แต่ยังส่งผลต่อว่าใครจะได้เข้าถึงเงินและในเงื่อนไขใดอีกด้วย

หนึ่งในตัวอย่างที่พูดถึงมากที่สุดในโลกแห่งความเป็นจริงมาจาก Apple Card บัตรเครดิตดิจิทัลที่ออกโดย Goldman Sachs

ในปี 2019 ลูกค้าบนสื่อสังคมออนไลน์ได้แชร์ว่า อัลกอริทึมของวงเงินเครดิตของบัตรให้วงเงินสูงกว่ามากแก่ผู้ชายบางคนเมื่อเทียบกับภรรยาหรือคู่รักหญิงของพวกเขา แม้ในกรณีที่คู่รักมีโปรไฟล์ทางการเงินที่คล้ายคลึงกันก็ตาม วิศวกรซอฟต์แวร์คนหนึ่งกล่าวว่าเขาได้รับ วงเงินเครดิตสูงกว่าภรรยาถึง 20 เท่า และแม้แต่สตีฟ วอซเนียก ผู้ร่วมก่อตั้งแอปเปิลก็ยืนยันประสบการณ์ที่คล้ายกันกับคู่สมรสของเขา

รูปแบบเหล่านี้ได้จุดประกายให้เกิดกระแสวิพากษ์วิจารณ์จากสาธารณชน และนำไปสู่การสอบสวนโดย กรมบริการทางการเงินแห่งรัฐนิวยอร์ก ว่าอัลกอริทึมดังกล่าวมีการเลือกปฏิบัติต่อผู้หญิงหรือไม่ ซึ่งสะท้อนให้เห็นถึงปัญหาที่เครื่องมือทางการเงินอัตโนมัติอาจก่อให้เกิดผลลัพธ์ที่ไม่เท่าเทียมกัน

📖 อ่านเพิ่มเติม: วิธีใช้ AI สำหรับการกำกับดูแลข้อมูล (กรณีศึกษาและเครื่องมือ)

5. คำบรรยายอัตโนมัติและการจดจำเสียงที่ตัดเสียงออก

ระบบรู้จำเสียงพูดและระบบสร้างคำบรรยายอัตโนมัติมัก ไม่สามารถได้ยินทุกคนอย่างเท่าเทียมกันงานวิจัยหลายชิ้นแสดงให้เห็นว่าเครื่องมือเหล่านี้ทำงานได้ดีกว่าสำหรับผู้พูดบางคนมากกว่าคนอื่น ขึ้นอยู่กับปัจจัยต่างๆ เช่น สำเนียง ภาษาถิ่น เชื้อชาติ และภาษาอังกฤษเป็นภาษาแรกของผู้พูดหรือไม่

นั่นเกิดขึ้นเพราะระบบเชิงพาณิชย์มักถูกฝึกฝนบนชุดข้อมูลที่มีลักษณะเสียงพูดบางแบบเป็นส่วนใหญ่—มักเป็นภาษาอังกฤษมาตรฐานของตะวันตก—ทำให้เสียงพูดอื่น ๆ ไม่ได้รับการแทนที่อย่างเพียงพอ

ตัวอย่างเช่น นักวิจัยที่มหาวิทยาลัยสแตนฟอร์ดได้ทดสอบระบบแปลงเสียงเป็นข้อความชั้นนำ 5 ระบบ (จาก Amazon, Google, Microsoft, IBM และ Apple) และพบว่าพวกมันทำผิดพลาด nเกือบสองเท่าเมื่อถอดเสียงจากผู้พูดผิวดำเมื่อเทียบกับผู้พูดผิวขาว ปัญหานี้เกิดขึ้นแม้เมื่อผู้เข้าร่วมพูดคำเดียวกันภายใต้เงื่อนไขเดียวกัน

เมื่อคำบรรยายไม่ถูกต้องสำหรับผู้พูดบางคน อาจนำไปสู่ประสบการณ์ที่ไม่ดีสำหรับผู้ใช้ และไม่สามารถเข้าถึงได้สำหรับผู้ที่มีความจำเป็นต้องพึ่งพาคำบรรยาย ยิ่งไปกว่านั้น อาจทำให้เกิดผลลัพธ์ที่มีอคติในระบบที่ใช้การรู้จำเสียงในกระบวนการจ้างงาน การศึกษา หรือการรักษาพยาบาล

ตัวอย่างแต่ละข้อเหล่านี้แสดงให้เห็นถึงวิธีที่อคติสามารถฝังตัวอยู่ในระบบอัตโนมัติได้อย่างชัดเจน ผ่านข้อมูลการฝึกอบรมที่ลำเอียง ตัวแทนที่ไม่เหมาะสม หรือการทดสอบที่ไม่สะท้อนความเป็นจริง ในทุกกรณี ผลลัพธ์ไม่ได้เป็นเพียงปัญหาทางเทคนิคเท่านั้น—แต่ยัง กำหนดโอกาส สร้างความไม่ไว้วางใจ และก่อให้เกิดความเสี่ยงทางธุรกิจและจริยธรรมอย่างแท้จริง

📖 อ่านเพิ่มเติม: ความเสี่ยงกับปัญหา – ต่างกันอย่างไร?

สรุป: ความลำเอียงของ AI ปรากฏอย่างไร และใครที่ได้รับผลกระทบ

| ที่ซึ่งมีอคติปรากฏ | ใครที่ได้รับผลกระทบ | ผลกระทบที่เกิดขึ้นจริง |

|---|---|---|

| อัลกอริทึมการสรรหาบุคลากร (เครื่องมือการจ้างงานด้วย AI ที่ถูกยกเลิก) | ผู้หญิง | ประวัติย่อถูกลดระดับตามคำสำคัญที่เกี่ยวข้องกับเพศ ซึ่งส่งผลให้โอกาสในการสัมภาษณ์งานและโอกาสการทำงานลดลง |

| ระบบจดจำใบหน้า (Gender Shades + กรณีการจับกุมโดยมิชอบ) | ผู้หญิงผิวสีเข้ม; กลุ่มเชื้อชาติที่ถูกกีดกัน | อัตราการระบุตัวตนผิดพลาดที่สูงกว่ามากนำไปสู่การจับกุมโดยมิชอบ ความเสียหายต่อชื่อเสียง และข้อกังวลด้านสิทธิพลเมือง |

| อัลกอริทึมการทำนายความเสี่ยงด้านสุขภาพ (การศึกษาจากมหาวิทยาลัยชิคาโก) | ผู้ป่วยผิวดำ | ผู้ป่วยถูกจัดลำดับความสำคัญต่ำลงสำหรับการดูแลเพิ่มเติม เนื่องจากค่าใช้จ่ายด้านการดูแลสุขภาพถูกใช้เป็นตัวแทนที่ไม่เหมาะสมสำหรับความต้องการทางการแพทย์ ซึ่งทำให้ความไม่เท่าเทียมทางสุขภาพแย่ลง |

| อัลกอริทึมการกำหนดวงเงินเครดิต (การตรวจสอบ Apple Card) | ผู้หญิง | ผู้ชายได้รับวงเงินเครดิตสูงกว่าผู้หญิงที่มีคุณสมบัติเท่าเทียมกันอย่างมาก ซึ่งส่งผลกระทบต่อการเข้าถึงทางการเงินและอำนาจในการกู้ยืม |

| การรู้จำเสียงพูดและคำบรรยายอัตโนมัติ (การศึกษา Stanford ASR) | ผู้พูดที่มีสำเนียงไม่มาตรฐาน; ผู้พูดผิวสี | อัตราความผิดพลาดที่สูงขึ้นเกือบสองเท่าได้สร้างอุปสรรคในการเข้าถึง การสื่อสารที่ผิดพลาด และผลลัพธ์ที่มีอคติในเครื่องมือที่ใช้ในการจ้างงาน การศึกษา และการเข้าถึงดิจิทัลในชีวิตประจำวัน |

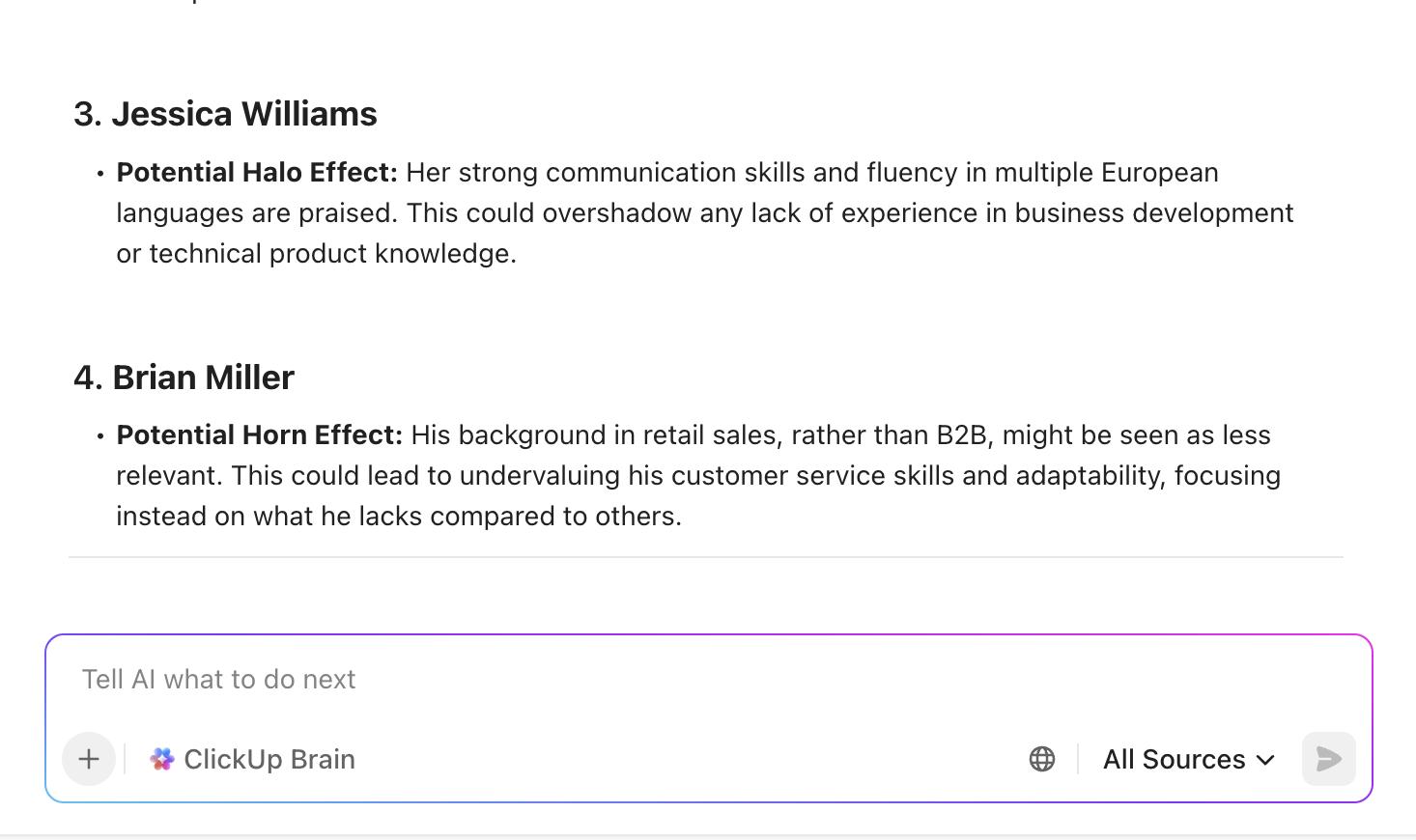

📖 อ่านเพิ่มเติม: วิธีหลีกเลี่ยงผลกระทบฮาโลและฮอร์นเพื่อลดอคติ

กลยุทธ์การลดอคติที่ได้ผล

ไม่มีวิธีวิเศษเพียงวิธีเดียวที่จะขจัดอคติของ AI ได้

การลดอคติอย่างมีประสิทธิภาพต้องอาศัยการป้องกันหลายชั้นที่คุณนำไปใช้ตลอดวงจรชีวิตของ AI ทั้งหมด โดยการผสมผสานกลยุทธ์ที่พิสูจน์แล้วเหล่านี้ คุณสามารถลดความเสี่ยงของผลลัพธ์ที่ไม่เป็นธรรมได้อย่างมาก

รวบรวมข้อมูลการฝึกอบรมที่หลากหลาย

ข้อมูลตัวแทนเป็นรากฐานที่มั่นคงที่สุดของ AI ที่ยุติธรรม

โมเดลของคุณไม่สามารถเรียนรู้ที่จะให้บริการกลุ่มคนที่มันไม่เคยเห็นในระหว่างการฝึกอบรมได้ ให้เริ่มต้นด้วยการตรวจสอบชุดข้อมูลที่คุณมีอยู่เพื่อค้นหาช่องว่างทางประชากรศาสตร์ จากนั้นให้พยายามอย่างตั้งใจที่จะรวบรวมข้อมูลใหม่จากประชากรกลุ่มที่ไม่ได้ถูกแทนที่อย่างเพียงพอ

เมื่อข้อมูลในโลกจริงหายาก คุณสามารถใช้เทคนิคเช่นการเพิ่มปริมาณข้อมูล (การสร้างสำเนาข้อมูลที่มีอยู่โดยปรับเปลี่ยน) หรือการสร้างข้อมูลสังเคราะห์เพื่อช่วยเติมเต็มช่องว่าง

🚧 ชุดเครื่องมือ:ใช้แม่แบบรายการตรวจสอบการตรวจสอบภายในของ ClickUpเพื่อวางแผนกระบวนการตรวจสอบของคุณ

แบบจำลองทดสอบสำหรับอคติ

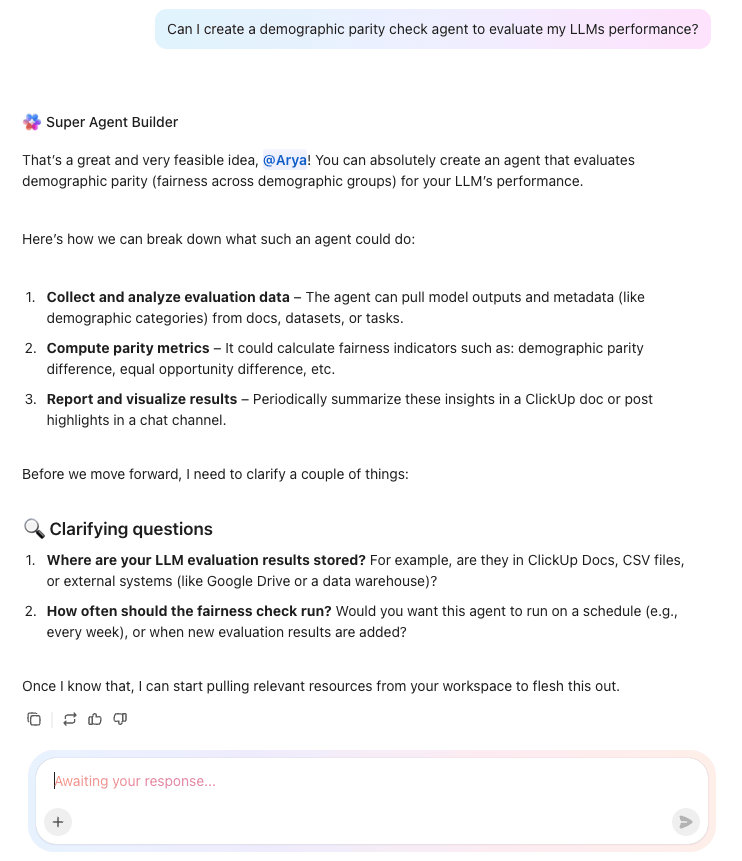

คุณต้องทดสอบอคติอย่างเป็นระบบเพื่อจับมันก่อนที่จะก่อให้เกิดความเสียหายจริง ใช้ตัวชี้วัดความเป็นธรรมเพื่อวัดประสิทธิภาพของโมเดลของคุณในกลุ่มที่แตกต่างกัน

ตัวอย่างเช่น การตรวจสอบความเท่าเทียมทางประชากรศาสตร์จะตรวจสอบว่าโมเดลให้ผลลัพธ์เชิงบวก (เช่น การอนุมัติสินเชื่อ) ในอัตราที่เท่ากันระหว่างกลุ่มต่างๆ หรือไม่ ในขณะที่การตรวจสอบความเท่าเทียมของอัตราต่อรองจะตรวจสอบว่าอัตราความผิดพลาดเท่ากันหรือไม่

แบ่งผลการดำเนินงานของโมเดลของคุณตามทุกกลุ่มประชากรที่คุณสามารถทำได้—เชื้อชาติ, เพศ, อายุ, ภูมิศาสตร์—เพื่อค้นหาจุดที่ความแม่นยำลดลง หรือความไม่เป็นธรรมแทรกซึมเข้ามา

ให้มนุษย์มีส่วนร่วมในกระบวนการ

ระบบอัตโนมัติอาจมองข้ามความไม่เป็นธรรมที่ละเอียดอ่อนและขึ้นอยู่กับบริบทซึ่งมนุษย์สามารถสังเกตเห็นได้ทันที แนวทางที่มีมนุษย์เข้ามาเกี่ยวข้องจึงมีความสำคัญอย่างยิ่งในการตัดสินใจที่มีความเสี่ยงสูง ซึ่งแม้ AI จะสามารถให้คำแนะนำได้ แต่สุดท้ายแล้วมนุษย์ยังคงเป็นผู้ตัดสินใจขั้นสุดท้าย

สิ่งนี้มีความสำคัญอย่างยิ่งในด้านต่างๆ เช่น การจ้างงาน การให้กู้ยืม และการวินิจฉัยทางการแพทย์ เพื่อให้สิ่งนี้ทำงานได้อย่างมีประสิทธิภาพ ผู้ตรวจสอบที่เป็นมนุษย์ของคุณต้องได้รับการฝึกอบรมให้สามารถรับรู้อคติและมีอำนาจในการยกเลิกคำแนะนำของ AI ได้

ประยุกต์ใช้เทคนิคความเป็นธรรมเชิงอัลกอริทึม

คุณยังสามารถใช้วิธีการทางเทคนิคเพื่อแทรกแซงโดยตรงและลดอคติได้ เทคนิคเหล่านี้แบ่งออกเป็นสามประเภทหลัก:

- การเตรียมข้อมูลเบื้องต้น: ขั้นตอนนี้เกี่ยวข้องกับการปรับแต่งข้อมูลฝึกฝน ก่อน ที่โมเดลจะได้เห็นข้อมูลนั้น โดยมักจะทำโดยการปรับน้ำหนักหรือสุ่มตัวอย่างข้อมูลใหม่ เพื่อสร้างตัวแทนที่มีความสมดุลมากขึ้นของกลุ่มต่าง ๆ

- การประมวลผลภายใน: ที่นี่ คุณจะเพิ่มข้อจำกัดด้านความเป็นธรรมเข้าไปในกระบวนการฝึกอบรมของโมเดลโดยตรง สอนให้โมเดลปรับให้เหมาะสมทั้งในด้านความแม่นยำและความเป็นธรรมในเวลาเดียวกัน

- การประมวลผลหลังการฝึก: หมายถึงการปรับการคาดการณ์สุดท้ายของโมเดล หลังจาก ที่ได้ทำการคาดการณ์แล้ว เพื่อให้มั่นใจว่าผลลัพธ์มีความเป็นธรรมและเท่าเทียมกันในทุกกลุ่ม

เทคนิคเหล่านี้มักเกี่ยวข้องกับการแลกเปลี่ยน ซึ่งอาจจำเป็นต้องลดความแม่นยำโดยรวมลงเล็กน้อยเพื่อให้ได้มาซึ่งความยุติธรรมที่เพิ่มขึ้นอย่างมีนัยสำคัญ

💟 โบนัส: BrainGPTคือผู้ช่วยบนเดสก์ท็อปที่ขับเคลื่อนด้วย AI ที่จะยกระดับการทดสอบอคติของ AI ไปอีกขั้น ด้วยการให้คุณเข้าถึงโมเดลชั้นนำหลากหลายรูปแบบ—รวมถึง GPT-5, Claude, Gemini และอีกมากมาย—ทั้งหมดในที่เดียว

ซึ่งหมายความว่าคุณสามารถเรียกใช้คำสั่งหรือสถานการณ์เดียวกันกับโมเดลต่างๆ ได้อย่างง่ายดาย เปรียบเทียบความสามารถในการให้เหตุผล และสังเกตจุดที่คำตอบแตกต่างกันหรือแสดงอคติ แอป AI ซูเปอร์แอปนี้ยังช่วยให้คุณใช้การพูดเป็นข้อความเพื่อตั้งค่ากรณีทดสอบ บันทึกผลการค้นพบ และจัดระเบียบผลลัพธ์เพื่อการวิเคราะห์แบบเคียงข้างกัน

เครื่องมือการคิดวิเคราะห์ขั้นสูงและเครื่องมือที่ตระหนักถึงบริบทของมันช่วยคุณแก้ไขปัญหา, ระบุรูปแบบ, และเข้าใจว่าแต่ละแบบจำลองมีแนวทางอย่างไรต่อหัวข้อที่ละเอียดอ่อน ด้วยการรวมกระบวนการทำงานของคุณไว้ในที่เดียวและทำให้การทดสอบแบบหลายแบบจำลองโปร่งใส, Brain MAX ให้คุณตรวจสอบ, เปรียบเทียบ, และแก้ไขความลำเอียงของ AI ได้ด้วยความมั่นใจและความแม่นยำ

เพิ่มความโปร่งใสและความสามารถในการอธิบาย

หากคุณไม่ทราบว่าโมเดลของคุณตัดสินใจอย่างไร คุณจะไม่สามารถแก้ไขได้เมื่อมันผิดพลาด เทคนิค AI ที่สามารถอธิบายได้ (XAI) ช่วยให้คุณมองเข้าไปใน "กล่องดำ" และเห็นว่าข้อมูลลักษณะใดที่ขับเคลื่อนการทำนาย

คุณยังสามารถสร้างบัตรแบบจำลองได้ ซึ่งเหมือนกับฉลากโภชนาการสำหรับ AI ของคุณ โดยบันทึกการใช้ตามวัตถุประสงค์ ข้อมูลประสิทธิภาพ และข้อจำกัดที่ทราบไว้

📮ClickUp Insight: 13% ของผู้ตอบแบบสำรวจของเราต้องการใช้ AI เพื่อตัดสินใจในเรื่องที่ยากและแก้ไขปัญหาที่ซับซ้อน อย่างไรก็ตาม มีเพียง 28% เท่านั้นที่ระบุว่าใช้ AI เป็นประจำในการทำงาน เหตุผลที่เป็นไปได้: ความกังวลด้านความปลอดภัย!

ผู้ใช้ไม่ต้องการที่จะแบ่งปันข้อมูลการตัดสินใจที่ละเอียดอ่อนกับระบบปัญญาประดิษฐ์ภายนอก

ClickUp แก้ไขปัญหานี้ด้วยการนำการแก้ปัญหาด้วย AI มาสู่ Workspace ที่ปลอดภัยของคุณ ตั้งแต่มาตรฐาน SOC 2 ถึง ISO ClickUp ปฏิบัติตามมาตรฐานความปลอดภัยของข้อมูลสูงสุดและช่วยให้คุณใช้เทคโนโลยี AI สร้างสรรค์ได้อย่างปลอดภัยทั่วทั้ง Workspace ของคุณ

นโยบายการกำกับดูแลและความรับผิดชอบของปัญญาประดิษฐ์

โปรแกรมการกำกับดูแล AI ที่แข็งแกร่งสร้างความเป็นเจ้าของที่ชัดเจนและมาตรฐานที่สม่ำเสมอที่ทุกคนในทีมสามารถปฏิบัติตามได้

องค์กรของคุณจำเป็นต้องมีโครงสร้างการกำกับดูแลที่ชัดเจนเพื่อให้มั่นใจว่ามีการรับผิดชอบในการสร้างและใช้งาน AI อย่างมีจริยธรรมอยู่เสมอ

นี่คือองค์ประกอบสำคัญของโปรแกรมการกำกับดูแล AI ที่มีประสิทธิภาพ:

| องค์ประกอบด้านการกำกับดูแล | ความหมาย | ขั้นตอนปฏิบัติสำหรับองค์กรของคุณ |

|---|---|---|

| ความเป็นเจ้าของที่ชัดเจน | บุคคลหรือทีมที่รับผิดชอบโดยเฉพาะจะรับผิดชอบด้านจริยธรรม AI การกำกับดูแล และการปฏิบัติตามข้อกำหนด | • แต่งตั้งผู้นำด้านจริยธรรม AI หรือคณะกรรมการข้ามสายงาน• กำหนดความรับผิดชอบด้านข้อมูล คุณภาพของโมเดล การปฏิบัติตามข้อกำหนด และความเสี่ยง• รวมเสียงจากฝ่ายกฎหมาย วิศวกรรม ผลิตภัณฑ์ และ DEI ในการกำกับดูแล |

| นโยบายที่เป็นลายลักษณ์อักษร | แนวทางที่เป็นลายลักษณ์อักษรซึ่งกำหนดวิธีการเก็บรวบรวม ใช้ และติดตามข้อมูลตลอดวงจรชีวิตของระบบปัญญาประดิษฐ์ | • สร้างนโยบายภายในสำหรับการจัดหาข้อมูล, การติดป้ายกำกับ, ความเป็นส่วนตัว, และการเก็บรักษาข้อมูล • จัดทำเอกสารมาตรฐานสำหรับการพัฒนา, การตรวจสอบ, และการPLOYMENTของแบบจำลอง • กำหนดให้ทีมต้องปฏิบัติตามรายการตรวจสอบก่อนที่จะส่งมอบระบบ AI ใด ๆ |

| เส้นทางการตรวจสอบ | บันทึกที่โปร่งใสเกี่ยวกับการตัดสินใจ, รุ่นของแบบจำลอง, ชุดข้อมูล, และการเปลี่ยนแปลง | • ดำเนินการควบคุมเวอร์ชันสำหรับชุดข้อมูลและโมเดล • บันทึกการตัดสินใจสำคัญ, พารามิเตอร์ของโมเดล, และผลการตรวจสอบ • จัดเก็บเส้นทางการตรวจสอบในคลังข้อมูลกลางที่สามารถเข้าถึงได้ |

| การทบทวนเป็นประจำ | การประเมินระบบ AI อย่างต่อเนื่องเพื่อตรวจสอบอคติ การเบี่ยงเบน และความไม่สอดคล้องตามข้อกำหนด | • กำหนดเวลาการประเมินอคติรายไตรมาสหรือครึ่งปีผ่านการประเมิน LLMที่แข็งแกร่ง • ฝึกอบรมหรือปรับเทียบโมเดลใหม่เมื่อประสิทธิภาพลดลงหรือพฤติกรรมเปลี่ยนแปลง • ตรวจสอบโมเดลหลังจากการอัปเดตข้อมูลครั้งใหญ่หรือการเปลี่ยนแปลงผลิตภัณฑ์ |

| แผนการตอบสนองต่อเหตุการณ์ | ระเบียบปฏิบัติที่ชัดเจนสำหรับการระบุ รายงาน และแก้ไขอคติหรืออันตรายจากปัญญาประดิษฐ์ | • สร้างกระบวนการทำงานภายในสำหรับการยกระดับปัญหาที่มีอคติ• กำหนดวิธีการตรวจสอบปัญหาและผู้ที่มีอำนาจอนุมัติการแก้ไข• ระบุขั้นตอนการสื่อสารสำหรับผู้ใช้ ลูกค้า หรือหน่วยงานกำกับดูแลเมื่อจำเป็น |

💡เคล็ดลับจากผู้เชี่ยวชาญ: กรอบการทำงาน เช่น กรอบการจัดการความเสี่ยงด้าน AI ของ NIST และกฎหมาย AI ของสหภาพยุโรป ซึ่งมีโทษปรับสูงถึง 7% ของรายได้ต่อปี สามารถเป็นต้นแบบที่ยอดเยี่ยมสำหรับการสร้างโปรแกรมการกำกับดูแลของคุณเอง

วิธีการลดอคติด้วย ClickUp

ClickUp's converged AI workspaceนำทุกส่วนที่เคลื่อนไหวของโปรแกรมการกำกับดูแล AI ของคุณมาไว้ในที่ทำงานที่จัดระเบียบไว้เพียงที่เดียว

ทีมของคุณสามารถจัดการงาน, เก็บนโยบาย, ตรวจสอบผลการตรวจสอบ, หารือเกี่ยวกับความเสี่ยง, และติดตามเหตุการณ์ได้โดยไม่ต้องสลับไปมาระหว่างเครื่องมือหรือสูญเสียบริบท ทุกบันทึกของแบบจำลอง, บันทึกการตัดสินใจ, และแผนการแก้ไขจะเชื่อมโยงอยู่เสมอ ดังนั้นคุณจึงทราบเสมอว่าใครทำอะไรและทำไม

และเนื่องจาก AI ของ ClickUp เข้าใจงานภายในพื้นที่ทำงานของคุณ มันจึงสามารถแสดงการประเมินที่ผ่านมา สรุปรายงานยาว ๆ และช่วยให้ทีมของคุณทำงานสอดคล้องกันเมื่อมาตรฐานมีการพัฒนา ผลลัพธ์คือระบบการกำกับดูแลที่ง่ายต่อการปฏิบัติตาม ง่ายต่อการตรวจสอบ และเชื่อถือได้มากขึ้นเมื่อการใช้งาน AI ของคุณเพิ่มขึ้น

มาดูกันเป็นขั้นตอนการทำงาน!

ขั้นตอนที่ 1: ตั้งค่าพื้นที่ทำงานสำหรับการกำกับดูแล AI ของคุณ

เริ่มต้นด้วยการสร้างพื้นที่เฉพาะใน ClickUp สำหรับงานที่เกี่ยวข้องกับการกำกับดูแลทั้งหมด เพิ่มรายการสำหรับคลังข้อมูลโมเดล การประเมินอคติ รายงานเหตุการณ์ เอกสารนโยบาย และการตรวจสอบตามกำหนด เพื่อให้ทุกองค์ประกอบของโปรแกรมอยู่ในสภาพแวดล้อมที่ควบคุมได้เพียงแห่งเดียว

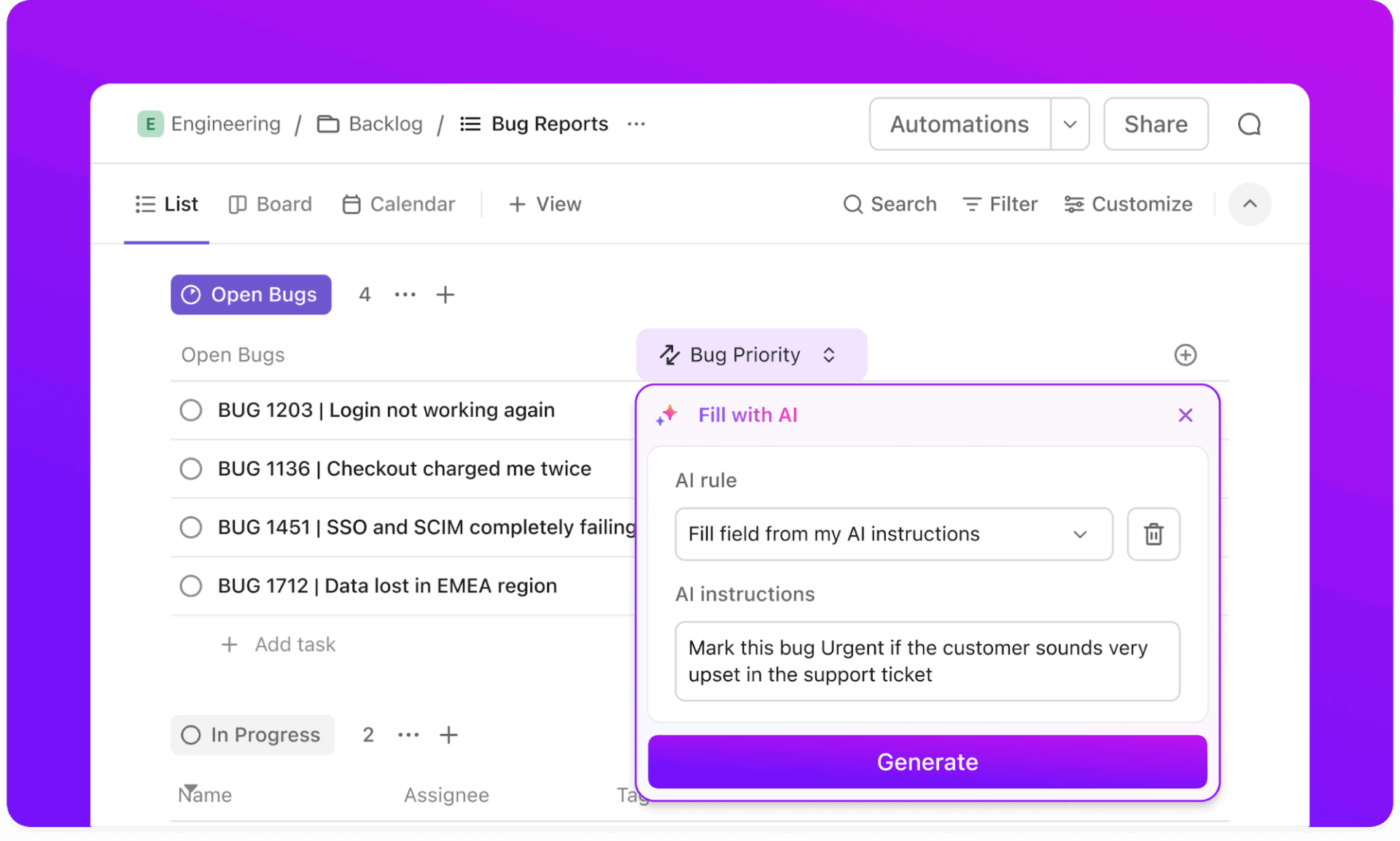

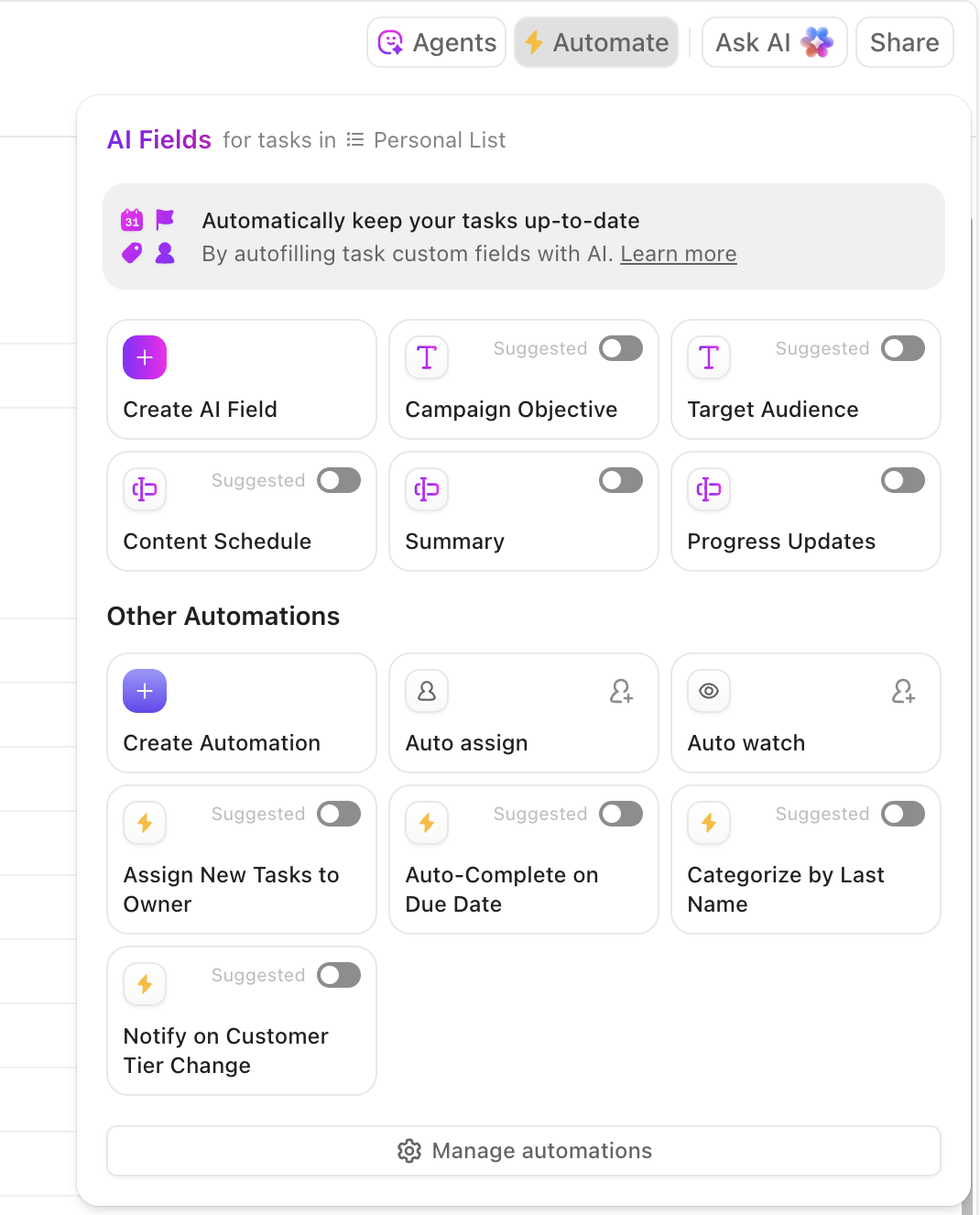

กำหนดค่าฟิลด์ที่กำหนดเองหรือฟิลด์AI เพื่อติดตามตัวชี้วัดความยุติธรรม คะแนนความลำเอียง รุ่นของโมเดล สถานะการตรวจสอบ และระดับความเสี่ยง ใช้สิทธิ์การเข้าถึงตามบทบาทเพื่อให้แน่ใจว่าเฉพาะผู้ตรวจสอบ วิศวกร และผู้นำด้านการปฏิบัติตามข้อกำหนดที่ได้รับอนุญาตเท่านั้นที่สามารถเข้าถึงงาน AI ที่ละเอียดอ่อนได้ สิ่งนี้สร้างรากฐานโครงสร้างที่เครื่องมือจุดและแพลตฟอร์มโครงการทั่วไปของคู่แข่งไม่สามารถนำเสนอได้

ขั้นตอนที่ 2: สร้างกรอบการกำกับดูแลของคุณ

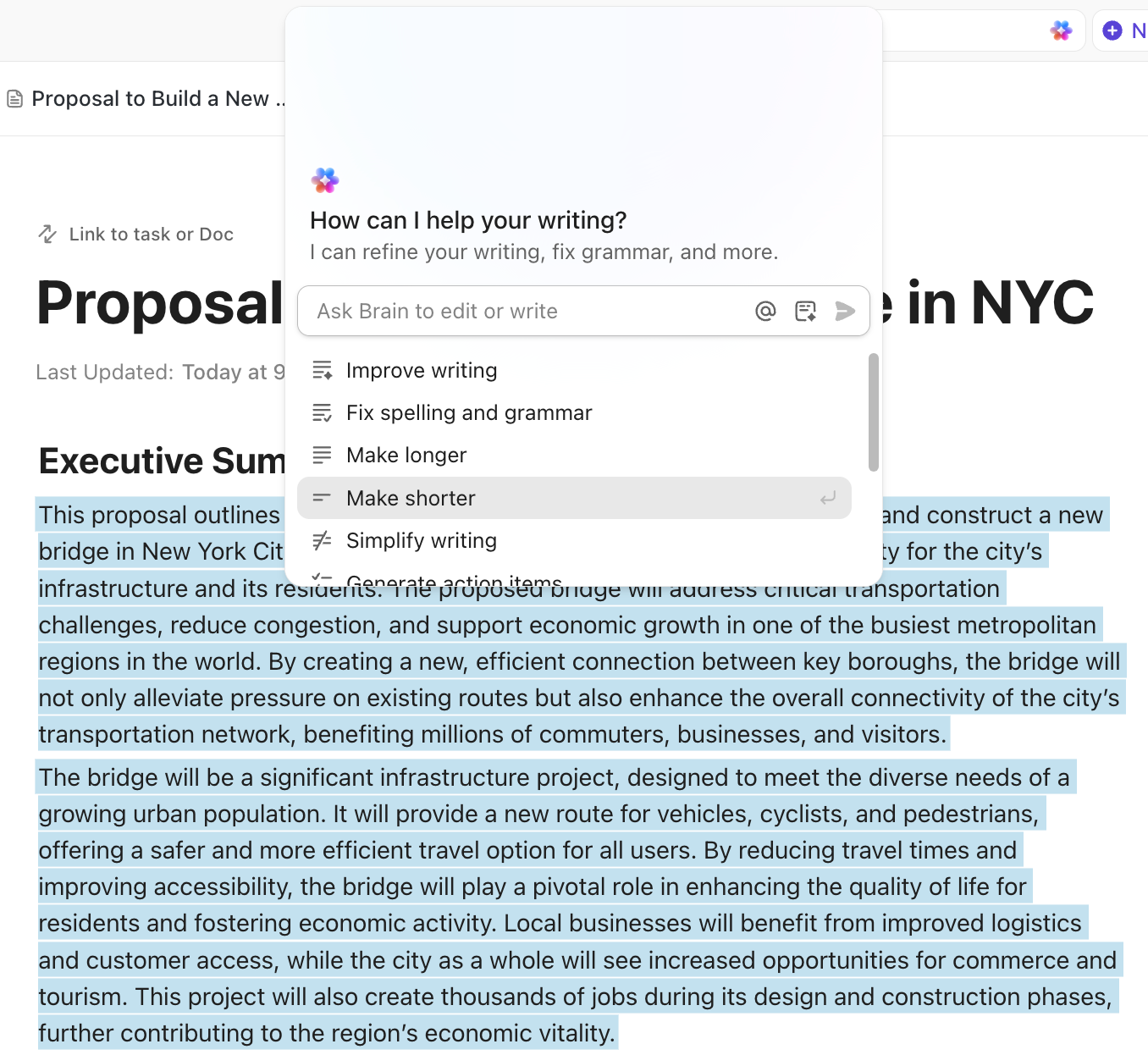

ต่อไป สร้างเอกสารClickUp Docเพื่อใช้เป็นคู่มือการกำกับดูแลที่ใช้งานได้จริง นี่คือที่ที่คุณจะระบุขั้นตอนการประเมินอคติ เกณฑ์ความยุติธรรม แนวทางเอกสารประกอบแบบจำลอง ขั้นตอนการมีส่วนร่วมของมนุษย์ และขั้นตอนการส่งต่อปัญหา

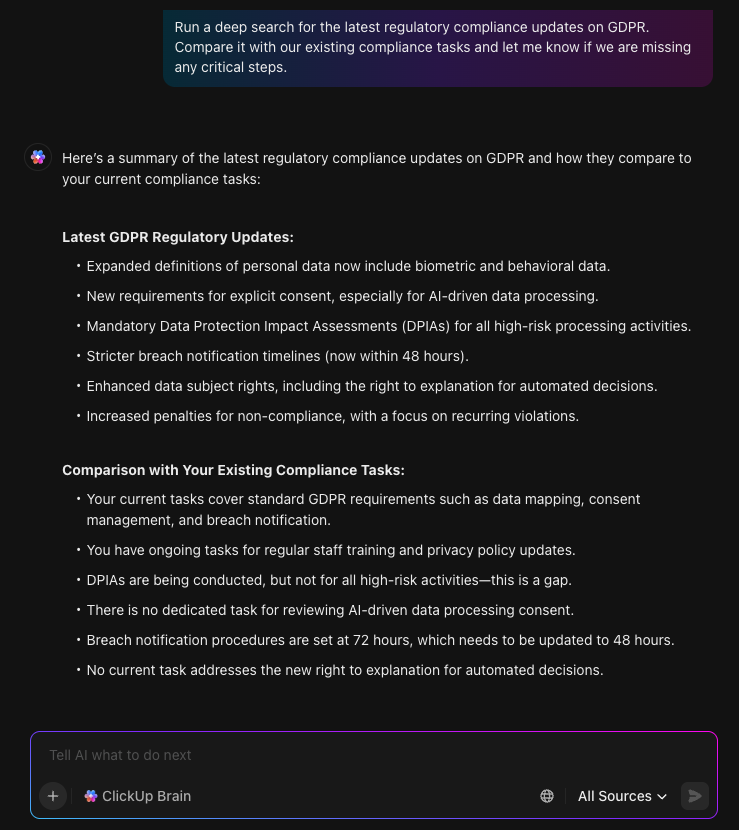

เนื่องจากเอกสารยังคงเชื่อมโยงกับงานและบันทึกโมเดล ทีมงานของคุณจึงสามารถทำงานร่วมกันได้โดยไม่สูญเสียประวัติเวอร์ชันหรือกระจายไฟล์ไปทั่วเครื่องมือต่างๆ ต่อไปClickUp Brainสามารถช่วยสรุปข้อบังคับภายนอก ร่างนโยบายใหม่ หรือแสดงผลการตรวจสอบก่อนหน้านี้ ทำให้การสร้างนโยบายมีความสม่ำเสมอและตรวจสอบย้อนกลับได้มากขึ้น

เนื่องจากสามารถค้นหาข้อมูลบนเว็บ สลับระหว่างโมเดล AI หลายแบบ และสังเคราะห์ข้อมูลให้เป็นคำแนะนำที่ชัดเจน ทีมงานของคุณจึงสามารถติดตามมาตรฐานใหม่และการเปลี่ยนแปลงในอุตสาหกรรมได้อย่างทันท่วงทีโดยไม่ต้องออกจากพื้นที่ทำงาน ทุกสิ่งที่คุณต้องการ ไม่ว่าจะเป็นนโยบายที่อัปเดต ข้อมูลเชิงลึกด้านกฎระเบียบ และการตัดสินใจในอดีต ล้วนถูกรวบรวมไว้ในที่เดียว ทำให้ระบบการกำกับดูแลของคุณมีความมั่นคงและง่ายต่อการดูแลรักษามากยิ่งขึ้น

ขั้นตอนที่ 3: ลงทะเบียนทุกรุ่น

แต่ละโมเดลควรมีงานของตนเองในรายการ "คลังโมเดล" เพื่อให้การเป็นเจ้าของและความรับผิดชอบชัดเจนอยู่เสมอ

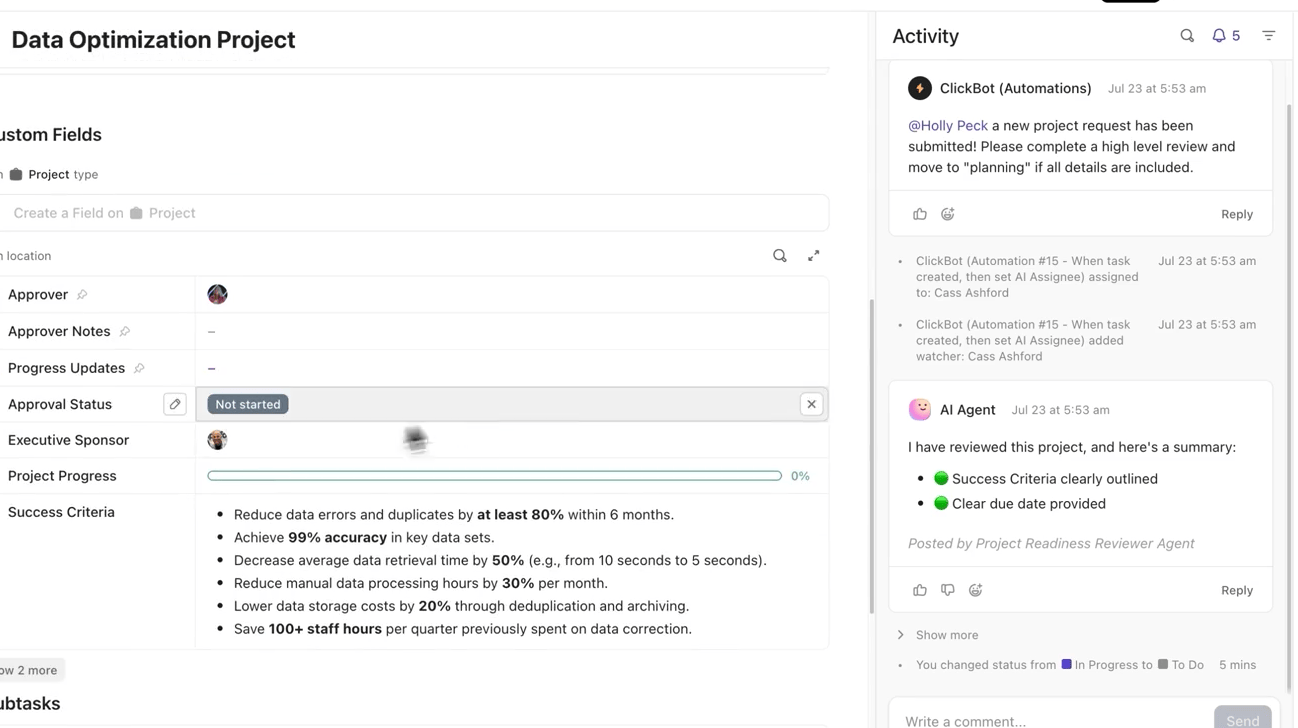

ติดตามทุกเหตุการณ์อคติได้อย่างง่ายดายในฐานะรายการที่สามารถดำเนินการได้ โดยใช้ ClickUp Tasksและ ClickUp Custom Fieldsเพื่อจัดโครงสร้างกระบวนการประเมินอคติของคุณและบันทึกทุกรายละเอียดที่สำคัญ

ด้วยวิธีนี้ คุณสามารถติดตามประเภทของอคติ ระดับความรุนแรง สถานะการแก้ไข สมาชิกทีมที่รับผิดชอบ และวันที่ตรวจสอบครั้งถัดไป เพื่อให้มั่นใจว่าทุกปัญหาได้รับการดูแลอย่างชัดเจนและมีกำหนดเวลาที่แน่นอน

แนบชุดข้อมูล สรุปการประเมิน และบันทึกสายการสืบค้น เพื่อให้ทุกอย่างอยู่ในที่เดียว จากนั้นระบบอัตโนมัติสามารถแจ้งเตือนผู้ตรวจสอบได้ทุกครั้งที่แบบจำลองถูกย้ายไปยังขั้นตอน staging หรือ production

ขั้นตอนที่ 4: ดำเนินการตรวจสอบอคติตามกำหนดเวลาและตามเหตุการณ์

การตรวจสอบอคติควรเกิดขึ้นทั้งตามกำหนดเวลาที่สม่ำเสมอและเมื่อมีการกระตุ้นเฉพาะ

ตั้งค่ากฎง่าย ๆ ผ่านClickUp Automationsที่จะกระตุ้นงานตรวจสอบโดยอัตโนมัติทุกครั้งที่โมเดลถึงจุดสำคัญใหม่ในการปรับใช้หรือเมื่อถึงกำหนดการตรวจสอบตามกำหนดการ คุณจะไม่พลาดการประเมินอคติรายไตรมาสอีกต่อไป เนื่องจาก Automations สามารถมอบหมายผู้ตรวจสอบที่เหมาะสม กำหนดเส้นตายที่ถูกต้อง และแม้กระทั่งส่งการเตือนเมื่อใกล้ถึงกำหนด

สำหรับการตรวจสอบตามเหตุการณ์ClickUp Formsช่วยให้การรวบรวมรายงานเหตุการณ์อคติหรือความคิดเห็นจากมนุษย์เป็นเรื่องง่าย ในขณะที่ผู้ตรวจสอบสามารถใช้ฟิลด์ที่กำหนดเองเพื่อบันทึกช่องว่างด้านความยุติธรรม ผลการทดสอบ และคำแนะนำ การส่งแบบฟอร์มแต่ละครั้งจะถูกส่งไปยังทีมของคุณเป็นงาน ซึ่งสร้างช่องทางตรวจสอบที่สามารถทำซ้ำได้

ขั้นตอนที่ 5: ตรวจสอบและแก้ไขเหตุการณ์ที่มีอคติ

เมื่อพบปัญหาความลำเอียง ให้สร้างงานเหตุการณ์ที่บันทึกความรุนแรง กลุ่มที่ได้รับผลกระทบ รุ่นของโมเดล และงานบรรเทาผลกระทบที่จำเป็นตัวแทน AIสามารถยกระดับการค้นพบที่มีความเสี่ยงสูงไปยังผู้นำด้านการปฏิบัติตามข้อกำหนดและมอบหมายผู้ตรวจสอบและวิศวกรที่เหมาะสม

แต่ละการดำเนินการเพื่อบรรเทาผลกระทบ, ผลการทดสอบ, และขั้นตอนการตรวจสอบความถูกต้องจะยังคงเชื่อมโยงกับบันทึกเหตุการณ์อยู่ ClickUp Brain สามารถสร้างสรุปสำหรับผู้นำหรือช่วยเตรียมบันทึกการแก้ไขสำหรับเอกสารการกำกับดูแลของคุณได้ ทำให้ทุกอย่างโปร่งใสและสามารถตรวจสอบได้

ขั้นตอนที่ 6: ตรวจสอบสุขภาพของโปรแกรมการกำกับดูแล AI ของคุณ

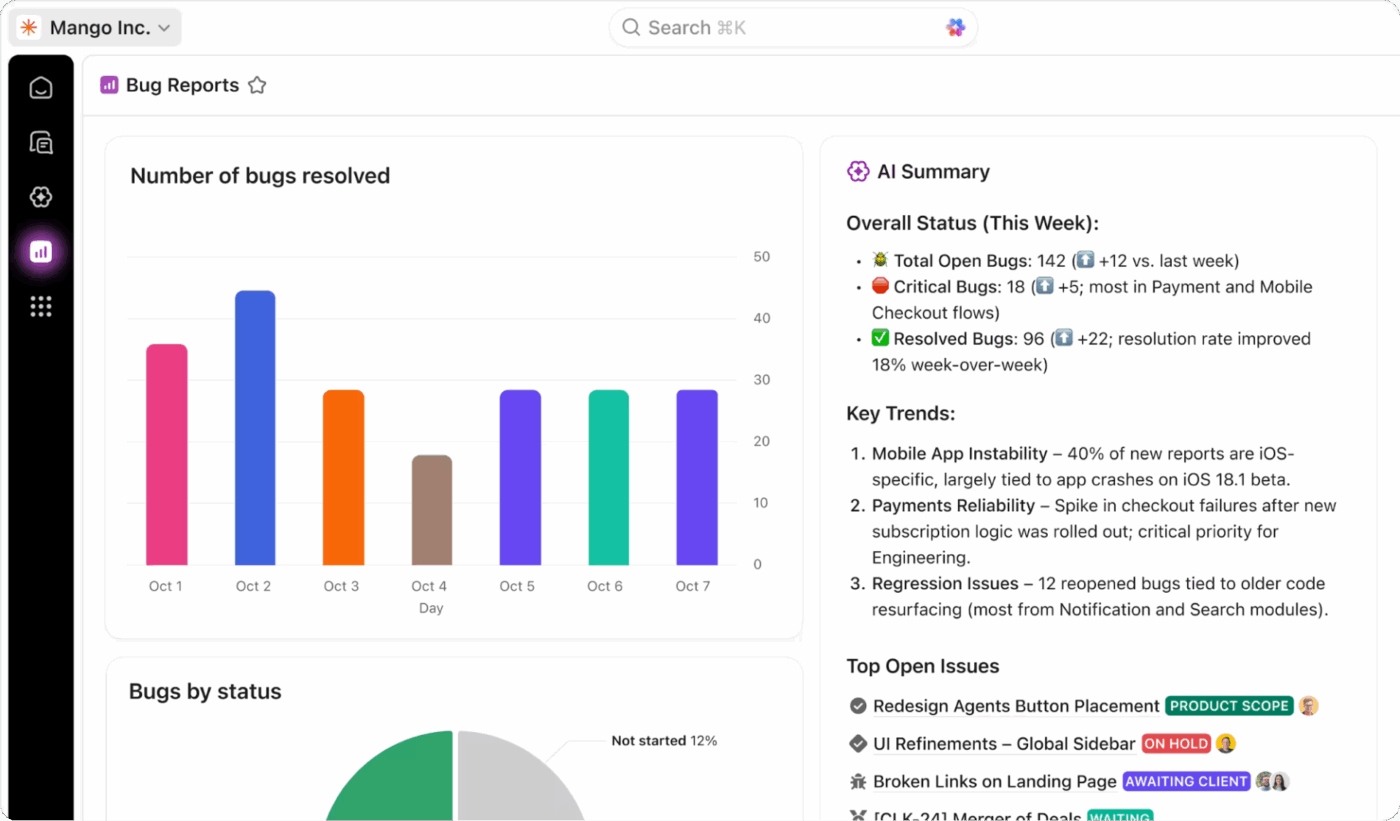

สุดท้าย สร้างแดชบอร์ดที่ให้ผู้นำเห็นภาพรวมของโปรแกรมการลดอคติของคุณแบบเรียลไทม์

รวมแผงที่แสดงเหตุการณ์ที่เปิดอยู่, เวลาที่ใช้ในการแก้ไข, อัตราการตรวจสอบเสร็จสมบูรณ์, ตัวชี้วัดความยุติธรรม, และสถานะการปฏิบัติตามข้อกำหนดในทุกโมเดลที่ใช้งานอยู่แดชบอร์ดแบบ ไม่ต้องเขียนโค้ดใน ClickUp สามารถ ดึงข้อมูลและอัปเดตงานโดยอัตโนมัติเมื่อการทำงานดำเนินไป พร้อมสรุปโดย AI ที่สร้างขึ้นในมุมมองแดชบอร์ดของคุณ

📖 อ่านเพิ่มเติม: วิธีเอาชนะความท้าทายทั่วไปของ AI

การตรวจสอบอคติหลังการปฏิบัติงาน

งานของคุณยังไม่เสร็จเมื่อโมเดล AI เริ่มใช้งานจริง

ในความเป็นจริง นี่คือจุดเริ่มต้นของการทดสอบที่แท้จริง แบบจำลองสามารถ "เบี่ยงเบน" และพัฒนาความลำเอียงใหม่ได้เมื่อเวลาผ่านไป เนื่องจากข้อมูลในโลกจริงที่พวกเขาเห็นเริ่มเปลี่ยนแปลง การตรวจสอบอย่างต่อเนื่องเป็นวิธีเดียวที่จะจับความลำเอียงที่กำลังเกิดขึ้นนี้ได้ก่อนที่จะก่อให้เกิดความเสียหายอย่างกว้างขวาง

นี่คือสิ่งที่คุณควรตรวจสอบอย่างต่อเนื่อง:

| ฝึกฝน | สิ่งที่มันรับประกัน |

|---|---|

| การติดตามประสิทธิภาพตามกลุ่ม | วัดความแม่นยำและความเป็นธรรมของแบบจำลองอย่างต่อเนื่องในทุกกลุ่มประชากร เพื่อให้สามารถตรวจพบความเหลื่อมล้ำได้ตั้งแต่เนิ่นๆ |

| การตรวจจับการเบี่ยงเบนของข้อมูล | ตรวจสอบการเปลี่ยนแปลงในข้อมูลนำเข้าที่อาจทำให้เกิดอคติใหม่หรือทำให้ประสิทธิภาพของแบบจำลองลดลงเมื่อเวลาผ่านไป |

| วงจรข้อเสนอแนะจากผู้ใช้ | ให้ช่องทางที่ชัดเจนสำหรับผู้ใช้ในการรายงานผลลัพธ์ที่มีอคติหรือไม่ถูกต้อง เพื่อปรับปรุงการกำกับดูแลในโลกแห่งความเป็นจริง |

| การตรวจสอบตามกำหนดการ | ตรวจสอบให้มีการวิเคราะห์เชิงลึกเป็นประจำทุกไตรมาสหรือทุกครึ่งปีเกี่ยวกับพฤติกรรมของแบบจำลอง, ตัวชี้วัดความยุติธรรม, และข้อกำหนดการปฏิบัติตามกฎระเบียบ |

| การตอบสนองต่อเหตุการณ์ | กำหนดกระบวนการที่มีโครงสร้างสำหรับการตรวจสอบ แก้ไข และบันทึกเหตุการณ์อคติที่ถูกรายงาน |

💟 โบนัส: ระบบ AI เชิงสร้างสรรค์โดยเฉพาะอย่างยิ่งต้องการความระมัดระวังเป็นพิเศษ เนื่องจากผลลัพธ์ของระบบเหล่านี้มีความคาดเดาได้น้อยกว่าระบบการเรียนรู้ของเครื่องแบบดั้งเดิมอย่างมาก เทคนิคที่ยอดเยี่ยมสำหรับเรื่องนี้คือ การทดสอบแบบฝ่ายตรงข้าม (Red-teaming) ซึ่งทีมเฉพาะกิจจะพยายามกระตุ้นให้ระบบสร้างผลลัพธ์ที่มีอคติหรือเป็นอันตราย เพื่อระบุจุดอ่อนของระบบ

ตัวอย่างเช่นโครงการ Lighthouse ของ Airbnbเป็นกรณีศึกษาที่ดีของอุตสาหกรรมที่แสดงให้เห็นถึงการนำการตรวจสอบอคติอย่างเป็นระบบหลังการใช้งานไปปฏิบัติจริง

นี่คือโครงการวิจัยที่ศึกษาว่า การรับรู้เรื่องเชื้อชาติ อาจส่งผลต่อผลลัพธ์การจองอย่างไร เพื่อช่วยให้บริษัทสามารถระบุและลดการเลือกปฏิบัติบนแพลตฟอร์มได้ โครงการนี้ใช้วิธีการที่ปลอดภัยต่อความเป็นส่วนตัว ร่วมมือกับกลุ่มสิทธิพลเมือง และแปลผลการค้นพบไปสู่การเปลี่ยนแปลงผลิตภัณฑ์และนโยบาย ทำให้ผู้เข้าพักสามารถใช้งานแพลตฟอร์มได้โดยไม่พบอุปสรรคที่มองไม่เห็น

ลดอคติของ AI ด้วย ClickUp

การสร้าง AI ที่ยุติธรรมและรับผิดชอบได้เป็นความมุ่งมั่นขององค์กร

เมื่อนโยบาย บุคลากร กระบวนการ และเครื่องมือของคุณทำงานร่วมกันอย่างสอดคล้อง คุณจะได้ระบบธรรมาภิบาลที่สามารถปรับตัวต่อความเสี่ยงใหม่ ๆ ตอบสนองต่อเหตุการณ์ได้อย่างรวดเร็ว และสร้างความไว้วางใจจากผู้ที่พึ่งพาผลิตภัณฑ์ของคุณ

ด้วยการทบทวนที่มีโครงสร้าง เอกสารที่ชัดเจน และกระบวนการทำงานที่สามารถทำซ้ำได้สำหรับการจัดการกับอคติ ทีมสามารถทำงานร่วมกันอย่างสอดคล้องและมีความรับผิดชอบ แทนที่จะตอบสนองในโหมดวิกฤต

โดยการรวมทุกอย่างไว้ภายใน ClickUp ตั้งแต่บันทึกของโมเดล ผลการตรวจสอบ ไปจนถึงรายงานเหตุการณ์ คุณจะสร้างชั้นปฏิบัติการเดียวที่การตัดสินใจมีความโปร่งใส ความรับผิดชอบชัดเจน และการปรับปรุงไม่เคยสูญหายไปในความวุ่นวาย

การกำกับดูแลที่เข้มแข็งไม่ได้ทำให้การนวัตกรรมช้าลง แต่ทำให้การนวัตกรรมมั่นคงขึ้น พร้อมที่จะสร้างการลดอคติเข้าไปในกระบวนการทำงานของ AI ของคุณแล้วหรือยัง?เริ่มต้นได้ฟรีกับ ClickUpและเริ่มสร้างโปรแกรมการกำกับดูแล AI ของคุณในวันนี้

คำถามที่พบบ่อย

ขั้นตอนแรกที่ยอดเยี่ยมคือการตรวจสอบอคติของระบบ AI ที่คุณมีอยู่ การประเมินพื้นฐานนี้จะแสดงให้คุณเห็นถึงความไม่เป็นธรรมที่มีอยู่ในปัจจุบันและช่วยให้คุณจัดลำดับความสำคัญของความพยายามในการแก้ไขปัญหา

ทีมใช้ตัวชี้วัดความยุติธรรมที่เฉพาะเจาะจง เช่น ความเท่าเทียมทางประชากร โอกาสที่เท่าเทียม และอัตราส่วนผลกระทบที่ไม่เท่าเทียมกัน เพื่อวัดความลำเอียง ตัวชี้วัดที่เหมาะสมขึ้นอยู่กับกรณีการใช้งานเฉพาะของคุณและความยุติธรรมประเภทที่สำคัญที่สุดในบริบทนั้น

คุณควรเพิ่มขั้นตอนการตรวจสอบโดยมนุษย์ในทุกการตัดสินใจที่มีความเสี่ยงสูงซึ่งส่งผลกระทบอย่างมีนัยสำคัญต่อชีวิตหรือโอกาสของบุคคล เช่น ในการจ้างงาน การให้กู้ยืม หรือการดูแลสุขภาพ นอกจากนี้ยังควรใช้ในระหว่างการนำโมเดลใหม่มาใช้ในช่วงแรกเมื่อพฤติกรรมของมันยังไม่สามารถคาดการณ์ได้

เนื่องจาก AI สร้างสรรค์สามารถสร้างคำตอบที่หลากหลายและคาดเดาไม่ได้เกือบไม่มีที่สิ้นสุด คุณจึงไม่สามารถตรวจสอบความถูกต้องได้เพียงอย่างเดียว คุณจำเป็นต้องใช้เทคนิคการทดสอบเชิงรุก เช่น การทดสอบแบบ red-teaming และการสุ่มตัวอย่างผลลัพธ์ในวงกว้าง เพื่อค้นหาว่าโมเดลสร้างเนื้อหาที่มีอคติภายใต้เงื่อนไขที่แตกต่างกันหรือไม่