พวกเราส่วนใหญ่เคยมีประสบการณ์ 'พูดคุย' กับเครื่องมือ AI ล่าสุดที่ออกมา หากคุณใช้เวลากับ AI มากพอ คุณจะรู้ว่ามันเหมือนเพื่อนที่ฉลาดแต่ขี้ลืม มีไอเดียดีๆ แต่บางครั้งก็ลืมว่าคุณสองคนคุยอะไรกัน หรือเพื่อนร่วมงานที่ติดโทรศัพท์ตลอดเวลาและแชร์ข่าวที่น่าสงสัยจากกระทู้แชทสุ่มๆ ทำให้เกิดข้อมูลที่ผิดพลาด

นั่นเป็นเพียงส่วนน้อยนิดเมื่อเราพูดถึงความท้าทายในด้านปัญญาประดิษฐ์

นักวิจัยจากมหาวิทยาลัยรัฐโอเรกอนและ Adobe กำลังพัฒนาเทคนิคการฝึกอบรมใหม่เพื่อลดอคติทางสังคมในระบบปัญญาประดิษฐ์ หากเทคนิคนี้พิสูจน์ได้ว่าเชื่อถือได้ อาจทำให้ AI มีความยุติธรรมมากขึ้นสำหรับทุกคน

แต่เราอย่าเพิ่งรีบไปข้างหน้า นี่เป็นเพียงหนึ่งในหลายๆ วิธีแก้ปัญหาที่เราต้องการเพื่อรับมือกับความท้าทายด้าน AI มากมายที่เราเผชิญอยู่ในปัจจุบัน ตั้งแต่ปัญหาทางเทคนิคไปจนถึงปัญหาทางจริยธรรม เส้นทางสู่ AI ที่เชื่อถือได้เต็มไปด้วยปัญหาที่ซับซ้อน

มาทำความเข้าใจกับความท้าทายด้าน AI เหล่านี้ไปด้วยกัน และดูว่าต้องทำอย่างไรจึงจะเอาชนะได้

10 ความท้าทายและแนวทางแก้ไขของ AI

เมื่อเทคโนโลยีปัญญาประดิษฐ์ก้าวหน้าไปข้างหน้า มันต้องเผชิญกับปัญหาหลากหลายประการ รายการนี้จะสำรวจปัญหาที่ท้าทายของปัญญาประดิษฐ์ 10 ประการ และให้แนวทางแก้ไขที่เป็นประโยชน์สำหรับการนำไปใช้ในทางที่รับผิดชอบและมีประสิทธิภาพ

1. อัลกอริทึมที่มีอคติ

อคติเชิงอัลกอริทึม หมายถึงแนวโน้มของระบบปัญญาประดิษฐ์ (AI) ที่จะแสดงผลลัพธ์ที่มีอคติ ซึ่งมักเกิดจากลักษณะของข้อมูลที่ใช้ฝึกฝนหรือการออกแบบ อคติเหล่านี้สามารถปรากฏในรูปแบบต่าง ๆ มากมาย และมักส่งผลให้เกิดการสืบทอดและขยาย อคติทางสังคม ที่มีอยู่เดิม

วิธีแก้ไข

- ข้อมูลที่หลากหลายและเป็นตัวแทน: ใช้ชุดข้อมูลฝึกอบรมที่สะท้อนถึงความหลากหลายของทุกกลุ่มอย่างแท้จริง เพื่อหลีกเลี่ยงอคติที่เกี่ยวข้องกับเพศ เชื้อชาติ หรืออายุ

- การตรวจจับและติดตามอคติ: ตรวจสอบระบบ AI ของคุณเป็นประจำเพื่อค้นหาอคติ ควรใช้การตรวจสอบอัตโนมัติร่วมกับทบทวนด้วยตนเองเพื่อให้แน่ใจว่าไม่มีสิ่งใดหลุดรอดไป

- การปรับแต่งอัลกอริทึม: มีบทบาทเชิงรุกในการปรับแต่งอัลกอริทึมของ AI เพื่อต่อสู้กับอคติ ซึ่งอาจหมายถึงการปรับสมดุลน้ำหนักของข้อมูลใหม่ หรือเพิ่มข้อจำกัดด้านความเป็นธรรมให้กับโมเดลของคุณ

- แนวทางการใช้ AI อย่างมีจริยธรรม: ช่วยกำหนดแนวทางปฏิบัติด้าน AI ที่มีจริยธรรมโดยการนำแนวทางปฏิบัติที่จัดการกับความยุติธรรมและอคติมาใช้และดำเนินการให้แน่ใจว่าหลักการเหล่านี้ถูกผสานเข้ากับทุกขั้นตอนของโครงการ AI ของคุณ

2. การขาดความโปร่งใสของ AI ทำให้เกิดความไม่ไว้วางใจ

ความโปร่งใสใน AI หมายถึงการเปิดเผยอย่างเปิดเผยเกี่ยวกับวิธีการทำงานของระบบ AI รวมถึงการออกแบบ ข้อมูลที่ใช้ และกระบวนการตัดสินใจของพวกมัน ความสามารถในการอธิบายได้ ไปไกลกว่านั้นโดยการรับประกันว่าใครก็ตาม ไม่ว่าจะมีทักษะทางเทคโนโลยีเพียงใด ก็สามารถเข้าใจได้ว่า AI กำลังตัดสินใจอะไรและทำไม แนวคิดเหล่านี้ช่วยแก้ไขความกลัวเกี่ยวกับ AI เช่น ความลำเอียง ปัญหาความเป็นส่วนตัว หรือแม้กระทั่งความเสี่ยงเช่นการใช้ในทางทหารแบบอัตโนมัติ

วิธีแก้ไข

- พัฒนาเอกสารที่ชัดเจน: ให้รายละเอียดที่ครอบคลุมเกี่ยวกับโมเดล AI กระบวนการพัฒนา ข้อมูลนำเข้า และกระบวนการตัดสินใจ สิ่งนี้จะช่วยส่งเสริมความเข้าใจที่ดีขึ้นและวางรากฐานสำหรับความไว้วางใจ

- การนำโมเดล AI ที่สามารถอธิบายได้มาใช้: ใช้โมเดลที่ให้ความโปร่งใสมากขึ้น เช่น ต้นไม้ตัดสินใจหรือระบบที่ใช้กฎเกณฑ์ เพื่อให้ผู้ใช้เห็นได้อย่างชัดเจนว่าข้อมูลนำเข้าถูกแปลงเป็นผลลัพธ์อย่างไร

- ใช้เครื่องมือที่สามารถอธิบายได้: ใช้เครื่องมือเช่น LIME (Local Interpretable Model-agnostic Explanations) หรือ SHAP (SHapley Additive exPlanations) เพื่อแยกแยะการมีส่วนร่วมของลักษณะต่าง ๆ ในกระบวนการตัดสินใจของแบบจำลอง

3. การขยายขนาด AI นั้นยากกว่าที่เห็น

การขยายเทคโนโลยี AI เป็นสิ่งสำคัญสำหรับองค์กรที่ต้องการใช้ประโยชน์จากศักยภาพของ AI ในหน่วยธุรกิจต่างๆ อย่างไรก็ตาม การบรรลุความยืดหยุ่นของโครงสร้างพื้นฐาน AI นี้เต็มไปด้วยความซับซ้อน

แม้จะมีศักยภาพในการให้ผลตอบแทนจากการลงทุนที่สูง แต่หลายบริษัทพบว่ามีความยากลำบากในการก้าวข้ามจากโครงการนำร่องไปสู่การนำไปใช้ในวงกว้างอย่างเต็มรูปแบบ

ความล้มเหลวในการพลิกบ้านของ Zillow เป็นเครื่องเตือนใจที่ชัดเจนถึงความท้าทายในการขยายขนาดของ AI ระบบ AI ของพวกเขาซึ่งมุ่งเน้นไปที่การคาดการณ์ราคาบ้านเพื่อทำกำไร มีอัตราความผิดพลาดสูงถึง6.9% ส่งผลให้เกิดความสูญเสียทางการเงินอย่างรุนแรงและต้องตัดลดมูลค่าสินค้าคงคลังลงถึง 304 ล้านดอลลาร์

ความท้าทายด้านความสามารถในการขยายตัวเห็นได้ชัดเจนที่สุดนอกเหนือจากบริษัทยักษ์ใหญ่ด้านเทคโนโลยีอย่าง Google และ Amazon ซึ่งมีทรัพยากรเพียงพอที่จะใช้ประโยชน์จาก AI ได้อย่างมีประสิทธิภาพ สำหรับบริษัทอื่นๆ ส่วนใหญ่ โดยเฉพาะบริษัทที่ไม่ใช่เทคโนโลยีที่เพิ่งเริ่มสำรวจ AI อุปสรรคต่างๆ ได้แก่ การขาดโครงสร้างพื้นฐาน กำลังการประมวลผล ความเชี่ยวชาญ และการนำไปใช้เชิงกลยุทธ์

วิธีแก้ไข

- โครงสร้างพื้นฐานที่ได้รับการปรับปรุง: พัฒนาโครงสร้างพื้นฐานดิจิทัลที่แข็งแกร่งซึ่งสามารถรองรับการPLOY AI ขนาดใหญ่ได้ ตัวอย่างเช่น บริการคลาวด์และศูนย์ข้อมูลที่ตั้งอยู่ในท้องถิ่นช่วยลดความล่าช้าและปรับปรุงประสิทธิภาพ

- ทีมสหวิทยาการ: ส่งเสริมสภาพแวดล้อมที่เอื้อต่อการทำงานร่วมกันระหว่างฝ่ายเทคโนโลยีและฝ่ายธุรกิจ เพื่อผสานโซลูชัน AI เข้ากับรูปแบบธุรกิจที่มีอยู่ได้อย่างราบรื่น

- เครื่องมือพัฒนา AI อัตโนมัติ: ใช้แพลตฟอร์มเช่น TurinTech's evoML เพื่อทำให้การพัฒนาโค้ดการเรียนรู้ของเครื่องเป็นอัตโนมัติ ช่วยให้การสร้างและPLOY แบบจำลองได้รวดเร็วขึ้น

- การเรียนรู้และการปรับตัวอย่างต่อเนื่อง: ดำเนินกลไกสำหรับการเรียนรู้และการอัปเดตแบบต่อเนื่องของแบบจำลอง AI เพื่อให้สามารถปรับตัวกับข้อมูลในโลกจริงและสภาพตลาดที่เปลี่ยนแปลงได้ พร้อมทั้งรับประกันความเกี่ยวข้องและประสิทธิภาพในระยะยาว

- ลงทุนในการพัฒนาบุคลากร: สร้างความเชี่ยวชาญด้าน AI ภายในองค์กรผ่านการฝึกอบรมและการสรรหาบุคลากรที่เน้นเทคโนโลยี AI ที่กำลังเกิดขึ้นใหม่ เพื่อลดการพึ่งพาบุคลากร AI จากภายนอกมากเกินไป

อ่านเพิ่มเติม: สถิติ AI ที่จำเป็นที่ต้องรู้ในวันนี้

4. การฉ้อโกงด้วยดีพเฟคและปัญญาประดิษฐ์เชิงสร้างสรรค์

เทคโนโลยีปัญญาประดิษฐ์เชิงสร้างสรรค์และเทคโนโลยีดีปเฟกกำลังเปลี่ยนแปลงภูมิทัศน์ของการฉ้อโกง โดยเฉพาะอย่างยิ่งในภาคบริการทางการเงิน เทคโนโลยีเหล่านี้ทำให้การสร้างของปลอมที่น่าเชื่อถือเป็นเรื่องง่ายและประหยัดค่าใช้จ่ายมากขึ้น

ตัวอย่างเช่น ในเดือนมกราคม 2024 มีกรณีการปลอมแปลงใบหน้าแบบลึก (deepfake) ที่เลียนแบบประธานเจ้าหน้าที่ฝ่ายการเงิน (CFO) และสั่งการให้พนักงานโอนเงินจำนวน 25 ล้านดอลลาร์ ซึ่งแสดงให้เห็นถึงผลกระทบที่ร้ายแรงของเทคโนโลยีดังกล่าว

แนวโน้มที่เพิ่มขึ้นนี้เน้นย้ำถึงความท้าทายที่ธนาคารต้องเผชิญในการปรับตัวให้เข้ากับระบบการจัดการข้อมูลและการตรวจจับการฉ้อโกง เพื่อรับมือกับการฉ้อโกงที่ซับซ้อนมากขึ้นซึ่งไม่เพียงแต่หลอกลวงบุคคลเท่านั้น แต่ยังหลอกลวงระบบความปลอดภัยที่ใช้เครื่องจักรอีกด้วย

วิธีแก้ไข

- เทคโนโลยีการตรวจจับขั้นสูง: ธนาคารต้องลงทุนในเทคโนโลยีใหม่ที่สามารถตรวจจับการปลอมแปลงลึก (deepfake) และความผิดปกติของปัญญาประดิษฐ์เชิงสร้างสรรค์ (generative AI) ได้อย่างมีประสิทธิภาพมากขึ้น

- การกำกับดูแลโดยมนุษย์: การผสานการวิเคราะห์โดยมนุษย์ที่มีทักษะเข้ากับการตอบสนองของ AI ช่วยเพิ่มอัตราการตรวจจับและช่วยในการตรวจสอบและทำความเข้าใจการระบุการฉ้อโกงที่ขับเคลื่อนด้วย AI

- ความร่วมมือในการป้องกันการฉ้อโกง: การสร้างความร่วมมือภายในและระหว่างอุตสาหกรรมสามารถช่วยพัฒนาวิธีการที่แข็งแกร่งขึ้นในการระบุและป้องกันการฉ้อโกง

5. ความท้าทายด้านความสามารถในการทำงานร่วมกันและการปฏิสัมพันธ์ระหว่างมนุษย์กับ AI

เมื่อองค์กรหรือประเทศต่าง ๆ ใช้ระบบปัญญาประดิษฐ์ร่วมกัน พวกเขาต้องมั่นใจว่าระบบปัญญาประดิษฐ์นั้นประพฤติตนอย่างมีจริยธรรมตามกฎกติกาของทุกคน นี่คือสิ่งที่เรียกว่า การประสานงานอย่างมีจริยธรรม และสิ่งนี้มีความสำคัญอย่างยิ่งในสาขาเช่นการป้องกันประเทศและความมั่นคง

ขณะนี้ รัฐบาลและองค์กรต่าง ๆ มีกฎเกณฑ์และจริยธรรมของตนเอง ตัวอย่างเช่น ลองดูแนวทางของไมโครซอฟท์สำหรับการปฏิสัมพันธ์ระหว่างมนุษย์กับปัญญาประดิษฐ์:

อย่างไรก็ตาม ยังขาดมาตรฐานที่เป็นสากลในแนวคิดและกฎระเบียบนี้ทั่วโลก

ขณะนี้ ระบบ AI มาพร้อมกับชุดกฎทางจริยธรรมของตัวเอง ซึ่งอาจเหมาะสมในที่หนึ่ง แต่เป็นปัญหาในที่อื่น เมื่อระบบเหล่านี้มีปฏิสัมพันธ์กับมนุษย์ หากพวกมันไม่ประพฤติตามที่คาดหวังไว้ อาจนำไปสู่ การเข้าใจผิดหรือความไม่ไว้วางใจ

วิธีแก้ไข

- กำหนดมาตรฐานจริยธรรมสากล: ตกลงในกฎจริยธรรมพื้นฐานที่ระบบ AI ทุกระบบต้องปฏิบัติตาม ไม่ว่าจะมาจากที่ใดก็ตาม เน้นที่ความยุติธรรม ความรับผิดชอบ และความโปร่งใส

- ใช้ระบบการรับรองที่แข็งแกร่ง: ก่อนที่ระบบ AI ใด ๆ จะถูกนำมาใช้ ควรผ่านการทดสอบที่เข้มงวดเพื่อยืนยันว่ามันปฏิบัติตามมาตรฐานทางจริยธรรมเหล่านี้ ซึ่งอาจรวมถึงการตรวจสอบโดยผู้สร้างเองและกลุ่มอิสระ

- ให้ทุกคนได้รับข้อมูลอย่างครบถ้วน: ควรชี้แจงให้ชัดเจนเสมอว่า AI ตัดสินใจและใช้ข้อมูลอย่างไร ความโปร่งใสนี้จะช่วยสร้างความไว้วางใจและทำให้การผสานระบบ AI ต่าง ๆ เข้าด้วยกันง่ายขึ้น

- คอยจับตาดูสิ่งต่างๆ: ตรวจสอบระบบ AI อย่างสม่ำเสมอเพื่อให้แน่ใจว่ายังคงเป็นไปตามมาตรฐานทางจริยธรรม อัปเดตระบบตามความจำเป็นเพื่อให้ทันกับกฎระเบียบหรือเทคโนโลยีใหม่ๆ

6. จริยธรรมของ AI เกี่ยวข้องกับมากกว่าแค่เจตนาที่ดี

ปัญญาประดิษฐ์ (AI) กำลังขยายตัวเข้าสู่เกือบทุกส่วนของชีวิตเรา—ตั้งแต่รถยนต์ขับเคลื่อนอัตโนมัติไปจนถึงผู้ช่วยเสมือนจริง และมันยอดเยี่ยมมาก! แต่มีข้อควรระวัง: วิธีที่เราใช้ AI บางครั้งอาจก่อให้เกิดปัญหาทางจริยธรรมที่ร้ายแรงได้ มีประเด็นทางจริยธรรมที่ซับซ้อนเกี่ยวกับ ความเป็นส่วนตัว, อคติ, การสูญเสียงาน และอื่นๆ อีกมากมาย

ด้วยปัญญาประดิษฐ์ที่สามารถทำงานที่มนุษย์เคยทำได้ จึงเกิดการถกเถียงกันอย่างมากว่ามันควรจะทำบางงานเหล่านั้นหรือไม่

ตัวอย่างเช่น ควรให้ AI เขียนบทภาพยนตร์หรือไม่? ฟังดูเจ๋ง แต่สิ่งนี้ได้จุดชนวนให้เกิดความวุ่นวายครั้งใหญ่ในวงการบันเทิงด้วยการนัดหยุดงานทั่วสหรัฐอเมริกาและยุโรป และมันไม่ได้เกี่ยวกับแค่ว่า AI จะมาแย่งงานอะไรจากเราเท่านั้น แต่ยังเกี่ยวกับวิธีที่มันใช้ข้อมูลของเรา ตัดสินใจ และบางครั้งก็ทำผิดพลาดอีกด้วย เรื่องนี้ทำให้ทุกคนตั้งแต่ผู้สร้างเทคโนโลยีไปจนถึงผู้เชี่ยวชาญด้านกฎหมายต้องเร่งหาวิธี จัดการกับ AI อย่างมีความรับผิดชอบ

วิธีแก้ไข

- ชี้แจงกฎระเบียบ: พัฒนาแนวทางที่ชัดเจนและเข้าใจง่ายเกี่ยวกับวิธีการใช้ AI ซึ่งหมายถึงการกำหนดขอบเขตเพื่อป้องกันการนำไปใช้ในทางที่ผิด และทำความเข้าใจถึงผลกระทบทางกฎหมายจากการกระทำของ AI

- เคารพความเป็นส่วนตัว: ข้อมูลจำนวนมหาศาล รวมถึงข้อมูลส่วนบุคคล ถูกนำมาใช้ในการฝึกฝน AI เราจำเป็นต้องระมัดระวังอย่างยิ่งเกี่ยวกับวิธีการเก็บรวบรวม ใช้ และปกป้องข้อมูลเหล่านี้ เรื่องนี้เกี่ยวกับการทำให้แน่ใจว่า AI เคารพความเป็นส่วนตัวของเรา

- ต่อสู้กับความลำเอียง: AI จะดีได้เพียงเท่าข้อมูลที่มันเรียนรู้ และบางครั้งข้อมูลเหล่านี้ก็มีความลำเอียง เราต้องกำจัดความลำเอียงเหล่านี้ออกจากระบบ AI เพื่อให้แน่ใจว่ามันยุติธรรมและไม่เลือกปฏิบัติ

- ปกป้องทรัพย์สินทางปัญญา: AI สามารถสร้างผลงานใหม่โดยอาศัยสิ่งที่ได้เรียนรู้จากผลงานสร้างสรรค์ของผู้อื่น ซึ่งอาจละเมิดลิขสิทธิ์และขโมยผลงานอันควรได้รับจากผู้สร้างสรรค์ หากเราไม่ระมัดระวัง

- จริยธรรม vs. ความเร็ว: ในการแข่งขันอย่างบ้าคลั่งเพื่อนำเทคโนโลยี AI ล่าสุดออกสู่ตลาด จริยธรรมอาจถูกมองข้ามไป เราต้องหาจุดสมดุลระหว่างความต้องการความเร็วกับการทำสิ่งที่ถูกต้อง

7. การผสมผสานชุดข้อมูล AI อาจนำไปสู่หายนะ

เมื่อพัฒนาแบบจำลองการเรียนรู้ของเครื่อง (AI) อาจมีความท้าทายในการแยกแยะอย่างถูกต้องระหว่างชุดข้อมูลสำหรับการฝึกอบรม, ชุดข้อมูลสำหรับการตรวจสอบ, และชุดข้อมูลสำหรับการทดสอบ ชุดข้อมูลสำหรับการฝึกอบรมของแบบจำลอง AI จะสอนให้แบบจำลองเข้าใจ, ชุดข้อมูลสำหรับการตรวจสอบจะปรับแต่งให้เหมาะสม, และชุดข้อมูลสำหรับการทดสอบจะประเมินประสิทธิภาพของมัน

การผิดพลาดนี้อาจทำให้ความสามารถของแบบจำลองในการทำงานอย่างมีประสิทธิภาพในแอปพลิเคชัน AI ในโลกจริงลดลงอย่างรุนแรง ซึ่งความสามารถในการปรับตัวและความถูกต้องบนข้อมูลมาตรฐานเป็นปัจจัยสำคัญ

วิธีแก้ไข

- การแยกข้อมูลโครงสร้าง: ใช้แนวทางที่เป็นระบบในการแบ่งข้อมูลออกเป็นชุดฝึกอบรม ชุดตรวจสอบความถูกต้อง และชุดทดสอบ

- เทคนิคการตรวจสอบความถูกต้องข้ามกลุ่ม: ใช้เทคนิคการตรวจสอบความถูกต้องข้ามกลุ่ม โดยเฉพาะในสถานการณ์ที่มีข้อมูลจำกัด เทคนิคเช่น K-fold cross-validation ช่วยเพิ่มประสิทธิภาพการใช้ข้อมูลในการฝึกฝนและให้การประมาณค่าที่มั่นคงยิ่งขึ้นเกี่ยวกับประสิทธิภาพของแบบจำลองในข้อมูลที่ไม่เคยเห็นมาก่อน

- การสุ่มข้อมูล: ตรวจสอบให้แน่ใจว่าการแบ่งข้อมูลถูกสุ่มอย่างถูกต้องเพื่อป้องกันไม่ให้มีการลำเอียงของระบบ AI เกิดขึ้นจากลำดับของข้อมูล ซึ่งช่วยให้การสร้างชุดข้อมูลสำหรับการฝึกอบรมและชุดข้อมูลสำหรับการตรวจสอบมีความเป็นตัวแทนของข้อมูลทั้งหมดในชุดข้อมูลทั้งหมด

8. ความเสี่ยงและความกังวลเกี่ยวกับการตัดสินใจโดยอัตโนมัติ

เมื่อระบบปัญญาประดิษฐ์ (AI) ตัดสินใจ บางครั้งอาจเกิดปัญหาได้ โดยเฉพาะอย่างยิ่งในสาขาที่มีความสำคัญสูง เช่น การแพทย์และการธนาคาร ปัญหาใหญ่ประการหนึ่งคือเราไม่สามารถมองเห็นได้ว่าระบบ AI ได้ตัดสินใจอย่างไร

สิ่งนี้อาจนำไปสู่ การตัดสินใจที่ไม่เป็นธรรม ที่ไม่มีใครสามารถอธิบายได้ นอกจากนี้ ระบบเหล่านี้ยังเป็นเป้าหมายของแฮกเกอร์ ซึ่งหากพวกเขาสามารถเจาะเข้ามาได้ อาจขโมยข้อมูลสำคัญจำนวนมากไปได้

วิธีแก้ไข

- พัฒนาระบบความปลอดภัยที่แข็งแกร่ง: ตรวจสอบให้แน่ใจว่าระบบ AI ถูกป้องกันอย่างแน่นหนาจากแฮ็กเกอร์ อัปเดตความปลอดภัยอย่างต่อเนื่องเพื่อปิดช่องโหว่ใหม่ ๆ ที่อาจเกิดขึ้น

- เพิ่มความโปร่งใส: ใช้เทคโนโลยีที่ช่วยให้ AI อธิบายการเลือกของมันในคำที่เข้าใจง่าย หากทุกคนเข้าใจว่ามีการตัดสินใจอย่างไร พวกเขาก็จะไว้วางใจ AI มากขึ้น

- ปกป้องข้อมูลส่วนตัว: รักษาความปลอดภัยข้อมูลส่วนบุคคลทั้งหมดที่ AI จัดการ ปฏิบัติตามกฎหมาย เช่น GDPR เพื่อให้แน่ใจว่าความเป็นส่วนตัวของใครก็ตามไม่ถูกละเมิด

- ส่งเสริมความร่วมมือแบบสหสาขาวิชาชีพ: รวบรวมผู้เชี่ยวชาญจากทุกสาขา—เทคโนโลยี, กฎหมาย, จริยธรรม—ให้ทำงานร่วมกัน พวกเขาสามารถช่วยให้มั่นใจว่าการตัดสินใจของ AI เป็นธรรมและปลอดภัย

อ่านเพิ่มเติม:เครื่องมือ AIที่ได้รับความนิยมมากที่สุดสำหรับนักเรียน

9. ขาดกฎระเบียบและข้อบังคับที่ชัดเจนเกี่ยวกับ AI

ขณะนี้ ยังไม่มีองค์กรเฝ้าระวังระดับโลกสำหรับ AI อย่างเดียว; การกำกับดูแลมีความแตกต่างกันตามประเทศ และแม้กระทั่งตามสาขา ตัวอย่างเช่น ไม่มีหน่วยงานกลางที่เฉพาะเจาะจงสำหรับ AI ในสหรัฐอเมริกา

แนวทางแบบกระจายศูนย์นี้อาจนำไปสู่ ความไม่สอดคล้องและความสับสน; มาตรฐานที่แตกต่างกันอาจถูกนำมาใช้ขึ้นอยู่กับสถานที่และวิธีการที่ AI ถูกนำไปใช้ ซึ่งทำให้ผู้พัฒนาและผู้ใช้ AI มีความท้าทายในการรับรองว่าพวกเขาปฏิบัติตามข้อกำหนดในทุกเขตอำนาจศาลอย่างครบถ้วน

วิธีแก้ไข

- จัดตั้งหน่วยงานกำกับดูแล AI โดยเฉพาะ: ประเทศต่างๆ อาจได้รับประโยชน์จากการจัดตั้งหน่วยงานเฉพาะที่มุ่งเน้นด้าน AI หน่วยงานนี้สามารถดูแลประเด็นที่เกี่ยวข้องกับ AI ทั้งหมด ติดตามความก้าวหน้าอย่างรวดเร็วของการพัฒนา AI และรับรองการปฏิบัติตามมาตรฐานด้านความปลอดภัยและจริยธรรม

- ความร่วมมือระหว่างประเทศ: ปัญญาประดิษฐ์ไม่หยุดอยู่แค่พรมแดน ประเทศต่างๆ จำเป็นต้องร่วมมือกันเพื่อสร้างมาตรฐานและข้อตกลงระหว่างประเทศเกี่ยวกับการใช้ปัญญาประดิษฐ์ เช่นเดียวกับที่สนธิสัญญาระหว่างประเทศทำงานเพื่อการปกป้องสิ่งแวดล้อม

- กฎหมายที่ชัดเจนและปรับตัวได้: กฎหมายต้องชัดเจน (เพื่อให้บริษัททราบวิธีการปฏิบัติตาม) แต่ยังต้องยืดหยุ่นเพียงพอที่จะปรับตัวให้เข้ากับความก้าวหน้าใหม่ ๆ ของ AI การปรับปรุงและทบทวนกฎหมาย AI อย่างสม่ำเสมอสามารถช่วยให้กฎหมายยังคงมีความเกี่ยวข้อง

- การมีส่วนร่วมของสาธารณชนและผู้มีส่วนได้ส่วนเสีย: กฎระเบียบควรได้รับการพัฒนาโดยมีข้อมูลจากผู้มีส่วนได้ส่วนเสียที่หลากหลาย รวมถึงบริษัทเทคโนโลยี นักจริยธรรม และประชาชนทั่วไป การทำเช่นนี้จะช่วยให้มั่นใจได้ว่าจะมีการพิจารณาจากมุมมองที่หลากหลาย และทำให้สาธารณชนมีความเชื่อมั่นในระบบ AI มากขึ้น

อ่านเพิ่มเติม:เครื่องมือ AI สำหรับทนายความ

10. ข้อมูลที่ผิดพลาดจาก AI

ลองจินตนาการถึงเทคโนโลยีที่สามารถคิดเหมือนมนุษย์ได้ นั่นคือคำสัญญาของ ปัญญาประดิษฐ์ทั่วไป (AGI) แต่มันมาพร้อมกับความเสี่ยงใหญ่ ข้อมูลที่ผิดพลาดเป็นหนึ่งในปัญหาหลักที่นี่

ด้วย AGI, คุณสามารถสร้าง ข่าวปลอม หรือข้อมูลเท็จที่น่าเชื่อถือได้อย่างง่ายดาย ทำให้ทุกคนยากที่จะแยกแยะว่าอะไรเป็นความจริงและอะไรไม่ใช่

นอกจากนี้ หาก AGI ตัดสินใจโดยอาศัยข้อมูลเท็จนี้ อาจนำไปสู่ผลลัพธ์ที่เลวร้าย ส่งผลกระทบต่อทุกสิ่งตั้งแต่การเมืองไปจนถึงชีวิตส่วนตัว

วิธีแก้ไข

- ตั้งค่าการตรวจสอบที่เข้มงวด: ตรวจสอบข้อเท็จจริงอย่างละเอียดก่อนให้ AGI เผยแพร่ข้อมูล ใช้แหล่งข้อมูลที่เชื่อถือได้และยืนยันรายละเอียดก่อนที่ข้อมูลจะเผยแพร่สู่สาธารณะ

- สอน AGI เกี่ยวกับจริยธรรม: เช่นเดียวกับที่เราสอนเด็กให้รู้ผิดชอบชั่วดี เราจำเป็นต้องสอน AGI เกี่ยวกับพฤติกรรมที่มีจริยธรรม ซึ่งรวมถึงการเข้าใจผลกระทบของการเผยแพร่ข้อมูลเท็จ และการตัดสินใจที่ยุติธรรมและเที่ยงธรรม

- ให้มนุษย์มีส่วนร่วมอยู่เสมอ: ไม่ว่า AGI จะฉลาดแค่ไหนก็ตาม ให้มนุษย์มีส่วนร่วมในกระบวนการตัดสินใจอยู่เสมอ นี่จะช่วยให้สามารถตรวจจับข้อผิดพลาดได้ และทำให้การกระทำของ AGI สะท้อนถึงคุณค่าและจริยธรรมของเรา

- สร้างกฎที่ชัดเจน: กำหนดแนวทางที่เข้มงวดสำหรับสิ่งที่ AGI สามารถทำได้และไม่สามารถทำได้ โดยเฉพาะอย่างยิ่งเมื่อเกี่ยวข้องกับการสร้างและเผยแพร่ข้อมูล ตรวจสอบให้แน่ใจว่ากฎเหล่านี้ถูกปฏิบัติตามอย่างเคร่งครัด

อ่านเพิ่มเติม: พจนานุกรม AIฉบับสมบูรณ์

เครื่องมือสำหรับรับมือกับความท้าทายจาก AI

เมื่อคุณจมอยู่กับ AI การเลือกเครื่องมือที่เหมาะสมไม่ใช่แค่สิ่งที่ควรมี แต่เป็นสิ่งจำเป็นเพื่อให้การเดินทางของคุณกับ AI ไม่กลายเป็นหายนะ มันเกี่ยวกับการทำให้เรื่องซับซ้อนง่ายขึ้น การรักษาความปลอดภัยของข้อมูล และการได้รับการสนับสนุนที่คุณต้องการเพื่อแก้ไขปัญหา AI โดยไม่ต้องเสียเงินมากมาย

กุญแจสำคัญคือการเลือกซอฟต์แวร์ AI ที่ปรับแต่งให้เหมาะสมซึ่งช่วยเพิ่มประสิทธิภาพการทำงานในขณะที่ยังคงปกป้องความเป็นส่วนตัวและความปลอดภัยของข้อมูลของคุณ

เข้าสู่ClickUp Brain, มีดสวิสอาร์มี่สำหรับ AI ในที่ทำงานของคุณ

ClickUp Brain: ประสิทธิภาพ ความปลอดภัย และนวัตกรรม—รวมไว้ในหนึ่งเดียว

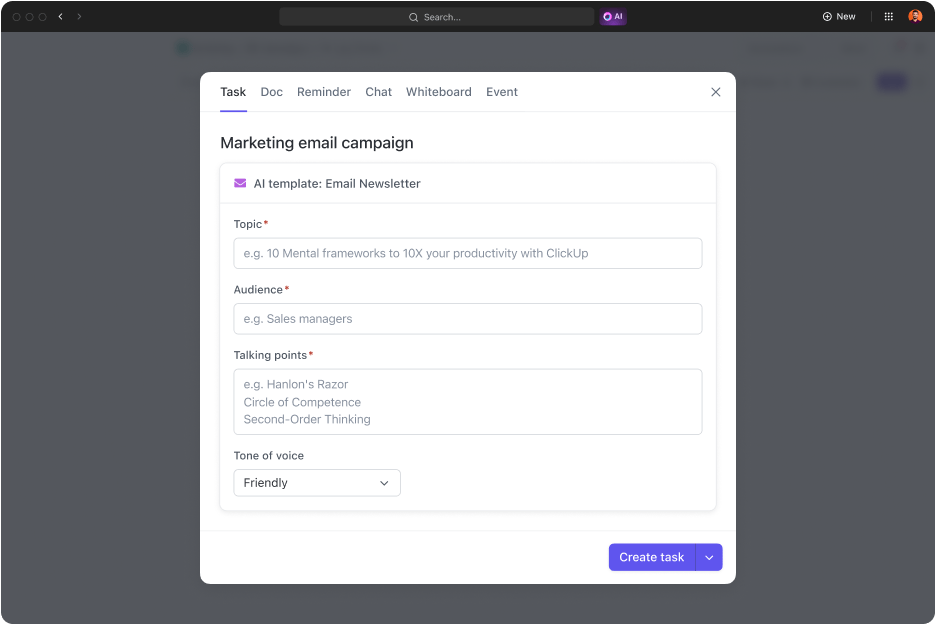

ClickUp Brain ได้รับการออกแบบมาเพื่อจัดการทุกสิ่งที่เกี่ยวข้องกับ AI—ตั้งแต่การจัดการโครงการและเอกสารของคุณไปจนถึงการเพิ่มประสิทธิภาพการสื่อสารในทีม ด้วยความสามารถของ AI ใน ClickUp Brain คุณสามารถแก้ไขปัญหาที่เกี่ยวข้องกับข้อมูล ปรับปรุงการจัดการโครงการ และเพิ่มประสิทธิภาพการทำงาน ทั้งหมดนี้ในขณะเดียวกันก็รักษาความเรียบง่ายและความปลอดภัย ClickUp Brain เป็นโซลูชันที่ครอบคลุมซึ่ง:

- ผสานการทำงานเข้ากับงานประจำวันของคุณได้อย่างไร้รอยต่อ

- รับประกันว่าข้อมูลของคุณยังคงเป็นของคุณเอง

- ประหยัดเงินและทรัพยากรของคุณ

ClickUp Brain ผสานการทำงานเข้ากับกระบวนการทำงานของคุณอย่างชาญฉลาดเพื่อประหยัดเวลาและความพยายามของคุณ พร้อมทั้งปกป้องข้อมูลของคุณอย่างปลอดภัย มันเป็น (เช่นเดียวกับส่วนอื่น ๆ ของแพลตฟอร์ม ClickUp) สอดคล้องกับ GDPR และไม่ใช้ข้อมูลของคุณในการฝึกอบรม

นี่คือวิธีการทำงาน:

- ผู้จัดการความรู้ด้วย AI: เคยต้องการคำตอบที่รวดเร็วและถูกต้องจากเอกสารงานหรือการสนทนาของคุณหรือไม่? ClickUp Brain ทำให้มันเป็นไปได้ ไม่ต้องเสียเวลาค้นหาไฟล์เป็นชั่วโมงอีกต่อไป เพียงแค่ถาม แล้วคุณจะได้รับคำตอบ—ไม่ว่าจะเป็นรายละเอียดจากเอกสารโครงการหรือข้อมูลเชิงลึกจากการอัปเดตของทีมในอดีต

- ผู้จัดการโครงการ AI: จินตนาการถึงการมีผู้ช่วย AI ที่คอยดูแลโครงการของคุณให้อยู่ในเส้นทางที่ถูกต้อง ตั้งแต่การอัปเดตงานอัตโนมัติไปจนถึงการสรุปความคืบหน้าของโครงการ ClickUp Brain จัดการกับส่วนที่น่าเบื่อเพื่อให้คุณสามารถมุ่งเน้นไปที่ภาพรวมได้

- AI Writer สำหรับการทำงาน: เครื่องมือนี้เปลี่ยนเกมสำหรับทุกคนที่เกลียดการเขียน ไม่ว่าคุณจะกำลังร่างอีเมลสั้น ๆ หรือจัดทำรายงานที่ครอบคลุม ClickUp Brain ช่วยปรับปรุงสำนวนของคุณ ตรวจสอบการสะกดคำ และปรับโทนเสียงให้สมบูรณ์แบบ

รับมือกับความท้าทายด้าน AI ด้วยเครื่องมือที่เหมาะสม

แม้จะมีความท้าทายด้าน AI ที่เราได้พูดคุยกัน แต่เราสามารถเห็นพ้องต้องกันว่าปัญญาประดิษฐ์ได้พัฒนาไปไกลมากแล้ว มันได้วิวัฒนาการจากระบบอัตโนมัติพื้นฐานไปสู่ระบบที่ซับซ้อนซึ่งสามารถเรียนรู้ ปรับตัว และคาดการณ์ผลลัพธ์ได้ หลายคนในพวกเราได้ผสาน AI เข้ากับแง่มุมต่างๆ ของชีวิตแล้ว ตั้งแต่ผู้ช่วยเสมือนไปจนถึงเครื่องมือการเก็บรวบรวมและวิเคราะห์ข้อมูลขั้นสูง

เมื่อปัญญาประดิษฐ์ก้าวหน้าไปมากขึ้น เราสามารถคาดหวังได้ว่าจะมีการนวัตกรรมใหม่ ๆการแฮ็กปัญญาประดิษฐ์ และเครื่องมือปัญญาประดิษฐ์ที่ช่วยเพิ่มประสิทธิภาพการทำงาน ปรับปรุงการตัดสินใจ และปฏิวัติวงการต่าง ๆ ได้มากขึ้น ความก้าวหน้านี้เปิดโอกาสใหม่ ๆ ให้เราได้ก้าวไปสู่โลกอนาคตที่ปัญญาประดิษฐ์มีบทบาทสำคัญทั้งในชีวิตส่วนตัวและอาชีพการงาน

ด้วยเครื่องมือ AIอย่าง ClickUp Brain คุณสามารถใช้ประโยชน์จากเทคโนโลยี AI ได้อย่างเต็มที่ พร้อมทั้งปกป้องตัวเองจากปัญหาด้านความเป็นส่วนตัวและความปลอดภัยของข้อมูลที่อาจเกิดจาก AI ClickUp คือเครื่องมือจัดการงานที่ขับเคลื่อนด้วย AI ที่คุณไว้วางใจได้ สำหรับทุกงานตั้งแต่โครงการซอฟต์แวร์ไปจนถึงการตลาด เลือก ClickUp เพื่อเปลี่ยนองค์กรของคุณให้กลายเป็นองค์กรที่ขับเคลื่อนด้วยข้อมูลและ AI อย่างปลอดภัย ในขณะเดียวกันก็เพิ่มประสิทธิภาพการทำงานของทีมให้เติบโตยิ่งขึ้น

พร้อมที่จะเปลี่ยนแปลงกระบวนการทำงานของคุณด้วย AI หรือยัง?สมัครใช้ ClickUp ตอนนี้เลย!