Pernahkah model AI Anda memberikan jawaban yang meyakinkan yang disebut ketinggalan zaman oleh pengguna Anda? Itulah jenis pengalaman yang berakhir dengan tim Anda mempertanyakan setiap responsnya.

Kedengarannya seperti mimpi buruk bagi setiap pengembang dan penggemar AI, bukan?

Model bahasa besar (LLM) berjalan pada data pelatihan, tetapi seiring bertambahnya usia data, ketidakakuratan akan muncul. Karena pelatihan ulang membutuhkan biaya jutaan dolar, maka pengoptimalan adalah langkah yang lebih cerdas.

Retrieval Augmented Generation (RAG) dan fine-tuning adalah kerangka kerja teratas untuk meningkatkan akurasi. Namun, mengingat perbedaan antara masing-masing pendekatan, keduanya ideal untuk aplikasi yang berbeda. Kerangka kerja yang tepat adalah kunci untuk meningkatkan LLM Anda secara efektif.

Tapi mana yang tepat untuk Anda?

Artikel ini membahas dilema dalam panduan RAG vs. fine-tuning. Baik Anda bekerja dengan data khusus domain atau ingin membangun solusi pengambilan data berkualitas tinggi, Anda akan menemukan jawabannya di sini!

rangkuman 60 Detik

- Meningkatkan performa LLM dan model AI adalah bagian penting dari setiap fungsi bisnis dan pengembangan. Meskipun RAG dan fine-tuning merupakan pendekatan yang populer, penting untuk memahami nuansa dan dampaknya

- RAG melengkapi LLM dengan pengambilan data eksternal secara real-time, sehingga mengurangi biaya pelatihan ulang

- Fine-tuning mengoptimalkan LLM dengan melatih set data khusus, meningkatkan akurasi untuk tugas-tugas khusus domain

- RAG paling baik untuk lingkungan data yang berubah dengan cepat seperti keuangan, pembaruan hukum, dan dukungan pelanggan

- Penyempurnaan sangat ideal untuk AI khusus merek, industri dengan tingkat kepatuhan yang tinggi, dan analisis sentimen

- ClickUp Brain memadukan keduanya, menggunakan RAG untuk wawasan kontekstual dan fine-tuning untuk otomatisasi yang disesuaikan dan pembuatan konten

- Alat bantu bertenaga AI dari ClickUp meningkatkan pengambilan pengetahuan, otomatisasi alur kerja, dan manajemen proyek untuk efisiensi terbaik

Apa yang dimaksud dengan Retrieval-Augmented Generation (RAG)?

Melihat laporan dan survei terbaru yang terlewatkan oleh LLM Anda? Di situlah Anda membutuhkan RAG. Untuk memahami hal ini dengan lebih baik, mari kita bahas dasar-dasar pendekatan ini.

Definisi RAG

RAG adalah kerangka kerja AI yang melibatkan pengambilan informasi tambahan untuk LLM Anda untuk meningkatkan akurasi respons. Sebelum membuat respons LLM, RAG mengambil data yang paling relevan dari sumber eksternal, seperti sumber pengetahuan atau database.

Anggap saja sebagai asisten peneliti dalam model LLM atau AI generatif.

👀 Tahukah Anda LLM, terutama generator teks, dapat berhalusinasi dengan menghasilkan informasi yang salah namun masuk akal. Semua itu karena adanya kesenjangan dalam data pelatihan.

Keuntungan utama dari RAG

Mungkin sudah jelas sekarang. RAG adalah lapisan tambahan dari AI terkoneksi yang dibutuhkan oleh proses bisnis Anda. Untuk menyoroti potensinya, berikut ini adalah keuntungan yang ditawarkannya:

- Mengurangi biaya pelatihan: Mengurangi kebutuhan untuk pelatihan ulang model yang sering dengan pengambilan informasi yang dinamis. Hal ini mengarah pada penerapan AI yang lebih hemat biaya, terutama untuk domain dengan data yang berubah dengan cepat

- Skalabilitas: Memperluas pengetahuan LLM tanpa meningkatkan ukuran sistem utama. Mereka membantu bisnis menskalakan, mengelola kumpulan data yang besar, dan menjalankan lebih banyak kueri tanpa biaya komputasi yang tinggi

- Pembaruan waktu nyata: Mencerminkan informasi terbaru dalam setiap respons dan menjaga model tetap relevan. Memprioritaskan akurasi melalui pembaruan waktu nyata sangat penting dalam banyak operasi, termasuk analisis keuangan, perawatan kesehatan, dan audit kepatuhan

📮 ClickUp Insight: Setengah dari responden kami kesulitan dengan adopsi AI; 23% tidak tahu harus memulai dari mana, sementara 27% membutuhkan lebih banyak pelatihan untuk melakukan sesuatu yang lebih lanjut.

ClickUp memecahkan masalah ini dengan antarmuka obrolan yang familiar yang terasa seperti mengirim pesan. Tim dapat langsung mengajukan pertanyaan dan permintaan sederhana, lalu secara alami menemukan fitur otomatisasi dan alur kerja yang lebih kuat sambil berjalan tanpa kurva pembelajaran yang mengintimidasi yang membuat banyak orang ragu.

Kasus penggunaan RAG

Ingin tahu di mana keunggulan RAG? Pertimbangkan beberapa kasus penggunaan utama ini:

Chatbot dan dukungan pelanggan

Pertanyaan pelanggan sering kali membutuhkan tanggapan yang terkini dan sesuai konteks. RAG meningkatkan kemampuan chatbot dengan mengambil artikel dukungan, kebijakan, dan langkah pemecahan masalah terbaru.

Hal ini memungkinkan bantuan yang lebih akurat dan real-time tanpa pra-pelatihan yang ekstensif.

Pengambilan dokumen dinamis

RAG mengoptimalkan pencarian dokumen dengan menarik bagian yang paling relevan dari repositori yang sangat luas. Alih-alih ringkasan umum, LLM dapat memberikan jawaban yang tepat dari manual, makalah penelitian, atau dokumen hukum yang telah diperbarui.

Mengadopsi LLM yang didukung RAG membuat pengambilan informasi menjadi lebih cepat dan tepat.

Fakta Menarik: Meta, yang memiliki Facebook, Instagram, Threads, dan WhatsApp, memperkenalkan RAG ke dalam pengembangan LLM pada tahun 2020.

Apa yang dimaksud dengan Fine-Tuning?

Mari kita bahas apa yang dilakukan oleh fine-tuning.

Definisi fine-tuning

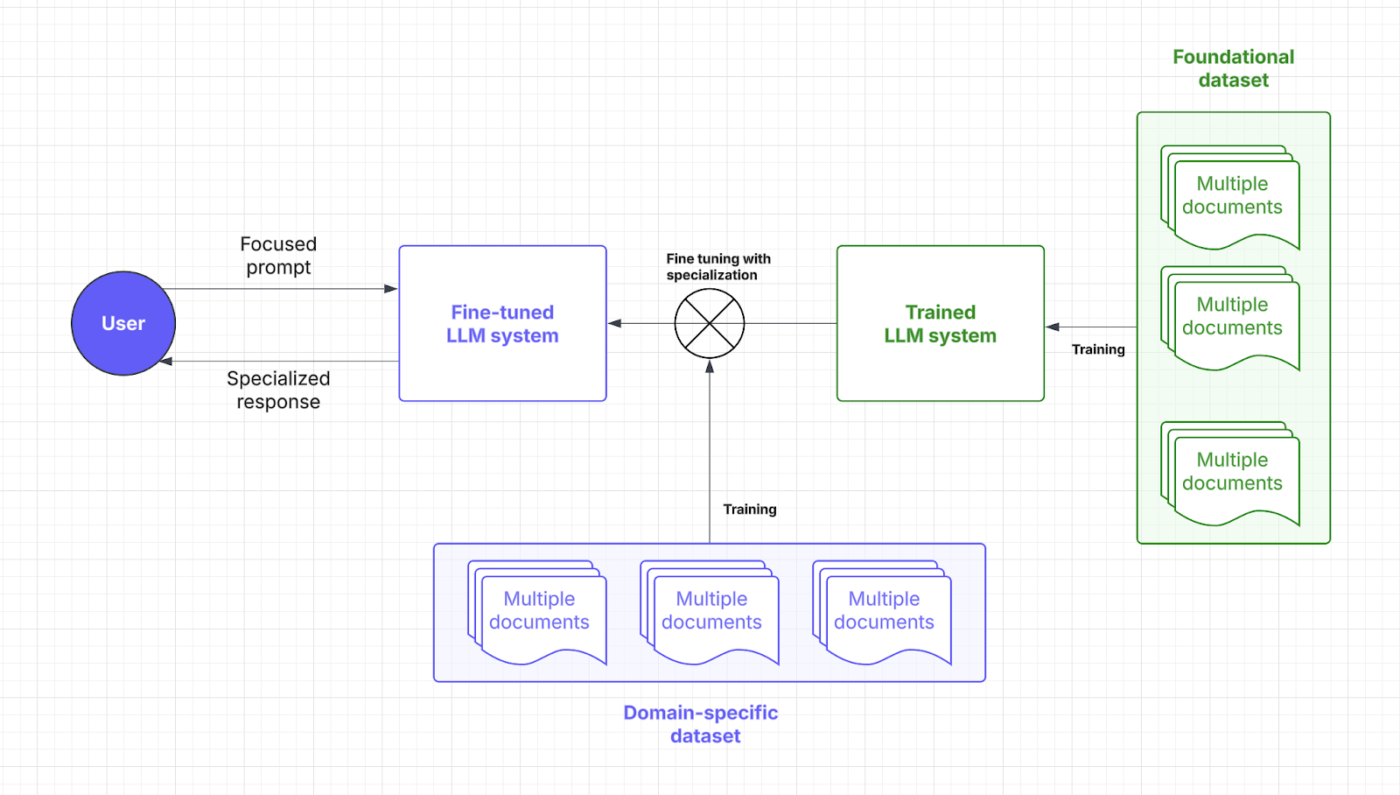

Fine-tuning melibatkan pelatihan model bahasa yang telah dilatih sebelumnya. Ya, banyak pelatihan, yang dapat dijelaskan melalui titik dan fokus.

🧠 Tahukah Anda: Dalam pelatihan Large Language Model (LLM), "bobot" adalah parameter yang dapat disesuaikan dalam jaringan saraf yang menentukan kekuatan koneksi antara neuron, yang pada dasarnya menyimpan informasi yang dipelajari; proses pelatihan mengoptimalkan bobot ini untuk meminimalkan kesalahan prediksi.

"Fokus", di sisi lain, mencakup beberapa aspek: melibatkan kurasi data yang cermat untuk memastikan kualitas dan relevansi, pemanfaatan mekanisme perhatian untuk memprioritaskan segmen input yang relevan, dan penyempurnaan yang ditargetkan untuk mengkhususkan model untuk tugas-tugas tertentu.

Melalui kumpulan data khusus, fine-tuning memungkinkan model AI mempersempit eksekusi tugas-tugas spesifik domain. Dengan menyesuaikan bobot dan fokus model, LLM Anda akan mendapatkan pemahaman dan akurasi yang lebih kontekstual.

Pikirkan tentang menyempurnakan gelar master yang dibutuhkan LLM Anda untuk berbicara dalam bahasa industri Anda. Mari kita tinjau di mana strategi AI ini memasuki proses respons yang cepat:

Manfaat fine-tuning

Teknik fine-tuning hanyalah penyempurnaan AI. Ini lebih seperti kemampuan untuk memperbesar detail yang sudah ditentukan sebelumnya. Berikut ini adalah manfaat yang menyertainya:

- Pengoptimalan khusus untuk tugas tertentu: Kumpulan data khusus mempertajam respons LLM untuk tugas-tugas tertentu. Ingin membantu pengguna agar tidak perlu pusing dengan permintaan yang rumit? Penyempurnaan membantu pengembang mendapatkan solusi AI yang disesuaikan

- Peningkatan akurasi untuk aplikasi khusus: Pengetahuan domain mengurangi kesalahan dan meningkatkan ketepatan setiap respons. Penyempurnaan juga meningkatkan keandalan LLM, sehingga bisnis tidak perlu lagi melakukan manajemen mikro dan pengawasan manual

- Penyesuaian untuk suara merek dan kepatuhan: Penyempurnaan mengajarkan istilah, gaya, dan peraturan perusahaan kepada LLM. Hal ini mempertahankan suara merek yang konsisten dan kepatuhan khusus industri

Kasus penggunaan fine-tuning

Proses fine-tuning Anda membuka efisiensi yang ditargetkan. Di sinilah keunggulannya:

Sistem QA khusus domain

Industri seperti hukum, kesehatan, dan keuangan mengandalkan respons AI yang tepat dan sadar domain. Fine-tuning melengkapi LLM dengan pengetahuan khusus, memastikan jawaban pertanyaan yang akurat (QA).

Asisten AI hukum, misalnya, dapat menafsirkan kontrak dengan lebih tepat, sementara chatbot medis dapat memberikan panduan berbasis gejala menggunakan kumpulan data tepercaya.

Analisis Sentimen dan alur kerja khusus

Bisnis menggunakan model fine-tuned untuk memantau merek, menganalisis umpan balik pelanggan, dan mengotomatiskan alur kerja yang disesuaikan dengan kebutuhan operasional yang unik. Alat yang didukung AI dapat mendeteksi sentimen bernuansa dalam ulasan produk, sehingga membantu perusahaan menyempurnakan penawaran mereka.

Di bidang SDM, menggabungkan fine-tuning dengan pemrosesan bahasa alami membantu AI menganalisis survei karyawan dan menandai masalah di tempat kerja dengan kesadaran kontekstual yang lebih besar.

💡 Kiat Pro: Penyempurnaan dapat melibatkan penambahan data yang lebih beragam untuk menghilangkan potensi bias. Hal ini tidak sepenuhnya spesifik untuk domain tertentu, tetapi tetap merupakan aplikasi yang penting.

Perbandingan: RAG vs Fine-Tuning

Tidak dapat disangkal bahwa kedua strategi AI bertujuan untuk meningkatkan kinerja.

Namun, memilihnya tampaknya masih cukup rumit, bukan? Berikut ini adalah uraian tentang fine-tuning vs RAG untuk membantu Anda membuat keputusan yang tepat untuk investasi LLM Anda.

| Aspek | RAG (Pengambilan-pembangkitan yang ditingkatkan) | Penyetelan halus |

| Definisi | Memungkinkan LLM untuk mengambil data yang relevan dan real-time dari sumber eksternal dengan sistem khusus | Melatih model yang telah dilatih sebelumnya dengan set data khusus untuk tugas-tugas khusus domain |

| Performa dan akurasi | Sangat bagus untuk pengambilan data waktu nyata, tetapi keakuratannya bergantung pada kualitas data eksternal | Meningkatkan akurasi kontekstual dan respons spesifik tugas |

| Persyaratan biaya dan sumber daya | Fokus di muka yang lebih hemat biaya pada akses data real-time | Membutuhkan lebih banyak sumber daya untuk pelatihan awal, tetapi hemat biaya dalam jangka panjang |

| Pemeliharaan dan skalabilitas | Sangat terukur dan fleksibel, tetapi tergantung pada frekuensi pembaruan ke sumber eksternal | Membutuhkan pembaruan dan pemeliharaan yang sering tetapi menawarkan kinerja jangka panjang yang stabil |

| Gunakan kasus | Chatbot, pengambilan dokumen dinamis, analisis waktu nyata | Sistem QA khusus domain, analisis sentimen, dan kustomisasi suara merek |

| Kapan harus memilih | Data yang berubah dengan cepat, pembaruan waktu nyata, dan memprioritaskan biaya sumber daya | Segmen pelanggan khusus, logika khusus domain, kustomisasi khusus merek |

| Ideal untuk | Industri membutuhkan informasi yang akurat dan real-time (keuangan, hukum, dukungan pelanggan) | Industri yang membutuhkan bahasa, kepatuhan, atau konteks tertentu (perawatan kesehatan, hukum, SDM) |

Perlu lebih banyak kejelasan untuk menghilangkan keraguan Anda? Berikut ini adalah penjelasan mengenai aspek-aspek utama yang memengaruhi kebutuhan Anda.

Performa dan akurasi

Dalam hal performa, RAG memainkan peran kunci dengan menarik data baru dari sumber eksternal. Keakuratan dan waktu responsnya bergantung pada kualitas data ini. Ketergantungan pada basis data eksternal ini memungkinkan RAG untuk memberikan informasi terkini secara efektif.

Di sisi lain, fine-tuning meningkatkan cara model memproses dan merespons melalui pelatihan ulang khusus. Proses ini menghasilkan respons yang lebih akurat secara kontekstual, terutama untuk aplikasi khusus. LLM yang disetel dengan baik sangat ideal untuk menjaga konsistensi dalam industri dengan persyaratan yang ketat, seperti perawatan kesehatan atau keuangan.

Intinya: RAG sangat bagus untuk data waktu nyata dan penyempurnaan untuk respons yang akurat secara kontekstual.

Seorang pengguna Reddit mengatakan,

Jika Anda menggunakan model kecil dan basis data yang baik dalam pipeline RAG, Anda dapat menghasilkan set data berkualitas tinggi, lebih baik daripada menggunakan output dari AI berkualitas tinggi.

Jika Anda menggunakan model kecil dan basis data yang baik dalam pipeline RAG, Anda dapat menghasilkan set data berkualitas tinggi, lebih baik daripada menggunakan output dari AI berkualitas tinggi.

💡 Kiat Pro: Untuk memandu LLM Anda menuju output tertentu, fokuslah pada rekayasa yang efektif dan cepat.

Persyaratan biaya dan sumber daya

RAG biasanya lebih hemat biaya di awal karena hanya menambahkan lapisan untuk pengambilan data eksternal. Dengan menghindari kebutuhan untuk melatih ulang seluruh model, RAG muncul sebagai opsi yang jauh lebih ramah anggaran, terutama di lingkungan yang dinamis. Namun, biaya operasional untuk akses dan penyimpanan data secara real-time dapat bertambah.

Fine-tuning membutuhkan lebih banyak persiapan set data dan sumber daya pelatihan, tetapi merupakan investasi jangka panjang. Setelah disempurnakan, LLM membutuhkan lebih sedikit pembaruan, sehingga menghasilkan kinerja yang dapat diprediksi dan penghematan biaya. Pengembang harus mempertimbangkan investasi awal terhadap biaya operasional yang sedang berjalan.

Intinya: RAG hemat biaya, mudah diterapkan, dan memiliki manfaat yang cepat. Fine-tuning membutuhkan sumber daya yang intensif di awal, namun meningkatkan kualitas LLM dan menghemat biaya operasional dalam jangka panjang.

💡 Kiat Pro: Sistem RAG Anda hanya secerdas data yang diambilnya. Jaga kebersihan sumber Anda dan kemas dengan data yang akurat dan terkini!

Pemeliharaan dan skalabilitas

RAG menawarkan skalabilitas yang sangat baik karena fokusnya terutama pada perluasan sumber eksternal. Fleksibilitas dan kemampuan beradaptasi membuatnya sempurna untuk industri yang bergerak cepat. Namun, pemeliharaan tergantung pada frekuensi pembaruan ke database eksternal.

Fine-tuning membutuhkan pemeliharaan yang cukup sering, terutama ketika informasi spesifik domain berubah. Meskipun menuntut lebih banyak sumber daya, ini memberikan konsistensi yang lebih besar dari waktu ke waktu dan secara bertahap membutuhkan lebih sedikit penyesuaian. Meskipun demikian, skalabilitas untuk fine-tuning jauh lebih kompleks, melibatkan kumpulan data yang lebih luas dan beragam.

Intinya: RAG paling baik untuk penskalaan cepat dan fine-tuning untuk pemeliharaan minimal dan kinerja yang stabil.

Seorang pengguna Reddit menambahkan,

Ketika tugas kecil, sering kali lebih efisien untuk mendapatkan model yang lebih besar daripada menyempurnakan model yang lebih kecil.

Ketika tugas kecil, sering kali lebih efisien untuk mendapatkan model yang lebih besar daripada menyempurnakan model yang lebih kecil.

👀 Tahukah Anda Ada solusi AI yang dapat mencium bau sekarang. Dengan betapa kompleksnya wewangian, itu berarti banyak penyempurnaan rutin dan pengambilan data yang rumit.

Pendekatan Mana yang Tepat untuk Kasus Penggunaan Anda?

Meskipun sudah memahami nuansanya, membuat keputusan mungkin terasa hampa tanpa referensi atau konteks yang jelas. Mari kita jalankan beberapa skenario bisnis yang menyoroti bagaimana setiap model AI bekerja lebih baik.

Kapan harus memilih RAG

RAG membantu memberikan fakta dan informasi yang tepat kepada LLM Anda, termasuk standar teknis, catatan penjualan, umpan balik pelanggan, dan banyak lagi.

Bagaimana Anda memanfaatkannya? Pertimbangkan skenario berikut ini untuk mengadopsi RAG ke dalam operasi Anda:

Kasus penggunaan #1: Analisis waktu nyata

- Skenario: Sebuah perusahaan fintech menyediakan wawasan pasar bertenaga AI untuk para trader. Pengguna bertanya tentang tren saham, dan sistem harus mengambil laporan pasar terbaru, pengajuan SEC, dan berita

- Mengapa RAG menang: Pasar saham bergerak cepat, sehingga melatih ulang model AI secara terus-menerus akan menjadi mahal dan tidak efisien. RAG menjaga semuanya tetap tajam dengan hanya menarik data keuangan terbaru, memangkas biaya, dan meningkatkan akurasi

- Aturan praktis: RAG harus menjadi strategi utama Anda untuk AI yang menangani data yang berubah dengan cepat. Aplikasi yang populer adalah analisis data media sosial, pengoptimalan energi, deteksi ancaman keamanan siber, dan pelacakan pesanan

Kasus Penggunaan #2: Pemeriksaan data dan kepatuhan terhadap peraturan

- Skenario: Asisten AI hukum membantu pengacara menyusun kontrak dan memverifikasi kepatuhan terhadap hukum yang terus berkembang dengan menarik undang-undang, preseden, dan putusan terbaru

- Mengapa RAG menang: Memverifikasi aspek hukum dan komersial tidak memerlukan pembaruan perilaku yang mendalam. RAG melakukan pekerjaan dengan cukup baik dengan menarik teks hukum dari kumpulan data pusat secara real time

- Aturan praktis: RAG unggul dalam hal sumber daya dan wawasan yang digerakkan oleh statistik. Cara terbaik untuk memaksimalkannya adalah dengan menggunakan asisten AI medis untuk rekomendasi perawatan dan chatbot pelanggan untuk pemecahan masalah dan pembaruan kebijakan

Masih bertanya-tanya apakah Anda memerlukan RAG dalam LLM Anda? Berikut daftar periksa singkatnya:

- Apakah Anda memerlukan data baru yang berkualitas tinggi tanpa mengubah LLM itu sendiri?

- Apakah informasi Anda sering berubah?

- Apakah LLM Anda perlu bekerja dengan informasi dinamis, bukan data pelatihan statis?

- Apakah Anda ingin menghindari biaya besar dan pelatihan ulang model yang memakan waktu?

➡️ Baca juga: Alat Rekayasa Prompt Terbaik untuk AI Generatif

Ketika Fine-tuning lebih efektif

Seperti yang telah kami sebutkan sebelumnya, fine-tuning adalah sekolah lanjutan AI. LLM Anda bahkan dapat mempelajari istilah-istilah industri. Berikut ini adalah sorotan dari sudut pandang industri tentang kapan LLM benar-benar bersinar:

Kasus penggunaan #1: Menambahkan suara dan nada suara merek

- Skenario: Sebuah merek mewah menciptakan AI concierge untuk berinteraksi dengan pelanggan dengan nada yang halus dan eksklusif. Nada suara, frasa, dan nuansa emosional yang spesifik untuk merek tersebut harus diwujudkan

- Mengapa fine-tuning menang: Fine-tuning membantu model AI menangkap dan mereplikasi suara dan nada unik merek. Ini memberikan pengalaman yang konsisten di setiap interaksi

- Aturan praktis: Fine-tuning lebih efektif jika LLM Anda harus beradaptasi dengan keahlian tertentu. Ini ideal untuk game imersif yang berorientasi pada genre, penceritaan tematik dan empati, atau bahkan salinan pemasaran bermerek

Fakta Menarik: LLM yang terlatih dalam keterampilan lunak tersebut unggul dalam menganalisis sentimen dan kepuasan karyawan. Namun, hanya 3% bisnis yang saat ini menggunakan AI generatif dalam HR.

Kasus penggunaan #2: Moderasi konten dan wawasan berbasis konteks

- Skenario: Sebuah platform media sosial menggunakan model AI untuk mendeteksi konten berbahaya. Model ini berfokus pada pengenalan bahasa khusus platform, bahasa gaul yang muncul, dan pelanggaran yang peka terhadap konteks

- Mengapa fine-tuning menang: Keterampilan lunak seperti penyusunan kalimat sering kali berada di luar cakupan sistem RAG. Penyempurnaan meningkatkan pemahaman LLM tentang nuansa spesifik platform dan jargon industri, terutama moderasi konten yang relevan

- Aturan praktis: Memilih fine-tuning adalah hal yang bijaksana ketika berhadapan dengan perbedaan budaya atau wilayah. Hal ini juga berlaku untuk beradaptasi dengan istilah-istilah khusus industri seperti istilah medis, hukum, atau teknis

Akan menyempurnakan LLM Anda? Tanyakan pada diri Anda beberapa petunjuk penting ini:

- Apakah LLM Anda perlu disampaikan kepada segmen pelanggan khusus atau tema merek?

- Apakah Anda ingin menambahkan data kepemilikan atau data khusus domain ke dalam logika LLM?

- Apakah Anda memerlukan respons yang lebih cepat tanpa kehilangan akurasi?

- Apakah LLM Anda memberikan solusi offline?

- Dapatkah Anda mengalokasikan sumber daya khusus dan daya komputasi untuk pelatihan ulang?

Meningkatkan pengalaman pengguna memang bagus. Namun, banyak bisnis juga membutuhkan AI sebagai pendorong produktivitas untuk menjustifikasi biaya investasi yang tinggi. Itulah mengapa mengadopsi model AI yang sudah terlatih sering kali menjadi pilihan utama bagi banyak perusahaan.

Tahukah Anda? Gen AI memiliki potensi untuk mengotomatisasi aktivitas kerja yang menghemat hingga 70 persen waktu karyawan. Meminta wawasan dari AI secara efektif memainkan peran besar di sini!

Bagaimana ClickUp Memanfaatkan Teknik AI Tingkat Lanjut

Memilih antara RAG dan fine-tuning adalah perdebatan yang cukup besar.

Bahkan membaca beberapa thread Reddit saja sudah cukup untuk membuat Anda bingung. Tapi siapa bilang Anda harus memilih salah satu?

Bayangkan memiliki model AI yang dapat disesuaikan, otomatisasi, dan manajemen tugas di satu tempat. Itulah ClickUp, aplikasi segalanya untuk bekerja. Aplikasi ini menyatukan manajemen proyek, dokumentasi, dan komunikasi tim di bawah satu atap dan didukung oleh AI generasi berikutnya.

Singkatnya, aplikasi ini unggul dalam segala hal, terutama dengan solusi AI yang komprehensif: ClickUp Brain.

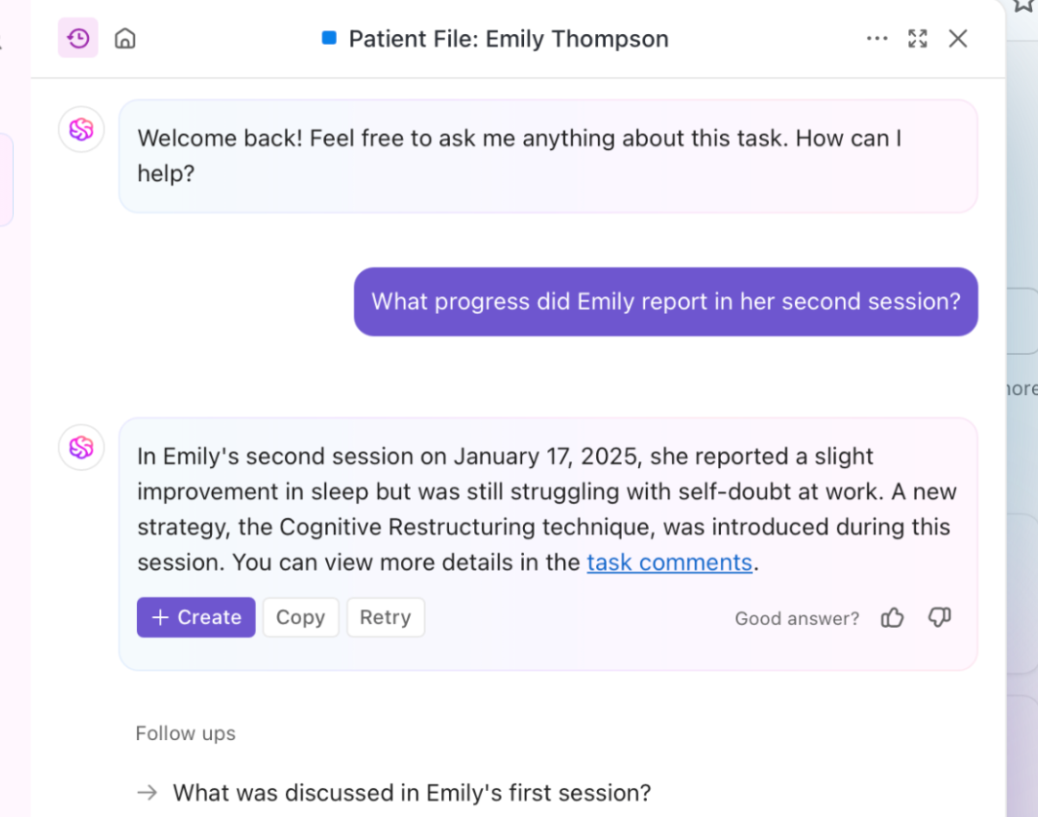

Butuh wawasan yang cepat dan sesuai konteks? Brain menarik informasi waktu nyata dari dokumen, tugas, dan sumber daya Anda. Itulah yang membuat RAG bekerja dengan sangat baik. Selain itu, LLM dasarnya, Brain, dapat menghasilkan laporan dan pembaruan proyek rutin.

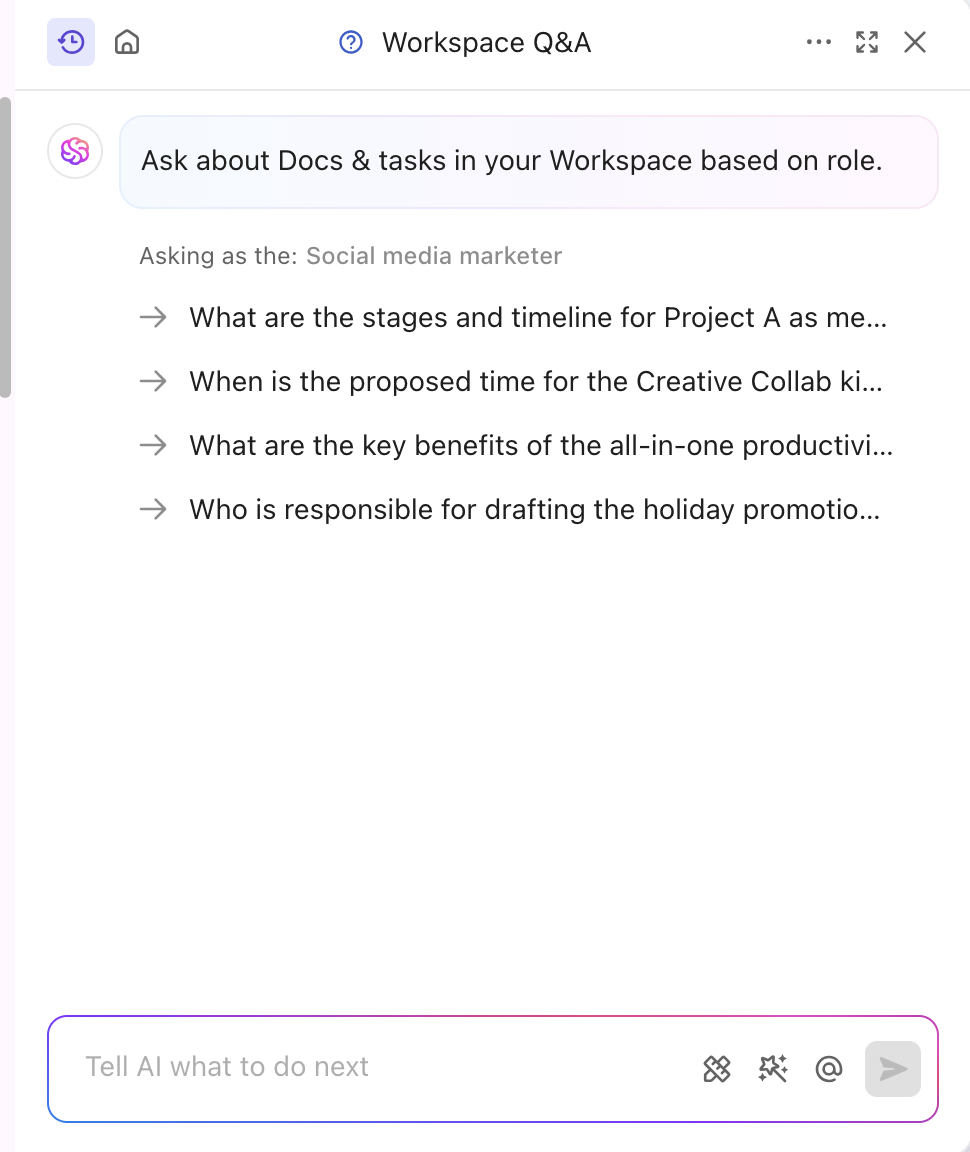

Alat AI juga disesuaikan agar sesuai dengan industri dan segmen Anda, memberikan wawasan profesional dan kreatif. Alat ini bahkan mempersonalisasi konten secara real time tanpa pelatihan manual. Brain memadukan fine-tuning dan RAG untuk mengotomatiskan pembaruan proyek, penugasan tugas, dan pemberitahuan alur kerja. Ingin tanggapan yang disesuaikan dengan peran Anda? ClickUp Brain juga bisa melakukannya!

Selain berspesialisasi dalam konten, ClickUp juga memperkuat platformnya dengan fitur AI berbasis pengetahuan yang kuat.

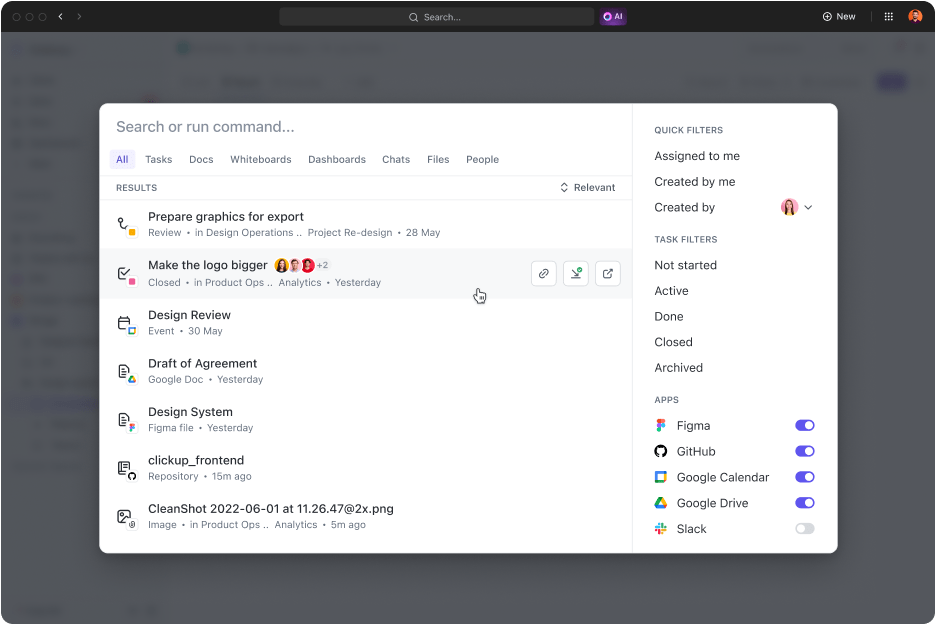

ClickUp Connected Search adalah alat bertenaga AI yang dengan cepat mengambil sumber daya apa pun dari ruang terintegrasi Anda. Apakah Anda memerlukan dokumen untuk presentasi hari ini atau jawaban untuk tugas apa pun, kueri sederhana akan menampilkan tautan sumber, kutipan, dan wawasan terperinci.

Aplikasi ini juga meluncurkan aplikasi, mencari riwayat clipboard Anda, dan membuat cuplikan. Bagian terbaiknya? Semua itu dapat diakses dengan satu klik dari pusat perintah, bilah tindakan, atau desktop.

Pakar pemasaran digital, presiden Hum JAM bahkan mengatakan,

ClickUp adalah alat otomatisasi tim "all-in-one" yang paling menakjubkan yang akan melacak, mengotomatisasi, dan mengukur kesuksesan tim. Percayalah ketika saya mengatakan bahwa tim Anda tidak bisa hidup tanpa alat ini.

ClickUp adalah alat otomatisasi tim "all-in-one" yang paling menakjubkan yang akan melacak, mengotomatisasi, dan mengukur kesuksesan tim. Percayalah ketika saya mengatakan bahwa tim Anda tidak bisa hidup tanpa alat ini.

➡️ Baca juga: Perbedaan Antara Pembelajaran Mesin & Kecerdasan Buatan

Meningkatkan Akurasi Gen AI dan LLM dengan ClickUp

Respons daya RAG, yang dipertajam dengan data eksternal baru dan fine-tuning, digunakan untuk tugas dan perilaku tertentu. Keduanya meningkatkan kinerja AI, tetapi pendekatan yang tepat menentukan kecepatan dan efisiensi Anda.

Dalam industri yang dinamis, keputusan sering kali bermuara pada metode mana yang harus diadopsi terlebih dahulu. Solusi terlatih yang kuat biasanya merupakan pilihan yang lebih bijaksana.

Jika Anda ingin meningkatkan kualitas layanan dan produktivitas, ClickUp adalah mitra yang tepat. Kemampuan AI-nya mendorong pembuatan konten, pengambilan data, dan respons analitis. Selain itu, platform ini dilengkapi dengan 30+ alat yang mencakup segalanya, mulai dari manajemen tugas hingga menghasilkan visual yang memukau.

Daftar dengan ClickUp hari ini!