AI-bias kan verka som ett tekniskt problem. Men dess effekter visar sig i den verkliga världen och kan ofta vara förödande.

När ett AI-system lutar åt fel håll, även om det bara är lite, kan det leda till orättvisa resultat.

Med tiden kan dessa små problem leda till frustrerade kunder, reputationsproblem eller till och med compliancefrågor som du inte förutsåg.

De flesta team har inte för avsikt att skapa partisk AI. Det händer eftersom data är röriga, den verkliga världen är ojämn och de verktyg vi använder inte alltid fungerar som vi förväntar oss. Den goda nyheten är att du inte behöver vara datavetare för att förstå vad som händer.

I den här bloggen går vi igenom vad AI-bias egentligen är, varför det uppstår och hur det kan yttra sig i vardagliga affärsverktyg.

Vad är AI-bias?

AI-fördomar uppstår när ett artificiellt intelligenssystem producerar systematiska, orättvisa resultat som konsekvent gynnar eller missgynnar vissa grupper av människor. Det handlar inte bara om slumpmässiga fel, utan om förutsägbara mönster som blir en del av hur AI fattar beslut. Orsaken? AI lär sig av data som speglar befintliga mänskliga fördomar, andra omedvetna fördomar och samhälleliga ojämlikheter.

Tänk på det så här: om du tränar en anställningsalgoritm på tio års företagsdata där 90 % av cheferna var män, kan AI felaktigt lära sig att det är en viktig kvalifikation för en chefsroll att vara man. AI är inte illvillig, utan identifierar och upprepar helt enkelt de mönster som den har visats.

Här är vad som gör AI-bias så knepigt:

- Det är systematiskt, inte slumpmässigt: Orättvisan är inte en engångsföreteelse utan ett återkommande mönster i AI:s resultat.

- Det är ofta osynligt: Partiska resultat kan döljas bakom den komplexa matematiken i en till synes neutral algoritm, vilket gör dem svåra att upptäcka.

- Det har sin grund i data och design: Fördomar kommer in i systemet genom de val vi människor gör när vi bygger och tränar AI.

⭐ Utvald mall

ClickUps mall för incidenthanteringsrapport erbjuder en färdig struktur för att dokumentera, spåra och lösa incidenter från början till slut. Registrera alla relevanta incidentdetaljer, upprätthåll tydligt kategoriserade statusar och fånga upp viktiga attribut som allvarlighetsgrad, berörda grupper och åtgärdssteg. Den stöder anpassade fält för saker som Godkänd av, Incidentanteckningar och Stödjande dokument, vilket hjälper till att synliggöra ansvar och bevis under hela granskningsprocessen.

Varför det är viktigt att minska AI-bias

När dina AI-system är orättvisa riskerar du att skada verkliga människors liv.

Detta utsätter i sin tur din organisation för allvarliga affärsutmaningar och kan till och med förstöra det förtroende du har arbetat hårt för att bygga upp hos dina kunder.

En partisk AI som nekar någon ett lån, avvisar deras jobbansökan eller ger felaktiga rekommendationer får allvarliga konsekvenser i verkligheten.

Nya branschstandarder och ramverk uppmuntrar nu organisationer att aktivt identifiera och hantera partiskhet i sina AI-system. Riskerna drabbar din organisation från alla håll:

- Regulatorisk risk: Att inte uppfylla nya AI-standarder kan leda till betydande affärsutmaningar.

- Skada på anseendet: När allmänheten får reda på att din AI är partisk är det oerhört svårt att återvinna deras förtroende.

- Operativ ineffektivitet: Partiska modeller ger opålitliga resultat eller AI-hallucinationer som leder till dåliga beslut och kräver dyra korrigeringar.

- Etiskt ansvar: Din organisation bör se till att den teknik du använder behandlar alla användare rättvist.

När du lyckas minska partiskheten kan du bygga AI-system som människor faktiskt kan lita på. Rättvis AI öppnar dörrar till nya marknader, förbättrar kvaliteten på dina beslut och visar alla att du är engagerad i att driva ett etiskt företag.

📮 ClickUp Insight: 22 % av våra respondenter är fortfarande skeptiska när det gäller att använda AI på jobbet. Av dessa 22 % oroar sig hälften för sin dataintegritet, medan den andra hälften helt enkelt inte är säker på att de kan lita på vad AI säger.

ClickUp tar itu med båda dessa problem genom robusta säkerhetsåtgärder och genom att generera detaljerade länkar till uppgifter och källor för varje svar.

Det innebär att även de mest försiktiga teamen kan börja njuta av produktivitetsökningen utan att behöva oroa sig för om deras information är skyddad eller om de får tillförlitliga resultat.

Typer och källor till AI-bias

Partiskhet kan smyga sig in i dina AI-system från flera håll.

Från det ögonblick du börjar samla in data till långt efter att systemet har implementerats förblir detta element relativt stabilt. Men om du vet var du ska leta kan du rikta dina ansträngningar och sluta spela ett ändlöst spel av whack-a-mole med orättvisa resultat.

Urvalsbias

Urvalsbias uppstår när de data du använder för att träna din AI inte representerar den verkliga världen där AI:n kommer att användas på ett korrekt sätt.

Om du till exempel bygger ett röstigenkänningssystem som huvudsakligen tränats på data från amerikanska engelsktalande personer, kommer det naturligtvis att ha svårt att förstå personer med skotska eller indiska accenter, på samma sätt som LLM-modeller i 85,1 % av fallen gynnar namn som associeras med vita personer vid granskning av CV. Denna underrepresentation skapar stora blinda fläckar, vilket gör att din modell inte är förberedd för att betjäna hela grupper av människor.

Algoritmisk partiskhet

Algoritmisk bias uppstår när modellens design eller matematiska process förstärker orättvisa mönster, även om data verkar neutrala.

En persons postnummer bör inte avgöra om hen får ett lån, men om postnumren i dina träningsdata är starkt korrelerade med ras kan algoritmen lära sig att använda platsen som ett mått på diskriminering.

Problemet förvärras ytterligare av återkopplingsloopar – när en partisk förutsägelse (till exempel att neka ett lån) matas tillbaka in i systemet som ny data, förstärks partiskheten bara med tiden.

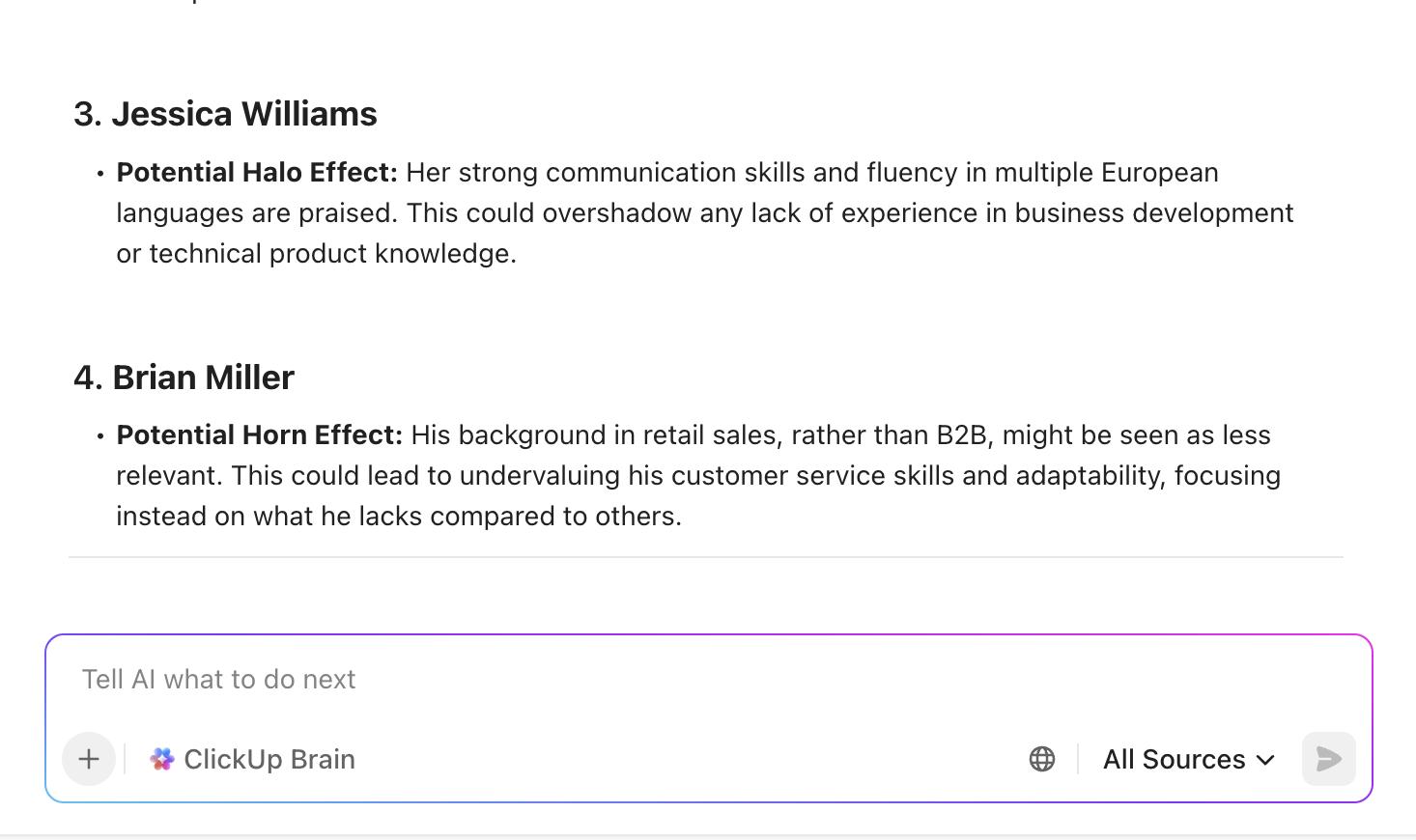

Mänsklig beslutsbias

Varje val som en person gör när hen bygger ett AI-system kan introducera partiskhet.

Detta innefattar att besluta vilka data som ska samlas in, hur de ska märkas och hur man definierar ”framgång” för modellen. Ett team kan till exempel omedvetet gynna data som stöder det de redan tror på (bekräftelsebias) eller lägga för stor vikt vid den första informationen de ser (förankringseffekt).

Även de mest välmenande teamen kan av misstag kodifiera sina egna antaganden och världsbild i ett AI-system.

Exempel på AI-bias i verkligheten

Verkliga företag har drabbats av allvarliga konsekvenser när deras AI-system visat sig vara partiska, vilket kostat dem miljontals dollar i skadestånd och förlorat kundernas förtroende. Här är några dokumenterade exempel:

1. Partiska rekryteringsverktyg

Ett av de mest omtalade fallen gällde ett stort teknikföretag som skrotade ett internt AI-rekryteringssystem efter att det lärt sig att gynna manliga kandidater framför kvinnor. Systemet hade tränats på tio års CV där de flesta framgångsrika sökande var män. Det började därför straffa CV med ord som ”kvinnor” och till och med nedgradera kvinnor som hade examen från kvinnliga högskolor.

Detta visar hur historiska datafördomar, när tidigare mönster återspeglar befintlig ojämlikhet, kan smyga sig in i automatiseringen om de inte granskas noggrant. Men i takt med att automatiserad rekrytering med AI blir allt vanligare blir problemet ännu större.

🌼 Visste du att: Färska data visar att 37 % av organisationerna nu ”aktivt integrerar” eller ”experimenterar” med Gen AI-verktyg i rekryteringen, en ökning från 27 % för ett år sedan.

2. Ansiktsigenkänning som missar hälften av befolkningen

Forskning ledd av Joy Buolamwini och dokumenterad i studien Gender Shades visade att kommersiella ansiktsigenkänningssystem hade felprocent på upp till 34,7 % för mörkhyade kvinnor, jämfört med mindre än 1 % för ljushyade män.

Detta är återigen ett resultat av obalanserade träningsdatauppsättningar. Fördomar i biometriska verktyg har ännu mer långtgående effekter.

Polisen och myndigheter har också stött på problem med partisk ansiktsigenkänning. Undersökningar från The Washington Post visade att vissa av dessa system var mycket mer benägna att felidentifiera personer från marginaliserade grupper. I flera verkliga fall ledde detta till felaktiga arresteringar, allmänhetens motreaktioner och stora farhågor om hur dessa verktyg påverkar människors rättigheter.

3. Hälsoalgoritmer som prioriterar vård i för liten utsträckning

Hälso-AI-system som är utformade för att förutsäga vilka patienter som behöver extra vård har också visat sig vara partiska.

I ett väl dokumenterat fall uppstod ett betydande fel i en allmänt använd algoritm för prognoser inom hälso- och sjukvården. Algoritmen skulle hjälpa till att avgöra vilka patienter som skulle få extra vård, men slutade med att systematiskt ge svarta patienter lägre prioritet, även när de var lika sjuka eller sjukare än vita patienter.

Det berodde på att modellen använde hälso- och sjukvårdsutgifter som ett mått på medicinska behov. Eftersom svarta patienter historiskt sett haft lägre hälso- och sjukvårdsutgifter på grund av ojämlik tillgång till vård, behandlade algoritmen dem som mindre behövande. Som ett resultat av detta styrdes vårdresurserna bort från dem som faktiskt behövde dem mest. Forskare fann att en enkel korrigering av detta mått kunde öka tillgången till rättvisa vårdprogram avsevärt.

Oro över just dessa frågor har fått medborgarrättsorganisationer att kräva ”equity-first”-standarder inom AI i hälso- och sjukvården. I december 2025 publicerade NAACP en detaljerad plan där man uppmanade sjukhus, teknikföretag och beslutsfattare att införa biasrevisioner, transparenta designmetoder, inkluderande ramverk och AI-styrningsverktyg för att förhindra att ojämlikheterna inom hälso- och sjukvården förvärras.

4. Kreditalgoritmer med ojämlika resultat

AI och automatiserat beslutsfattande påverkar inte bara vad du ser på sociala medier, utan också vem som får tillgång till pengar och på vilka villkor.

Ett av de mest omtalade exemplen från verkligheten kom från Apple Card , ett digitalt kreditkort utfärdat av Goldman Sachs.

Under 2019 delade kunder på sociala medier att kortets kreditgränsalgoritm gav vissa män mycket högre gränser än deras fruar eller kvinnliga partners. Detta hände även när paren uppgav att de hade liknande ekonomiska profiler. En mjukvaruingenjör sa att han fick en kreditgräns som var 20 gånger högre än sin frus, och till och med Apples medgrundare Steve Wozniak bekräftade en liknande upplevelse med sin make.

Dessa mönster väckte allmän upprördhet och ledde till en utredning av New York State Department of Financial Services om algoritmen diskriminerade kvinnor, vilket belyste hur automatiserade finansiella verktyg kan ge ojämlika resultat.

5. Automatiska undertexter och röstigenkänning som utesluter röster

Taligenkänning och automatiska undertextsystem hör ofta inte alla lika bra. Flera studier har visat att dessa verktyg tenderar att fungera bättre för vissa talare än andra, beroende på faktorer som accent, dialekt, etnicitet och om engelska är talarens modersmål.

Det beror på att kommersiella system vanligtvis tränas på datamängder som domineras av vissa talmönster – ofta västerländska, standardengelska – vilket gör att andra röster blir underrepresenterade.

Forskare vid Stanford testade till exempel fem ledande tal-till-text-system (från Amazon, Google, Microsoft, IBM och Apple) och fann att de gjorde nästan dubbelt så många fel när de transkriberade tal från svarta talare jämfört med vita talare . Problemet uppstod även när försökspersonerna sa samma ord under samma förhållanden.

När undertexter är felaktiga för vissa talare kan det leda till dåliga användarupplevelser och bristande tillgänglighet för personer som är beroende av undertexter. Ännu värre är att det kan bidra till partiska resultat i system som använder taligenkänning inom rekrytering, utbildning eller hälso- och sjukvård.

Var och en av dessa exempel illustrerar ett tydligt sätt på vilket partiskhet kan inbäddas i automatiserade system, genom skeva träningsdata, dåligt valda proxyservrar eller icke-representativa tester. I samtliga fall är resultaten inte bara tekniska – de formar möjligheter, undergräver förtroendet och medför reella affärsmässiga och etiska risker.

📖 Läs mer: Risker kontra problem – vad är skillnaden?

Sammanfattning: Hur AI-fördomar uppstår och vem de skadar

| Var partiskheten uppstod | Vem påverkades | Verklig påverkan |

|---|---|---|

| Rekryteringsalgoritmer (skrotat AI-rekryteringsverktyg) | Kvinnor | CV:n nedvärderades baserat på könsrelaterade nyckelord, vilket minskade tillgången till intervjuer och jobbmöjligheter. |

| Ansiktsigenkänningssystem (Gender Shades + fall av felaktiga arresteringar) | Mörkhyade kvinnor; marginaliserade etniska grupper | Betydligt högre felidentifieringsfrekvenser ledde till felaktiga arresteringar, skadat rykte och problem med medborgerliga rättigheter. |

| Algoritmer för riskbedömning inom hälso- och sjukvården (studie från University of Chicago) | Svarta patienter | Patienter prioriterades bort från extra vård eftersom sjukvårdskostnaderna användes som ett felaktigt mått på medicinska behov, vilket förvärrade ojämlikheterna inom hälso- och sjukvården. |

| Kreditgränsalgoritmer (Apple Card-utredning) | Kvinnor | Män fick betydligt högre kreditgränser än kvinnliga partners med samma kvalifikationer, vilket påverkade deras tillgång till finansiering och lånekapacitet. |

| Taligenkänning och automatisk textning (Stanford ASR-studie) | Talare med icke-standardiserade accenter; svarta talare | Nästan dubbelt så höga felfrekvenser skapade tillgänglighetshinder, missförstånd och partiska resultat i verktyg som används vid rekrytering, utbildning och daglig digital åtkomst. |

Strategier för att minska partiskhet som fungerar

Det finns ingen enkel lösning för att eliminera AI-bias.

Effektiv minskning av partiskhet kräver ett flerlagrigt försvar som du tillämpar under hela AI-livscykeln. Genom att kombinera dessa beprövade strategier kan du dramatiskt minska risken för orättvisa resultat.

Samla in diversifierade träningsdata

Representativa data är den absoluta grunden för rättvis AI.

Din modell kan inte lära sig att betjäna grupper av människor som den aldrig har sett under sin träning. Börja med att granska dina befintliga datamängder för att hitta eventuella demografiska luckor. Gör sedan en medveten ansträngning för att skaffa nya data från dessa underrepresenterade populationer.

När det är svårt att hitta data från verkligheten kan du använda tekniker som dataaugmentering (skapa modifierade kopior av befintliga data) eller generering av syntetiska data för att fylla luckorna.

🚧 Verktygslåda: Använd ClickUps mall för internrevisionschecklista för att kartlägga din revisionsprocess.

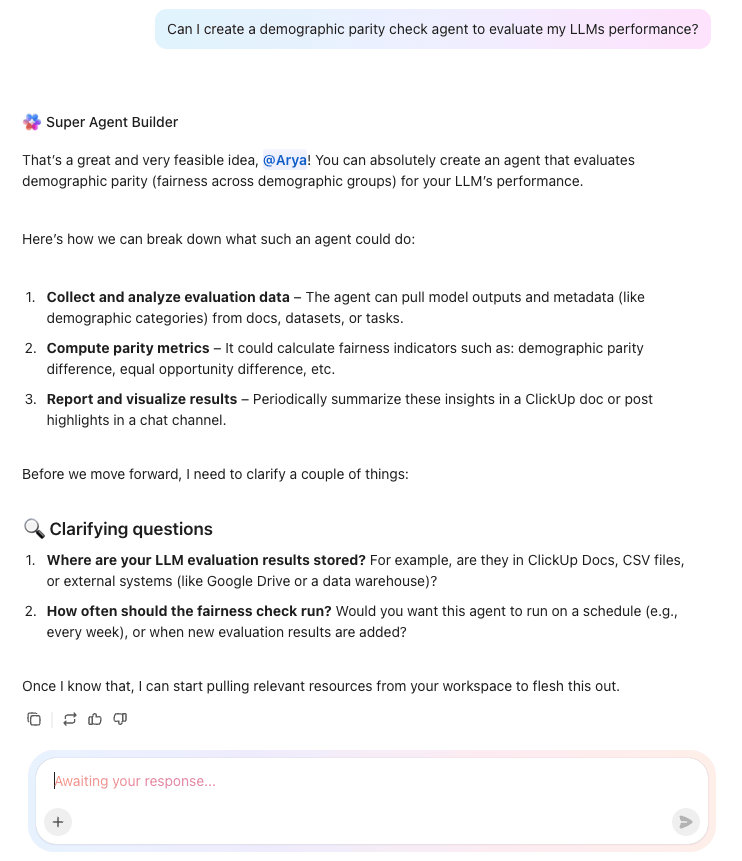

Testa modeller för partiskhet

Du måste systematiskt testa för partiskhet för att upptäcka den innan den orsakar verklig skada. Använd rättvisemätvärden för att mäta hur din modell presterar i olika grupper.

Demografisk paritet kontrollerar till exempel om modellen ger ett positivt resultat (till exempel ett lånegodkännande) till lika villkor för alla grupper, medan utjämnade odds kontrollerar om felfrekvensen är lika.

Dela upp din modells prestanda efter alla demografiska faktorer du kan – etnicitet, kön, ålder, geografi – för att upptäcka var noggrannheten minskar eller orättvisor smyger sig in.

Håll människan i loop

Automatiserade system kan missa subtila, kontextspecifika orättvisor som en person skulle upptäcka direkt. En human-in-the-loop-strategi är avgörande för beslut med höga insatser, där en AI kan ge en rekommendation, men en person fattar det slutgiltiga beslutet.

Detta är särskilt viktigt inom områden som rekrytering, utlåning och medicinsk diagnostik. För att detta ska fungera måste dina mänskliga granskare vara utbildade i att känna igen partiskhet och ha befogenhet att åsidosätta AI:s förslag.

Tillämpa algoritmiska rättvisetekniker

Du kan också använda tekniska metoder för att direkt ingripa och minska partiskheten. Dessa tekniker kan delas in i tre huvudkategorier:

- Förbehandling: Detta innebär att man justerar träningsdata innan modellen ser den, ofta genom att omvärdera eller omprova data för att skapa en mer balanserad representation av olika grupper.

- Under bearbetning: Här lägger du till rättvisebegränsningar direkt i modellens träningsprocess och lär den att optimera både noggrannhet och rättvisa samtidigt.

- Efterbearbetning: Detta innebär att justera modellens slutliga förutsägelser efter att de har gjorts för att säkerställa att resultaten är rättvisa för alla grupper.

Dessa tekniker innebär ofta en avvägning, där en liten minskning av den totala noggrannheten kan vara nödvändig för att uppnå en betydande förbättring av rättvisan.

💟 Bonus: BrainGPT är din AI-drivna desktopkompanjon som tar AI-biastestning till nästa nivå genom att ge dig tillgång till flera ledande modeller – inklusive GPT-5, Claude, Gemini och fler – allt på ett och samma ställe.

Det innebär att du enkelt kan köra samma uppmaningar eller scenarier i olika modeller, jämföra deras resonemangsförmåga och upptäcka var svaren skiljer sig åt eller visar fördomar. Denna AI-superapp låter dig också använda talk-to-text för att ställa in testfall, dokumentera dina resultat och organisera resultaten för jämförande analys.

Dess avancerade resonemang och kontextmedvetna verktyg hjälper dig att felsöka problem, lyfta fram mönster och förstå hur varje modell hanterar känsliga ämnen. Genom att centralisera ditt arbetsflöde och möjliggöra transparent testning av flera modeller ger Brain MAX dig möjlighet att granska, jämföra och hantera AI-bias med självförtroende och precision.

Öka transparensen och förklarbarheten

Om du inte vet hur din modell fattar beslut kan du inte korrigera den när den är felaktig. Förklarbara AI-tekniker (XAI) hjälper dig att titta in i den ”svarta lådan” och se vilka dataegenskaper som styr förutsägelserna.

Du kan också skapa modellkort, som är som näringsdeklarationer för din AI, där du dokumenterar dess avsedda användning, prestandadata och kända begränsningar.

📮ClickUp Insight: 13 % av våra undersökningsdeltagare vill använda AI för att fatta svåra beslut och lösa komplexa problem. Men endast 28 % uppger att de använder AI regelbundet i sitt arbete. En möjlig orsak: säkerhetsfarhågor!

Användare kanske inte vill dela känslig beslutsdata med en extern AI.

ClickUp löser detta genom att erbjuda AI-driven problemlösning direkt i din säkra arbetsmiljö. Från SOC 2 till ISO-standarder uppfyller ClickUp de högsta datasäkerhetsstandarderna och hjälper dig att använda generativ AI-teknik på ett säkert sätt i hela din arbetsmiljö.

Policyer för AI-styrning och ansvarsskyldighet

Ett starkt AI-styrningsprogram skapar tydligt ansvar och konsekventa standarder som alla i teamet kan följa.

Din organisation behöver tydliga styrningsstrukturer för att säkerställa att någon alltid är ansvarig för att bygga och implementera AI på ett etiskt sätt.

Här är de viktigaste elementen i ett effektivt AI-styrningsprogram:

| Styrningselement | Vad det innebär | Åtgärder för din organisation |

|---|---|---|

| Tydligt ägarskap | Särskilda personer eller team ansvarar för AI-etik, övervakning och efterlevnad. | • Utse en ansvarig för AI-etik eller en tvärfunktionell kommitté • Definiera ansvar för data, modellkvalitet, efterlevnad och risk • Involvera juridik, teknik, produkt och DEI i övervakningen |

| Dokumenterade policyer | Skriftliga riktlinjer som definierar hur data samlas in, används och övervakas under AI-livscykeln. | • Skapa interna policyer för datainsamling, märkning, integritet och lagring • Dokumentera standarder för modellutveckling, validering och implementering • Kräv att teamen följer checklistor innan de levererar något AI-system |

| Revisionsspår | En transparent dokumentation av beslut, modellversioner, datamängder och ändringar | • Implementera versionskontroll för datamängder och modeller • Logga viktiga beslut, modellparametrar och granska resultat • Lagra revisionsspår i ett centralt, tillgängligt arkiv |

| Regelbundna granskningar | Löpande utvärderingar av AI-system för att kontrollera fördomar, avvikelser och brister i efterlevnaden. | • Planera kvartalsvisa eller halvårsvisa bedömningar av partiskhet via robust LLM-utvärdering • Omskola eller kalibrera om modeller när prestandan sjunker eller beteendet förändras • Granska modeller efter större datauppdateringar eller produktförändringar |

| Plan för incidenthantering | Ett tydligt protokoll för att identifiera, rapportera och korrigera AI-bias eller skada. | • Skapa ett internt arbetsflöde för eskalering av partiskhet • Definiera hur problem utreds och vem som godkänner korrigeringar • Skissa på kommunikationssteg för användare, kunder eller tillsynsmyndigheter när det behövs |

💡Proffstips: Ramverk som NIST AI Risk Management Framework och EU AI Act, med böter på upp till 7 % av den årliga omsättningen, kan vara utmärkta mallar för att bygga upp ditt eget styrningsprogram.

Hur man implementerar minskning av partiskhet med ClickUp

ClickUps konvergerade AI-arbetsyta samlar alla rörliga delar i ditt AI-styrningsprogram i en organiserad arbetsyta.

Dina team kan hantera uppgifter, lagra policyer, granska revisionsresultat, diskutera risker och spåra incidenter utan att behöva växla mellan olika verktyg eller tappa sammanhanget. Alla modellposter, beslutsloggar och åtgärdsplaner förblir länkade, så att du alltid vet vem som gjorde vad och varför.

Eftersom ClickUps AI förstår arbetet i din arbetsmiljö kan den ta fram tidigare utvärderingar, sammanfatta långa rapporter och hjälpa ditt team att hålla sig uppdaterat när standarderna utvecklas. Resultatet är ett styrningssystem som är lättare att följa, lättare att granska och mycket mer tillförlitligt i takt med att din AI-närvaro växer.

Låt oss bryta ner det i ett arbetsflöde!

Steg 1: Skapa din arbetsyta för AI-styrning

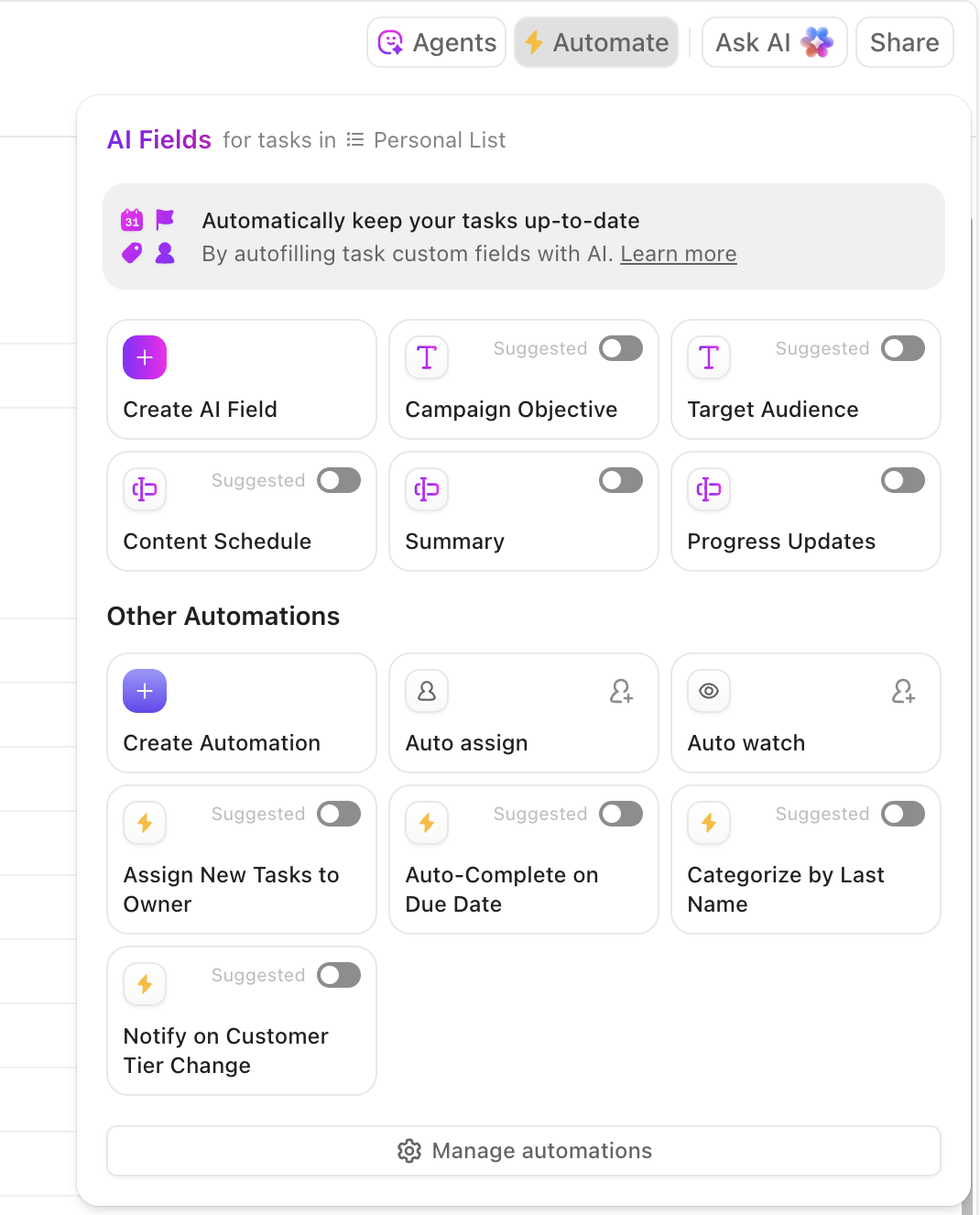

Börja med att skapa ett särskilt utrymme i ClickUp för allt arbete som rör styrning. Lägg till listor för din modellinventering, partiskhetsbedömningar, incidentrapporter, policydokument och schemalagda granskningar så att alla delar av programmet finns i en kontrollerad miljö.

Konfigurera anpassade fält eller AI-fält för att spåra rättvisemätvärden, partiskhetspoäng, modellversioner, granskningsstatus och risknivåer. Använd rollbaserade behörigheter för att säkerställa att endast auktoriserade granskare, ingenjörer och compliance-ansvariga har tillgång till känsligt AI-arbete. Detta skapar en strukturell grund som konkurrenternas punktverktyg och generiska projektplattformar inte kan erbjuda.

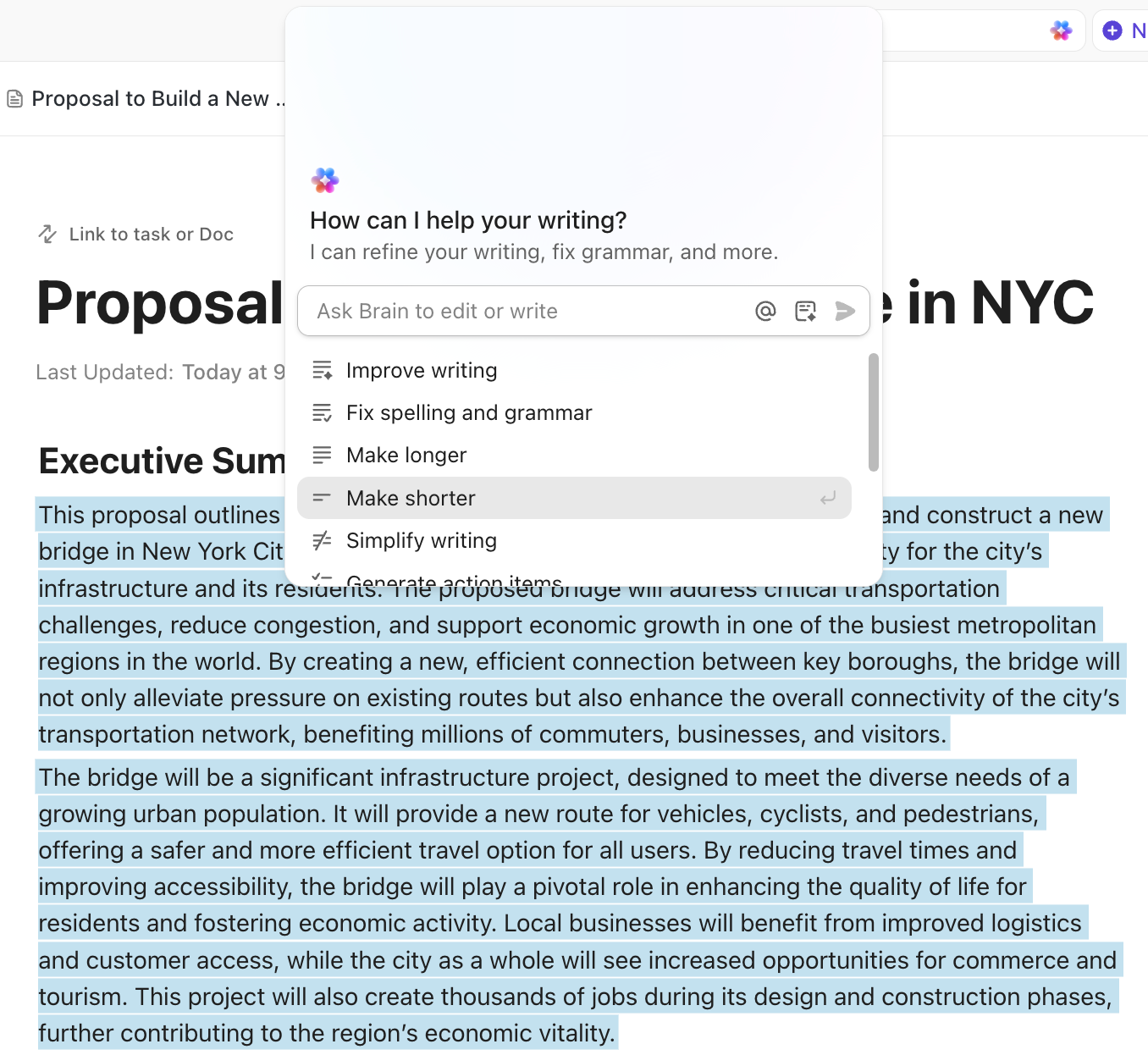

Steg 2: Skapa ditt styrningsramverk

Skapa sedan ett ClickUp Doc som fungerar som din levande styrningshandbok. Här beskriver du dina förfaranden för utvärdering av partiskhet, tröskelvärden för rättvisa, riktlinjer för modelldokumentation, steg för mänsklig inblandning och eskaleringsprotokoll.

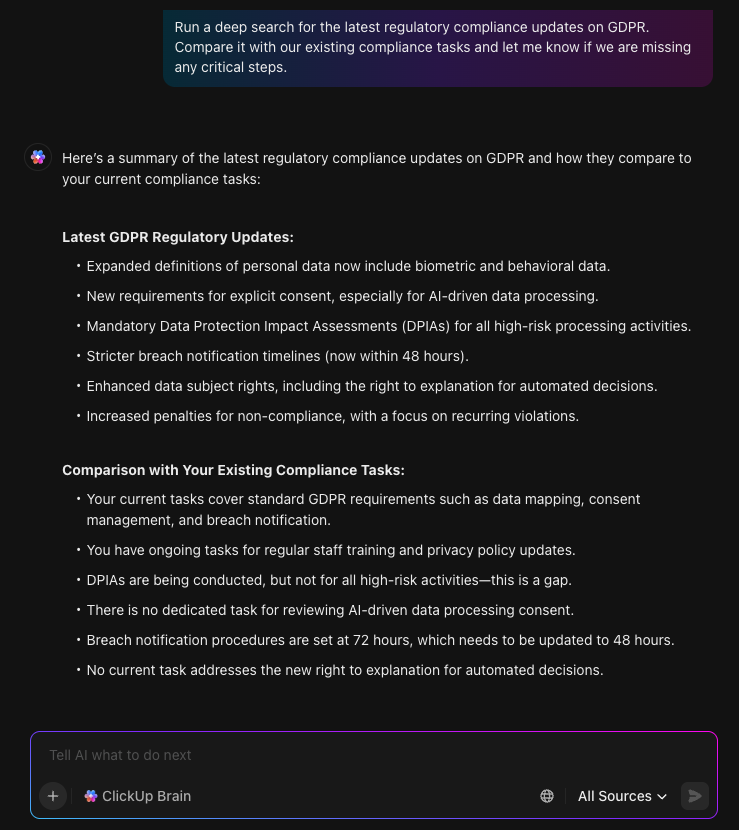

Eftersom dokument förblir kopplade till uppgifter och modellposter kan dina team samarbeta utan att förlora versionshistoriken eller sprida filer över olika verktyg. Därefter kan ClickUp Brain hjälpa till att sammanfatta externa regler, utarbeta nya policyformuleringar eller ta fram tidigare revisionsresultat, vilket gör policyarbetet mer konsekvent och spårbart.

Eftersom systemet kan söka på webben, växla mellan flera AI-modeller och sammanställa information till tydliga riktlinjer, kan ditt team hålla sig uppdaterat om nya standarder och förändringar i branschen utan att lämna arbetsplatsen. Allt du behöver, policyuppdateringar, insikter om regelverk och tidigare beslut, samlas på ett ställe, vilket gör ditt styrningssystem stabilare och mycket enklare att underhålla.

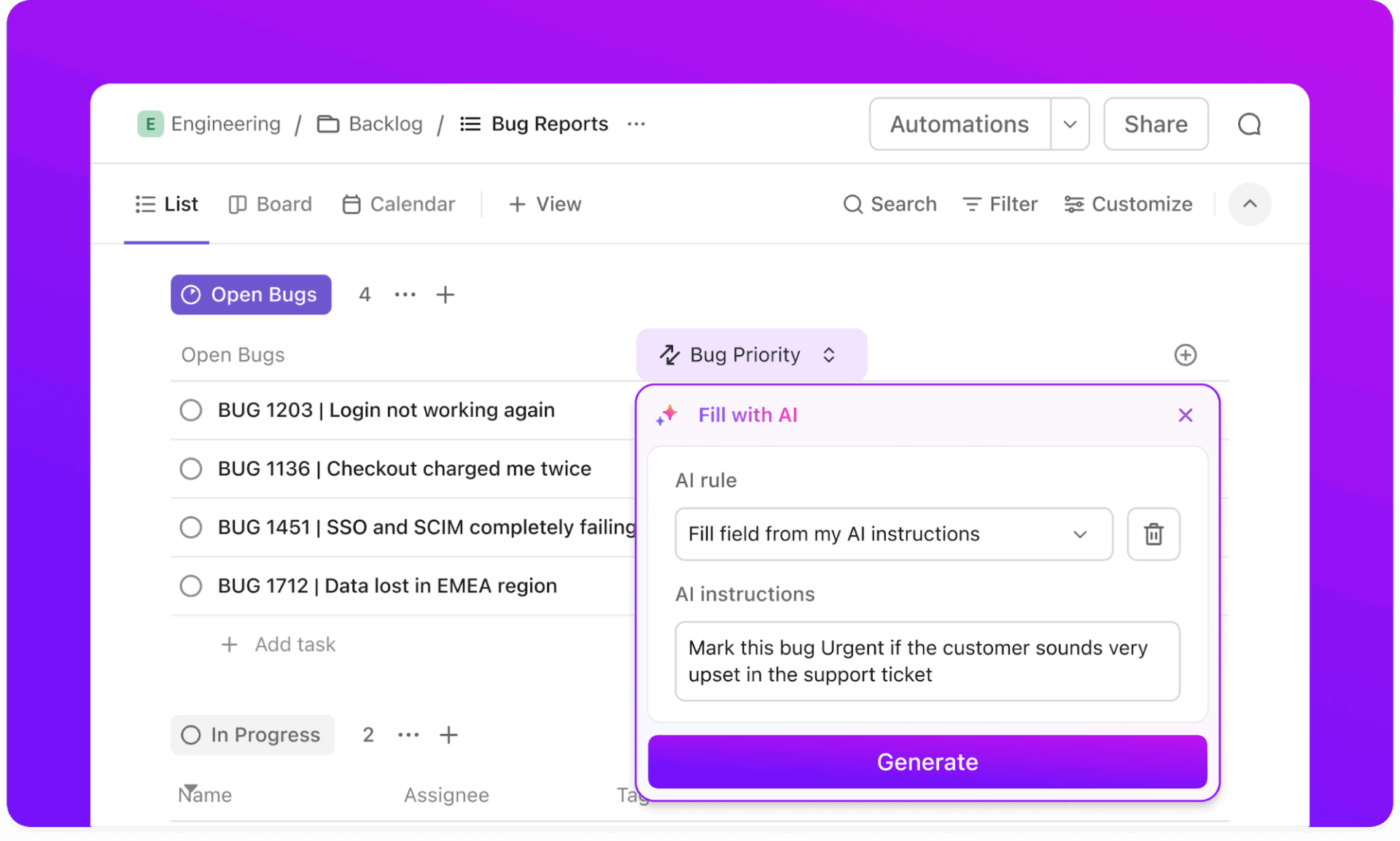

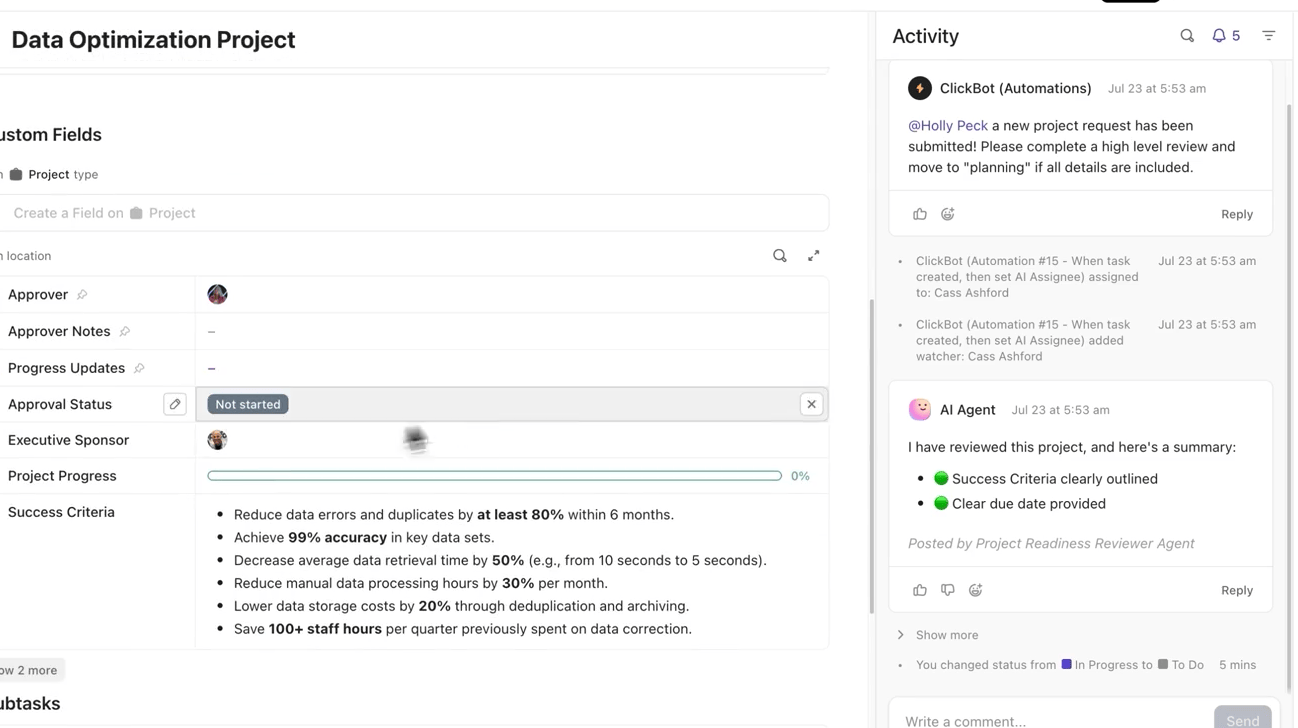

Steg 3: Registrera varje modell

Varje modell bör ha sin egen uppgift i listan ”Modellinventering” så att ägarskap och ansvar alltid är tydliga.

Spåra enkelt varje partiskhetsincident som en åtgärdsbar post genom att använda ClickUp Tasks och ClickUp Custom Fields för att strukturera dina arbetsflöden för partiskhetsbedömning och fånga upp alla viktiga detaljer.

På så sätt kan du spåra typen av partiskhet, allvarlighetsgrad, åtgärdsstatus, ansvarig teammedlem och nästa granskningsdatum, vilket säkerställer att varje problem har en tydlig ansvarig och en deadline.

Bifoga datamängder, utvärderingssammanfattningar och härkomstanteckningar så att allt finns på ett ställe. Automatiseringar kan sedan varna granskare när en modell flyttas till staging eller produktion.

Steg 4: Genomför schemalagda och händelsebaserade partiskhetsrevisioner

Partiskhetsrevisioner bör genomföras både enligt ett återkommande schema och som svar på specifika utlösande faktorer.

Ställ in enkla regler via ClickUp Automations som automatiskt utlöser granskningsuppgifter när en modell når en ny milstolpe i implementeringen eller när en schemalagd granskning ska genomföras. Du kommer aldrig mer att missa en kvartalsvis bedömning av partiskhet, eftersom Automations kan tilldela rätt granskare, ställa in korrekta deadlines och till och med skicka påminnelser när förfallodagen närmar sig.

För händelsebaserade revisioner gör ClickUp Forms det enkelt att samla in rapporter om partiskhetsincidenter eller mänsklig feedback, medan granskare använder anpassade fält för att logga brister i rättvisa, testresultat och rekommendationer. Varje formulär som skickas in vidarebefordras till ditt team som en uppgift, vilket skapar en repeterbar revisionsprocess.

Steg 5: Undersök och lösa incidenter med partiskhet

När ett problem med partiskhet identifieras skapar du en incidentuppgift som beskriver allvarlighetsgraden, berörda grupper, modellversion och nödvändiga åtgärder. AI-agenter kan eskalera högriskfynd till compliance-ansvariga och tilldela rätt granskare och ingenjörer.

Varje åtgärd, testresultat och valideringssteg förblir kopplat till incidentrapporten. ClickUp Brain kan generera sammanfattningar för ledningen eller hjälpa till att förbereda åtgärdsanteckningar för din styrningsdokumentation, så att allt förblir transparent och spårbart.

Steg 6: Övervaka hälsan hos ditt AI-styrningsprogram

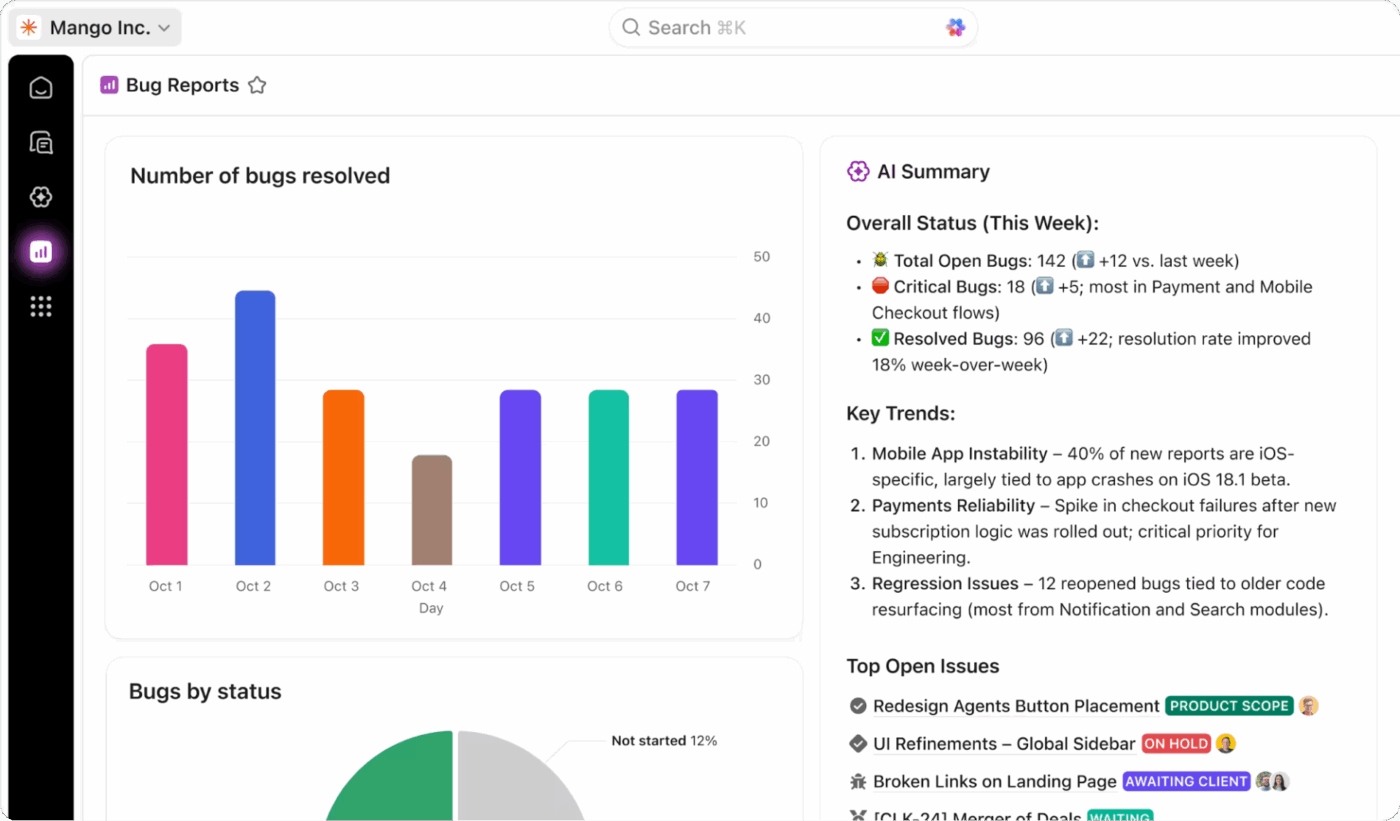

Slutligen kan du skapa instrumentpaneler som ger ledarna en realtidsbild av ditt program för att minska partiskhet.

Inkludera paneler som visar öppna incidenter, tid till lösning, revisionsgrader, rättvisemätvärden och efterlevnadsstatus för alla aktiva modeller. De kodfria instrumentpanelerna i ClickUp kan automatiskt hämta data och uppdatera uppgifter allteftersom arbetet fortskrider, med AI-sammanfattningar inbyggda i din instrumentpanelvy.

📖 Läs mer: Hur man övervinner vanliga AI-utmaningar

Kontroller av partiskhet efter implementering

Ditt arbete är inte klart när AI-modellen tas i drift.

Det är faktiskt då det verkliga testet börjar. Modeller kan "driva iväg" och utveckla nya fördomar över tid när de verkliga data de ser börjar förändras. Kontinuerlig övervakning är det enda sättet att upptäcka dessa nya fördomar innan de orsakar omfattande skada.

Här är vad din löpande övervakning bör omfatta:

| Övning | Vad det garanterar |

|---|---|

| Prestationsuppföljning per grupp | Mäter kontinuerligt modellens noggrannhet och rättvisa över olika demografiska segment så att skillnader upptäcks tidigt. |

| Detektering av datadrift | Övervakar förändringar i indata som kan introducera ny partiskhet eller försvaga modellens prestanda över tid. |

| Användarfeedbackloopar | Ger användarna tydliga kanaler för att rapportera partiska eller felaktiga resultat, vilket förbättrar den verkliga övervakningen. |

| Planerade revisioner | Säkerställer kvartalsvisa eller halvårsvisa djupdykningar i modellbeteende, rättvisemätningar och efterlevnadskrav. |

| Incidenthantering | Definierar en strukturerad process för att undersöka, korrigera och dokumentera alla rapporterade partiskhetshändelser. |

💟 Bonus: Generativa AI-system kräver extra vaksamhet eftersom deras resultat är mycket mindre förutsägbara än traditionella maskininlärningsmodeller. En utmärkt teknik för detta är red-teaming, där ett dedikerat team aktivt försöker provocera fram partiska eller skadliga svar från modellen för att identifiera dess svaga punkter.

Airbnbs Project Lighthouse är till exempel en utmärkt branschstudie av ett företag som implementerar systematisk övervakning av partiskhet efter implementering.

Det är ett forskningsinitiativ som undersöker hur uppfattad ras kan påverka bokningsresultaten, vilket hjälper företaget att identifiera och minska diskriminering på plattformen. Det använder sekretesskyddade metoder, samarbetar med medborgarrättsgrupper och omsätter resultaten i produkt- och policyförändringar, vilket gör det möjligt för fler gäster att navigera på plattformen utan att stöta på osynliga hinder.

Minska AI-bias med ClickUp

Att bygga rättvis och ansvarsfull AI är ett organisatoriskt åtagande.

När dina policyer, medarbetare, processer och verktyg fungerar i harmoni skapar du ett styrningssystem som kan anpassas till nya risker, reagera snabbt på incidenter och vinna förtroendet hos de människor som förlitar sig på dina produkter.

Med strukturerade granskningar, tydlig dokumentation och ett repeterbart arbetsflöde för hantering av partiskhet kan teamen hålla sig samordnade och ansvariga, istället för att reagera i krissituationer.

Genom att centralisera allt i ClickUp, från modellregister till revisionsresultat och incidentrapporter, skapar du ett enda operativt lager där besluten är transparenta, ansvarsområdena tydliga och förbättringarna aldrig går förlorade i virrvarret.

Stark styrning bromsar inte innovation, utan stabiliserar den. Är du redo att bygga in minskning av partiskhet i dina AI-arbetsflöden? Kom igång gratis med ClickUp och börja bygga ditt AI-styrningsprogram redan idag.

Vanliga frågor

Ett bra första steg är att genomföra en partiskhetsgranskning av dina befintliga AI-system. Denna grundläggande utvärdering visar var det finns orättvisor och hjälper dig att prioritera dina åtgärder för att minska dem.

Teamen använder specifika rättvisemått, såsom demografisk paritet, utjämnade odds och ojämlikhetskvot, för att kvantifiera partiskhet. Vilket mått som är rätt beror på ditt specifika användningsfall och vilken typ av rättvisa som är viktigast i det sammanhanget.

Du bör alltid lägga till ett steg med mänsklig granskning för beslut med höga insatser som väsentligt påverkar en persons liv eller möjligheter, till exempel vid anställning, utlåning eller hälso- och sjukvård. Det är också klokt att använda det under den tidiga implementeringen av en ny modell när dess beteende fortfarande är oförutsägbart.

Eftersom generativ AI kan producera ett nästan oändligt antal oförutsägbara svar kan du inte bara kontrollera noggrannheten. Du måste använda aktiva testtekniker som red-teaming och storskalig utdatasampling för att ta reda på om modellen producerar partiskt innehåll under olika förhållanden.