Az AI elfogultsága technikai problémának tűnhet. De hatása a valós világban is megmutatkozik, és gyakran pusztító lehet.

Ha egy AI-rendszer akár csak kissé is rossz irányba hajlik, az igazságtalan eredményekhez vezethet.

Idővel ezek a kis problémák frusztrált ügyfelekhez, hírnévromboláshoz, vagy akár előre nem látható megfelelési kérdésekhez vezethetnek.

A legtöbb csapat nem azzal a szándékkal állítja össze az AI-t, hogy az elfogult legyen. Ez azért történik, mert az adatok rendezetlenek, a valós világ egyenetlen, és az általunk használt eszközök nem mindig úgy gondolkodnak, ahogyan mi elvárjuk. A jó hír az, hogy nem kell adat tudósnak lenni ahhoz, hogy megértsük, mi történik.

Ebben a blogban bemutatjuk, mi is valójában az AI elfogultság, miért alakul ki, és hogyan nyilvánulhat meg a mindennapi üzleti eszközökben.

Mi az AI elfogultság?

Az AI elfogultság akkor jelentkezik, amikor egy mesterséges intelligencia rendszer szisztematikus, tisztességtelen eredményeket hoz, amelyek következetesen előnyben részesítenek vagy hátrányosan megkülönböztetnek bizonyos embercsoportokat. Ezek nem csak véletlenszerű hibák, hanem előre jelezhető minták, amelyek beépülnek az AI döntéshozatali folyamatába. Mi az oka? Az AI olyan adatokból tanul, amelyek tükrözik a meglévő emberi elfogultságot, más tudattalan elfogultságokat és társadalmi egyenlőtlenségeket.

Gondoljon rá így: ha egy felvételi algoritmust tíz évnyi vállalati adattal tanít be, amelyben a vezetők 90%-a férfi volt, az AI tévesen megtanulhatja, hogy a férfi nem a vezetői pozíció betöltésének kulcsfontosságú feltétele. Az AI nem rosszindulatú, egyszerűen csak azonosítja és megismétli a neki bemutatott mintákat.

Az AI elfogultságát az alábbiak teszik olyan bonyolulttá:

- Ez szisztematikus, nem véletlenszerű: a tisztességtelenség nem egyszeri hiba, hanem az AI kimeneteiben megismétlődő minta.

- Gyakran láthatatlan: Az elfogult eredmények elrejtőzhetnek egy látszólag semleges algoritmus komplex matematikája mögött, ami megnehezíti azok felismerését.

- Ez az adatokban és a tervezésben gyökerezik: az elfogultság azáltal kerül a rendszerbe, hogy mi, emberek, döntéseket hozunk, amikor mesterséges intelligenciát építünk és tanítunk.

⭐ Kiemelt sablon

A ClickUp incidenskezelési jelentés sablonja kész struktúrát biztosít az incidensek dokumentálásához, nyomon követéséhez és megoldásához az elejétől a végéig. Rögzítse az incidens összes releváns részletét, tartsa karban a világosan kategorizált állapotokat, és rögzítse a fontos tulajdonságokat, mint például a súlyosság, az érintett csoportok és a javító intézkedések. Támogatja az olyan egyéni mezőket, mint a Jóváhagyta, Incidensjegyzetek és Kiegészítő dokumentumok, amelyek segítenek a felelősségre vonhatóság és a bizonyítékok feltárásában a felülvizsgálati folyamat során.

📖 További információk: Hogyan kell elvégezni a kockázatértékelést: eszközök és technikák

Miért fontos az AI elfogultság csökkentése?

Ha az AI-rendszerei nem tisztességesek, azzal kockáztatja, hogy kárt okoz valódi emberek életében.

Ez viszont komoly üzleti kihívások elé állítja a szervezetét, és akár tönkre is teheti azt a bizalmat, amelyet kemény munkával épített ki ügyfeleivel.

Egy elfogult AI, amely megtagadja valakinek a hitelt, elutasítja az álláspályázatát vagy helytelen ajánlást tesz, komoly valós következményekkel jár.

A kialakulóban lévő ipari szabványok és keretrendszerek most arra ösztönzik a szervezeteket, hogy aktívan azonosítsák és kezeljék az AI-rendszereikben fellelhető elfogultságot. A kockázatok minden oldalról érintik a szervezetét:

- Szabályozási kockázat: Az új AI-szabványok be nem tartása jelentős üzleti kihívásokhoz vezethet.

- Hírnévrombolás: Ha a nyilvánosság megtudja, hogy az AI-je elfogult, rendkívül nehéz visszanyerni a bizalmát.

- Működési hatékonyság hiánya: Az elfogult modellek megbízhatatlan eredményeket vagy mesterséges intelligencia által okozott hallucinációkat eredményeznek, amelyek rossz döntésekhez vezetnek és drága javításokat igényelnek.

- Etikai felelősség: Szervezetének gondoskodnia kell arról, hogy az Ön által alkalmazott technológia minden felhasználót méltányosan kezeljen.

Ha sikeresen csökkenti az elfogultságot, olyan AI-rendszereket építhet, amelyekre az emberek valóban támaszkodhatnak. A tisztességes AI új piacok előtt nyitja meg az ajtókat, javítja döntéseinek minőségét, és mindenki számára bizonyítja, hogy elkötelezett az etikus üzletvitel mellett.

📮 ClickUp Insight: A válaszadók 22%-a még mindig óvatos az AI munkahelyi használatát illetően. A 22% közül a fele az adatainak biztonságáért aggódik, míg a másik fele egyszerűen nem biztos abban, hogy megbízhat az AI által nyújtott információkban.

A ClickUp mindkét problémát határozott biztonsági intézkedésekkel és az egyes válaszokhoz tartozó feladatokra és forrásokra mutató részletes linkek létrehozásával kezeli.

Ez azt jelenti, hogy még a legóvatosabb csapatok is élvezhetik a termelékenység növekedését anélkül, hogy aggódniuk kellene az információik védelme vagy a megbízható eredmények miatt.

📖 További információk: AI Compliance Assistant: Hogyan alakítja át az AI a megfelelőségi és auditálási folyamatokat?

Az AI elfogultság típusai és forrásai

Az elfogultság több irányból is beépülhet az AI-rendszereibe.

Az adatok gyűjtésének megkezdésétől a rendszer bevezetése után hosszú idővel is ez az elem viszonylag állandó marad. De ha tudja, hol kell keresni, akkor célzottan tud fellépni, és véget vethet a végtelen, tisztességtelen eredményekkel járó „whack-a-mole” játéknak.

Mintavételi elfogultság

A mintavételi elfogultság akkor fordul elő, amikor az AI képzéséhez használt adatok nem tükrözik pontosan azt a valós világot, ahol az AI-t használni fogják.

Például, ha olyan hangfelismerő rendszert épít, amely főként amerikai angol anyanyelvűek adataival van betanítva, akkor természetesen nehezen fogja érteni a skót vagy indiai akcentussal beszélőket, hasonlóan ahhoz, ahogyan az LLM-ek 85,1%-ban a fehér emberekkel társított neveket részesítik előnyben az önéletrajzok szűrésénél. Ez az alulreprezentáltság hatalmas vakfoltokat eredményez, ami miatt a modell nem lesz képes egész embercsoportok kiszolgálására.

Algoritmikus elfogultság

Algoritmikus elfogultság akkor fordul elő, amikor a modell tervezése vagy matematikai folyamata felerősíti a tisztességtelen mintákat, még akkor is, ha az adatok semlegesnek tűnnek.

Egy személy postai irányítószáma nem dönthet arról, hogy kap-e hitelt, de ha a képzési adatokban szereplő postai irányítószámok szorosan összefüggenek a faji hovatartozással, az algoritmus megtanulhatja, hogy a helyszínt diszkrimináció helyettesítőjeként használja.

Ez a probléma még súlyosabbá válik a visszacsatolási hurkok miatt – amikor egy elfogult előrejelzés (például egy hitel elutasítása) új adatként visszakerül a rendszerbe, az elfogultság idővel csak fokozódik.

Emberi döntési elfogultság

Minden döntés, amelyet egy személy az AI-rendszer felépítése során meghoz, elfogultságot eredményezhet.

Ez magában foglalja annak eldöntését, hogy milyen adatokat gyűjtsünk, hogyan címkézzük azokat, és hogyan határozzuk meg a modell „sikerét”. Például egy csapat tudat alatt előnyben részesítheti azokat az adatokat, amelyek alátámasztják a már meglévő meggyőződésüket (megerősítő elfogultság), vagy túl nagy súlyt fektethet az első információra, amelyet meglát (lehorgonyzó elfogultság).

Még a legjobb szándékú csapatok is véletlenül beépíthetik saját feltételezéseiket és világnézetüket egy AI-rendszerbe.

📖 További információ: 10 projektirányítási sablon a feladatok kezeléséhez

AI-előítéletek példái a valós világban

Valódi vállalatok súlyos következményekkel szembesültek, amikor mesterséges intelligencia rendszereik elfogultságot mutattak, ami több millió dolláros kárt és az ügyfelek bizalmának elvesztését okozta. Íme néhány dokumentált példa:

1. Előítéletes toborzási eszközök

Az egyik leggyakrabban idézett eset egy nagy technológiai vállalatot érintett, amely megszüntette belső AI toborzási rendszerét, miután az megtanulta előnyben részesíteni a férfi jelölteket a nőkkel szemben. A rendszert egy évtizednyi önéletrajz alapján képezték ki, amelyekben a legsikeresebb pályázók többsége férfi volt. Így a rendszer elkezdte büntetni az olyan szavakat tartalmazó önéletrajzokat, mint a „nők”, sőt, a női főiskolák diplomásait is alacsonyabb besorolásba sorolta.

Ez azt mutatja, hogy a történelmi adatok torzítása, amikor a múltbeli minták a meglévő egyenlőtlenségeket tükrözik, gondos ellenőrzés nélkül beépülhet az automatizálásba. Azonban az AI-val történő automatizált toborzás elterjedésével a probléma mértéke még nagyobbá válik.

🌼 Tudta-e: A legfrissebb adatok szerint a szervezetek 37%-a „aktívan integrálja” vagy „kísérletezik” a Gen AI eszközökkel a toborzásban, ami egy évvel ezelőtti 27%-ról emelkedett.

2. Arcfelismerés, amely a lakosság felét nem ismeri fel

Joy Buolamwini által vezetett és a Gender Shades tanulmányban dokumentált kutatások kimutatták, hogy a kereskedelmi arcfelismerő rendszerek hibaaránya sötét bőrű nők esetében akár 34,7% is lehet, míg világos bőrű férfiak esetében ez az arány kevesebb mint 1%.

Ez ismételten a kiegyensúlyozatlan képzési adatkészletek tükröződése. A biometrikus eszközök elfogultsága még messzebb mutató hatásokkal jár.

A rendőrség és a kormányzati szervek is szembesültek az elfogult arcfelismerés problémájával. A The Washington Post vizsgálata megállapította, hogy ezek közül a rendszerek közül néhány sokkal nagyobb valószínűséggel tévesztette meg a marginalizált csoportokhoz tartozó személyeket. Számos valós esetben ez téves letartóztatásokhoz, nyilvános visszhanghoz és komoly aggodalmakhoz vezetett azzal kapcsolatban, hogy ezek az eszközök hogyan befolyásolják az emberek jogait.

📖 További információ: AI a munkahelyen: a termelékenység és a hatékonyság javításának módjai

3. Az ellátást alulértékelő egészségügyi algoritmusok

Azok az egészségügyi AI-rendszerek, amelyek arra szolgálnak, hogy megjósolják, mely betegek igényelnek különleges ellátást, szintén elfogultságot mutattak.

Egy jól dokumentált esetben egy széles körben használt egészségügyi előrejelző algoritmus jelentős hibát vétett. Az algoritmusnak segítenie kellett volna eldönteni, mely betegek kapjanak extra ellátást, de végül szisztematikusan alacsonyabb prioritást adott a fekete bőrű betegeknek, még akkor is, ha azok ugyanolyan vagy súlyosabb betegségben szenvedtek, mint a fehér bőrű betegek.

Ez azért történt, mert a modell az egészségügyi kiadásokat használta a gyógyászati szükségletek helyettesítő mutatójaként. Mivel a fekete betegek történelmileg alacsonyabb egészségügyi kiadásokkal rendelkeztek az egyenlőtlen hozzáférés miatt, az algoritmus őket kevésbé rászorulóként kezelte. Ennek eredményeként a gondozási erőforrásokat elvonta azoktól, akiknek valójában a legnagyobb szükségük volt rájuk. A kutatók megállapították, hogy ennek a helyettesítő mutató javítása jelentősen növelheti a méltányos gondozási programokhoz való hozzáférést.

Ezekkel a kérdésekkel kapcsolatos aggodalmak arra késztették a polgárjogi csoportokat, hogy „méltányosság-első” szabványok bevezetését szorgalmazzák az egészségügyi AI területén. 2025 decemberében az NAACP részletes tervet tett közzé, amelyben felszólította a kórházakat, a technológiai vállalatokat és a politikai döntéshozókat, hogy vezessenek be elfogultsági ellenőrzéseket, átlátható tervezési gyakorlatokat, inkluzív keretrendszereket és AI irányítási eszközöket a faji egészségügyi egyenlőtlenségek mélyülésének megakadályozása érdekében.

4. Egyenlőtlen eredményeket hozó hitelalgoritmusok

Az AI és az automatizált döntéshozatal nem csak azt határozza meg, hogy mit látsz a közösségi médiában, hanem azt is, hogy ki fér hozzá pénzhez és milyen feltételekkel.

Az egyik leginkább beszédtéma valós példa az Apple Card , a Goldman Sachs által kibocsátott digitális hitelkártya volt.

2019-ben a közösségi médiában az ügyfelek arról számoltak be, hogy a kártya hitelkeret-algoritmusa egyes férfiaknak sokkal magasabb hitelkeretet biztosított, mint feleségeiknek vagy női partnereiknek. Ez akkor is előfordult, ha a párok hasonló pénzügyi profilról számoltak be. Egy szoftvermérnök elmondta, hogy 20-szor magasabb hitelkeretet kapott, mint felesége, és még az Apple társalapítója, Steve Wozniak is megerősítette, hogy hasonló tapasztalatai voltak a feleségével kapcsolatban.

Ezek a minták nyilvános felháborodást váltottak ki, és a New York-i Pénzügyi Szolgáltatások Minisztériuma szabályozási vizsgálatot indított annak megállapítására, hogy az algoritmus diszkriminálja-e a nőket, rámutatva arra, hogy az automatizált pénzügyi eszközök hogyan eredményezhetnek egyenlőtlen eredményeket.

📖 További információk: Hogyan használható az AI az adatkezeléshez (használati esetek és eszközök)

5. Automatikus feliratok és hangfelismerés, amely kizárja a hangokat

A beszédfelismerő és automatikus feliratozó rendszerek gyakran nem hallanak mindenkit egyformán. Több tanulmány is kimutatta, hogy ezek az eszközök egyes beszélők esetében jobban működnek, mint másoknál, olyan tényezőktől függően, mint az akcentus, a dialektus, a faj és az, hogy az angol az első nyelv-e a beszélő számára.

Ez azért történik, mert a kereskedelmi rendszereket általában olyan adatkészleteken képezik, amelyekben bizonyos beszédminták dominálnak – gyakran a nyugati, standard angol –, így más hangok alulreprezentáltak maradnak.

Például a Stanford kutatói öt vezető beszéd-szöveg átalakító rendszert (az Amazon, a Google, a Microsoft, az IBM és az Apple termékeit) teszteltek, és megállapították, hogy nközel kétszer annyi hibát követtek el a fekete bőrű beszélők beszédének átírásakor, mint a fehér bőrű beszélők esetében . A probléma akkor is felmerült, amikor a vizsgálati alanyok ugyanazokat a szavakat mondták ugyanolyan körülmények között.

Ha a feliratok bizonyos beszélők esetében pontatlanok, az rossz felhasználói élményhez és hozzáférhetetlenséghez vezethet azok számára, akik a feliratokra támaszkodnak. Sőt, ez hozzájárulhat az elfogult eredményekhez azokban a rendszerekben, amelyek beszédfelismerést használnak a munkaerő-felvétel, az oktatás vagy az egészségügy területén.

Ezek a példák mindegyike egy-egy különféle módot szemléltet, ahogyan az elfogultság beépülhet az automatizált rendszerekbe, torzított képzési adatok, rosszul megválasztott helyettesítők vagy nem reprezentatív tesztelés révén. Minden esetben az eredmények nem csupán technikai jellegűek – lehetőségeket alakítanak, aláássák a bizalmat, és valós üzleti és etikai kockázatot hordoznak.

📖 További információ: Kockázatok és problémák – mi a különbség?

Összefoglalás: Hogyan jelenik meg az AI elfogultsága és kiket érint hátrányosan?

| Hol jelentkezett az elfogultság? | Kiket érintett a probléma? | Valós hatások |

|---|---|---|

| Toborzási algoritmusok (leselejtezett AI-alapú toborzási eszköz) | Nők | Az önéletrajzokat nemi alapú kulcsszavak alapján minősítették le, ami csökkentette az interjúkra és álláslehetőségekre való hozzáférést. |

| Arcfelismerő rendszerek (Gender Shades + jogtalan letartóztatások) | Sötét bőrű nők; marginalizált faji csoportok | A sokkal magasabb téves azonosítási arányok jogtalan letartóztatásokhoz, hírnévromboláshoz és polgári jogi aggályokhoz vezettek. |

| Egészségügyi kockázat-előrejelző algoritmusok (a Chicagói Egyetem tanulmánya) | Fekete bőrű betegek | A betegek nem kaptak elsőbbségi ellátást, mert az egészségügyi kiadásokat hibásan használták fel a gyógyászati szükségletek helyettesítő mutatójaként, ami tovább rontotta az egészségügyi egyenlőtlenségeket. |

| Hitelkeret-algoritmusok (Apple Card vizsgálat) | Nők | A férfiak drámaian magasabb hitelkeretet kaptak, mint az azonos képzettségű női partnerek, ami befolyásolta a pénzügyi hozzáférést és a hitelfelvételi képességet. |

| Beszédfelismerés és automatikus feliratozás (Stanford ASR tanulmány) | Nem szabványos kiejtésű előadók; fekete előadók | A hibaarányok közel kétszeresére emelkedése akadályokat, félreértéseket és elfogult eredményeket okozott a toborzás, az oktatás és a mindennapi digitális hozzáférés területén használt eszközökben. |

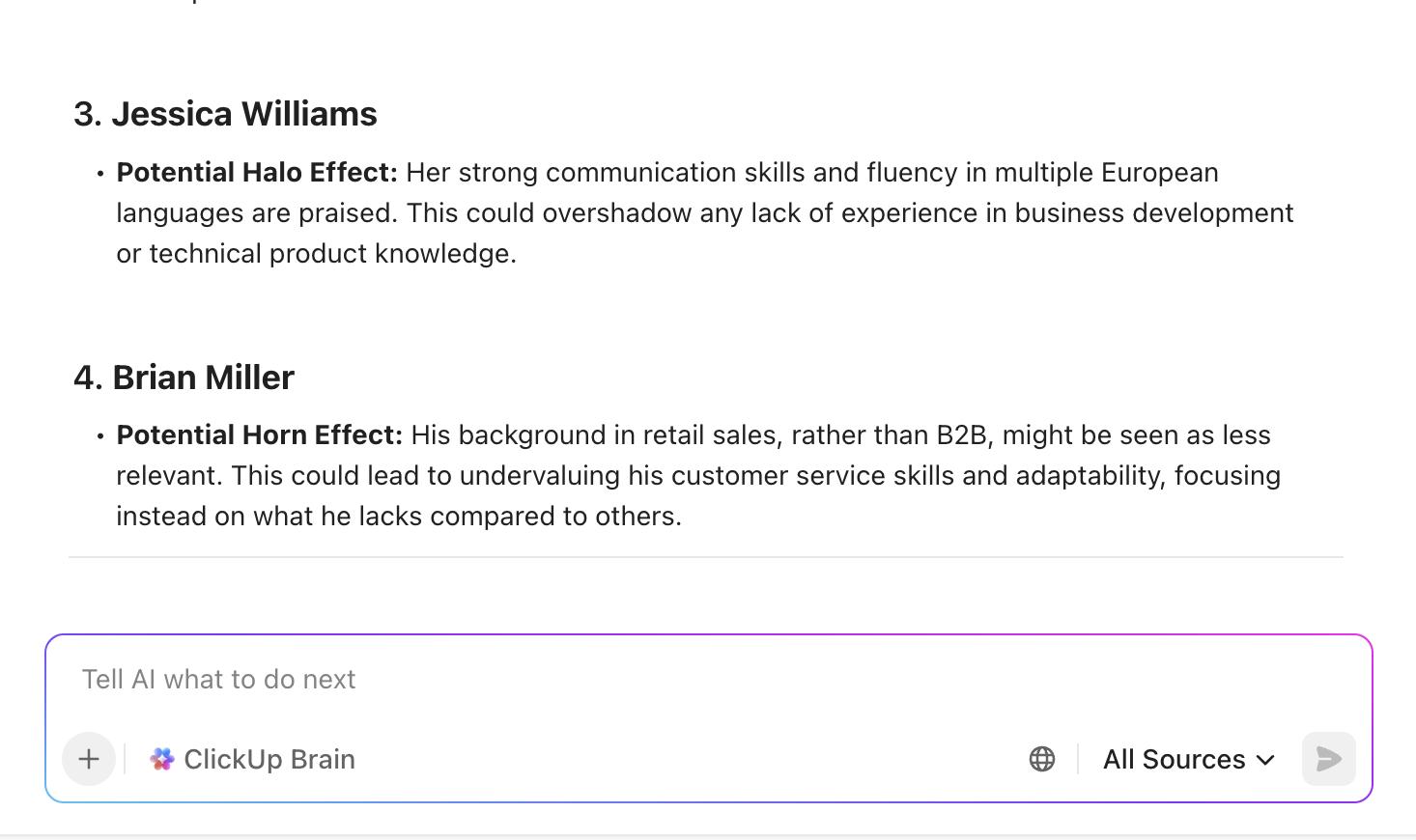

📖 További információ: Hogyan lehet elkerülni a halo- és horn-hatást az elfogultság csökkentése érdekében

Hatékony elfogultságcsökkentő stratégiák

Nincs egyetlen csodaszer az AI elfogultságának kiküszöbölésére.

A torzítások hatékony csökkentéséhez többszintű védelemre van szükség, amelyet az AI teljes életciklusa során alkalmazni kell. Ezen bevált stratégiák kombinálásával jelentősen csökkenthető a tisztességtelen eredmények kockázata.

Gyűjtsön sokszínű képzési adatokat

A reprezentatív adatok a tisztességes AI abszolút alapját képezik.

A modell nem tud megtanulni olyan embercsoportokat kiszolgálni, amelyeket még soha nem látott a képzés során. Kezdje azzal, hogy ellenőrzi a meglévő adatkészleteit, hogy megtalálja az esetleges demográfiai hiányosságokat. Ezután tegyen tudatos erőfeszítéseket, hogy új adatokat szerezzen az alulreprezentált népességcsoportoktól.

Ha nehéz valós adatokat találni, akkor olyan technikákat alkalmazhat, mint az adatkiegészítés (a meglévő adatok módosított másolatainak létrehozása) vagy a szintetikus adatok generálása, hogy pótolja a hiányzó adatokat.

🚧 Eszköztár: Használja a ClickUp belső ellenőrzési ellenőrzőlista sablonját az ellenőrzési folyamat felvázolásához.

Tesztelje a modelleket elfogultság szempontjából

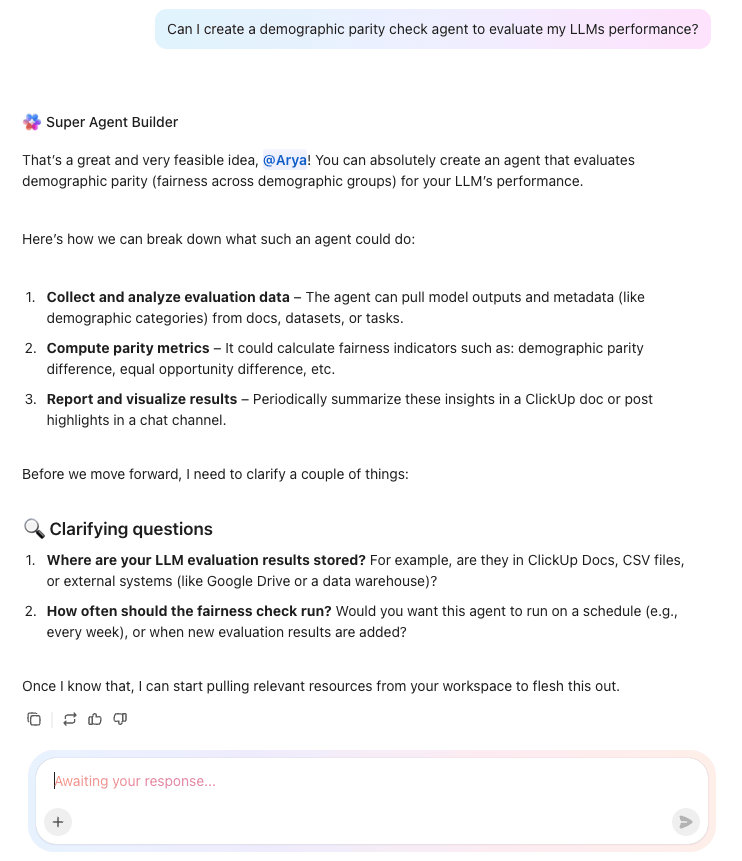

Szisztematikusan kell tesztelni az elfogultságot, hogy még mielőtt valódi kárt okozhatna, felismerje azt. Használjon méltányossági mutatókat, hogy mérje, hogyan teljesít a modellje a különböző csoportokban.

Például a demográfiai paritás ellenőrzi, hogy a modell minden csoport esetében egyenlő arányban eredményez-e pozitív kimenetelt (például hiteljóváhagyást), míg az egyenlő esélyek ellenőrzése azt vizsgálja, hogy a hibaarányok egyenlőek-e.

Vágja fel modellje teljesítményét minden lehetséges demográfiai adat szerint – faj, nem, életkor, földrajzi elhelyezkedés –, hogy felismerje, hol csökken a pontosság, vagy hol jelentkezik igazságtalanság.

Tartsa az embert a folyamatban

Az automatizált rendszerek nem veszik észre azokat a finom, kontextusfüggő igazságtalanságokat, amelyeket egy ember azonnal észrevenne. A „human-in-the-loop” megközelítés elengedhetetlen a nagy kockázatú döntéseknél, ahol az AI ajánlást tehet, de a végső döntést egy ember hozza meg.

Ez különösen fontos olyan területeken, mint a munkaerő-felvétel, a hitelezés és az orvosi diagnózis. Ahhoz, hogy ez működjön, az emberi felülvizsgálóknak képzésben kell részesülniük az elfogultság felismerése terén, és rendelkezniük kell a mesterséges intelligencia javaslatainak felülírására vonatkozó jogosultsággal.

📖 További információ: Hogyan használjuk az emberközpontú mesterséges intelligenciát a munkahelyen: A végső útmutató

Algoritmikus méltányossági technikák alkalmazása

Technikai módszerekkel is közvetlenül beavatkozhat és csökkentheti az elfogultságot. Ezek a technikák három fő kategóriába sorolhatók:

- Előfeldolgozás: Ez magában foglalja a képzési adatok előtti módosítását, mielőtt a modell meglátná azokat, gyakran az adatok újrasúlyozásával vagy újramintavételezésével, hogy a különböző csoportok kiegyensúlyozottabb ábrázolását hozzák létre.

- Feldolgozás közben: Itt közvetlenül a modell képzési folyamatába építi be a méltányossági korlátozásokat, megtanítva azt, hogy egyszerre optimalizálja a pontosságot és a méltányosságot.

- Utómunka: Ez azt jelenti, hogy a modell végső előrejelzéseit azok elkészülte után módosítják, hogy az eredmények minden csoport számára egyenlőek legyenek.

Ezek a technikák gyakran kompromisszummal járnak, ahol a teljes pontosság enyhe csökkenése szükséges lehet a méltányosság jelentős javítása érdekében.

💟 Bónusz: A BrainGPT egy AI-alapú asztali társ, amely új szintre emeli az AI elfogultság tesztelését azzal, hogy egy helyen hozzáférést biztosít több vezető modellhez, többek között a GPT-5-hez, a Claude-hoz, a Gemini-hez és még sok máshoz.

Ez azt jelenti, hogy ugyanazokat a parancsokat vagy forgatókönyveket könnyedén futtathatja különböző modelleken, összehasonlíthatja azok érvelési képességeit, és kiszúrhatja, hol térnek el a válaszok vagy mutatnak elfogultságot. Ez az AI szuperalkalmazás lehetővé teszi a beszéd-szöveggé alakítás funkció használatát is, amellyel teszteseteket állíthat be, dokumentálhatja eredményeit, és rendszerezheti az eredményeket egymás melletti elemzéshez.

Fejlett érvelési és kontextusérzékeny eszközei segítenek a problémák elhárításában, a minták kiemelésében és annak megértésében, hogy az egyes modellek hogyan közelítik meg az érzékeny témákat. A munkafolyamatok központosításával és az átlátható, többmodellű tesztelés lehetővé tételével a Brain MAX lehetővé teszi az AI elfogultságának magabiztos és pontos ellenőrzését, összehasonlítását és kezelését.

Növelje az átláthatóságot és a magyarázhatóságot

Ha nem tudja, hogyan hozza meg döntéseit a modellje, akkor nem tudja kijavítani, ha hibás. A magyarázható mesterséges intelligencia (XAI) technikák segítségével beleláthat a „fekete dobozba”, és megnézheti, mely adatjellemzők határozzák meg az előrejelzéseket.

Modellkártyákat is létrehozhat, amelyek az AI táplálkozási címkéihez hasonlóak, és dokumentálják a tervezett felhasználást, a teljesítményadatokat és az ismert korlátozásokat.

📮ClickUp Insight: A felmérésünkben résztvevők 13%-a szeretné az AI-t használni nehéz döntések meghozatalához és komplex problémák megoldásához. Ugyanakkor csak 28% mondja, hogy rendszeresen használja az AI-t a munkájában. Lehetséges ok: biztonsági aggályok!

A felhasználók nem biztos, hogy szeretnék megosztani érzékeny döntéshozatali adataikat egy külső AI-vel.

A ClickUp ezt úgy oldja meg, hogy az AI-alapú problémamegoldást közvetlenül a biztonságos munkaterületére hozza. A SOC 2-től az ISO-szabványokig a ClickUp megfelel a legmagasabb adatbiztonsági szabványoknak, és segít Önnek a generatív AI-technológia biztonságos használatában a munkaterületén.

Mesterséges intelligencia irányítási és elszámoltathatósági irányelvek

Egy erős AI irányítási program egyértelmű felelősségi köröket és következetes szabványokat hoz létre, amelyeket a csapat minden tagja követhet.

Szervezetének egyértelmű irányítási struktúrákra van szüksége, hogy mindig legyen valaki, aki felelős az AI etikus kialakításáért és bevezetéséért.

Az alábbiakban bemutatjuk a hatékony mesterséges intelligencia irányítási program alapvető elemeit:

| Irányítási elem | Mit jelent ez? | Cselekvési lépések a szervezet számára |

|---|---|---|

| Egyértelmű felelősség | Az AI etikai kérdéseiért, felügyeletéért és megfelelőségéért elkötelezett személyek vagy csapatok felelősek. | • Nevezzen ki egy mesterséges intelligencia etikai vezetőt vagy funkcióközi bizottságot • Határozza meg a felelősségi köröket az adatok, a modellminőség, a megfelelés és a kockázatok tekintetében • Vonja be a jogi, mérnöki, termékfejlesztési és DEI szakembereket a felügyeletbe |

| Dokumentált irányelvek | Írásbeli irányelvek, amelyek meghatározzák, hogyan kell az adatokat gyűjteni, felhasználni és figyelemmel kísérni az AI életciklusa során. | • Hozzon létre belső irányelveket az adatok beszerzésére, címkézésére, adatvédelmére és megőrzésére vonatkozóan • Dokumentálja a modellfejlesztés, validálás és bevezetés szabványait • Követelje meg a csapatoktól, hogy az AI-rendszerek szállítása előtt kövessék az ellenőrzőlistákat |

| Audit nyomvonalak | A döntések, modellverziók, adatkészletek és változások átlátható nyilvántartása | • Vezessen be verziókezelést az adatkészletek és modellek számára • Naplózza a legfontosabb döntéseket, a modellparamétereket és a felülvizsgálati eredményeket • Tárolja az ellenőrzési nyomvonalakat egy központi, hozzáférhető adattárban |

| Rendszeres felülvizsgálatok | Az AI-rendszerek folyamatos értékelése az elfogultság, eltérés és megfelelés hiányosságainak ellenőrzése érdekében. | • Negyedéves vagy féléves elfogultsági értékelések ütemezése robusztus LLM-értékelés segítségével • A modellek újraképzése vagy újrakalibrálása, ha a teljesítmény csökken vagy a viselkedés megváltozik • A modellek felülvizsgálata jelentős adatfrissítések vagy termékváltozások után |

| Incidenskezelési terv | Egyértelmű protokoll az AI elfogultságának vagy káros hatásának azonosítására, jelentésére és kijavítására. | • Hozzon létre egy belső elfogultság-eskalációs munkafolyamatot • Határozza meg, hogyan vizsgálják ki a problémákat, és ki hagyja jóvá a javításokat • Vázolja fel a felhasználók, ügyfelek vagy szabályozó hatóságok számára szükséges kommunikációs lépéseket |

💡Profi tipp: Az olyan keretrendszerek, mint a NIST AI kockázatkezelési keretrendszer és az EU AI törvény, amely az éves forgalom 7%-áig terjedő bírságokat ír elő, kiváló alapot nyújthatnak saját irányítási programjának kidolgozásához.

Hogyan lehet csökkenteni az elfogultságot a ClickUp segítségével?

A ClickUp konvergált AI-munkaterülete az AI-irányítási program összes mozgó elemét egy szervezett munkaterületbe egyesíti.

Csapatai feladatok kezelésére, irányelvek tárolására, audit eredmények áttekintésére, kockázatok megvitatására és incidensek nyomon követésére képesek anélkül, hogy eszközök között kellene váltaniuk vagy elveszítenék a kontextust. Minden modellrekord, döntési napló és javítási terv összekapcsolva marad, így mindig tudni fogja, ki mit tett és miért.

Mivel a ClickUp mesterséges intelligenciája megérti a munkaterületén végzett munkát, képes felhozni korábbi értékeléseket, összefoglalni hosszú jelentéseket, és segíteni a csapatának abban, hogy a szabványok fejlődésével lépést tartson. Az eredmény egy olyan irányítási rendszer, amely könnyebben követhető, könnyebben ellenőrizhető, és sokkal megbízhatóbb, ahogy a mesterséges intelligencia lábnyoma növekszik.

Vessünk egy pillantást a munkafolyamatra!

1. lépés: Állítsa be mesterséges intelligencia irányítási munkaterületét

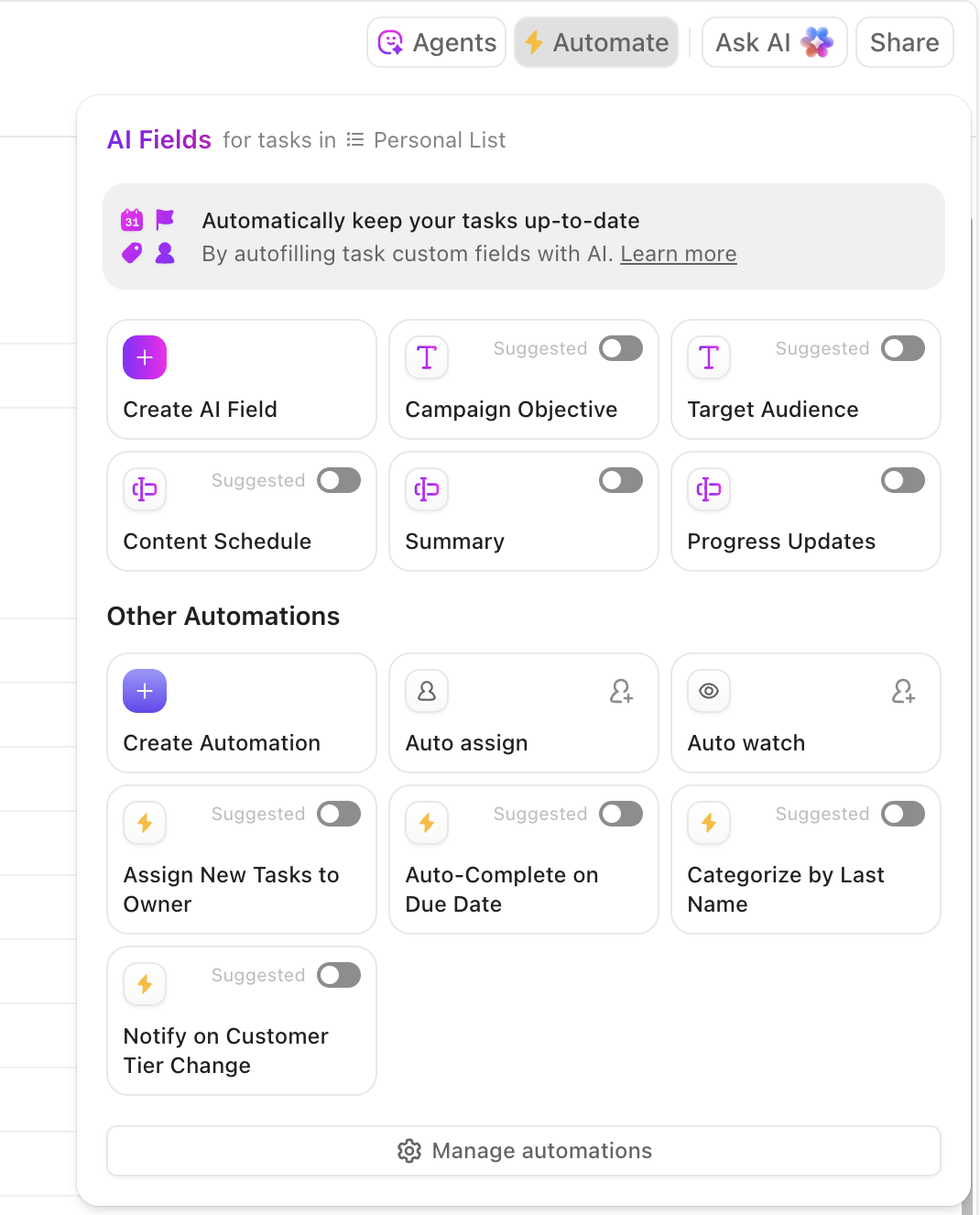

Kezdje azzal, hogy létrehoz egy külön teret a ClickUp-ban az összes irányítással kapcsolatos munkához. Adjon hozzá listákat a modellkészletéhez, az elfogultságértékelésekhez, az incidensjelentésekhez, a szabályzati dokumentumokhoz és a tervezett felülvizsgálatokhoz, hogy a program minden eleme egy ellenőrzött környezetben legyen.

Konfiguráljon egyéni mezőket vagy AI-mezőket a méltányossági mutatók, elfogultsági pontszámok, modellverziók, felülvizsgálati állapot és kockázati szintek nyomon követéséhez. Használjon szerepköralapú jogosultságokat annak biztosítására, hogy csak az engedélyezett felülvizsgálók, mérnökök és megfelelőségi vezetők férhessenek hozzá az érzékeny AI-munkákhoz. Ez olyan strukturális alapot teremt, amelyet a versenytársak pontszerszámai és általános projektplatformjai nem tudnak nyújtani.

2. lépés: Készítse el irányítási keretrendszerét

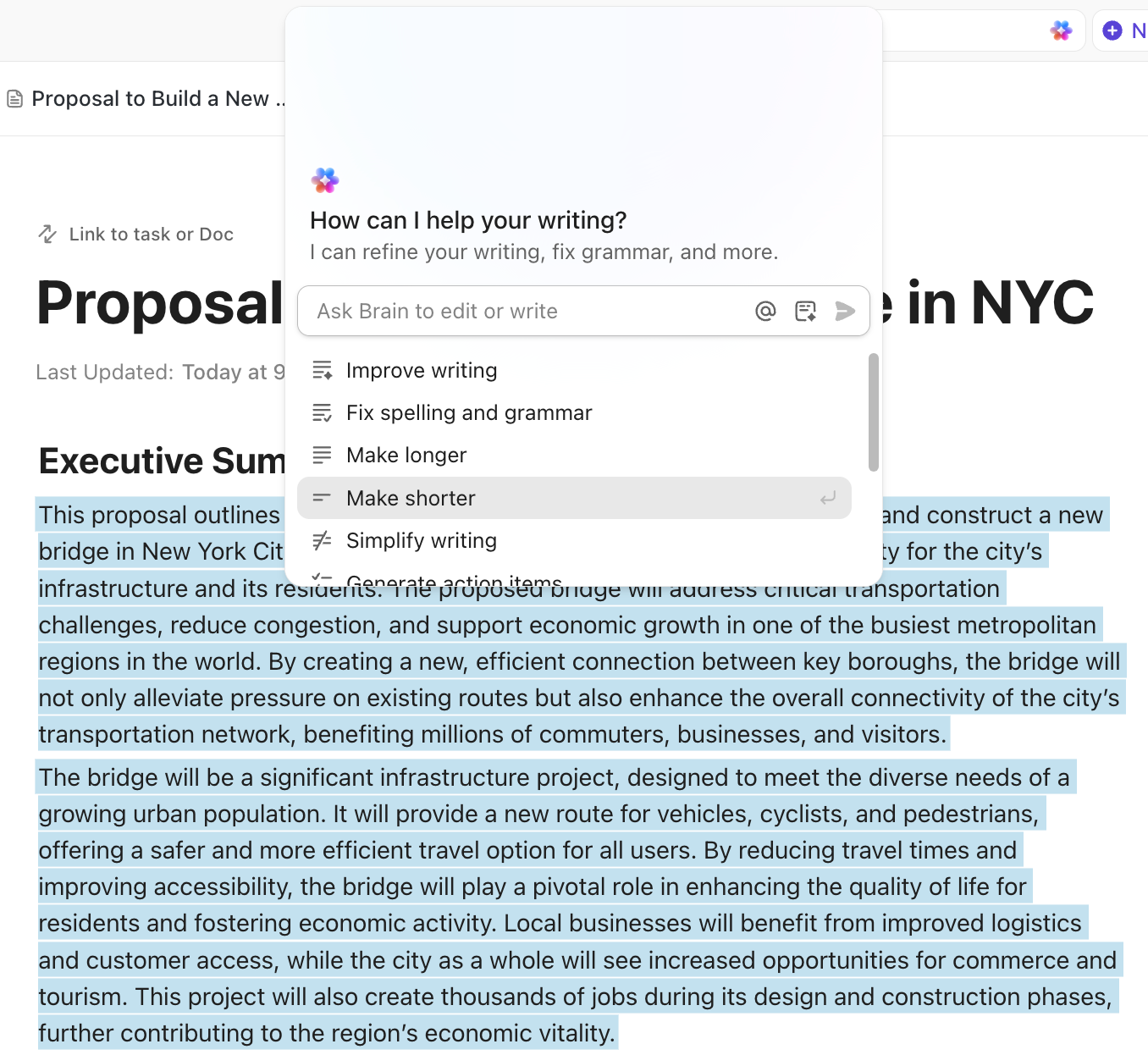

Ezután hozzon létre egy ClickUp Doc dokumentumot, amely élő irányítási útmutatóként szolgál. Itt vázolja fel az elfogultságértékelési eljárásokat, a méltányossági küszöbértékeket, a modellek dokumentálására vonatkozó irányelveket, az emberi beavatkozást igénylő lépéseket és az eskalációs protokollokat.

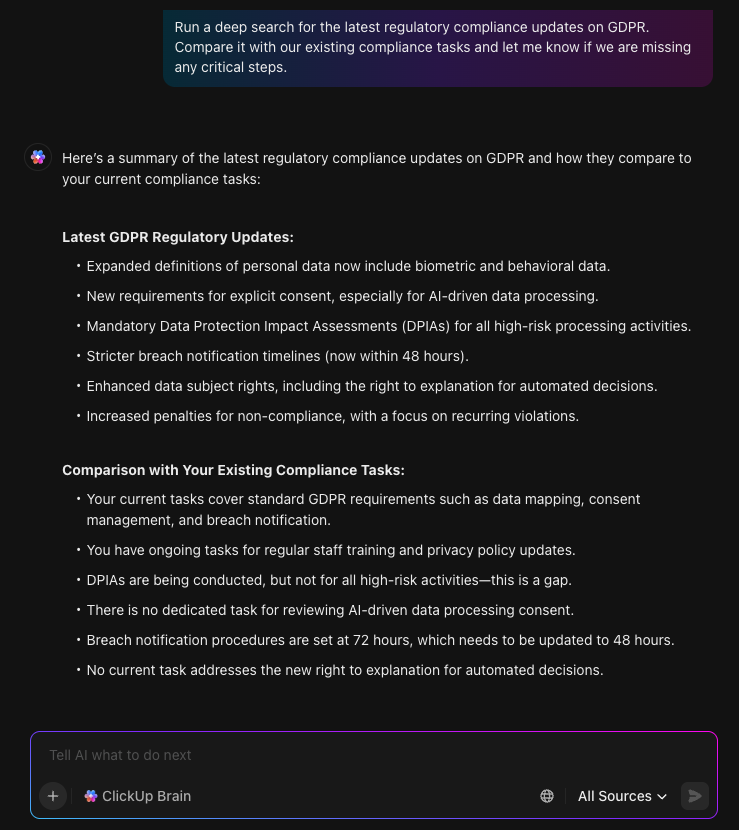

Mivel a dokumentumok kapcsolatban maradnak a feladatokkal és a modellrekordokkal, csapataid együttműködhetnek anélkül, hogy elveszítenék a verziótörténetet vagy szétszórnák a fájlokat a különböző eszközök között. Ezután a ClickUp Brain segítségével összefoglalhatod a külső szabályozásokat, új szabályzati szövegeket fogalmazhatsz meg vagy korábbi audit eredményeket hozhatsz felszínre, így a szabályzatok kidolgozása következetesebb és nyomon követhetőbb lesz.

Mivel a rendszer képes keresni az interneten, több mesterséges intelligencia modell között váltani és az információkat világos útmutatásokká szintetizálni, csapata a munkaterületet elhagyása nélkül is naprakész marad a kialakuló szabványok és az iparági változások tekintetében. Minden, amire szüksége van – szabályzatfrissítések, szabályozási betekintések és korábbi döntések – egy helyen található, így irányítási rendszere stabilabbá és sokkal könnyebben karbantarthatóvá válik.

3. lépés: Minden modell regisztrálása

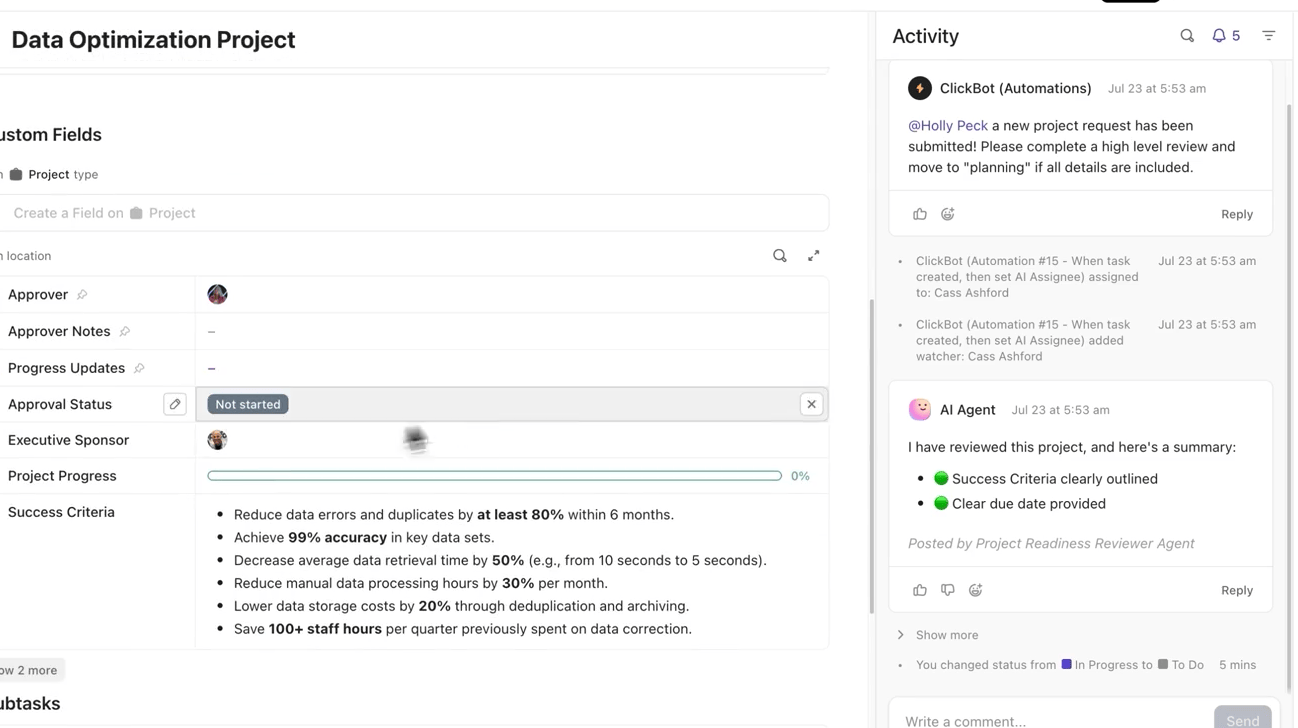

Minden modellnek meg kell lennie a saját feladatának a „Modellleltár” listában, hogy a felelősség és az elszámoltathatóság mindig egyértelmű legyen.

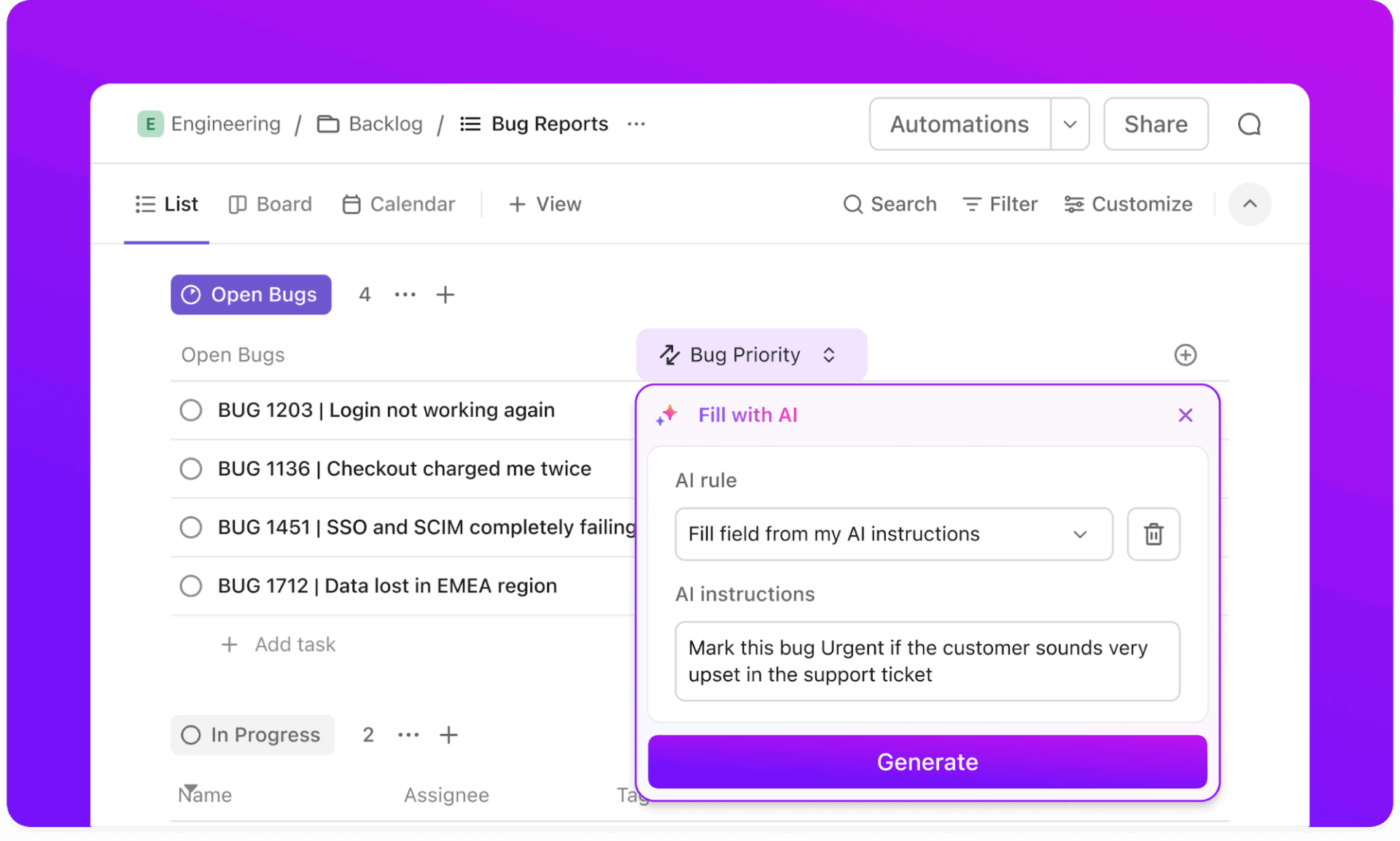

A ClickUp Tasks és a ClickUp Custom Fields segítségével könnyedén nyomon követheti minden elfogultsági esetet, mint cselekvésre váró tételt, strukturálhatja az elfogultságértékelési munkafolyamatokat, és rögzítheti minden fontos részletet.

Így nyomon követheti az elfogultság típusát, súlyosságát, a javítás állapotát, a felelős csapattagot és a következő felülvizsgálat dátumát, biztosítva, hogy minden kérdésnek egyértelmű felelőse és határideje legyen.

Csatoljon adatkészleteket, értékelési összefoglalókat és származási jegyzeteket, hogy minden egy helyen legyen. Az automatizálás segítségével a felülvizsgálók értesítést kapnak, amikor egy modell átkerül a staging vagy a termelési szakaszba.

4. lépés: Végezzen ütemezett és eseményalapú elfogultsági ellenőrzéseket

Az elfogultsági ellenőrzéseket rendszeresen és konkrét kiváltó okok esetén is el kell végezni.

Állítson be egyszerű szabályokat a ClickUp Automations segítségével, amelyek automatikusan elindítják a felülvizsgálati feladatokat, amikor egy modell eléri egy új telepítési mérföldkövet, vagy egy ütemezett audit esedékessé válik. Soha többé nem fogja elmulasztani a negyedéves elfogultsági értékelést, mivel az Automations kijelölheti a megfelelő felülvizsgálókat, beállíthatja a helyes határidőket, és akár emlékeztetőket is küldhet a határidők közeledtével.

Eseményalapú auditok esetén a ClickUp Forms egyszerűvé teszi az elfogultsági incidensekkel kapcsolatos jelentések vagy az emberi visszajelzések gyűjtését, míg a felülvizsgálók az egyéni mezőket használják a méltányossági hiányosságok, a tesztelési eredmények és az ajánlások rögzítésére. Minden űrlap benyújtása feladatként kerül továbbításra a csapatához, ami ismétlődő auditfolyamatot hoz létre.

5. lépés: Vizsgálja ki és oldja meg az elfogultsági eseteket

Ha elfogultsági problémát azonosít, hozzon létre egy incidensfeladatot, amely rögzíti a probléma súlyosságát, az érintett csoportokat, a modell verzióját és a szükséges enyhítő intézkedéseket. Az AI-ügynökök a magas kockázatú eredményeket továbbíthatják a megfelelőségi vezetőknek, és kijelölhetik a megfelelő ellenőröket és mérnököket.

Minden mérséklési intézkedés, teszt eredmény és validációs lépés kapcsolódik az incidens nyilvántartásához. A ClickUp Brain összefoglalókat készíthet a vezetőség számára, vagy segíthet a kormányzási dokumentációhoz szükséges javítási jegyzetek elkészítésében, így minden átlátható és nyomon követhető marad.

6. lépés: Figyelje az AI irányítási programjának állapotát

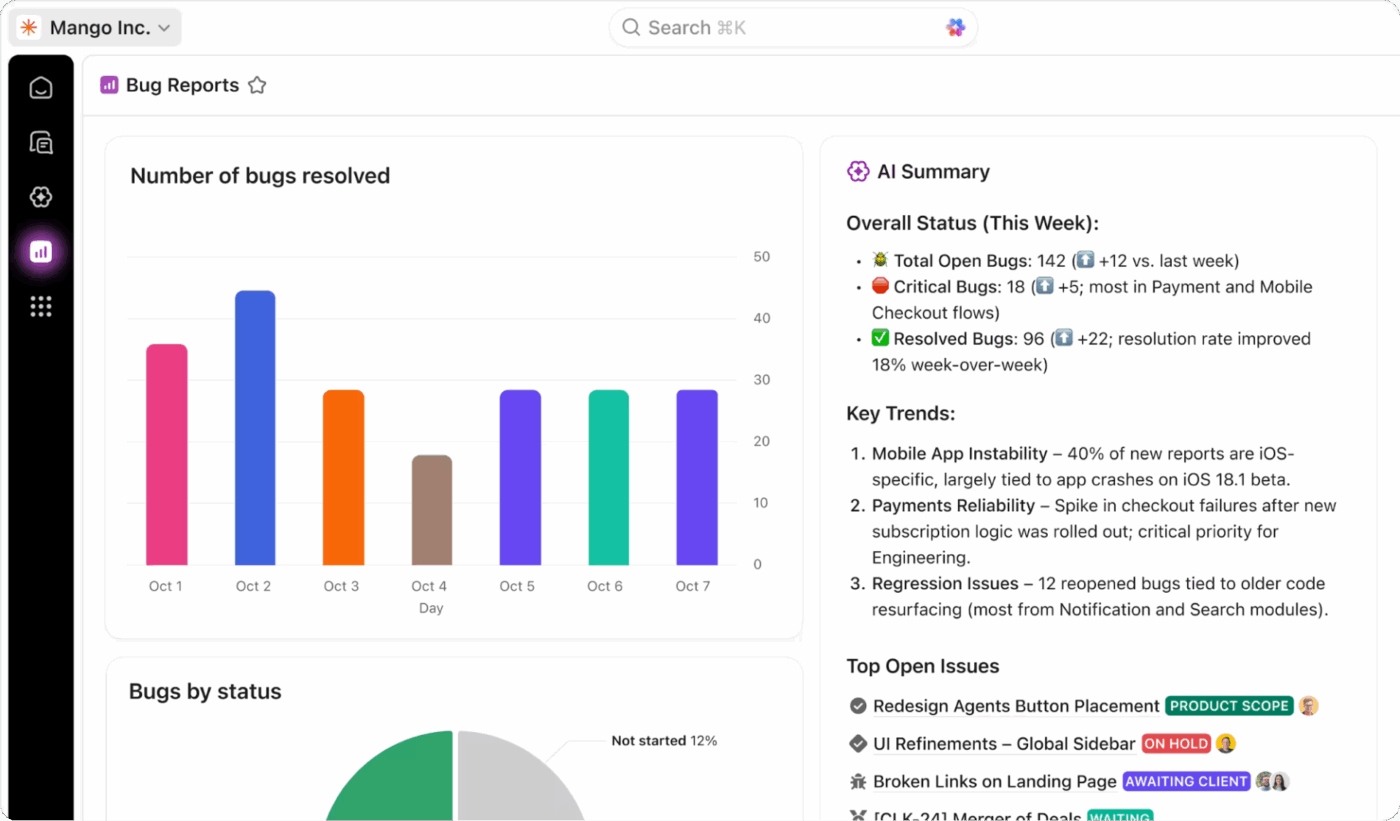

Végül hozzon létre olyan irányítópultokat, amelyek valós idejű képet adnak a vezetőknek az elfogultság csökkentésére irányuló programjáról.

Tartalmazza az összes aktív modellnél a nyitott incidenseket, a megoldásig eltelt időt, az audit befejezési arányokat, a méltányossági mutatókat és a megfelelési állapotot bemutató paneleket. A ClickUp kód nélküli irányítópultjai automatikusan lekérhetik az adatokat és frissíthetik a feladatokat a munka előrehaladtával, az irányítópult nézetébe beépített AI-összefoglalók segítségével.

📖 További információ: Hogyan lehet leküzdeni a mesterséges intelligencia általános kihívásait?

Telepítés utáni elfogultsági ellenőrzések

A munkája nem ér véget az AI-modell élesítésével.

Valójában ez az, amikor a valódi teszt elkezdődik. A modellek idővel „eltérhetnek” és új elfogultságokat alakíthatnak ki, ahogy a valós világból származó adatok, amelyeket látnak, megváltoznak. A folyamatos figyelemmel kísérés az egyetlen módja annak, hogy ezt a kialakuló elfogultságot észrevegyük, mielőtt széles körű kárt okozna.

A folyamatos figyelemmel kísérésnek a következőket kell tartalmaznia:

| Gyakorlat | Mit biztosít |

|---|---|

| Teljesítménykövetés csoportok szerint | Folyamatosan méri a modell pontosságát és méltányosságát a demográfiai szegmensekben, így a eltérések korán felismerhetők. |

| Adateltérés észlelése | Figyelemmel kíséri a bemeneti adatokban bekövetkező változásokat, amelyek idővel új elfogultságot okozhatnak vagy gyengíthetik a modell teljesítményét. |

| Felhasználói visszacsatolási ciklusok | Egyértelmű csatornákat biztosít a felhasználók számára az elfogult vagy helytelen eredmények jelentésére, javítva ezzel a valós világbeli felügyeletet. |

| Ütemezett auditok | Negyedéves vagy féléves mélyreható elemzéseket biztosít a modell viselkedéséről, a méltányossági mutatókról és a megfelelőségi követelményekről. |

| Incidenskezelés | Meghatározza a bejelentett elfogultsági események kivizsgálásának, kijavításának és dokumentálásának strukturált folyamatát. |

💟 Bónusz: Különösen a generatív AI-rendszerek igényelnek fokozott éberséget, mivel kimenetük sokkal kevésbé megjósolható, mint a hagyományos gépi tanulási modelleké. Ehhez kiváló technika a red-teaming, amelynek során egy erre szakosodott csapat aktívan megpróbálja provokálni a modell elfogult vagy káros válaszokat, hogy azonosítsa annak gyenge pontjait.

Például az Airbnb Project Lighthouse nevű projektje egy kiváló iparági esettanulmány egy olyan vállalatról, amely szisztematikus, telepítés utáni elfogultság-monitorozást valósít meg.

Ez egy kutatási kezdeményezés, amely azt vizsgálja, hogy a felfogott faj hogyan befolyásolhatja a foglalási eredményeket, segítve a vállalatot a platformon előforduló diszkrimináció azonosításában és csökkentésében. Adatvédelmi szempontból biztonságos módszereket alkalmaz, polgárjogi csoportokkal működik együtt, és az eredményeket termék- és irányelvváltozásokká alakítja, lehetővé téve, hogy több vendég láthatatlan akadályok nélkül navigálhasson a platformon.

📖 További információ: Generatív AI és prediktív AI: a különbségek és alkalmazások megértése

Csökkentse az AI elfogultságát a ClickUp segítségével

A tisztességes, elszámoltatható AI kialakítása szervezeti elkötelezettséget igényel.

Ha a politikák, az emberek, a folyamatok és az eszközök harmonikusan működnek együtt, olyan irányítási rendszert hozhat létre, amely képes alkalmazkodni az új kockázatokhoz, gyorsan reagálni az incidensekre, és elnyerni azok bizalmát, akik az Ön termékeire támaszkodnak.

A strukturált felülvizsgálatok, a világos dokumentáció és az elfogultság kezelésére szolgáló, megismételhető munkafolyamatok segítségével a csapatok összehangoltan és felelősségteljesen működnek, ahelyett, hogy válsághelyzetben reagálnának.

A ClickUp-on belül minden központosításával, a modellrekordoktól az audit eredményekig és az incidensjelentésekig, egyetlen operatív réteget hozhat létre, ahol a döntések átláthatók, a felelősségek egyértelműek, és a fejlesztések soha nem vesznek el a kavarodásban.

A szigorú irányítás nem lassítja az innovációt, hanem stabilizálja azt. Készen áll arra, hogy beépítse az elfogultság csökkentését az AI munkafolyamataiba? Kezdje el ingyenesen a ClickUp használatát, és kezdje el még ma az AI irányítási programjának kidolgozását.

Gyakran ismételt kérdések

Az első lépésként érdemes elvégezni a meglévő AI-rendszerek elfogultsági auditját. Ez az alapértékelés megmutatja, hol vannak jelenleg igazságtalanságok, és segít prioritásokat felállítani a csökkentési erőfeszítésekhez.

A csapatok konkrét méltányossági mutatókat, például demográfiai paritást, kiegyenlített esélyeket és eltérő hatási arányt használnak az elfogultság számszerűsítésére. A megfelelő mutató az Ön konkrét felhasználási esetétől és attól függ, hogy az adott kontextusban melyik méltányossági típus a legfontosabb.

Mindig érdemes emberi felülvizsgálati lépést beiktatni olyan fontos döntések esetén, amelyek jelentősen befolyásolják egy személy életét vagy lehetőségeit, például a munkaerő-felvétel, a hitelezés vagy az egészségügyi ellátás területén. Ugyancsak célszerű ezt alkalmazni bármely új modell korai bevezetése során, amikor annak viselkedése még kiszámíthatatlan.

Mivel a generatív AI szinte végtelenül sokféle, előre nem látható választ adhat, nem elég csak a pontosságot ellenőrizni. Aktív vizsgálati technikákat kell alkalmazni, például red-teaminget és nagyméretű kimeneti mintavételt, hogy kiderüljön, vajon a modell különböző körülmények között elfogult tartalmat állít-e elő.