คนส่วนใหญ่คิดว่าพวกเขาต้องเลือกระหว่างการใช้เครื่องมือ AI ที่ทรงพลังหรือการรักษาข้อมูลส่วนตัวของพวกเขาไว้ แต่คุณสามารถมีทั้งสองอย่างได้ การใช้งาน AI ในเครื่องหมายความว่าการข้อมูลจะไม่ถูกส่งออกจากฮาร์ดแวร์ของคุณ คุณยังคงควบคุมข้อมูลของคุณได้อย่างเต็มที่ในขณะที่ยังคงทำงานซ้ำๆ ของคุณให้เป็นอัตโนมัติ

คู่มือนี้จะแสดงวิธีการใช้ AI ท้องถิ่นเพื่อสร้างกระบวนการทำงานที่ปลอดภัยโดยใช้เครื่องมือเช่น Ollama คุณจะได้เรียนรู้วิธีการเลือกโมเดลโอเพนซอร์สที่เหมาะกับสเปคฮาร์ดแวร์เฉพาะของคุณ และสร้างกระบวนการทำงานอัตโนมัติที่ประมวลผลเอกสารส่วนตัวในเครื่อง

เราจะพิจารณาการรวมเวิร์กโฟลว์ไว้ในที่เดียว เช่นClickUp ด้วย 😎

อะไรคือ AI ท้องถิ่น?

ระบบ AI ท้องถิ่นหมายความว่าคุณสามารถใช้งานแบบจำลองภาษาขนาดใหญ่(LLMs) ได้ทั้งหมดบนฮาร์ดแวร์ของคุณเอง—เช่น แล็ปท็อปหรือเซิร์ฟเวอร์ภายในองค์กร—แทนที่จะส่งข้อมูลของคุณไปยังบริการคลาวด์ภายนอก ซึ่งเหมาะสำหรับทีมใดก็ตามที่จัดการข้อมูลที่ละเอียดอ่อน ตั้งแต่ฝ่ายวิศวกรรมและการออกแบบผลิตภัณฑ์ ไปจนถึงฝ่ายกฎหมายและการเงิน

ด้วยเครื่องมือ AI ที่ใช้ระบบคลาวด์ส่วนใหญ่ คำสั่ง, เอกสาร, และข้อมูลของคุณจะถูกส่งไปยังเซิร์ฟเวอร์ของบุคคลที่สาม คุณจะสูญเสียการควบคุมวิธีการประมวลผล, การจัดเก็บ, หรือการใช้ข้อมูลนั้น

ในทางกลับกัน AI ท้องถิ่นจะเก็บข้อมูลของคุณไว้ภายในสภาพแวดล้อมของคุณ คุณยังคงควบคุมความปลอดภัยและการปกป้องข้อมูลสำหรับกระบวนการทำงานของคุณได้อย่างสมบูรณ์

แน่นอนว่ามีข้อแลกเปลี่ยน การตั้งค่า AI ในพื้นที่ต้องใช้ความพยายามทางเทคนิคมากขึ้นและต้องลงทุนในฮาร์ดแวร์ล่วงหน้า อย่างไรก็ตาม มันจะขจัดความพึ่งพาผู้ให้บริการภายนอกออกไปอย่างสิ้นเชิง ด้วยการประมวลผลบนอุปกรณ์ ข้อมูลของคุณจะคงอยู่ตรงที่คุณต้องการอย่างแท้จริง

ทำไม AI ท้องถิ่นจึงมีความสำคัญต่อการทำงานของทีมอย่างปลอดภัย

🔎 คุณทราบหรือไม่? มีเพียง1 ใน 10 ของผู้บริโภคเท่านั้นที่เต็มใจแบ่งปันข้อมูลที่ละเอียดอ่อน เช่น ข้อมูลทางการเงิน การสื่อสาร หรือข้อมูลชีวมิติ กับระบบที่ขับเคลื่อนด้วย AI

ความลังเลนี้สะท้อนถึงความเป็นจริงที่เพิ่มขึ้นสำหรับทีม B2B ด้วย AI บนคลาวด์ คุณกำลังมอบทรัพย์สินทางปัญญาของบริษัทให้กับบุคคลที่สาม ซึ่งสำหรับทีมกฎหมาย การเงิน หรือทรัพยากรบุคคลแล้ว สิ่งนี้ก่อให้เกิดความรับผิดชอบทางกฎหมายอย่างมหาศาล

การเปลี่ยนแปลงของ AI ในระดับท้องถิ่นเปลี่ยนแปลงพลวัตนี้โดยการย้าย AI ไปยังฮาร์ดแวร์ของคุณเอง นี่คือเหตุผลว่าทำไมสิ่งนี้จึงมีความสำคัญต่อการดำเนินงานประจำวันของคุณ:

- กำจัดการรั่วไหลของข้อมูล: ป้องกันไม่ให้โค้ดที่เป็นกรรมสิทธิ์หรือสัญญาของลูกค้าถูกนำไปใช้ในการฝึกอบรมโมเดลสาธารณะที่คู่แข่งของคุณอาจนำไปใช้

- รักษาการปฏิบัติตามข้อกำหนดทางกฎหมาย: ปฏิบัติตามข้อกำหนดของ GDPRหรือ HIPAAอย่างเคร่งครัดเนื่องจากข้อมูลที่ละเอียดอ่อนจะไม่ถูกส่งข้ามพรมแดนระหว่างประเทศหรือเข้าสู่เซิร์ฟเวอร์ของบุคคลที่สาม

- ขจัดความพึ่งพาอินเทอร์เน็ต: ดำเนินการวิเคราะห์ข้อมูลที่ซับซ้อนหรืองานร่างเอกสารในช่วงที่ระบบอินเทอร์เน็ตขัดข้อง หรือในสภาพแวดล้อมที่มีความปลอดภัยสูงซึ่งการเข้าถึงคลาวด์ถูกจำกัด

- บริหารจัดการต้นทุนได้อย่างคาดการณ์: หลีกเลี่ยงค่าธรรมเนียม API ที่เพิ่มขึ้นเมื่อทีมของคุณขยายตัว เนื่องจากต้นทุนของคุณมีเพียงฮาร์ดแวร์ที่คุณมีอยู่แล้วเท่านั้น

โดยการผสานรวม AI ท้องถิ่นกับเครื่องมือที่คุณมีอยู่แล้ว คุณสามารถทำให้การทำงานของคุณเป็นอัตโนมัติได้โดยไม่กระทบต่อความปลอดภัยของคุณ

⚠️ อย่างไรก็ตาม สิ่งสำคัญคือต้องจำไว้ว่าปัญหานี้อาจเลวร้ายลงได้ ทีมของคุณอาจต้องการนำเครื่องมือ AI หลายตัวมาใช้ ซึ่งอาจนำไปสู่การแพร่กระจายของ AI— การเพิ่มขึ้นของเครื่องมือ AI โดยไม่มีการกำกับดูแลหรือกลยุทธ์ ซึ่งอาจนำไปสู่การสูญเสียเงิน ความพยายามซ้ำซ้อน และความเสี่ยงด้านความปลอดภัย

ท้ายที่สุดแล้ว มันจะขยายรูปแบบภัยคุกคามด้านความปลอดภัยของคุณและทำให้การติดตามงานยากขึ้น

📮ClickUp Insight: ทีมที่มีประสิทธิภาพต่ำมีแนวโน้มที่จะใช้เครื่องมือมากกว่า 15 ชิ้นถึง 4 เท่า ในขณะที่ทีมที่มีประสิทธิภาพสูงยังคงรักษาประสิทธิภาพด้วยการจำกัดเครื่องมือไว้ที่ 9 แพลตฟอร์มหรือน้อยกว่า แต่การใช้แพลตฟอร์มเดียวล่ะ? ในฐานะแอปครบวงจรสำหรับการทำงานClickUpนำงาน โครงการ เอกสาร วิกิ แชท และการโทรของคุณมารวมไว้ในแพลตฟอร์มเดียว พร้อมด้วยเวิร์กโฟลว์ที่ขับเคลื่อนด้วย AI พร้อมทำงานอย่างชาญฉลาดขึ้นหรือไม่? ClickUp ทำงานได้กับทุกทีม ทำให้งานของคุณมองเห็นได้ และให้คุณมุ่งเน้นกับสิ่งที่สำคัญ ขณะที่ AI จัดการส่วนที่เหลือให้คุณ

คุณต้องการอะไรเพื่อใช้งาน AI ท้องถิ่น?

คุณไม่จำเป็นต้องใช้ซูเปอร์คอมพิวเตอร์เฉพาะทางเพื่อรัน AI ในเครื่องของคุณเอง การเปลี่ยนแปลงล่าสุดในวิธีการสร้างโมเดลทำให้คุณสามารถเริ่มต้นด้วยฮาร์ดแวร์ที่คุณมีอยู่แล้ว สิ่งที่จำเป็นคือต้องตรงตามเกณฑ์เฉพาะไม่กี่ข้อเท่านั้น

ข้อกำหนดด้านฮาร์ดแวร์

ฮาร์ดแวร์ของคุณกำหนดขนาดและความเร็วของโมเดล AIที่คุณสามารถใช้งานได้ แม้ว่าเครื่องที่มีประสิทธิภาพสูงจะช่วยให้คุณรันโมเดลการให้เหตุผลที่ซับซ้อนมากขึ้นได้ แต่โมเดลขนาดเล็กก็มีความสามารถที่น่าประหลาดใจเช่นกัน

- GPU พร้อม VRAM: การ์ด NVIDIA แบบเฉพาะที่มี VRAM อย่างน้อย 12GB เป็นจุดที่เหมาะสมที่สุดสำหรับทีมส่วนใหญ่ในปัจจุบัน ซึ่งช่วยให้คุณสามารถรันโมเดลขนาดกลาง เช่น Llama 3.3 (8B) หรือ Mistral Small ได้ด้วยความเร็วสูง

- RAM ของระบบ: หากคุณไม่มี GPU ระดับสูง RAM ของคอมพิวเตอร์ของคุณจะรับภาระงานแทน 32GB ให้พื้นที่เพียงพอสำหรับการรันโมเดลในขณะที่ยังคงเปิดเบราว์เซอร์และเครื่องมือจัดการโปรเจกต์ของคุณไว้ได้

- หน่วยความจำรวม (สำหรับผู้ใช้ Mac): หากคุณใช้ Mac ที่มีชิปซีรีส์ M (M2, M3 หรือ M4) หน่วยความจำ RAM และ GPU ของคุณจะถูกรวมกันใช้ร่วมกัน ซึ่งทำให้ Mac มีประสิทธิภาพเป็นพิเศษสำหรับการประมวลผล AI ในเครื่อง เนื่องจากโมเดลสามารถเข้าถึงหน่วยความจำทั้งหมดได้

- การจัดเก็บอย่างรวดเร็ว: โมเดลเป็นไฟล์ขนาดใหญ่ มักมีขนาดตั้งแต่ 5GB ถึง 50GB การใช้ NVMe SSD เป็นสิ่งจำเป็นเพื่อหลีกเลี่ยงเวลาการโหลดนานเมื่อโหลดโมเดลใหม่

🔎 คุณรู้หรือไม่? การสร้างคอมพิวเตอร์ในปัจจุบันมีค่าใช้จ่ายสูงกว่าเมื่อไม่กี่เดือนก่อนอย่างมาก ก่อนหน้านี้ ชุดหน่วยความจำ DDR5 ขนาด 32GB มีราคาต่ำกว่า 130 ดอลลาร์ แต่ตอนนี้ชุดเดียวกันนี้พุ่งสูงเกิน 400 ดอลลาร์แล้ว การเปลี่ยนแปลงนี้ทำให้ 32GB กลายเป็นขนาดขั้นต่ำใหม่สำหรับการทำงาน AI บนเครื่องอย่างจริงจัง เนื่องจากคุณต้องมีพื้นที่ว่างเพียงพอในการรันโมเดลโดยไม่ทำให้ประสิทธิภาพของระบบลดลง

ข้อกำหนดของซอฟต์แวร์

ซอฟต์แวร์ทำหน้าที่เป็นสะพานเชื่อมระหว่างฮาร์ดแวร์ของคุณกับระบบปัญญาประดิษฐ์ คุณไม่จำเป็นต้องเป็นนักพัฒนาอีกต่อไปเพื่อให้ระบบนี้ทำงานได้

- ระบบปฏิบัติการ: แม้ว่า Linux จะเป็นบ้านเกิดของ AI แต่ Windows และ macOS ก็มีความสามารถเทียบเท่ากันในปัจจุบัน ผู้ใช้ Windows สามารถใช้ WSL2 เพื่อสร้างสภาพแวดล้อมที่คล้ายกับ Linux แม้ว่าเครื่องมือหลายอย่างจะสามารถทำงานได้โดยตรงบน Windows แล้วก็ตาม

- ผู้จัดการโมเดล: เครื่องมือเช่น Ollama หรือ LM Studio เป็นจุดเริ่มต้นที่ง่ายที่สุด พวกมันจัดการการควอนไทซ์—การบีบอัดโมเดลให้พอดีกับฮาร์ดแวร์ของคุณโดยอัตโนมัติ

- ผู้ขับขี่: คุณจะต้องมีไดร์เวอร์ล่าสุดสำหรับฮาร์ดแวร์ของคุณ เช่น ไดร์เวอร์ CUDA ล่าสุดสำหรับบัตร NVIDIA. ตัวติดตั้งที่ทันสมัยส่วนใหญ่จะตรวจสอบให้คุณในระหว่างการติดตั้ง

ตัวเลือก LLM แบบโอเพนซอร์ส

เรากำลังเห็นการเพิ่มขึ้นอย่างรวดเร็วของโมเดลน้ำหนักเปิดที่คุณสามารถดาวน์โหลดได้ฟรี โมเดลเหล่านี้ถูกพัฒนาโดยบริษัทต่างๆ เช่น Meta (Llama), Mistral และ Alibaba (Qwen) ซึ่งแตกต่างจากระบบปิด โมเดลเหล่านี้อนุญาตให้คุณเห็นการทำงานได้อย่างชัดเจนและทราบว่าข้อมูลของคุณไปที่ไหน

เมื่อเลือกแบบจำลองภาษาขนาดใหญ่ ให้ตรวจสอบใบอนุญาตซอฟต์แวร์ ส่วนใหญ่ใช้ Apache 2.0 หรือ MIT ซึ่งอนุญาตให้คุณนำไปใช้ในกิจการธุรกิจได้โดยไม่ต้องเสียค่าธรรมเนียมรายเดือน เนื่องจากแบบจำลองเหล่านี้ทำงานบนฮาร์ดแวร์ของคุณเอง จึงสามารถผสานเข้ากับกระบวนการทำงานส่วนตัวของคุณได้โดยตรง

ตัวอย่างเช่น คุณสามารถใช้โมเดลท้องถิ่นเพื่อร่างอีเมลภายใน สรุปบันทึกการประชุม หรือวิเคราะห์ชุดข้อมูลที่เป็นกรรมสิทธิ์ได้ วิธีนี้จะช่วยให้รายละเอียดโครงการที่ละเอียดอ่อนที่สุดและบันทึกเชิงกลยุทธ์ของคุณยังคงอยู่ในเครื่องของคุณ

🧠 ข้อเท็จจริงที่น่าสนใจ: ชิป M-series ของ Apple มอบข้อได้เปรียบทางสถาปัตยกรรมที่เป็นเอกลักษณ์สำหรับทีมที่ให้ความสำคัญกับความเป็นส่วนตัว หน่วยความจำรวมของ Mac ช่วยให้ AI สามารถใช้หน่วยความจำ RAM ของระบบทั้งหมดได้เหมือนกับหน่วยความจำกราฟิกเฉพาะ

นั่นหมายความว่า MacBook ที่ติดตั้ง RAM 128GB สามารถรันโมเดลขนาดใหญ่และซับซ้อนสูงซึ่งโดยปกติจะต้องใช้ฮาร์ดแวร์เฉพาะทางสำหรับองค์กรที่มีราคาสูงกว่า 10,000 ดอลลาร์ได้

โมเดล AI ท้องถิ่นที่ดีที่สุดสำหรับกระบวนการทำงานของทีม

ในการค้นหาโมเดลที่เหมาะสม ให้จับคู่จุดแข็งของโมเดลกับงานของทีมและความสามารถของฮาร์ดแวร์ของคุณ

แบบจำลองเอนกประสงค์

นี่คือเครื่องมือหลักของการทำงานในท้องถิ่นของคุณ ใช้สำหรับร่างอีเมล สรุปความคืบหน้าของโครงการ หรือระดมความคิดสร้างสรรค์

- Llama 4 Scout (17B): มีหน้าต่างบริบทขนาด 10 ล้านโทเค็น ซึ่งช่วยให้คุณสามารถประมวลผลข้อความได้หลายพันหน้าพร้อมกัน

- Mistral Small 4: ใช้สถาปัตยกรรมแบบผสมผสานผู้เชี่ยวชาญ หมายความว่ามันจะเปิดใช้งานพารามิเตอร์เพียงบางส่วนสำหรับแต่ละงานเท่านั้น

- Qwen 3.5 (7B): มีประสิทธิภาพเหนือกว่าอย่างต่อเนื่องหากทีมของคุณจัดการเอกสารทางเทคนิคในหลายภาษา

แบบจำลองสำหรับการให้เหตุผลและการใช้เครื่องมือ

ใช้สิ่งเหล่านี้เมื่อคุณต้องการให้ตัวแทน LLMแก้ไขปัญหาหลายขั้นตอน ทำตามตรรกะที่ซับซ้อน หรือทำหน้าที่เป็นตัวแทนอิสระภายในเวิร์กโฟลว์ของคุณ

- Llama 4 Maverick: รองรับหลายรูปแบบโดยกำเนิด ทำให้เหมาะสำหรับทีมที่ต้องการวิเคราะห์แผนภูมิที่ซับซ้อนหรือสเปรดชีตทางการเงิน ซึ่งบริบททางภาพมีความสำคัญพอๆ กับข้อความ

- Phi-4 (14B): ปรับแต่งสำหรับการเรียนรู้เชิงวิทยาศาสตร์และตรรกะ ใช้สำหรับการตรวจสอบข้อมูลหรือการคำนวณทางคณิตศาสตร์ที่ซับซ้อนซึ่งโดยปกติแล้วต้องใช้โมเดลที่มีขนาดใหญ่และมีค่าใช้จ่ายสูงกว่ามาก

- DeepSeek-R1: แสดงลำดับความคิดภายใน ซึ่งช่วยให้คุณตรวจสอบตรรกะสำหรับการวิเคราะห์ที่มีความเสี่ยงสูง เหมาะสำหรับการวิจัยเชิงลึกและการวางแผนกลยุทธ์

แบบจำลองเฉพาะงาน

บางครั้ง เครื่องมือเฉพาะทางมีประสิทธิภาพมากกว่าผู้ช่วยทั่วไป โมเดลเหล่านี้ได้รับการปรับแต่งให้เหมาะสมกับส่วนใดส่วนหนึ่งของกระบวนการทำงานของคุณโดยเฉพาะ

- Qwen 3-Coder-Next: เข้าใจตรรกะในระดับคลังข้อมูล ช่วยให้สามารถแนะนำการแก้ไขข้อบกพร่องหรือปรับปรุงโครงสร้างโค้ดข้ามไฟล์ได้หลายไฟล์ พร้อมปฏิบัติตามแนวทางสไตล์เฉพาะของทีมคุณ

- Voxtral Mini: ระบุผู้พูดที่แตกต่างกันในบันทึกเสียงและเปลี่ยนการบันทึกการประชุมส่วนตัวให้กลายเป็นข้อความที่สามารถค้นหาได้ ทำงานได้ทั้งหมดแบบออฟไลน์ เหมาะสำหรับการป้องกันการรั่วไหลของข้อมูล

- Nomic Embed v1. 5: เปลี่ยนเอกสารส่วนตัวของคุณให้เป็นข้อมูลทางคณิตศาสตร์เพื่อการค้นหาเชิงความหมาย ซึ่งช่วยให้คุณสามารถค้นหาฐานความรู้ภายในทีมของคุณโดยใช้ความหมายแทนการค้นหาด้วยคำสำคัญ

📚 อ่านเพิ่มเติม:เครื่องมือค้นหา LLM: การสืบค้นข้อมูลด้วยปัญญาประดิษฐ์

เครื่องมือยอดนิยมสำหรับการรัน AI ในเครื่อง

คุณไม่จำเป็นต้องเป็นวิศวกรซอฟต์แวร์อีกต่อไปเพื่อรันโมเดลบนเครื่องของคุณเอง. มีแอปพลิเคชันที่ใช้งานง่ายหลายตัวที่จัดการการตั้งค่าทางเทคนิคให้คุณเสร็จสิ้นในเวลาไม่กี่นาที.

Ollama และ OpenWebUI

Ollama เหมาะสำหรับคุณหากคุณต้องการความเร็วและความยืดหยุ่น มันทำงานในพื้นหลังและจัดการไลบรารีโมเดลของคุณผ่านอินเทอร์เฟซที่เรียบง่าย

แม้ว่าจะเริ่มต้นเป็นเครื่องมือพื้นฐาน แต่คนส่วนใหญ่จะใช้งานร่วมกับ OpenWebUI ซึ่งจะเพิ่มประสบการณ์การแชทที่สมบูรณ์แบบในเบราว์เซอร์ของคุณ ให้ดูและรู้สึกเหมือนกับเครื่องมือบนคลาวด์ที่คุณคุ้นเคย นอกจากนี้ยังสร้างสะพานเชื่อมต่อในเครื่องสำหรับแอปอื่นๆ บนคอมพิวเตอร์ของคุณเพื่อสื่อสารกับโมเดล AI ของคุณอย่างปลอดภัย

LM Studio

หากคุณต้องการแอปพลิเคชันเดสก์ท็อปแบบดั้งเดิม LM Studio เป็นทางเลือกที่ยอดเยี่ยม มันทำหน้าที่เหมือนกับแอปสโตร์สำหรับ AI คุณสามารถใช้มันเพื่อค้นหา ดาวน์โหลด และคุยกับโมเดลใหม่ได้ในเพียงไม่กี่คลิก

แอปนี้มีการตรวจจับฮาร์ดแวร์ในตัว ดังนั้นจึงสามารถปรับการตั้งค่าของคุณให้ตรงกับ GPU หรือ RAM ที่คุณใช้ได้โดยอัตโนมัติ ซึ่งทำให้เป็นจุดเริ่มต้นที่ดีหากคุณต้องการทดลองใช้โมเดลต่างๆ โดยไม่ต้องเขียนโค้ดแม้แต่บรรทัดเดียว

จีพีที4ออล

สำหรับทีมที่มุ่งเน้นเฉพาะเรื่องความเป็นส่วนตัวและการวิเคราะห์เอกสาร GPT4All เป็นโซลูชันที่เชื่อถือได้และใช้งานง่าย มันทำงานได้บนคอมพิวเตอร์เกือบทุกเครื่อง รวมถึงแล็ปท็อปรุ่นเก่าที่อาจไม่มีกราฟิกการ์ดเฉพาะ

คุณสมบัติที่มีประโยชน์ที่สุดของมันคือความสามารถในการแชทกับไฟล์ท้องถิ่นของคุณได้โดยตรง คุณสามารถชี้แอปไปที่โฟลเดอร์บนฮาร์ดดิสก์ของคุณ และ AI จะตอบคำถามเกี่ยวกับเอกสารเฉพาะเหล่านั้นได้ ทั้งหมดนี้โดยไม่ต้องอัปโหลดไฟล์ไปยังเซิร์ฟเวอร์ของบุคคลที่สามเลย

📚 อ่านเพิ่มเติม:ตัวแทน AI ที่ดีที่สุดสำหรับผู้ใช้ที่ไม่มีความรู้ด้านการเขียนโค้ด

วิธีตั้งค่า AI ท้องถิ่นสำหรับกระบวนการทำงานที่ปลอดภัย

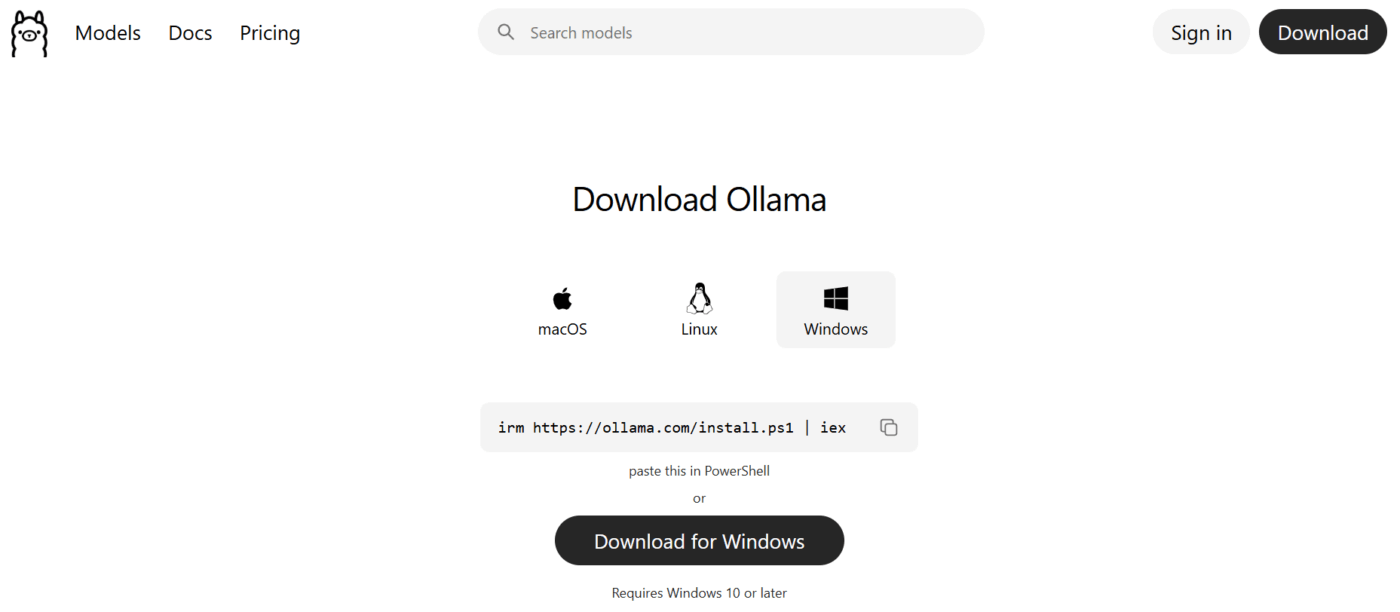

คู่มือการใช้งานนี้ใช้ Ollama เนื่องจากเป็นเครื่องมือที่ได้รับการสนับสนุนอย่างกว้างขวางสำหรับการสร้างเวิร์กโฟลว์ AI ที่ปลอดภัยในเครื่อง

ขั้นตอนที่ 1: ติดตั้ง Ollama

ดาวน์โหลดตัวติดตั้งจากเว็บไซต์อย่างเป็นทางการสำหรับระบบปฏิบัติการของคุณโดยเฉพาะ. ในขณะที่เวอร์ชันก่อนหน้าของ Windows ต้องการการติดตั้งระบบย่อย Linux ด้วยตนเอง ตัวติดตั้งในปัจจุบันติดตั้งเป็นแอปพลิเคชันแบบเนทีฟ.

การติดตั้งควรใช้เวลาเพียงไม่กี่นาที เมื่อการติดตั้งเสร็จสิ้นแล้ว ให้เปิดเทอร์มินัลหรือพรอมต์คำสั่งของคุณและพิมพ์ ollama --version เพื่อยืนยันว่าพร้อมใช้งานแล้ว

ขั้นตอนที่ 2: ดาวน์โหลดและเรียกใช้โมเดล

ในการเริ่มต้นใช้งาน AI คุณจำเป็นต้องดึงค่าพารามิเตอร์ของมันมาไว้ที่เครื่องของคุณ สำหรับการทดสอบครั้งแรก ลองใช้โมเดลที่กะทัดรัดแต่ทรงพลัง เช่น Llama 3.2 (3B) หรือ Mistral รุ่นล่าสุด

ใช้คำสั่ง ollama run llama3.2 เพื่อเริ่มการดาวน์โหลด

ขึ้นอยู่กับความเร็วอินเทอร์เน็ตของคุณ ขั้นตอนนี้อาจใช้เวลาไม่กี่นาที เมื่อการดาวน์โหลดเสร็จสิ้น คุณสามารถพิมพ์คำสั่งโดยตรงในเทอร์มินัลเพื่อรับคำตอบทันทีจากโมเดลบนฮาร์ดไดรฟ์ของคุณ

ขั้นตอนที่ 3: เชื่อมต่อกับเครื่องมือเวิร์กโฟลว์ของคุณ

คุณค่าที่แท้จริงของ AI ท้องถิ่นมาจากการผสานรวมเข้ากับงานประจำวันของคุณ เมื่อ Ollama กำลังทำงานอยู่ มันจะเริ่มเซิร์ฟเวอร์ท้องถิ่นที่ http://localhost:11434 โดยอัตโนมัติ ซึ่งสร้างสะพานที่ปลอดภัยสำหรับแอปพลิเคชันอื่น ๆ ในการสื่อสารกับโมเดลของคุณ

เนื่องจากเซิร์ฟเวอร์นี้รองรับโปรโตคอลมาตรฐานของ OpenAI คุณสามารถเชื่อมต่อกับแพลตฟอร์มอัตโนมัติหรือสคริปต์ภายในได้โดยเพียงแค่เปลี่ยนที่อยู่ API ตัวอย่างเช่น คุณสามารถชี้เครื่องมือค้นหาเอกสารในเครื่องไปยังที่อยู่นี้ ซึ่งจะช่วยให้เครื่องมือสามารถสรุปไฟล์ส่วนตัวได้โดยไม่ต้องส่งข้อความนั้นไปยังคลาวด์เลย

📖 อ่านเพิ่มเติม: วิธีปรับปรุงการประสานงานของกระบวนการทำงานให้มีประสิทธิภาพยิ่งขึ้น

แนวทางปฏิบัติที่ดีที่สุดด้านความปลอดภัยสำหรับเวิร์กโฟลว์ AI ในระบบท้องถิ่น

การรัน AI บนเครื่องเป็นก้าวสำคัญในการปกป้องความเป็นส่วนตัว อย่างไรก็ตาม การเก็บข้อมูลไว้บนเครื่องหมายความว่าคุณต้องรับผิดชอบในการปกป้องข้อมูลนั้นด้วยตนเอง แม้ว่าคุณจะลดความเสี่ยงจากการรั่วไหลของข้อมูลบนคลาวด์ของบุคคลที่สามได้แล้ว แต่คุณยังคงต้องรักษาความปลอดภัยของฮาร์ดแวร์และวิธีการที่ทีมของคุณโต้ตอบกับโมเดลเหล่านั้น

ปฏิบัติตามแนวทางปฏิบัติที่ดีที่สุดเหล่านี้:

- การแยกเครือข่าย: จำกัดการเข้าถึง API เฉพาะเครือข่ายภายในที่เชื่อถือได้ เพื่อให้เซิร์ฟเวอร์ AI ของคุณไม่สามารถเข้าถึงได้จากอินเทอร์เน็ตสาธารณะ

- การตรวจสอบข้อมูลนำเข้า: ทำความสะอาดข้อมูลทั้งหมดก่อนส่งไปยังโมเดล เพื่อป้องกันคำสั่งที่เป็นอันตรายที่ซ่อนอยู่ในเอกสารหรืออีเมล

- การควบคุมการเข้าถึง: ดำเนินการตรวจสอบสิทธิ์บนจุดเชื่อมต่อ AI ของคุณเพื่อยืนยันว่าเฉพาะผู้ใช้ที่ได้รับอนุญาตเท่านั้นที่สามารถเรียกใช้การดำเนินการของโมเดลได้

- การบันทึกการตรวจสอบ: บันทึกการโต้ตอบทั้งหมดของโมเดลเพื่อช่วยในการตรวจสอบการปฏิบัติตามข้อกำหนดและความปลอดภัย

- การแยกคอนเทนเนอร์: ทำงานโมเดลของคุณในสภาพแวดล้อมที่แยกเป็นสัดส่วน เช่น Docker ซึ่งช่วยป้องกันการเข้าถึงไฟล์ระบบหลักของคุณในกรณีที่เกิดการละเมิดความปลอดภัย

- อัปเดตเป็นประจำ: ติดตั้งแพตช์ล่าสุดสำหรับเครื่องมือต่าง ๆ เช่น Ollama เพื่อปกป้องระบบของคุณจากช่องโหว่ที่ค้นพบใหม่

- การจำกัดอัตรา: เพื่อป้องกันไม่ให้ผู้ใช้หรือสคริปต์เพียงรายเดียวทำให้เซิร์ฟเวอร์ของคุณทำงานหนักเกินไปจากปริมาณคำร้องขอที่มากเกินไป ให้ดำเนินการจำกัดอัตราเพื่อควบคุมจำนวนคำร้องขอที่สามารถทำได้ในช่วงเวลาที่กำหนด

🔎 คุณทราบหรือไม่? การปรับแต่งด้วยคำสั่งแบบมีเงื่อนไขไม่ใช่ภัยคุกคามทางทฤษฎีอีกต่อไปแล้ว การสำรวจล่าสุดของ Gartner พบว่า32% ขององค์กรได้ประสบกับการโจมตีด้วยคำสั่งที่เป็นอันตรายต่อแอปพลิเคชัน AI ในปีที่ผ่านมา การโจมตีเหล่านี้สามารถปรับแต่งโมเดลในเครื่องของคุณให้สร้างผลลัพธ์ที่มีอคติหรือไม่ได้รับอนุญาต

วิธีสร้างกระบวนการทำงาน AI ที่ปลอดภัยสำหรับทีมของคุณ

เมื่อเซิร์ฟเวอร์ท้องถิ่นของคุณทำงานแล้ว คุณสามารถผสานรวมเข้ากับงานประจำวันของคุณได้ นี่จะเปลี่ยนเครื่องมือที่เรียบง่ายให้กลายเป็นเครื่องมือเพิ่มประสิทธิภาพส่วนตัว วิธีที่มีประสิทธิภาพที่สุดในการทำเช่นนี้คือผ่านการใช้การค้นหาและเพิ่มข้อมูล (Retrieval-Augmented Generationหรือ RAG)

กระบวนการนี้เชื่อมต่อ AI ในเครื่องของคุณกับฐานข้อมูลส่วนตัวที่มีไฟล์ของคุณเอง คุณสามารถตอบคำถามโดยใช้บริบทเฉพาะของบริษัทของคุณได้โดยไม่ต้องอัปโหลดข้อมูลแม้แต่ไบต์เดียวไปยังคลาวด์

คุณยังสามารถออกแบบกระบวนการทำงานแบบมีมนุษย์ควบคุม (human-in-the-loop)ที่ให้สมาชิกในทีมมนุษย์ตรวจสอบงานของ AI ได้ด้วย ซึ่งจะช่วยเพิ่มความถูกต้องแม่นยำ พร้อมทั้งเร่งความเร็วในการทำงานของคุณอย่างมีนัยสำคัญ

นี่คือตัวอย่างที่เป็นประโยชน์:

- การวิเคราะห์เอกสาร: สรุปรายงานภายในหรือข้อเสนอแนะจากลูกค้าเพื่อสกัดข้อมูลสำคัญได้ทันที

- การสร้างร่าง: สร้างเวอร์ชันแรกของอีเมลหรือการอัปเดตโครงการสำหรับสมาชิกทีมเพื่อปรับปรุง

- การจัดประเภทข้อมูล: จัดหมวดหมู่ภารกิจที่เข้ามาโดยอัตโนมัติตามเนื้อหาเฉพาะของคำขอ

- การเตรียมการประชุม: สร้างประเด็นการสนทนาโดยการวิเคราะห์ไฟล์โครงการที่เกี่ยวข้องที่เก็บไว้ในไดรฟ์ท้องถิ่นของคุณ

- การตรวจสอบโค้ด: รับข้อเสนอแนะเกี่ยวกับซอร์สโค้ดที่เป็นกรรมสิทธิ์ของคุณโดยไม่ต้องเปิดเผยทรัพย์สินทางปัญญาของคุณต่อบุคคลที่สาม

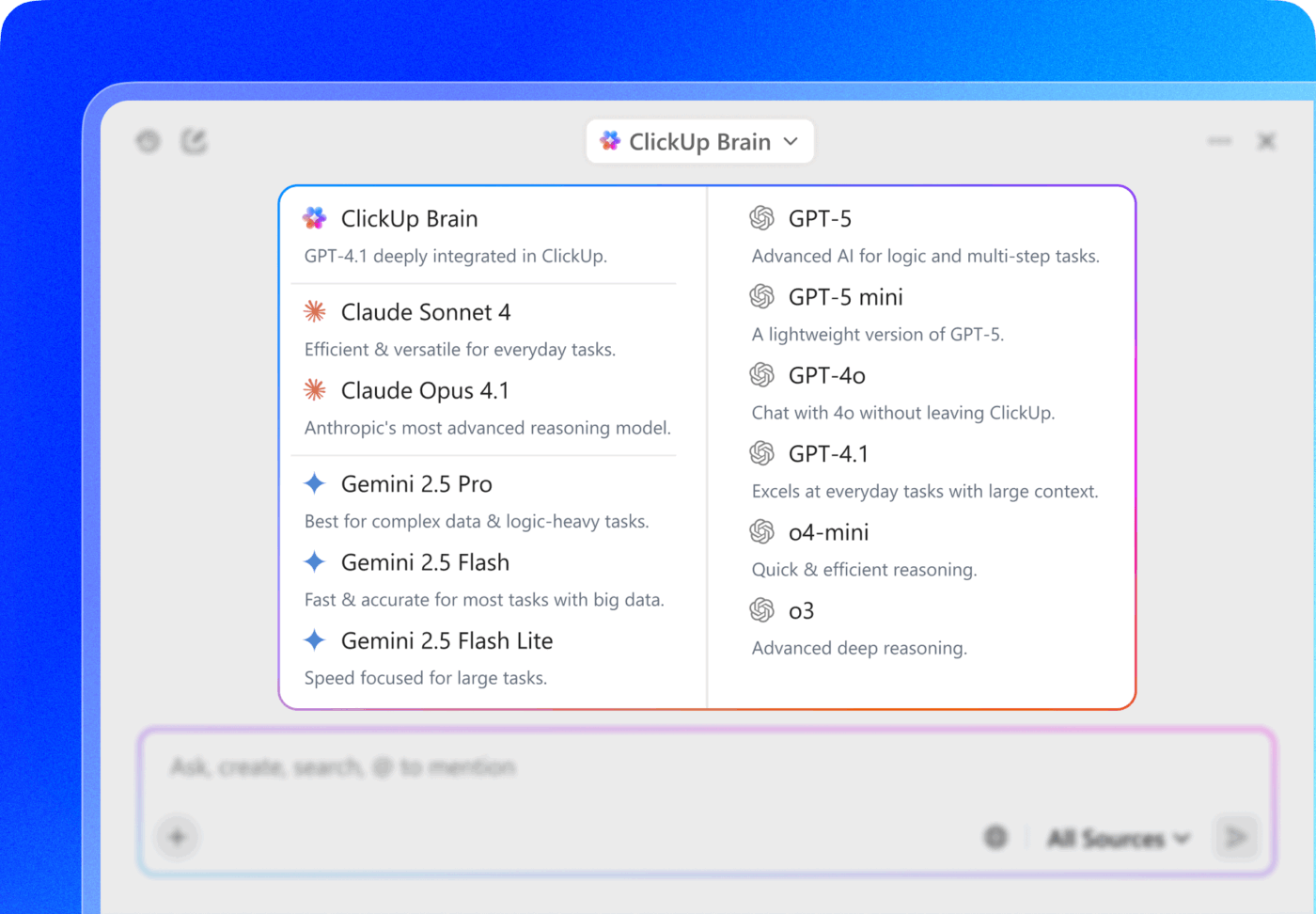

📮ClickUp Insight: แบบสำรวจความพร้อมด้าน AI ของเราแสดงให้เห็นว่าการเข้าถึง AI ในที่ทำงานยังคงมีจำกัด—36% ของผู้คนไม่มีการเข้าถึงเลย และเพียง 14% เท่านั้นที่กล่าวว่าพนักงานส่วนใหญ่สามารถทดลองใช้ได้จริง เมื่อ AI ถูกจำกัดอยู่หลังการอนุญาต เครื่องมือเพิ่มเติม หรือการตั้งค่าที่ซับซ้อน ทีมต่างๆ ก็ไม่มีโอกาสแม้แต่จะลองใช้มันในงานประจำวันจริงๆ

ClickUp Brainช่วยขจัดความยุ่งยากทั้งหมดด้วยการนำ AI มาไว้ภายในพื้นที่ทำงานที่คุณใช้งานอยู่แล้วโดยตรง คุณสามารถเข้าถึงโมเดล AI หลากหลาย สร้างภาพ เขียนหรือแก้ไขโค้ด ค้นหาข้อมูลบนเว็บ สรุปเอกสาร และอื่นๆ อีกมากมาย—โดยไม่ต้องสลับเครื่องมือหรือเสียสมาธิ

มันคือผู้ช่วย AI ที่อยู่รอบตัวคุณ ใช้งานง่ายและเข้าถึงได้สำหรับทุกคนในทีม

ข้อจำกัดของการใช้ AI ท้องถิ่นสำหรับกระบวนการทำงานของ AI

ระบบ AI ท้องถิ่นเป็นเครื่องมือที่ทรงพลัง แต่ไม่ใช่การแก้ไขปัญหาทุกประการอย่างมหัศจรรย์ การเข้าใจข้อจำกัดของมันช่วยให้คุณตัดสินใจได้ว่าเมื่อใดควรเก็บงานไว้บนฮาร์ดแวร์ของคุณเอง และเมื่อใดควรใช้ระบบคลาวด์ สำหรับบางทีม การแลกเปลี่ยนทางเทคนิคและทางการเงินอาจมีน้ำหนักมากกว่าประโยชน์ทางด้านความเป็นส่วนตัว

- ขีดจำกัดความสามารถ: โมเดลที่เป็นกรรมสิทธิ์ระดับสูงสุดยังคงมีความได้เปรียบเล็กน้อยในด้านการให้เหตุผลที่ซับซ้อนและความละเอียดอ่อนเชิงสร้างสรรค์เมื่อเทียบกับเวอร์ชันโอเพนซอร์ส

- การลงทุนในฮาร์ดแวร์: ประสิทธิภาพที่รวดเร็วบนโมเดลขนาดใหญ่ต้องการ GPU ที่มีราคาแพงพร้อม VRAM ที่มาก ซึ่งอาจเป็นค่าใช้จ่ายเริ่มต้นที่สูงสำหรับทีมขนาดเล็ก

- ค่าใช้จ่ายในการบำรุงรักษา: คุณเป็นผู้รับผิดชอบในการอัปเดตซอฟต์แวร์ทั้งหมด, การแก้ไขปัญหาฮาร์ดแวร์, และการติดตั้งแพตช์ความปลอดภัยโดยไม่มีการสนับสนุนจากทีมผู้ให้บริการ

- ความเชี่ยวชาญทางเทคนิค: การปรับแต่งสภาพแวดล้อมในท้องถิ่นให้เหมาะสมต้องอาศัยความรู้เชิงปฏิบัติเกี่ยวกับการแปลงแบบจำลองเป็นคิวอติเซชันและการกำหนดค่าเซิร์ฟเวอร์

- การจัดการความปลอดภัย: ต่างจากบริการคลาวด์ โมเดลท้องถิ่นไม่มีระบบตรวจสอบเนื้อหาในตัว คุณต้องติดตั้งตัวกรองเนื้อหาและมาตรการป้องกันของคุณเอง

- การใช้พลังงาน: การรันโมเดล AI ขนาดใหญ่บนเซิร์ฟเวอร์หรือเวิร์กสเตชันของคุณเองสามารถเพิ่มการใช้ไฟฟ้าและความต้องการในการระบายความร้อนได้อย่างมาก

หลายทีมใช้แนวทางแบบผสมผสาน: AI ท้องถิ่นสำหรับข้อมูลที่ละเอียดอ่อน, AI บนคลาวด์สำหรับงานที่ไม่ละเอียดอ่อนที่ต้องการความสามารถสูงสุด. นี่คือภาพรวมอย่างรวดเร็วของการเปรียบเทียบระหว่างสองอย่าง:

| ปัจจัย | ปัญญาประดิษฐ์ท้องถิ่น | คลาวด์ เอไอ |

|---|---|---|

| ความเป็นส่วนตัวของข้อมูล | การควบคุมอย่างเต็มที่ | ข้อมูลที่ส่งไปยังผู้ให้บริการ |

| ความซับซ้อนในการตั้งค่า | สูงขึ้น | ต่ำกว่า |

| ค่าใช้จ่ายที่เกิดขึ้นอย่างต่อเนื่อง | ฮาร์ดแวร์ + ไฟฟ้า | ค่าธรรมเนียมต่อโทเค็น |

| ความสามารถของโมเดล | ดี กำลังพัฒนา | ล้ำสมัย |

| การบำรุงรักษา | บริหารจัดการด้วยตนเอง | ผู้ให้บริการจัดการ |

ClickUp สนับสนุนการทำงานที่ปลอดภัยด้วย AI อย่างไร

ทีมส่วนใหญ่ในปัจจุบันติดอยู่ในภาวะต้องเลือกระหว่างการใช้ AI บนคลาวด์ที่ทรงพลังแต่ต้องกังวลเกี่ยวกับที่ตั้งของข้อมูล หรือตั้งค่าโมเดลในท้องถิ่นและจัดการกับค่าใช้จ่ายที่เกิดขึ้นอย่างต่อเนื่อง ClickUp หลีกเลี่ยงปัญหาดังกล่าวด้วยการทำหน้าที่เป็นพื้นที่ทำงาน AI แบบรวมศูนย์— ที่ซึ่ง AI อยู่ในระบบเดียวกับที่งานของคุณอยู่

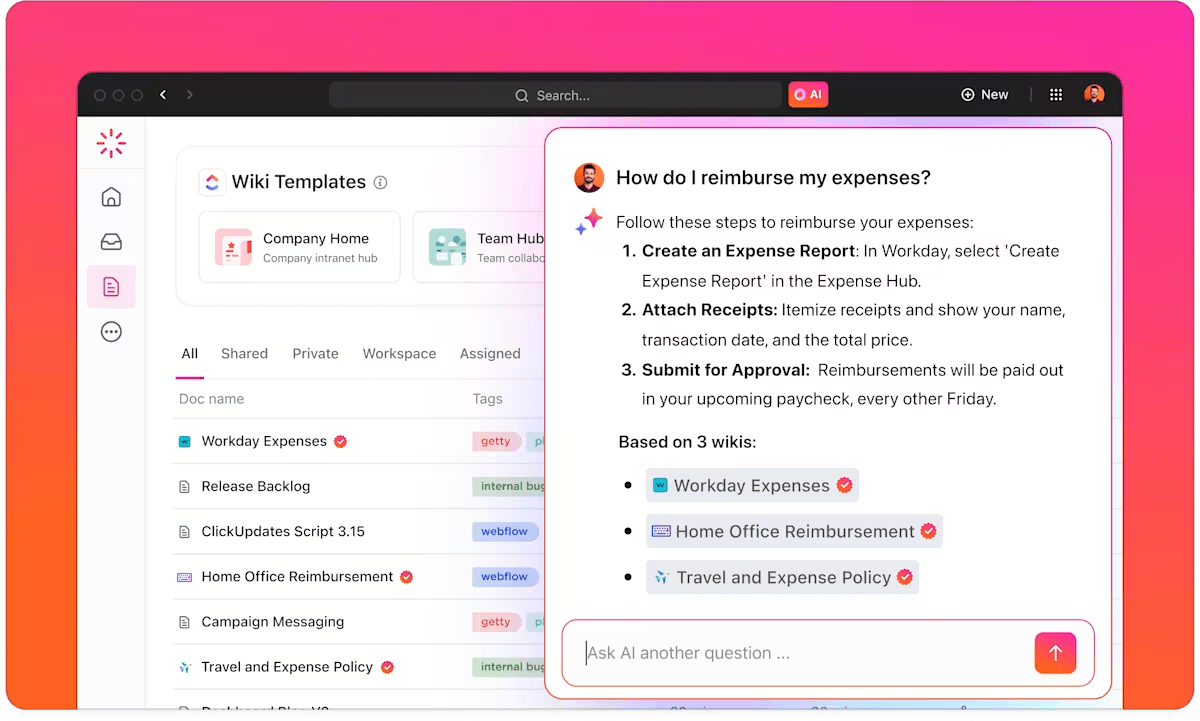

ClickUp Brainคือชั้น AI ที่ถูกสร้างขึ้นโดยตรงในเวิร์กสเปซของ ClickUp ออกแบบมาเพื่อเข้าใจงาน เอกสารและการสื่อสารของทีมคุณในที่เดียว มอบความช่วยเหลือจาก AI พร้อมบริบทครบถ้วน—ไม่ต้องใช้เครื่องมือแยก ไม่ต้องเชื่อมต่อที่เปราะบาง

สำหรับทีมที่ต้องการสร้างกระบวนการทำงานของ AI ที่ปลอดภัย การผสมผสานระหว่างบริบทและการควบคุมคือความแตกต่างระหว่างการทดลองและการนำไปใช้จริง

🌟 ClickUp ยังสอดคล้องกับมาตรฐาน SOC 2 และปฏิบัติตามมาตรฐาน ISO 42001 สำหรับการจัดการ AI อย่างรับผิดชอบ ซึ่งทำให้ข้อมูลของคุณไม่ถูกนำไปใช้เพื่อฝึกอบรมแบบจำลองของบุคคลที่สาม ทำให้คุณสามารถทำงานอัตโนมัติได้ด้วยความมั่นใจเช่นเดียวกับระบบติดตั้งบนเซิร์ฟเวอร์ของคุณเอง

เข้าถึงการค้นหาและกระบวนการทำงานอัตโนมัติด้วย ClickUp Brain

เมื่อข้อมูลของคุณได้รับการรักษาความปลอดภัยภายในพื้นที่ทำงานแล้ว ClickUp Brain จะดึงคุณค่าจากงานและเอกสารของคุณแบบเรียลไทม์

เนื่องจาก AI ถูกฝังอยู่ภายใน จึงหลีกเลี่ยงช่องว่างของบริบทที่ทำให้การตั้งค่าในท้องถิ่นช้าลง คุณสามารถถามคำถามที่ต้องการมุมมองที่ครบถ้วนของประวัติโครงการของคุณเพื่อให้ได้คำตอบที่ถูกต้อง:

- ระบุการตัดสินใจขั้นสุดท้าย จากเอกสารสรุปทางเทคนิคที่ยาวโดยไม่ต้องเลื่อนดูหลายเวอร์ชัน

- ร่างการอัปเดตสำหรับผู้มีส่วนได้ส่วนเสีย จากความคิดเห็นของงานและการเปลี่ยนแปลงสถานะ

ClickUp Brain สร้างคำตอบที่อิงจากข้อมูลในพื้นที่ทำงานของคุณโดยการวิเคราะห์เนื้อหาเฉพาะภายในเอกสาร งาน และแชทของคุณ ซึ่งช่วยให้มั่นใจได้ว่าเมื่อโครงการของคุณพัฒนาไป AI จะมีบริบทล่าสุดอยู่เสมอ

สิ่งนี้ช่วยให้ทีมของคุณสามารถต่อยอดจากข้อมูลเชิงลึกได้โดยไม่ต้องอธิบายประวัติโครงการซ้ำหรือย้ายข้อมูลระหว่างเครื่องมือที่ไม่เชื่อมต่อกัน

💡เคล็ดลับมืออาชีพ: คุณสามารถขยายบริบทของพื้นที่ทำงานของคุณได้มากยิ่งขึ้นโดยใช้Enterprise AI Searchเพื่อดึงข้อมูลจากเครื่องมือภายนอกทั้งหมดของคุณ

ตัวอย่างเช่น ถามคำถามเชิงลึกเช่น 'แสดงรายการดีลที่เปิดอยู่ทั้งหมดในกระบวนการ' แล้ว ClickUp Brain จะค้นหาข้อมูลจากแอปที่เชื่อมต่อของคุณ รวมถึง Slack, Google Drive และ Gmail เพื่อนำเสนอคำตอบที่เชื่อถือได้แบบเรียลไทม์พร้อมแหล่งอ้างอิง

สิ่งนี้เปลี่ยนข้อมูลที่กระจัดกระจายในหลายแพลตฟอร์มให้กลายเป็นชั้นข้อมูลอัจฉริยะเดียวที่สามารถค้นหาได้ ซึ่งคุณสามารถค้นหาไฟล์ ข้อความ หรือภารกิจใด ๆ ได้โดยไม่ต้องออกจากพื้นที่ทำงานของคุณเลย

จัดการงานอย่างชาญฉลาดด้วยระบบอัตโนมัติและปัญญาประดิษฐ์

ClickUp Brain ไม่ได้เพียงแค่ช่วยเหลือแบบเฉื่อยชา—แต่ทำงานอย่างกระตือรือร้นภายในระบบงานของคุณ มันสามารถ:

- สร้างงานจากบันทึกการประชุมหรือเอกสาร

- แยกงานใหญ่ให้กลายเป็นงานย่อย

- แนะนำเจ้าของงานตามกิจกรรมที่ผ่านมา

- แนะนำกำหนดเวลาตามบริบทของโครงการ

นอกจากนี้ยังสามารถอัปเดตสถานะงาน สรุปความคิดเห็นที่ยาวให้กลายเป็นขั้นตอนต่อไปที่ชัดเจน และแจ้งเตือนอุปสรรคก่อนที่จะทำให้การดำเนินการช้าลง

เมื่อใช้ร่วมกับClickUp Automationระบบนี้จะกลายเป็นระบบแบบปิด: AI สามารถกระตุ้นการทำงานของเวิร์กโฟลว์ (เช่น การมอบหมายงาน การแจ้งเตือนผู้มีส่วนได้ส่วนเสีย หรือการอัปเดตความสำคัญ) ตามการเปลี่ยนแปลงที่เกิดขึ้นภายในพื้นที่ทำงานของคุณ

ตัวอย่างเช่น เมื่อเอกสารถูกทำให้เป็นเอกสารฉบับสมบูรณ์ งานสามารถถูกสร้างและมอบหมายโดยอัตโนมัติได้ โดยไม่ต้องให้ใครย้ายข้อมูลระหว่างเครื่องมือด้วยตนเอง

💟 โบนัส: เปลี่ยนClickUp Brain MAXให้เป็น "หน่วยความจำการตัดสินใจ" ของคุณ

ใช้เพื่อ:

- สรุปความคิดเห็นยาว ๆ ให้เป็นคำตัดสินที่ชัดเจนและขั้นตอนต่อไป

- อัปเดตเอกสารด้วย "สิ่งที่เปลี่ยนแปลงและเหตุผล" หลังจากเหตุการณ์สำคัญ

- สร้างบันทึกการตัดสินใจประจำสัปดาห์จากงาน การประชุม และการอัปเดต

เมื่อเวลาผ่านไป สิ่งนี้จะสร้างชั้นความรู้เชิงสถาบันที่มีชีวิตซึ่ง Brain MAX สามารถอ้างอิงได้ ดังนั้นแทนที่จะตอบคำถามแบบแยกส่วน มันจะเริ่มตอบสนองด้วยความตระหนักรู้ถึงการตัดสินใจในอดีต ลำดับความสำคัญ และรูปแบบต่างๆ

นั่นคือเมื่อ AI เปลี่ยนจากการเป็นประโยชน์ไปสู่การเป็น เชื่อถือได้—โดยเฉพาะอย่างยิ่งในกระบวนการทำงานของ AI ที่มีความปลอดภัยซึ่งบริบทและการตรวจสอบย้อนกลับมีความสำคัญ

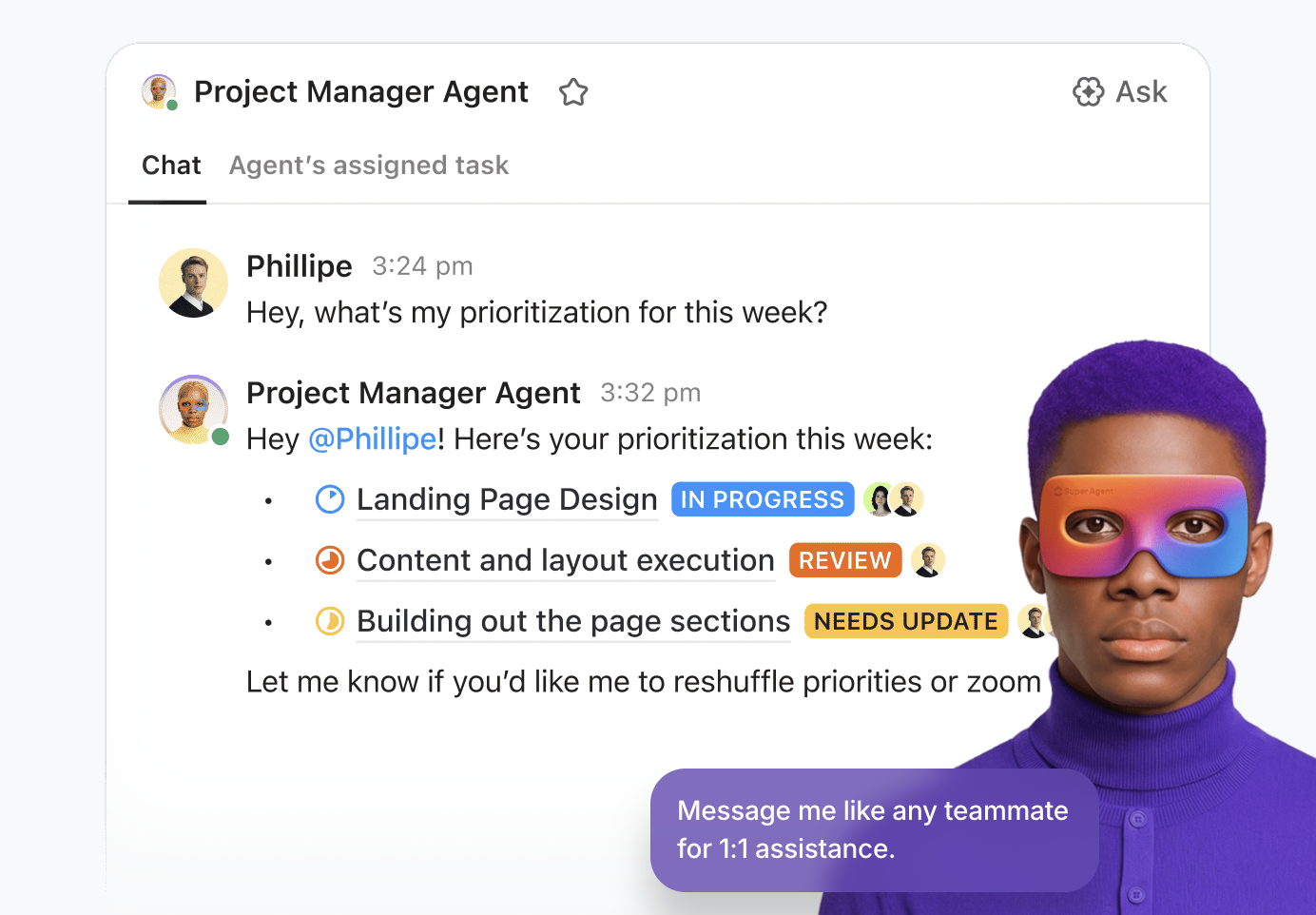

รับการดำเนินการที่ปลอดภัยและเข้าใจบริบทในระดับที่กว้างขวางด้วย Super Agents

ClickUp Super Agentsพัฒนา ClickUp Brain ไปอีกขั้น—จากการช่วยเหลือในการทำงานไปสู่การขับเคลื่อนงานอย่างจริงจัง ตัวแทนเหล่านี้สามารถตั้งค่าให้ตรวจสอบกระบวนการทำงาน ดำเนินการ และประสานงานต่างๆ ภายในพื้นที่ทำงานของคุณตามกฎที่กำหนดไว้ล่วงหน้าและบริบทแบบเรียลไทม์

ตัวอย่างเช่น ซูเปอร์เอเจนต์สามารถ:

- ตรวจสอบคำขอหรือเอกสารที่เข้ามาโดยอัตโนมัติและแปลงเป็นงานที่มีโครงสร้างพร้อมเจ้าของและกำหนดเวลา

- ติดตามความคืบหน้าของโครงการและแจ้งเตือนความเสี่ยงหรือความล่าช้าก่อนที่จะลุกลาม

- กระตุ้นการทำงานอัตโนมัติหลายขั้นตอนเมื่อเงื่อนไขตรงตาม—เช่น การแจ้งเตือนผู้มีส่วนได้ส่วนเสีย, อัปเดตความสำคัญ, หรือสร้างงานติดตามผล

ตัวแทนเหล่านี้ทำงานทั้งหมดภายในพื้นที่ทำงานแบบรวมของ ClickUp โดยมีความตระหนักรู้อย่างเต็มที่เกี่ยวกับงาน เอกสาร และโครงสร้างสิทธิ์การเข้าถึงของคุณ นั่นหมายความว่า:

- คุณไม่จำเป็นต้องส่งออกข้อมูลไปยังระบบ AI ภายนอกหรือเครื่องมือจัดการระบบ

- พวกเขาเข้าถึงข้อมูลเฉพาะที่ได้รับอนุญาตให้ดูเท่านั้น

- พวกเขาดำเนินการภายในขอบเขตสิทธิ์เดียวกันกับทีมของคุณ

เรียนรู้เพิ่มเติมเกี่ยวกับการทำงานร่วมกับซูเปอร์เอเจนต์:

รับประโยชน์จากการช่วยเหลือของ AI ภายในเอกสารของคุณ

ด้วยClickUp Docs ความช่วยเหลือจาก AI จะถูกฝังอยู่ในกระบวนการทำงานเอกสารของคุณโดยตรง ทีมงานสามารถร่างสรุปโครงการ สรุปรายงานยาว ดึงรายการที่ต้องดำเนินการ หรือเขียนเนื้อหาใหม่สำหรับกลุ่มเป้าหมายที่แตกต่างกัน—ทั้งหมดนี้โดยไม่ต้องออกจากแพลตฟอร์ม

สิ่งนี้มีความสำคัญสำหรับกระบวนการทำงานของ AI ที่ปลอดภัย เนื่องจากหนึ่งในความเสี่ยงที่ใหญ่ที่สุดมาจากการคัดลอกและวางข้อมูลที่ละเอียดอ่อนไปยังเครื่องมือภายนอก ใน ClickUp คุณสามารถลดการเคลื่อนย้ายข้อมูลและรักษาการควบคุมการเข้าถึงได้อย่างเต็มที่ผ่านสิทธิ์การเข้าถึง

คำตัดสินสุดท้าย: การสร้างชุดเครื่องมือ AI ส่วนตัวของคุณ

ระบบปัญญาประดิษฐ์ท้องถิ่นใช้ประโยชน์จากปัญญาประดิษฐ์ในขณะที่ยังคงควบคุมความเป็นส่วนตัวของข้อมูลและการปฏิบัติตามข้อกำหนดได้อย่างสมบูรณ์ อย่างไรก็ตาม เส้นทางนี้ต้องมีการลงทุนอย่างมากในด้านฮาร์ดแวร์ การตั้งค่าทางเทคนิค และการบำรุงรักษาอย่างต่อเนื่อง

การปฏิบัติด้านความปลอดภัยยังคงมีความสำคัญอย่างยิ่งไม่ว่าคุณจะใช้ AI แบบท้องถิ่นหรือแบบคลาวด์ก็ตาม กลยุทธ์ที่มีประสิทธิภาพมากที่สุดมักเกี่ยวข้องกับการใช้แนวทางแบบผสมผสาน: ใช้ AI แบบท้องถิ่นสำหรับการดำเนินงานที่มีความอ่อนไหวมากที่สุด ในขณะที่ใช้โซลูชันที่มีการจัดการและปลอดภัยสำหรับการเพิ่มประสิทธิภาพการทำงานในชีวิตประจำวัน

สิ่งสำคัญคือการพิจารณาถึงข้อแลกเปลี่ยน—สำหรับหลายทีม ค่าใช้จ่ายในการพัฒนาโซลูชันด้วยตนเองอาจไม่ใช่ทางเลือกที่เหมาะสม

สำหรับผู้ที่ต้องการประสิทธิภาพการทำงานด้วย AI ที่ทรงพลังโดยไม่ต้องแบกรับภาระโครงสร้างพื้นฐาน โซลูชันแบบจัดการอย่าง ClickUp Brain เป็นทางเลือกที่น่าสนใจ มันมอบความปลอดภัยระดับองค์กรโดยมีความซับซ้อนในการตั้งค่าเป็นศูนย์

เริ่มต้นใช้งาน ClickUp ฟรีและสำรวจเวิร์กโฟลว์ที่ปลอดภัยและขับเคลื่อนด้วย AI ที่เข้าใจบริบทสำหรับทีมของคุณ

คำถามที่พบบ่อย

ความแตกต่างระหว่าง AI ท้องถิ่นกับ AI บนคลาวด์สำหรับกระบวนการทำงานของทีมคืออะไร?

ระบบ AI ท้องถิ่นทำงานบนฮาร์ดแวร์ของคุณเองทั้งหมด ทำให้ข้อมูลไม่หลุดออกจากเครือข่ายภายในของคุณเลย ขณะที่ระบบ AI บนคลาวด์จะส่งคำสั่งไปยังเซิร์ฟเวอร์ของบุคคลที่สามเพื่อประมวลผล การตั้งค่าแบบท้องถิ่นให้ความเป็นเจ้าของข้อมูลอย่างสมบูรณ์และการเข้าถึงแบบออฟไลน์ ขณะที่บริการบนคลาวด์ให้พลังการประมวลผลที่สูงขึ้นและความสะดวกในการใช้งาน โดยแลกกับการควบคุมข้อมูลโดยตรง

ทีมสามารถใช้แบบจำลอง AI ท้องถิ่นกับข้อมูลโครงการที่เป็นความลับได้อย่างไร?

ทีมสามารถใช้ AI ท้องถิ่นเพื่อประมวลผลเอกสารที่มีความอ่อนไหว, โค้ดที่เป็นกรรมสิทธิ์, และบันทึกทางการเงินได้โดยการชี้โมเดลไปยังไดเรกทอรีส่วนตัวภายในองค์กร เนื่องจากการอนุมานเกิดขึ้นบนอุปกรณ์ คุณจึงสามารถทำงานต่างๆ เช่น การสรุปโดยอัตโนมัติ, การสกัดข้อมูล, และการค้นหาความรู้ภายในองค์กรได้โดยไม่เสี่ยงต่อการเปิดเผยต่อชุดข้อมูลฝึกอบรม LLM สาธารณะ

โมเดล AI ท้องถิ่นมีความสามารถเทียบเท่ากับ ChatGPT สำหรับงานหรือไม่?

โมเดลท้องถิ่นแบบโอเพนซอร์สหลายตัว เช่น Llama 3 และ Mistral ขณะนี้มีความสามารถสูงในการจัดการงานประจำ เช่น การร่าง การเขียนโค้ด และการสรุปข้อมูล แม้ว่าโมเดลคลาวด์ระดับสูงอย่าง GPT-4o ยังคงเป็นผู้นำในด้านการให้เหตุผลที่ซับซ้อนมาก แต่โมเดลท้องถิ่นก็ให้ประสิทธิภาพที่เทียบเคียงได้สำหรับ 90% ของการดำเนินงานทางธุรกิจประจำวัน พร้อมด้วยความเป็นส่วนตัวที่ดีกว่าอย่างมีนัยสำคัญ

ข้อเสียของการใช้ระบบ AI บนเครื่องกับบริการ AI บนคลาวด์คืออะไร?

การแลกเปลี่ยนหลักคือการเลือกระหว่างความเป็นส่วนตัวของข้อมูลอย่างสมบูรณ์ด้วย AI ในเครื่องกับศักยภาพในการขยายตัวโดยไม่ต้องบำรุงรักษาของ AI บนคลาวด์ การใช้งาน AI ในเครื่องต้องมีการลงทุนด้านฮาร์ดแวร์ล่วงหน้าและความเชี่ยวชาญทางเทคนิค แต่จะช่วยลดค่าธรรมเนียม API ที่เกิดขึ้นซ้ำและความเสี่ยงในการรั่วไหลของข้อมูล AI บนคลาวด์สามารถปรับใช้ได้เร็วกว่าแต่มีค่าใช้จ่ายในการสมัครสมาชิกอย่างต่อเนื่องและต้องพึ่งพาข้อมูลจากบุคคลที่สาม