Ahogy az LLM-ek egyre erősebbek lesznek, a prompting már nem jelent nehézséget. A kontextus válik korlátossá.

A kontextus-tervezés azt jelenti, hogy a megfelelő információkat a megfelelő formátumban juttatjuk el az LLM-ekhez (nagy nyelvi modellek).

Mi teszi nehézvé a kontextus-tervezést?

A kontextus rögzítése és elérhetővé tétele érdekében a stack minden rétegét meg kell tervezni. Ha túl kevés kontextust küldünk, az LLM-ek nem tudják, mit kell tenniük. Ha túl sok kontextust küldünk, elfogynak a tokenek. Hogyan lehet megtalálni az egyensúlyt?

Az alábbiakban megosztunk mindent, amit a kontextus-tervezésről tudni kell.

Mi az AI kontextus-mérnöki munka?

Az AI kontextus-tervezés az LLM-ek, valamint a fejlett AI és multimodális modellek számára az utasítások és a releváns kontextus megtervezésének és optimalizálásának folyamata, hogy azok hatékonyan végezhessék feladataikat.

Ez túlmutat a prompt írásán. A kontextus-tervezés határozza meg:

- Milyen információk kerülnek felszínre?

- Honnan származik (memória, eszközök, adatbázisok, dokumentumok)

- Hogyan van formázva (sémák, összefoglalók, korlátozások)

- Mikor kerül be a modell gondolkodási ciklusába?

🌟 A cél: Az LLM kontextusablakában megadott információk optimalizálása és a zavaró információk kiszűrése.

Hogyan javítja a kontextus az AI válaszokat?

Kontextus nélkül az LLM a szöveg statisztikailag legvalószínűbb folytatását jósolja meg. Másrészt a jó kontextus-mérnöki munka javítja az eredményeket az alábbiak révén:

- Horgonyzó érvelés: A modell válaszait ismert tényekre alapozza, nem pedig statisztikai becslésekre.

- A hallucinációk csökkentése: A világos korlátok és a releváns adatok szűkítik a megoldások körét.

- A konzisztencia javítása: Hasonló bemenetek hasonló kimeneteket eredményeznek, mert a kontextus alakja stabil.

- Költségek és késleltetés csökkentése: A célzott kontextus jobb megoldás, mint teljes dokumentumok vagy előzmények mentése.

Tobi Lutke, a Shopify vezérigazgatójának szavaival összefoglalva:

Nagyon tetszik a kontextus-tervezés kifejezés a prompt-tervezés helyett. Ez jobban leírja a alapvető készséget: a művészetet, hogy minden kontextust megadjon a feladathoz, hogy az LLM-ek hihetően megoldhassák azt.

Nagyon tetszik a kontextus-tervezés kifejezés a prompt-tervezés helyett. Ez jobban leírja a alapvető készséget: a művészetet, hogy minden kontextust megadjon a feladathoz, hogy az LLM-ek hihetően megoldhassák azt.

A kontextus-mérnöki munka szerepe az AI-vezérelt munkafolyamatokban

Az AI-vezérelt munkafolyamatokban az LLM-ek nem önálló eszközök. Olyan rendszereken belül működnek, amelyek már rendelkeznek adatokkal, szabályokkal és állapotokkal.

A kontextus-mérnöki munka lehetővé teszi a modell számára, hogy megértse, hol tart a munkafolyamatban és mit tehet legközelebb.

Ha a modell tisztában van a jelenlegi állapottal, a múltbeli cselekvésekkel és a hiányzó bemenetekkel, akkor általános tanácsok helyett a helyes következő lépést javasolhatja vagy végrehajthatja.

Ez azt is jelenti, hogy kifejezetten meg kell adni az üzleti logikát, például a jóváhagyási szabályokat, a megfelelési korlátozásokat és az eskalációs útvonalakat. Ha ezek a kontextus részét képezik, az AI döntései összhangban maradnak a működési valósággal.

Végül a kontextus-mérnöki munka több lépéses és ügynöki munkafolyamatokat tesz lehetővé azáltal, hogy minden lépésben biztosítja az állapotok és döntések tiszta átadását.

Ez megakadályozza a hibák halmozódását a munkafolyamatok bővülésével, ezáltal javítva a kontextus hatékonyságát.

👀 Tudta? A vállalati GenAI-implementációk 95%-a nem teljesíti a várakozásokat, nem azért, mert a modellek gyengék, hanem mert a szervezetek nem tudják integrálni az AI-t a valós munkafolyamatokba.

Az általános AI-eszközök, mint például a ChatGPT, egyének számára jól működnek, de nagy léptékben nem, mert nem tanulnak a rendszer kontextusából, az üzleti szabályokból vagy a változó állapotokból. Más szavakkal, az AI-k legtöbb kudarca integrációs és kontextusbeli kudarc, nem pedig modellkudarc.

📮ClickUp Insight: A válaszadók 62%-a beszélgető AI eszközökre, például a ChatGPT-re és a Claude-ra támaszkodik . Ismerős chatbot felületük és sokoldalú képességeik – tartalom generálása, adatok elemzése és még sok más – lehet az oka annak, hogy olyan népszerűek a különböző szerepkörökben és iparágakban. Ha azonban a felhasználónak minden alkalommal másik fülre kell váltania, hogy kérdést tegyen fel az AI-nak, akkor a kapcsolódó váltási költségek és a kontextusváltás költségei idővel felhalmozódnak. A ClickUp Brain esetében azonban ez nem így van. A ClickUp Brain közvetlenül a munkaterületén található, tudja, min dolgozik, megérti a sima szöveges utasításokat, és olyan válaszokat ad, amelyek nagyon relevánsak a feladataival kapcsolatban! A ClickUp segítségével kétszeresére növelheti termelékenységét!

Hogyan működik a kontextus-mérnöki munka?

A kontextus-tervezés úgy működik, hogy fokozatosan alakítja az információkat, mielőtt azok eljutnának a modellhez.

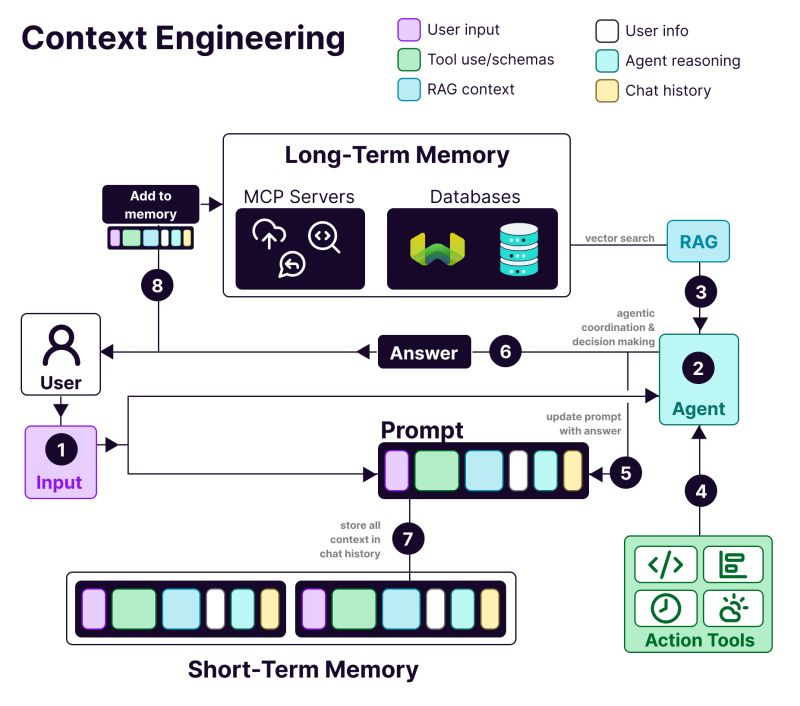

A kontextus-mérnöki rendszer felépítése a következőket tartalmazza:

- 𝗨𝘀𝗲𝗿 i𝗻𝗳𝗼𝗿𝗺𝗮𝘁𝗶𝗼𝗻: Beállítások, előzmények és személyre szabott adatok

- T𝗼𝗼𝗹 u𝘀𝗲: API-k, számológépek, keresőmotorok – bármi, amire az LLM-nek szüksége van a feladat elvégzéséhez.

- 𝗥𝗔𝗚 c𝗼𝗻𝘁𝗲𝘅𝘁: Információk lekérése vektoros adatbázisokból, például a Weaviate-ből.

- 𝗨𝘀𝗲𝗿 i𝗻𝗽𝘂𝘁: A tényleges lekérdezés vagy feladat

- 𝗔𝗴𝗲𝗻𝘁 r𝗲𝗮𝘀𝗼𝗻𝗶𝗻𝗴: Az LLM gondolkodási folyamata és döntéshozatali lánca

- 𝗖𝗵𝗮𝘁 h𝗶𝘀𝘁𝗼𝗿𝘆: A folytonosságot biztosító korábbi interakciók

A kontextus-mérnöki munka előnyei az AI-rendszerekben

Íme, miért van szükség kontextus-tervezésre az AI-alkalmazások fejlesztése során:

Pontosabb eredmények

A döntéshozatalhoz releváns kontextus megadása csökkenti a kétértelműséget. A modell ismert tények, korlátok és állapotok alapján érvel, ahelyett, hogy valószínűségi becslésekre támaszkodna.

Következetes viselkedés nagy léptékben

A stabil kontextusstruktúrák ismétlődő eredményeket hoznak. Hasonló bemenetek hasonló döntésekhez vezetnek, ami elengedhetetlen a termelési munkafolyamatokhoz.

Csökkentett költségek és késleltetés

A célzott, tömörített kontextus elkerüli a tokenek pazarlását. A rendszerek gyorsabban reagálnak, anélkül, hogy újra és újra betöltenék a teljes előzményeket vagy dokumentumokat.

Biztonságosabb automatizálás

A kontextus kódolja az üzleti szabályokat és engedélyeket. Ez lehetővé teszi az AI számára, hogy a szabályokat megsértése vagy kockázatos cselekmények kiváltása nélkül cselekedjen.

Jobb több lépéses munkafolyamatok

A tiszta kontextusátadás megőrzi az állapotot a lépések között. A hibák nem halmozódnak fel, ahogy a munkafolyamatok egyre összetettebbé és aktívabbá válnak.

Könnyebb hibakeresés és iteráció

A strukturált kontextus láthatóvá teszi a hibákat. A hibákat hiányzó, elavult vagy rosszul rangsorolt bemenetekre vezethetjük vissza, ahelyett, hogy a modellt hibáztatnánk.

Erőteljesebb vállalati alkalmazás

A munkafolyamat kontextusát figyelembe vevő AI-rendszerek megbízhatónak tűnnek – ez a kritikus különbség a kísérleti projektek és a vállalati szintű bevezetésre szánt eszközök között.

📚 További információ: Hogyan lehet kihasználni az AI-t a valós idejű adatokhoz való hozzáféréssel?

👀 Tudta? A kontextust figyelembe vevő AI közvetlenül befolyásolja a termelékenységet. A Boston Consulting Group egy tanulmánya megállapította, hogy a kommunikációs csapatok önmagukban 26–36%-kal csökkenthetik a munkaidejüket a generatív AI segítségével, és a kontextust figyelembe vevő, újratervezett munkafolyamatok és ügynöki rendszerek segítségével a termelékenység akár 50%-kal is növekedhet.

AI kontextus-mérnöki munka vs. prompt-mérnöki munka

Prompt engineering: Kérje meg a ChatGPT-t, hogy írjon egy új funkció bejelentő e-mailt. Egyetlen feladatra vonatkozó utasításokat ír.

Kontextus-mérnöki munka: Ügyfélszolgálati botot építesz. A botnak emlékeznie kell a korábbi jegyekre, hozzá kell férnie a felhasználói fiókok adatait, és meg kell őriznie a beszélgetések történetét.

Ahogy Andrej Karpathy, AI-kutató elmagyarázza:

Az emberek a promptokat rövid feladatleírásokkal társítják, amelyeket a mindennapi használat során adnak meg az LLM-nek. Minden ipari szintű LLM-alkalmazásban a kontextus-tervezés az a kényes művészet és tudomány, amelynek célja, hogy a kontextusablakot a következő lépéshez szükséges információkkal töltse meg.

Az emberek a promptokat rövid feladatleírásokkal társítják, amelyeket a mindennapi használat során adnak meg az LLM-nek. Minden ipari szintű LLM-alkalmazásban a kontextus-tervezés az a kényes művészet és tudomány, amelynek célja, hogy a kontextusablakot a következő lépéshez szükséges információkkal töltse meg.

+1 a „kontextus-mérnöki munkának” a „prompt-mérnöki munkával” szemben.

Az emberek a promptokat rövid feladatleírásokkal társítják, amelyeket a mindennapi használat során adnak meg az LLM-nek. Minden ipari szintű LLM-alkalmazásban a kontextus-tervezés a kontextusablak kitöltésének kényes művészete és tudománya... https://t.co/Ne65F6vFcf

— Andrej Karpathy (@karpathy) 2025. június 25.

+1 a „kontextus-mérnöki munkának” a „prompt-mérnöki munkával” szemben.

Az emberek a promptokat rövid feladatleírásokkal társítják, amelyeket a mindennapi használat során adnak meg az LLM-nek. Minden ipari szintű LLM-alkalmazásban a kontextus-tervezés a kontextusablak kitöltésének kényes művészete és tudománya... https://t.co/Ne65F6vFcf

— Andrej Karpathy (@karpathy) 2025. június 25.

| Megközelítés | Mire összpontosít | Legalkalmasabb |

| Prompt-mérnöki munka | Utasítások és kimeneti formátumok kidolgozása a modellhez | Egyszeri feladatok, tartalomgenerálás, formátum-specifikus kimenetek |

| Kontextus-mérnöki munka | Releváns adatok, állapotok és korlátozások biztosítása a modell számára | Beszélgető AI, dokumentumelemző eszközök, kódolási asszisztensek |

| Mindkettő együtt | Egyértelmű utasítások és rendszer szintű kontextus kombinálása | Termelési AI alkalmazások, amelyek konzisztens, megbízható teljesítményt igényelnek |

A legtöbb alkalmazás a prompt-mérnöki munka és a kontextus-mérnöki munka kombinációját használja. A kontextus-mérnöki rendszerben továbbra is jól megírt promptokra van szükség.

A különbség az, hogy ezek a promptok gondosan kezelt háttérinformációkkal működnek. Nem kell minden alkalommal elölről kezdeni.

📮 ClickUp Insight: A válaszadók több mint fele naponta három vagy több eszközbe ír, küzdve az „AI Sprawl ” és a szétszórt munkafolyamatok ellen.

Bár ez produktívnak és elfoglaltnak tűnhet, a kontextus egyszerűen elveszik az alkalmazások között, nem is beszélve a gépelésből származó energiafogyasztásról. A Brain MAX mindent összefog: egyszer beszél, és a frissítései, feladatai és jegyzetei pontosan oda kerülnek, ahová tartoznak a ClickUp-ban. Nincs több váltogatás, nincs több káosz – csak zökkenőmentes, központosított termelékenység.

Az AI kontextus-mérnöki munka alkalmazásai

Az AI kontextus-mérnöki munka legfontosabb területei, ahol máris alkalmazzák, a következők: 👇

Ügyfélszolgálat és helpdesk automatizálás

A legtöbb csevegőrobot minden üzenetet újnak tekinti, így a felhasználóknak újra és újra meg kell ismételniük magukat.

A kontextus-tervezés segítségével az AI hivatkozhat a felhasználói előzményekre, a korábbi interakciókra, a vásárlási adatokra és a termékdokumentációra. Ezáltal úgy reagál, mint egy csapattárs, aki már ismeri a problémát.

📌 Valós példa: A Coda ügyfélszolgálati csapata olyan technikai termékekkel kapcsolatos kérdéseket kezel, amelyek megértéséhez a korábbi üzenetek ismerete és a termékdokumentációra való hivatkozás szükséges. Az ügyfélszolgálat méretének növelése érdekében az Intercom Fin szoftvert használják. A Fin a válaszadás előtt elolvassa a dokumentációt és a korábbi beszélgetéseket, így önállóan megoldja az ügyfelek kérdéseinek 50–70%-át, miközben magas CSAT-szintet tart fenn.

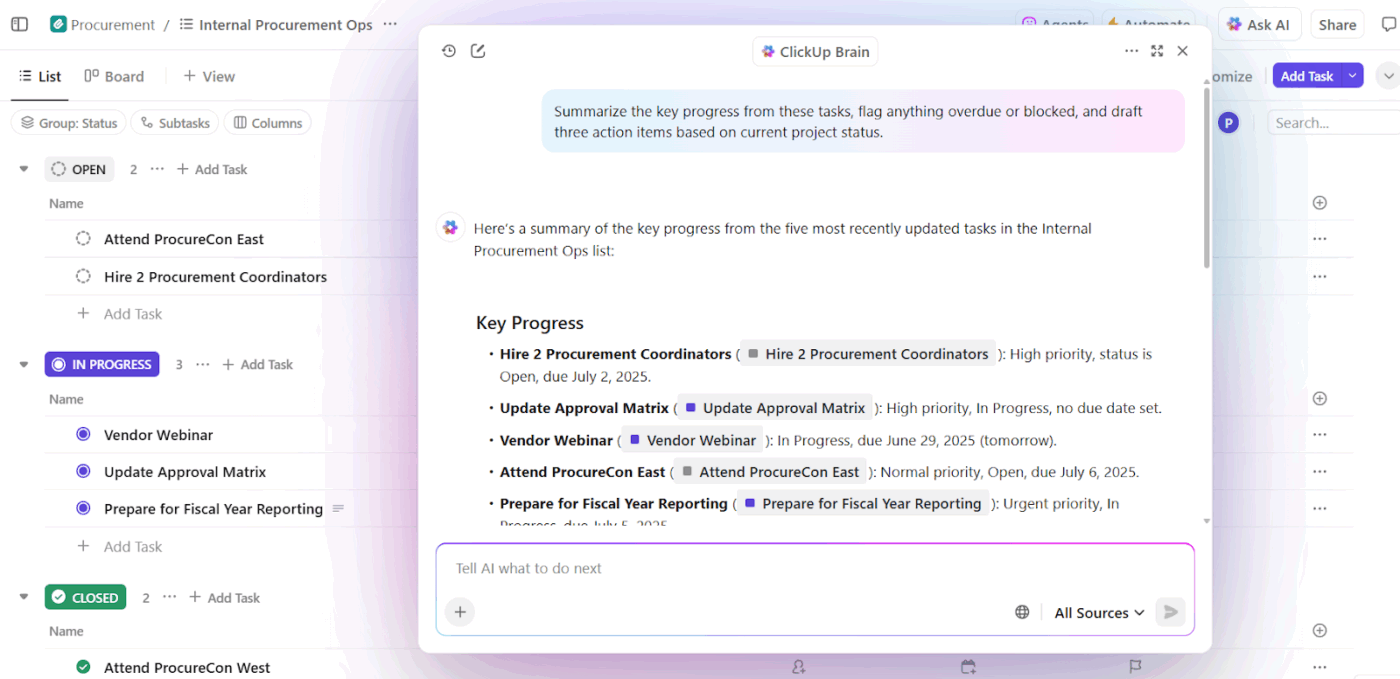

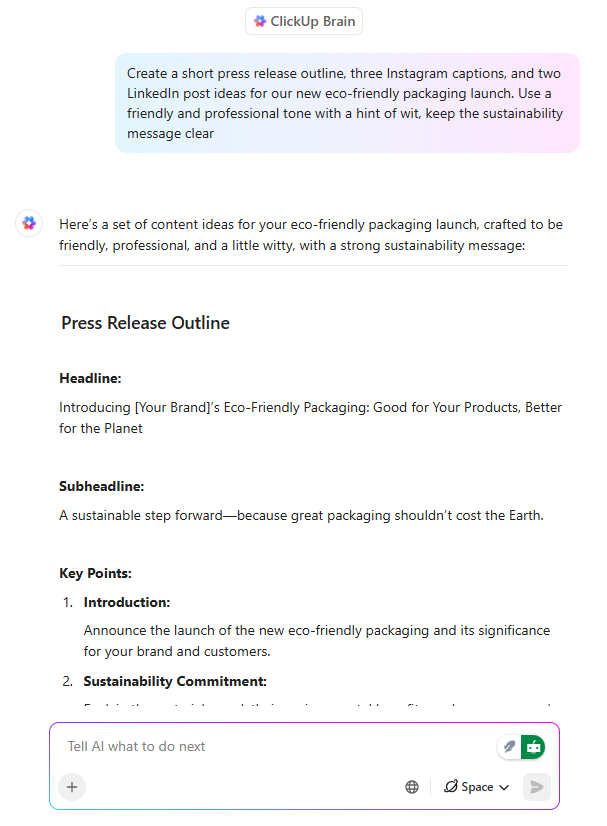

AI írás és munkahelyi termelékenységi asszisztensek

Az AI írási eszközök csak akkor nyújtanak értéket, ha megértik, min dolgozol, miért fontos, és mi létezik már. E kontextus nélkül időt takarítanak meg a vázlatkészítésben, de még mindig jelentős átírásokat és manuális összehangolást igényelnek.

Itt jön be a képbe a kontextus-mérnöki AI, amely megváltoztatja az eredményeket. Az AI-t a feladat állapotára, a dokumentumokra, a korábbi döntésekre és a csapat konvencióira alapozva az írási asszisztensek az általános szöveggenerálástól a munkafolyamat-tudatos támogatás felé mozdulnak el.

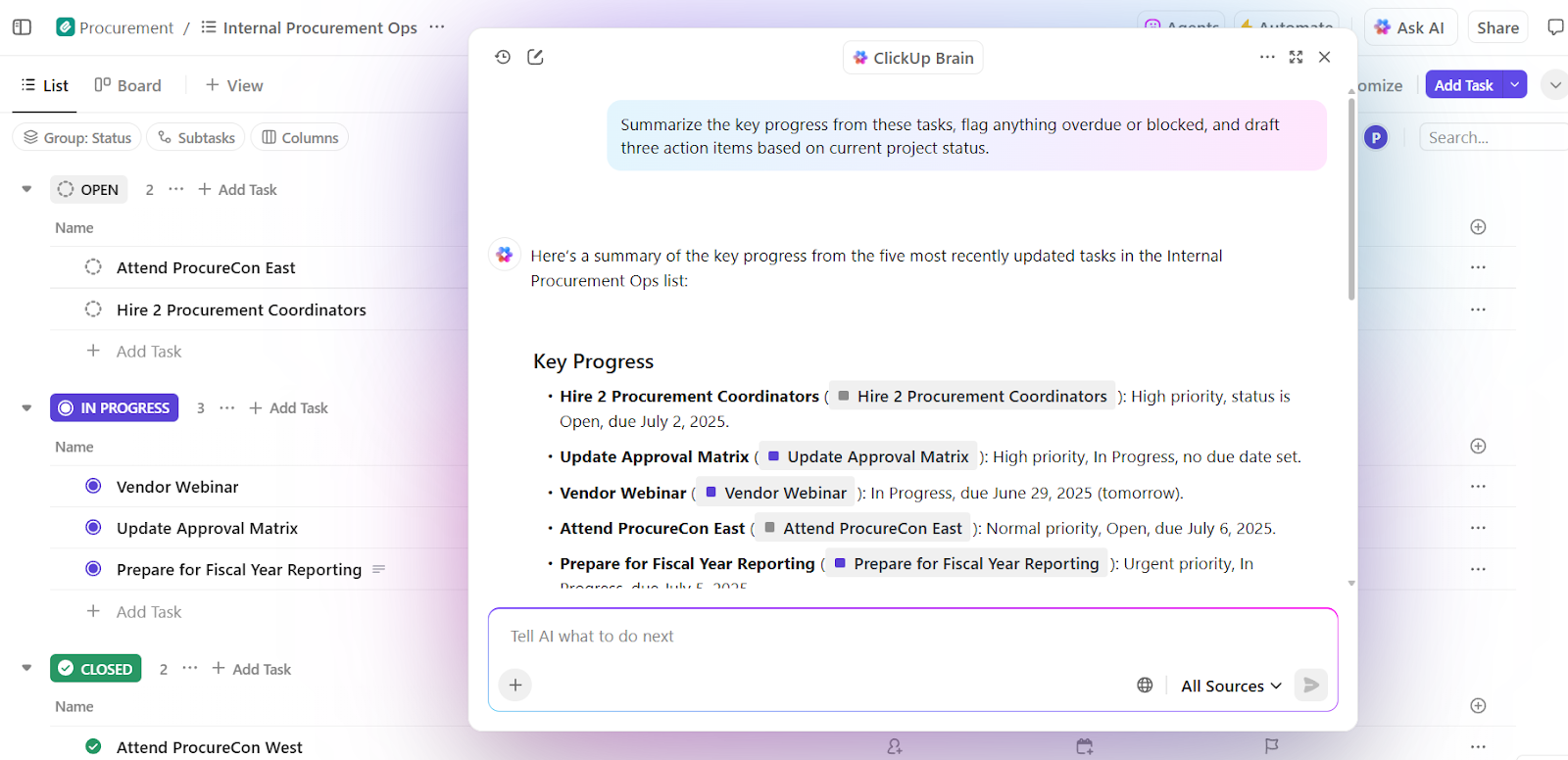

📌 Valós példa: A ClickUp Brain, a ClickUp natív mesterséges intelligenciája, a munkaterület szintjén alkalmazza a kontextus-mérnöki munkát. Ahelyett, hogy a felhasználókat arra kérné, hogy illesszék be a háttérinformációkat a promptokba, közvetlenül a Feladatokból, Dokumentumokból, megjegyzésekből, prioritásokból és ütemtervekből vonja ki a kontextust.

A kontextus alapú döntéshozatal kulcsfontosságú képesség. Értékeli a folyamatban lévő projekteket, a csapat kapacitását és a múltbeli teljesítményt, hogy megvalósítható betekintést nyújtson.

Először is, a Brain képes felismerni a túlterhelést, a késéseket és a szűk keresztmetszeteket. A probléma összefoglalása mellett konkrét módosításokat is javasol – a feladatok újraelosztása, az ütemtervek frissítése és a prioritások újraelosztása formájában.

Mivel ezek a döntések élő munkakörnyezetben születnek, az eredmények azonnal felhasználhatók. Nincs szükség a háttér ismertetésére, a prioritások magyarázására vagy az ajánlások kézi összehangolására a valósággal.

A ClickUp Brain-t használó csapatok 2,26-szor magasabb teljes integrációs arányt és a legalacsonyabb AI-frusztrációs pontszámot (27,1%) jelentenek.

Értékesítési és CRM-intelligencia

Az értékesítési munkafolyamatok e-maileket, megbeszéléseket, CRM-eket és táblázatokat foglalnak magukban. Kontextus nélkül az AI nem tudja megérteni az üzlet dinamikáját vagy a vevő szándékát.

A kontextus-mérnöki munka révén az AI betekintést nyer a vevők beszélgetéseibe, idővonalába, kommunikációs hangnemébe és korábbi interakcióiba. Ez segít felismerni a fontos információkat, felismerni a megakadt ügyleteket és javaslatot tenni a megfelelő következő lépésre.

📌 Valós példa: A Microsoft saját értékesítési csapata a Copilot for Sales alkalmazást használja, amely az Outlookból, a Teams hívásokból, a CRM frissítésekből és a jegyzetekből meríti a kontextust, hogy a megfelelő betekintést nyújtsa és a követő lépéseket megfogalmazza. A belső csapatok 20%-os növekedést tapasztaltak a megnyert üzletekben és 9,4%-os emelkedést az eladók egy főre jutó bevételében, ami jól mutatja, hogy a kontextusvezérelt AI hogyan növeli a teljesítményt.

Egészségügyi és klinikai AI asszisztensek

Az orvosi döntések a betegek kórtörténetén, laboreredményein, receptjein és az orvosok feljegyzésein alapulnak, de ezek az információk gyakran egymástól független rendszerekben találhatók. Ez azt eredményezi, hogy az orvosok sok időt veszítenek az adatok újbóli bevitelével, és kockáztatják, hogy fontos részleteket figyelmen kívül hagynak. Néha időük közel 40%-át adminisztratív munkával töltik.

Az AI kontextus-mérnöki munka összekapcsolja ezeket az adatpontokat. Pontos összefoglalásokkal, dokumentumtervezetekkel, a releváns előzmények kiemelésével, valamint a potenciális kockázatok vagy a következő lépések feltárásával támogatja az orvosokat.

📌 Valós példa: Az Atrium Health a Microsofttal együttműködésben kifejlesztett Nuance DAX Copilot szoftvert használja a korábbi feljegyzések és a valós idejű beszélgetések alapján a klinikai látogatások automatikus dokumentálására. Ennek eredményeként az orvosok naponta 30–40 percet spóroltak a dokumentációval, míg egy 12 orvosi szakterületet felölelő tanulmány a betegek biztonságának veszélyeztetése nélkül magasabb szolgáltatói hatékonyságról és elégedettségről számolt be.

HR és toborzási asszisztensek

A toborzási döntések a kontextustól függenek, például a készségektől, az interjú visszajelzéseitől, a pozícióhoz való illeszkedéstől és a korábbi felvételi adatoktól. Az AI kontextus-mérnöki munka lehetővé teszi az önéletrajzok, a munkaköri leírások, az interjú jegyzőkönyvek és a korábbi minták elemzését, hogy gyorsabban azonosíthassa a legmegfelelőbb jelölteket.

📌 Valós példa: A Micron vállalati csapatai az Eightfold AI-t használják, egy tehetségintelligencia-platformot, amely elemzi az önéletrajzokat, a pozíció követelményeit, a belső karrierutakat és a korábbi felvételi eredményeket, hogy megjósolja a munkakörhöz való illeszkedést. A platform a jelölteket készségeik és potenciáljuk alapján értékeli. Az eredmény? Bővült a tehetségállományuk, és havonta nyolc további jelöltet vettek fel egy kis létszámú toborzócsapattal.

A kontextus-mérnöki munkát támogató eszközök és platformok

Mely eszközök segítenek a kontextus-tervezés nagyméretű megvalósításában?

1. LangChain (A kontextust leginkább programozással lehet összeállítani)

A LangChain egy nyílt forráskódú koordinációs keretrendszer olyan AI-rendszerek építéséhez, ahol a kontextust programozással kell összeállítani, frissíteni és továbbítani.

Az AI-ügynök eszköz segít a fejlesztőknek az LLM-eket eszközökkel, adatforrásokkal, memóriával és vezérlő logikával összekapcsolni, ahelyett, hogy statikus utasításokra támaszkodnának.

A Core LangChain kezeli a láncolást és a visszakeresést, míg a LangGraph állapotfüggő, gráf alapú munkafolyamatokat tesz lehetővé komplex, több lépésből álló érveléshez.

A DeepAgents erre az alapra építve támogatja a hosszú távú, autonóm ügynököket tervezéssel, alügynökökkel és állandó kontextussal.

Ezek a komponensek együttesen teszik a LangChain-t a kontextus-mérnöki munka vezérlő rétegévé, amely eldönti, mikor kell a kontextust lekérni, hogyan alakul, és hol áramlik az ügynöki munkafolyamatokban.

A LangChain legjobb tulajdonságai

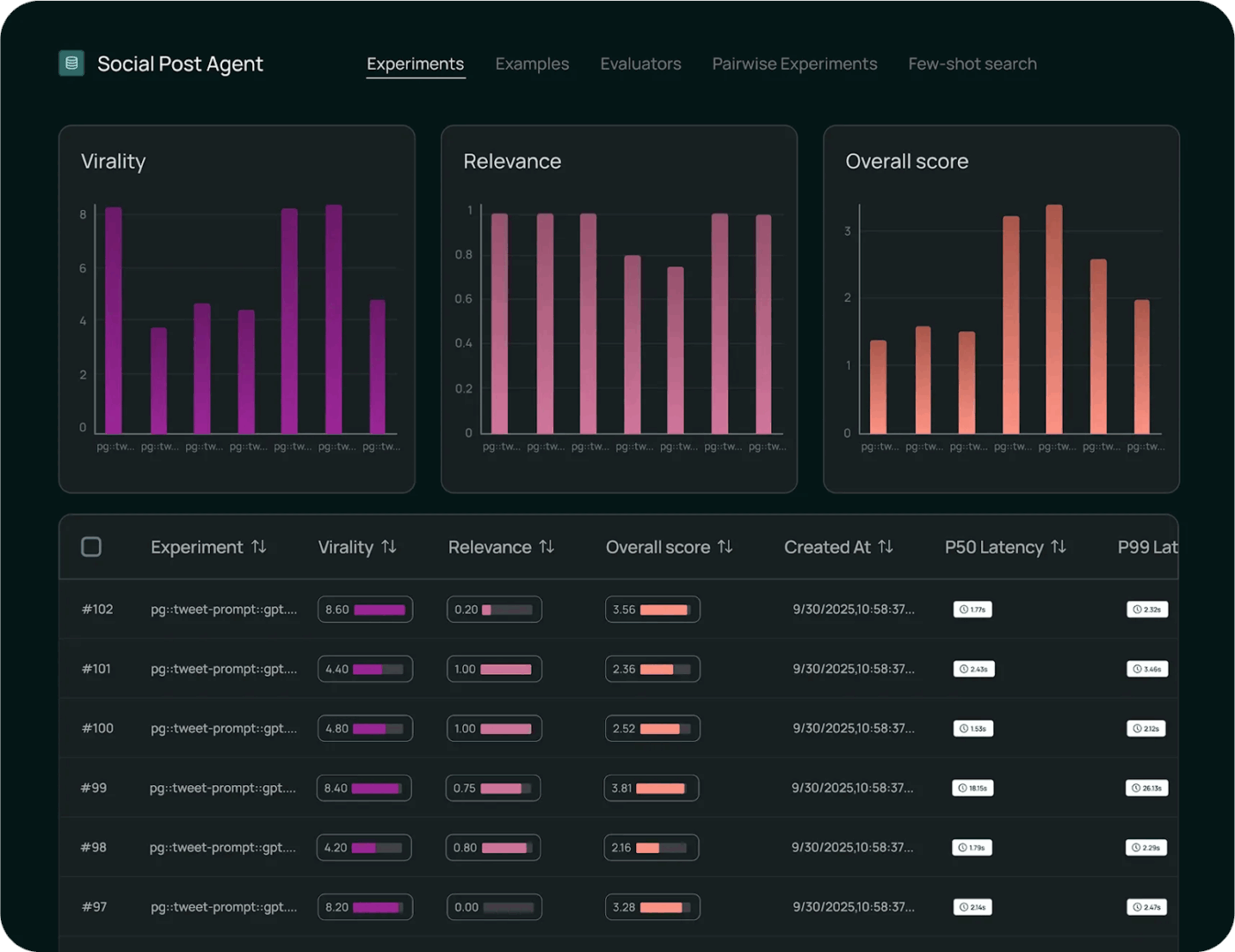

- Figyelje a végrehajtást megfigyelhetőségi eszközökkel, hogy nyomon követhesse a modellhívásokat, a késleltetést, a hibákat és a kontextus áramlását a hibakeresés és a teljesítményelemzés érdekében.

- Értékelje a modell viselkedését szisztematikusan a beépített tesztelési keretrendszerek segítségével, amelyek mérik a helyességet, összehasonlítják a kimeneteket és validálják a változásokat a referenciaértékekhez képest.

- Vezessen be nagyméretű munkafolyamatokat olyan felügyelt környezetekkel, amelyek támogatják a verziókezelést, a bevezetés ellenőrzését, valamint a láncok és ügynökök termeléskész végrehajtását.

A LangChain korlátai

- A szerszám kezdőknek nehéz megtanulni, és a dokumentáció, amelyet néhány naponta frissítenek, túlterhelővé teszi.

A LangChain árazása

- Fejlesztő: Ingyenes

- Plusz: 39 USD/felhasználó/hónap

- Vállalatok: Egyedi árazás

LangChain értékelések és vélemények

- G2: 4. 7/5, (30+ értékelés)

- Capterra: Nincs elég értékelés és vélemény

Mit mondanak a LangChainről a valódi felhasználók?

Egy Reddit-felhasználó szerint:

Miután kipróbáltam néhány különböző módszert, végül a langgraph worfklows standard eszközhívás használata tetszett a legjobban. Tehát a determinisztikus munkafolyamatokat olyan ügynökökként csomagolom, amelyeket a fő LLM eszközként hív meg. Így a fő LLM valódi dinamikus felhasználói élményt nyújt, és csak átadja a nehéz munkát a munkafolyamatnak, amely aztán szépen visszaadja az eredményt a fő LLM-nek.

Miután kipróbáltam néhány különböző módszert, végül a langgraph worfklows standard eszközhívás használata tetszett a legjobban. Tehát a determinisztikus munkafolyamatokat olyan ügynökökként csomagolom, amelyeket a fő LLM eszközként hív meg. Így a fő LLM valódi dinamikus felhasználói élményt nyújt, és csak átadja a nehéz munkát a munkafolyamatnak, amely aztán szépen visszaadja az eredményt a fő LLM-nek.

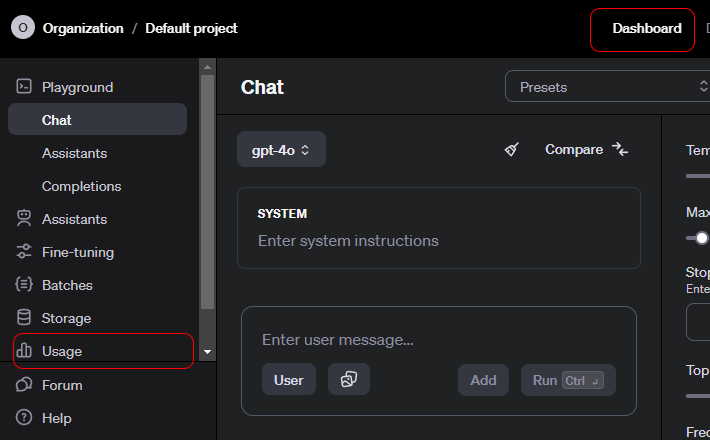

2. OpenAI API (A kontextus-alapú AI API strukturált kontextust, eszközhívást és rendszer szintű vezérlést biztosít)

Az OpenAI API egy általános célú interfész, amely hozzáférést biztosít a fejlett generatív AI modellekhez, amelyek számos alkalmazást támogatnak.

A fejlesztők ezt használják a nyelvértés és -generálás integrálására a termékekbe. Támogatja az összefoglalást, a fordítást, a kódsegítést és az érvelést is.

Az API támogatja a csevegést, a beágyazásokat, a függvényhívásokat, a moderálást és a multimodális bemeneteket, lehetővé téve a modellekkel való strukturált interakciókat. Az OpenAI kiválóan alkalmas gyors prototípus-készítésre, mivel kezeli a hitelesítést, a méretezést és a verziókezelést.

A könnyű használat annak köszönhető, hogy az API a komplex modell viselkedést egyszerű, megbízható végpontokká absztrahálja.

Az OpenAI API legjobb funkciói

- Kontextusérzékeny kimeneteket generálunk szöveg, kód és multimodális bemenetek alapján természetes nyelvi feladatokhoz és érveléshez.

- Hozzon létre gazdag beágyazásokat a szemantikai keresés, a klaszterezés és a vektor alapú visszakeresési munkafolyamatok támogatásához.

- Hívjon meg funkciókat és eszközöket strukturált hívásokon keresztül, amelyek lehetővé teszik a modellek számára a külső rendszerekkel és szolgáltatásokkal való interakciót.

OpenAI API korlátozás

- Nincs natív hosszú távú memória. Az API alapértelmezés szerint állapotmentes.

OpenAI API árak

GPT-5. 2

- Bemenet: 1,750 dollár / 1 millió token

- Cache-elt bemenet: 0,175 USD / 1 millió token

- Kimenet: 14 000 dollár / 1 millió token

GPT-5. 2 Pro

- Bemenet: 21,00 $ / 1 millió token

- Cache-elt bemenet: Nem elérhető

- Kimenet: 168,00 dollár / 1 millió token

GPT-5 Mini

- Bemenet: 0,250 USD / 1 millió token

- Cache-elt bemenet: 0,025 USD / 1 millió token

- Kimenet: 2000 dollár / 1 millió token

OpenAI API értékelések és vélemények

- G2: Nincs elég értékelés

- Capterra: Nincs elég értékelés

Mit mondanak a valós felhasználók az OpenAI API-ról?

Egy Reddit-felhasználó szerint:

Az OpenAI API-jai ugyanolyanok, mint bármelyik másik, így technikai szempontból nem kell tanulni a használatukat. Az összes végpont, paraméter és példaválasz jól dokumentált. Ha van alapvető fejlesztői tapasztalatod, akkor nem kell tanfolyamra járnod. Egyetértek a fenti ponttal, hogy meg kell tanulni a Python nyelvet. A Python könyvtárak minden releváns információt tartalmaznak, ami megkönnyíti az életet. Ha a JS-nél szeretnél maradni, akkor Node könyvtárak is rendelkezésre állnak. A legnagyobb tanulási görbe az lesz, hogy hogyan lehet őket stratégiailag használni. Szánj egy kis időt a rendszerüzenetek, a felhasználói promptok és a paraméterek kipróbálására a Playgroundban, mielőtt megpróbálnád kóddal megírni. (Biztos vagyok benne, hogy miután találtál valamit, ami működik, a Playgroundból beszerezhetsz mintakódot. )

Az OpenAI API-jai ugyanolyanok, mint bármelyik másik, így technikai szempontból nem kell tanulni a használatukat. Az összes végpont, paraméter és példaválasz jól dokumentált. Ha van alapvető fejlesztői tapasztalatod, akkor nem kell tanfolyamra járnod. Egyetértek a fenti ponttal, hogy meg kell tanulni a Python nyelvet. A Python könyvtárak minden releváns információt tartalmaznak, ami megkönnyíti az életet. Ha a JS-nél szeretnél maradni, akkor Node könyvtárak is rendelkezésre állnak. A legnagyobb tanulási görbe az lesz, hogy hogyan lehet őket stratégiailag használni. Szánj egy kis időt a rendszerüzenetek, a felhasználói promptok és a paraméterek kipróbálására a Playgroundban, mielőtt megpróbálnád kóddal megírni. (Biztos vagyok benne, hogy miután találtál valamit, ami működik, a Playgroundból beszerezhetsz mintakódot. )

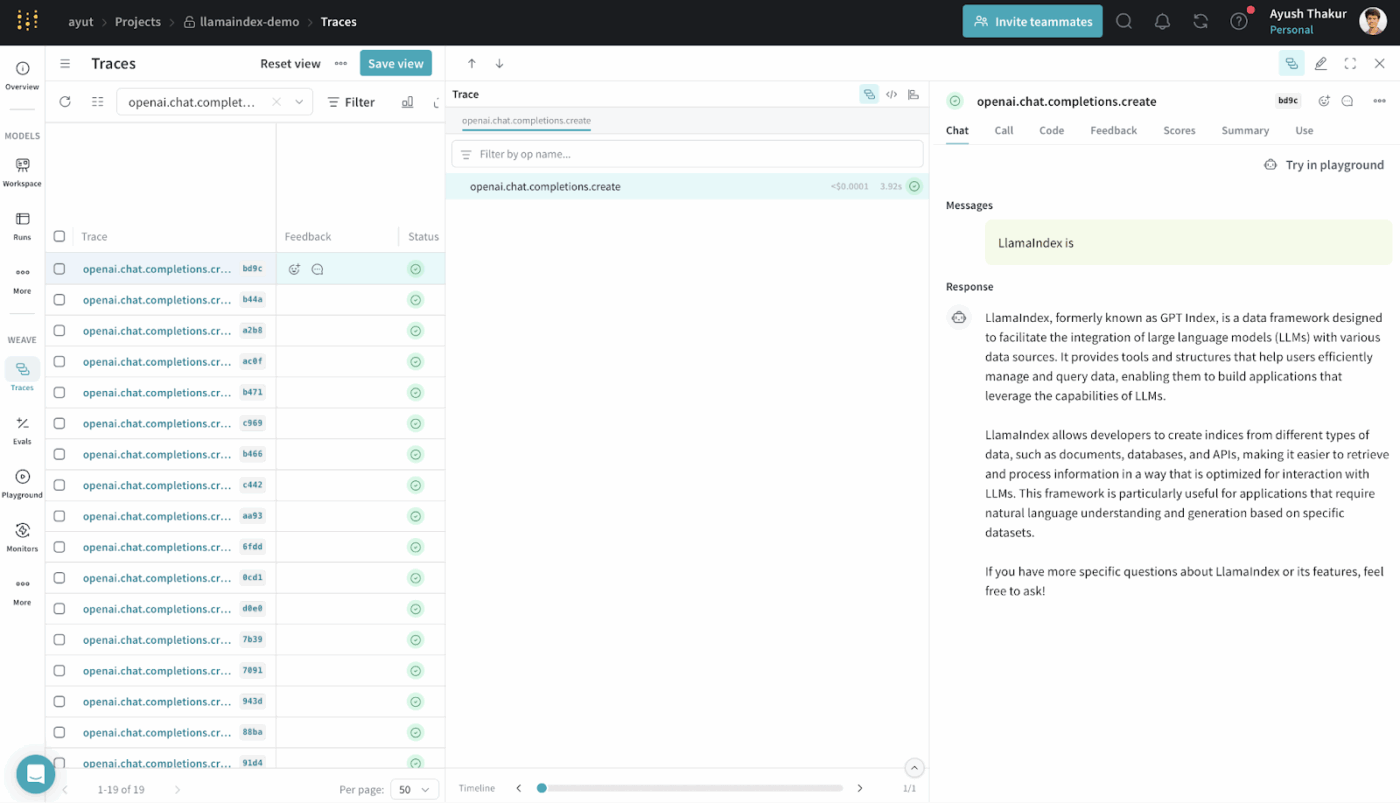

3. LlamaIndex (a legjobb a visszakeresés-kiegészítő generáló rendszerhez)

A LlamaIndex egy nyílt forráskódú adatkörnyezet, amelynek célja, hogy a külső adatokat hozzáférhetővé és használhatóvá tegye a nagy nyelvi modellek számára.

Csatlakozókat, indexeket és lekérdezési felületeket biztosít, amelyek a strukturált és strukturálatlan adatokat az LLM-ek számára hatékonyan értelmezhető formátumokká alakítják át.

RAG rendszereket lehet építeni mélyreható egyedi infrastruktúra nélkül. Ez absztrahálja a visszakeresést, a vektorizálást és a relevancia rangsorolást.

Általában olyan felhasználási esetekben alkalmazzák, mint a szemantikai keresés, az összefoglalás és a kérdések megválaszolása, valós adatok alapján.

A LlamaIndex legjobb funkciói

- Indexelje a heterogén adatforrásokat olyan kereshető struktúrákba, amelyeket az LLM-ek hatékonyan lekérdezhetnek.

- Vektoros kereséssel és lekérdezések tervezésével stratégiailag nyerjük ki a kontextust a pontos bizonyítékok beillesztéséhez.

- Tömörítsük és foglaljuk össze a kontextust, hogy a következtetés hatékony és releváns maradjon.

A LlamaIndex árazása

- Ingyenes

- Kezdő csomag: 50 USD/hó

- Előny: 500 dollár/hó

- Vállalatok: Egyedi árazás

LlamaIndex értékelések és vélemények

- G2: Nincs elég értékelés

- Capterra: Nincs elég értékelés

Mit mondanak a LlamaIndexről a valódi felhasználók?

Egy felhasználó a Redditen osztja meg véleményét:

Őszintén szólva úgy gondolom, hogy a legtöbb ilyen genAi keretrendszer, mint a langchain vagy a llamaindex, nem túl jó, és bonyolultabbá teszi a kódot. Jobb a vanilla python használata.

Őszintén szólva úgy gondolom, hogy a legtöbb ilyen genAi keretrendszer, mint a langchain vagy a llamaindex, nem túl jó, és bonyolultabbá teszi a kódot. Jobb a vanilla python használata.

4. ClickUp BrainGPT (A legjobb munkahelyi AI asszisztens)

A listán szereplő legtöbb eszköz segít a kontextus-tervezés egyes részeiben. Összeállítják a promptokat, lekérik az adatokat vagy összehangolják a munkafolyamatokat.

A ClickUp Brain más megközelítést alkalmaz. A világ első konvergált AI munkaterületeként a ClickUp egyetlen platformba egyesíti a projekteket, feladatokat, dokumentumokat és kommunikációt, beágyazott kontextusérzékeny AI-vel.

Így 👇

Dolgozzon olyan AI-val, amely megérti Önt és a munkáját!

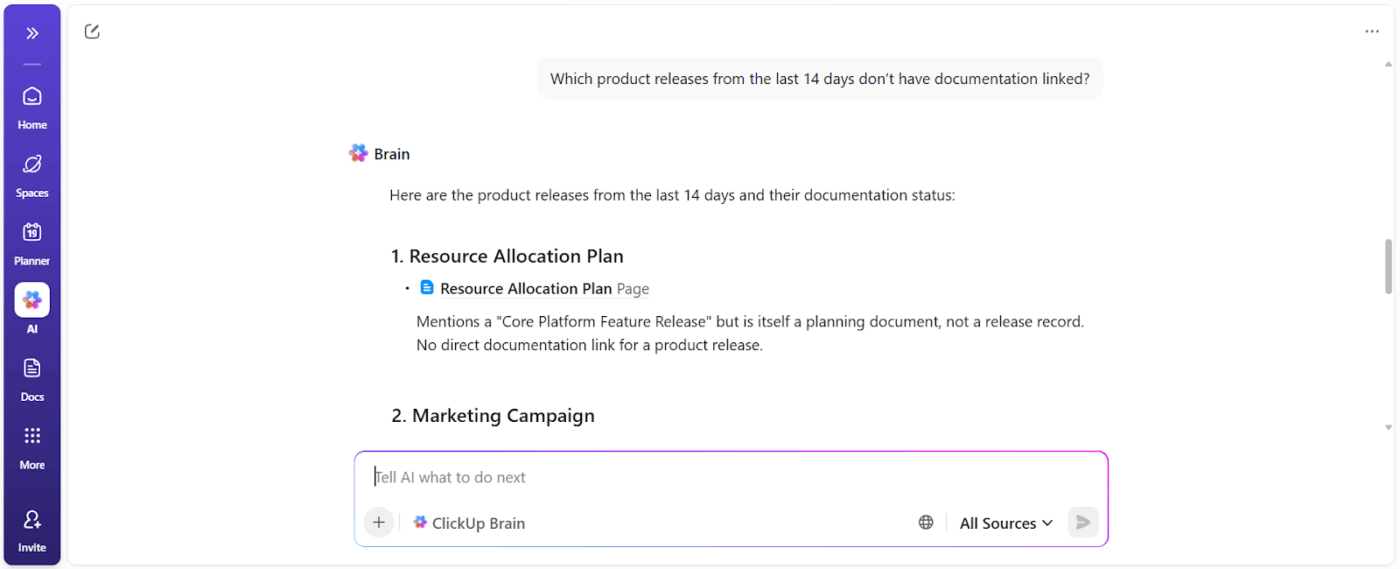

A ClickUp Brain megérti a munkád kontextusát.

A kontextust a ClickUp feladatokból, dokumentumokból, megjegyzésekből, függőségekből, állapotokból, ütemtervekből és tulajdonjogokból nyeri. Nem kell beillesztenie a háttérinformációkat, vagy elmagyarázni a projekt történetét minden alkalommal, amikor a munkaterület adatai alapján kérdést tesz fel.

📌 Például, amikor egy menedzser azt kérdezi: „Mi lassítja a harmadik negyedévi kampányt?”, a rendszer átvizsgálja a munkaterületet és felszínre hozza a konkrét akadályokat, például:

- Nem hozzárendelt feladatok

- Függőben lévő jóváhagyások

- Megakadt értékelések

- Az eszközöket váró függőségek

Kapunk egy blokkoló jelentést, amely bemutatja a cselekvés felelőseit és az időbeli hatásokat.

Már a végrehajtáshoz igazított AI-írás

A ClickUp Brain mesterséges intelligencia íróasszisztensként működik, de egy fontos különbséggel: írás közben figyelembe veszi, hogy a csapat mit épít.

Amikor egy termékmenedzser vagy marketinges ClickUp Doc-ban fogalmazza meg a bevezetési üzenetet, a Brain a következőket teheti:

- Határozza meg az értékajánlatokat a meglévő termékkontextus felhasználásával

- A különböző közönségszintekhez igazítsa az üzeneteket

- Írja át a tartalmat, hogy az illeszkedjen a hangnemhez, az egyértelműséghez vagy a pozicionálási célokhoz.

Ennél is fontosabb, hogy az írás kapcsolódjon a feladatokhoz, az ütemtervekhez és a jóváhagyásokhoz. Nincs szakadék a dokumentáció és a munka között. Ez jelentős időmegtakarítást jelent, mivel a tartalmat később nem kell újra értelmezni.

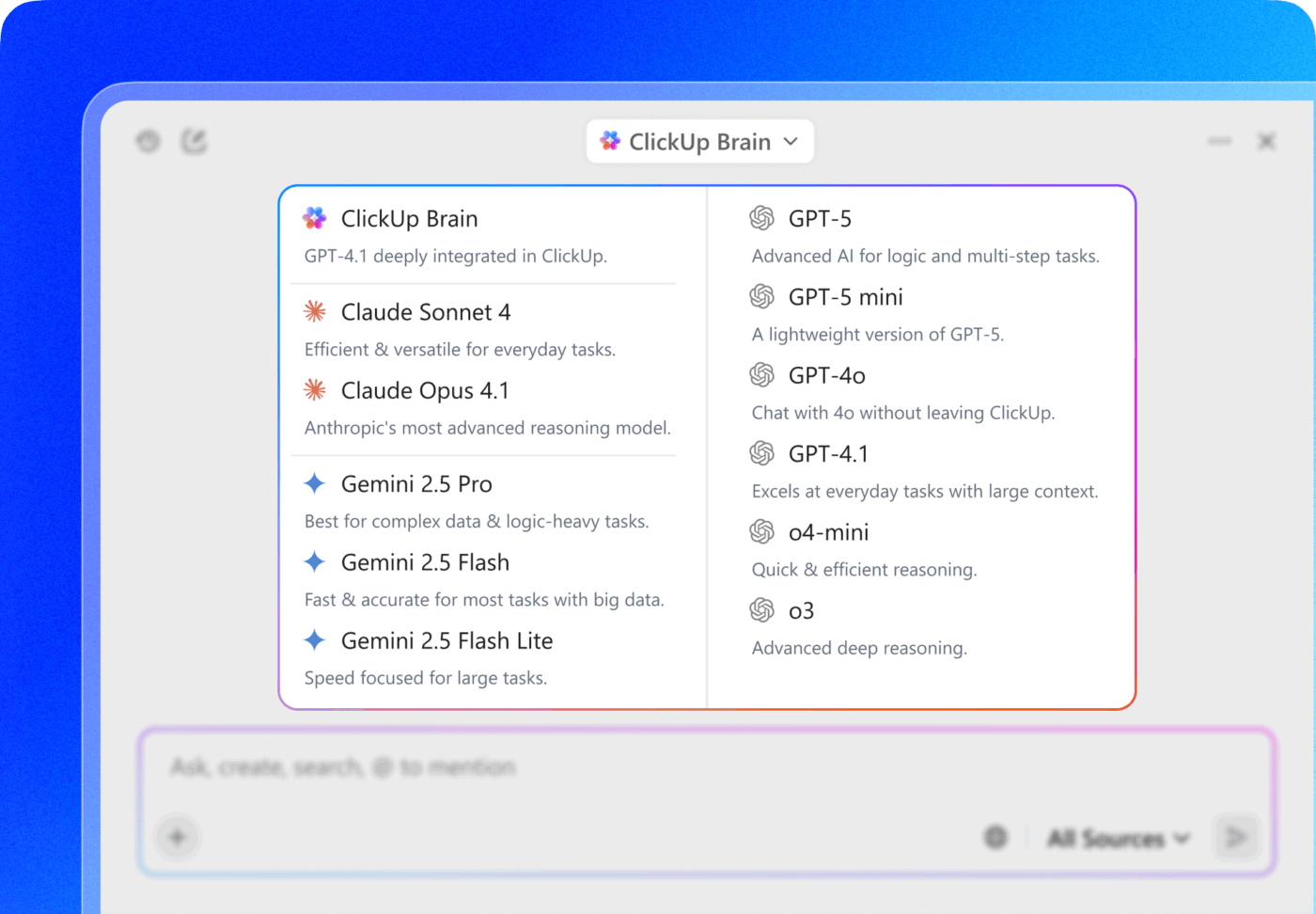

💡 Profi tipp: Válasszon a ChatGPT, Claude és Gemini családok több AI modellje közül közvetlenül a ClickUp Brain-ben!

- Használjon gyors, könnyű modellt a feladatban szereplő találkozói jegyzetek összefoglalásához.

- Váltson egy inkább érvelésen alapuló modellre, amikor a kampány teljesítményét elemzi a Docs, a feladatok és a műszerfalak között.

A valódi erőforrás? Párosítsa a modell kiválasztását a ClickUp kapcsolódó kontextusával – feladatok, megjegyzések, dokumentumok és egyéni mezők –, így a modell nem csak „intelligens” lesz, hanem a valós munkaterületén is működik.

Kontextusfüggő feladat-automatizálás, amely csökkenti a manuális ráfordítást

Az AI-alapú feladatokkal a ClickUp a kontextust cselekvéssé alakítja. A legfontosabb funkciók a következők:

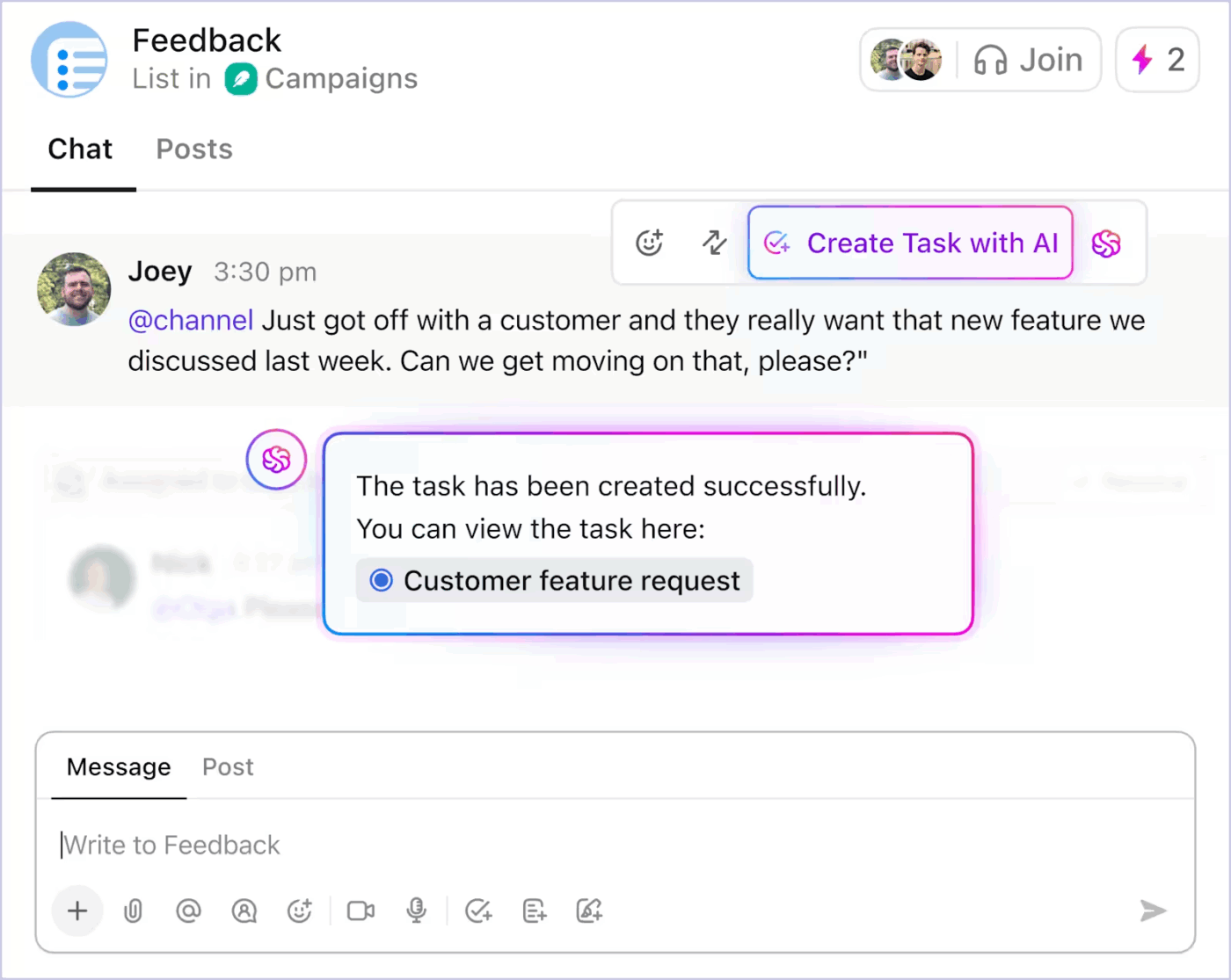

- A ClickUp Chat beszélgetéseit feladatokká alakítja

- A hatókör alapján generáljon alfeladatokat és feladatleírásokat egy meglévő feladat címéből.

- Javasoljon következő lépéseket, ha a munka megakad

- A rutinfrissítések automatizálása a valós projektállapot felhasználásával

Így használhatja a ClickUp AI-alapú feladatautomatizálását a monoton munkák csökkentésére 👇

Mivel az automatizálás élő kontextuson alapul, a csapatok kevesebb időt töltenek azzal, hogy a szándékot struktúrába fordítsák. A munka folyamatos manuális beavatkozás nélkül halad előre.

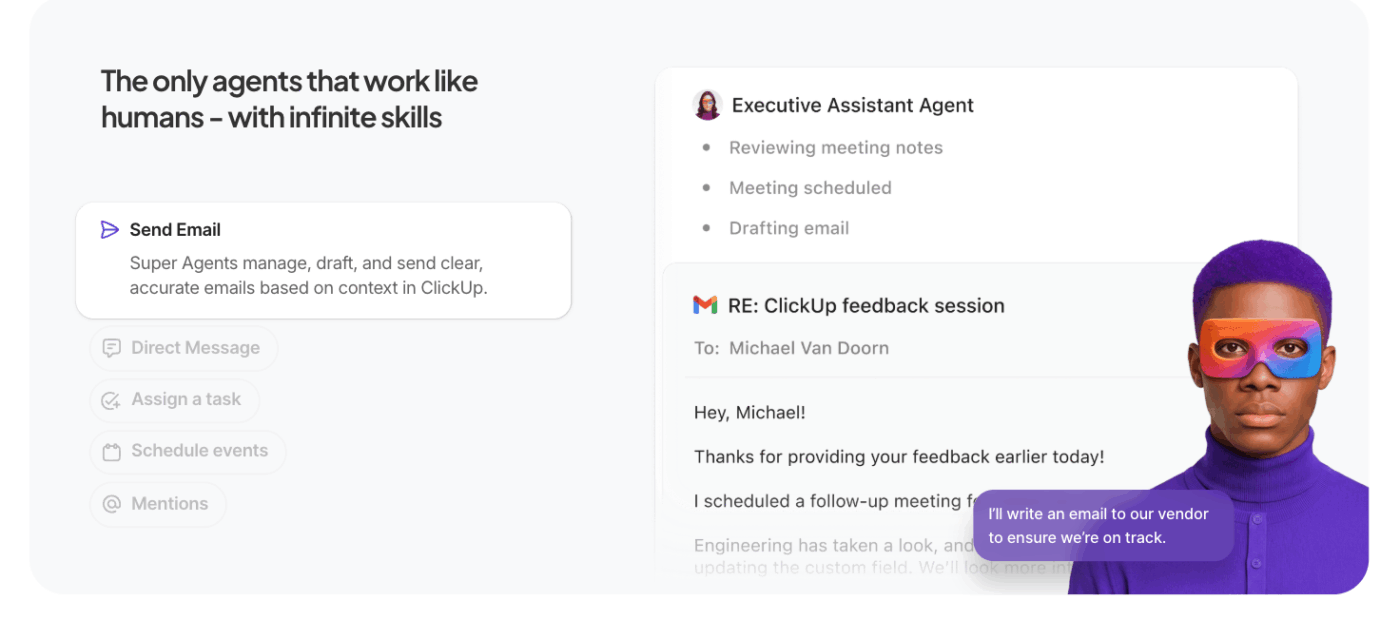

Hagyjuk, hogy az AI-ügynökök végezzék el a nehéz munkát

A ClickUp Super Agents kiterjeszti a ClickUp kontextusfüggő mesterséges intelligenciáját az egyedi lekérdezéseken túl az autonóm, több lépésből álló végrehajtásra.

Ahelyett, hogy konkrét utasításokra várnának, ezek az automatizálásra szolgáló AI-ügynökök a munkaterületen a felhasználó nevében cselekszenek, és a felhasználó által meghatározott kontextus és célok alapján végzik el a feladatokat, szabályokat és eredményeket.

Mi különbözteti meg őket a hagyományos ügynököktől:

- Proaktív feladatvégrehajtás: Az ügynökök értelmezik a munkaterület kontextusát – feladatokat, függőségeket, ütemterveket – és végrehajtják a sorozatokat, például a státuszok frissítését, alfeladatok létrehozását vagy a tulajdonosok értesítését manuális utasítások nélkül.

- Célorientált munkafolyamatok: Meghatározza a magas szintű célt (pl. „A harmadik negyedévi kampány akadályainak megoldása”), és az ügynök megtervezi, lekérdezi a kontextust, és végrehajtja a munkát előre vivő lépéseket.

- Tartós kontextus és memória: Az ügynökök lépésről lépésre fenntartják az állapotot, ami lehetővé teszi számukra, hogy elgondolkodjanak azon, mi történt már és mi maradt még hátra, javítva ezzel a pontosságot és csökkentve a felesleges munkát.

- Integráció a munkaterületi eszközökkel: Interakcióba lépnek a ClickUp Tasks, Docs és kommentekkel, valamint a kapcsolódó eszközökkel, és a rendszerek között koordinálnak a munkafolyamatok befejezése érdekében, ahelyett, hogy kontextus nélküli műveleteket javasolnának.

📚 További információ: Mik azok a modellalapú reflex ügynökök?

A ClickUp legjobb funkciói

- Hozza az AI-t az asztali számítógépére és a csatlakoztatott alkalmazásokba a ClickUp Brain MAX segítségével: Keressen a munkaterületén, írja le a beszédet szöveggé, váltson a legjobb AI-modellek között, és hajtson végre műveleteket feladatokon, dokumentumokon és csevegéseken anélkül, hogy megszakítaná a munkáját.

- Az Enterprise Search segítségével azonnal megtalálhatja a válaszokat: Keressen feladatok, dokumentumok, megjegyzések, fájlok és kapcsolódó eszközök között, így a kritikus kontextus soha nem vész el és nem lesz elszigetelve.

- Gyorsan rögzítheti ötleteit a Talk to Text funkcióval: diktálja le jegyzeteit, terveit vagy frissítéseit, és alakítsa át beszédét strukturált munkává anélkül, hogy elveszítené koncentrációját vagy lendületét.

- Csökkentse a manuális munkát a ClickUp Dashboards segítségével: Indítson el automatikusan feladatfrissítéseket, feladatok kiosztását és nyomon követéseket a valós munkaterület kontextusa és állapotváltozásai alapján.

- Tartsd a beszélgetéseket cselekvésorientáltnak a ClickUp Chat segítségével: Beszéljétek meg a döntéseket, visszajelzéseket és jóváhagyásokat közvetlenül a feladatok mellett, így a beszélgetések a végrehajtáshoz kapcsolódnak.

- Cserélje le a megbeszéléseket SyncUps -ra: ossza meg az aszinkron frissítéseket, szerezzen be AI által generált összefoglalókat, és tartsa összehangolva a csapatokat ismétlődő hívások nélkül.

- Koordinálja a csapatokat a Teams Hub segítségével: Tekintse meg a csapatok tevékenységét, felelősségi körét, prioritásait és kapacitását egy helyen, hogy időben felismerje a kockázatokat és újból egyensúlyba hozza a munkát.

- Tervezd meg a napodat a ClickUp Calendar segítségével: Szerezz AI-támogatott napi terveket a határidők, prioritások és munkaterhelés alapján, hogy a személyes fókuszod összhangban legyen a csapat céljaival.

A ClickUp korlátai

- Funkciói és testreszabási lehetőségei túlterhelhetik az új felhasználókat.

ClickUp árak

ClickUp értékelések és vélemények

- G2: 4. 7/5 (10 585+ értékelés)

- Capterra: 4. 6/5 (4500+ értékelés)

Mit mondanak a ClickUp AI-ről a valódi felhasználók?

Egy ClickUp-felhasználó is megosztja tapasztalatait a G2-n:

A ClickUp Brain MAX hihetetlenül megkönnyítette a munkámat. Az, hogy több LLM-et egyesít egy platformon, gyorsabbá és megbízhatóbbá teszi a válaszokat, és a platformon belüli beszéd-szöveggé alakítás hatalmas időmegtakarítást jelent. Nagyon értékelem a vállalati szintű biztonságot is, ami nyugodtságot ad az érzékeny információk kezelése során. […] A legkiemelkedőbb tulajdonsága, hogy segít kiszűrni a zavaró tényezőket és tisztábban gondolkodni – függetlenül attól, hogy értekezleteket foglalok össze, tartalmat szerkesztem vagy új ötleteket gyűjtök. Olyan, mintha egy mindenre kiterjedő AI-asszisztensem lenne, aki alkalmazkodik minden igényemhez.

A ClickUp Brain MAX hihetetlenül megkönnyítette a munkámat. Az, hogy több LLM-et egyesít egy platformon, gyorsabbá és megbízhatóbbá teszi a válaszokat, és a platformon belüli beszéd-szöveggé alakítás hatalmas időmegtakarítást jelent. Nagyon értékelem a vállalati szintű biztonságot is, ami nyugodtságot ad az érzékeny információk kezelése során. […] A legkiemelkedőbb tulajdonsága, hogy segít kiszűrni a zavaró tényezőket és tisztábban gondolkodni – függetlenül attól, hogy értekezleteket foglalok össze, tartalmat szerkesztem vagy új ötleteket gyűjtök. Olyan, mintha egy mindenre kiterjedő AI-asszisztensem lenne, aki alkalmazkodik minden igényemhez.

Kihívások és szempontok az AI kontextus-mérnökséggel való munkában

Íme a legfontosabb kihívások, amelyekkel tisztában kell lennie. A kontextus kezelhetetlenné válhat, még akkor is, ha a modell 1 millió tokenes kontextusablakot támogat. Íme a legfontosabb kihívások, amelyekkel tisztában kell lennie 👇

Kontextusmérgezés

Ha egy hallucináció vagy helytelen következtetés bekerül a kontextusba, és azt többször is hivatkoznak, a modell tényként kezeli. Ez a mérgezett kontextus a munkafolyamatokat érvénytelen feltételezésekbe zárhatja, amelyek idővel megmaradnak és rontják a kimeneti minőséget.

Kontextus-figyelemelterelés

A nagyobb kontextusok csábítóak, de ha a kontextus túl nagyra nő, a modellek túlzottan összpontosítanak a felhalmozott történelemre, és nem használják ki teljes mértékben a képzés során tanultakat. Ez oda vezethet, hogy az AI a múltbeli részleteken ragad le, ahelyett, hogy a következő legjobb lépést szintetizálná.

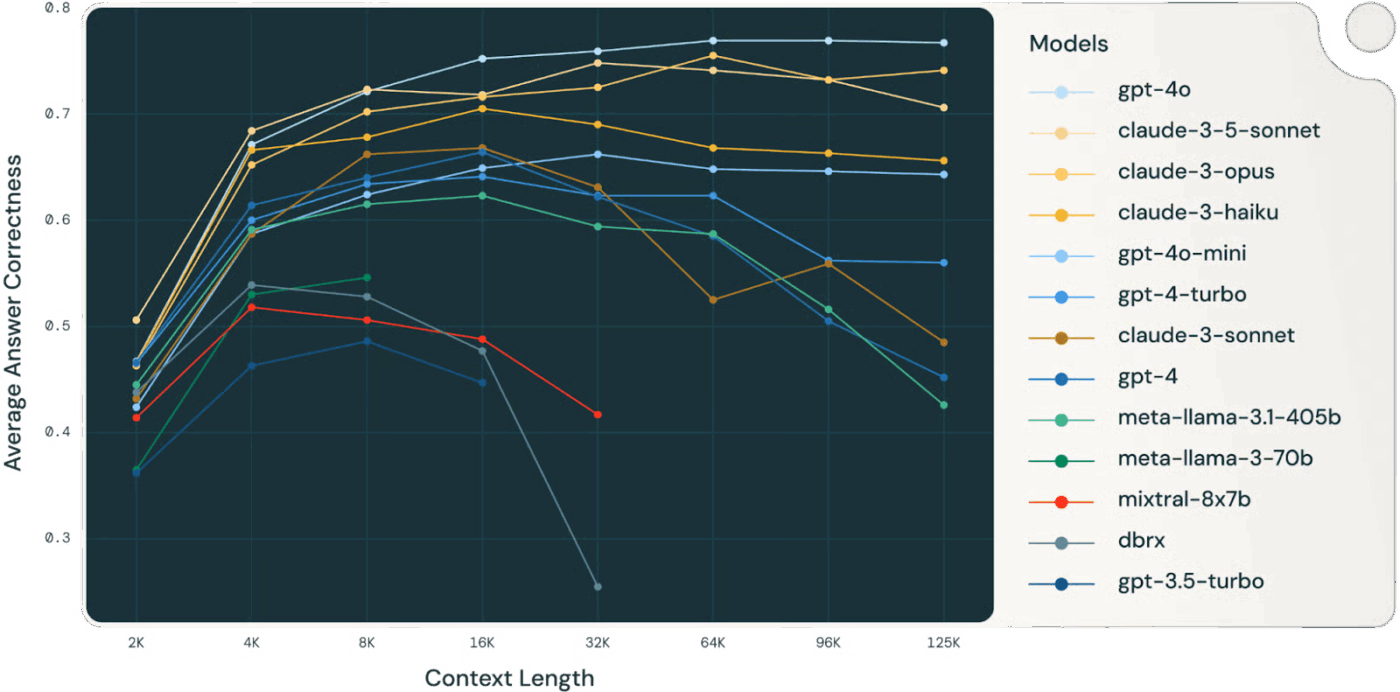

👀 Tudta? A Databricks tanulmánya megállapította, hogy a Llama 3. 1 405B modell pontossága 32 000 token körül kezdett csökkenni, jóval azelőtt, hogy a kontextusablak megtelt volna. A kisebb modellek még korábban romlottak.

A modellek gyakran már jóval azelőtt elveszítik a következtetés minőségét, hogy „elfogyna” a kontextusuk, ezért a kontextus kiválasztása és tömörítése értékesebb, mint a nyers kontextus mérete.

📚 További információ: Mi az a munkahelyi keresés, és hogyan javítja az alkalmazottak termelékenységét?

Kontextus zavar

A kontextusban szereplő irreleváns vagy alacsony jelű információk a kritikus adatokkal versengenek a figyelemért. Amikor a modell kénytelen minden kontextus token használatára, a döntések zavarosak lesznek és a pontosság romlik – még akkor is, ha technikailag „több” információ áll rendelkezésre.

Kontextusütközés

Az információk felhalmozódásával az új tények vagy eszközleírások ellentmondhatnak a korábbi tartalomnak. Ha ellentmondásos kontextus áll fenn, a modellek nehezen tudják összeegyeztetni az egymással versengő jeleket, ami inkonzisztens vagy koherens kimenetekhez vezet.

Eszközök túlterhelése és kiválasztási problémák

Ha túl sok eszközdefiníciót tartalmaz a kontextus, szűrés nélkül, a modell irreleváns eszközöket hívhat meg, vagy nem optimális eszközöket helyezhet előtérbe. A releváns eszközök szelektív betöltése csökkenti a zavart és javítja a döntés minőségét.

A mérnöki munka összetettsége és karbantartása

A hatékony kontextuskezeléshez folyamatos kontextus-kivágás, összefoglalás, kiszedés és karanténba helyezés szükséges. A rendszereknek el kell dönteniük, mikor tömörítsék a történetet, és mikor szerezzenek be új információkat, ami inkább átgondolt infrastruktúrát igényel, mint ad hoc trükköket.

Token-költségvetési fegyelem

Minden token befolyásolja a viselkedést; a nagyobb kontextusablakok nem garantálnak jobb eredményeket. A kontextust kezelni kell, mint egy kezelt erőforrást, mérlegelve a relevanciát és az aktualitást a tokenek költségével és a modell figyelem-költségvetésével szemben.

⚠️ Statisztikai figyelmeztetés: A munkavállalók közel 60%-a elismeri, hogy munkahelyén engedélyezetlen nyilvános AI-eszközöket használ, és gyakran érzékeny vállalati adatokat illeszt be felügyelet nélküli platformokra.

És a helyzet még rosszabb: a szervezetek 63%-a nem rendelkezik olyan AI-irányítási politikával, amely figyelemmel kísérné, korlátozná vagy akár csak felismerné ezt az árnyékos AI-használatot.

Az eredmény? Az adatok kiszivárognak, mert senki sem figyel arra, hogyan használják az AI-t.

A kontextus-mérnöki munka jövője

Ez jelzi az átmenetet a kísérletezésről a méretezhetőségre. A kontextust már nem emberek fogják kezelni, hanem kódok fogják generálni és kezelni. Ez a rendszer saját struktúrájának funkciója lesz.

Ezt Serge Liatko kiváló cikkével az OpenAI fejlesztői közösségről alapul véve foglaljuk össze:

A kontextus-tervezés a munkafolyamat-architektúrába fejlődik

A kontextus-mérnöki munka egyre inkább átadja helyét az automatizált munkafolyamat-architektúrának. A feladat nem korlátozódik majd a megfelelő tokenek bevitelére.

A hatékony kontextus-tervezés magában foglalja a teljes érvelési sorozatok, eszközök és adatáramok összehangolását, amelyek automatikusan alkalmazkodnak a változó igényekhez.

Ez azt jelenti, hogy olyan dinamikus rendszereket kell építeni, amelyek önállóan kezelik a megfelelő kontextust a holisztikus munkafolyamatokon belül.

Az automatizált koordináció felváltja a manuális utasításokat

A következő határ az önmagát szervező AI. Ez összekapcsolja a visszakeresést, az eszközöket, a memóriát és az üzleti logikát anélkül, hogy az emberek kézzel készítenék el az egyes promptokat vagy kontextuscsomagokat. Ahelyett, hogy minden adatot kifejezetten megadnának, a rendszerek következtetnek arra, hogy melyik kontextus releváns, és automatikusan kezelik azt a célok és a történelem alapján.

🧠 Ez már megvalósult a ClickUp Super Agents esetében. Ezek környezeti és mindig aktív AI-társak, amelyek segítenek megérteni és végrehajtani a munkát, akárcsak az emberek. Folyamatosan fejlődnek a korábbi interakciókból, gazdag memóriájukat felhasználva – tanulási preferenciák, legutóbbi cselekvések és projektelőzmények –, és proaktív módon tudnak cselekedni, problémákat eskalálni vagy betekintést nyújtani anélkül, hogy várakoznának egy utasításra.

A végpontok közötti automatizálás lesz a valódi termelékenységi tényező

A kontextus-mérnöki munka fejlődésével a termelékenység növekedése az automatizált munkafolyamatokból származik. Az LLM-ek ügynökként működnek, koordinálják az eszközöket, figyelemmel kísérik az állapotot és több lépésből álló logikai műveleteket hajtanak végre anélkül, hogy a felhasználónak mikromanagementtel kellene foglalkoznia.

Nem kell manuálisan beírnia a hiányzó kontextust. A rendszer összeállítja a kontextust, hogy támogassa a hosszú távú memóriát és a gondolkodást.

Az egységes kontextus javítja az AI működését

Az AI pontossága romlik, ha a kontextus töredékes az eszközök, a munkafolyamatok és az emberek között. Ha az információk szétszórtak, a modellek kénytelenek találgatni.

A konvergált AI-munkaterületek, mint például a ClickUp, kiválóan teljesítenek ebben – egyesítik a munkát, az adatokat és az AI-t a kontextus stratégiájában.

Készen állsz kipróbálni? Regisztrálj ingyenesen a ClickUp-on.