Neurala sökningar ersätter snabbt föråldrade, nyckelordsbaserade system som inte håller jämna steg med hur moderna team arbetar. I takt med att datamängderna växer och frågorna blir mer komplexa behöver teamen sökfunktioner som förstår avsikten och inte bara orden.

Så vad är egentligen neural sökning, och varför förändrar det hur företagsteam hittar information?

⏰ 60-sekunderssammanfattning

Drunknar du i dokument eller kämpar du för att hitta rätt information i olika verktyg? Så här förändrar neural sökning spelreglerna för företagsteam:

- Använd neural sökning för att förstå sammanhang och avsikt, inte bara nyckelord, för snabbare och smartare informationshämtning.

- Ersätt äldre söksystem med AI-drivna modeller som använder vektorsökning, semantisk betydelse och djupinlärning.

- Använd neural sökning inom e-handel, kunskapshantering, chatbots och hälso- och sjukvård för att eliminera manuell sökning.

- Integrera sömlöst i befintliga system med hjälp av inbäddade pipelines, vektordatabaser och hybridsökmodeller.

- Effektivisera arbetsflöden med ClickUps Connected Search, ClickUp Brain, inbyggda integrationer och automatiseringar.

Prova lämpliga sökverktyg för att få intelligent sökning till din arbetsplats och arbeta snabbare utan att behöva gräva.

Vad är neural sökning?

Neuralsökning är en AI-driven metod för informationshämtning som förstår vad du frågar, även om du inte formulerar det perfekt. Istället för att matcha exakta nyckelord tolkar den betydelsen och returnerar resultat baserat på kontext.

Den använder artificiella neurala nätverk och vektorsökning för att bearbeta sökfrågor på samma sätt som människor bearbetar språk:

- Känner automatiskt igen synonymer och relaterade termer.

- Tolkar avsikten bakom orden, inte bara orden i sig

- Lär sig av användarinteraktioner för att förbättra framtida sökresultat.

Det innebär att du eller ditt team inte längre behöver gissa det ”rätta” nyckelordet för att hitta ett dokument. Neurala sökningar anpassar sig efter hur du faktiskt talar och tänker, vilket gör dem mycket effektivare i komplexa, ostrukturerade miljöer.

Hur det skiljer sig från traditionell sökning baserad på nyckelord

Traditionell sökning med nyckelord fungerar genom att söka efter exakta termmatchningar. Det är snabbt men bokstavligt. Neurala sökningar, å andra sidan, förstår vad användaren försöker säga – även när orden inte matchar exakt.

Här är en jämförelse mellan de två:

| Funktion | Nyckelordsbaserad sökning | Neurala sökningar |

| Sökmatchningsfunktion | Exakt sökning efter nyckelord | Förstår avsikten och den semantiska betydelsen |

| Hantering av synonymer | Begränsad, kräver ofta manuell konfiguration | Känner automatiskt igen synonymer och relaterade termer |

| Språkförståelse | Bokstavlig och syntaxberoende | Kontextmedveten och språkanpassad |

| Svar på vaga frågor | Låg noggrannhet om inte nyckelorden är tydliga | Ger relevanta resultat även vid otydliga formuleringar. |

| Sökbarhetens anpassningsförmåga | Statiska regler, hårdkodad relevans | Lär sig av användarinteraktioner och förbättras med tiden |

| Stöd för ostrukturerade data | Begränsad och inkonsekvent | Optimerad för ostrukturerade data som dokument, anteckningar och meddelanden. |

| Teknikbas | Algoritmer för strängmatchning | Djupinlärning och vektorbaserade modeller |

| Användarupplevelse | Ofta frustrerande och ofullständigt | Intuitivt, mer anpassat till hur människor tänker och söker |

Om ditt team fortfarande förlitar sig på sökning baserad på nyckelord har du troligen stött på begränsningar. Neurala sökningar löser dessa problem genom att gå bortom det bokstavliga.

Deep learning och neurala nätverks roll i sökning

Neuralsökning gissar inte bara bättre – den lär sig bättre. Bakom kulisserna finns djupinlärningsmodeller som tränats på enorma mängder mänskligt språk. Dessa modeller upptäcker mönster, relationer och sammanhang på sätt som nyckelordsbaserade system inte kan replikera.

Så här förbättrar de söksystemen:

- Artificiella neurala nätverk simulerar hur hjärnan bearbetar information – genom att kartlägga relationer mellan ord, begrepp och fraser.

- Djupa neurala nätverk går flera lager på djupet och extraherar högnivåsemantisk mening från rådata.

- Maskininlärningsmodeller finjusterar dessa nätverk över tid med hjälp av feedback från användarinteraktioner och utvecklade sökfrågor.

För företagsteam som arbetar med tusentals dokument innebär detta snabbare upptäckter, bättre anpassning till användarnas avsikter och färre återvändsgränder.

Även om två användare ställer samma fråga på helt olika sätt kan en neural sökmotor som tränats i djupinlärning fortfarande leverera relevanta resultat.

📌 Viktig fakta: Till skillnad från sökning med nyckelord kan neural sökning hitta relevanta resultat även när inga ursprungliga söktermer förekommer i dokumentet, tack vare vektorbaserad likhet.

Hur neural sökning fungerar

Neuralsökning kan kännas som magi för användarna, men under ytan är det en välkonstruerad process som drivs av lager av AI-modeller, vektorinbäddningar och indexstrukturer.

Här är en förenklad beskrivning av hur en neural sökmotor bearbetar en sökfråga:

- En användare skriver in en fråga på naturligt språk: Det kan vara något vagt som ”bästa verktyg för introduktion av nyanställda” eller något specifikt som ”mall för arbetsflöde för godkännande av kontrakt”.

- Sökfrågan omvandlas till vektorinbäddningar: Istället för att bearbeta sökfrågan som ren text använder systemet en förtränad modell eller språkmodell för att omvandla den till numerisk vektorform. Dessa inbäddningar fångar den semantiska betydelsen av sökfrågan.

- Sökmotorn jämför vektorer med indexerade data: Varje dokument, anteckning eller supportärende i systemet har redan konverterats till vektorer under inläsningstiden. Motorn beräknar likheten mellan sökvektorn och dokumentvektorerna i indexet.

- Modellen returnerar de mest semantiskt relevanta resultaten: Istället för att hämta dokument som matchar nyckelord, hämtar den innehåll som stämmer överens med avsikten, även om det inte finns någon exakt överlappning av nyckelord.

- Resultaten förbättras med användarinteraktioner: Den implementerade modellen fortsätter att lära sig av feedback som klick, vistelsetid och hoppade resultat, vilket förbättrar framtida sökningar över tid.

Hela processen sker på några millisekunder.

Bakom kulisserna: tekniker som driver neural sökning

Flera avancerade tekniker samverkar för att göra neural sökning möjlig:

- Vektorsökning: Möjliggör snabb likhetsmatchning mellan sökvektorer och dokumentvektorer.

- Textinbäddningsmodeller: Konvertera naturligt språk till täta vektorrepresentationer

- Djupinlärning och maskininlärning: Används för att träna och finjustera modeller för bättre noggrannhet.

- Modellindex och inmatningspipeline: Hanterar indexering av inkommande data för realtidssökning.

- Söksystemets arkitektur: Skalbara lager som stöder frågor med hög volym och låg latens.

Neurala söksystem stöder också hybridmodeller som kombinerar traditionell sökning på nyckelord med semantisk sökning. Detta är idealiskt när precision och återhämtning är lika viktiga.

Oavsett om du söker bland tusentals kundärenden, interna kunskapsbaser eller molndokument förbättrar neural sökning dramatiskt kvaliteten, hastigheten och relevansen hos resultaten.

📖 Läs också: De bästa AI-sökmotorerna du måste prova

Fördelar med neural sökning

När ditt team inte kan hitta rätt dokument, instrumentpanel eller insikt, saktar arbetet ner. Neurala sökningar eliminerar den flaskhalsen genom att göra informationen omedelbart tillgänglig, även i stora, ostrukturerade system.

Här är vad det innebär i stor skala:

- Snabbare upptäckt i röriga data: Oavsett om du söker i supportärenden, e-postmeddelanden eller produktdokumentation, så skär neural sökning igenom bruset genom att förstå vad användarna menar och inte bara vad de skriver.

- Förbättrad relevans i sökresultaten: Istället för att hämta alla dokument som innehåller ordet ”onboarding” visar den det dokument som löser problemet.

- Stöd för sökningar med naturligt språk: Ditt team behöver inte komma ihåg filnamn eller tekniska termer – de kan söka på samma sätt som de talar.

- Kontinuerligt lärande från användarbeteende: Varje användarfråga, klick och interaktion finjusterar modellen, vilket gör resultaten smartare med tiden.

- Produktivitetsvinster för alla team: Ingenjörer, analytiker, juridiska team – i princip alla hittar det de behöver snabbare, med mindre fram och tillbaka.

Det förbättrar också sökupplevelsen mellan olika plattformar. Med system integrerade via API:er eller datakopplingar fungerar neural sökning som ett enhetligt lager som ger relevanta resultat från molndiskar, CRM-system, kunskapsbaser och mycket mer.

Om din organisation hanterar stora sökvolymer eller omfattande datakällor är uppgraderingen betydelsefull för:

- Minskad söktid

- Färre missade insikter

- Mer välgrundade och snabbare beslut

Neuralsökning optimerar informationshämtningen och förbättrar hur hela din organisation arbetar med information.

Användningsfall för neural sökning

Neuralsökning är inte en nischfunktion – den omformar hur hela branscher hämtar, hanterar och tillämpar information. När den implementeras i system med stora, ostrukturerade datamängder eliminerar den den friktion som äldre sökmotorer medför.

Så här fungerar det i verkliga miljöer på företagsnivå:

E-handel och produktsökning

Produktupptäckten är bara så bra som systemet bakom den. När sökmotorer förlitar sig på nyckelord missar kunderna ofta det de letar efter – även om det finns i katalogen.

Neurala sökmotorer löser detta genom att:

- Tolkning av vaga, avsiktsrika sökfrågor som ”miljövänliga löparskor med fotvalvsstöd” och visning av artiklar med dessa egenskaper, även om de exakta termerna inte finns i produktnamnen.

- Utnyttjar tidigare sökfrågor och användarinteraktioner för att ge mer personaliserade resultat i realtid.

- Automatisk indexering av produktdata, användarrecensioner, specifikationer och metadata till vektorinbäddningar för snabbare semantisk filtrering.

Detta minskar tiden till produkt och ökar konverteringarna. Det kan också skalas globalt – hantera flerspråkiga frågor och anpassa sig till förändringar i lager utan manuella regeluppdateringar.

För team som hanterar produktkataloger över flera marknader eller plattformar eliminerar neural sökning behovet av ständig manuell justering.

Kunskapshantering i företag

I företagsmiljöer finns viktig dokumentation överallt: projektmappar, ärenden, interna wikis, PDF-filer och arkiverade inkorgar. Och det mesta är ostrukturerat.

Med neural sökning:

- Team kan extrahera information från decentraliserade verktyg, även om de inte kommer ihåg källsystemet.

- Sökfrågor som ”klientspecifika SLA-undantag” hittar dolda dokument baserat på semantiska relationer, inte strängmatchningar.

- Textinbäddningsmodeller omvandlar långa data till sökbara vektorer över plattformar som Google Drive eller SharePoint.

För IT-chefer innebär detta mindre beroende av tribal kunskap och färre interna supportärenden med frågor som ”var hittar jag…?”.

Resultatet är en levande, sökbar organisationshjärna som utvecklas i takt med att din dokumentation växer.

AI-driven chatbots och virtuella assistenter

Virtuella assistenter av företagsklass misslyckas ofta när de möter naturliga, konversationsbaserade inmatningar. Neurala sökningar förändrar detta genom att omvandla hur bots tolkar och hämtar data.

Så här fungerar det:

- Integrerar kontextmedvetna sökfunktioner direkt i chatbot-backends.

- Ansluter assistenten till live-datakällor som CRM-system, interna helpdesks och dokument om regelefterlevnad.

- Använder ett neuralt lager för förståelse av sökfrågor för att hämta exakta svar – inte förprogrammerade svar.

I stället för att förlita sig på fasta sökvägar anpassar sig neurala botar i realtid. Om en användare till exempel frågar ”Kan jag uppdatera åtkomsten efter att avtalet har undertecknats?” dirigeras hen till rätt policydokument – även om den frasen inte finns någonstans.

Detta gör självbetjäningen mer effektiv och minskar trycket på supportteamet.

Hälso- och sjukvård och forskning

Sökning inom hälso- och sjukvården är inte valfritt, utan snarare avgörande för verksamheten. Läkare, forskare och analytiker är beroende av snabb och korrekt informationshämtning från kliniska anteckningar, akademiska studier och patientjournaler.

Neurala sökningar stöder detta genom att:

- Detektering av icke uppenbara relationer mellan termer (t.ex. ”off-label-användning” och ”alternativ behandling”) med hjälp av djupa neurala nätverk.

- Indexering av stora volymer ostrukturerade data – kliniska anteckningar, bildrapporter, elektroniska patientjournaler – i ett enhetligt vektorbaserat söksystem.

- Möjliggör sökning med naturligt språk i forskningsrapporter, fallstudier och datalager utan krav på strikt formatering eller terminologi.

Detta förbättrar diagnostisk noggrannhet, påskyndar behandlingsplanering och sparar timmar i litteraturgenomgångar. I forskningssammanhang ökar det upptäckterna genom att möjliggöra semantisk utforskning av tidigare arbete och datamängder.

Implementera neural sökning i ditt företag

Övergången från sökning baserad på nyckelord till neural sökning är en strategisk förändring i hur din organisation hämtar, kopplar samman och aktiverar information.

Oavsett om du utvärderar plattformar, integrerar AI i befintliga system eller skalar upp till hela företaget är det viktigt att förstå de verktyg, integrationer och avvägningar som krävs.

Låt oss bryta ner det:

Populära AI-drivna sökverktyg och plattformar

Flera ledande plattformar erbjuder nu inbyggt stöd för neural sökning – var och en optimerad för olika företagsbehov:

- Elasticsearch + kNN: Utökar den populära sökmotorn med vektorsökningsfunktioner, användbara för hybridmodeller som kombinerar traditionella sökord och semantisk relevans.

- OpenSearch med neurala plugins: Öppen källkod och modulärt, stöder integration med PyTorch/Hugging Face för anpassade neurala sökpipelines.

- Pinecone: Hanterad vektordatabas som hanterar semantisk sökindexering i stor skala med realtidsprestanda.

- Weaviate: Öppen källkodsmotor med inbyggt stöd för text- och bildinbäddningar, snabb att installera och flexibel i produktionsmiljöer.

- Vespa: Utvecklad för realtidssökning och rekommendationssystem, stöder storskalig bearbetning av sökfrågor och personalisering.

Dessa plattformar erbjuder byggstenar som vektorsökning, indexering, semantisk matchning och hybridfrågehantering, men de kräver ofta dedikerad infrastruktur och kontinuerlig support för ML-operationer.

ClickUps roll i neural sökning

ClickUp omdefinierar hur neural sökning ser ut på arbetsplatsen. Istället för att fungera som ett backend-verktyg integreras intelligent sökning direkt i arbetsflödena. Med hjälp av AI kopplas det samman mellan plattformar och hjälper team att arbeta snabbare och smidigare.

Så här gör ClickUp detta möjligt:

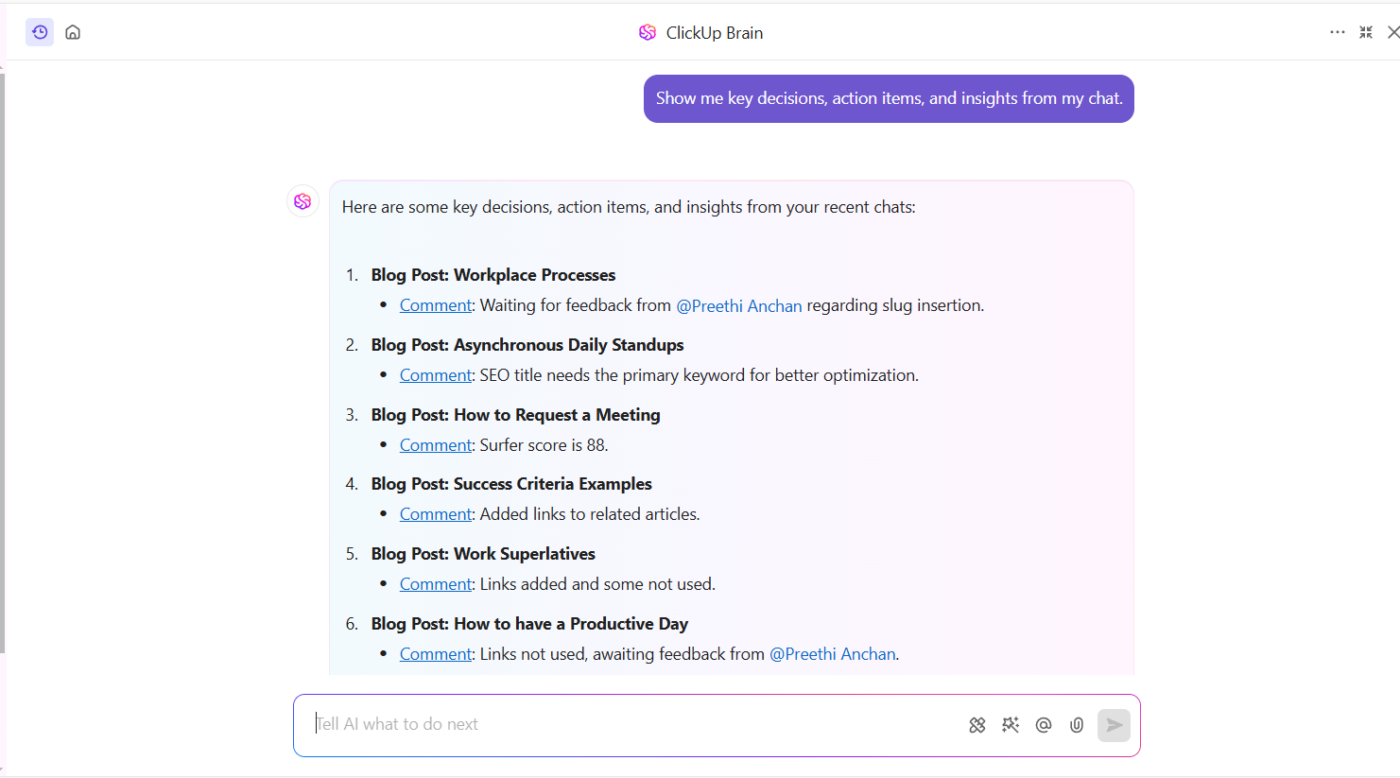

AI-driven förståelse och återvinning

ClickUp Brain använder avancerade neurala söktekniker för att förstå naturligt språk och leverera precisa, kontextmedvetna resultat utan att förlita sig på exakta nyckelord.

Oavsett om någon skriver in ”kvartalsplaneringstidplan” eller ”uppdatera onboarding-dokument” tolkar ClickUp Brain avsikten och visar det mest relevanta innehållet i uppgifter, dokument och konversationer.

Den lär sig kontinuerligt från användarinteraktioner, vilket innebär att resultaten blir smartare med tiden och anpassar sig efter hur ditt team kommunicerar.

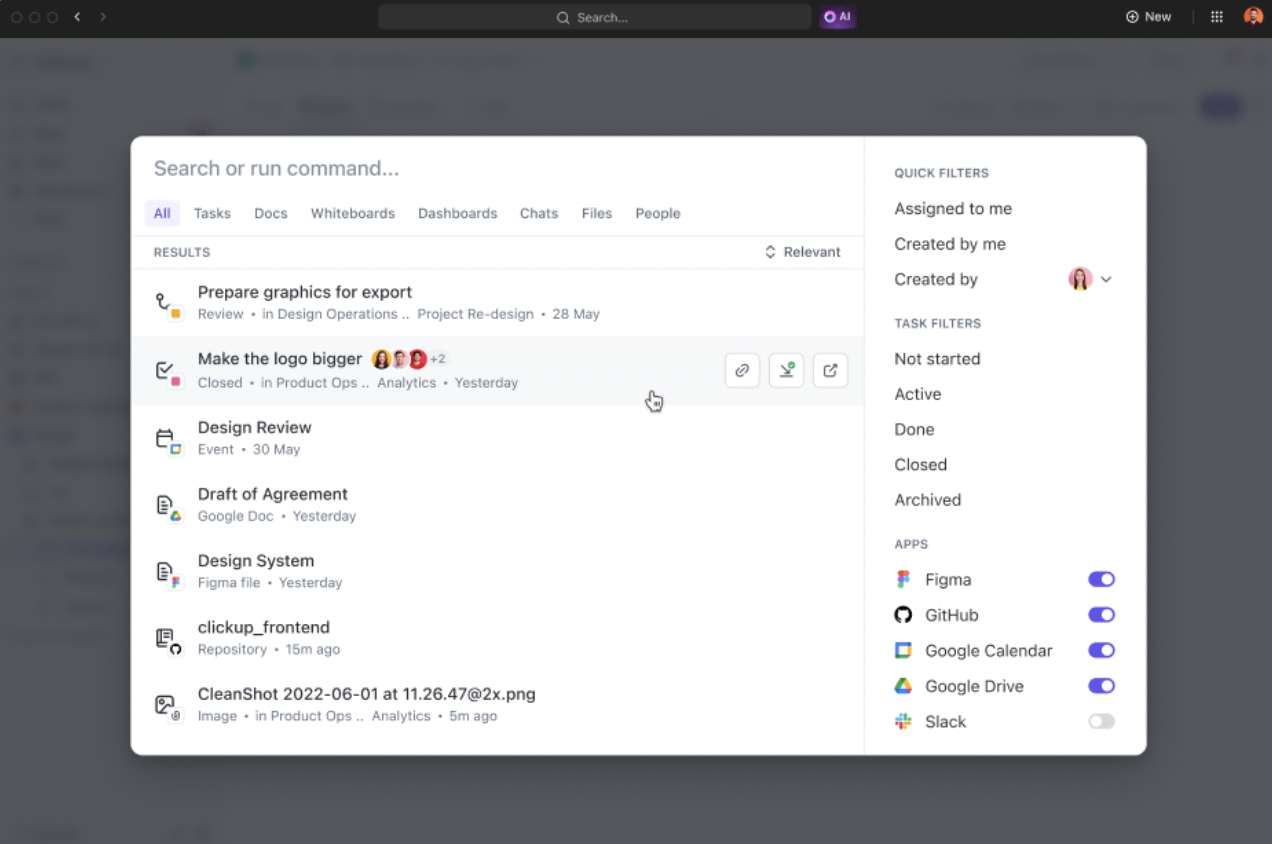

Plattformsoberoende semantisk sökning

Med ClickUp Connected Search kan du söka på flera plattformar som Google Drive och Dropbox från ett enda, enhetligt gränssnitt. Under huven analyserar neurala sökmodeller semantisk betydelse för att leverera rätt fil, anteckning eller biljett, även om formuleringen skiljer sig från det som är lagrat.

Detta gör Connected Search till en verklig produktivitetsförstärkare:

- Inget mer växlande mellan flikar eller verktyg

- Du behöver inte komma ihåg filnamn eller mappvägar.

- Ett enda ställe där du snabbt hittar allt

Det är ClickUps innovativa steg för att göra neural sökning inte bara kraftfull, utan också tillgänglig för alla team.

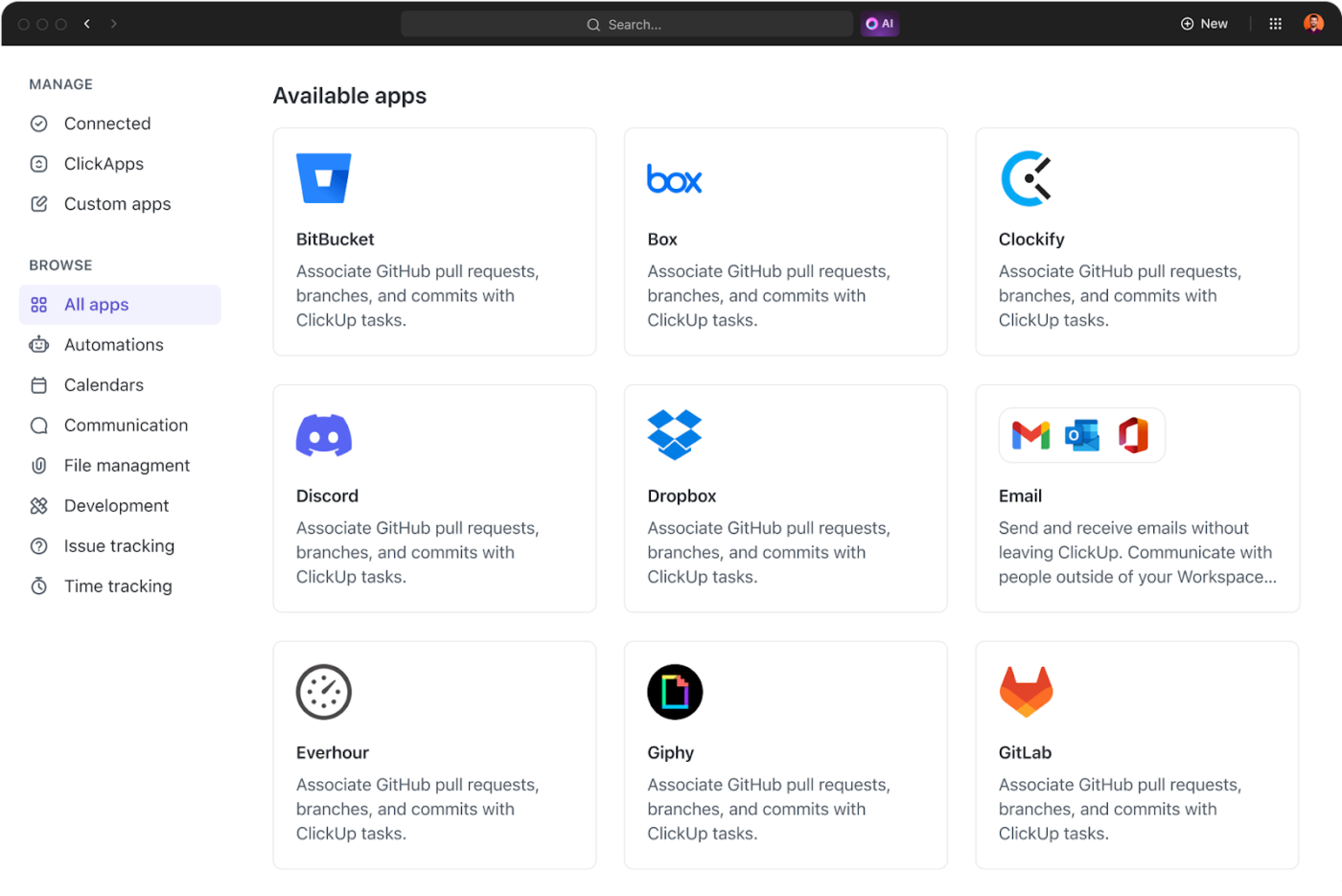

Sömlös integration med företagsverktyg

Företagsmiljöer drivs av dussintals plattformar, och neural sökning fungerar bara när den har tillgång till hela bilden. ClickUp-integrationer gör detta möjligt genom att synkronisera innehåll från CRM-system, projektverktyg, molndrivna enheter och supportsystem direkt till ClickUp-arbetsytan.

Detta möjliggör:

- Realtidsindexering av verktyg i företagsklass

- Konsekvent åtkomstkontroll och dataintegritet

- En enda källa till sanning över tidigare isolerade system

Med neural sökning som ett extra lager kan team hämta innehåll från hela organisationen på millisekunder, utan att manuell synkronisering krävs.

📮ClickUp Insight: 92 % av kunskapsarbetare riskerar att förlora viktiga beslut som är utspridda i chattar, e-postmeddelanden och kalkylblad. Utan ett enhetligt system för att registrera och spåra beslut går viktiga affärsinsikter förlorade i det digitala bruset.

Med ClickUps funktioner för uppgiftshantering behöver du aldrig oroa dig för detta. Skapa uppgifter från chatt, uppgiftskommentarer, dokument och e-postmeddelanden med ett enda klick!

Omvandla insikter till handling

Sökningen ska aldrig vara slutet på arbetsflödet. ClickUp Automations kopplar samman neurala sökresultat med omedelbara, intelligenta åtgärder.

Till exempel:

- Tagga uppgifter automatiskt baserat på vad användaren söker efter.

- Vidarebefordra ärenden eller förfrågningar till rätt team baserat på AI-detekterad avsikt.

- Visa relaterade objekt under aktivt arbete för snabbare kontextväxling

Det är så team går från "Jag har hittat det" till "Det är redan hanterat", utan extra steg. ClickUp gör inte bara informationen lättare att hitta, utan också lättare att använda, agera på och lära sig av.

Hur man integrerar neural sökning i befintliga system

Du behöver inte göra om din infrastruktur för att kunna använda neural sökning. De flesta team lägger till det i befintliga system med minimal störning. Nyckeln är att veta var man ska infoga intelligensen – och hur man stöder den bakom kulisserna.

Här är en praktisk väg framåt:

- Granska befintliga sökflöden: Kartlägg hur användarna söker idag, vilka verktyg de använder och var sökningar baserade på nyckelord brister.

- Lägg till ett neuralt lager för tolkning: Skicka frågorna genom en språkmodell eller inbäddningsmotor innan de matchas mot indexerat innehåll.

- Välj en vektordatabas: Lagra och hämta inbäddningar med verktyg som FAISS, Pinecone eller Weaviate – beroende på dina krav på skala och latens.

- Indexera kritiska ostrukturerade data: Importera PDF-filer, chattar, biljetter och dokument till din inbäddningspipeline – dessa innehåller oftast det mest outnyttjade värdet.

- Kombinera med traditionell logik: För användningsfall där precision är avgörande erbjuder hybridmodeller (semantik + nyckelord) den bästa balansen mellan återhämtning och kontroll.

- Övervaka och anpassa: Spåra sökkvalitet, sökprestanda och systemfeedback för att finjustera tröskelvärden och omskola modeller över tid.

Neurala sökningar fungerar bäst när de passar in i din befintliga arkitektur och inte när de försöker ersätta den.

Utmaningar och överväganden vid införande

Neurala sökningar möjliggör smartare och snabbare tillgång till information – men införandet handlar inte bara om att koppla in en ny modell. Det medför nya tekniska, operativa och organisatoriska överväganden som kräver noggrann planering.

Här är vad företagsteam behöver överväga:

Dataredskap är inte automatiskt

Neurala modeller är bara så bra som de data som ligger bakom dem. Om dina data är inkonsekventa, fragmenterade eller låsta bakom behörigheter kommer den semantiska noggrannheten att försämras.

- Rena, välstrukturerade data förbättrar inbäddningskvaliteten.

- Ostrukturerat innehåll måste göras indexerbart utan att kontexten går förlorad.

- Åtkomstkontroll måste respekteras i alla system och team.

Utan datajustering kommer även den bästa modellen att ge felaktiga resultat.

Modellvalet påverkar allt

Att välja fel modell eller överkonstruera en modell kan hindra införandet.

- Förutbildade modeller fungerar bra för allmänt bruk, men kan missa nyanser inom vissa områden.

- Finjusterade modeller erbjuder precision, men kräver mer data och arbete.

- Löpande modelluppdateringar kan behövas för att återspegla förändringar i innehåll eller terminologi.

Det här är inte en engångskonfiguration, utan ett levande system som behöver finjusteras.

Infrastrukturkraven ökar i takt med framgången

I takt med att användningen ökar, ökar också kraven på datorkraft, lagringsutrymme och latens.

- Vektordatabaser måste hantera storskaliga frågor med låg latens.

- Inbäddade pipelines måste hållas uppdaterade i realtid.

- Sökvolymen kan öka oförutsägbart när användarna börjar använda systemet.

Team måste balansera prestanda och kostnad när de skalas upp över avdelningar eller geografiska områden.

Förväntningar kontra förklarbarhet

Neuralsökning introducerar en abstraktionsnivå som inte alla användare (eller intressenter) är redo för.

- Relevansen kan förbättras, men ”varför” bakom resultaten är inte alltid uppenbart.

- Hybridmodeller (semantiska + nyckelord) erbjuder bättre förklarbarhet när det behövs.

- Vissa användningsfall (t.ex. efterlevnad eller juridik) kan kräva transparent resultatlogik.

Det är viktigt att ställa rätt förväntningar från början, särskilt i miljöer med höga insatser eller reglerade miljöer.

Neuralsökning är inte en snabb lösning. Men för team som är villiga att investera i grunden är vinsten enorm: smartare system, snabbare upptäckter och bättre samordning mellan människor och den data de förlitar sig på.

Framtiden för neural sökning

Neuralsökning är inte längre en innovationsnivå, utan håller på att bli en central infrastruktur för företagsinformation. Det som kommer härnäst handlar inte om funktioner, utan om strategisk påverkan.

Här är vad IT-chefer inom företag bör hålla ett öga på och satsa på:

- Sökningen kommer att bli proaktiv: Resultaten kommer att visas baserat på roll, uppgift och tidpunkt utan att någon behöver skriva in en sökfråga.

- Sökningen kommer att mata beslutsystem: Neurala sökningar hämtar inte bara dokument, utan visar också insikter direkt i dashboards, ärenden och rapporter.

- Finjusterade modeller kommer att avgöra framgången: Team som tränar modeller på interna data kommer att prestera bättre än de som förlitar sig på generiska API:er.

- Kunskap kommer att prioriteras framför lagring: Siloerad dokumentation blir sökbar oavsett var den finns.

- Sökningen kommer att agera, inte bara informera: Hämtningen kommer att utlösa automatisering – föreslå nästa steg, tilldela uppgifter eller visa hinder i realtid.

- Infrastrukturen kommer att skifta från sökning till intelligens: Neurala sökningar blir ryggraden för skalbar, sammankopplad beslutsfattande.

Framtiden handlar inte om att söka efter bättre. Det handlar om att bygga system där sökningen blir osynlig eftersom rätt information alltid finns inom räckhåll.

📚 Rolig läsning: Hur använder man AI i vardagen?

Är du redo att ompröva hur ditt team hittar information?

Neurala sökningar förändrar hur team arbetar, fattar beslut och samarbetar. De underlättar vektorsökningar som förstår relationerna mellan datapunkter. De går långt utöver traditionella sökmetoder, som baseras på sökordsmatchning.

När datamängderna växer och arbetsflödena blir mer komplexa blir förmågan att hitta rätt information i rätt sammanhang en viktig konkurrensfördel. De smartaste teamen kommer inte bara att söka bättre. De kommer att sluta söka helt och hållet.

ClickUp optimerar neural sökning genom att integrera AI-driven hämtning direkt i arbetsflöden, vilket gör det möjligt för team att snabbt få tillgång till relevant information över plattformar utan avbrott. Dess sömlösa integration med företagsverktyg förbättrar produktiviteten ytterligare och säkerställer att viktiga insikter enkelt omvandlas till genomförbara uppgifter.

Prova ClickUp idag och se vad intelligent sökning verkligen kan göra.