Повечето хора смятат, че трябва да избират между използването на мощни AI инструменти и запазването на поверителността на данните си. Но всъщност можете да имате и двете. Използването на AI локално означава, че данните никога не напускат вашия хардуер. Вие запазвате пълен контрол над информацията си, като в същото време автоматизирате най-рутинните си задачи.

Това ръководство ви показва как да използвате локален ИИ за сигурни работни процеси с помощта на инструменти като Ollama. Ще научите как да избирате модели с отворен код, които отговарят на конкретните спецификации на вашия хардуер. И да създавате автоматизирани работни процеси, които обработват лични документи локално.

Ще разгледаме и централизирането на работните процеси в едно обединено пространство като ClickUp. 😎

Какво е локален ИИ?

Локалната изкуствена интелигентност означава, че изпълнявате големи езикови модели (LLM) изцяло на собствения си хардуер – като лаптопа си или локален сървър – вместо да изпращате данните си към външни облачни услуги. Това е подходящо за всеки екип, който работи с чувствителна информация, от инженерните и продуктовите отдели до правните и финансовите отдели.

При повечето инструменти за изкуствен интелект, базирани в облака, вашите команди, документи и данни се прехвърлят към сървъри на трети страни. Вие губите контрол върху това как тази информация се обработва, съхранява или използва.

От друга страна, локалният ИИ запазва данните ви във вашата среда. Вие запазвате пълен контрол върху сигурността и защитата на данните за вашите работни процеси.

Разбира се, има и компромис. Настройването на локален ИИ изисква повече технически усилия и първоначална инвестиция в хардуер. Въпреки това, то напълно елиминира зависимостта ви от външни доставчици. С извличането на заключения на устройството вашата информация остава точно там, където искате.

Защо локалният ИИ е важен за сигурните работни процеси в екипа

🔎 Знаете ли? Само 1 от 10 потребители е склонен да споделя чувствителна информация, като финансови, комуникационни или биометрични данни, със системи, задвижвани от изкуствен интелект.

Това колебание отразява една все по-често срещана реалност за B2B екипите. С изкуствения интелект в облака вие по същество предавате интелектуалната собственост на вашата компания на трета страна. За юридическите, финансовите или HR екипи това създава огромна отговорност.

Локалната изкуствена интелигентност променя тази динамика, като премества изкуствената интелигентност на вашия собствен хардуер. Ето защо това е важно за вашите ежедневни операции:

- Предотвратете изтичането на данни: Не позволявайте фирмен код или частни клиентски договори да бъдат използвани за обучение на публичен модел, който вашите конкуренти биха могли да използват

- Спазвайте нормативните изисквания: Останете в рамките на GDPR или HIPAA, тъй като чувствителните данни никога не преминават международни граници и не достигат до сървъри на трети страни

- Премахнете зависимостта от интернет: Извършвайте сложни задачи за анализ на данни или изготвяне на чертежи по време на прекъсване на интернет връзката или в среди с висока степен на сигурност, където достъпът до облака е ограничен

- Управлявайте разходите предвидимо: Избягвайте нарастващите такси за API с разрастването на екипа ви, тъй като единственият ви разход е хардуерът, който вече притежавате

Чрез интегриране на локален ИИ с наличните ви инструменти можете да автоматизирате работата си, без да компрометирате сигурността си.

⚠️ Важно е обаче да имате предвид, че този проблем може да се влоши. Вашият екип може да пожелае да внедри множество AI инструменти, което да доведе до разрастване на AI — разпространение на AI инструменти без надзор или стратегия. Това може да доведе до загуба на средства, дублиране на усилия и рискове за сигурността.

В крайна сметка това разширява модела на заплахите за сигурността и затруднява проследяването на работата.

📮ClickUp Insight: Екипите с ниска производителност са 4 пъти по-склонни да използват над 15 инструмента, докато екипите с висока производителност поддържат ефективността си, като ограничават набора си от инструменти до 9 или по-малко платформи. Но какво ще кажете за използването на една платформа? Като универсално приложение за работа, ClickUp обединява вашите задачи, проекти, документи, уикита, чат и разговори в една платформа, допълнена с работни процеси, задвижвани от изкуствен интелект. Готови ли сте да работите по-умно? ClickUp работи за всеки екип, прави работата видима и ви позволява да се фокусирате върху това, което е важно, докато изкуственият интелект се занимава с останалото.

Какво ви е необходимо, за да използвате локален ИИ?

Не се нуждаете от специализиран суперкомпютър, за да изпълнявате ИИ локално. Последните промени в начина на изграждане на моделите ви позволяват да започнете с хардуера, с който вече разполагате. Той трябва само да отговаря на няколко конкретни критерия.

Изисквания към хардуера

Вашият хардуер определя размера и скоростта на моделите за изкуствен интелект, които можете да използвате. Докато мощна машина ви позволява да изпълнявате по-сложни модели за разсъждение, по-малките модели са станали изненадващо способни.

- GPU с VRAM: Специализирана NVIDIA карта с поне 12 GB VRAM е най-подходящият вариант за повечето екипи в момента. Тя ви позволява да изпълнявате модели със среден размер като Llama 3.3 (8B) или Mistral Small с висока скорост

- Системна RAM: Ако нямате високопроизводителен графичен процесор (GPU), RAM паметта на компютъра ви поема натоварването. 32 GB ви осигуряват достатъчно резерв за изпълнение на модел, докато браузърът и инструментите за управление на проекти остават отворени

- Унифицирана памет (за потребители на Mac): Ако използвате Mac с чип от серията M (M2, M3 или M4), RAM паметта и паметта на графичния процесор се споделят. Това прави Mac компютрите особено ефективни за локален ИИ, тъй като моделът има достъп до целия обем памет

- Бързо съхранение: Моделите са големи файлове, често с размер от 5 GB до 50 GB. Използването на NVMe SSD е от съществено значение, за да се избегнат дългите времена на изчакване при зареждането на нов модел

🔎 Знаете ли? Сглобяването на компютър е значително по-скъпо, отколкото беше преди само няколко месеца. По-рано комплект памет DDR5 с 32 GB струваше под 130 долара, но сега цената на същите комплекти скочи над 400 долара. Тази промяна направи 32 GB новото минимално изискване за всякаква сериозна работа с локален ИИ, тъй като ви е необходим достатъчен резерв, за да изпълнявате модели, без производителността на системата ви да се срине.

Софтуерни изисквания

Софтуерът действа като мост между вашия хардуер и изкуствения интелект. Вече не е необходимо да сте разработчик, за да го пуснете в действие.

- Операционна система: Въпреки че Linux е естествената среда за изкуствен интелект, Windows и macOS вече са също толкова способни. Потребителите на Windows могат да използват WSL2 за среда, подобна на Linux, въпреки че много инструменти вече се изпълняват директно на Windows

- Управление на модели: Инструменти като Ollama или LM Studio са най-лесната отправна точка. Те се занимават с квантизацията – компресират модела, така че той автоматично да се побере на вашия хардуер

- Драйвери: Ще ви са необходими най-новите драйвери за вашия хардуер, като например най-новият CUDA драйвер за NVIDIA карти. Повечето съвременни инсталатори ще проверят това за вас по време на настройката

Опции за LLM с отворен код

Наблюдаваме бум на модели с отворен код, които можете да изтеглите безплатно. Те са разработени от компании като Meta (Llama), Mistral и Alibaba (Qwen). За разлика от затворените системи, тези модели ви позволяват да видите точно как работят и къде отиват вашите данни.

Когато избирате голям езиков модел, обърнете внимание на софтуерния лиценз. Повечето използват Apache 2.0 или MIT, което ви позволява да ги използвате за бизнес операции без месечна абонаментна такса. Тъй като тези модели се намират на вашия хардуер, те се интегрират директно във вашите частни работни процеси.

Например, можете да използвате локален модел за изготвяне на вътрешни имейли, обобщаване на протоколи от срещи или анализ на собствени набори от данни. По този начин най-чувствителните детайли по проектите и стратегическите бележки остават на вашия компютър.

🧠 Интересен факт: Чиповете от серията M на Apple предлагат уникално архитектурно предимство за екипи, фокусирани върху поверителността. Унифицираната памет на Mac позволява на изкуствения интелект да използва целия обем системна RAM, сякаш е специално предназначена графична памет.

Това означава, че MacBook, оборудван с 128 GB RAM, може да изпълнява мащабни, изключително сложни модели, които обикновено биха изисквали специализиран корпоративен хардуер, струващ над 10 000 долара.

Най-добрите локални модели за изкуствен интелект за работни процеси в екип

За да намерите подходящия модел, съпоставяйте силните страни на модела със задачите на вашия екип и възможностите на хардуера.

Модели за общо предназначение

Това са основните инструменти на вашата локална конфигурация. Използвайте ги за написване на имейли, обобщаване на актуализации по проекти или генериране на творчески идеи.

- Llama 4 Scout (17B): Разполага с контекстен прозорец от 10 милиона токена, което ви позволява да обработвате хиляди страници текст наведнъж

- Mistral Small 4: Използва архитектура от типа „микс от експерти“, което означава, че активира само част от параметрите си за всяка задача

- Qwen 3.5 (7B): Постига постоянно по-добри резултати, ако екипът ви работи с техническа документация на няколко езика

Модели за разсъждение и използване на инструменти

Използвайте ги, когато имате нужда от LLM агенти за решаване на многоетапни проблеми, следване на сложна логика или за да действат като автономни агенти във вашите работни процеси.

- Llama 4 Maverick: Той е мултимодален по подразбиране. Това го прави идеален за екипи, които трябва да анализират сложни диаграми или финансови таблици, където визуалният контекст е също толкова важен, колкото и текстът

- Phi-4 (14B): Настроен за STEM и логическо мислене. Използвайте го за валидиране на данни или сложни математически задачи, които обикновено изискват много по-големи и по-скъпи модели

- DeepSeek-R1: Показва вътрешната си верига от разсъждения, което ви помага да проверите логиката му при анализи с висок залог. Идеален за задълбочени изследвания и стратегическо планиране

Модели за конкретни задачи

Понякога специализираният инструмент е по-ефективен от общия асистент. Тези модели са оптимизирани за една конкретна част от вашия работен процес.

- Qwen 3-Coder-Next: Разбира логиката на ниво хранилище, което му позволява да предлага корекции на грешки или рефакторинг на код в множество файлове. Всичко това, като следва специфичните стилови указания на вашия екип

- Voxtral Mini: Идентифицира различните говорители в даден запис и превръща записите от частни срещи в текст, който може да се търси. Работи изцяло офлайн, което е подходящо за избягване на изтичане на данни

- Nomic Embed v1. 5: Превръща вашите лични документи в математически данни за семантично търсене. Това ви позволява да търсите във вътрешната база от знания на вашия екип по смисъл, а не само по ключови думи

📚 Прочетете също: Търсачки с големи езикови модели (LLM): извличане на информация, задвижвано от изкуствен интелект

Популярни инструменти за изпълнение на локален ИИ

Вече не е необходимо да сте софтуерен инженер, за да изпълнявате модели на собствения си компютър. Няколко лесни за употреба приложения вече се занимават с техническата настройка за вас за няколко минути.

Ollama и OpenWebUI

Ollama е подходящ, ако искате скорост и гъвкавост. Той работи на заден план и управлява библиотеката ви с модели чрез прост интерфейс.

Въпреки че започва като основен инструмент, повечето хора го комбинират с OpenWebUI. Това добавя изтънчено чат изживяване в браузъра ви, което изглежда и се усеща като облачните инструменти, които вече познавате. Също така създава локален мост за други приложения на компютъра ви, за да комуникират сигурно с вашите AI модели.

LM Studio

Ако предпочитате традиционно настолно приложение, LM Studio е отлична алтернатива. То действа като магазин за приложения за изкуствен интелект. Можете да го използвате, за да търсите, изтегляте и общувате с нов модел само с няколко кликвания.

Приложението включва вградена функция за разпознаване на хардуера, така че автоматично конфигурира настройките ви, за да съответстват на вашия конкретен графичен процесор или RAM памет. Това го прави чудесна отправна точка, ако искате да експериментирате с различни модели, без изобщо да пипате и ред код.

GPT4All

За екипи, фокусирани изцяло върху поверителността и анализа на документи, GPT4All е надеждно и просто решение. То работи на почти всеки компютър, включително по-стари лаптопи, които може да нямат специална графична карта.

Най-полезната му функция е възможността да общувате директно с вашите локални файлове. Можете да насочите приложението към папка на вашия твърд диск, а изкуственият интелект ще отговаря на въпроси относно тези конкретни документи. Всичко това, без изобщо да ги качвате на сървър на трета страна.

📚 Прочетете също: Най-добрите AI агенти за потребители без познания по програмиране

Как да настроите локален ИИ за сигурни работни процеси

В това ръководство се използва Ollama, тъй като това е широко поддържан инструмент за създаване на сигурни локални AI работни процеси.

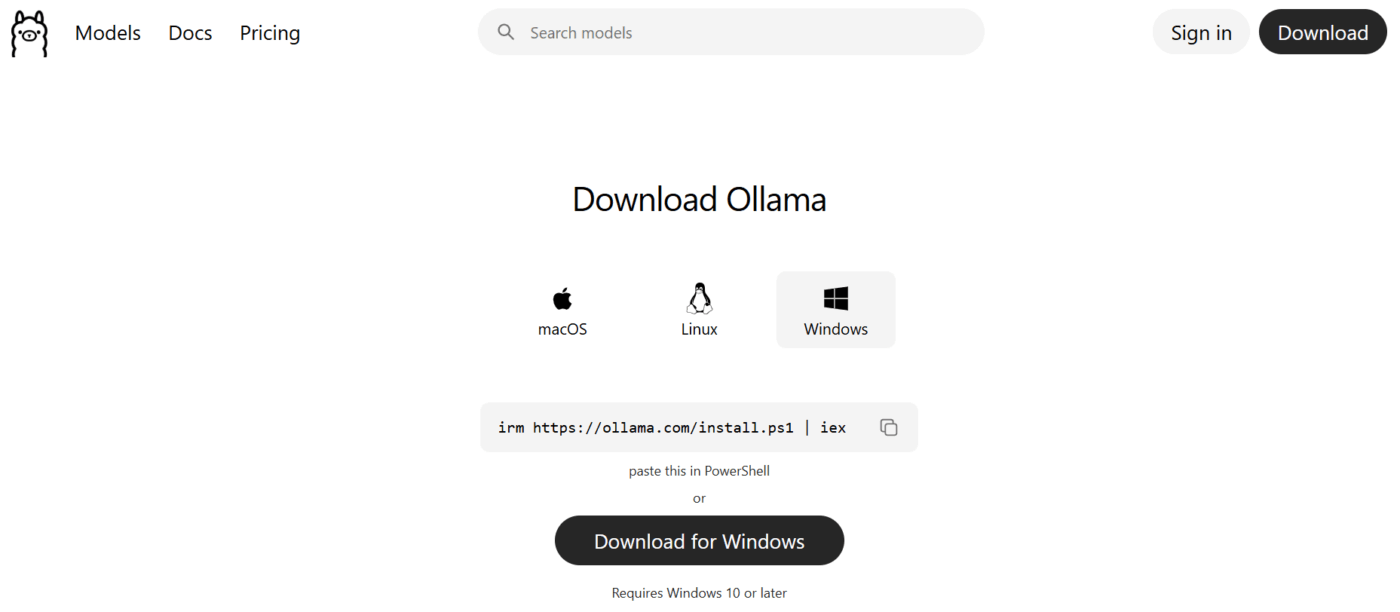

Стъпка 1: Инсталирайте Ollama

Изтеглете инсталатора от официалния уебсайт за вашата конкретна операционна система. Докато по-ранните версии на Windows изискваха ръчна настройка на Linux подсистемата, настоящата версия се инсталира като родно приложение.

Инсталирането трябва да отнеме само няколко минути. След като инсталирането приключи, отворете терминала или командния ред и въведете ollama --version, за да потвърдите, че всичко е готово за работа.

Стъпка 2: Изтеглете и стартирайте модел

За да започнете да използвате ИИ, трябва да прехвърлите неговите тегла на вашия компютър. За първия си тест опитайте с компактен, но мощен модел като Llama 3.2 (3B) или най-новия Mistral.

Използвайте командата ollama run llama3. 2, за да започнете изтеглянето.

В зависимост от скоростта на вашия интернет, това обикновено отнема няколко минути. След като изтеглянето приключи, можете да въведете команда директно в терминала, за да получите незабавен отговор от модела на вашия твърд диск.

Стъпка 3: Свържете се с инструмента за работни потоци

Истинската стойност на локалния ИИ идва от интегрирането му във вашите ежедневни задачи. Когато Ollama работи, той автоматично стартира локален сървър на http://localhost:11434. Това създава сигурен мост, чрез който други приложения могат да комуникират с вашия модел.

Тъй като този сървър е съвместим със стандартните протоколи на OpenAI, можете да го свържете с платформи за автоматизация или вътрешни скриптове, като просто замените адреса на API. Например, можете да насочите локален инструмент за търсене на документи към този адрес. Това му позволява да обобщава лични файлове, без изобщо да изпраща този текст в облака.

Най-добри практики за сигурност при локални AI работни потоци

Използването на ИИ локално е важна крачка напред за защитата на личните данни. Съхранението на данни локално обаче означава, че вече вие носите отговорността за тяхната защита. Въпреки че сте елиминирали риска от пробив в облака от трета страна, все пак трябва да осигурите сигурността на хардуера си и на начина, по който екипът ви взаимодейства с моделите.

Следвайте тези най-добри практики:

- Изолиране на мрежата: Ограничете достъпа до API до надеждни вътрешни мрежи, така че вашият AI сървър да остане недостъпен от публичния интернет

- Валидиране на входните данни: Пречистете всички данни, преди да ги изпратите към модела. Това блокира скрити злонамерени инструкции в документи или имейли

- Контрол на достъпа: Въведете удостоверяване на вашата AI крайна точка, за да се уверите, че само оторизирани потребители могат да задействат действия на модела

- Регистриране на одити: Водете записи на всички взаимодействия с моделите, за да подпомогнете разследванията, свързани със съответствието и сигурността

- Изолиране в контейнери: Изпълнявайте моделите си в защитени среди като Docker. Това предотвратява потенциално проникване в основните файлове на системата ви

- Редовни актуализации: Инсталирайте най-новите кръпки за инструменти като Ollama, за да сте защитени срещу новооткрити уязвимости

- Ограничаване на честотата: За да предотвратите един потребител или скрипт да претовари сървъра ви със заявки, приложете ограничаване на честотата, за да контролирате колко заявки могат да бъдат направени в даден период

🔎 Знаете ли? Манипулациите чрез подсказки вече не са само теоретична заплаха. Неотдавнашно проучване на Gartner установи, че 32% от организациите са претърпели злонамерена атака чрез подсказки срещу ИИ приложения през последната година. Тези атаки могат да манипулират вашия локален модел, за да генерира пристрастен или неразрешен резултат.

Как да създадете сигурни AI работни процеси за вашия екип

След като локалният ви сървър заработи, можете да го интегрирате в ежедневната си работа. Това превръща един прост инструмент в частен двигател за продуктивност. Най-ефективният начин да направите това е чрез Retrieval-Augmented Generation (RAG).

Този процес свързва вашия локален ИИ с частна база данни от вашите собствени файлове. Можете да отговаряте на въпроси, като използвате контекста на вашата компания, без да качвате нито един байт в облака.

Можете също така да проектирате работни процеси с човешко участие, при които работата на ИИ се проверява от членове на екипа. Това гарантира точност, като същевременно значително ускорява производителността ви.

Ето няколко практични примера:

- Анализ на документи: Обобщавайте вътрешни доклади или обратна връзка от клиенти, за да извличате ключови прозрения незабавно

- Създаване на чернови: Създавайте първи версии на имейли или актуализации по проекти, които членовете на екипа да доработват

- Класификация на данните: Категоризирайте автоматично постъпващите задачи въз основа на конкретното съдържание на заявката

- Подготовка за срещата: Създайте теми за обсъждане, като анализирате свързаните проектни файлове, съхранени на локалния ви диск

- Преглед на кода: Получете обратна връзка за собствения си изходен код, без да излагате интелектуалната си собственост на трети страни

📮ClickUp Insight: Нашето проучване за зрелостта на ИИ показва, че достъпът до ИИ на работното място все още е ограничен – 36% от хората нямат никакъв достъп, а само 14% казват, че повечето служители могат действително да експериментират с него. Когато ИИ е ограничен от разрешения, допълнителни инструменти или сложни настройки, екипите нямат възможност дори да го изпробват в реалната си ежедневна работа.

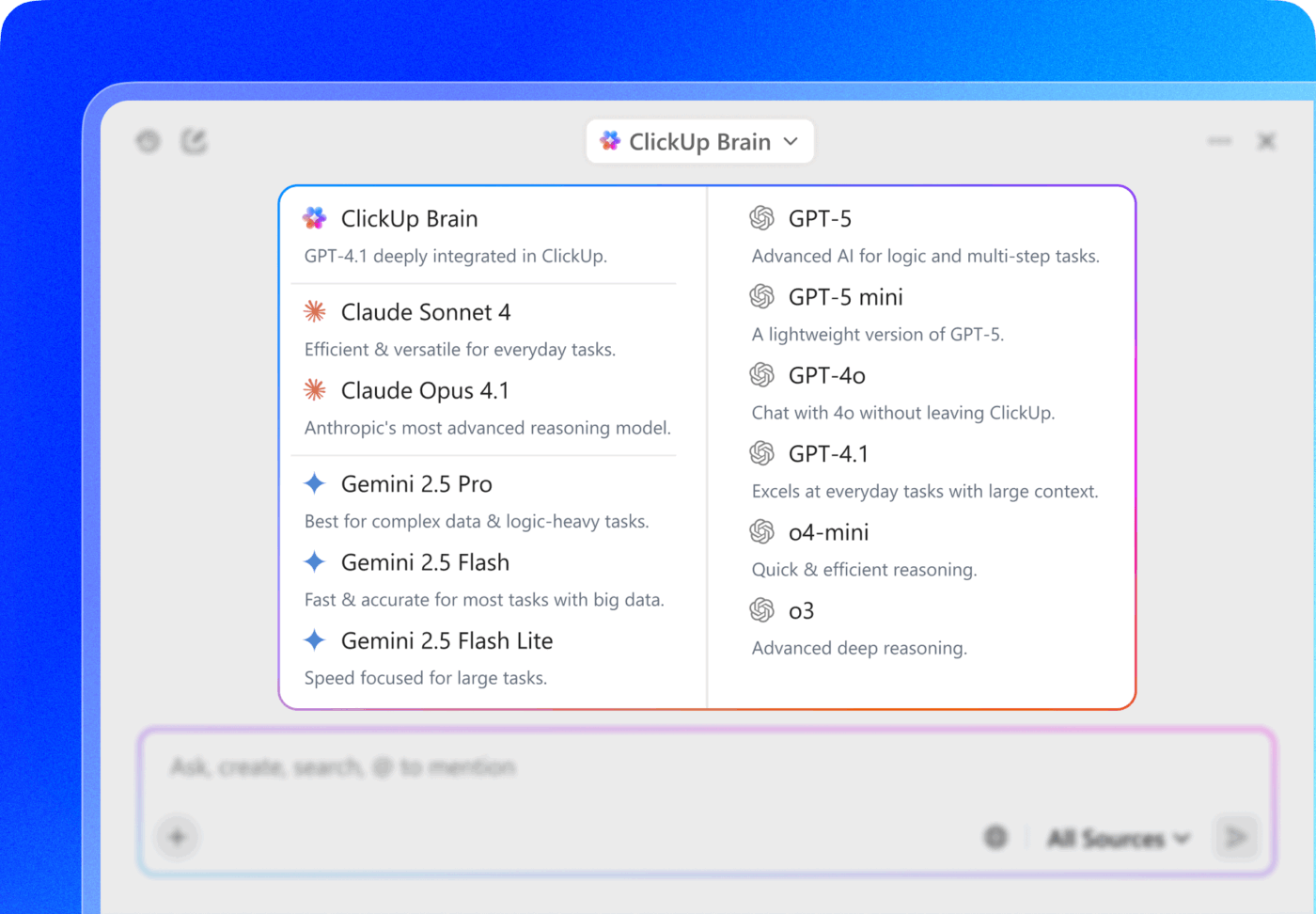

ClickUp Brain премахва всички тези пречки, като вгражда изкуствения интелект директно в работната среда, която вече използвате. Можете да се възползвате от множество модели на изкуствен интелект, да генерирате изображения, да пишете или отстранявате грешки в код, да търсите в интернет, да обобщавате документи и много други – без да сменяте инструменти или да губите концентрация.

Това е вашият партньор за AI в работната среда, лесен за използване и достъпен за всеки член на екипа.

Ограничения при използването на локален ИИ за ИИ работни потоци

Локалната ИИ е мощен инструмент, но не е магическо решение за всеки проблем. Разбирането на нейните ограничения ви помага да решите кога да изпълнявате дадена задача на собствения си хардуер и кога да използвате облака. За някои екипи техническите и финансовите компромиси може да надделеят над ползите за поверителността.

- Максимален капацитет: Първокласните патентовани модели все още имат леко предимство в сложните разсъждения и творческите нюанси в сравнение с версиите с отворен код

- Инвестиция в хардуер: Бързото изпълнение на големи модели изисква скъпи графични процесори (GPU) със значителен обем VRAM. Това може да представлява високи начални разходи за малки екипи

- Разходи за поддръжка: Вие носите отговорност за всички софтуерни актуализации, отстраняване на хардуерни проблеми и инсталиране на кръпки за сигурност без подкрепата на екипа на доставчика

- Технически умения: Оптимизирането на локална среда изисква практически познания за квантизация на модели и конфигуриране на сървъри

- Управление на безопасността: За разлика от облачните услуги, локалните модели не разполагат с вградена модерация. Трябва да внедрите свои собствени филтри за съдържание и предпазни мерки

- Консумация на енергия: Изпълнението на мащабни модели за изкуствен интелект на вашите собствени сървъри или работни станции може значително да увеличи потреблението на електроенергия и нуждите от охлаждане

Много екипи използват хибриден подход: локален ИИ за чувствителни данни, облачен ИИ за по-малко чувствителни задачи, изискващи максимална производителност. Ето кратък преглед на сравнението между двата:

| Фактор | Локален ИИ | Изкуствен интелект в облака |

|---|---|---|

| Поверителност на данните | Пълен контрол | Данни, изпратени до доставчика |

| Сложност на настройката | По-високо | Надолу |

| Текущи разходи | Хардуер + електроенергия | Такси за всеки токен |

| Възможности на моделите | Добре, подобрява се | Най-съвременни |

| Поддръжка | Самоуправляем | Управлявано от доставчика |

Как ClickUp поддържа сигурни работни процеси, задвижвани от изкуствен интелект

Днес повечето екипи са изправени пред дилема: да използват мощна изкуствена интелигентност в облака и да се притесняват за това къде отиват данните им, или да създадат локални модели и да се справят с текущите разходи. ClickUp избягва тази дилема, като действа като конвергентно работно пространство за изкуствена интелигентност — където изкуствената интелигентност вече е част от системата, в която се извършва работата ви.

ClickUp Brain е AI слой, вграден директно в работната среда на ClickUp, проектиран да разбира вашите задачи, документи и комуникация в екипа на едно място. Той предоставя AI помощ с пълен контекст — без отделни инструменти, без нестабилни интеграции.

За екипите, които се стремят да създадат сигурни AI работни потоци, тази комбинация от контекст и контрол е разликата между експериментирането и реалното внедряване.

🌟 ClickUp е в съответствие със стандарта SOC 2 и спазва стандартите ISO 42001 за отговорно управление на изкуствения интелект. Това гарантира, че вашите данни никога няма да бъдат използвани за обучение на модели на трети страни, което ви позволява да автоматизирате работата си с същата увереност, както при локална инсталация.

Достъп до търсене и автономни работни процеси с ClickUp Brain

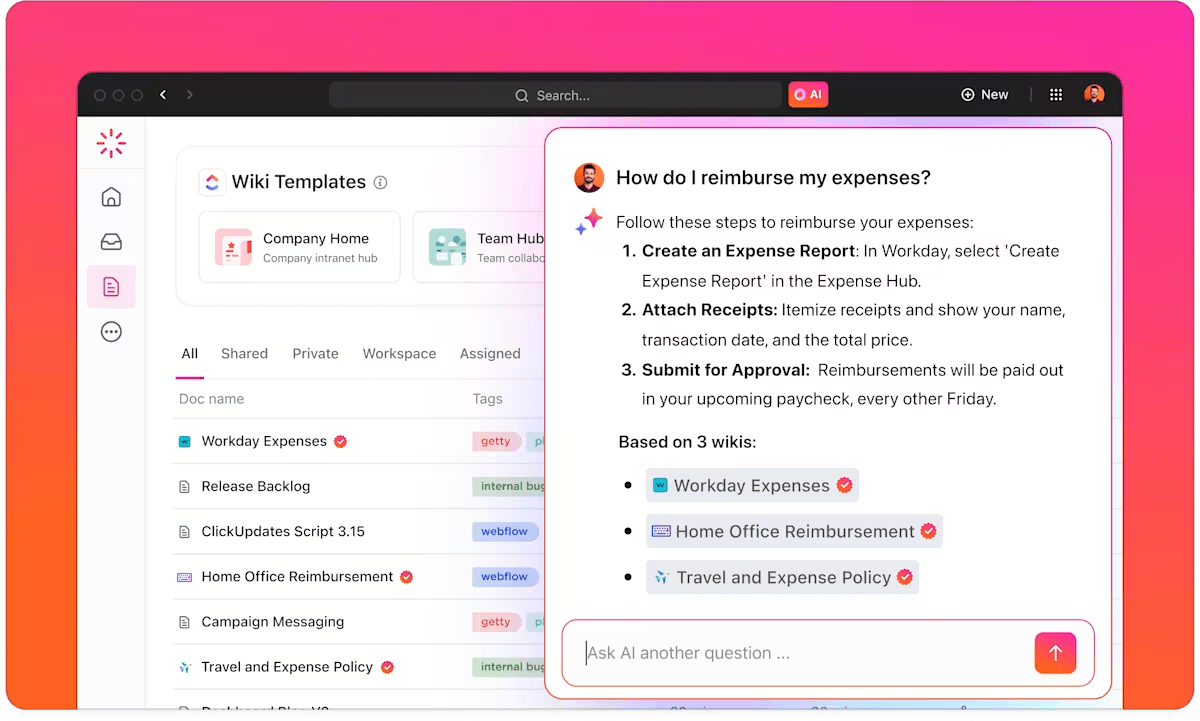

След като данните ви са защитени в работната среда, ClickUp Brain извлича стойност от вашите задачи и документи в реално време.

Тъй като изкуственият интелект е вграден, той избягва пропуските в контекста, които забавят локалните настройки. Можете да му задавате въпроси, които изискват пълен преглед на историята на проекта ви, за да отговори точно:

- Идентифицирайте окончателните решения от дълъг технически брифинг, без да превъртате през различните версии

- Създавайте предварителни актуализации за заинтересованите страни въз основа на коментари към задачите и промени в статуса

ClickUp Brain генерира отговори, основани на данните от работното ви пространство, като анализира конкретното съдържание в вашите документи, задачи и чатове. Това гарантира, че с развитието на проекта ви изкуственият интелект винаги разполага с най-актуалния контекст.

Това позволява на екипа ви да се основава на аналитични данни, без да се налага ръчно да обяснявате отново историята на проекта или да прехвърляте данни между несвързани инструменти.

💡Съвет от професионалист: Можете да разширите контекста на работното си пространство още повече, като използвате Enterprise AI Search, за да извличате информация от всичките си външни инструменти.

Например, задайте задълбочен въпрос като „Покажи ми всички отворени сделки в процеса“ и ClickUp Brain ще претърси свързаните ви приложения, включително Slack, Google Drive и Gmail, за да ви предостави надежден отговор в реално време с източници.

Това превръща фрагментираните данни, разпръснати по различни платформи, в единен слой с възможност за търсене, където можете да намерите всеки файл, съобщение или задача, без да напускате работното си пространство.

Управлявайте задачите интелигентно с автоматизация и изкуствен интелект

ClickUp Brain не само ви помага пасивно — той работи активно във вашата система за задачи. Той може:

- Генерирайте задачи от бележки от срещи или документи

- Разделете големите задачи на подзадачи

- Предлагайте собственици на задачи въз основа на минали дейности

- Препоръчайте крайни срокове въз основа на контекста на проекта

Той може също да актуализира статуса на задачите, да обобщава дълги коментари в ясни следващи стъпки и да сигнализира за пречки, преди те да забавят изпълнението.

Когато се комбинира с ClickUp Automation, това се превръща в система със затворена верига: изкуственият интелект може да задейства работни потоци (като възлагане на задачи, уведомяване на заинтересованите страни или актуализиране на приоритетите) въз основа на промени във вашето работно пространство.

Например, когато документът е финализиран, задачите могат да се създават и разпределят автоматично, без никой да премества ръчно данни между инструментите.

💟 Бонус: Превърнете ClickUp Brain MAX във вашата „памет за решения“.

Използвайте го, за да:

- Обобщавайте дълги коментари в ясни решения и следващи стъпки

- Актуализирайте документацията с „какво се е променило и защо“ след ключови етапи

- Генерирайте седмични регистри на решенията от задачи, срещи и актуализации

С течение на времето това създава динамичен слой от институционално знание, към който Brain MAX може да се позовава. Така, вместо да отговаря на запитвания изолирано, той започва да отговаря, като отчита минали решения, приоритети и модели.

Тогава изкуственият интелект преминава от това да бъде полезен към това да бъде надежден — особено в сигурни работни процеси с изкуствен интелект, където контекстът и проследимостта са от значение.

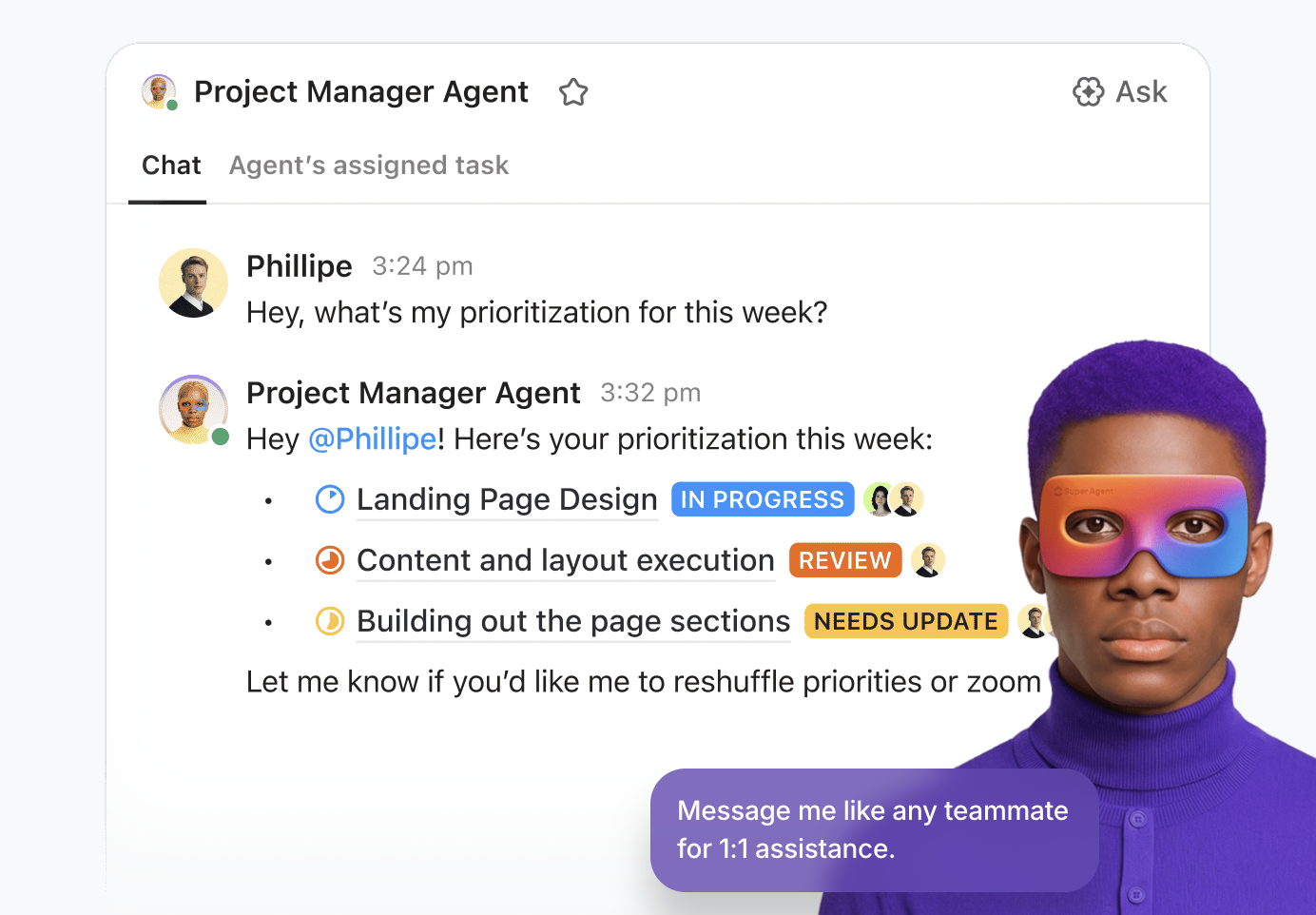

Получете сигурно, контекстно-ориентирано изпълнение в голям мащаб с Super Agents

Супер агентите на ClickUp пренасят ClickUp Brain на следващото ниво – от подпомагане на работата към активното й направляване. Тези агенти могат да бъдат конфигурирани да наблюдават работните процеси, да предприемат действия и да координират задачите във вашето работно пространство въз основа на предварително дефинирани правила и контекст в реално време.

Например, Super Agent може:

- Наблюдавайте входящите заявки или документи и автоматично ги превръщайте в структурирани задачи с отговорници и крайни срокове

- Проследявайте напредъка на проекта и сигнализирайте за рискове или забавяния, преди те да се влошат

- Задействайте многоетапни автоматизации, когато са изпълнени определени условия – като уведомяване на заинтересованите страни, актуализиране на приоритетите или създаване на последващи задачи

Тези агенти работят изцяло в рамките на обединеното работно пространство на ClickUp, като имат пълна информация за вашите задачи, документи и структура на разрешенията. Това означава:

- Няма нужда да експортирате данни към външни AI системи или инструменти за оркестриране

- Те имат достъп само до данните, за които имат разрешение

- Те действат в рамките на същите разрешения, както вашият екип

Научете повече за работата със Super Agents:

Възползвайте се от помощта на изкуствения интелект във вашите документи

С ClickUp Docs AI помощта е вградена директно във вашите работни процеси за документация. Екипите могат да изготвят проектни брифинги, да обобщават дълги доклади, да извличат задачи за действие или да преписват съдържание за различни аудитории – всичко това, без да напускат платформата.

Това е важно за сигурните AI работни процеси, защото един от най-големите рискове идва от копирането и поставянето на чувствителна информация във външни инструменти. В ClickUp вие минимизирате преместването на данни и запазвате пълен контрол над достъпа чрез разрешенията.

Окончателно заключение: Изграждане на вашия частен AI стек

Локалната ИИ използва изкуствен интелект, като същевременно поддържа пълен контрол върху поверителността на данните и съответствието с нормативните изисквания. Този подход обаче изисква значителни инвестиции в хардуер, техническа настройка и текуща поддръжка.

Практиките за сигурност остават от решаващо значение, независимо дали използвате локален или облачен ИИ. Най-ефективната стратегия често включва хибриден подход: използване на локален ИИ за най-чувствителните операции, като същевременно се възползвате от управлявани, сигурни решения за ежедневната продуктивност.

Много е важно да се обмислят компромисите – за много екипи разходите за решение „направи си сам“ може да не са правилният избор.

За тези, които искат мощна производителност на изкуствения интелект без тежестта на инфраструктурата, управляваните решения като ClickUp Brain предлагат привлекателен компромис. Те осигуряват сигурност на корпоративно ниво без никаква сложност при настройката.

Започнете безплатно с ClickUp и разгледайте сигурни, контекстуални работни процеси, задвижвани от изкуствен интелект, за вашия екип.

Често задавани въпроси

Каква е разликата между локалния ИИ и ИИ в облака за работните процеси на екипа?

Локалната ИИ работи изцяло на вашия собствен хардуер, гарантирайки, че данните никога не напускат вашата вътрешна мрежа, докато ИИ, базирана в облака, изпраща заявки за обработка към сървъри на трети страни. Локалните конфигурации осигуряват пълна суверенност над данните и офлайн достъп, докато облачните услуги предлагат по-голяма изчислителна мощност и лекота на използване за сметка на директния контрол над данните.

Как екипите могат да използват локални модели на изкуствен интелект с поверителни проектни данни?

Екипите могат да използват локален ИИ за обработка на чувствителни документи, патентован код и финансови записи, като насочат модела към частни локални директории. Тъй като извличането на заключения се извършва на устройството, можете да изпълнявате задачи като автоматизирано обобщаване, извличане на данни и вътрешно търсене на знания, без да рискувате излагане на публични набори за обучение на големи езикови модели (LLM).

Местните модели за изкуствен интелект толкова ли са способни като ChatGPT за работни задачи?

Много от локалните модели с отворен код, като Llama 3 и Mistral, вече са напълно способни да се справят с рутинни работни задачи като изготвяне на чернови, кодиране и обобщаване. Докато най-добрите облачни модели като GPT-4o все още водят в областта на ултрасложното разсъждение, локалните модели предлагат сравнима производителност за 90% от ежедневните бизнес операции, като осигуряват значително по-добра защита на личните данни.

Какви са компромисите при локалното изпълнение на ИИ в сравнение с използването на облачни ИИ услуги?

Основният компромис е изборът между пълна поверителност на данните с локален ИИ и мащабируемостта без необходимост от поддръжка на ИИ в облака. Използването на ИИ локално изисква първоначална инвестиция в хардуер и технически опит, но елиминира повтарящите се такси за API и рисковете от изтичане на данни. ИИ в облака се внедрява по-бързо, но включва текущи разходи за абонамент и зависимост от данни на трети страни.