Om du har använt Claude kontinuerligt har du säkert stött på något av följande (mer än en gång):

- På grund av oväntade kapacitetsbegränsningar kan Claude inte svara på ditt meddelande. Försök igen snart.

- Närmar sig 5-timmarsgränsen

- Ditt meddelande överskrider längdgränsen för denna chatt.

När du är mitt uppe i en viktig uppgift med Claude AI och detta meddelande dyker upp, undrar du vad du ska göra.

Här visar vi dig hur du löser problemet med begränsad kapacitet i Claude AI.

Vad kapacitetsbegränsningar i Claude AI egentligen innebär

När Claudes servrar utsätts för hög belastning orsakar det tillfälliga systemomfattande fördröjningar, vilket begränsar dess förmåga att svara på dina meddelanden. Istället för att låta hela systemet kollapsa under trycket upprätthåller Claude stabiliteten genom att begränsa användningen under perioder med hög belastning.

Här är användningsgränsen för varje Claude-prisplan 👇

| Planera | Användningsbegränsningar | Kapacitetsbeteende |

| Gratis plan | Begränsad meddelandekvot med strängare hastighetsbegränsningar och kortare konversations-/kontextbegränsningar. Användningsbegränsningarna återställs regelbundet baserat på efterfrågan och sessionsaktivitet. | Kapacitetsfel uppstår oftast under rusningstider. Åtkomsten kan vara tillfälligt begränsad när systemet är hårt belastat. |

| Pro-plan | Högre meddelandegränser än i gratispaketet, med utökad konversationslängd och filbehandlingskapacitet. Fungerar med rullande användningsfönster (ofta kallade 5-timmars användningscykler). | Prioriterad åtkomst minskar avbrott, men användare kan fortfarande se meddelanden om att gränsen närmar sig eller tillfälliga kapacitetsfel vid hög global användning. |

| Max-plan | Avsevärt utökade användningsgränser för tunga promptar, långa chattar och analys av flera dokument. Utvecklad för kontinuerlig individuell användning med hantering av större sammanhang. | Mindre sannolikhet att nå gränserna, men fortfarande föremål för rullande användningsfönster och tillfälliga kapacitetsminskningar i hela systemet. |

| Teamplan | Gemensam användning för alla medlemmar i arbetsytan med högre sammanlagda gränser för meddelanden och kontext än individuella nivåer. Administratörsstyrd användning av arbetsytan. | Kapaciteten beror både på teamets användning och den globala efterfrågan. Team kan fortfarande uppleva fördröjningar under perioder med hög användning. |

| Enterprise-plan | Anpassade användningsgränser, högre genomströmning och utökat kontextstöd baserat på organisationens behov. Inkluderar administratörs- och säkerhetskontroller. | Högsta prioritet för åtkomst och tillförlitlighet. Kapacitetsbegränsningar är sällsynta, men kan ändå uppstå vid extrem global efterfrågan eller infrastrukturbelastning. |

Vanliga kapacitetsmeddelanden som användare ser (och vad de betyder)

Du har säkert sett olika felmeddelanden och varningar när du använder Claude. Dessa kan handla om användningsbegränsningar, systemkapacitet eller något annat. De vanligaste är:

Varningar och felmeddelanden om användningsbegränsningar

Felmeddelande: Närmar sig 5-timmarsgränsen

Vad detta innebär: Du närmar dig meddelandegränsen för ditt nuvarande 5-timmarsfönster. Claude spårar användningen med hjälp av rullande fönster istället för dagliga återställningar. Denna varning ger dig en förvarning innan du når gränsen.

Felmeddelande: 5-timmarsgränsen har nåtts – återställer [tid]

Vad detta innebär: Om du når gränsen för din plan efter att varningen visas, kommer du att se ett blockerande felmeddelande som informerar dig om när du kan använda Claude igen.

Meddelande om extra användning

Felmeddelande: 5-timmarsgränsen återställs [tid] – fortsätter med extra användning

Vad detta innebär: Om du är en betalande Claude-användare med extra användning aktiverad i användningsinställningarna kommer du att se detta meddelande. All användning efter detta kommer att faktureras separat enligt priser per meddelande utöver din inkluderade kvot.

📚 Läs mer: Hur man använder Claude för dataanalys

Meddelande om kapacitetsbegränsningar

Felmeddelande: På grund av oväntade kapacitetsbegränsningar kan Claude inte svara på ditt meddelande. Försök igen snart.

Vad detta innebär: Claudes infrastruktur upplever hög efterfrågan i hela systemet. Detta problem är tillfälligt och löses vanligtvis när efterfrågemönstren förändras under dagen.

Inloggningsfel

Felmeddelande: Det uppstod ett fel vid inloggningen.

Vad detta betyder: Autentiseringen misslyckades på Claudes sida. Detta kan bero på att sessionen har gått ut, problem med autentiseringen på serversidan eller tillfälliga anslutningsproblem mellan din webbläsare och Claudes servrar.

📚 Läs mer: Hur man bygger en AI-agent med Claude

Fel på grund av längdbegränsning

Felmeddelande: Ditt meddelande överskrider längdgränsen för denna chatt. Försök att bifoga färre eller mindre filer eller starta en ny konversation.

Vad detta betyder: Detta felmeddelande indikerar att ditt meddelande överskrider den maximalt tillåtna längden. Det är för långt och måste förkortas innan det skickas till Claude. När kontextgränserna närmar sig hanterar Claude dock automatiskt långa konversationer genom att sammanfatta tidigare meddelanden. På så sätt kommer de flesta användare sällan att stöta på längdbegränsningsfel vid normal användning.

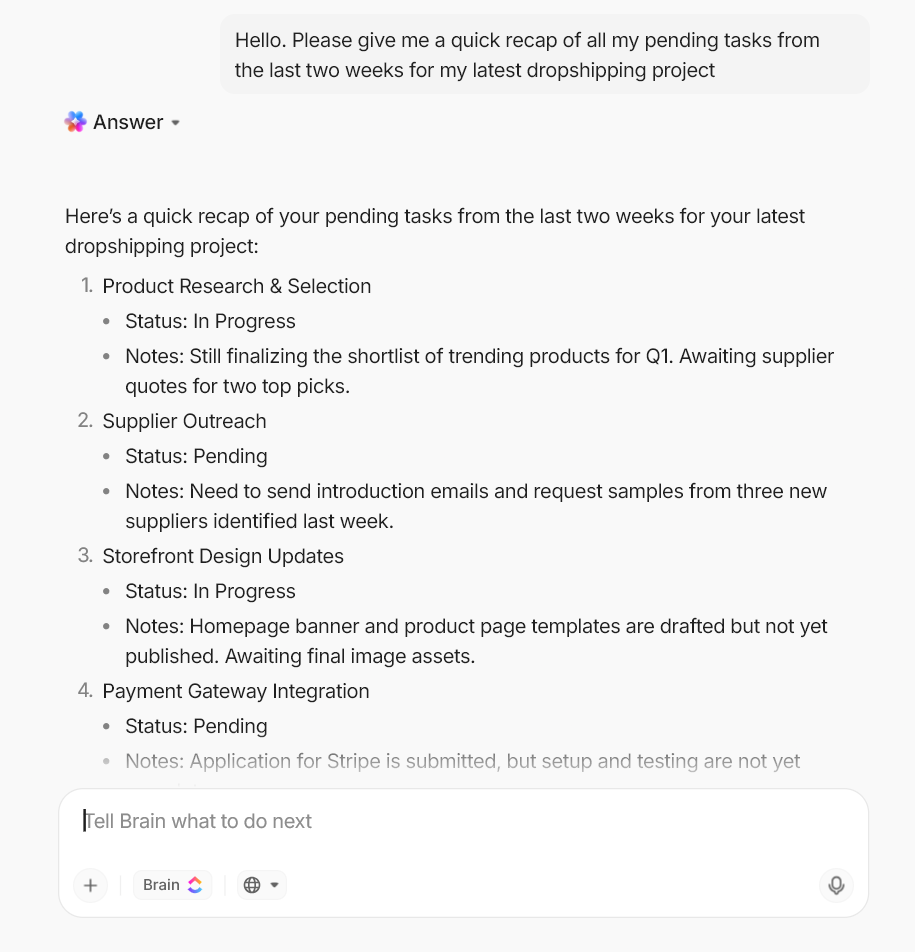

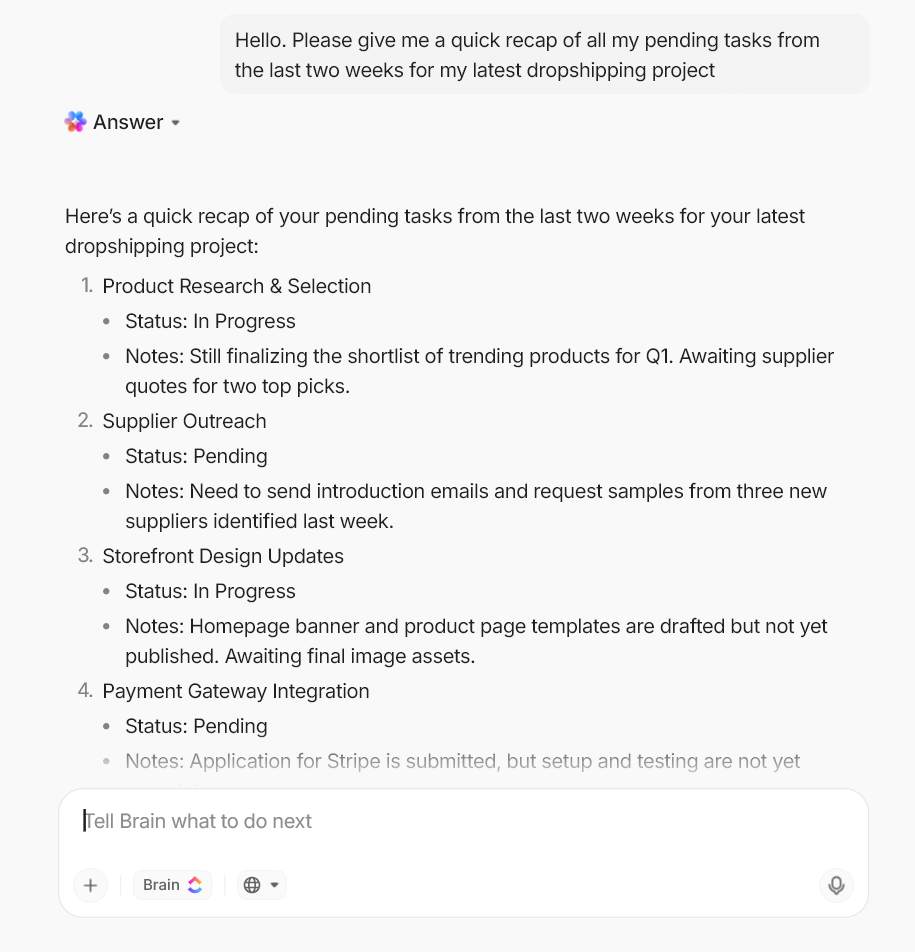

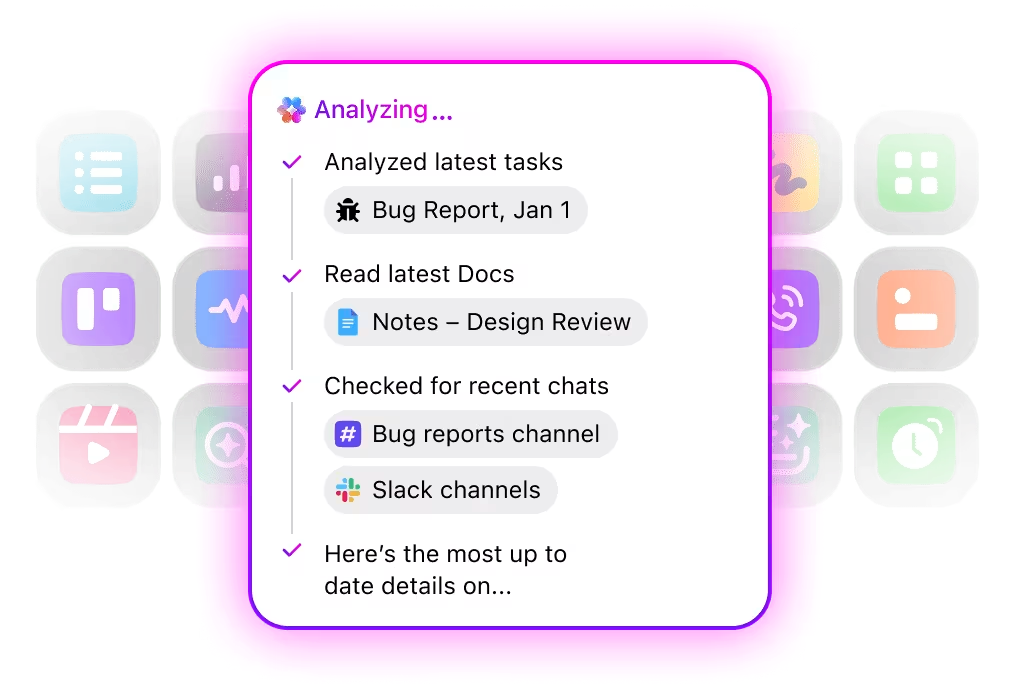

📮 ClickUp Insight: 62 % av våra respondenter förlitar sig på konversationsbaserade AI-verktyg som ChatGPT och Claude. Deras välbekanta chatbot-gränssnitt och mångsidiga funktioner – för att generera innehåll, analysera data och mycket mer – kan vara anledningen till att de är så populära inom olika roller och branscher.

Om en användare måste byta till en annan flik för att ställa en fråga till AI varje gång, ökar dock kostnaderna för växling och kontextbyte med tiden.

Men inte med ClickUp Brain. Det finns direkt i din arbetsyta, vet vad du arbetar med, förstår vanlig text och ger dig svar som är mycket relevanta för dina uppgifter! Upplev en fördubbling av produktiviteten med ClickUp!

👀 Visste du att? Den globala dataproduktionen nästan tredubblades mellan 2020 och 2025. År 2025 hade företagen 181 zettabyte data – en guldgruva som väntar på att analyseras.

Varför kapacitetsbegränsningar uppstår oftare än väntat

Kapacitetsbegränsningar följer förutsägbara mönster som är kopplade till användarbeteende och infrastrukturbegränsningar. Om du ofta stöter på kapacitetsbegränsningar kan detta vara en av orsakerna:

Tider med hög användning

Claude upplever högst efterfrågan under kontorstid i de stora tidszonerna, dvs. PST och EST. Professionella användare, utvecklare och team arbetar aktivt med Claude, vilket skapar en koncentrerad belastning på systemet.

Betalande användare får företräde framför gratisanvändare under dessa perioder med hög trafik, vilket ökar sannolikheten för kapacitetsfel.

Uppgiftens komplexitet

När användare utför uppgifter och begärningar som kräver mer beräkningsresurser når de snabbare användningsgränserna.

Så här använder du Claude på ett sätt som kan påverka din användning:

| Faktor | Inverkan på användningen |

| Längd och komplexitet i din konversation | Några exempel på uppgifter som snabbt förbrukar tokens: Längre trådar med omfattande fram- och återkommande meddelanden, uppladdning av flera filer eller analys av stora dokument, komplexa kodningsuppgifter som kräver sammanhang från tidigare meddelanden. |

| Funktioner du använder | Vissa funktioner förbrukar kapaciteten snabbare än grundläggande textgenerering. Till exempel: Tokenintensiva verktyg och anslutningar som Google Drive-integration eller MCP-servrar Utökad tänkande som tilldelar ett stort antal tokens för intern resonemang Realtidswebbsökning |

| Claude-modellen | Valet av Claude-modell avgör också användningen av tokens. Till exempel:Opus 4. 5: TokeneffektivSonnet 4. 5: Balanserad prestanda och effektivitetHaiku 4. 5: Snabb, låg kostnad för allmänna behov |

Uppladdning av för många filer

Varje fil du laddar upp till Claude konverteras till tokens. Stora filer eller för många små filer förbrukar fler tokens, vilket snabbt tömmer dina användningsgränser.

Dessutom kommer Claude att bearbeta alla uppladdade data på nytt varje gång du skickar en prompt för att behålla sammanhanget. Detta kommer att göra att dina gränser förbrukas snabbare.

Oväntade efterfrågetoppar

När nya funktioner tillkännages, virala händelser inträffar eller nya modeller lanseras upplever Claude oväntade belastningsökningar. Ofta klarar infrastrukturen inte av detta.

Dessutom kräver nya modeller tekniska justeringar och optimeringar i början, vilket ökar belastningen utöver den ökade trafiken. Claude kommer sannolikt att visa kapacitetsbegränsningsfel även för betalande användare.

Omfattande driftstopp

Kapacitetsbegränsningar kan också uppstå när infrastrukturen fallerar eller det uppstår tekniska fel hos Anthropic.

Användare upplever partiella eller fullständiga avbrott där plattformen blir helt otillgänglig tills problemet är löst. Kontrollera Claudes statusida för att bekräfta att det problem du upplever är ett avbrott som gäller hela tjänsten.

📊 Verklig användningssituation: I juli 2025 började flitiga Claude-användare rapportera om plötsliga användningsbegränsningar och blockerad åtkomst i alla abonnemang. Många hade abonnemang i högre prisklasser, inklusive Max-abonnemanget för 200 dollar per månad. Ändringarna infördes utan förvarning och upptäcktes först när arbetsflödena började störas.

Praktiska sätt att minska kapacitetsstörningar i Claude

Det finns inte mycket du kan göra åt avbrott eller tillfälliga infrastrukturproblem som orsakas av Claudes servrar, men det finns sätt att praktiskt minska kapacitetsbegränsningarna.

Planera din AI-användning strategiskt

Claude upplever störst efterfrågan under globala kontorstider, särskilt i de amerikanska tidszonerna. Planera in stora AI-arbetsuppgifter under tider med mindre trafik, till exempel tidigt på morgonen eller sent på kvällen.

Samla tunga uppgifter som långa utkast, analys av flera filer eller kodgranskningar till tider utanför rusningstid och reservera rusningstider för snabba frågor eller finjusteringar.

Använd Claude-projekt för repetitiva arbetsuppgifter

Claude-projekt är fristående arbetsytor med egen chattlogg och kunskapsbas. När du laddar upp dokument till ett projekt sparas de i cacheminnet för framtida bruk. Varje gång du refererar till det innehållet räknas endast nya eller icke-cachelagrade delar mot dina begränsningar.

Hur detta sparar användning:

- Ladda upp varumärkesriktlinjer, briefs eller datamängder en gång

- Referera till dem i flera chattar

- Kör flera analyser utan att behöva bearbeta filerna på nytt varje gång

- Separera projekt efter kund eller arbetsflöde för en tydligare kontext.

Claude tillämpar också partiell caching på ofta återanvända sammanhang, vilket minskar upprepade bearbetningskostnader mellan sessioner.

När projektkunskapen närmar sig kontextgränserna aktiverar Claude automatiskt läget Retrieval-Augmented Generation (RAG). Detta utökar den användbara kunskapskapaciteten samtidigt som svarskvaliteten bibehålls, vilket gör att du kan arbeta med betydligt större datamängder utan att gränserna nås så snabbt.

⭐ Här är vår guide om hur du använder Claude Projects.

📌 Exempel: Om du analyserar kvartalsvisa försäljningsdata laddar du upp kalkylbladet till ett projekt en gång. Du kan sedan generera flera rapporter, köra olika analyser och ställa uppföljningsfrågor i separata chattar utan att behöva ladda upp filen igen varje gång.

Håll projektinstruktionerna koncisa

Undvik att lägga in för många detaljer i instruktionerna på projektnivå.

Projektinstruktionerna ska innehålla:

- Övergripande sammanhang

- Claudes roll

- Allmänna riktlinjer

Uppgiftsspecifika instruktioner hör hemma i enskilda chattar.

Genom att separera dessa förhindras Claude från att bearbeta stora block av upprepade sammanhang med varje meddelande, vilket minskar tokenförbrukningen i långa arbetsflöden.

📌 Exempel på projektspecifika instruktioner:

Du är B2B SaaS-innehållsstrateg för ett företag som utvecklar projektledningsprogramvara. Skriv i en tydlig, direkt och icke-reklamisk ton. Undvik jargong och fluff. Målgrupp: operativa chefer, produktchefer och marknadsföringsteam. Strukturera alltid svaren med tydliga rubriker, praktiska exempel och konkreta tips. Använd amerikansk engelska. Prioritera tydlighet framför kreativitet.

(Detta gäller för alla chattar i projektet. )

📌 Exempel på chatt-specifik instruktion:

Skapa en bloggskiss på 1 200 ord om ”AI-arbetsflödesautomatisering för driftsteam”. Inkludera:

- Viktiga problem som operativa chefer står inför

- 5 praktiska användningsfall för automatisering

- Exempel på mätbara effektivitetsvinster

- Ett kort avsnitt som jämför manuella arbetsflöden med AI-drivna arbetsflöden.

Ton: praktisk och insiktsdriven. Format med H2-rubriker, punktlistor och exempel.

Stäng av utökad tänkande

Om dina uppgifter inte kräver avancerad resonemangsförmåga kan du stänga av den här funktionen. Utökad resonemangsförmåga förbrukar dina användningsgränser betydligt snabbare än standardbearbetning.

Stäng av utökad tänkande när:

- Skapa enkelt innehåll: t.ex. e-postmeddelanden, inlägg på sociala medier eller grundläggande sammanfattningar

- Kör repetitiva uppgifter: t.ex. formatera data, generera liknande utdata i bulk

- Begära snabba, sakliga svar: t.ex. definitioner, syntaxkontroller eller enkla förklaringar

Inaktivera tillfälligt icke-kritiska verktyg och anslutningar

Varje aktiverad integration ökar bearbetningskostnaden. Även när du inte aktivt använder det verktyget eller den integrationen i en fråga, allokerar Claude fortfarande resurser för att kontrollera deras tillgänglighet, vilket förbrukar tokens i bakgrunden.

Icke-kritiska verktyg som kan inaktiveras tillfälligt är bland annat:

- Google Drive-integration: Om du inte har åtkomst till lagrade filer i den aktuella sessionen

- MCP-servrar: När du inte behöver externa datakällor eller anpassade verktyg

- Webbsökning i realtid: För uppgifter som enbart bygger på Claudes träningskunskap.

- Kodkörningsmiljöer: Om ditt arbete inte innefattar att köra eller testa kod

Utnyttja Claudes chatt- och minnesfunktioner

Undvik att ladda upp dokument på nytt eller förklara sammanhanget igen i varje konversation.

Använd referenser som:

- ”Använd de tidigare varumärkesriktlinjerna”

- ”Se förra veckans strategidiskussion”.

Betalda abonnemang kan söka i tidigare chattar och återanvända kontext, vilket minskar upprepad tokenförbrukning och gör aktuella sessioner lättare.

Starta nya chattar istället för att fortsätta långa trådar

Sluta förlänga konversationer som redan har tjänat sitt syfte. Långa trådar ackumulerar kontext som Claude bearbetar om med varje nytt meddelande, vilket tömmer dina användningsgränser snabbare. Starta helt enkelt nya chattar när du byter ämne eller påbörjar icke-relaterade uppgifter.

⭐ Bonus: Förstå vad som faktiskt räknas in i användningsgränserna

Flera faktorer påverkar hur snabbt du når Claude-användningsgränserna:

- Meddelandets längd och komplexiteten i uppmaningen

- Filuppladdningsstorlek och antal bilagor

- Total konversationslängd

- Verktygsanvändning (webbsökning, integrationer, kopplingar)

- Val av modell (Opus, Sonnet, Haiku)

- Generering och bearbetning av artefakter

🔔 Påminnelse: Ju tyngre dessa indata är, desto snabbare förbrukas ditt användningsfönster. En enda stor prompt med filer och utökad tänkande aktiverat kan använda mer kapacitet än dussintals korta textprompts.

📮 ClickUp Insight: Vår undersökning om AI-mognad visar på en tydlig utmaning: 54 % av teamen arbetar i spridda system, 49 % delar sällan information mellan verktyg och 43 % har svårt att hitta den information de behöver.

När arbetet är fragmenterat kan dina AI-verktyg inte få tillgång till hela sammanhanget, vilket innebär ofullständiga svar, fördröjda svar och resultat som saknar djup eller noggrannhet. Det är arbetsutbredning i praktiken, och det kostar företag miljontals kronor i förlorad produktivitet och bortkastad tid.

ClickUp Brain övervinner detta genom att fungera i en enhetlig, AI-driven arbetsyta där uppgifter, dokument, chattar och mål är sammankopplade. Enterprise Search visar alla detaljer direkt, medan AI-agenter arbetar över hela plattformen för att samla in information, dela uppdateringar och driva arbetet framåt.

Resultatet är en AI som är snabbare, tydligare och konsekvent informerad, något som icke-anslutna verktyg helt enkelt inte kan matcha.

Vad du inte ska göra när Claude är fullt utnyttjad

Det är frustrerande att få felmeddelandet ”På grund av oväntade kapacitetsbegränsningar”, men att göra något av följande kommer inte att lösa problemet – och kan faktiskt förvärra det. Här är vad du ska undvika när Claude visar kapacitetsproblem:

- Fortsätt använda tyngre modeller: Om du använder tyngre Claude-modeller, byt till lättare Claude Sonnet- eller Haiku-modeller som kräver mindre beräkningsresurser.

- Spamma inte med omförsök: Att uppdatera webbläsaren upprepade gånger när Claude AI ofta visar kapacitetsfel ökar belastningen på ett redan ansträngt system och översvämmar kön med dubbla förfrågningar.

- Sluta skicka samma meddelande flera gånger: Att skicka samma prompt flera gånger kommer inte att kringgå kapacitetsbegränsningarna – vänta istället tills systemet har stabiliserats.

- Fortsätt samma chatt: Om du når en gräns för kontextlängd kommer försök att tvinga in fler stora inmatningar i samma konversation bara att orsaka fler fel.

- Rensa cacheminnet för tidigt: Rensa inte webbläsarens cacheminne impulsivt – detta tvingar Claude att återskapa dina sessionsdata från grunden, vilket faktiskt förbrukar fler tokens när du ansluter igen.

👀 Visste du att? År 2024 orsakade CrowdStrike det största IT-avbrottet i historien, vilket ledde till att 8,5 miljoner system kraschade globalt. Allt som krävdes var en enda felaktig kodsekvens i en programuppdatering för att stoppa flygningar, avbryta operationer och kosta Fortune 500-företag 5,4 miljarder dollar.

Hur team utformar sina lösningar utifrån AI-kapacitetsbegränsningar

Så vad är lösningen? Här är hur du minimerar störningar och får ut det mesta av Claude ⭐

Planera dina konversationer

Kartlägg dina behov innan du inleder en konversation med Claude. Strukturerade Claude-prompter minskar behovet av fram- och återgång och ger dig bättre resultat snabbare utan omfattande användning av token.

Ställ dig själv dessa frågor innan du börjar chatta med Claude:

- Vilken specifik information eller vilka resultat behöver du från denna session?

- Kan du samla flera relaterade frågor i en enda omfattande prompt?

- Vilken bakgrundsinformation, vilka filer eller exempel kan du tillhandahålla i förväg för att undvika upprepade förtydliganden?

- Är detta en engångsförfrågan eller en del av ett större arbetsflöde som bör ingå i ett särskilt projekt?

- Vem mer i ditt team behöver denna information, och bör de ha tillgång till samma chatt eller projekt?

📌 Exempel: Istället för ”Hjälp mig med marknadsundersökningen” kan du skicka en välplanerad prompt med frågan: ”Analysera dessa tre konkurrentrapporter (bifogade) och identifiera deras prisstrategier, målgrupper och viktigaste differentieringsfaktorer i en jämförelsetabell. ”

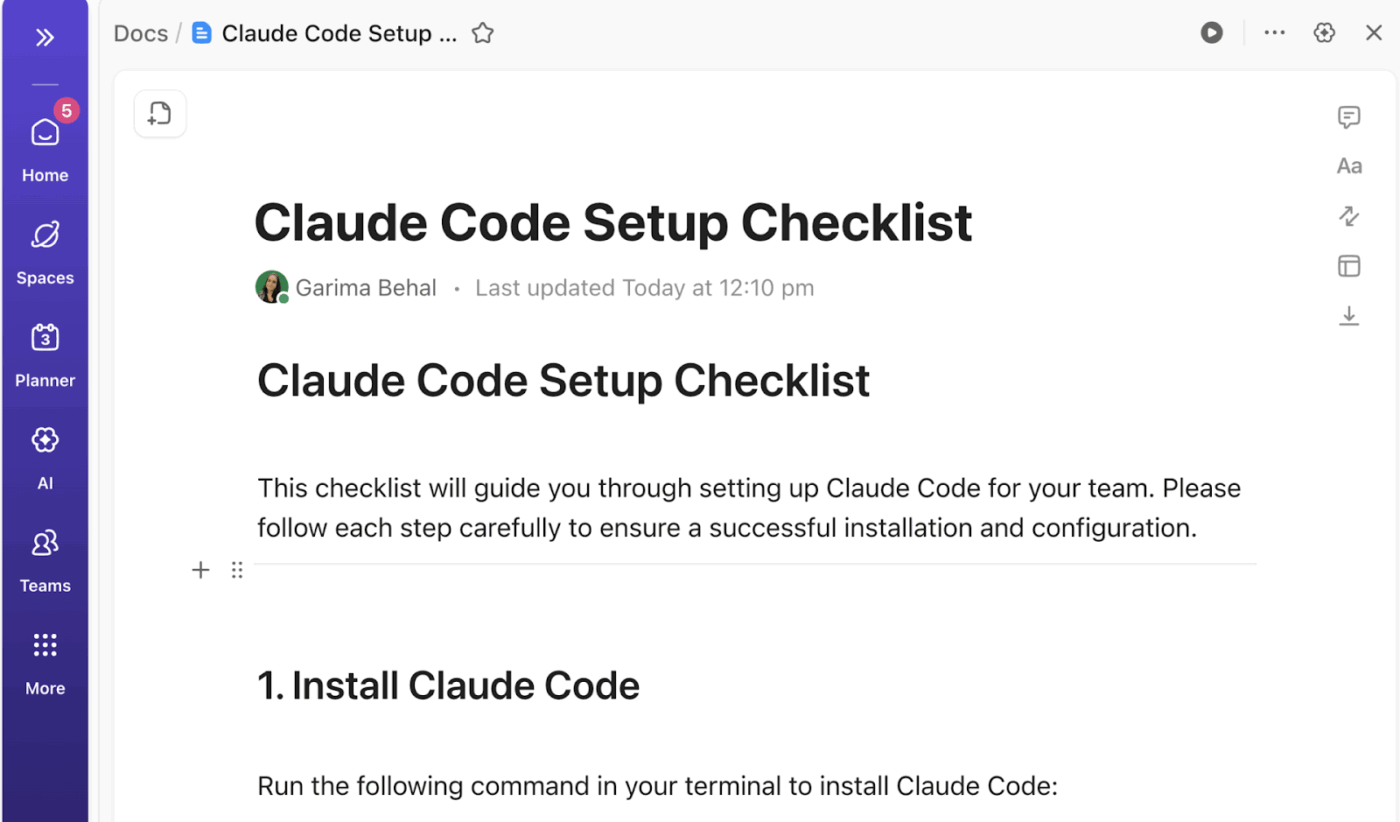

💡 Proffstips: Använd ClickUp Docs för att förfina och experimentera med uppmaningar i realtid tillsammans med andra. Med tiden kommer du att bygga upp ett arkiv med beprövade uppmaningar som ger konsekventa resultat. Ditt team behöver inte skapa förfrågningar från grunden. De kan hämta testade mallar och anpassa dem efter sitt användningsfall.

Samla liknande förfrågningar i ett meddelande

Om du har flera relaterade uppgifter eller frågor kan du gruppera dem i ett enda meddelande.

Till exempel:

- Istället för att skicka separata meddelanden för varje matematikproblem, skicka dem alla i ett enda meddelande.

- Begär analys av fem kundsupportärenden i ett meddelande istället för att ladda upp och analysera varje ärende individuellt.

- Be Claude att generera mötesagendor för de kommande fyra kundsamtalen samtidigt istället för att begära dem ett efter ett.

- Samla kodgranskningsförfrågningar från flera filer i en enda konversation istället för att öppna separata chattar för varje fil.

Separata meddelanden tvingar Claude att ladda om och bearbeta delad kontext upprepade gånger. Genom att samla dem i en konsoliderad prompt används färre tokens och bearbetningskostnaden minskar.

📚 Läs mer: AI-PDF-sammanfattare som sparar tid

Integrera Claude med API:et

Integrera Claude i dina arbetsflöden och befintliga teknikstackar via Claude API för en mer stabil och förutsägbar upplevelse. Naturligtvis behöver du teknisk expertis för att konfigurera detta, men vinsten är betydande kontroll över hur du hanterar kapaciteten.

Så här hjälper API-integration till att hantera begränsningar i Claude:

- Övervaka hastighetsbegränsningar programmatiskt och justera arbetsbelastningsfördelningen i realtid.

- Skapa anpassad timeout-hantering som pausar uppgifter istället för att förlora arbete när kapaciteten nås.

- Dirigera olika typer av uppgifter till lämpliga modeller (Haiku för enkla frågor, Opus för komplexa resonemang) för att optimera resursanvändningen.

- Implementera köhanteringssystem som fördelar API-anrop under rusningstider.

👀 Visste du att? Kostnaden för AI-hallucinationer går utöver dåliga resultat – det medför även juridiskt ansvar. Air Canada betalade en gång 812,02 dollar i skadestånd och rättegångskostnader till en kund som bokade flyg baserat på felaktig information från en chatbot. Flygbolagets chatbot gav ett svar som inte stämde överens med deras faktiska policy för sorgpriser.

När du bör överväga reserv-AI-verktyg (och när du inte bör göra det)

Claudes tillfälliga kapacitetsbegränsningar och användningsbegränsningar kan störa viktiga arbetsflöden och fördröja tids känsliga leveranser. När ditt teams produktivitet är beroende av AI-tillgänglighet kan ett enda kapacitetsfel leda till missade deadlines och stoppade projekt.

Claude är exceptionellt kapabel när det gäller resurskrävande uppgifter och arbete med långa sammanhang, men finns det några långsiktiga lösningar på kapacitetsbegränsningarna?

Ja, byt till andra AI-modeller. Det är dock inte alltid den idealiska lösningen.

Låt oss se när du bör och när du inte bör överväga att använda reserv-AI-verktyg:

Överväg att använda reserv-AI-verktyg när

- Du har kritiska deadlines, t.ex. leveranser till kunder, publiceringsscheman och juridiska inlämningar.

- Kapacitetsproblem uppstår så ofta att de stör ditt veckovisa arbetsflöde.

- Du behöver olika AI-specialiteter, t.ex. ChatGPT för kreativ brainstorming, Perplexity för forskning med källhänvisningar och Claude för analys av långa sammanhang.

- Ditt teams arbetsbelastning är fördelad på flera projekt, där mångfalden av verktyg gör att arbetet kan fortsätta när en plattform inte är tillgänglig.

- Du testar resultaten för kvalitetskontroll och vill jämföra svaren mellan olika modeller innan du slutför leveransen.

Hoppa över säkerhetskopieringsverktyg för AI när

- Dina nuvarande användningsmönster passar bra inom Claudes gränser.

- Att hantera flera verktyg ökar komplexiteten. Istället för att effektivisera arbetet saktar kontextväxling mellan plattformar ner dig.

- Kapacitetsbegränsningar hindrar inte ditt viktiga dagliga arbete

- Budgetbegränsningar gör det opraktiskt att betala för flera prenumerationer, särskilt när du inte använder dem regelbundet.

- Inlärningskurvan och installationstiden för ett nytt verktyg överstiger fördelarna med att ha det som backup.

👀 Visste du att? Du kan köra Anthropics Claude-modeller direkt via Amazon Bedrock, en helt hanterad AWS-tjänst som låter utvecklare bygga generativa AI-applikationer i företagsstorlek med ett enda, enhetligt API.

Hur ClickUp hjälper team att fortsätta arbeta när AI inte är tillgängligt

AI-verktyg som Claude och ChatGPT är i sig fristående. De är utmärkta när det gäller det tänkande lagret i arbetet – analys, kreativt skrivande, kodning, forskning – men de omsätter inte det tänkandet i faktisk handling. De driver inte projekt framåt, tilldelar uppgifter, håller koll på deadlines eller ser till att teamen är samordnade.

ClickUp överbryggar klyftan mellan tanke och handling genom att samla allt ditt arbete, alla dina uppgifter, all din kommunikation och all din kunskap i en enda samlad AI-arbetsyta. AI fungerar direkt där du arbetar, inte i ett separat verktyg som du måste byta till.

Så här frigör ClickUp AI-potentialen i exekveringslagret 👇

En kontextuell AI som känner till allt ditt arbete

ClickUp Brain fungerar som ett kontextuellt AI-lager som är inbäddat direkt i din arbetsyta. Du behöver inte återskapa kontexten eller ladda upp filer upprepade gånger. Det vet hur ditt arbete är strukturerat. Du ställer frågor och det visar svaren genom att referera till realtidsdata från arbetsytan.

Här är vad ClickUp Brain hänvisar till:

- Uppgifter, deluppgifter och projekthierarkier kopplade till faktiska leveranser

- Status, prioriteringar, beroenden och deadlines som visar var arbetet står just nu

- Dokument kopplade till specifika projekt och de beslut de innehåller

- Kommentarer och pågående konversationer där kontexten faktiskt finns

- Teamets ägarskap och ansvar i arbetsflöden

Eftersom Brain fungerar inom ClickUps behörighetsmodell visar det bara information som du har behörighet att se. Det viktigaste är att insikterna inte fastnar i statiska filer. Brain analyserar live-exekveringsdata och ger svar baserade på ditt aktuella projektstatus.

Få tillgång till de bästa AI-modellerna till priset av en

ClickUp erbjuder tillgång till ledande AI-modeller – ChatGPT, Claude och Gemini – direkt i din arbetsyta. Detta konsoliderar AI-åtkomsten, vilket minskar antalet prenumerationer och kostnaderna. Men framför allt slipper du bygga upp kontexten på nytt varje gång du byter modell.

Ditt team kan välja de stora språkmodeller som passar bäst för deras uppgift och jämföra svar från de bästa modellerna direkt från ClickUp-arbetsytan. Om Claude inte fungerar under en stund kan de enkelt byta till ChatGPT eller Gemini inom samma konversationstråd.

Enterprise Search som spänner över arbete, kunskap och anslutna verktyg

Med ClickUp Enterprise Search kan du söka i hela ditt arbetsområde och anslutna system genom naturligt språk.

Istället för att leta igenom mappar eller instrumentpaneler kan teamen ställa frågor som:

- Vilka beslut fattades om prismodellen under granskningen av fjärde kvartalet?

- Vilka öppna uppgifter hänvisar till kundens API-integrationskrav?

- Var dokumenterade vi det slutgiltiga godkännandet för produktlanseringens tidsplan?

- Visa mig alla konversationer om budgetbegränsningar från förra månaden

BrainGPT söker igenom och returnerar svar och relaterade filer baserat på hur arbetet är organiserat. Detta är särskilt värdefullt i stora arbetsutrymmen där informationen är fragmenterad mellan projekt, team och verktyg.

🔔 Påminnelse: Om du behöver aktuell information utanför din arbetsyta stöder ClickUp även webbsökning i realtid för att hämta extern data utan att lämna plattformen.

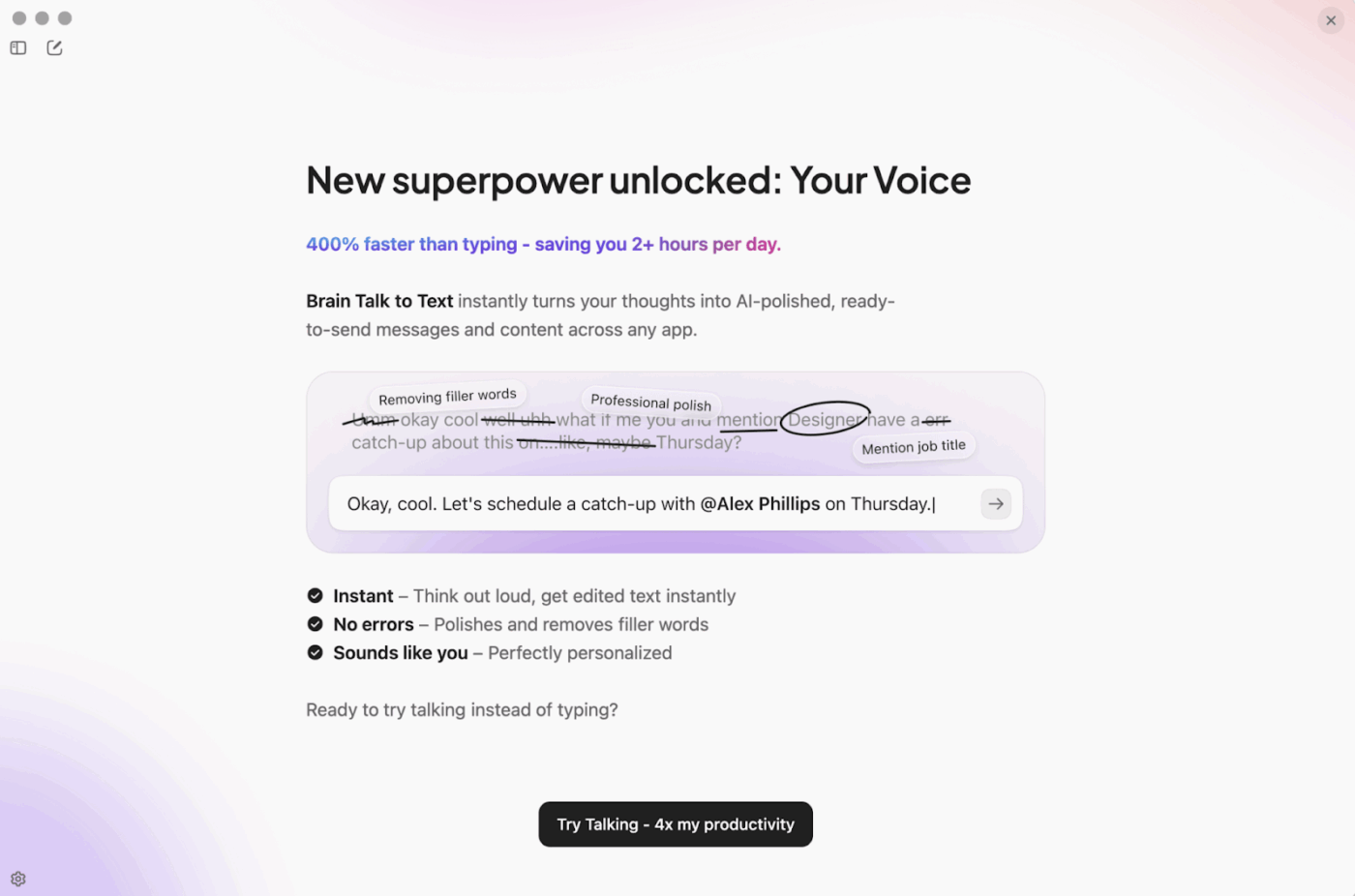

Fånga upp idéer utan att bryta arbetsflödet

Med ClickUps funktion Talk to Text kan team diktera idéer, uppdateringar eller mötesanteckningar och omvandla dem till strukturerad text direkt.

Hur Talk to Text håller arbetet igång:

- Diktera projektuppdateringar under kundsamtal och konvertera dem omedelbart till uppgifter.

- Spela in mötesdiskussioner och låt Brain extrahera åtgärdspunkter, tilldela ansvar och skapa uppföljningsuppgifter automatiskt.

- Spela in brainstormingsessioner muntligt och omvandla dem till strukturerade dokument utan att behöva skriva in allt manuellt.

- Omvandla röstanteckningar till organiserade uppgiftslistor med prioriteringar och deadlines när du inte är vid ditt skrivbord.

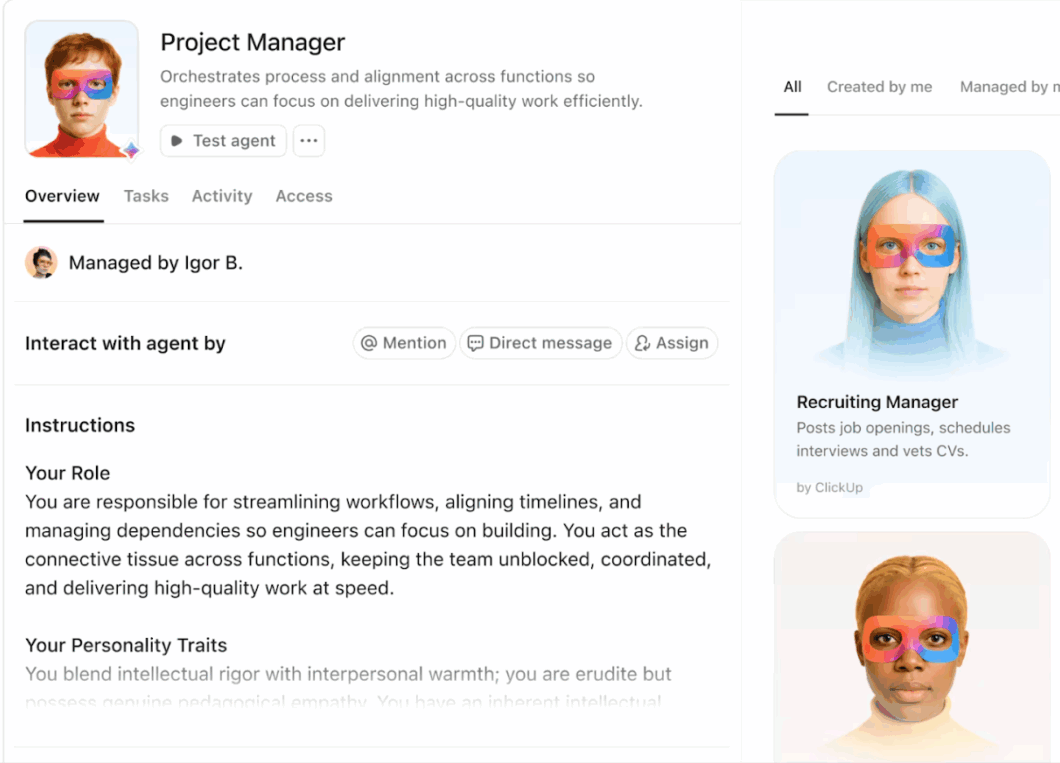

Effektivisera repetitiva arbetsflöden med Super Agents

ClickUps Super Agents är omgivande AI-assistenter som körs kontinuerligt i bakgrunden, övervakar din arbetsyta och utför arbetsflöden i flera steg.

Dessa agenter spårar förändringar i uppgifter, tidsplaner, beroenden och data – de upptäcker problem och vidtar åtgärder självständigt medan ditt team fokuserar på strategiskt arbete.

Exempel på vad Super Agents hanterar:

- Upptäck när projektets tidsplaner ändras och meddela automatiskt berörda parter, samt uppdatera beroende uppgifter i olika team.

- Övervaka uppgiftsgenomförandegraden och omfördela försenade uppgifter proaktivt utifrån teamets aktuella kapacitet.

- Skapa återkommande statusrapporter genom att sammanställa data från flera projekt utan att behöva vänta på att någon sammanställer dem manuellt.

- Aktivera uppföljningsåtgärder när beroenden är klara, så att arbetsflödena fortsätter även under AI-kapacitetsbegränsningar.

- Identifiera formateringsfel i uppladdade filer och markera dem innan de kommer in i dina arbetsflöden.

För att se hur det fungerar i praktiken, titta på den här videon om hur ClickUp använder Super Agents 👇

🔐 ClickUp-fördel: Superagenter är inte beroende av externa AI-modeller för att fungera – de arbetar inom ClickUps infrastruktur, vilket säkerställer att kritiska arbetsflöden förblir aktiva oavsett tillgängligheten av tredjeparts-AI.

Förbli produktiv även när AI-kapaciteten är begränsad

Claudes kapacitetsbegränsningar är verkliga, men de behöver inte hindra ditt teams produktivitet. De flesta AI-verktyg fungerar isolerat – du får svar och överför sedan manuellt insikterna till dina faktiska arbetssystem.

ClickUp eliminerar den luckan. Dess konvergens erbjuder en fördel där:

- AI fungerar direkt i dina projekt, uppgifter, dokument och konversationer – inte i separata chattfönster.

- Flera AI-modeller fungerar inom samma arbetsytestruktur, vilket gör att du kan växla mellan dem utan att behöva bygga om kontexten.

- Superagenter körs autonomt och utför arbetsflöden oberoende av extern AI-tillgänglighet.

- Sökning, röstinmatning och realtidsdata håller teamen igång under avbrott.

Är du redo att skapa arbetsflöden som inte avbryts när AI-verktygen slutar fungera?

Registrera dig gratis på ClickUp ✅

Vanliga frågor

Claude visar kapacitetsfel när efterfrågan överstiger vad infrastrukturen kan hantera. Systemet orsakar tillfälliga systemomfattande fördröjningar, vilket begränsar dess förmåga att svara på dina meddelanden.

Nej. Betalda abonnemang ger dig prioriterad åtkomst under perioder med hög efterfrågan, men de eliminerar inte kapacitetsbegränsningarna helt. Vid kraftiga trafikökningar eller infrastrukturproblem kan även Pro- och Team-användare drabbas av fördröjningar eller tillfälliga blockeringar.

De flesta kapacitetsbegränsningar löses inom några minuter till några timmar när efterfrågemönstren förändras under dagen. Tjänsteomfattande avbrott orsakade av tekniska fel kan pågå längre – kontrollera Claudes statusida för realtidsuppdateringar om pågående problem.

Inte helt. Du kan minska hur ofta du stöter på dem genom att tidsplanera förfrågningar under tider med låg belastning, använda enklare modeller, samla ihop förfrågningar och hantera filuppladdningar strategiskt. Men oväntade efterfrågetoppar och infrastrukturproblem ligger utanför din kontroll.

Skapa reservarbetsflöden och underhåll dokumentationen så att arbetet kan fortsätta manuellt under avbrott. Se till att mallar och tidigare resultat är tillgängliga, utbilda teammedlemmarna i kritiska uppgifter och överväg att använda reservverktyg för AI för tidspressade uppgifter som inte kan vänta på att kapaciteten frigörs.