A legtöbb ember azt feltételezi, hogy választania kell a hatékony AI-eszközök használata és az adatok magánjellegének megőrzése között. De valójában mindkettő meglehet. Az AI helyi futtatása azt jelenti, hogy az adatok soha nem hagyják el a hardverét. Teljes ellenőrzést gyakorol az információi felett, miközben automatizálja a leggyakrabban ismétlődő feladatait.

Ez az útmutató bemutatja, hogyan használhatja a helyi mesterséges intelligenciát biztonságos munkafolyamatokhoz olyan eszközökkel, mint az Ollama. Megtanulja, hogyan válassza ki az adott hardver specifikációknak megfelelő nyílt forráskódú modelleket. Emellett olyan automatizált munkafolyamatokat is létrehozhat, amelyek a magánjellegű dokumentumokat helyben dolgozzák fel.

Megvizsgáljuk továbbá a munkafolyamatok központosítását egy olyan egységes felületen, mint a ClickUp. 😎

Mi az a helyi mesterséges intelligencia?

A helyi mesterséges intelligencia azt jelenti, hogy a nagy nyelvi modelleket (LLM-eket) teljes egészében a saját hardverén – például a laptopján vagy egy helyszíni szerveren – futtatja, ahelyett, hogy az adatait külső felhőszolgáltatásoknak küldené el. Ez minden olyan csapat számára alkalmas, amely érzékeny információkat kezel, a mérnöki és terméktervezési részlegektől a jogi és pénzügyi osztályokig.

A legtöbb felhőalapú AI-eszköz esetében a parancsai, dokumentumai és adatai harmadik felek szerverére kerülnek. Elveszíti az irányítást az adatok feldolgozása, tárolása és felhasználása felett.

Ezzel szemben a helyi mesterséges intelligencia az adatokat a saját környezetében tartja. Ön teljes mértékben kézben tartja a munkafolyamatok biztonságát és adatvédelmét.

Természetesen ennek ára van. A helyi mesterséges intelligencia beállítása nagyobb technikai erőfeszítést és előzetes hardverbefektetést igényel. Ugyanakkor teljesen kiküszöböli a külső szolgáltatóktól való függőségét. Az eszközön történő következtetéssel az információi pontosan ott maradnak, ahol szeretné.

Miért fontos a helyi mesterséges intelligencia a biztonságos csapatmunkafolyamatok szempontjából?

🔎 Tudta? A fogyasztók mindössze 10%-a hajlandó érzékeny információkat, például pénzügyi, kommunikációs vagy biometrikus adatokat megosztani mesterséges intelligenciával működő rendszerekkel.

Ez a habozás a B2B-csapatok számára egyre inkább valósággá váló helyzetet tükrözi. A felhőalapú mesterséges intelligenciával lényegében átadja vállalatának szellemi tulajdonát egy harmadik félnek. A jogi, pénzügyi vagy HR-csapatok számára ez hatalmas felelősséget jelent.

A helyi mesterséges intelligencia megváltoztatja ezt a dinamikát azzal, hogy a mesterséges intelligenciát a saját hardverére helyezi át. Íme, miért fontos ez a mindennapi működése szempontjából:

- Az adat szivárgás kiküszöbölése: Akadályozza meg, hogy a saját fejlesztésű kódot vagy a magánügyfelekkel kötött szerződéseket felhasználják olyan nyilvános modell betanításához, amelyet versenytársai is felhasználhatnak

- Tartsa be a szabályozási előírásokat: Maradjon a GDPR vagy a HIPAA keretein belül, mivel az érzékeny adatok soha nem lépik át a nemzetközi határokat, és nem kerülnek harmadik fél szerverére

- Szabaduljon meg az internetfüggőségtől: Végezzen komplex adatelemzéseket vagy tervezési feladatokat áramkimaradás esetén vagy olyan szigorúan biztonsági környezetben, ahol a felhőhöz való hozzáférés korlátozott.

- Költségek kiszámítható kezelése: Kerülje el az API-díjak emelkedését a csapat bővülésével, mivel az egyetlen költsége a már meglévő hardver

A helyi mesterséges intelligencia meglévő eszközeibe történő integrálásával automatizálhatja munkáját anélkül, hogy veszélybe sodorná a biztonságot.

⚠️ Fontos azonban szem előtt tartani, hogy ez a probléma tovább súlyosbodhat. Előfordulhat, hogy csapata több AI-eszközt is bevezetni kíván, ami az AI-terjedéshez vezethet – azaz az AI-eszközök felügyelet és stratégia nélküli elszaporodásához. Ez pénzpazarláshoz, felesleges munkához és biztonsági kockázatokhoz vezethet.

Végül is ez kiszélesíti a biztonsági fenyegetési modellt, és megnehezíti a munka nyomon követését.

📮ClickUp Insight: Az alacsony teljesítményű csapatoknál négyszer nagyobb az esélye annak, hogy 15 vagy több eszközt használnak egyszerre, míg a magas teljesítményű csapatok hatékonyságukat úgy tartják fenn, hogy eszköztárukat 9 vagy annál kevesebb platformra korlátozzák. De mi lenne, ha csak egy platformot használna? A munka mindenre kiterjedő alkalmazásaként a ClickUp egyetlen platformon egyesíti feladatait, projektjeit, dokumentumait, wikijeit, csevegéseit és hívásait, mindezt AI-alapú munkafolyamatokkal kiegészítve. Készen állsz az okosabb munkavégzésre? A ClickUp minden csapat számára megfelelő, láthatóvá teszi a munkát, és lehetővé teszi, hogy a lényegre koncentrálj, míg a többit az AI intézi.

Mire van szüksége a helyi mesterséges intelligencia futtatásához?

Nincs szüksége speciális szuperszámítógépre az AI helyi futtatásához. A modellek építésének legújabb változásai lehetővé teszik, hogy a már meglévő hardverével kezdje el a munkát. Csak néhány konkrét kritériumnak kell megfelelnie.

Hardverkövetelmények

A hardvere határozza meg, hogy milyen méretű és sebességű AI-modelleket használhat. Míg egy nagy teljesítményű gép lehetővé teszi bonyolultabb következtető modellek futtatását, a kisebb modellek is meglepően hatékonnyá váltak.

- GPU VRAM-mal: A legtöbb csapat számára jelenleg a legideálisabb megoldás egy legalább 12 GB VRAM-mal rendelkező dedikált NVIDIA kártya. Ez lehetővé teszi olyan közepes méretű modellek nagy sebességű futtatását, mint a Llama 3.3 (8B) vagy a Mistral Small.

- Rendszer RAM: Ha nincs csúcskategóriás GPU-ja, a számítógép RAM-ja kezeli a terhelést. 32 GB elegendő kapacitást biztosít a modell futtatásához, miközben a böngésző és a projektkezelő eszközök is nyitva maradhatnak

- Egységes memória (Mac-felhasználók számára): Ha M-sorozatú chipet (M2, M3 vagy M4) tartalmazó Mac-et használ, a RAM és a GPU memóriája megosztott. Ez különösen hatékonnyá teszi a Mac-eket a helyi mesterséges intelligencia számára, mivel a modell a teljes memóriakészlethez hozzáférhet

- Gyors tárolás: A modellek nagy fájlok, méretük gyakran 5 GB és 50 GB között mozog. Az NVMe SSD használata elengedhetetlen az új modell betöltésekor fellépő hosszú várakozási idők elkerüléséhez

🔎 Tudta? A PC-k összeállítása jelentősen drágább, mint néhány hónappal ezelőtt. Korábban egy 32 GB-os DDR5 memóriakészlet ára 130 dollár alatt volt, ma viszont ugyanazok a készletek ára 400 dollár fölé emelkedett. Ez a változás miatt a 32 GB-os memóriakapacitás lett az új minimumkövetelmény minden komolyabb helyi mesterséges intelligencia-feladathoz, mivel elegendő tartalékra van szükség a modellek futtatásához anélkül, hogy a rendszer teljesítménye összeomlana.

Szoftverkövetelmények

A szoftver hidat képez a hardver és a mesterséges intelligencia között. Már nem kell fejlesztőnek lennie ahhoz, hogy ezt működésbe hozza.

- Operációs rendszer: Bár a Linux az AI természetes otthona, a Windows és a macOS ma már ugyanolyan képességekkel rendelkezik. A Windows-felhasználók a WSL2 segítségével Linux-szerű környezetet hozhatnak létre, bár számos eszköz ma már közvetlenül a Windowson is fut.

- Modellkezelők: Az Ollama vagy az LM Studiohoz hasonló eszközök jelentik a legegyszerűbb kiindulási pontot. Ezek kezelik a kvantálást – automatikusan tömörítik a modellt, hogy az elférjen a hardverén.

- Illesztőprogramok: Szüksége lesz a hardveréhez tartozó legújabb illesztőprogramokra, például a legújabb CUDA-illesztőprogramra az NVIDIA-kártyákhoz. A legtöbb modern telepítőprogram a telepítés során ellenőrzi ezt Ön helyett.

Nyílt forráskódú LLM-opciók

A nyílt súlyú modellek száma robbanásszerűen növekszik, és ezeket ingyenesen letöltheti. Ezeket olyan cégek fejlesztették ki, mint a Meta (Llama), a Mistral és az Alibaba (Qwen). A zárt rendszerekkel ellentétben ezeknél a modelleknél pontosan láthatja, hogyan működnek, és hová kerülnek az adatai.

Ha nagy nyelvi modellt választ, figyeljen a szoftverlicencre. A legtöbb az Apache 2.0 vagy az MIT licencet használja, ami lehetővé teszi azok üzleti célú használatát havi előfizetési díj nélkül. Mivel ezek a modellek a saját hardverén futnak, közvetlenül integrálhatók a magán munkafolyamataiba.

Például használhat helyi modellt belső e-mailek megírásához, értekezletek jegyzőkönyveinek összefoglalásához vagy saját adatkészletek elemzéséhez. Így a legérzékenyebb projektadatok és stratégiai jegyzetek a saját gépén maradnak.

🧠 Érdekesség: Az Apple M-sorozatú chipjei egyedülálló architektúrai előnyt kínálnak az adatvédelemre összpontosító csapatok számára. A Mac Unified Memory funkciója lehetővé teszi az AI számára, hogy a rendszer teljes RAM-kapacitását úgy használja, mintha az dedikált grafikus memória lenne.

Ez azt jelenti, hogy egy 128 GB RAM-mal felszerelt MacBook képes futtatni olyan hatalmas, rendkívül kifinomult modelleket , amelyekhez általában 10 000 dollár feletti áron kapható speciális vállalati hardverre lenne szükség.

A legjobb helyi AI-modellek csapatmunkafolyamatokhoz

A megfelelő modell kiválasztásához hasonlítsa össze a modell erősségeit a csapata feladataival és a hardver képességeivel.

Általános célú modellek

Ezek a helyi rendszerének legfőbb munkagépei. Használja őket e-mailek megírásához, a projektfrissítések összefoglalásához vagy kreatív ötletek kidolgozásához.

- Llama 4 Scout (17B): 10 millió tokenes kontextusablakkal rendelkezik, amely lehetővé teszi több ezer oldalnyi szöveg egyszerre történő feldolgozását

- Mistral Small 4: „mix-of-experts” architektúrát használ, ami azt jelenti, hogy minden feladatnál csak paramétereinek egy részét aktiválja

- Qwen 3.5 (7B): Állandóan kiemelkedő teljesítményt nyújt, ha csapata több nyelven kezeli a műszaki dokumentációt

Modellek a következtetéshez és az eszközhasználathoz

Használja ezeket, ha szüksége van az LLM-ügynökökre több lépésből álló problémák megoldásához, összetett logika követéséhez, vagy ha önálló ügynökként szeretné őket bevonni a munkafolyamataiba.

- Llama 4 Maverick: Natívan multimodális. Ez ideális azoknak a csapatoknak, amelyeknek komplex diagramokat vagy pénzügyi táblázatokat kell elemezniük, ahol a vizuális kontextus ugyanolyan fontos, mint a szöveg

- Phi-4 (14B): A STEM-tárgyakra és a logikai gondolkodásra hangolva. Használja adatellenőrzéshez vagy összetett matematikai feladatokhoz, amelyekhez általában sokkal nagyobb, drágább modellek szükségesek

- DeepSeek-R1: Megjeleníti belső gondolati láncolatát, ami segít ellenőrizni a logikáját a nagy kockázatú elemzések során. Ideális mélyreható kutatásokhoz és stratégiai tervezéshez

Feladatspecifikus modellek

Néha egy speciális eszköz hatékonyabb, mint egy általános asszisztens. Ezek a modellek a munkafolyamat egy konkrét részére vannak optimalizálva.

- Qwen 3-Coder-Next: Megérti a repository-szintű logikát, így hibajavításokat javasolhat, vagy több fájlban is átalakíthatja a kódot. Mindezt a csapatod saját stílusú irányelveinek betartása mellett.

- Voxtral Mini: Azonosítja a felvételeken szereplő különböző beszélőket, és a zárt ülés felvételeit kereshető szöveggé alakítja. Teljesen offline módon működik, így kiválóan alkalmas az adat szivárgás elkerülésére

- Nomic Embed v1. 5: A magánjellegű dokumentumokat matematikai adatokká alakítja a szemantikus kereséshez. Ez lehetővé teszi, hogy a csapat belső tudásbázisában ne csak kulcsszavak, hanem jelentés alapján is kereshessen.

📚 Olvassa el még: LLM keresőmotorok: AI-vezérelt információkeresés

Népszerű eszközök a helyi mesterséges intelligencia futtatásához

Már nem kell szoftverfejlesztőnek lennie ahhoz, hogy saját gépén futtassa a modelleket. Számos felhasználóbarát alkalmazás néhány perc alatt elvégzi Ön helyett a technikai beállításokat.

Ollama és OpenWebUI

Az Ollama akkor ideális választás, ha gyorsaságra és rugalmasságra vágyik. A háttérben fut, és egy egyszerű felületen keresztül kezeli a modellek könyvtárát.

Bár alapvetően egyszerű eszközként indul, a legtöbb felhasználó az OpenWebUI-val párosítja. Ezzel a böngészőjében kifinomult csevegési élményt kap, amely kinézetre és kezelhetőségre is hasonlít az Ön által már ismert felhőalapú eszközökhöz. Emellett helyi hidat hoz létre a számítógépén található egyéb alkalmazások számára, hogy azok biztonságosan kommunikálhassanak az AI-modellekkel.

LM Studio

Ha inkább a hagyományos asztali alkalmazásokat részesíti előnyben, az LM Studio kiváló alternatíva. Ez egyfajta alkalmazásbolt a mesterséges intelligenciához. Segítségével néhány kattintással kereshet, letölthet és beszélgethet egy új modellel.

Az alkalmazás beépített hardverfelismerő funkcióval rendelkezik, így automatikusan konfigurálja a beállításokat az Ön konkrét GPU-jához vagy RAM-jához igazodva. Ez kiváló kiindulási pontot jelent, ha különböző modellekkel szeretne kísérletezni anélkül, hogy egy sor kódot is megírna.

GPT4All

Azok számára, akik kizárólag az adatvédelemre és a dokumentumelemzésre koncentrálnak, a GPT4All megbízható, egyszerű megoldás. Szinte minden számítógépen működik, beleértve azokat a régebbi laptopokat is, amelyek nem rendelkeznek dedikált grafikus kártyával.

A leghasznosabb funkciója az, hogy közvetlenül a helyi fájljaival tud csevegni. Megadhatja az alkalmazásnak a merevlemezén található mappát, és a mesterséges intelligencia válaszolni fog az adott dokumentumokkal kapcsolatos kérdésekre. Mindezt anélkül, hogy azokat valaha is fel kellene töltenie egy harmadik fél szerverére.

📚 Olvassa el még: A legjobb AI-ügynökök kódolás nélküli felhasználók számára

Hogyan állítsa be a helyi mesterséges intelligenciát a biztonságos munkafolyamatokhoz

Ez az útmutató az Ollama eszközt használja, mivel ez egy széles körben támogatott eszköz biztonságos, helyi AI-munkafolyamatok létrehozásához.

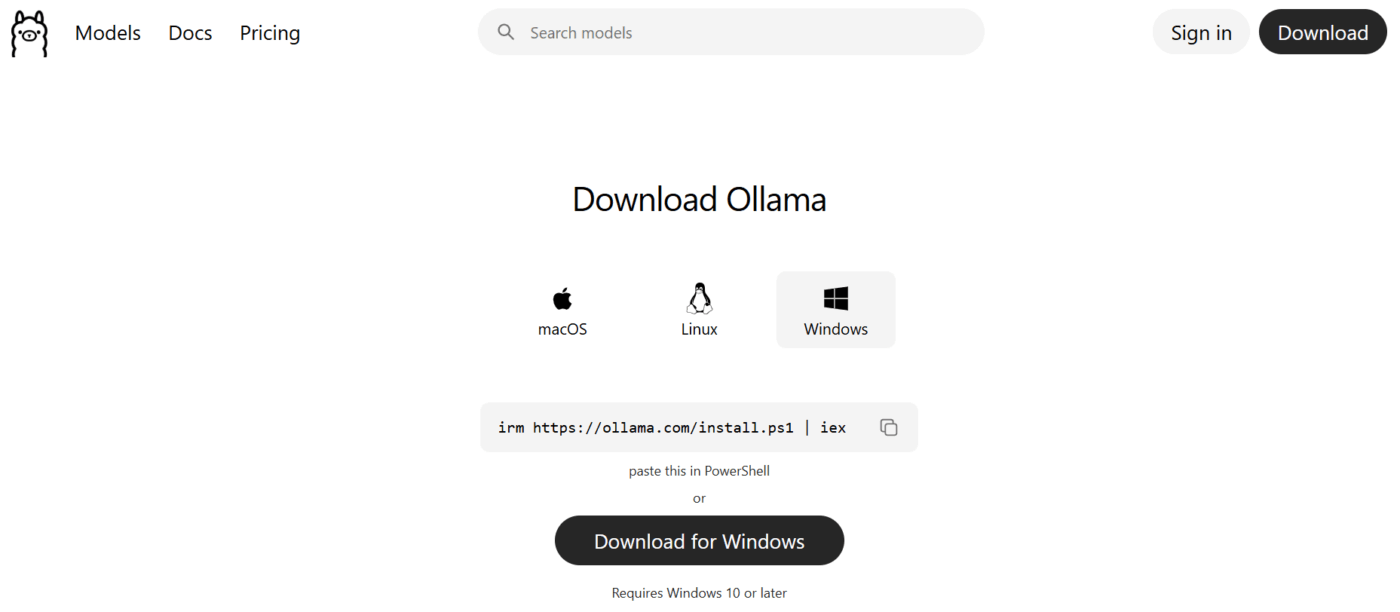

1. lépés: Telepítse az Ollamát

Töltse le a telepítőt a hivatalos weboldalról az Ön operációs rendszeréhez. Míg a korábbi Windows-verziókhoz manuálisan kellett beállítani a Linux-alrendszert, a jelenlegi verzió natív alkalmazásként települ.

A telepítés csak néhány percet vesz igénybe. A telepítés befejezése után nyissa meg a terminált vagy a parancssort, és írja be az ollama --version parancsot, hogy ellenőrizze, minden készen áll-e a használatra.

2. lépés: Töltse le és futtassa a modellt

Az AI használatának megkezdéséhez le kell töltenie a súlyait a gépre. Első tesztjéhez próbáljon ki egy kompakt, de nagy teljesítményű modellt, mint például a Llama 3.2 (3B) vagy a legújabb Mistral.

A letöltés megkezdéséhez használja az ollama run llama3. 2 parancsot.

Az internetkapcsolat sebességétől függően ez általában néhány percet vesz igénybe. A letöltés befejezése után közvetlenül beírhat egy parancsot a terminálba, hogy azonnali választ kapjon a merevlemezen található modelltől.

3. lépés: Csatlakozzon a munkafolyamat-kezelő eszközéhez

A helyi mesterséges intelligencia valódi értéke abból származik, hogy beépíti azt a napi feladataiba. Amikor az Ollama fut, automatikusan elindít egy helyi szervert a http://localhost:11434 címen. Ez biztonságos hidat hoz létre más alkalmazások számára, hogy kommunikálhassanak a modelljével.

Mivel ez a szerver kompatibilis a szabványos OpenAI protokollokkal, egyszerűen az API-cím cseréjével összekapcsolhatja automatizálási platformokkal vagy belső szkriptekkel. Például egy helyi dokumentumkereső eszközt irányíthat erre a címre. Ez lehetővé teszi a magánfájlok összefoglalását anélkül, hogy a szöveget valaha is elküldené a felhőbe.

📖 Olvassa el még: Hogyan lehet hatékonyabbá tenni a munkafolyamatok összehangolását a nagyobb hatékonyság érdekében

Biztonsági bevált gyakorlatok a helyi mesterséges intelligencia munkafolyamatokhoz

A mesterséges intelligencia helyi futtatása jelentős előrelépés az adatvédelem terén. Az adatok helyi tárolása azonban azt is jelenti, hogy mostantól Ön felelős azok védelméért. Bár kiküszöbölte a harmadik fél felhőalapú rendszerének megsértéséből fakadó kockázatot, továbbra is gondoskodnia kell a hardver biztonságáról, valamint arról, hogy csapata hogyan lép kapcsolatba a modellekkel.

Kövesse az alábbi bevált gyakorlatokat:

- Hálózati elszigetelés: Korlátozza az API-hozzáférést a megbízható belső hálózatokra, így AI-kiszolgálója nem lesz elérhető a nyilvános internetről

- Bemeneti érvényesítés: Tisztítsa meg az összes adatot, mielőtt elküldi azokat a modellnek. Ez megakadályozza a dokumentumokban vagy e-mailekben rejtett rosszindulatú utasítások végrehajtását.

- Hozzáférés-vezérlés: Vezessen be hitelesítést a mesterséges intelligencia végpontján, hogy csak az engedélyezett felhasználók indíthassák el a modell műveleteit

- Auditnaplózás: Készítsen nyilvántartást az összes modell-interakcióról, hogy segítsen a szabályozási és biztonsági vizsgálatokban

- Konténeres elszigetelés: Futtassa modelljeit olyan sandbox-környezetekben, mint a Docker. Ez megakadályozza, hogy egy esetleges biztonsági rés eljusson a rendszer alapvető fájljaihoz.

- Rendszeres frissítések: Telepítse az Ollama és hasonló eszközök legújabb javításait, hogy védve legyen az újonnan felfedezett sebezhetőségek ellen

- Sebességkorlátozás: Annak érdekében, hogy egyetlen felhasználó vagy szkript se terhelje túl a szerverét kérésekkel, vezessen be sebességkorlátozást, hogy szabályozhassa, hány lekérdezés történhet egy adott időszakban

🔎 Tudta? A prompt-alapú manipulációk már nem csupán elméleti fenyegetést jelentenek. A Gartner legutóbbi felmérése szerint a szervezetek 32%-a tapasztalt rosszindulatú prompt-támadást a mesterséges intelligencia alkalmazásai ellen az elmúlt évben. Ezek a támadások manipulálhatják a helyi modelljét, hogy elfogult vagy jogosulatlan kimenetet generáljon.

Hogyan építsen biztonságos AI-munkafolyamatokat a csapatának

Miután a helyi szerver elindult, beépítheti azt a mindennapi munkájába. Ezzel egy egyszerű eszközből magáncélú termelékenységi motor válik. A leghatékonyabb módszer erre a Retrieval-Augmented Generation (RAG) használata.

Ez a folyamat összeköti a helyi mesterséges intelligenciáját a saját fájljainak magán adatbázisával. Válaszolhat kérdésekre a vállalatára jellemző kontextus felhasználásával anélkül, hogy egyetlen bájtot is feltöltene a felhőbe.

Emellett olyan munkafolyamatokat is kialakíthat, amelyekben az AI munkáját emberi csapattagok ellenőrzik. Ez biztosítja a pontosságot, miközben jelentősen felgyorsítja a kimenetet.

Íme néhány gyakorlati példa:

- Dokumentumelemzés: Összegezze a belső jelentéseket vagy az ügyfelek visszajelzéseit, hogy azonnal ki tudja szűrni a legfontosabb információkat

- Vázlatkészítés: Készítsen e-mailek vagy projektfrissítések első verzióit, amelyeket a csapattagok finomíthatnak

- Adatbesorolás: A beérkező feladatok automatikus kategorizálása a kérés konkrét tartalma alapján

- Felkészülés a megbeszélésre: Készítsen beszélgetési témákat a helyi meghajtón tárolt kapcsolódó projektfájlok elemzésével

- Kódfelülvizsgálat: Kapjon visszajelzést a saját fejlesztésű forráskódra anélkül, hogy szellemi tulajdonát harmadik félnek tenné ki

📮ClickUp Insight: AI-érettségi felmérésünk azt mutatja, hogy a munkahelyi AI-hozzáférés még mindig korlátozott: az emberek 36%-a egyáltalán nem fér hozzá, és csak 14% mondja, hogy a legtöbb alkalmazott ténylegesen kísérletezhet vele. Amikor az AI engedélyek, extra eszközök vagy bonyolult beállítások mögött rejtőzik, a csapatoknak esélyük sincs kipróbálni a valós, mindennapi munkában.

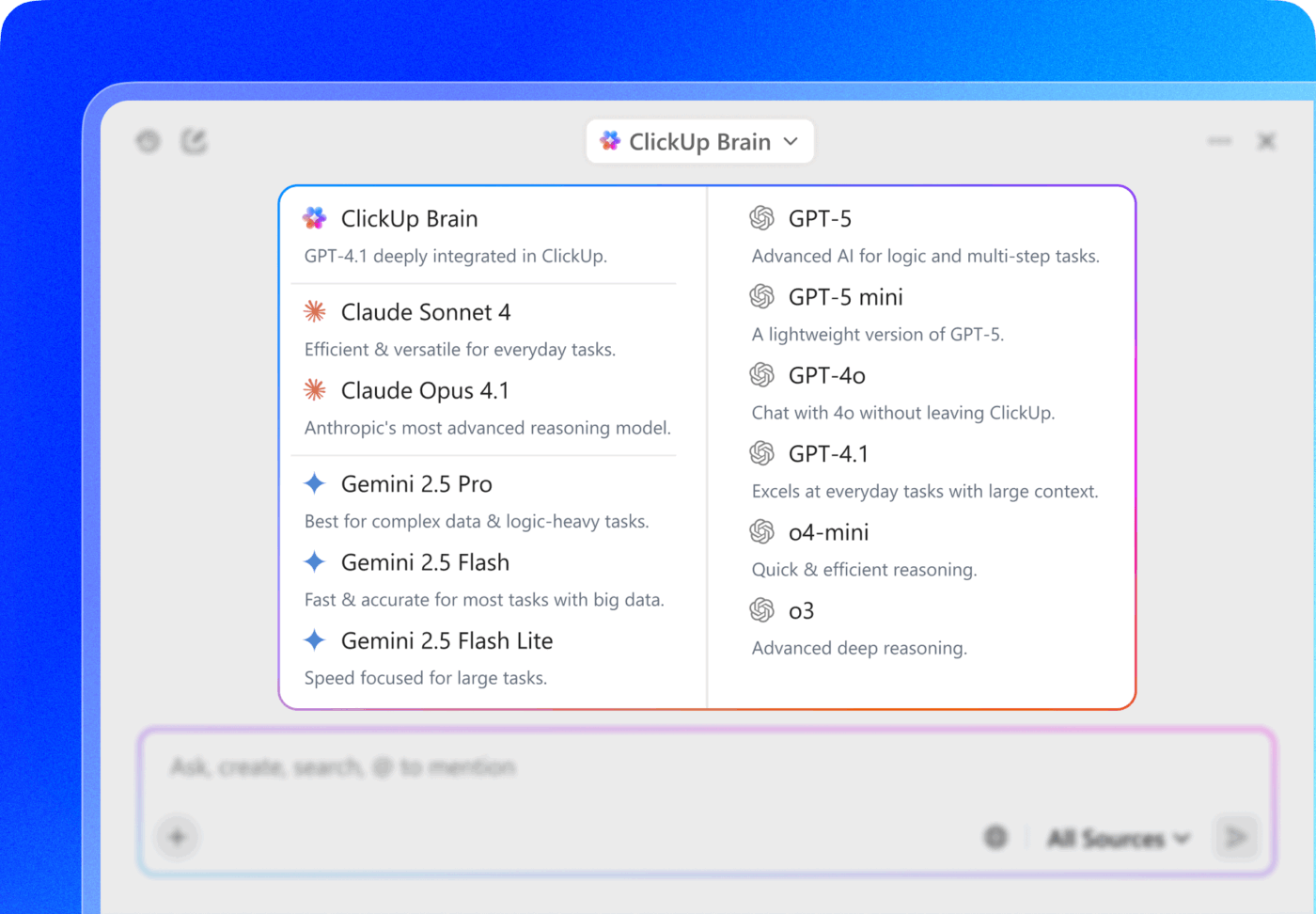

A ClickUp Brain mindezt egyszerűvé teszi azzal, hogy az AI-t közvetlenül az Ön által már használt munkaterületbe integrálja. Több AI-modellhez is hozzáférhet, képeket generálhat, kódot írhat vagy hibakeresést végezhet, az interneten kereshet, dokumentumokat összefoglalhat és még sok mást tehet – anélkül, hogy eszközt kellene váltania vagy elveszítené a koncentrációját.

Ez az Ön környezeti mesterséges intelligencia partnere, könnyen használható és a csapat minden tagja számára elérhető.

A helyi mesterséges intelligencia használatának korlátai az AI-munkafolyamatokban

A helyi mesterséges intelligencia hatékony eszköz, de nem csodaszer minden problémára. Ha megérti a korlátait, könnyebben eldöntheti, mikor érdemes egy feladatot a saját hardverén futtatni, és mikor a felhőt használni. Egyes csapatok számára a technikai és pénzügyi kompromisszumok felülmúlhatják az adatvédelmi előnyöket.

- Teljesítményhatár: A csúcskategóriás, saját fejlesztésű modellek még mindig enyhe előnyt élveznek a komplex érvelés és a kreatív árnyalatok terén az open source verziókhoz képest

- Hardverbefektetés: A nagy modellek gyors feldolgozásához drága, jelentős VRAM-mal rendelkező GPU-kra van szükség. Ez kis csapatok számára magas kezdeti költségeket jelenthet

- Karbantartási költségek: Ön felelős az összes szoftverfrissítésért, a hardveres hibaelhárításért és a biztonsági javítások telepítéséért, a szolgáltató támogató csapatának segítsége nélkül

- Technikai szakértelem: A helyi környezet optimalizálásához gyakorlati ismeretekre van szükség a modellkvantálás és a szerverkonfiguráció terén

- Biztonsági menedzsment: A felhőszolgáltatásokkal ellentétben a helyi modellek nem rendelkeznek beépített moderációs funkcióval. Saját tartalomszűrőket és védelmi intézkedéseket kell bevezetnie.

- Energiafogyasztás: A nagyméretű mesterséges intelligencia modellek futtatása a saját szervereken vagy munkaállomásokon jelentősen megnövelheti az áramfogyasztást és a hűtési igényeket

Sok csapat hibrid megközelítést alkalmaz: helyi mesterséges intelligenciát az érzékeny adatokhoz, felhőalapú mesterséges intelligenciát pedig a kevésbé érzékeny, de maximális teljesítményt igénylő feladatokhoz. Íme egy rövid áttekintés a kettő összehasonlításáról:

| Faktor | Helyi mesterséges intelligencia | Felhőalapú mesterséges intelligencia |

|---|---|---|

| Adatvédelem | Teljes ellenőrzés | A szolgáltatóhoz elküldött adatok |

| A beállítás bonyolultsága | Magasabb | Alacsonyabb |

| Folyamatos költségek | Hardver + áram | Tokenonkénti díjak |

| A modell képességei | Jó, javul | A legmodernebb |

| Karbantartás | Saját kezelt | Szolgáltató által kezelt |

Hogyan támogatja a ClickUp a biztonságos, AI-alapú munkafolyamatokat

A mai csapatok többsége egy kompromisszum előtt áll: használják-e a hatékony felhőalapú mesterséges intelligenciát, és aggódjanak-e az adatok sorsa miatt, vagy hozzanak létre helyi modelleket, és vállalják a folyamatos költségeket. A ClickUp elkerüli ezt a dilemmát azzal, hogy konvergált mesterséges intelligencia munkaterületként működik – ahol a mesterséges intelligencia már eleve része annak a rendszernek, amelyben a munkája zajlik.

A ClickUp Brain egy közvetlenül a ClickUp munkaterületébe beépített AI-réteg, amelyet úgy terveztek, hogy egy helyen értelmezze a feladatait, dokumentumait és a csapat kommunikációját. Teljes kontextusú AI-támogatást nyújt – külön eszközök és bizonytalan integrációk nélkül.

Azok számára, akik biztonságos AI-munkafolyamatokat szeretnének kialakítani, ez a kontextus és az ellenőrzés kombinációja jelenti a különbséget a kísérletezés és a valódi bevezetés között.

🌟 A ClickUp emellett SOC 2-kompatibilis, és betartja az ISO 42001 szabványokat a felelősségteljes AI-kezelés terén. Ez biztosítja, hogy adatait soha ne használják fel harmadik felek modelljeinek betanítására, így ugyanolyan bizalommal automatizálhatja munkáját, mint egy helyszíni telepítés esetén.

Hozzáférés a keresési és autonóm munkafolyamatokhoz a ClickUp Brain segítségével

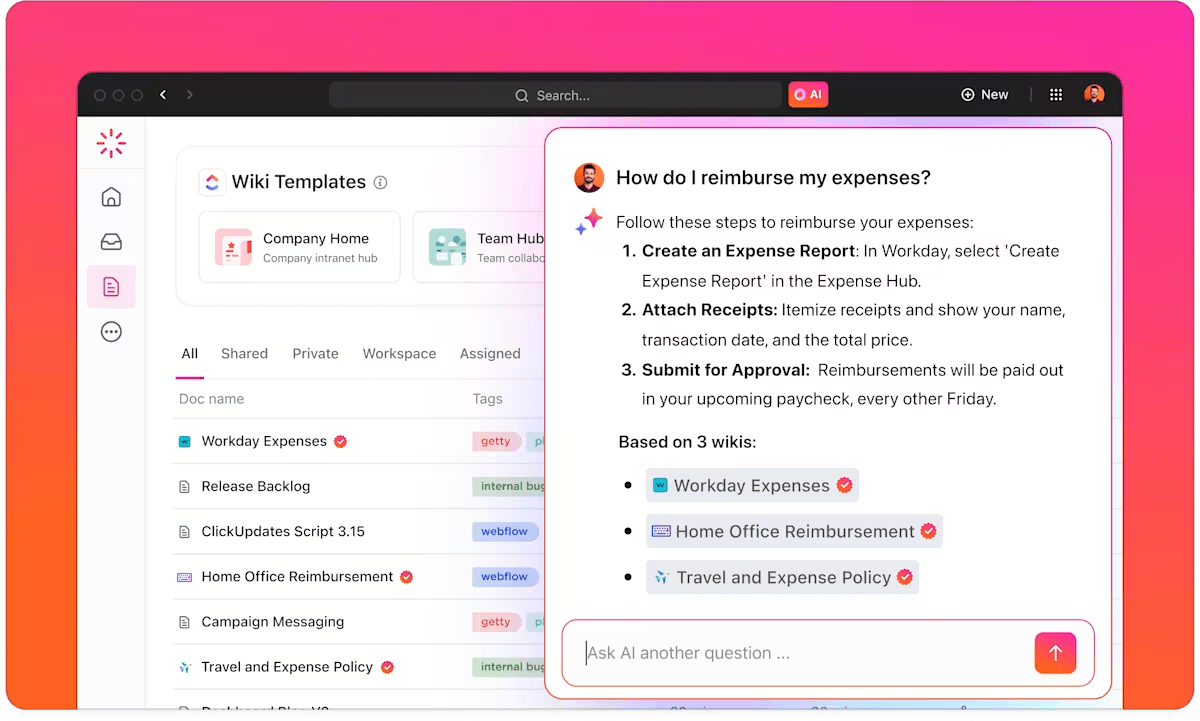

Miután adatai biztonságban vannak a munkaterületen, a ClickUp Brain valós időben kiaknázza a feladatok és dokumentumok értékét.

Mivel a mesterséges intelligencia beágyazott, elkerüli azt a kontextusbeli hiányosságot, amely lassítja a helyi beállításokat. Olyan kérdéseket tehet fel neki, amelyek pontos megválaszolásához a projekt teljes történetére van szükség:

- Határozza meg a végső döntéseket egy hosszú műszaki összefoglalóból anélkül, hogy végig kellene görgetnie a különböző verziókat

- Tervezzen felérdekelt felek számára szóló frissítéseket a feladatmegjegyzések és az állapotváltozások alapján

A ClickUp Brain a munkaterületén található adatokra alapozva generál válaszokat, elemezve a Dokumentumok, feladatok és csevegések konkrét tartalmát. Ez biztosítja, hogy a projekt fejlődésével az AI mindig a legfrissebb kontextussal rendelkezzen.

Így csapata a projekt előzményeinek manuális ismételt elmagyarázása vagy az adatok egymástól független eszközök közötti áthelyezése nélkül építhet a megszerzett ismeretekre.

💡Profi tipp: Az Enterprise AI Search segítségével még tovább bővítheti munkaterületének kontextusát, és információkat gyűjthet az összes külső eszközéből.

Például tegyen fel egy mélyreható kérdést, például: „Mutasd meg az összes folyamatban lévő nyitott ügyletet!”, és a ClickUp Brain átkutatja a csatlakoztatott alkalmazásait, beleértve a Slacket, a Google Drive-ot és a Gmailt, hogy hivatkozásokkal ellátott, valós idejű, megbízható választ adjon.

Ezzel a több platformon szétszórt adatok egyetlen, kereshető intelligencia-réteggé alakulnak, ahol bármilyen fájlt, üzenetet vagy feladatot megtalálhat anélkül, hogy elhagyná a munkaterületét.

Feladatok intelligens kezelése automatizálással és mesterséges intelligenciával

A ClickUp Brain nem csupán passzívan segít, hanem aktívan működik a feladatrendszerén belül. Képes:

- Feladatok létrehozása értekezletek jegyzetéből vagy a Docs-ból

- Bontsa le a nagy volumenű feladatokat alfeladatokra

- Javasoljon feladatgazdákat a korábbi tevékenységek alapján

- Javasoljon határidőket a projekt kontextusa alapján

Emellett frissítheti a feladatok állapotát, összefoglalhatja a hosszú megjegyzésszálakat világos következő lépésekre, és jelölheti a gátló tényezőket, mielőtt azok lelassítanák a végrehajtást.

A ClickUp Automation szolgáltatással párosítva ez egy zárt hurkú rendszerré válik: az AI a munkaterületen belüli változások alapján indíthat el munkafolyamatokat (például feladatok kiosztása, az érintettek értesítése vagy a prioritások frissítése).

Például amikor egy dokumentum véglegesítésre kerül, a feladatok automatikusan létrehozhatók és kioszthatók anélkül, hogy bárkinek manuálisan kellene adatokat mozgatnia az eszközök között.

💟 Bónusz: Tegye a ClickUp Brain MAX-ot a „döntési memóriájává”.

Használja a következőkre:

- Összegezze a hosszú kommentfolyamokat világos döntésekre és következő lépésekre

- A fontosabb mérföldkövek után frissítse a dokumentumokat azzal, hogy „mi változott és miért”.

- Heti döntési naplók létrehozása feladatok, értekezletek és frissítések alapján

Idővel ez egy élő intézményi tudásréteget hoz létre, amelyre a Brain MAX hivatkozhat. Így ahelyett, hogy elszigetelten válaszolna a kérdésekre, a korábbi döntések, prioritások és minták ismeretében kezd el reagálni.

Ekkor válik az AI a hasznosból megbízhatóvá – különösen a biztonságos AI-munkafolyamatokban, ahol a kontextus és a nyomon követhetőség fontos.

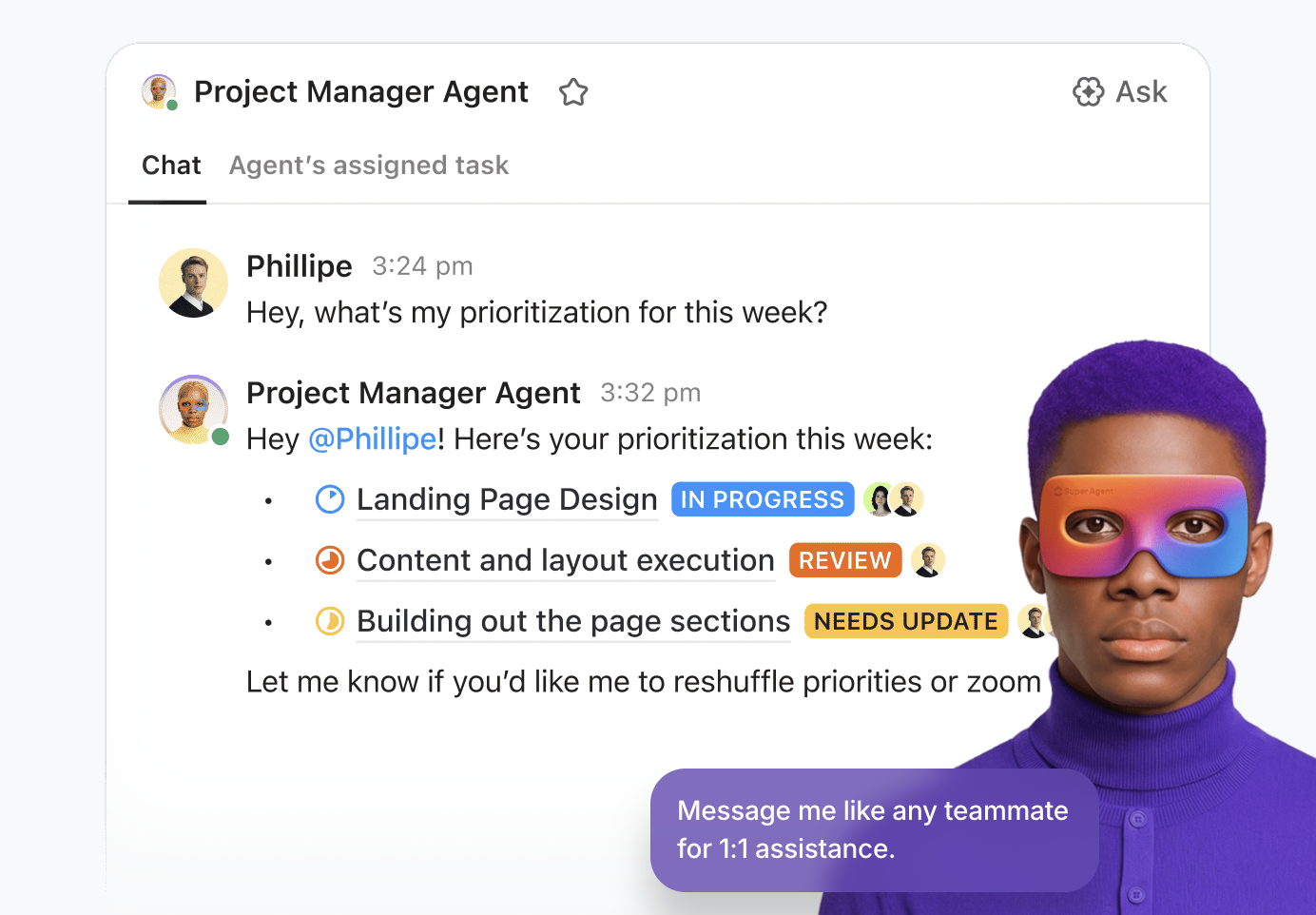

Biztonságos, kontextusérzékeny végrehajtás nagy léptékben a Super Agents segítségével

A ClickUp Super Agents egy lépéssel továbbviszi a ClickUp Brain-t – a munka segítésétől annak aktív irányításáig. Ezek az ügynökök úgy konfigurálhatók, hogy előre meghatározott szabályok és valós idejű kontextus alapján figyeljék a munkafolyamatokat, intézkedéseket hajtsanak végre és koordinálják a feladatokat a munkaterületén.

Például egy Super Agent képes:

- Figyelje a beérkező kéréseket vagy dokumentumokat, és automatikusan alakítsa át őket strukturált feladatokká, tulajdonosokkal és határidőkkel

- Kövesse nyomon a projekt előrehaladását, és jelölje meg a kockázatokat vagy a késedelmeket, mielőtt azok súlyosbodnának

- Indítson el több lépésből álló automatizálásokat, ha a feltételek teljesülnek – például értesítse az érintetteket, frissítse a prioritásokat vagy hozzon létre nyomon követési feladatokat

Ezek az ügynökök teljes egészében a ClickUp egységes munkaterületén belül futnak, teljes körűen ismerve a feladatait, a dokumentumait és a jogosultsági struktúrát. Ez azt jelenti, hogy:

- Nem kell adatokat exportálnia külső AI-rendszerekbe vagy koordinációs eszközökbe

- Csak azokhoz az adatokhoz férnek hozzá, amelyek megtekintésére jogosultak

- Ugyanazon engedélyhatárokon belül működnek, mint a csapata

Tudjon meg többet a Super Agents használatáról:

Használja ki a dokumentumokban elérhető AI-támogatás előnyeit

A ClickUp Docs segítségével az AI-támogatás közvetlenül beépül a dokumentációs munkafolyamatokba. A csapatok projektleírásokat készíthetnek, hosszú jelentéseket foglalhatnak össze, teendőket emelhetnek ki, vagy átírhatják a tartalmat különböző célközönségek számára – mindezt anélkül, hogy elhagynák a platformot.

Ez a biztonságos AI-munkafolyamatok szempontjából fontos, mivel az egyik legnagyobb kockázatot az érzékeny információk másolása és beillesztése külső eszközökbe jelenti. A ClickUpban minimalizálhatja az adatmozgást, és a jogosultságok segítségével teljes ellenőrzést gyakorolhat a hozzáférés felett.

Végső ítélet: Saját magán AI-stack felépítése

A helyi mesterséges intelligencia kihasználja a mesterséges intelligencia előnyeit, miközben teljes ellenőrzést biztosít az adatvédelem és a szabályozási előírások betartása felett. Ez az út azonban jelentős beruházást igényel a hardver, a technikai beállítások és a folyamatos karbantartás terén.

A biztonsági gyakorlatok továbbra is kritikus fontosságúak, függetlenül attól, hogy helyi vagy felhőalapú mesterséges intelligenciát használ. A leghatékonyabb stratégia gyakran egy hibrid megközelítést jelent: a legérzékenyebb műveletekhez helyi mesterséges intelligenciát használ, míg a mindennapi termelékenységhez felügyelt, biztonságos megoldásokat alkalmaz.

Fontos figyelembe venni a kompromisszumokat – sok csapat számára a saját kezűleg összeállított megoldás többletköltségei miatt ez nem feltétlenül a legjobb választás.

Azok számára, akik hatékony AI-termelékenységet szeretnének az infrastruktúra terhe nélkül, a ClickUp Brainhez hasonló felügyelt megoldások vonzó középútat kínálnak. Vállalati szintű biztonságot nyújt, a beállítás pedig egyáltalán nem bonyolult.

Kezdje el ingyenesen használni a ClickUp-ot, és fedezze fel a csapatának szóló, biztonságos, kontextusfüggő, AI-alapú munkafolyamatokat.

Gyakran ismételt kérdések

Mi a különbség a helyi és a felhőalapú mesterséges intelligencia között a csapat munkafolyamatai szempontjából?

A helyi mesterséges intelligencia teljes egészében a saját hardverén fut, így biztosítva, hogy az adatok soha ne hagyják el a belső hálózatot, míg a felhőalapú mesterséges intelligencia feldolgozás céljából parancsokat küld harmadik fél szerverére. A helyi beállítások teljes adatszabadságot és offline hozzáférést biztosítanak, míg a felhőszolgáltatások nagyobb számítási teljesítményt és könnyű használatot kínálnak, cserébe az adatok közvetlen ellenőrzésének feladásáért.

Hogyan használhatják a csapatok a helyi AI-modelleket bizalmas projektadatokkal?

A csapatok a helyi mesterséges intelligenciát felhasználva feldolgozhatják az érzékeny dokumentumokat, a saját fejlesztésű kódokat és a pénzügyi nyilvántartásokat úgy, hogy a modellt a helyszíni magánkönyvtárakra irányítják. Mivel a következtetés a készüléken történik, olyan feladatokat hajthat végre, mint az automatizált összefoglalás, az adatkinyerés és a belső tudáskeresés anélkül, hogy kockáztatná a nyilvános LLM-edzéskészletekhez való hozzáférést.

A helyi AI-modellek ugyanolyan hatékonyak a munkavégzésben, mint a ChatGPT?

Számos nyílt forráskódú helyi modell, például a Llama 3 és a Mistral, ma már kiválóan képes kezelni a rutin feladatokat, mint például a vázlatkészítés, a kódolás és az összefoglalás. Míg a csúcskategóriás felhőalapú modellek, mint a GPT-4o, továbbra is vezető szerepet töltenek be az ultrakomplex gondolkodás terén, a helyi modellek a napi üzleti műveletek 90%-ában hasonló teljesítményt nyújtanak, jelentősen jobb adatvédelem mellett.

Milyen előnyökkel és hátrányokkal jár a mesterséges intelligencia helyi futtatása a felhőalapú szolgáltatások használatához képest?

A legfontosabb kompromisszum a teljes adatvédelem és a helyi AI, illetve a karbantartást nem igénylő, skálázható felhőalapú AI közötti választás. A helyi AI futtatása előzetes hardverberuházást és technikai szakértelmet igényel, de kiküszöböli az ismétlődő API-díjakat és az adatszivárgás kockázatát. A felhőalapú AI gyorsabban telepíthető, de folyamatos előfizetési költségekkel és harmadik féltől származó adatfüggőséggel jár.