De flesta utvecklare kan få Gemini API att fungera på mindre än 10 minuter.

Den verkliga utmaningen kommer efter installationen.

Den här guiden visar hur du får din API-nyckel, installerar SDK och gör din första förfrågan.

Du lär dig också hur du håller ordning på dina API-arbetsflöden så att ditt team inte slösar tid på att uppfinna nya lösningar eller söka efter dokumentation.

Vad är Gemini API?

Gemini API är Googles gränssnitt för åtkomst till dess familj av multimodala AI-modeller, vilket gör det möjligt för utvecklare att integrera textgenerering, bildförståelse, kodassistans och konversations-AI i applikationer.

Det är utformat för produktteam, ingenjörer och företag som vill lägga till kraftfulla AI-funktioner till sina produkter utan att bygga stora språkmodeller från grunden.

Geminis stora språkmodeller, som Gemini 3 Flash och Gemini 3 Pro, är multimodala, vilket innebär att de kan hantera flera typer av indata, inklusive text, bilder, ljud och video. API:et i sig använder REST API-arkitektur , vilket är ett standardiserat sätt för datorsystem att kommunicera över internet.

För att göra det ännu enklare tillhandahåller Google Software Development Kits (SDK) för populära språk som Python, JavaScript och Go. Det är bra att förstå skillnaden mellan API och Google AI Studio.

| Primär användning | Produktionsapplikationer | Prototyputveckling och testning |

| Åtkomstmetod | Kodbaserade SDK-anrop | Webbaserat visuellt gränssnitt |

| Bäst för | Utvecklare som bygger appar | Experimentera med uppmaningar |

💡Proffstips: Samla all projektinformation på ett ställe och slipp leta efter information i olika verktyg genom att skapa en intern kunskapsbas för dina AI-projekt. Med ClickUp Docs kan du länka kodsnuttar och API-dokumentation direkt till ditt teams uppgifter, vilket eliminerar verktygsspridning och påskyndar AI-implementeringen.

Så här får du din Gemini API-nyckel

Ditt team kanske är redo att börja bygga, men först behöver du en API-nyckel.

För att kunna använda Gemini API behöver du en nyckel för att autentisera dina förfrågningar, och hanteringen av dessa nycklar är det första steget mot en smidigare arbetsflödeshantering. Du behöver ett Google-konto för att komma igång.

Så här får du din nyckel:

- Navigera till Google AI Studio

- Logga in med ditt Google-konto

- Klicka på Hämta API-nyckel i vänster sidfält.

- Välj Skapa API-nyckel i ett nytt projekt eller välj ett befintligt Google Cloud-projekt.

- Kopiera din genererade nyckel omedelbart och förvara den på en säker plats.

Din API-nyckel ger dig tillgång till din Gemini-kvot och fakturering – behandla den som ett lösenord. 🔑

Din API-nyckel ger dig tillgång till din Gemini-kvot och fakturering – behandla den som ett lösenord. 🔑

För större team kan du också hantera nycklar via Google Cloud Console, som erbjuder mer avancerade kontroller.

Hur man installerar Gemini SDK

En ny utvecklare ansluter sig till ditt AI-projekt, men tillbringar sin första dag med att brottas med miljöinställningar istället för att skriva kod.

Deras Python-version är felaktig, eller så saknar de en beroende, vilket leder till det klassiska problemet ”det fungerar på min maskin”.

Detta är ofta anledningen till att utvecklare förlorar 3 timmar per vecka. Sådana inkonsekvenser saktar ner onboarding och introducerar oförutsägbara buggar som slösar bort värdefull utvecklingstid.

Ett SDK, eller Software Development Kit, förenklar dessa API-interaktioner genom att hantera autentisering, formatering av förfrågningar och analys av svar åt dig. För att undvika installationsproblem behöver ditt team en standardiserad, dokumenterad process för installation av Gemini SDK.

Så här installerar du det för de vanligaste miljöerna.

För Python:

- Obs: Du behöver Python 3. 9 eller nyare. Det är bäst att använda en virtuell miljö för att undvika konflikter med andra projekt.

För JavaScript/Node. js:

- Obs: Detta är avsett för användning i en Node.js-miljö.

Efter installationen måste du konfigurera din API-nyckel som en miljövariabel. Detta håller din nyckel säker och borta från din källkod.

- På Mac/Linux: exportera GEMINI_API_KEY="din-api-nyckel-här"

- I Windows: setx GEMINI_API_KEY "din-api-nyckel-här"

Du har flera alternativ när det gäller vilket SDK du ska använda:

- Python SDK: Det mest populära valet, med omfattande dokumentation. Det är idealiskt för datavetenskap och backend-applikationer.

- JavaScript SDK: Det bästa alternativet för att bygga webbapplikationer och Node.js-backends.

- Go SDK: Ett utmärkt val för utvecklare som bygger högpresterande mikrotjänster i Go.

- REST API: Om du använder ett språk utan officiellt SDK kan du alltid göra direkta HTTP-förfrågningar till REST API.

💡Proffstips: Standardisera din utvecklingsmiljö och påskynda onboarding genom att skapa en checklista som alla nya teammedlemmar kan följa. Spara den som en mall i ClickUp Tasks, så att alla som stöter på problem kan använda ClickUp Brain för att få svar från teamets dokumentation. Här är en snabbguide:

Hur du gör din första Gemini API-förfrågan

Ditt team gör äntligen API-anrop, men varje utvecklare får lista ut det på egen hand.

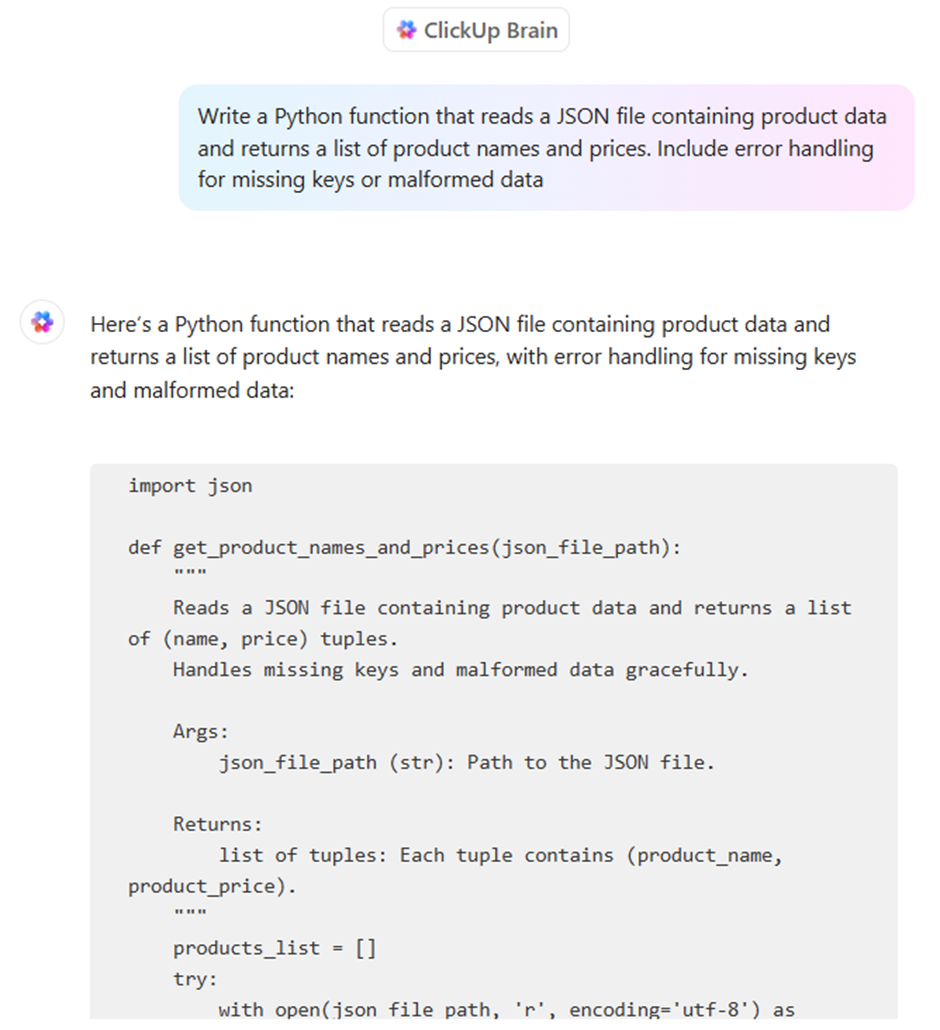

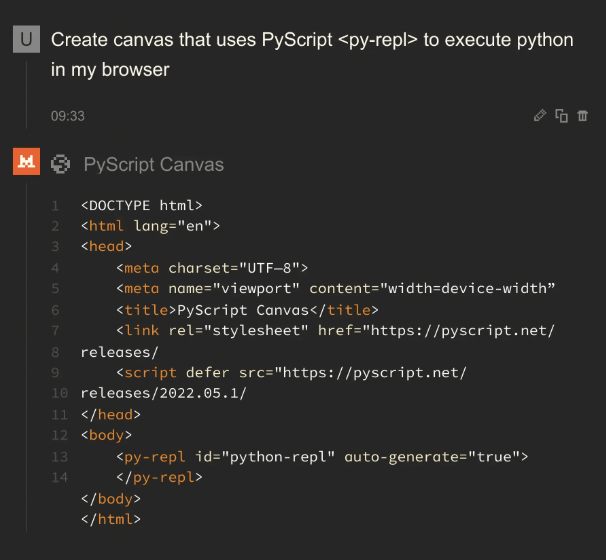

Ett framgångsrikt API-anrop är enkelt: du skickar en prompt till en Gemini-modell och får ett svar.

Den verkliga utmaningen är att göra processen repeterbar och skalbar för hela teamet. Här är några exempel på hur du gör din första förfrågan.

Python-exempel

Denna kod skickar en enkel textprompt till Gemini API och skriver ut svaret.

Låt oss bryta ner det:

- Importera och konfigurera: Detta laddar Google-biblioteket och konfigurerar autentisering med hjälp av den API-nyckel du konfigurerade tidigare.

- Initialisera modell: Här anger du vilken specifik Gemini-modell som ska användas. Gemini 3 Flash är optimerad för snabba uppgifter med stora volymer, medan Gemini 3 Pro är utformad för djupgående resonemang och komplexa arbetsflöden i flera steg.

- Generera innehåll: Detta är åtgärden. Du skickar din fråga till modellen.

- Åtkomst till utdata: Modellens svar lagras i svarsobjektet, och du kan komma åt texten med response. text.

JavaScript-exempel

Om du arbetar i en Node.js-miljö är processen liknande, men använder JavaScripts async/await-syntax.

Exempel på REST API

Om du inte använder Python eller JavaScript kan du alltid kommunicera direkt med API:et med hjälp av ett curl-kommando. Detta är utmärkt för snabba tester eller för användning i språk utan ett dedikerat SDK.

Detta kommando skickar en HTTP-begäran till API-slutpunkten och returnerar svaret som ett JSON-objekt.

Gör det enkelt för ditt team att hitta och återanvända framgångsrika kodsnuttar och uppmaningar genom att skapa ett gemensamt bibliotek.

Vad kan du bygga med Gemini API?

Gemini API är otroligt mångsidigt. Här är några saker du kan bygga:

- Verktyg för innehållsgenerering: Automatisera bloggutkast, inlägg på sociala medier och marknadsföringstexter.

- Chatbots och virtuella assistenter: Skapa konversationsgränssnitt för kundsupport eller interna helpdesks.

- Kodassistans: Generera kodsnuttar, förklara komplexa funktioner och hjälp till att felsöka fel.

- Hjälpmedel för dataanalys: Sammanfatta komplexa rapporter och extrahera viktiga insikter från ostrukturerad text.

- Multimodala applikationer: Analysera bilder eller bearbeta videoinnehåll för att göra det sökbart.

- Dokumenthantering: Extrahera information från PDF-filer och översätt dokument till olika språk.

Bygga agentiska arbetsflöden med Gemini

Till skillnad från en vanlig chatbot som svarar på frågor linjärt, gör ett agentiskt arbetsflöde i Gemini det möjligt för modellen att uppfatta ett mål, resonera sig fram till en plan och utföra en serie autonoma åtgärder i externa verktyg.

Denna ”agentiska” förändring drivs av tre kärnfunktioner i Gemini 3-ekosystemet:

- Inbyggt "tänkande" läge: Med parametern thinking_level kan du nu växla mellan "låg" för hastighet och "hög" för komplexa uppgifter. I högt resonemangsläge genererar Gemini 3 Pro dolda "tanketoken" för att validera sin egen logik innan den ger ett svar, vilket drastiskt minskar hallucinationer.

- Tankesignaturer: För att förhindra ”resonemangsavvikelser” i uppgifter med flera steg utfärdar API:et nu krypterade tankesignaturer. Utvecklare måste skicka tillbaka dessa signaturer i konversationshistoriken för att säkerställa att agenten behåller sin exakta tankegång över olika API-anrop och verktygsutföranden.

- Model Context Protocol (MCP): Gemini använder nu branschstandarden MCP för att ansluta till verktyg. Detta gör att din agent omedelbart kan "ansluta" till dina befintliga databaser, Slack eller GitHub utan att du behöver skriva anpassad integrationskod för varje enskild funktion.

📮 ClickUp Insight: Team med låg prestanda är fyra gånger mer benägna att jonglera med mer än 15 verktyg, medan team med hög prestanda upprätthåller effektiviteten genom att begränsa sin verktygslåda till nio eller färre plattformar.

Men vad sägs om att använda en enda plattform för allt detta?

ClickUp samlar dina uppgifter, projekt, dokument, wikis, chattar och samtal på en enda plattform, komplett med AI-drivna arbetsflöden. Är du redo att arbeta smartare? ClickUp fungerar för alla team, gör arbetet synligt och låter dig fokusera på det som är viktigt medan AI sköter resten.

Python-exempel: Bygga en forskningsagent

Detta utdrag visar hur man initialiserar en agent med hög resonemangsförmåga som upprätthåller en ihållande ”tankegång” via det senaste Gemini SDK.

📖 Läs mer: Hur du använder en chatbot för ditt företag

Hur du håller din Gemini API-nyckel säker

Ditt team levererar funktioner, men dina säkerhetsrutiner är en eftertanke.

API-nycklar lämnas ibland kvar i koden – vilket bidrog till att 23,7 miljoner hemligheter läckte ut till offentliga GitHub 2024 – och det finns ingen formell process för att rotera dem. Detta gör din organisation sårbar för obehörig användning, vilket kan leda till oväntade räkningar och allvarliga säkerhetsöverträdelser.

En reaktiv inställning till säkerhet är ett recept på katastrof. Du behöver ett proaktivt kunskapshanteringssystem för att hantera inloggningsuppgifter och skydda dina applikationer och ditt företags data.

Här är de viktigaste bästa metoderna för att hålla din Gemini API-nyckel säker:

- Använd miljövariabler: Skriv aldrig in nycklar direkt i din källkod. Lagra dem i .env-filer eller systemmiljövariabler.

- Lägg till. env till din. gitignore: Detta enkla steg förhindrar att du av misstag lägger in dina hemliga nycklar i ett offentligt kodarkiv.

- Rotera nycklar regelbundet: Generera regelbundet nya nycklar i Google Cloud Console och inaktivera de gamla.

- Implementera åtkomstkontroller: Använd Google Clouds Identity and Access Management (IAM) för att begränsa vilka i ditt team som kan visa eller hantera API-nycklar.

- Övervaka användningen: Håll ett öga på API-användningspanelen i Google Cloud Console för att upptäcka ovanlig aktivitet som kan tyda på en säkerhetsöverträdelse.

- Använd separata nycklar för olika miljöer: Ha olika nycklar för dina utvecklings-, test- och produktionsmiljöer för att begränsa skadeomfånget vid en eventuell läcka.

Gemini-prissättning

- Gemini 3 Flash: ~0,50 USD per 1 miljon inmatningar / 3,00 USD per 1 miljon utmatningar

- Gemini 3 Pro: ~2,00 $ per 1 miljon inmatningar / 12,00 $ per 1 miljon utmatningar (för sammanhang under 200 000)

- Sökgrund: Observera att Google nu tar ut 14 dollar per 1 000 sökfrågor för grundning när du överskrider den kostnadsfria månatliga kvoten (5 000 frågor).

Begränsningar vid användning av Gemini API

Din applikation är live, men du stöter på oväntade problem.

API:et är långsammare än du förväntade dig under rusningstid, eller så ger det inkonsekventa svar som förvirrar användarna.

Att förstå API:ets begränsningar är det första steget; att dokumentera dina lösningar är det som hjälper dig att skala effektivt.

Var medveten om dessa vanliga begränsningar:

- Begränsningar: Den kostnadsfria versionen har begränsningar för antal förfrågningar per minut och tokens per dag, vilket kan orsaka flaskhalsar för applikationer med hög volym.

- Variationer i latens: Svarstiderna kan variera beroende på komplexiteten i din prompt och den totala serverbelastningen.

- Begränsningar i kontextfönstret: Varje modell har ett maximalt antal token (ord och orddelar) som den kan bearbeta i en enda begäran, vilket kan vara en utmaning när man sammanfattar mycket långa dokument.

- Regional tillgänglighet: Vissa modeller eller funktioner kanske inte är tillgängliga i alla geografiska regioner.

- Konsekvens i resultatet: Generativ AI kan ge något olika resultat även för samma prompt, vilket kan kräva att du bygger in valideringssteg i ditt arbetsflöde.

- Inga realtidsdata: Modellerna uppdateras inte i realtid, så de kan inte ge information om mycket aktuella händelser.

Gemini API är ett multimodalt kraftpaket, men för att bygga en produktionsklar applikation krävs ofta en multimodellstrategi. Beroende på ditt projekts specifika behov av resonemangsdjup eller kodningsnoggrannhet kan du titta på dessa Gemini-alternativ.

De flesta AI-verktyg lovar att underlätta utvecklingen, men ofta blir de bara ytterligare en flik i en redan överfull stapel. Du kanske använder Gemini API för att driva din apps backend, ett separat verktyg för att sammanfatta mötesanteckningar och en tredje plattform för att hantera dina sprintuppgifter. Detta nätverk av spridda sammanhang och isolerade verktyg är ”AI-spridning”.

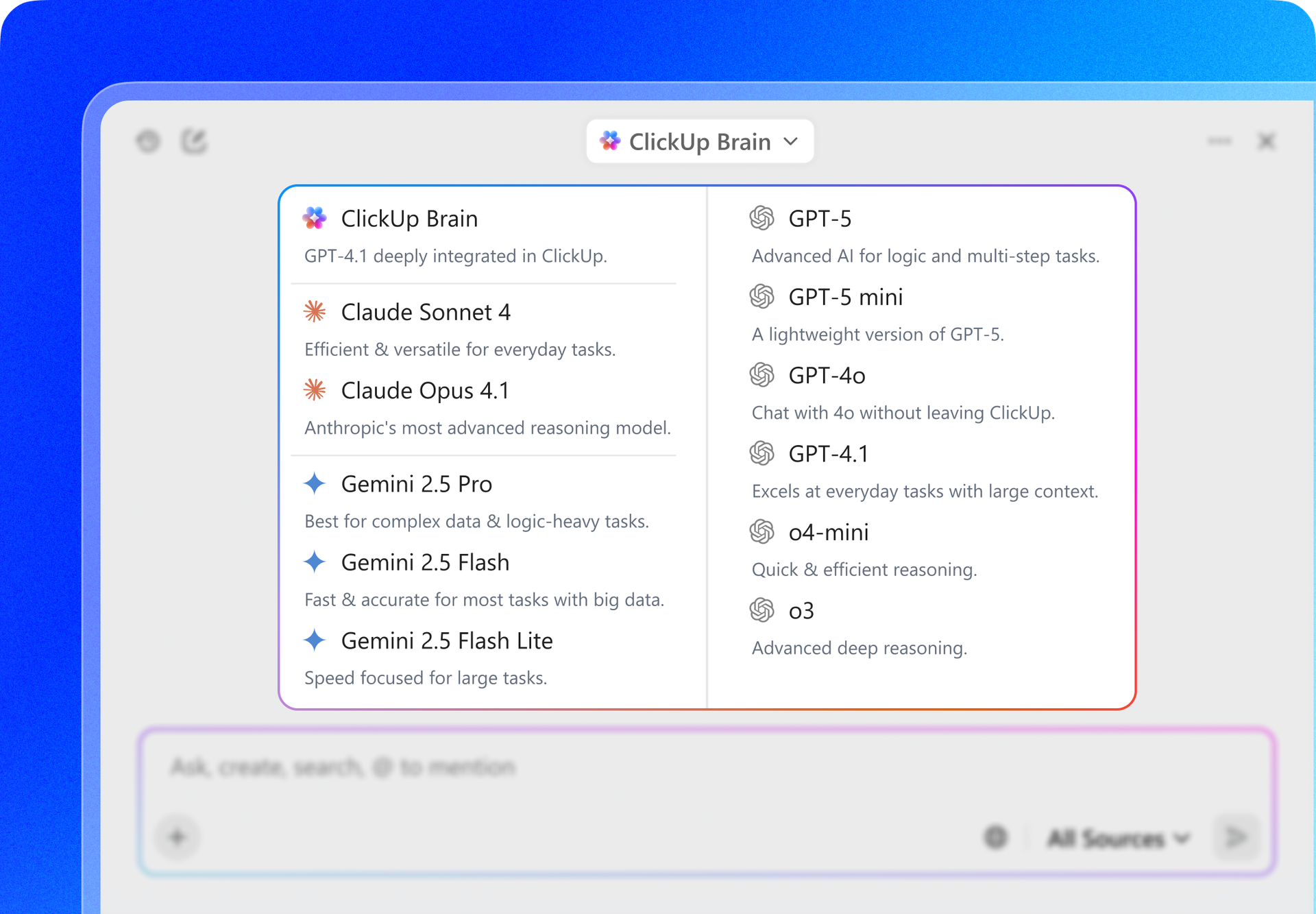

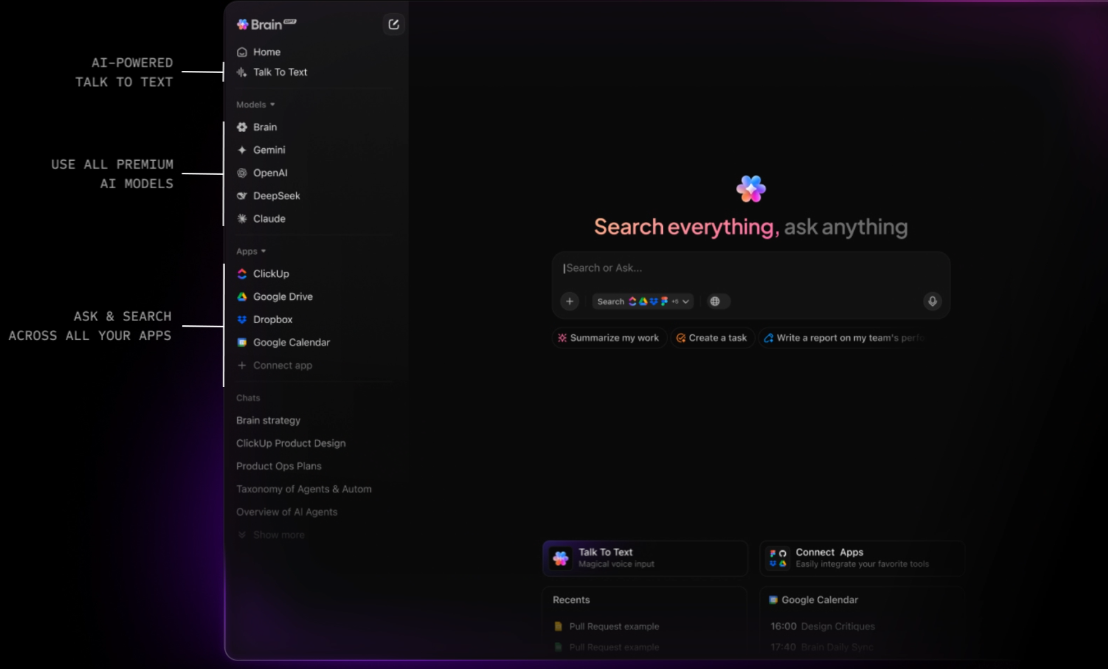

ClickUp är den första konvergerade AI-arbetsytan som kopplar samman dina uppgifter, dokument och medarbetare med ett centralt intelligenslager. Till skillnad från fristående API:er som kräver att du bygger egna system för kontextåtervinning (RAG) känner ClickUp Brain redan till allt i din arbetsyta.

Eftersom AI är integrerat från början genererar det inte bara text – det förstår också relationen mellan din Gemini API-dokumentation, dina projektdeadlines och ditt teams framsteg i realtid.

Aktivera ”Ask AI” var som helst och distribuera autonoma agenter

Den verkliga kraften i ClickUp ligger i dess förmåga att omvandla kunskap till handling. Med Brain Assistant kan du "fråga AI" var som helst i din arbetsmiljö – eller till och med via en desktop-kompanjon medan du skriver kod i din IDE. Du kan omedelbart upptäcka projektrisker genom att fråga: "Vad var feedbacken på den senaste Gemini 3 Pro-implementeringen?" ClickUp Brain kommer att göra en djupgående sökning i hela din historik och ge ett citerat svar med länkar till den exakta uppgiften eller kommentartråden där diskussionen ägde rum.

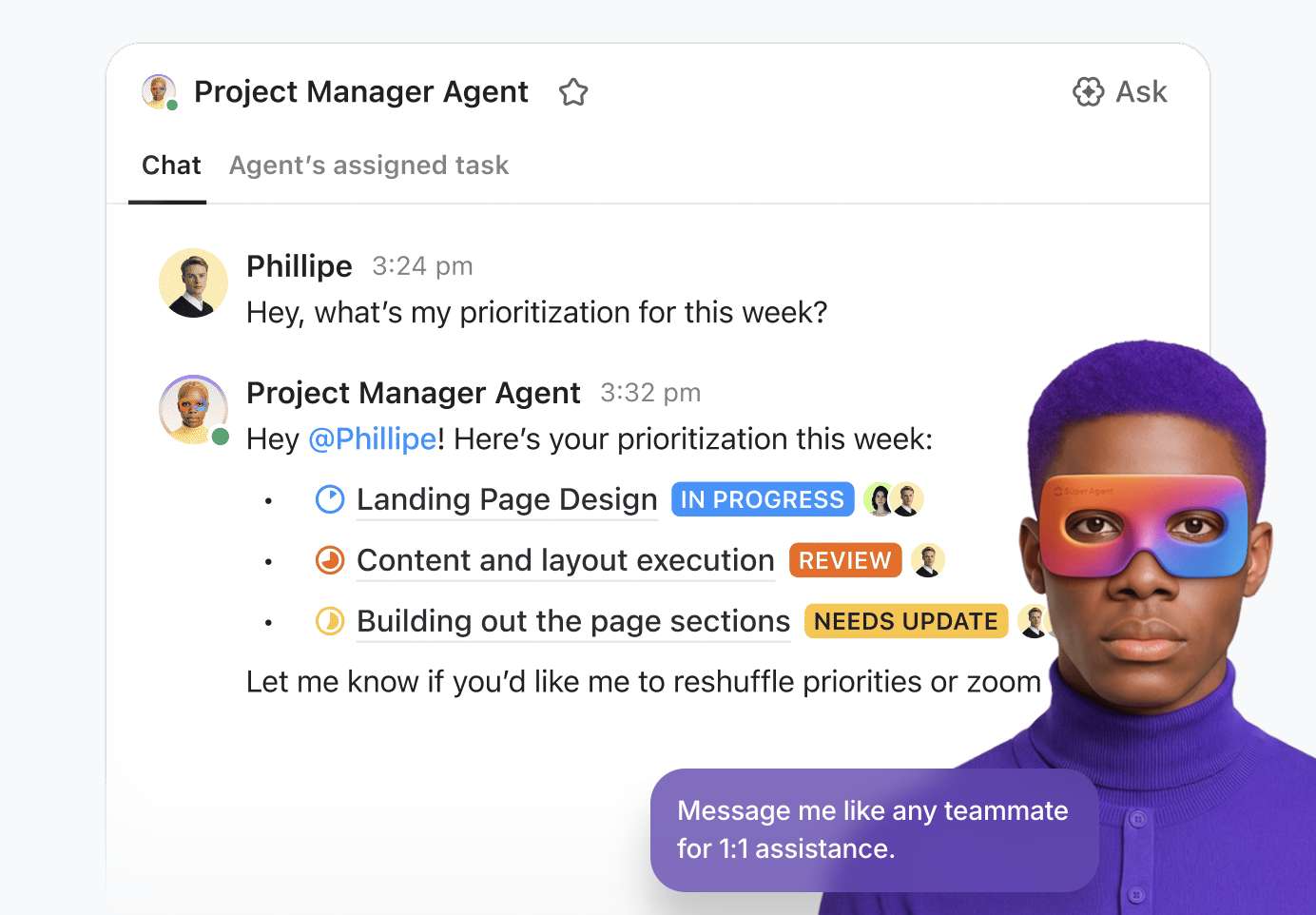

För team som bygger komplexa AI-produkter går ClickUp utöver enkel assistans genom att låta dig distribuera Super Agents . Dessa är kodfria, autonoma digitala teammedlemmar som hanterar det "busywork" som ingår i din utvecklingscykel. Du kan ställa in en Triage Agent för att övervaka inkommande buggar från din Gemini-integration, eller en Project Manager Agent som proaktivt identifierar sprintblockerare och genererar dagliga standup-sammanfattningar baserade på ditt teams aktivitet. Det är ett intelligent system som håller din utvecklingspipeline igång dygnet runt.

En enhetlig arbetshanteringsplattform för den moderna utvecklaren

ClickUp Docs fungerar som ditt teams gemensamma tekniska anteckningsbok. Oavsett om du utarbetar en PRD för en ny multimodal funktion eller lagrar dina Gemini API-säkerhetsprotokoll, förblir allt sammankopplat.

En kodrad i ett dokument kan omedelbart bli en uppgift, och ClickUp Brain låter dig utnyttja Enterprise Search för att hämta filer och konversationer från anslutna appar som Google Workspace, GitHub och Figma med hjälp av semantisk sökning.

Dessutom erbjuder ClickUp flexibilitet för flera modeller. Medan du bygger med Gemini API kan du använda ClickUps gränssnitt för att växla mellan Gemini 3, GPT-5. 2 och Claude 4. 5 för att jämföra resultat eller utkast till tekniska specifikationer. Detta säkerställer att du alltid har den bästa "hjärnan" för uppgiften utan att någonsin behöva lämna din projektledningsmiljö.

ClickUps bästa funktioner

Begränsningar för ClickUp

Priser för ClickUp

Betyg och recensioner av ClickUp

Vad säger verkliga användare om ClickUp?

En användarrecension säger:

ClickUps mallar, anpassade fält, prioriteringar, scrum-poäng, planer och olika visningsalternativ har, trots en viss inlärningskurva, gjort det möjligt för vårt team att anpassa verktyget efter våra föränderliga behov och maximera effektiviteten. Dess kraftfulla integrationer med verktyg som Google Drive, möten, kalendrar och det robusta API-stödet förbättrar vårt arbetsflöde på ett smidigt sätt. Dessutom tillför ClickUp-formulären ett betydande mervärde till vår verksamhet. Sammantaget är allt i ClickUp så kraftfullt och användbart att jag inte vill ändra någonting. Jag är övertygad om att ClickUp har utvecklats med användarnas preferenser i åtanke, vilket gör det perfekt för våra behov.

Fördelen med ClickUp: Istället för att skriva kod för att ansluta din databas till en LLM, fungerar BrainGPT, en fristående AI-superapp från ClickUp, som ett modelloberoende gränssnitt som redan är anslutet till dina uppgifter, dokument och kodförvar.

Det gör att du kan:

OpenAI:s API-plattform är fortfarande den främsta konkurrenten för utvecklare som bygger komplexa, ”tänkande” applikationer. Med lanseringen av GPT-5. 2-serien har OpenAI gått mot ”Agentic Reasoning”, där modellen automatiskt pausar för att validera sin logik innan den svarar.

Till skillnad från Geminis täta integration med Google Workspace erbjuder OpenAI en mer modulär "Foundry"-strategi, vilket gör det till ett förstahandsval för utvecklare som vill ha en leverantörsneutral plattform som kan skalas över olika molnleverantörer som Azure och AWS.

Gemini 3 Flash erbjuder däremot betydligt snabbare videobearbetning och ett mycket större kontextfönster på 2 miljoner token, medan GPT-5. 2 för närvarande begränsar sin inbyggda kontext till 400 000 token.

OpenAI API:s bästa funktioner

Begränsningar för OpenAI API

Priser för OpenAI API

OpenAI API-betyg och recensioner

Vad säger verkliga användare om OpenAI?

En användarrecension säger:

Vi är mycket imponerade av AI-modellerna och särskilt API-åtkomsten. Genom att integrera OpenAI i våra CRM-lösningar (BROSH CRM) kan vi leverera verkligt, konkret värde till våra kunder genom AI-driven automatisering. OpenAI gör det möjligt för BROSH CRM att tillhandahålla avancerade AI-baserade funktioner inom flera områden. Våra kunder drar nytta av högkvalitativa, kontextmedvetna AI-svar i sina kommunikationskanaler, som genereras direkt från CRM-data. Detta förbättrar kundinteraktionerna dramatiskt samtidigt som det sparar tid och resurser.

📖 Läs mer: Hur du använder ChatGPT API för dina applikationer

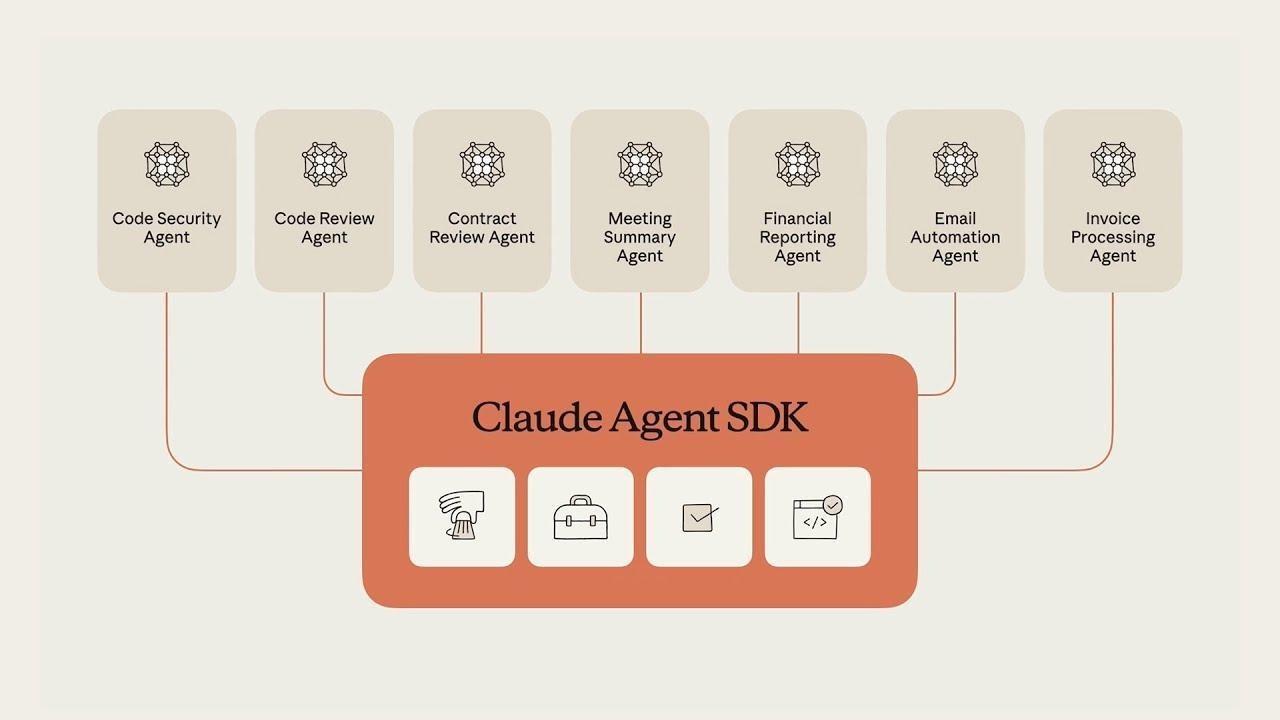

Claude, utvecklat av Anthropic, är det självklara alternativet för utvecklare som prioriterar teknisk noggrannhet och ”mänskligt” resonemang. Claude 4. 5 Sonnet anses allmänt vara den mest pålitliga modellen för mjukvaruutveckling och presterar konsekvent bättre än andra i kodningsbenchmarks som SWE-bench.

En av dess mest framstående funktioner är Claude Code, ett agentiskt CLI-verktyg som gör det möjligt för modellen att interagera direkt med din lokala terminal och ditt filsystem för att felsöka och skicka kod.

Gemini 3 Pro är utmärkt för att bearbeta stora mängder data på en gång (som en timmes video), men Claude föredras ofta för uppgifter där "känslan" och precisionen i resultatet är viktigare än den rena datamängden som bearbetas.

Claude API:s bästa funktioner

Begränsningar för Claude API

Priser för Claude API

Claude API-betyg och recensioner

Vad säger verkliga användare om Claude API?

En användarrecension säger:

Användningsavgiften för API:et är dyrare än ChatGPT eller Gemini, men om du bara vill ställa frågor kan du använda desktopversionen, så det är ingen stor sak. Det är dock inte det bästa alternativet om du vill integrera det i en app.

📖 Läs mer: Hur man använder Claude AI för effektiv och korrekt kodning

Mistral AI tillhandahåller högpresterande modeller som erbjuder ett alternativ till de ”slutna” systemen från Google och OpenAI. Det anses vara ledande för företag som kräver datasuveränitet eller vill distribuera modeller på sin egen privata infrastruktur.

Mistrals flaggskeppsmodeller, som Mistral Large 3, är utformade för att vara effektiva och "ofiltrerade", vilket ger utvecklare mer kontroll över modellens beteende jämfört med de strängare säkerhetsbarriärer som ofta finns i Gemini eller Claude.

Mistral AI:s bästa funktioner

Begränsningar för Mistral AI

Priser för Mistral AI

Mistral AI-betyg och recensioner

Vad säger verkliga användare om Mistral AI?

Jag frågade om en person från vårt lands historia. GEMINI kunde korrekt skilja mellan två mycket olika personer med samma för- och efternamn: den ena var historiker och universitetsprofessor, den andra var motståndskämpe som deporterades under andra världskriget. Mistral AI gav mig bara beskrivningen av den första personen.

Alternativa AI-verktyg att använda

Gemini API är ett multimodalt kraftpaket, men för att bygga en produktionsklar applikation krävs ofta en multimodellstrategi. Beroende på ditt projekts specifika behov av resonemangsdjup eller kodningsnoggrannhet kan du titta på dessa Gemini-alternativ.

1. ClickUp (Bäst för team som behöver en kontextmedveten AI integrerad i sitt arbetsflöde)

De flesta AI-verktyg lovar att underlätta utvecklingen, men ofta blir de bara ytterligare en flik i en redan överfull stapel. Du kanske använder Gemini API för att driva din apps backend, ett separat verktyg för att sammanfatta mötesanteckningar och en tredje plattform för att hantera dina sprintuppgifter. Detta nätverk av spridda sammanhang och isolerade verktyg är ”AI-spridning”.

ClickUp är den första konvergerade AI-arbetsytan som kopplar samman dina uppgifter, dokument och medarbetare med ett centralt intelligenslager. Till skillnad från fristående API:er som kräver att du bygger egna system för kontextåtervinning (RAG) känner ClickUp Brain redan till allt i din arbetsyta.

Eftersom AI är integrerat från början genererar det inte bara text – det förstår relationen mellan din Gemini API-dokumentation, dina projektdeadlines och ditt teams framsteg i realtid.

Aktivera ”Ask AI” var som helst och distribuera autonoma agenter

Den verkliga kraften i ClickUp ligger i dess förmåga att omvandla kunskap till handling. Med Brain Assistant kan du "fråga AI" var som helst i ditt arbetsutrymme – eller till och med via en desktop-kompanjon medan du skriver kod i din IDE. Du kan omedelbart upptäcka projektrisker genom att fråga: "Vad var feedbacken på den senaste Gemini 3 Pro-implementeringen?" ClickUp Brain kommer att göra en djupgående sökning i hela din historik och ge ett citerat svar med länkar till den exakta uppgiften eller kommentartråden där diskussionen ägde rum.

För team som bygger komplexa AI-produkter går ClickUp utöver enkel assistans genom att låta dig distribuera Super Agents . Dessa är kodfria, autonoma digitala teammedlemmar som hanterar det "rutinmässiga arbetet" i din utvecklingscykel. Du kan ställa in en Triage Agent för att övervaka inkommande buggar från din Gemini-integration, eller en Project Manager Agent som proaktivt identifierar sprintblockerare och genererar dagliga standup-sammanfattningar baserade på ditt teams aktivitet. Det är ett intelligent system som håller din utvecklingspipeline igång dygnet runt.

En enhetlig arbetshanteringsplattform för den moderna utvecklaren

ClickUp Docs fungerar som ditt teams gemensamma tekniska anteckningsbok. Oavsett om du utarbetar en PRD för en ny multimodal funktion eller lagrar dina Gemini API-säkerhetsprotokoll, förblir allt sammankopplat.

En kodrad i ett dokument kan omedelbart bli en uppgift, och ClickUp Brain låter dig utnyttja Enterprise Search för att hämta filer och konversationer från anslutna appar som Google Workspace, GitHub och Figma med hjälp av semantisk sökning.

Dessutom erbjuder ClickUp flexibilitet för flera modeller. Medan du bygger med Gemini API kan du använda ClickUps gränssnitt för att växla mellan Gemini 3, GPT-5. 2 och Claude 4. 5 för att jämföra resultat eller utkast till tekniska specifikationer. Detta säkerställer att du alltid har den bästa "hjärnan" för uppgiften utan att någonsin behöva lämna din projektledningsmiljö.

ClickUps bästa funktioner

- Universal Search & Ask AI: Hämta data direkt från ClickUp, Slack, GitHub och Drive, eller be AI att sammanfatta valfritt dokument eller uppgiftstråd från valfri plats i arbetsytan.

- Agenter utan kod: Använd agenter utan kod för att automatisera skapandet av uppgifter, statusuppdateringar och rapportering, och förvandla manuell projektledning till ett autonomt arbetsflöde.

- Integrerad AI-chatt: Nämn @Brain i valfri ClickUp-chattråd för att omedelbart omvandla en konversation till en formaterad uppgift eller för att få en sammanfattning av en lång diskussion.

- AI-drivna dashboards: Visualisera teamets hälsa med realtidsdashboards som använder AI för att identifiera sprintrisker, förutsäga förseningar och förklara datatrender på lättförståeligt språk.

- AI Writer for Docs: Skriv utkast till tekniska krav, SOP:er och mötesagendor som är förifyllda med specifika data och sammanhang för ditt projekt.

Begränsningar för ClickUp

- AI:ns effektivitet är kopplad till hur väl du sköter din arbetsplats. Om ditt team inte håller uppdatering av uppgifter och dokument har AI:n mindre "kontext" att utgå ifrån för sina svar.

ClickUp-priser

Betyg och recensioner för ClickUp

- G2: 4,7/5 (över 10 900 recensioner)

- Capterra: 4,6/5 (över 4 500 recensioner)

Vad säger verkliga användare om ClickUp?

En användarrecension säger:

ClickUps mallar, anpassade fält, prioriteringar, scrum-poäng, planer och olika visningsalternativ har, trots en viss inlärningskurva, gjort det möjligt för vårt team att anpassa verktyget efter våra föränderliga behov och maximera effektiviteten. Dess kraftfulla integrationer med verktyg som Google Drive, möten, kalendrar och det robusta API-stödet förbättrar vårt arbetsflöde på ett smidigt sätt. Dessutom tillför ClickUp-formulären ett betydande mervärde till vår verksamhet. Sammantaget är allt i ClickUp så kraftfullt och användbart att jag inte vill ändra någonting. Jag är övertygad om att ClickUp har utvecklats med användarnas preferenser i åtanke, vilket gör det perfekt för våra behov.

ClickUps mallar, anpassade fält, prioriteringar, scrum-poäng, planer och olika visningsalternativ har, trots en viss inlärningskurva, gjort det möjligt för vårt team att anpassa verktyget efter våra föränderliga behov och maximera effektiviteten. Dess kraftfulla integrationer med verktyg som Google Drive, möten, kalendrar och det robusta API-stödet förbättrar vårt arbetsflöde på ett smidigt sätt. Dessutom tillför ClickUp-formulären ett betydande mervärde till vår verksamhet. Sammantaget är allt i ClickUp så kraftfullt och användbart att jag inte vill ändra någonting. Jag är övertygad om att ClickUp har utvecklats med användarnas preferenser i åtanke, vilket gör det perfekt för våra behov.

Fördelen med ClickUp: Istället för att skriva kod för att ansluta din databas till en LLM, fungerar BrainGPT, en fristående AI-superapp från ClickUp, som ett modelloberoende gränssnitt som redan är anslutet till dina uppgifter, dokument och kodförvar.

Det gör att du kan:

- Växla mellan modeller: Använd Gemini 3 för stora kontextuppgifter med 2 miljoner token, och växla sedan till Claude 4. 5 för exakt kodningsprecision – allt i samma fönster.

- Enhetlig sökning: Fråga ”Vilka var de slutgiltiga API-säkerhetsspecifikationerna som diskuterades vid förra månadens möte?” och få ett välgrundat svar från Slack, GitHub och ClickUp Docs samtidigt.

- Talk-to-Text: Använd BrainGPT Desktop App för att diktera kommandon som ”Skapa ett Jira-ärende för Gemini-integrationen och tilldela det till huvudutvecklaren” – inget tangentbord krävs

2. OpenAI API (bäst för allmän intelligens och agentiska resonemang)

OpenAI:s API-plattform är fortfarande den främsta konkurrenten för utvecklare som bygger komplexa, ”tänkande” applikationer. Med lanseringen av GPT-5. 2-serien har OpenAI gått mot ”Agentic Reasoning”, där modellen automatiskt pausar för att validera sin logik innan den svarar.

Till skillnad från Geminis täta integration med Google Workspace erbjuder OpenAI en mer modulär "Foundry"-strategi, vilket gör det till ett förstahandsval för utvecklare som vill ha en leverantörsneutral plattform som kan skalas över olika molnleverantörer som Azure och AWS.

Gemini 3 Flash erbjuder däremot betydligt snabbare videobearbetning och ett mycket större kontextfönster på 2 miljoner token, medan GPT-5. 2 för närvarande begränsar sin inbyggda kontext till 400 000 token.

OpenAI API:s bästa funktioner

- Använd Thinking Mode för att hantera komplexa problem i flera steg som kräver intern verifiering innan ett slutgiltigt svar genereras.

- Få tillgång till Realtime API för att bygga multimodala upplevelser med låg latens, inklusive inbyggda tal-till-tal-interaktioner.

- Utnyttja File Search API (Vector Store) för att bygga RAG-system (Retrieval-Augmented Generation) med inbyggd dokumenthantering.

Begränsningar för OpenAI API

- Användningen kan snabbt bli dyr om den inte övervakas noggrant, särskilt när man använder modeller med hög resonemangsförmåga som GPT-5. 2 Pro

Priser för OpenAI API

- GPT-5. 2: 1,75 $/1 miljon inmatningar | 14,00 $/1 miljon utmatningar

- GPT-5. 2 Pro: 21,00 $/1 miljon inmatningar | 168,00 $/1 miljon utmatningar

- GPT-5 Mini: 0,25 $/1 miljon inmatningar | 2,00 $/1 miljon utmatningar

OpenAI API-betyg och recensioner

- G2: 4,7/5 (840+ recensioner)

- Gartner Peer Insights: 4,4/5 (över 60 recensioner)

Vad säger verkliga användare om OpenAI?

En användarrecension säger:

Vi är mycket imponerade av AI-modellerna och särskilt API-åtkomsten. Genom att integrera OpenAI i våra CRM-lösningar (BROSH CRM) kan vi leverera verkligt, konkret värde till våra kunder genom AI-driven automatisering. OpenAI gör det möjligt för BROSH CRM att tillhandahålla avancerade AI-baserade funktioner inom flera områden. Våra kunder drar nytta av högkvalitativa, kontextmedvetna AI-svar i sina kommunikationskanaler, som genereras direkt från CRM-data. Detta förbättrar kundinteraktionerna dramatiskt samtidigt som det sparar tid och resurser.

Vi är mycket imponerade av AI-modellerna och särskilt API-åtkomsten. Genom att integrera OpenAI i våra CRM-lösningar (BROSH CRM) kan vi leverera verkligt, konkret värde till våra kunder genom AI-driven automatisering. OpenAI gör det möjligt för BROSH CRM att tillhandahålla avancerade AI-baserade funktioner inom flera områden. Våra kunder drar nytta av högkvalitativa, kontextmedvetna AI-svar i sina kommunikationskanaler, som genereras direkt från CRM-data. Detta förbättrar kundinteraktionerna dramatiskt samtidigt som det sparar tid och resurser.

3. Claude API (bäst för kodning med höga insatser och nyanserad teknisk skrivning)

Claude, utvecklat av Anthropic, är det självklara alternativet för utvecklare som prioriterar teknisk noggrannhet och ”mänskligt” resonemang. Claude 4. 5 Sonnet anses allmänt vara den mest pålitliga modellen för mjukvaruutveckling och presterar konsekvent bättre än andra i kodningsbenchmarks som SWE-bench.

En av dess mest framstående funktioner är Claude Code, ett agentiskt CLI-verktyg som gör det möjligt för modellen att interagera direkt med din lokala terminal och ditt filsystem för att felsöka och skicka kod.

Gemini 3 Pro är utmärkt för att bearbeta stora mängder data på en gång (som en timmes video), men Claude föredras ofta för uppgifter där "känslan" och precisionen i resultatet är viktigare än den rena datamängden som bearbetas.

Claude API:s bästa funktioner

- Underhåll komplex projektlogik med Claude Projects, som låter dig gruppera relaterade dokument och kod för bättre sammanhang.

- Använd Prompt Caching för att avsevärt minska kostnaderna och latensen för repetitiva förfrågningar med hög volym.

- Kör och testa kod i realtid i modellens miljö med hjälp av analysverktyget (kodkörning).

Begränsningar för Claude API

- Claude saknar för närvarande inbyggda verktyg för bild- eller videogenerering, vilket kräver att utvecklare integrerar med tredjeparts-API:er för visuellt kreativt arbete.

Priser för Claude API

- Claude 4. 5 Opus: 15,00 $/1 miljon inmatningar | 75,00 $/1 miljon utmatningar

- Claude 4. 5 Sonnet: 3,00 $/1 miljon inmatningar | 15,00 $/1 miljon utmatningar

- Claude 4. 5 Haiku: 1,00 $/1 miljon inmatningar | 5,00 $/1 miljon utmatningar

Claude API-betyg och recensioner

- G2: 4,4/5 (55+ recensioner)

- Capterra: 4,6/5 (över 20 recensioner)

Vad säger verkliga användare om Claude API?

En användarrecension säger:

Användningsavgiften för API:et är dyrare än ChatGPT eller Gemini, men om du bara vill ställa frågor kan du använda desktopversionen, så det är ingen stor sak. Det är dock inte det bästa alternativet om du vill integrera det i en app.

Användningsavgiften för API:et är dyrare än ChatGPT eller Gemini, men om du bara vill ställa frågor kan du använda desktopversionen, så det är ingen stor sak. Det är dock inte det bästa alternativet om du vill integrera det i en app.

4. Mistral AI (Bäst för öppen flexibilitet och datasuveränitet)

Mistral AI tillhandahåller högpresterande modeller som erbjuder ett alternativ till de ”slutna” systemen från Google och OpenAI. Det anses vara ledande för företag som kräver datasuveränitet eller vill distribuera modeller på sin egen privata infrastruktur.

Mistrals flaggskeppsmodeller, som Mistral Large 3, är utformade för att vara effektiva och "ofiltrerade", vilket ger utvecklare mer kontroll över modellens beteende jämfört med de strängare säkerhetsbarriärer som ofta finns i Gemini eller Claude.

Mistral AI:s bästa funktioner

- Distribuera modeller på din egen hårdvara eller VPC (Virtual Private Cloud) för maximal dataintegritet och säkerhet.

- Använd Mistral Memories för att spara och återkalla viktig kontext mellan olika sessioner utan att manuellt behöva skicka data på nytt.

- Gå till Connectors Directory för att enkelt länka dina modeller till externa datakällor som Notion, GitHub och Slack.

Begränsningar för Mistral AI

- Dokumentationen och community-supporten för Mistral är inte lika omfattande som för Google eller OpenAI, vilket kan leda till en brantare inlärningskurva för nya utvecklare.

Priser för Mistral AI

- Mistral Large 3: 2,00 $/1 miljon inmatningar | 6,00 $/1 miljon utmatningar

- Mistral Small: 0,20 $/1 miljon inmatningar | 0,60 $/1 miljon utmatningar

- Mistral Free: Begränsad API-åtkomst för testning

Mistral AI-betyg och recensioner

- G2: 4,4/5 (Begränsat antal initiala recensioner)

- Capterra: 4,5/5 (Begränsat antal initiala recensioner)

Vad säger verkliga användare om Mistral AI?

Jag frågade om en person från vårt lands historia. GEMINI kunde korrekt skilja mellan två mycket olika personer med samma för- och efternamn: den ena var historiker och universitetsprofessor, den andra var motståndskämpe som deporterades under andra världskriget. Mistral AI gav mig bara beskrivningen av den första personen.

Jag frågade om en person från vårt lands historia. GEMINI kunde korrekt skilja mellan två mycket olika personer med samma för- och efternamn: den ena var historiker och universitetsprofessor, den andra var motståndskämpe som deporterades under andra världskriget. Mistral AI gav mig bara beskrivningen av den första personen.

API:er på ett enkelt sätt med ClickUp

Det är enkelt att komma igång med Google Gemini API: du skaffar en nyckel, installerar ett SDK och gör ditt första API-anrop. Men när du går från ett enkelt skript till en produktionsapplikation dyker de verkliga utmaningarna upp – att hantera nycklar, dokumentera uppmaningar och hålla ordning på ditt teams arbete.

Gemini API erbjuder kraftfulla AI-funktioner, men att integrera det i ditt arbetsflöde kan leda till spridd dokumentation, fragmenterad projektuppföljning och oändliga kontextbyten.

Team som centraliserar sin AI-utveckling tillsammans med sin uppgiftshantering och dokumentation arbetar snabbare och behåller ett bättre sammanhang. Valet av var du organiserar detta arbete avgör hur effektivt du kan innovera och samarbeta.

Kom igång gratis med ClickUp och upplev hur en konvergerad arbetsyta kan förändra din AI-utvecklingsprocess.

Vanliga frågor om Gemini API

Ja, Google erbjuder en generös gratistjänst för Gemini 3 Flash och Pro via Google AI Studio. Specialiserade verktyg som Google Search Grounding är dock avgiftsbelagda (14 USD/1 000 sökningar) efter de första 5 000 sökningarna varje månad.

Google AI Studio är ett webbaserat verktyg för att experimentera med promptar och snabbt generera API-nycklar. Gemini API är det programmatiska gränssnittet som du använder i din kod för att bygga in dessa AI-funktioner i dina egna applikationer.

Ja, Gemini API stöder konversationer med flera turer, vilket gör det till ett utmärkt val för att bygga interna chattbottar, kundsupportbottar eller teamassistenter. Du skulle använda API:et som chattbottens "hjärna" och bygga användargränssnittet separat.

Hastighetsbegränsningarna varierar beroende på vilken modell du använder och om du har ett gratis eller betalt abonnemang. Det gratis abonnemanget har lägre begränsningar för förfrågningar per minut, medan betalda abonnemang erbjuder högre genomströmning för produktionsapplikationer.