Tiềm năng của AI là vô cùng lớn, nhưng đối với nhiều nhà lãnh đạo CNTT, nó đang trở thành một cơn ác mộng về tuân thủ và bảo mật. Để làm sáng tỏ khoảng cách này, chúng tôi đã tiến hành một cuộc khảo sát toàn diện với hơn 200 nhân viên có trình độ chuyên môn.

Kết quả nghiên cứu của chúng tôi cho thấy các tổ chức đang đầu tư mạnh mẽ, nhưng thường thiếu các biện pháp kiểm soát cần thiết, dẫn đến những rủi ro bảo mật nghiêm trọng và các hậu quả khác của sự phát triển không kiểm soát của AI.

các phát hiện khóa từ cuộc khảo sát của chúng tôi*:

- 79,6% các nhóm không có chính sách rõ ràng về việc sử dụng các công cụ AI không được ủy quyền

- 60% nhân viên thừa nhận sử dụng các công cụ AI không được phép, và 68% lãnh đạo biết điều này đang xảy ra

- Trong 44% các nhóm, không có ai chịu tài khoản chính thức về hậu quả của kết quả AI xấu

- Hơn 42% các công ty không tự tin rằng họ có thể vượt qua một cuộc kiểm toán bảo mật của nhà cung cấp ngày nay

Sự lan rộng của AI không chỉ gây lãng phí mà còn là rủi ro bảo mật và tài khoản nghiêm trọng.

Giải pháp nằm ở việc áp dụng AI bảo mật, thống nhất và có thể kiểm toán, được hỗ trợ bởi các tiêu chuẩn mới nổi như ISO 42001—tiêu chuẩn quốc tế đầu tiên dành riêng cho Hệ thống Quản lý Trí tuệ Nhân tạo (AIMS).

ClickUp tự hào là một trong những nền tảng đầu tiên đạt chứng nhận ISO 42001. Chứng nhận nghiêm ngặt này thể hiện commitment của chúng tôi trong việc áp dụng các thực hành AI bảo mật, minh bạch và đạo đức trên tất cả các giải pháp của mình.

Bằng cách tham gia cuộc họp các yêu cầu của ISO 42001, ClickUp đảm bảo tổ chức của bạn được hưởng lợi từ AI vừa sáng tạo vừa tuân thủ. Chứng nhận của chúng tôi cung cấp sự đảm bảo có thể kiểm chứng rằng dữ liệu và quy trình làm việc của bạn được bảo vệ bởi các tiêu chuẩn cao nhất trong ngành. Với ClickUp, bạn có thể tin tưởng rằng công việc được hỗ trợ bởi AI của mình được quản lý một cách có trách nhiệm, mang lại cho bạn lợi thế cạnh tranh trong bối cảnh kỹ thuật số ngày nay.

Tại sao AI không được ủy quyền là mối đe dọa đối với doanh nghiệp của bạn?

Các vi phạm nghiêm trọng về quản trị dữ liệu và tuân thủ là hậu quả trực tiếp của việc sử dụng AI không được phép: 60% nhân viên thừa nhận sử dụng AI không được phép để hoàn thành công việc nhanh hơn.

Chi phí không chỉ là các khoản phạt tiềm năng; đó là sự suy giảm niềm tin, bảo mật dữ liệu bị đe dọa và mất kiểm soát cơ bản đối với tài sản kỹ thuật số của bạn.

Điều này xuất phát từ cách tiếp cận hỗn loạn và không được quản lý đối với AI – mà không có khung quản trị AI có cấu trúc:

- 49,8% nhân viên mô tả chính sách AI của nhóm mình là “The Wild West”

- Có tới 29,8% doanh nghiệp đang hoạt động theo phương pháp rủi ro “Không hỏi, không nói”

Các nhà lãnh đạo nhận thức được rủi ro tồn tại, nhưng họ thiếu nguồn lực để khắc phục chúng:

- 33. 17% cho rằng nhóm của họ chắc chắn không phải là ngoại lệ đối với các vi phạm này

- 35,12% cho biết nhóm của họ có khả năng không phải là trường hợp ngoại lệ

Để đối phó với mối đe dọa từ sự phát triển không kiểm soát của AI, các nhà lãnh đạo CNTT cần có chiến lược quản trị AI chủ động — không phải là các lệnh cấm toàn diện. Xây dựng phương pháp giảm thiểu rủi ro phù hợp với các khung tiêu chuẩn như ISO 42001 là yếu tố quan trọng để cân bằng giữa đổi mới và kiểm soát.

AI không có tài khoản trách nhiệm là một canh bạc về tuân thủ

Sự thiếu kiểm soát này dẫn đến tình trạng thiếu tài khoản đáng sợ và nỗi lo thực sự về việc bị phát hiện không chuẩn bị sẵn sàng bởi khách hàng hoặc cơ quan quản lý. Nếu không có quản trị AI có trách nhiệm rõ ràng, các kinh doanh phải đối mặt với rủi ro tuân thủ AI ngày càng gia tăng và thiếu tính truy vết trong quá trình ra quyết định dựa trên AI.

Đối với những hậu quả không mong muốn do lời khuyên sai lệch hoặc kết quả đầu ra thiên vị từ AI, 44% các nhóm cho biết không ai sẽ chịu tài khoản chính thức.

Ngoài thực tế đáng lo ngại này, sự lan rộng của AI khiến việc theo dõi các quyết định của AI, chứng minh việc sử dụng đạo đức hoặc thậm chí vượt qua một cuộc kiểm toán bảo mật một cách tự tin trở nên gần như bất khả thi.

hơn 42% các nhóm không tự tin rằng họ có thể vượt qua một cuộc kiểm toán về các thực hành AI bảo mật hiện nay*.

Quản trị AI chủ động không còn là lựa chọn. Các tiêu chuẩn như ISO 42001 cung cấp khung khổ quan trọng cho tính minh bạch và trách nhiệm tài khoản, trực tiếp đối phó với các rủi ro tuân thủ do sự phát triển không kiểm soát của AI.

*tăng cường năng lực cho nhân viên mà không làm ảnh hưởng đến bảo mật

Các nhân viên đang tận dụng AI vì nó thực sự nâng cao năng suất của họ. Việc cấm sử dụng AI một cách tuyệt đối sẽ dẫn đến mâu thuẫn nội bộ và sự lan rộng của AI trong hệ thống CNTT ngầm. Thay vào đó, các tổ chức cần thúc đẩy việc áp dụng AI bảo mật thông qua các chính sách rõ ràng, thực hành AI đạo đức và khả năng hiển thị việc sử dụng các công cụ AI không được phép.

82% lãnh đạo dự đoán sẽ có khiếu nại từ nhân viên nếu các trang web AI không được ủy quyền bị khối đơn giản.

Ưu tiên của người lao động rất rõ ràng:

- 42. 44% ưu tiên tốc độ và hiệu quả

- 14. 63% ưu tiên chính sách công ty và bảo mật

- 42. 93% ưu tiên cả hai

Họ đòi hỏi một giải pháp không buộc phải đánh đổi giữa tốc độ và bảo mật.

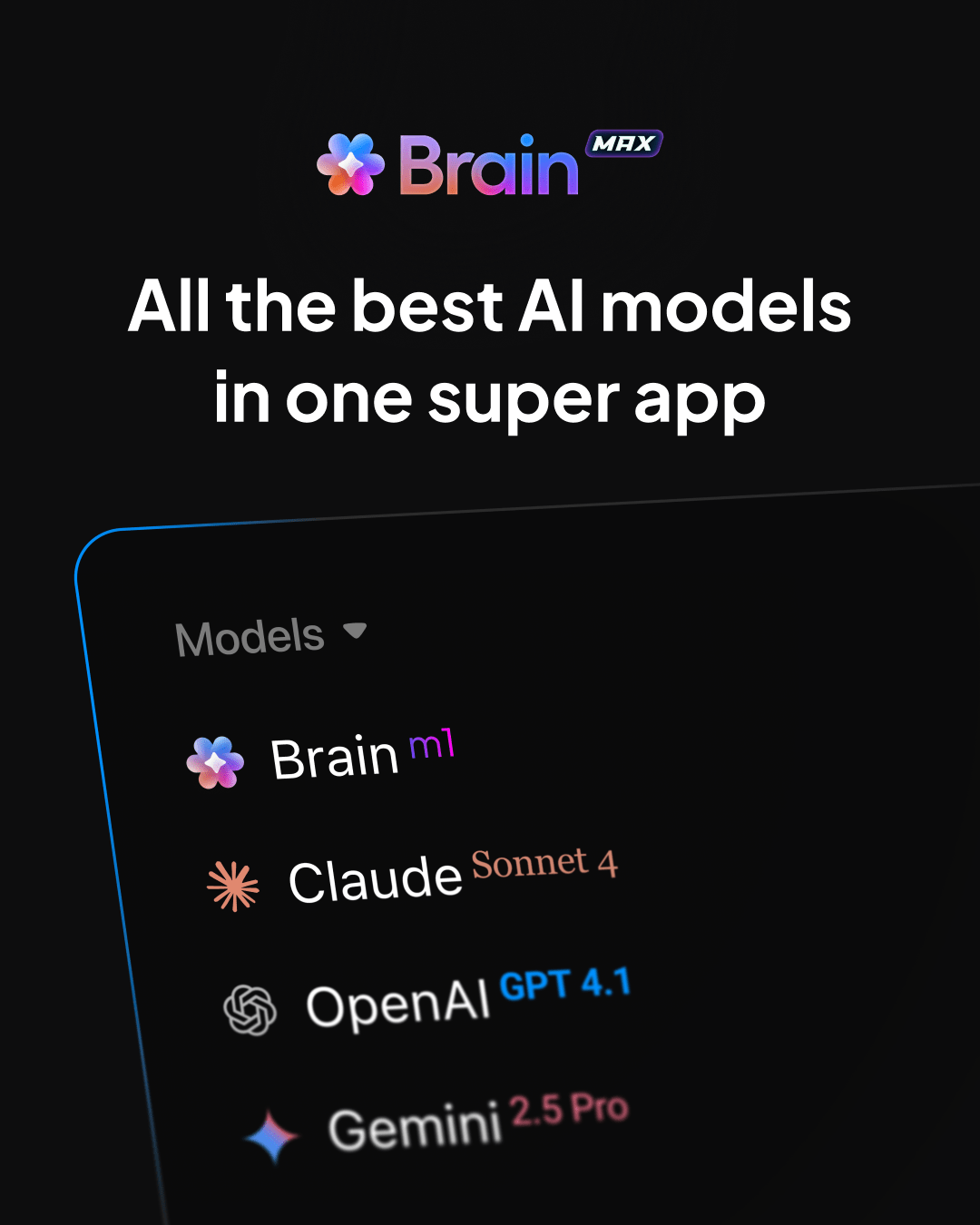

Giải pháp lý tưởng ẩn đi sự phức tạp của tất cả các mô hình ngôn ngữ lớn (LLMs) phía sau vào một thỏa thuận duy nhất với một nhà cung cấp. Nhà cung cấp sẽ xử lý, thông qua hợp đồng và ứng dụng của họ, tất cả sự phức tạp trong việc cài đặt một tiêu chuẩn AI duy nhất. Chúng ta không cần lo lắng về tất cả các chi tiết cụ thể của các LLMs hoặc mô hình. Thật tuyệt vời.

Giải pháp lý tưởng ẩn đi sự phức tạp của tất cả các mô hình ngôn ngữ lớn (LLMs) phía sau vào một thỏa thuận duy nhất với một nhà cung cấp. Nhà cung cấp sẽ xử lý, thông qua hợp đồng và ứng dụng của họ, tất cả sự phức tạp trong việc cài đặt một tiêu chuẩn AI duy nhất. Chúng ta không cần lo lắng về tất cả các chi tiết cụ thể của các LLMs hoặc mô hình. Thật tuyệt vời.

Điều này nhấn mạnh nhu cầu cấp thiết về một công cụ đáng tin cậy, thống nhất giúp đơn giản hóa việc quản lý AI cho các nhóm IT và bảo mật, cho phép các nhóm sáng tạo mà không gây ra rủi ro không thể chấp nhận được.

Từ hỗn loạn đến tuân thủ

Thời đại của sự phát triển không kiểm soát của AI đang kết thúc. Đã đến lúc đưa quyền kiểm soát trở lại cho bộ phận CNTT:

❌ DỪNG LẠI: Phụ thuộc vào việc áp dụng các công cụ AI một cách tùy tiện và hy vọng mọi thứ sẽ ổn, cho phép sự lan rộng của AI tạo ra các điểm mù tuân thủ không thể kiểm soát.

❌ DỪNG LẠI: Áp dụng các lệnh cấm toàn diện đối với AI, điều này làm suy giảm năng suất và thúc đẩy việc sử dụng công nghệ thông tin không chính thức.

❌ DỪNG LẠI: Đánh giá các công cụ AI tạm thời cho các nhóm khác nhau, khiến việc quản trị hiệu quả gần như không thể.

✅ BẮT ĐẦU: Triển khai một nền tảng AI thống nhất tích hợp mượt mà vào các quy trình làm việc hiện có và cung cấp khả năng sẵn sàng kiểm toán, kiểm soát rủi ro và giám sát cần thiết cho tuân thủ quy định—tất cả đều là những trụ cột quan trọng của khung quản trị AI hiện đại

✅ BẮT ĐẦU: Ưu tiên bảo mật AI ngay từ đầu. Tích hợp các biện pháp bảo mật mạnh mẽ vào chiến lược AI của bạn ngay từ ngày đầu tiên, thay vì coi đó là một việc làm sau này.

✅ BẮT ĐẦU: Ưu tiên các giải pháp AI cung cấp bảo mật cấp doanh nghiệp và trách nhiệm giải trình có thể kiểm toán, như những giải pháp tuân thủ ISO 42001.

Đây chính là lý do tại sao ClickUp được thiết kế khác biệt. Chúng tôi hiểu rằng các nhà lãnh đạo CNTT cần hơn một công cụ AI thông thường; họ cần một Hệ thống Quản lý AI toàn diện được thiết kế để loại bỏ sự phát triển không kiểm soát và đảm bảo tuân thủ.

clickUp hiện đã đạt chứng nhận ISO 42001, cài đặt tiêu chuẩn mới cho AI đáng tin cậy trong môi trường làm việc. * Chứng nhận này cung cấp sự đảm bảo có thể kiểm chứng rằng nền tảng của chúng tôi cung cấp bảo mật dữ liệu, tài khoản và các thực hành AI có trách nhiệm mà các nhà lãnh đạo CNTT đang rất cần, thông qua khung quản trị AI đáng tin cậy đáp ứng các tiêu chuẩn tuân thủ quy định toàn cầu.

Hướng đi phía trước

sự mở rộng không kiểm soát của AI *đặt ra một thách thức nguy hiểm cho các doanh nghiệp hiện đại, đặc biệt là đối với các nhà lãnh đạo CNTT.

Theo tôi, càng ít nhà cung cấp càng tốt… Mỗi nhà cung cấp đều gây ra thêm thời gian, chi phí, phức tạp. Thật tệ.

Theo tôi, càng ít nhà cung cấp càng tốt… Mỗi nhà cung cấp đều gây ra thêm thời gian, chi phí, phức tạp. Thật tệ.

Đây là lý do: Nghiên cứu của chúng tôi cho thấy nhân viên đang sử dụng AI không được ủy quyền để tăng năng suất. Tuy nhiên, sự thiếu hụt nghiêm trọng về trách nhiệm giải trình và khả năng kiểm toán khiến kinh doanh của bạn đối mặt với nguy cơ vi phạm tuân thủ và bảo mật.

đây là những gì bạn cần làm:* Con đường phía trước không phải là hạn chế, mà là kiểm soát chiến lược. Giải pháp là tập trung AI vào một nền tảng thống nhất duy nhất, là nhà cung cấp cả năng suất mà nhân viên yêu cầu và quản trị cấp doanh nghiệp mà lãnh đạo cần.

giải pháp của ClickUp: ClickUp được thiết kế để loại bỏ sự lan rộng của AI. Là một trong những nền tảng đầu tiên đạt được chứng nhận ISO 42001*, chúng tôi không chỉ cung cấp AI mạnh mẽ mà còn là nhà cung cấp Hệ thống Quản lý AI có thể xác minh. Chứng nhận này đảm bảo rằng ClickUp mang lại bảo mật, tài khoản và khung khổ có trách nhiệm để biến hỗn loạn thành lợi thế chiến lược đáng tin cậy.

Hành động ngay hôm nay

tìm hiểu thêm về ClickUp Brain *

Đây là AI duy nhất được chứng nhận ISO 42001 có khả năng kết nối xuyên suốt toàn bộ công việc của bạn

📺 Truy cập webinar theo yêu cầu và tài liệu hướng dẫn

Xem cách các nhóm hàng đầu đang loại bỏ sự phát triển không kiểm soát của AI và đạt được lợi nhuận thực sự.

Sẵn sàng tìm hiểu cách ClickUp có thể trở thành nhà cung cấp giải pháp AI bảo mật, thống nhất mà nhóm của bạn cần, được hỗ trợ bởi tiêu chuẩn ISO 42001? Đặt lịch tư vấn miễn phí ngay hôm nay.

Ghi chú về phương pháp nghiên cứu: Dữ liệu cho báo cáo này được thu thập trong vòng hai kỳ vào cuối tháng 7 năm 2025. Khảo sát, bao gồm 10 câu hỏi trắc nghiệm, được thực hiện ẩn danh với hơn 200 người tham gia. Các đối tượng tham gia đại diện cho sự kết hợp cân bằng giữa các vai trò chuyên môn, từ lãnh đạo cấp cao và quản lý đến nhân viên làm việc độc lập và doanh nhân. Để biết thêm chi tiết về phương pháp nghiên cứu và kết quả chi tiết, vui lòng liên hệ research@ClickUp.com.